Aprendizaje autosupervisado para eliminar el ruido de las imágenes

Descubra cómo el aprendizaje autosupervisado elimina el ruido de las imágenes y mejora su nitidez mediante técnicas de IA para fotografía, medicina y sistemas de visión.

Descubra cómo el aprendizaje autosupervisado elimina el ruido de las imágenes y mejora su nitidez mediante técnicas de IA para fotografía, medicina y sistemas de visión.

Las imágenes forman parte de nuestra vida cotidiana, desde las fotos que hacemos hasta los vídeos grabados por cámaras en lugares públicos. Contienen información muy valiosa, y la tecnología punta permite analizar e interpretar estos datos.

En concreto, la visión por ordenador, una rama de la inteligencia artificial (IA), permite a las máquinas procesar la información visual y comprender lo que ven, de forma muy parecida a como lo hacen los humanos. Sin embargo, en las aplicaciones del mundo real, las imágenes distan mucho de ser perfectas.

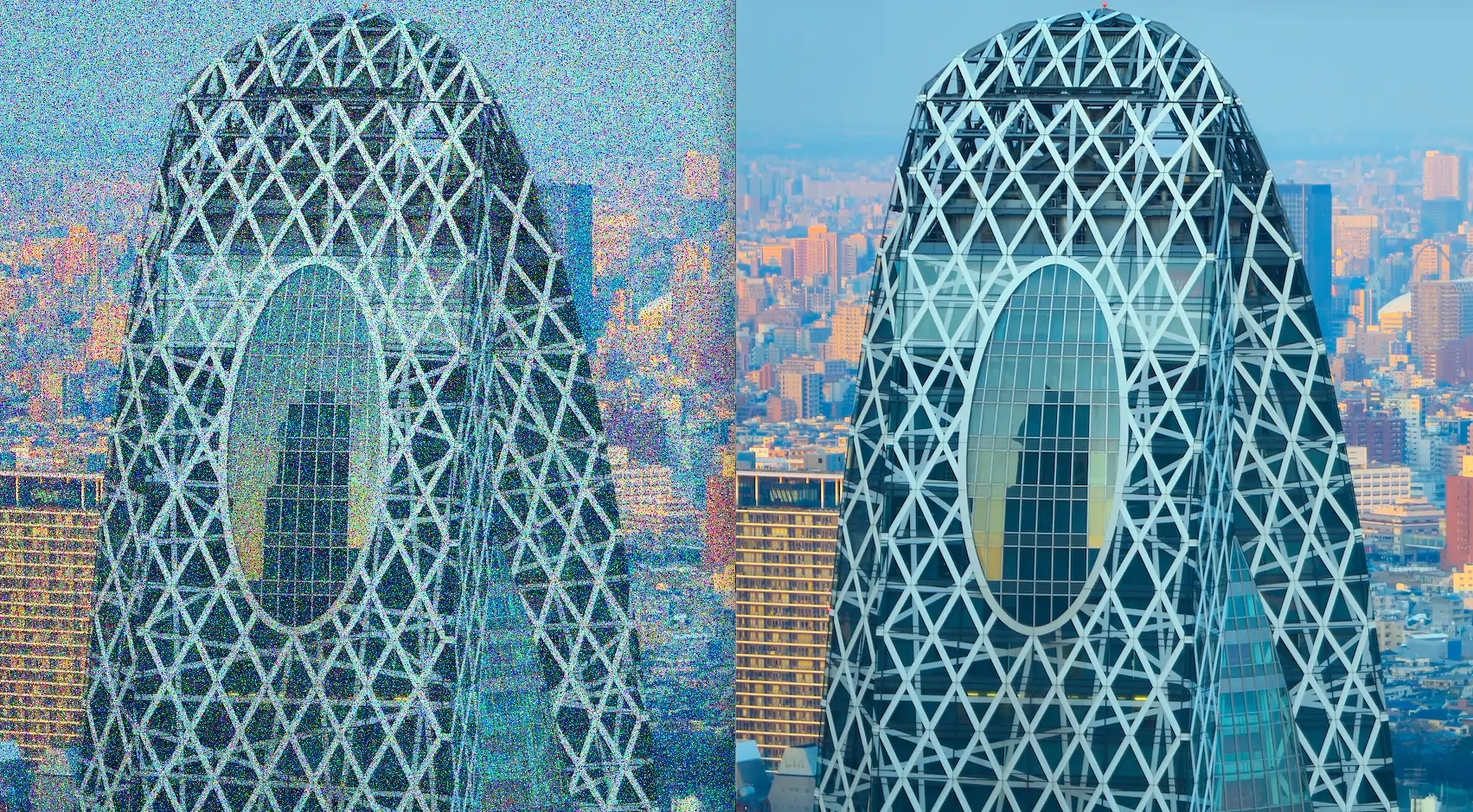

El ruido de las imágenes causado por la lluvia, el polvo, la poca luz o las limitaciones del sensor puede ocultar detalles importantes, lo que dificulta a los modelos de Vision AI la detect objetos o la interpretación precisa de las escenas. La eliminación del ruido de las imágenes ayuda a reducirlo, lo que permite a los modelos de Vision AI ver los detalles con más claridad y hacer mejores predicciones.

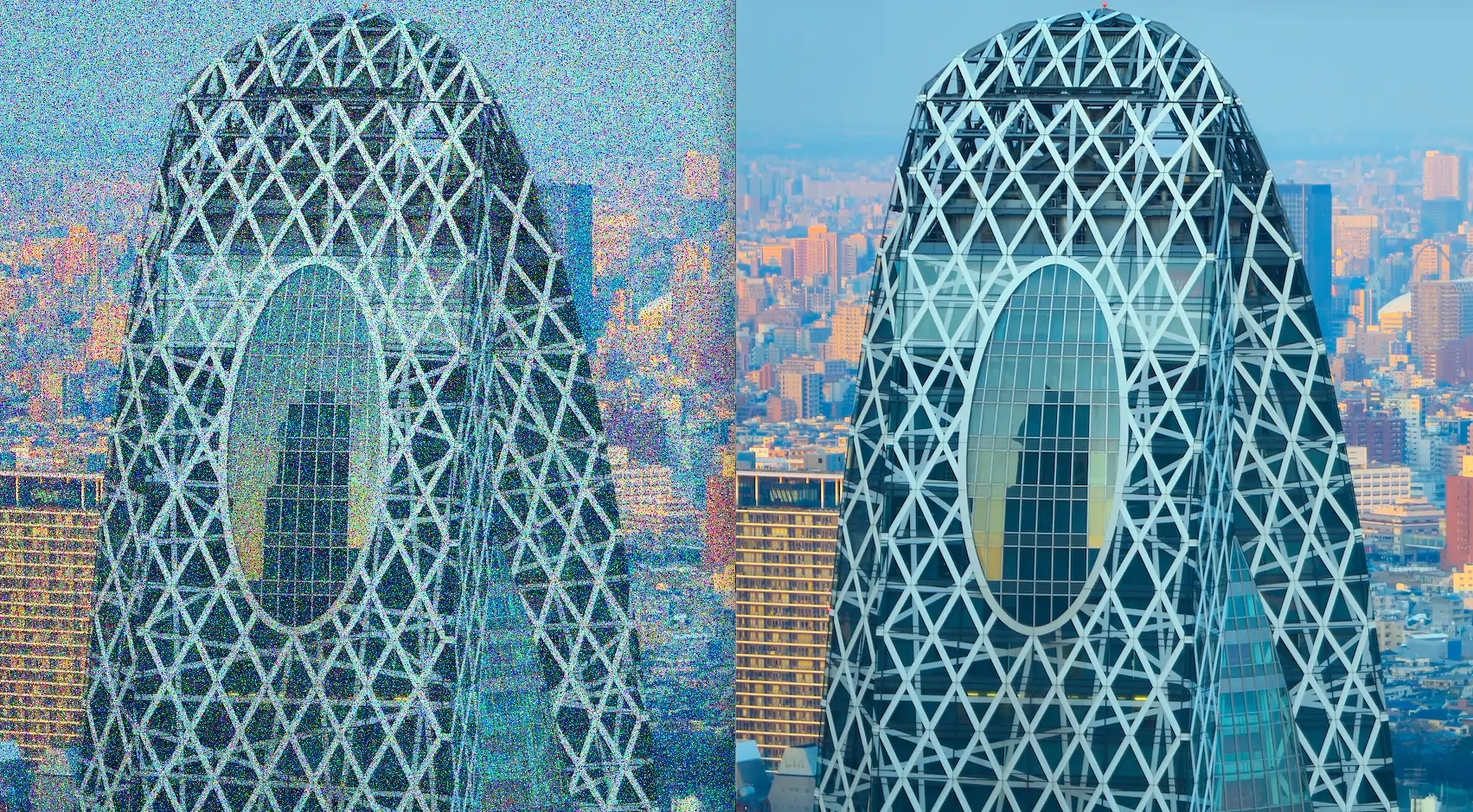

Tradicionalmente, la eliminación del ruido de las imágenes se ha basado en el aprendizaje supervisado, en el que los modelos se entrenan utilizando pares de imágenes limpias y ruidosas para aprender a eliminar el ruido. Sin embargo, recopilar imágenes de referencia perfectamente limpias no siempre es práctico.

Para hacer frente a este reto, los investigadores han desarrollado eliminadores de ruido de imágenes autosupervisados. Su objetivo es entrenar modelos de IA para que aprendan directamente de los datos, creando sus propias señales de aprendizaje para eliminar el ruido y conservar los detalles importantes sin necesidad de imágenes de referencia limpias.

En este artículo analizaremos los desenotificadores de imágenes autosupervisados, su funcionamiento, las técnicas clave que los sustentan y sus aplicaciones en el mundo real. Comencemos.

Las imágenes ruidosas pueden dificultar a los modelos de Vision AI la interpretación de lo que hay en una foto. Una foto tomada en condiciones de poca luz, por ejemplo, puede aparecer granulada o borrosa, ocultando características sutiles que ayudan a un modelo a identificar objetos con precisión.

En la eliminación de ruido basada en el aprendizaje supervisado, los modelos se entrenan utilizando pares de imágenes, una con ruido y otra limpia, para aprender a eliminar el ruido no deseado. Aunque este método funciona bien, recopilar datos de referencia perfectamente limpios suele llevar mucho tiempo y es difícil en el mundo real.

Por eso los investigadores han recurrido a la eliminación de ruido de imágenes con autosupervisión. La eliminación de ruido de imágenes autosupervisada se basa en el concepto de aprendizaje autosupervisado, en el que los modelos se enseñan a sí mismos creando sus propias señales de aprendizaje a partir de los datos.

Como este método no depende de grandes conjuntos de datos etiquetados, la eliminación de ruido autosupervisada es más rápida, más escalable y más fácil de aplicar en ámbitos como la fotografía con poca luz, las imágenes médicas y el análisis de imágenes de satélite, donde a menudo no se dispone de imágenes de referencia limpias.

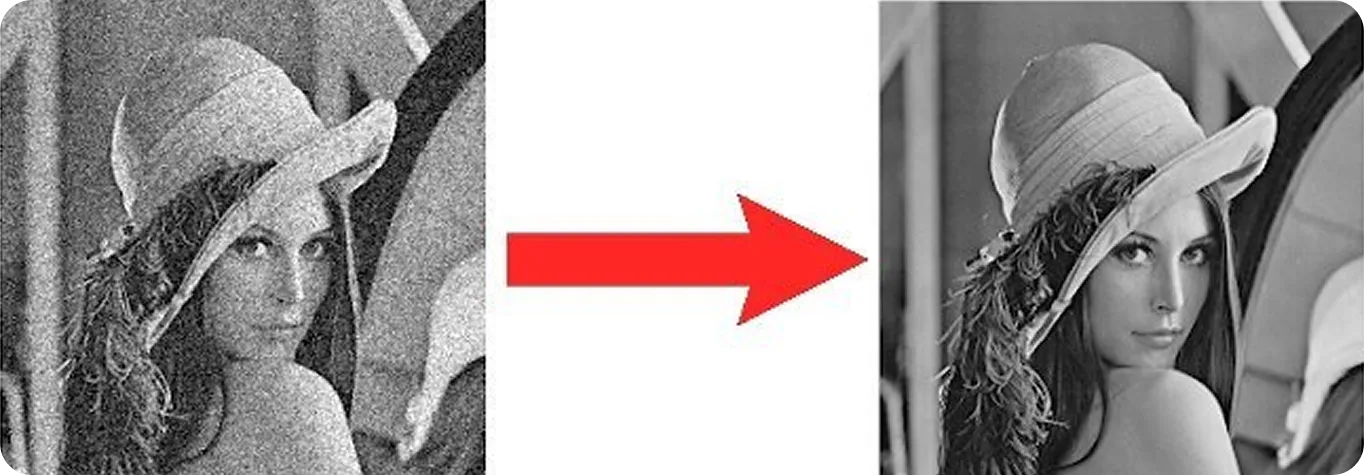

En lugar de basarse en imágenes de referencia limpias, este enfoque se entrena directamente en datos ruidosos mediante la predicción de píxeles enmascarados o la reconstrucción de partes perdidas. De este modo, el modelo aprende a distinguir entre los detalles significativos de la imagen y el ruido aleatorio, lo que se traduce en resultados más claros y precisos.

Aunque pueda parecer similar al aprendizaje no supervisado, el aprendizaje autosupervisado es en realidad un caso especial de éste. La distinción clave es que en el aprendizaje autosupervisado, el modelo crea sus propias etiquetas o señales de entrenamiento a partir de los datos para aprender una tarea específica. En cambio, el aprendizaje no supervisado se centra en encontrar patrones o estructuras ocultas en los datos sin ninguna tarea explícita ni objetivo predefinido.

Con respecto a la eliminación de ruido autosupervisada, hay varias formas de aprendizaje. Algunos modelos de eliminación de ruido con autosupervisión rellenan los píxeles enmascarados o que faltan, mientras que otros comparan varias versiones ruidosas de la misma imagen para encontrar detalles coherentes.

Por ejemplo, un método popular conocido como aprendizaje de puntos ciegos se centra en entrenar el modelo de eliminación de ruido para que ignore el píxel que está reconstruyendo y se base en el contexto circundante. Con el tiempo, el modelo reconstruye imágenes de alta calidad conservando texturas, bordes y colores esenciales.

A continuación, exploraremos el proceso por el que el aprendizaje autosupervisado elimina el ruido.

El proceso de eliminación de ruido autosupervisado suele comenzar con la introducción de imágenes ruidosas en el modelo de eliminación de ruido. El modelo analiza los píxeles cercanos para estimar qué aspecto debería tener cada píxel poco claro o enmascarado, aprendiendo gradualmente a distinguir entre el ruido y los detalles visuales reales.

Consideremos una imagen de un cielo oscuro y granulado. El modelo observa las estrellas cercanas y los patrones circundantes para predecir el aspecto que debería tener cada zona ruidosa sin ruido. Al repetir este proceso en toda la imagen, aprende a separar el ruido aleatorio de las características significativas, produciendo un resultado más claro y preciso.

En otras palabras, el modelo predice una versión más limpia de la imagen basándose en el contexto, sin necesitar nunca una referencia perfectamente limpia. Este proceso puede llevarse a cabo utilizando distintos tipos de modelos, cada uno de ellos con sus propios puntos fuertes a la hora de tratar el ruido.

A continuación se describen los tipos de modelos utilizados habitualmente para la eliminación de ruido de imágenes con autosupervisión:

El entrenamiento de estos modelos con imágenes tomadas con distintas iluminaciones y ajustes ISO les ayuda a funcionar bien en muchas situaciones del mundo real. En las cámaras digitales, los ajustes ISO controlan cuánto ilumina la cámara la imagen amplificando la señal que recibe.

Un ISO más alto hace que las fotos sean más brillantes en los lugares oscuros, pero también aumenta el ruido y reduce los detalles. Al aprender de las imágenes tomadas con distintos niveles de ISO, los modelos consiguen distinguir mejor los detalles reales del ruido, lo que permite obtener resultados más claros y precisos.

Los denoisers aprenden a distinguir el ruido de los detalles reales de la imagen mediante distintas técnicas de entrenamiento, que son independientes de los tipos de modelos utilizados para el denoising. Los tipos de modelos como CNN, autocodificadores y transformadores describen la estructura de la red y cómo procesa la información visual.

Las técnicas de entrenamiento, por su parte, definen cómo aprende el modelo. Algunos métodos utilizan la predicción basada en el contexto, en la que el modelo rellena los píxeles ausentes o enmascarados utilizando información de las zonas cercanas.

Otros utilizan el aprendizaje basado en la reconstrucción, en el que el modelo comprime una imagen en una forma más simple y luego la reconstruye, lo que le ayuda a reconocer estructuras significativas, como bordes y texturas, al tiempo que filtra el ruido aleatorio.

Juntos, el tipo de modelo y la técnica de entrenamiento determinan la eficacia con la que un eliminador de ruido puede limpiar las imágenes. Combinando la arquitectura adecuada con el método de aprendizaje correcto, los desenotificadores autosupervisados pueden adaptarse a muchos tipos de ruido y producir imágenes más claras y precisas incluso sin datos de referencia limpios.

Técnicas clave en la eliminación de ruido de imágenes con IA autosupervisada

A continuación se presentan algunas de las técnicas de entrenamiento más utilizadas que permiten una eficaz eliminación de ruido de imágenes autosupervisada:

La eliminación de ruido de las imágenes es un cuidadoso equilibrio entre dos objetivos: reducir el ruido y mantener intactos los detalles. Un exceso de eliminación de ruido puede hacer que una imagen parezca borrosa o poco nítida, mientras que un defecto puede dejar grano o artefactos no deseados.

Para entender hasta qué punto un modelo consigue este equilibrio, los investigadores utilizan métricas de evaluación que miden tanto la claridad de la imagen como la conservación de los detalles. Estas métricas muestran lo bien que un modelo limpia una imagen sin perder información visual importante.

A continuación se describen las métricas de evaluación más comunes que ayudan a medir la calidad de la imagen y el rendimiento de la eliminación de ruido:

Ahora que entendemos mejor qué es la eliminación de ruido, vamos a estudiar cómo se aplica la eliminación de ruido de imágenes autosupervisada en situaciones reales.

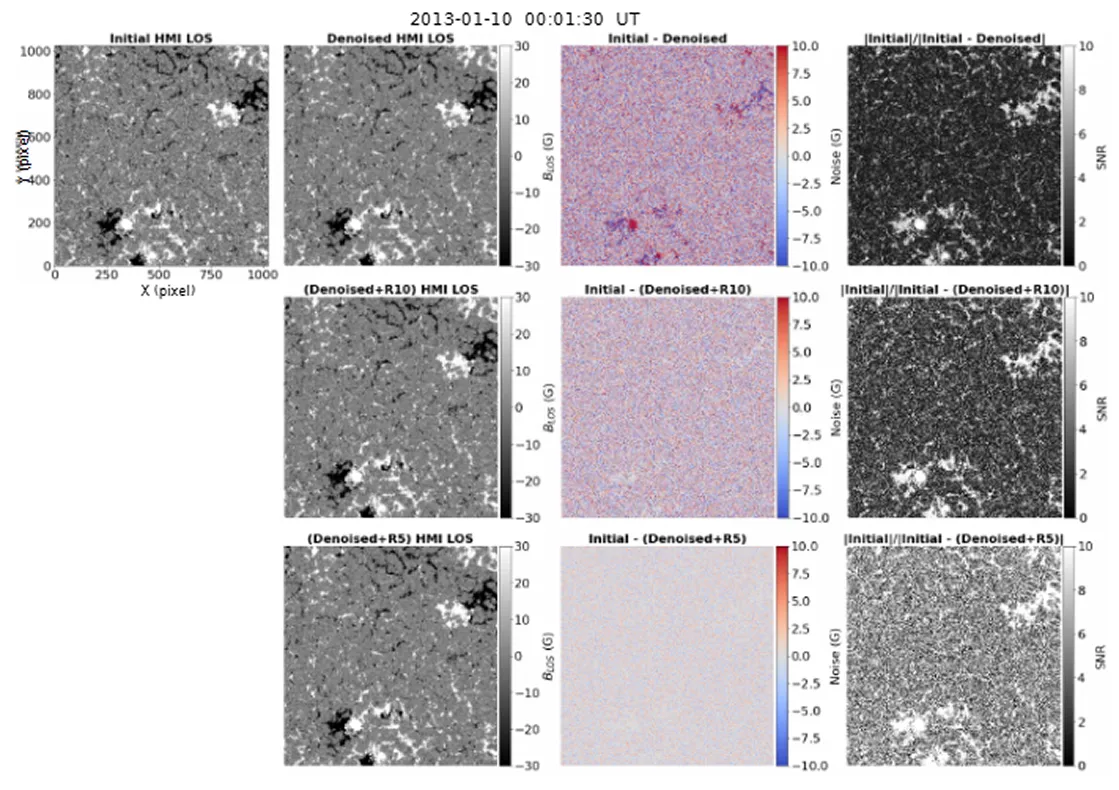

Hacer fotos nítidas de estrellas y galaxias no es fácil. El cielo nocturno es oscuro, por lo que las cámaras suelen requerir largos tiempos de exposición, lo que puede introducir ruido no deseado. Este ruido puede difuminar los detalles cósmicos y dificultar la detect señales débiles.

Las herramientas tradicionales de eliminación de ruido pueden ayudar a reducirlo, pero a menudo eliminan detalles importantes. La eliminación de ruido autosupervisada ofrece una alternativa más inteligente. Al aprender directamente de las imágenes ruidosas, el modelo de IA puede reconocer patrones que representan características reales y separarlas del ruido aleatorio.

El resultado son imágenes mucho más nítidas de objetos celestes como estrellas, galaxias y el Sol, que revelan detalles tenues que de otro modo podrían pasar desapercibidos. También puede realzar características astronómicas sutiles, mejorando la claridad de la imagen y haciendo que los datos sean más útiles para la investigación científica.

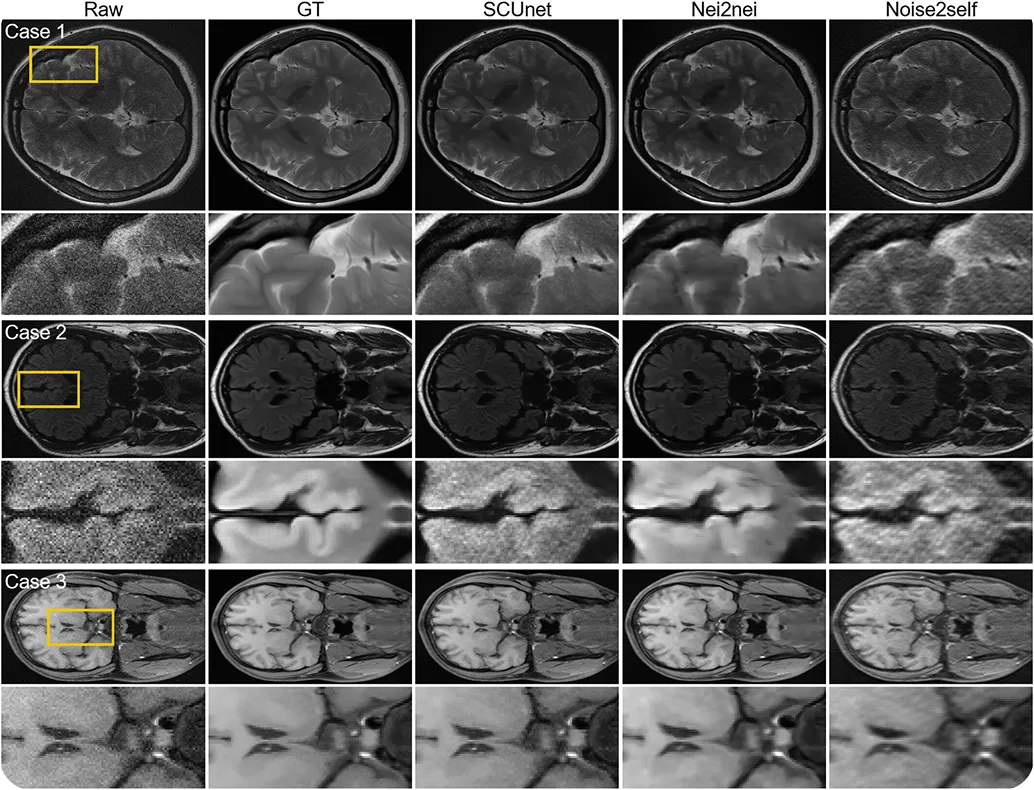

Los escáneres médicos, como las resonancias magnéticas, las tomografías computarizadas y las imágenes de microscopía, suelen captar ruido que puede dificultar la visualización de pequeños detalles. Esto puede ser un problema cuando los médicos necesitan detectar los primeros signos de una enfermedad o track los cambios a lo largo del tiempo.

El ruido de las imágenes puede deberse al movimiento del paciente, a la baja intensidad de la señal o a los límites de la radiación que puede utilizarse. Para que las exploraciones médicas sean más nítidas, los investigadores han explorado métodos de eliminación de ruido autosupervisados como Noise2Self y otros similares.

Estos modelos se entrenan directamente con imágenes de resonancia magnética cerebral ruidosas, aprendiendo los patrones de ruido por sí solos y limpiándolos sin necesidad de ejemplos perfectamente nítidos. Las imágenes procesadas mostraban texturas más nítidas y mejor contraste, lo que facilitaba la identificación de estructuras finas. Estos eliminadores de ruido basados en IA agilizan el flujo de trabajo en el diagnóstico por imagen y mejoran la eficacia del análisis en tiempo real.

En la mayoría de los casos, la eliminación de ruido tiene un impacto significativo en una amplia gama de aplicaciones de visión por ordenador. Al eliminar el ruido y las distorsiones no deseados, produce datos de entrada más limpios y coherentes para que los procesen los modelos de IA de visión.

Unas imágenes más nítidas permiten mejorar el rendimiento en tareas de visión por ordenador como la detección de objetos, la segmentación de instancias y el reconocimiento de imágenes. He aquí algunos ejemplos de aplicaciones en las que los modelos de Vision AI, como Ultralytics YOLO11 y Ultralytics YOLO26, pueden beneficiarse de la eliminación de ruido:

Estas son algunas de las principales ventajas de la eliminación de ruido autosupervisada en los sistemas de imágenes:

A pesar de sus ventajas, la eliminación de ruido autosupervisada tiene ciertas limitaciones. He aquí algunos factores a tener en cuenta:

La eliminación de ruido autosupervisada ayuda a los modelos de IA a aprender directamente de las imágenes con ruido, produciendo resultados más nítidos y conservando los detalles. Funciona con eficacia en diversas situaciones difíciles, como imágenes con poca luz, ISO alta e imágenes detalladas. A medida que la IA siga evolucionando, es probable que estas técnicas desempeñen un papel esencial en diversas aplicaciones de visión por ordenador.

Únase a nuestra comunidad y explore nuestro repositorio de GitHub para descubrir más sobre la IA. Si desea crear su propio proyecto de Vision AI, consulte nuestras opciones de licencia. Descubra más sobre aplicaciones como la IA en la sanidad y Vision AI en el comercio minorista visitando nuestras páginas de soluciones.

Comience su viaje con el futuro del aprendizaje automático