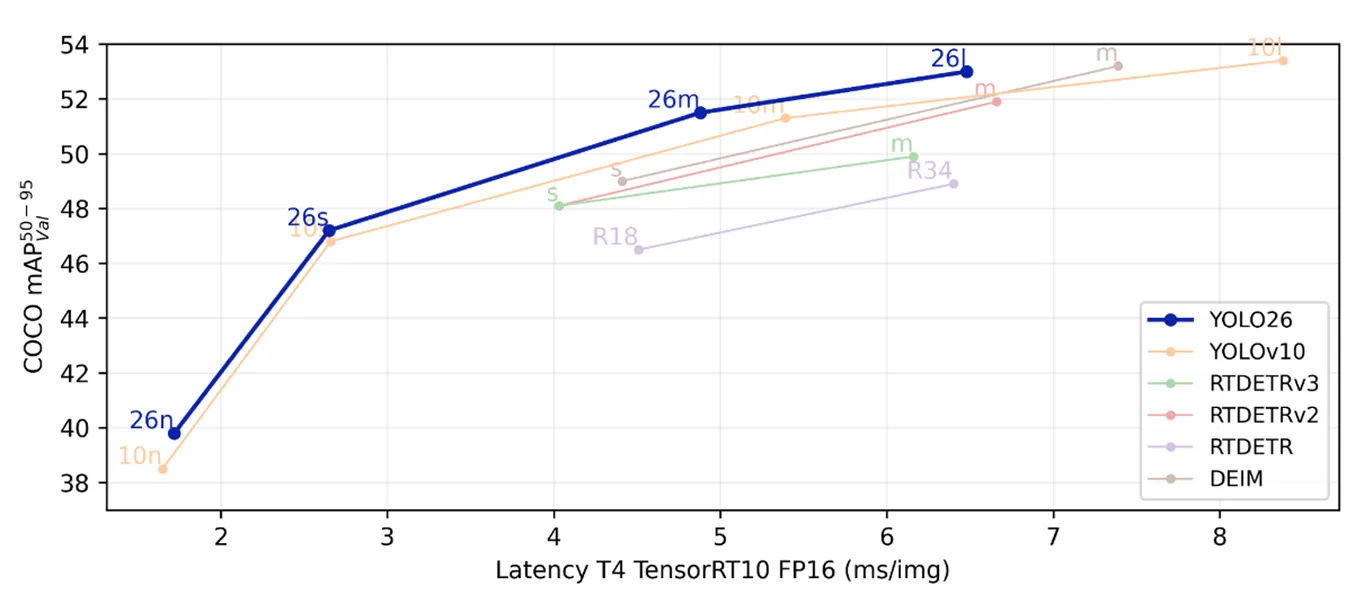

Ultralytics YOLO 最新モデル、Ultralytics YOLO26と、スピード、精度、展開性の最適なバランスをサポートする最先端の機能をご覧ください。

Ultralytics YOLO 最新モデル、Ultralytics YOLO26と、スピード、精度、展開性の最適なバランスをサポートする最先端の機能をご覧ください。

9月25日、ロンドンで開催された年次ハイブリッドイベント、YOLO Vision 2025 (YV25)で、弊社の創設者兼CEOであるグレン・ジョーチャーは、Ultralytics YOLO モデルシリーズの最新のブレークスルー、Ultralytics YOLO26を正式に発表しました!私たちの新しいコンピューター・ビジョン・モデルであるYOLO26は、スピード、正確さ、展開のしやすさのバランスが取れた合理的なアーキテクチャで、画像やビデオを分析し、解釈することができます。

Ultralytics YOLO26は、モデルの設計を簡素化し、新たな機能拡張を加える一方で、ユーザーがUltralytics YOLO モデルに期待するお馴染みの機能も引き続き提供します。例えば、Ultralytics YOLO26は使いやすく、様々なコンピュータビジョンタスクをサポートし、柔軟な統合と展開オプションを提供します。

言うまでもなく、Ultralytics YOLO26の使用への切り替えは手間がかからず、10月末に一般公開される際には、ユーザーが実際に体験するのを見るのが待ち遠しい。

簡単に言えば、Ultralytics YOLO26は、より良く、より速く、より小さなVision AIモデルです。この記事では、Ultralytics YOLO26の主な特徴と、それがもたらすものについて探っていきます。始めよう!

Ultralytics YOLO26の主な機能とそれが可能にするアプリケーションに飛び込む前に、一歩引いて、このモデルの開発を推進したインスピレーションと動機について説明しよう。

Ultralytics、常にイノベーションの力を信じてきました。設立当初から、私たちの使命は2つあります。一方では、誰もが障壁なくVision AIを利用できるよう、Vision AIを身近なものにしたいと考えています。もう一方では、私たちは最先端の技術を維持し、コンピューター・ビジョン・モデルが達成できることの限界を押し広げることにも同じように取り組んでいます。

このミッションの背景にある重要な要素は、AI分野が常に進化していることです。たとえば、クラウドに依存する代わりに、AIモデルをデバイス上で直接実行するエッジAIは、業界全体で急速に採用されています。

スマートカメラから自律システムまで、エッジデバイスはリアルタイムで情報を処理することが期待されています。この変化は、同じ高レベルの精度を維持しながら、より軽量で高速なモデルを必要とします。

だからこそ、Ultralytics YOLO モデルを常に改良し続ける必要があるのです。グレン・ジョーチャーが言うように、"最大の課題のひとつは、最高のパフォーマンスを提供しながらも、ユーザーがYOLO26を最大限に活用できるようにすることでした"。

YOLO26は5つの異なるモデルバリエーションがあり、どのような規模のアプリケーションにも柔軟に対応できます。

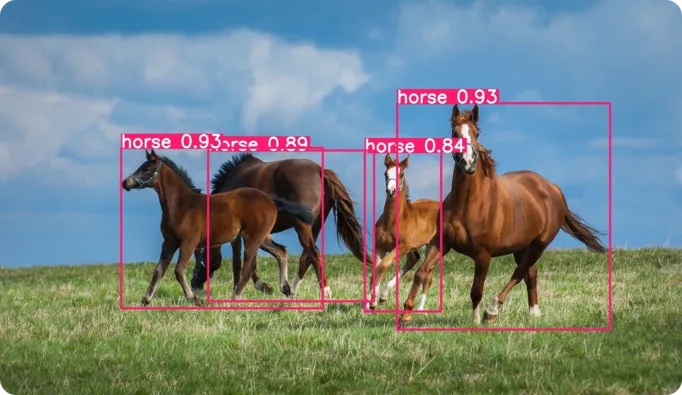

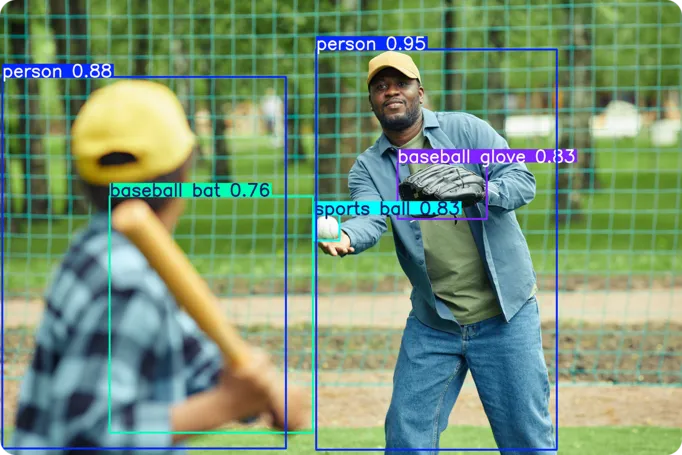

これらのモデルバリエーションはすべて、これまでのUltralytics YOLO モデルと同様に、複数のコンピュータービジョンタスクをサポートしています。つまり、どのサイズを選んでも、YOLO26は、次のような幅広い機能を提供します。 Ultralytics YOLO11.

YOLO26でサポートされているコンピュータビジョンタスクの概要をご紹介します。

YOLO26の能力について理解が深まったところで、そのアーキテクチャにおけるいくつかの革新を見ていきましょう。

推論速度を低下させ、バウンディングボックス回帰を制限していたDistribution Focal Loss(DFL)モジュールを削除することで、モデルの設計が合理化されました。

予測プロセスは、従来の非最大抑制NMSステップを省略できるエンドツーエンド(E2E)推論オプションによって簡素化されました。この機能強化により、複雑さが軽減され、モデルがより迅速に結果を提供できるようになり、実世界のアプリケーションでの展開が容易になりました。

その他の改善により、モデルはよりスマートで信頼性が高くなっています。Progressive Loss Balancing(ProgLoss)は、学習を安定させ、精度を向上させるのに役立ちます。一方、Small-Target-Aware Label Assignment(STAL)は、モデルが小さなオブジェクトをより効果的に検出できるようにします。さらに、新しいMuSGDオプティマイザは、学習の収束を改善し、全体的なパフォーマンスを向上させます。

実際、YOLO26の最小バージョンであるnanoモデルは、標準CPUで最大43%高速に動作するようになり、速度と効率が重要なモバイルアプリ、スマートカメラ、その他のエッジデバイスに特に適しています。

YOLO26の機能と、ユーザーが期待できることの簡単なまとめを以下に示します。

モバイルアプリ、スマートカメラ、企業システムのいずれに取り組んでいる場合でも、YOLO26の導入はシンプルで柔軟です。Ultralytics Python パッケージは、常に増え続けるエクスポート形式をサポートしているため、YOLO26を既存のワークフローに簡単に統合でき、ほぼすべてのプラットフォームと互換性があります。

いくつかのエクスポートオプションには、GPU アクセラレーションを最大化するためのTensorRT 、幅広い互換性のためのONNX 、ネイティブiOS アプリのためのCoreML 、Android およびエッジデバイスのためのTFLite 、およびIntel ハードウェア上で最適化されたパフォーマンスのためのOpenVINO 含まれます。この柔軟性により、YOLO26を開発から生産に移行する際、余分なハードルなしに簡単に移行することができる。

デプロイメントのもう1つの重要な部分は、リソースが限られたデバイス上でモデルが効率的に実行されるようにすることです。ここで量子化が役に立ちます。YOLOv8は、簡素化されたアーキテクチャのおかげで、これを非常にうまく処理します。INT8デプロイメント(8ビット圧縮を使用してサイズを縮小し、精度を最小限に抑えながら速度を向上)と、サポートされているハードウェアでのより高速な推論のための半精度(FP16)をサポートします。

最も重要なことは、YOLO26はこれらの量子化レベル全体で一貫したパフォーマンスを提供するため、強力なサーバーで実行しているか、コンパクトなエッジデバイスで実行しているかにかかわらず、信頼できます。

YOLO26は、さまざまな業界やユースケースにわたる幅広いコンピュータビジョンアプリケーションで使用できます。ロボット工学から製造業まで、ワークフローを改善し、より迅速で正確な意思決定を可能にすることで、大きな影響を与えることができます。

例えば、ロボティクスにおいて、YOLO26はロボットがリアルタイムで周囲の状況を解釈するのに役立ちます。これにより、ナビゲーションがよりスムーズになり、物体の取り扱いがより正確になります。また、人とのより安全な連携も可能になります。

もう1つの例は製造業で、モデルを欠陥検出に使用できます。手動検査よりも迅速かつ正確に、生産ラインの欠陥を自動的に識別できます。

一般に、YOLO26はより優れており、より高速で、より軽量であるため、軽量のエッジデバイスから大規模なエンタープライズシステムまで、幅広い環境に簡単に適応できます。これにより、効率、精度、信頼性の向上を目指す業界にとって実用的な選択肢となります。

Ultralytics YOLO26は、より良く、より速く、より軽く、しかも使いやすく、強力なパフォーマンスを発揮するコンピュータビジョンモデルです。幅広いタスクとプラットフォームで動作し、10月末までに誰でも利用できるようになる予定です。私たちは、コミュニティがこのモデルを使って新しいソリューションを生み出し、コンピュータ・ビジョンの限界を押し広げるのを見るのが待ちきれません。

成長を続けるコミュニティに参加しませんか?GitHubリポジトリでAIについてもっと学びましょう。ソリューションページでは、小売業におけるコンピュータビジョンや自動車産業におけるAIなどのイノベーションをご紹介しています。コンピュータビジョンを使った開発を始めるには、ライセンスオプションをご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。