視界不良からグレアまで、夜間の交通ビデオ検出の精度を困難にする要因と、コンピュータビジョンが安全性と流れをどのように改善するかを学びます。

視界不良からグレアまで、夜間の交通ビデオ検出の精度を困難にする要因と、コンピュータビジョンが安全性と流れをどのように改善するかを学びます。

道路は暗闇では異なって見えます。これは運転手だけでなく、道路を安全に保つシステムにとっても同様です。視界の悪さ、ヘッドライトのまぶしさ、そして素早く動く反射は、夜間の車両検出をより困難にする可能性があります。

従来の方法(手動観察やモーションベースのカメラなど)は、主に人間の判断と単純なモーションキューに依存しています。これは、暗い場所や複雑な交通状況では信頼性が低い可能性があります。これらの方法では、車両や歩行者を誤って識別し、誤検出や見落としにつながる可能性があります。

人工知能(AI)、深層学習、そしてコンピュータビジョンは、車両の検出と認識を自動化することで、このギャップを埋めることができます。特に、コンピュータビジョンはAIの一分野であり、機械が視覚データを認識し、解釈することを可能にします。夜間の交通ビデオ検出に関して言えば、Vision AIモデルは明るさや動きだけでなく、複雑なパターンを学習して認識精度を向上させることができます。

例えば、Ultralytics YOLO26やUltralytics YOLO26のようなコンピュータビジョンモデルがある。 Ultralytics YOLO11のようなコンピュータビジョンモデルは、その速度と精度で知られています。ビデオや画像データをリアルタイムで処理し、フレーム内の複数のオブジェクトを検出して分類し、シーケンス全体でそれらを追跡することができます。

これらの機能は、ヘッドライトや影、重なり合う車両が検出を困難にしている場合でも、物体検出やインスタンスのセグメンテーションなどのさまざまな視覚タスクによって実現される。これらの機能により、モデルは物体を識別、classify、区別することができる。

この記事では、夜間交通監視の課題、コンピュータビジョンがそれらにどのように対処しているか、そしてVision AIが現実世界の交通監視システムでどのように応用されているかを見ていきます。それでは始めましょう!

コンピュータビジョンが夜間の交通検出の課題をどのように解決するかを探る前に、暗闇の中で車両を見つけることが非常に難しい理由を見てみましょう。考慮すべき要素を以下に示します。

コンピュータビジョンモデルは、データセットとして知られる大規模な画像コレクションを使用して学習される。これらのデータセットには、車、トラック、歩行者、自転車など、含まれているオブジェクトが注意深くラベル付けされており、学習の基礎となる。これらのラベル付けされた例を研究することで、モデルはパターンを認識することを学習し、新しいビデオ映像内のオブジェクトを識別・detect できるようになる。

トレーニング中、モデルはデータから特徴を抽出し、それらを使用して検出精度を向上させます。このプロセスは、モデルが実際の交通シーンにさらされたときに、検出漏れや誤警報を減らすのに役立ちます。

しかし、夜間条件のデータセットやデータ収集を構築することは、はるかに困難です。ビデオ品質が低いため、ラベリングに時間がかかり、間違いが発生しやすくなります。また、事故や異常な運転行動など、まれではあるものの重要なイベントは、夜間の設定で捉えるのが難しい場合があります。その結果、モデルが学習するためのトレーニング例の数が限られてしまいます。

この問題に対処するため、研究者は特殊なベンチマークデータセットを開発してきた。ベンチマークデータセットは単なる画像の集まりではない。標準化されたラベル、評価プロトコル、そして精度、再現率、平均平均精度mAP)などの性能指標が含まれている。これらの指標により、異なるアルゴリズムを同じ条件でテストし比較することが可能になり、公平で一貫性のある評価が保証される。

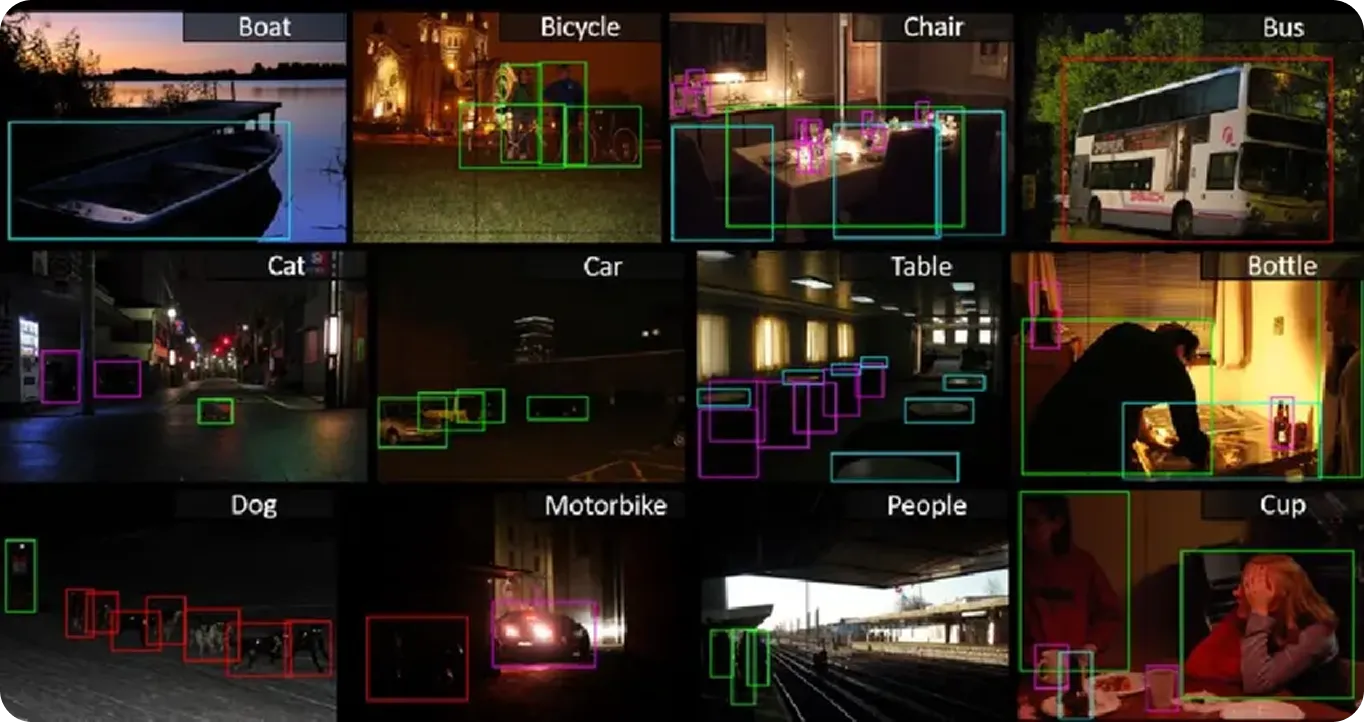

例えば、ExDarkベンチマークデータセットには、12のオブジェクトカテゴリ(自転車、ボート、ボトル、バス、車、猫、椅子、カップ、犬、バイク、人、テーブル)にわたる7,363枚の低照度画像が含まれています。各画像にはバウンディングボックスでアノテーションが付与されており、このデータセットは、低照度下での物体検出と分類を評価するための研究で広く使用されています。

同様に、NightOwlsベンチマークデータセットは、約115,000枚の夜間画像と約279,000のアノテーション(歩行者)を提供します。これは、道路の安全と高度な運転支援システム(ADAS)において重要な役割を果たす歩行者検出システムを評価するための重要なリソースとなっています。

関連する課題とデータセットの必要性について理解が深まったところで、ビジョンベースのシステムが夜間の交通ビデオをどのように解釈できるかを詳しく見ていきましょう。

YOLO11 YOLO26のようなモデルは、物体検出、追跡、インスタンス分割などのコンピュータ・ビジョン・タスクをサポートしており、低照度下でも交通を分析することが可能です。ここでは、これらのモデルが夜間の交通を分析するためにサポートするビジョンAIタスクの概要を説明します:

モデルのトレーニング、データセットの必要性、YOLO11 YOLO26のようなモデルがサポートするタスクについて説明した。しかし、すべてをまとめるには、もうひとつ、これらのモデルが夜間のモニタリングに実際にどのように適用されるかという概念を説明する必要がある。

Ultralytics YOLO モデルは訓練済みバージョンとして提供されており、COCO データセットのような多くの日常的なオブジェクトをカバーする大規模な汎用データセットですでに訓練されている。これにより、モデルには物体をdetect ・classify する強力なベースライン能力が与えられます。

ただし、これらのデータセットには、低照度または夜間の例が非常に少ないため、事前トレーニング済みのモデルは、グレア、影、またはコントラストの悪さを効果的に処理することが得意ではありません。夜間の交通ビデオ検出に影響を与えるためには、実際の夜間の状況を反映した特殊なデータセットで微調整する必要があります。

ファインチューニングまたはカスタムトレーニングでは、ヘッドライトのグレアの下の車両、横断歩道の歩行者、夜間の混雑した交差点など、暗い場所で撮影された追加のラベル付き画像でモデルをトレーニングし、夜間のシーン特有の特徴を学習させます。

カスタムトレーニングされたモデルは、低照度条件下で、検出、追跡、セグメンテーション、または分類などのタスクを、より高い精度でサポートできます。これにより、交通当局は、車両の計数、速度推定、適応型信号制御、および夜間の事故防止などの実用的なユースケースにそのようなモデルを適用できます。

次に、現実世界の夜間交通システムでコンピュータビジョンをどのように採用できるかを見ていきます。

都市部の交差点は、特に夜間、視界が悪くなり交通の流れが予測しにくくなるため、管理が最も難しい場所の1つです。従来の信号は固定されたタイマーに依存しており、リアルタイムの変化に対応できません。調査によると、これはドライバーの時間を無駄にするだけでなく、不必要な燃料消費と遅延にもつながります。

コンピュータ・ビジョン・システムは、まさにこの課題を克服するのに役立つ。これらのシステムは、車両の動きを監視し、車両の数をリアルタイムでdetect することができる。そして、そのデータは適応型交通管制システムに送られる。これにより、実際の道路状況に応じて信号を素早く調整することが可能になる。そのため、ある車線が混雑しているのに別の車線が空いている場合、信号のタイミングを即座に調整してボトルネックを解消することができる。

夜間の運転は日中よりも危険である。視界が悪くなり、照明にムラができ、まぶしいため、ドライバーは距離を判断しにくくなるからだ。実際、調査によると、夜間の1kmあたりの死亡事故率は昼間の3倍にもなる。

固定監視カメラ、道路パトロール、車両存在センサー、定時信号システムといった従来の監視方法は、反応的に作動するため、危険な状況の発生を未然に防ぐのに十分なほど早期にdetect できない可能性がある。

コンピュータビジョンソリューションは、ライブビデオストリームを分析し、道路や高速道路上の異常なパターンを検出することで、この懸念に対処できます。物体追跡を使用することで、これらのシステムは車両の挙動をリアルタイムで監視し、異常が見られる場合にアラートを発することができます。

例えば、走行中の車両が車線変更をしている場合、混雑したエリアで速すぎる速度で走行している場合、または急に減速している場合、システムはリアルタイムでそれを検知できます。これは、当局が迅速に対応し、事故が発生する前に防ぐことができることを意味します。

自動運転車やADASにとって、夜間の運転は特有の課題をもたらします。視界が悪く、予測不可能な交通パターンにより、従来のセンサーが安定した性能を発揮することが難しくなり、安全性の懸念が高まります。

コンピュータビジョンは、物体検出、車線追跡、セグメンテーションなどのタスクを処理することでこれらのシステムを強化し、車両が歩行者、他の車両、および悪天候下でも障害物を認識できるようにします。レーダーまたはLiDAR(Light Detection and Ranging)と組み合わせると、周囲を3Dでマッピングし、追加された視覚レイヤーにより、ADASは早期警告を提供し、自律走行車は夜間でもより安全にナビゲートするために必要な認識を得ることができます。

スピード違反は、世界中の交通事故死亡者の3分の1を占めており、そのリスクは夜間になるとさらに悪化します。暗闇の中では、昼間にはっきり見える詳細がぼやけてしまうことが多いため、交通警察が違反を摘発することが難しくなります。

そのため、空いている道路でのスピード違反、赤信号無視、または間違った車線への逸脱などの違反は、しばしば処罰されません。コンピュータビジョンは、赤外線カメラを使用して、暗い場所でも違反を特定することで、この問題に対処します。これらのシステムは、インシデントが記録される検出ゾーンを作成し、誤検知を減らし、明確で検証可能な証拠を提供します。運輸当局にとって、それは盲点が減り、手動チェックへの依存が少なくなることを意味します。

夜間の交通ビデオ検出にVision AIを利用する利点をいくつかご紹介します。

その利点にもかかわらず、Vision AIを使用した夜間交通検出には、いくつかの制限もあります。留意すべきいくつかの要素を次に示します。

都市が発展し道路が混雑するにつれ、夜間の交通検知はよりインテリジェントで応答性の高いシステムへと移行している。例えば、サーマルカメラや赤外線センサーは、人や車両の熱信号をdetect することができるため、完全な暗闇でも視認が可能です。これにより、標準的なカメラがまぶしさや低照度との闘いで発生するエラーを減らすことができる。

もう1つの成長しているアプローチは、カメラ-LiDARフュージョンです。カメラは道路の詳細な画像を提供し、LiDARは正確な3Dマップを生成します。これらを一緒に使用すると、特に暗い場所や適度な霧の中で、車線、車両、障害物の検出精度が向上します。

同時に、低照度画像強調、歩行者認識、およびナンバープレート識別の進歩により、コンピュータビジョンの機能が拡張されています。これらの改善により、照明の悪い道路や交差点でも、より高い信頼性と少ないエラーで監視できます。

夜間の交通監視において車両を検知することは常に課題でしたが、コンピュータビジョンの発展により、その管理がより容易になっています。グレアの影響を軽減し、複雑な交通シーンを処理することで、夜間の道路状況をより正確に把握できます。これらのシステムが進化し続けるにつれて、夜間における、より安全でスマートかつ効率的な輸送への道が開かれています。

Vision AIをプロジェクトに統合しませんか?活発なコミュニティに参加して、自動車産業におけるAIやロボット工学におけるVision AIなどのイノベーションを発見してください。当社のGitHubリポジトリで詳細をご覧ください。今日からコンピュータビジョンを始めるには、ライセンスオプションをご確認ください。

未来の機械学習で、新たな一歩を踏み出しましょう。