Ultralytics YOLO11 NVIDIA Jetson Orin Nano Superに導入することで、高度なAIアプリケーションのための印象的なベンチマークとGPU性能がどのように実現されるかをご覧ください。

Ultralytics YOLO11 NVIDIA Jetson Orin Nano Superに導入することで、高度なAIアプリケーションのための印象的なベンチマークとGPU性能がどのように実現されるかをご覧ください。

2024年12月17日に発売されたNVIDIA JetsonOrin Nano Super Developer Kitは、エッジコンピューティングに高度な機能をもたらすために設計された、コンパクトながら強力なジェネレーティブAIスーパーコンピュータです。リアルタイム処理を容易にし、クラウドコンピューティングを不要にします。NVIDIA Jetson Orin Nano Superにより、開発者はローカル環境で効率的に動作する手頃なインテリジェント・システムを構築することができます。

YOLO ようなUltralytics YOLO モデルと組み合わせると、次のようになります。 Ultralytics YOLO11のようなUltralytics YOLOモデルと組み合わせることで、Jetson Orin Nano Superは、エッジでの膨大なビジョンAIアプリケーションを処理することができます。特にYOLO11 11は、物体検出、物体追跡、インスタンス分割などのタスクにおいて、その速度と精度で知られるコンピュータ・ビジョン・モデルです。

YOLO11能力をキットの堅牢なGPU (グラフィックス・プロセッシング・ユニット)と組み合わせ、PyTorch、ONNX、NVIDIA TensorRT フレームワークをサポートすることで、高性能な導入が可能になります。この組み合わせは、ロボット工学における物体検出から、スマートスペースや小売システムにおけるリアルタイムの物体追跡まで、AIアプリケーションを作成するための効率的なソリューションを開発者に提供します。

この記事では、NVIDIA Jetson Orin Nanoスーパー・デベロッパー・キットについて、エッジAI向けのUltralytics YOLO11 どのように連携するのか、その性能ベンチマーク、実際のアプリケーション、そして開発者がVision AIプロジェクトを構築する際にどのように役立つのかを紹介する。さっそく始めよう!

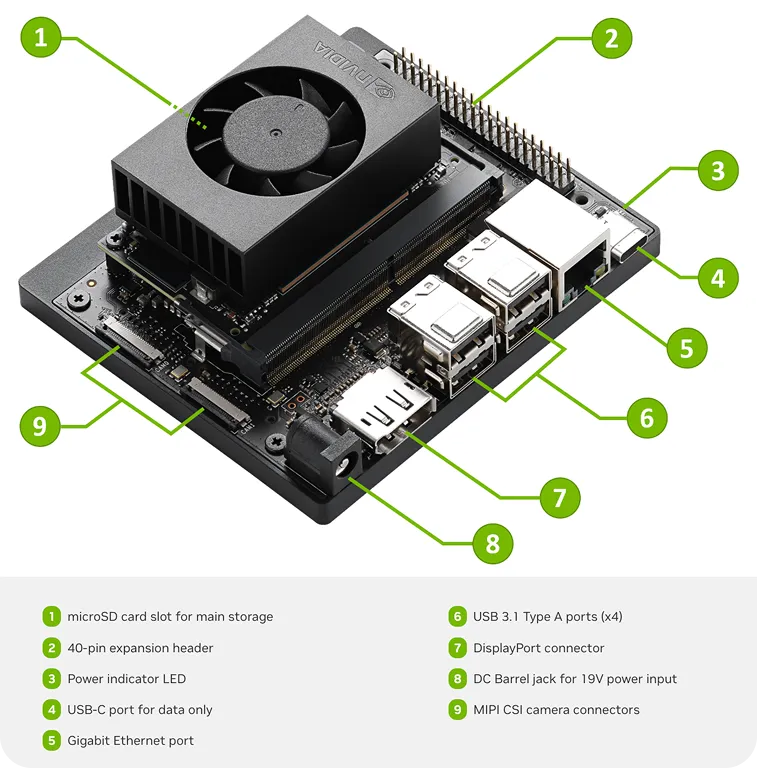

NVIDIA Jetson Orin Nanoスーパーデベロッパーキットは、小型エッジデバイス向けのジェネレーティブAIを再定義する、コンパクトでありながらパワフルなコンピュータです。最大67TOPS(1秒間に数兆回の演算)のAI性能を実現し、高度なAIプロジェクトに取り組む開発者、学生、ホビイストに最適です。

主な機能の一部を以下に示します。

NVIDIA製品に詳しい方であれば、この新しいリリースが既存のNVIDIA Jetson Orin NX 16GB(スーパーモードなし)と比べてどうなのか気になるかもしれません。Jetson Orin NXは全体的に高い性能を提供しますが、Jetson Orin Nanoスーパー・デベロッパー・キットは、わずかなコストで素晴らしい性能を提供します。

概要は以下のとおりです。

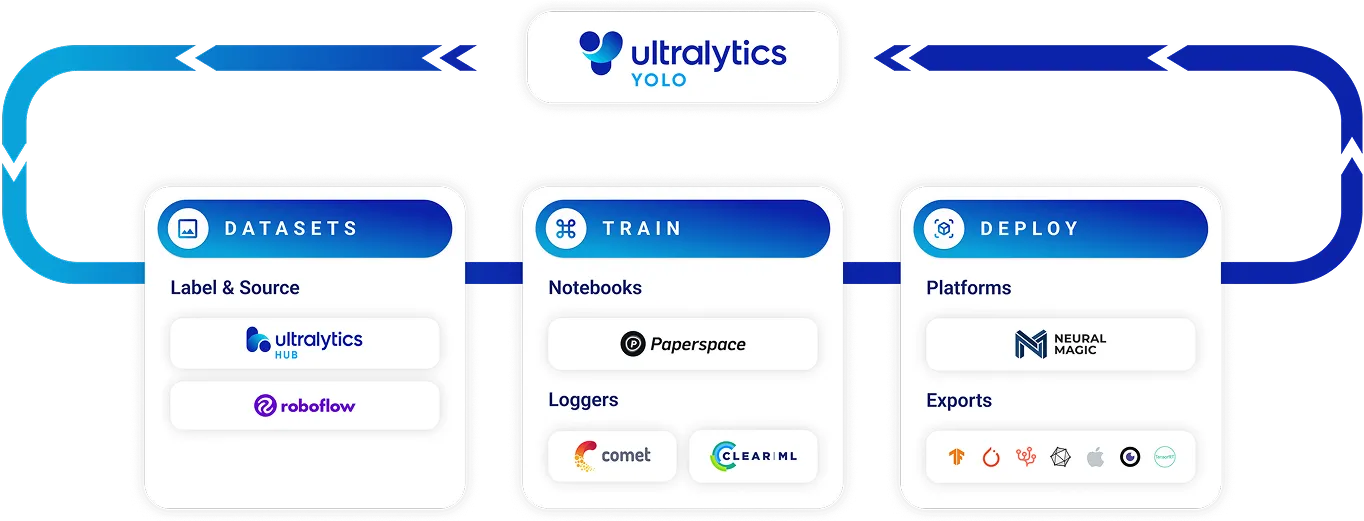

Jetson Orin Nano Superの理解が深まったところで、YOLO11 どのようにVision AI機能をエッジにもたらすことができるかを見てみよう。YOLO11含むUltralytics YOLO モデルには、訓練、予測、エクスポートなどの多彩なモードが用意されており、さまざまなAIワークフローに適応できるようになっている。

例えば、トレーニングモードでは、Ultralytics YOLO モデルは、ユニークなオブジェクトの検出や特定の環境に対する最適化など、特定のアプリケーションのためにカスタムデータセット上で微調整やトレーニングを行うことができます。同様に、 予測モードは推論用に設計されており、リアルタイムのコンピュータビジョンタスクを可能にします。最後に、エクスポートモードを使用して、モデルを展開用に最適化された形式に変換することができます。

エクスポートモードの YOLO11 11は、以下のようなさまざまなモデル展開オプションをサポートしている:

これらのデプロイメント・フォーマットを使用することで、開発者はJetson Orin Nano Superのハードウェアをフルに活用し、スマート・スペース、ロボット工学、リテール・オートメーションなどのリアルタイム・アプリケーション向けにYOLO11 実行することができる。

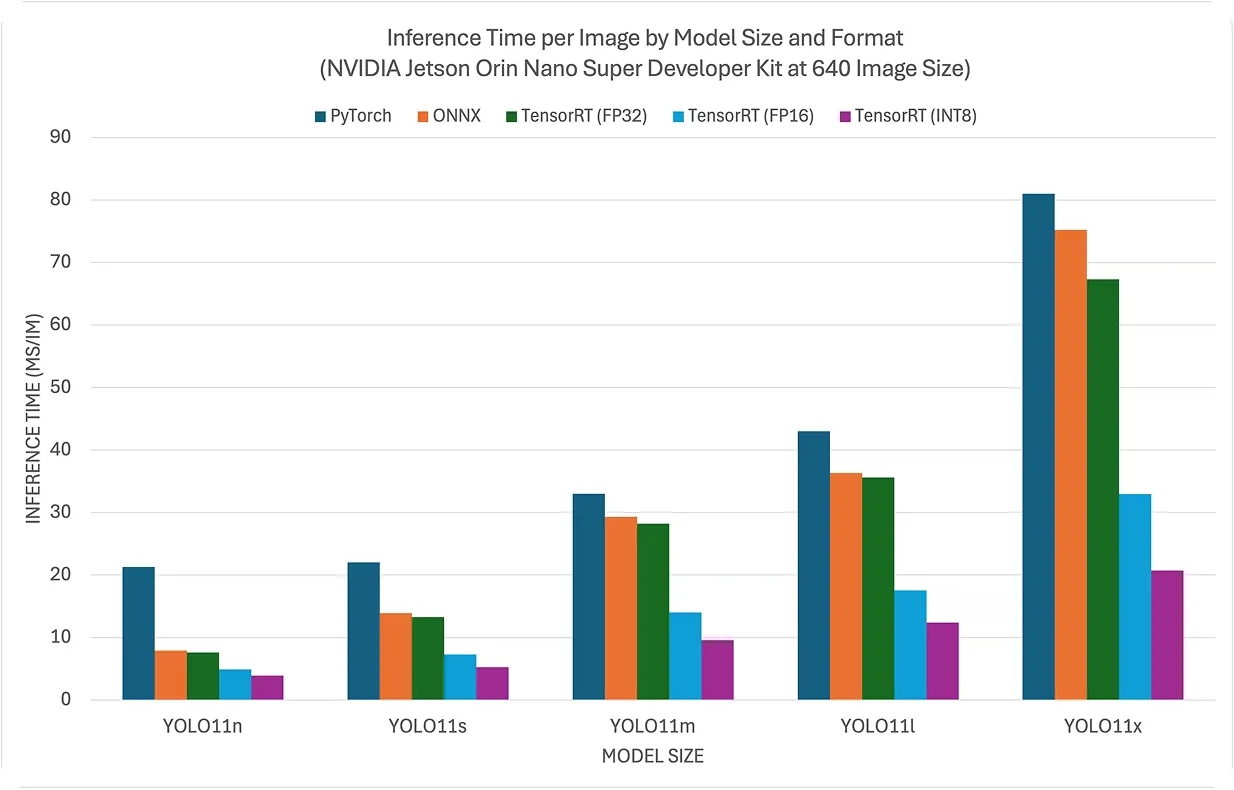

次に、YOLO11 NVIDIA Jetson Orin Nano Super上でどの程度高速に実行できるかを知るために、PyTorch、ONNX、TensorRTようなGPUエクスポート形式を使用して、その印象的なパフォーマンスとベンチマークを調べてみましょう。これらのテストにより、Jetson Orin Nano Superは、既存のJetson Orin NX 16GB(スーパーモードなし)に匹敵し、時にはそれを上回るYOLO11 モデルの推論時間を達成していることが明らかになりました。

さらに注目すべきは、Jetson Orin Nano Superの手頃な価格です。Jetson Orin NX 16GBの半分以下の価格でこのような性能を提供することで、高性能なYOLO11 アプリケーションを構築する開発者に卓越した価値を提供します。このコストと性能の組み合わせにより、Jetson Orin Nano SuperはエッジでのリアルタイムVision AIタスクに最適な選択肢となります。

Jetson Orin Nano SuperにYOLO11 デプロイすることを楽しみにしているなら、朗報があります-それは簡単なプロセスです。NVIDIA JetPack SDKでデバイスをフラッシュした後、ビルド済みのDockerイメージを使用して素早くセットアップするか、必要なパッケージを手動でインストールすることができます。

より高速でシームレスな統合を求める方には、更新されたJetPack 6 Dockerコンテナが理想的なソリューションです。Dockerコンテナは、特定のソフトウェアを実行するために必要なすべてのツールと依存関係を含む、軽量で移植可能な環境です。

JetPack 6.1用に最適化されたUltralytics コンテナには、CUDA 12.6、TensorRT 10.3、PyTorch TorchVisionなどの必須ツールがプリロードされており、これらはすべてJetsonのARM64アーキテクチャ用に調整されている。このコンテナを使用することで、開発者はセットアップの時間を節約し、YOLO11使用したVision AIアプリケーションの構築と最適化に集中することができる。

次期AIプロジェクトのインスピレーションをお探しの方にとって、エッジベースのコンピュータビジョンアプリケーションは、私たちの身の回りに可能性を秘めています。

日常生活において、エッジAIは、クラウド処理に依存することなく、リアルタイムで物体をdetect ・track するシステムを可能にすることで、スマートスペースを再定義している。賑やかな都市での交通の監視であれ、公共スペースでの異常な活動の特定であれ、エッジ・ビジョンAIはセキュリティと効率を高めている。

小売業者もエッジAIとコンピュータ・ビジョンを活用している。自動在庫チェックから盗難防止まで、YOLO11 ようなモデルは、企業が店舗に直接リアルタイム・ソリューションを導入することを可能にしている。

同様に、ヘルスケアにおけるAIに関して言えば、エッジベースのモニタリングは、患者の安全性を確保し、異常を検出し、コンプライアンスを維持します。Jetson Orin Nano SuperやYOLO11ようなツールにより、ビジョンAIの未来は、最も必要とされるエッジで展開されます。

YOLO11 ようなUltralytics YOLO モデルをNVIDIA Jetson Orin Nano Super Developer Kitに展開することで、エッジAIアプリケーションのための信頼性の高い効率的なソリューションを提供します。堅牢なGPU 性能、PyTorch、ONNX、TensorRTシームレスなサポート、印象的なベンチマークにより、物体検出や追跡などのリアルタイムコンピュータビジョンタスクに適しています。

Vision AIやハードウェア・アクセラレーションなどの最先端技術における革新やコラボレーションは、私たちの働き方を変革し、開発者がエッジでスケーラブルで高性能なソリューションを構築できるようにします。AIの進歩に伴い、YOLO11 Jetson Orin Nano Superのようなツールは、インテリジェントなリアルタイム・ソリューションの実現をかつてないほど容易にしています。

AIにご興味がありますか?GitHubリポジトリにアクセスして、私たちの貢献を探り、コミュニティに参加してください。農業やヘルスケアのような業界に影響を与えるために、私たちがどのようにAIを活用しているかをご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。