Ознакомьтесь с новой моделью GPT-4o от OpenAI, в которой представлен передовой ИИ с реалистичным взаимодействием, меняющим способы нашего общения с технологиями. Изучите ее новаторские функции!

Ознакомьтесь с новой моделью GPT-4o от OpenAI, в которой представлен передовой ИИ с реалистичным взаимодействием, меняющим способы нашего общения с технологиями. Изучите ее новаторские функции!

В понедельник, 13 мая 2024 года, OpenAI объявила о запуске своей новой флагманской модели GPT-4o, где 'o' означает 'omni' (всеохватывающий). GPT-4o — это продвинутая мультимодальная AI-модель для взаимодействия в реальном времени с текстом, аудио и видео, предлагающая более быструю обработку, многоязыковую поддержку и повышенную безопасность.

Он предлагает невиданные ранее возможности генеративного ИИ. Опираясь на разговорные возможности ChatGPT, функции GPT-4o знаменуют собой значительный шаг вперед в восприятии искусственного интеллекта людьми. Теперь мы можем разговаривать с GPT-4o так, как будто это реальный человек. Давайте погрузимся в игру и посмотрим, на что способен GPT-4o!

На весеннем обновлении OpenAI было объявлено, что, хотя GPT-4o так же умна, как и GPT-4, она может обрабатывать данные быстрее и лучше справляется с текстом, видео и аудио. В отличие от предыдущих релизов, которые были сосредоточены на том, чтобы сделать модели умнее, этот релиз был сделан с учетом необходимости сделать ИИ более простым в использовании для широкой аудитории.

.png)

Голосовой режим ChatGPT, выпущенный в конце прошлого года, включал в себя три различные модели, которые объединялись для расшифровки голосовых сообщений, понимания и создания письменных ответов, а также преобразования текста в речь, чтобы пользователь мог услышать ответ. В этом режиме возникали проблемы с задержками, и он казался не очень естественным. GPT-4o может обрабатывать текст, зрение и звук за один раз, создавая у пользователя впечатление, что он участвует в естественном разговоре.

Кроме того, в отличие от голосового режима, теперь вы можете прервать GPT-4o во время разговора, и она отреагирует так же, как человек. Она сделает паузу и выслушает, а затем даст свой ответ в реальном времени, основываясь на том, что вы сказали. Она также может выражать эмоции через свой голос и понимать ваш тон.

Оценка модели GPT-4o показывает, насколько она продвинута. Одним из самых интересных результатов было то, что GPT-4o значительно улучшает распознавание речи по сравнению с Whisper-v3 на всех языках, особенно на тех, которые используются реже.

Производительность Audio ASR (Automatic Speech Recognition — автоматическое распознавание речи) измеряет, насколько точно модель транскрибирует разговорный язык в текст. Производительность GPT-4o отслеживается с помощью Word Error Rate (WER — коэффициент ошибок в словах), который показывает процент неправильно транскрибированных слов (более низкий WER означает лучшее качество). На графике ниже показан более низкий WER GPT-4o в различных регионах, что демонстрирует его эффективность в улучшении распознавания речи для языков с меньшим количеством ресурсов.

.png)

Вот еще несколько уникальных особенностей GPT-4o:

Теперь вы можете достать GPT-4o на своем телефоне, включить камеру и попросить GPT-4o, как друга, угадать ваше настроение по выражению лица. GPT-4o может видеть вас через камеру и отвечать.

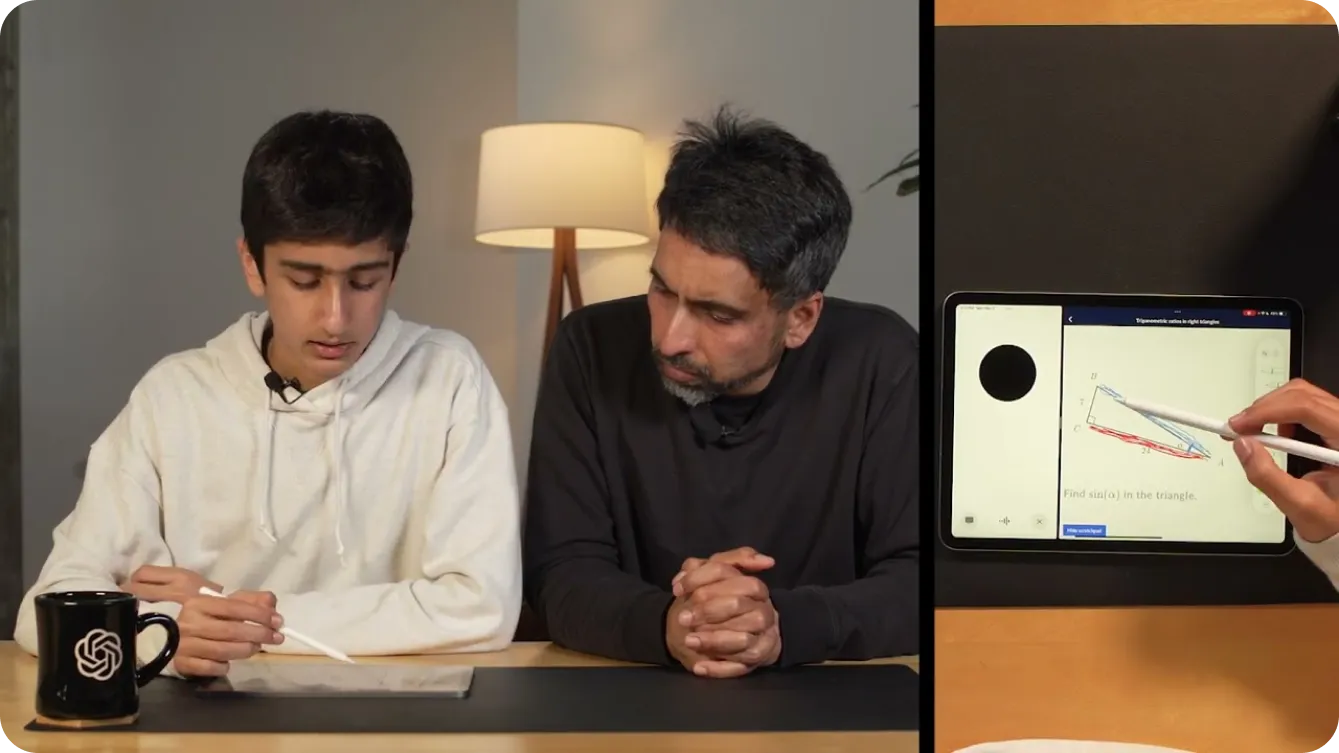

Вы даже можете использовать ее, чтобы помочь вам решать математические задачи, показывая GPT-4o то, что вы пишете, через видео. В качестве альтернативы, вы можете поделиться своим экраном, и она может стать полезным репетитором в Khan Academy, попросив вас указать различные части треугольника в геометрии, как показано ниже.

Помимо помощи детям в математике, разработчики могут общаться с GPT-4o для отладки своего кода. Это стало возможным благодаря появлению ChatGPT в качестве настольного приложения. Если вы выделите и скопируете свой код с помощью CTRL "C" во время разговора с настольным голосовым приложением GPT-4o, оно сможет прочитать ваш код. Или же вы можете использовать его для перевода разговоров между разработчиками, говорящими на разных языках.

Возможности GPT-4o кажутся безграничными. В одной из самых интересных демонстраций от OpenAI использовались два телефона, чтобы показать, как GPT-4o разговаривает с разными экземплярами самой себя и поет вместе.

Как показано в демонстрации, GPT-4o может сделать мир более доступным для людей с нарушениями зрения. Он может помочь им взаимодействовать и перемещаться более безопасно и независимо. Например, пользователи могут включить видео и показать GPT-4o вид улицы. Затем GPT-4o может предоставлять описания окружающей среды в режиме реального времени, например, идентифицировать препятствия, читать дорожные знаки или направлять их к определенному месту. Он даже может помочь им поймать такси, предупреждая о приближении машины.

.png)

Аналогично, GPT-4o может преобразовать различные отрасли благодаря своим расширенным возможностям. В розничной торговле он может улучшить обслуживание клиентов, предоставляя помощь в режиме реального времени, отвечая на вопросы и помогая клиентам находить товары как онлайн, так и в магазине. Представьте, что вы смотрите на полку с товарами и не можете найти нужный продукт, GPT-4o может вам помочь.

В здравоохранении GPT-4o может помочь с диагностикой, анализируя данные пациентов, предлагая возможные состояния на основе симптомов и предлагая рекомендации по вариантам лечения. Он также может поддерживать медицинских работников, обобщая записи пациентов, предоставляя быстрый доступ к медицинской литературе и даже предлагая перевод языка в режиме реального времени для общения с пациентами, говорящими на разных языках. Это всего лишь несколько примеров. Приложения GPT-4o облегчают повседневную жизнь, предлагая индивидуальную помощь с учетом контекста и устраняя барьеры для информации и общения.

Как и предыдущие версии GPT, которые повлияли на жизни сотен миллионов людей, GPT-4o, вероятно, будет взаимодействовать с аудио и видео в реальном времени по всему миру, что делает безопасность важнейшим элементом в этих приложениях. OpenAI очень внимательно подошла к созданию GPT-4o, уделяя особое внимание снижению потенциальных рисков.

Для обеспечения безопасности и надежности OpenAI внедрила строгие меры безопасности. К ним относятся фильтрация данных обучения, уточнение поведения модели после обучения и внедрение новых систем безопасности для управления голосовыми выходами. Более того, GPT-4o был тщательно протестирован более чем 70 внешними экспертами в таких областях, как социальная психология, предвзятость и справедливость, а также дезинформация. Внешнее тестирование гарантирует, что любые риски, привнесенные или усиленные новыми функциями, будут выявлены и устранены.

Для поддержания высоких стандартов безопасности OpenAI выпускает функции GPT-4o постепенно в течение следующих нескольких недель. Поэтапное развертывание позволяет OpenAI отслеживать производительность, решать любые проблемы и собирать отзывы пользователей. Такой осторожный подход гарантирует, что GPT-4o предоставляет расширенные возможности, поддерживая при этом самые высокие стандарты безопасности и этичного использования.

GPT-4o доступен для бесплатного доступа. Чтобы опробовать вышеупомянутые возможности общения в режиме реального времени, вы можете загрузить приложениеChatGPT из Google Play Store или Apple App Store прямо на свой телефон.

После входа в систему вы сможете выбрать GPT-4o из списка, отображаемого при нажатии на три точки в правом верхнем углу экрана. После перехода в чат, поддерживающий GPT-4o, если вы нажмете на знак плюса в левом нижнем углу экрана, вы увидите несколько вариантов ввода. В правом нижнем углу экрана вы увидите значок наушников. При выборе значка наушников вам будет предложено попробовать версию GPT-4o с громкой связью. После согласия вы сможете опробовать GPT-4o, как показано ниже.

Если вы хотите интегрировать расширенные возможности GPT-4o в свои собственные проекты, он доступен как API для разработчиков. Это позволяет вам включать мощное распознавание речи, многоязыковую поддержку и возможности разговора в реальном времени GPT-4o в свои приложения. Используя API, вы можете улучшить взаимодействие с пользователем, создавать более интеллектуальные приложения и внедрять передовые технологии искусственного интеллекта в различные сектора.

Хотя GPT-4o гораздо более совершенен, чем предыдущие модели ИИ, важно помнить, что GPT-4o имеет свои ограничения. Специалисты OpenAI отмечают, что иногда он может произвольно переключать языки во время разговора, переходя с English на французский. Они также видели, как GPT-4o неправильно переводит с одного языка на другой. По мере того как все больше людей будут опробовать модель, мы поймем, в чем GPT-4o преуспевает, а в чем нуждается в дальнейшем совершенствовании.

GPT-4o от OpenAI открывает новые двери для ИИ благодаря расширенной обработке текста, изображений и аудио, предлагая естественное, человеческое взаимодействие. Он превосходит по скорости, экономической эффективности и многоязыковой поддержке. GPT-4o — это универсальный инструмент для образования, обеспечения доступности и помощи в режиме реального времени. По мере того, как пользователи изучают возможности GPT-4o, отзывы будут стимулировать его развитие. GPT-4o доказывает, что ИИ действительно меняет наш мир и становится частью нашей повседневной жизни.

Изучите наш репозиторий GitHub и присоединяйтесь к нашему сообществу, чтобы глубже погрузиться в ИИ. Посетите страницы наших решений, чтобы узнать, как ИИ преобразует такие отрасли, как производство и сельское хозяйство.

Начните свой путь в будущее машинного обучения