Descubra qué es la computación de imágenes, cómo funciona y cómo se aplica en la asistencia sanitaria, la conducción autónoma y otros sistemas inteligentes modernos.

Descubra qué es la computación de imágenes, cómo funciona y cómo se aplica en la asistencia sanitaria, la conducción autónoma y otros sistemas inteligentes modernos.

Cuando caminas por un centro comercial o una calle pública concurrida, las cámaras instaladas sobre las entradas y las aceras graban la actividad. Generan datos visuales cada segundo y, la mayoría de las veces, ni siquiera nos damos cuenta.

Este flujo constante de datos alimenta los modernos sistemas basados en inteligencia artificial, desde los sistemas de seguridad inteligentes hasta los coches autónomos. Estas innovaciones están impulsadas por la computación de imágenes, un campo versátil que aúna la informática, las matemáticas y la física.

La computación de imágenes ayuda a las máquinas a comprender lo que ven en una imagen. Permite a los sistemas reconocer lo que está sucediendo en una escena y decidir cómo funcionar o responder, como detener un coche autónomo cuando aparece un obstáculo.

En este artículo, exploraremos qué es la computación de imágenes y cómo se utiliza en los sistemas de inteligencia artificial (IA) de última generación. ¡Empecemos!

La computación de imágenes es el proceso de capturar, procesar y analizar imágenes utilizando algoritmos avanzados. Trata las imágenes como datos que las máquinas pueden comprender y con los que pueden trabajar.

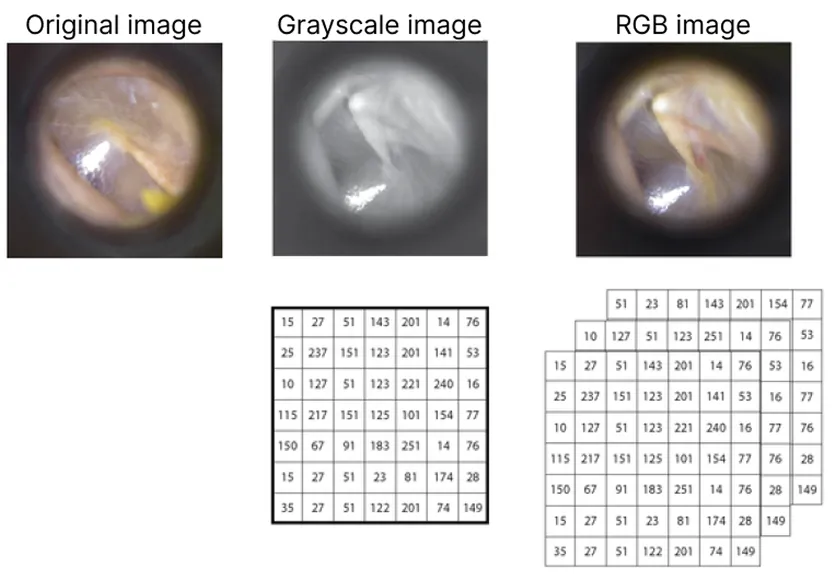

En otras palabras, cada imagen se procesa como una cuadrícula de números. Esto se hace convirtiendo los píxeles, las unidades más pequeñas de una imagen, en una matriz formada por filas y columnas. Cada píxel tiene un valor numérico que indica a la máquina el grado de luminosidad u oscuridad de una zona concreta de la imagen.

La forma en que se organizan estos valores depende de si la imagen es en escala de grises o en color. En las imágenes en escala de grises, los valores de los píxeles suelen oscilar entre 0 (negro) y 255 (blanco). En las imágenes en color, se utilizan múltiples matrices para representar diferentes canales de color, como rojo, verde y azul (RGB) o tono, saturación y valor (HSV).

Además de las matrices de píxeles, una imagen suele contener información contextual oculta, conocida como metadatos. Los metadatos proporcionan detalles importantes, como la resolución de la imagen, la profundidad de bits, la configuración de la cámara o el sensor y la hora exacta en que se capturó la imagen. Las imágenes se almacenan en formatos de archivo específicos para conservar tanto los datos visuales como los metadatos.

Por ejemplo, en la informática de imágenes biomédicas, las imágenes se almacenan habitualmente en formato DICOM (Digital Imaging and Communications in Medicine, Imágenes y comunicaciones digitales en medicina). El formato DICOM combina datos de imágenes visuales con información del paciente, como datos de identificación y ajustes del equipo, lo que garantiza que el análisis de las imágenes médicas sea preciso, coherente y seguro.

Ahora que comprendemos mejor qué es la computación de imágenes, veamos los pasos que se siguen para convertir las imágenes captadas por una cámara en información útil.

Aunque el flujo de trabajo exacto puede variar según la aplicación, la mayoría de los sistemas de computación de imágenes siguen estas etapas principales:

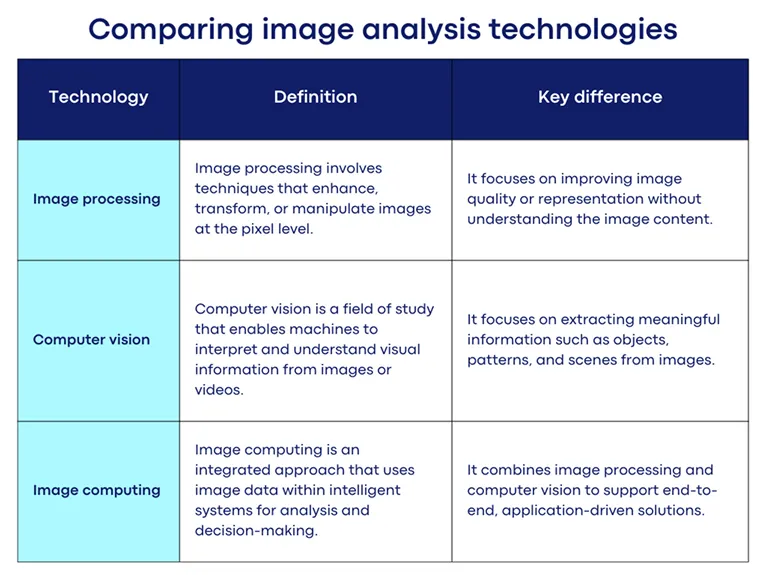

Cuando te encuentres con el término «computación de imágenes», es posible que también veas términos como «procesamiento de imágenes» y «visión artificial». Aunque estos términos suelen utilizarse indistintamente, describen diferentes formas en que los sistemas de IA interactúan con los datos visuales.

Por ejemplo, el procesamiento de imágenes se centra en la mejora de las imágenes o en la mejora de la calidad de las imágenes de entrada mediante operaciones básicas como la eliminación de ruido, el cambio de tamaño y el ajuste del contraste. Por su parte, la visión artificial, que es una rama de la IA, se basa en el procesamiento de imágenes y permite a las máquinas reconocer objetos, interpretar escenas y comprender lo que ocurre en imágenes o vídeos.

La computación de imágenes combina el procesamiento de imágenes y la visión artificial para transformar los datos visuales en resultados significativos y útiles para los sistemas inteligentes.

A continuación, veamos cómo se implementa actualmente la computación de imágenes.

En las primeras etapas de la computación de imágenes, características como los bordes, las esquinas y las texturas se definían manualmente utilizando algoritmos basados en reglas y creados artesanalmente. Aunque estas metodologías funcionaban razonablemente bien en entornos controlados, tenían dificultades para escalarse y adaptarse a las complejas condiciones del mundo real.

Los sistemas modernos de procesamiento de imágenes abordan estas limitaciones mediante el uso de enfoques basados en el aprendizaje profundo. Modelos como las redes neuronales convolucionales (CNN) y los transformadores de visión aprenden automáticamente las características relevantes a partir de grandes conjuntos de datos de imágenes. Esto les permite realizar tareas como la detección de objetos, la segmentación de instancias y el seguimiento de objetos con mayor precisión y solidez.

Hoy en día, los flujos de trabajo de computación de imágenes suelen basarse en modelos de visión en tiempo real diseñados para su implementación en sistemas de IA de última generación. Por ejemplo, los modelos de IA de visión como Ultralytics permiten capacidades de visión artificial rápidas y eficientes, como la detección de objetos y la segmentación de instancias, tanto en dispositivos periféricos como en entornos en la nube.

La computación de imágenes se utiliza ampliamente en aplicaciones del mundo real para comprender y actuar sobre datos visuales. Exploremos cómo se aplica la computación de imágenes en diferentes ámbitos.

La informática aplicada a la imagen puede ayudar a los médicos y clínicos a detectar enfermedades antes y analizar las exploraciones médicas de forma más eficiente. Estos innovadores sistemas sanitarios pueden procesar rápidamente datos de imágenes médicas, como radiografías y resonancias magnéticas (RM), y suelen ofrecer resultados más consistentes que la revisión manual.

Por ejemplo, modelos como Ultralytics pueden entrenarse con grandes conjuntos de imágenes de radiografías de tórax para aprender patrones relacionados con infecciones y anomalías. Una vez entrenados, estos modelos pueden ayudar a identificar si una exploración parece normal o muestra signos de afecciones como neumonía o COVID-19.

Los vehículos autónomos utilizan la computación de imágenes para comprender lo que sucede a su alrededor y tomar decisiones de conducción. La tecnología convierte las imágenes sin procesar de la cámara en información en tiempo real que ayuda al vehículo a moverse de forma segura y fluida.

La computación de imágenes se utiliza habitualmente en los sistemas avanzados de asistencia al conductor (ADAS). En lugar de limitarse a grabar vídeo, estos módulos analizan cada fotograma para detectar las marcas de los carriles, otros vehículos, peatones y obstáculos. Esto permite que el coche reaccione a las condiciones cambiantes de la carretera con poca intervención humana.

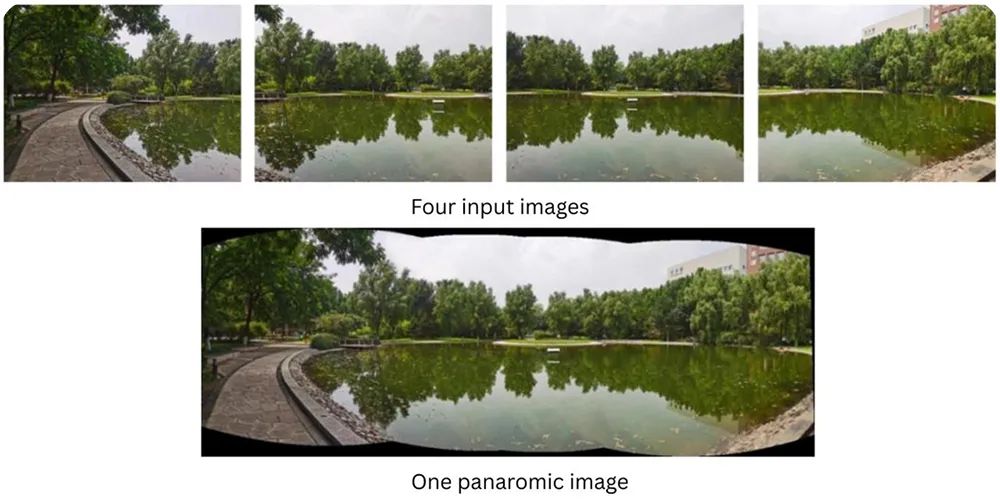

Otro caso de uso habitual es combinar imágenes de varias cámaras para crear una vista de 360 grados del entorno del vehículo. El procesamiento de imágenes ayuda a corregir la distorsión de la lente, mejorar la claridad de la imagen y equilibrar el brillo y el color en todas las señales de las cámaras. El resultado es una vista clara y sin interrupciones que permite al vehículo circular con seguridad, incluso en condiciones meteorológicas adversas o con poca luz.

Estas son algunas de las ventajas de la computación de imágenes:

Si bien existen muchas ventajas relacionadas con la computación de imágenes, también hay algunas limitaciones. A continuación se indican algunos factores que deben tenerse en cuenta:

La computación de imágenes ha evolucionado desde el procesamiento básico de imágenes hasta convertirse en una tecnología que permite a los sistemas de IA percibir y comprender el mundo real en tiempo real. A medida que el aprendizaje profundo sigue avanzando, la computación de imágenes se está convirtiendo en una parte esencial de la creación de herramientas y aplicaciones más inteligentes y prácticas.

Únase a nuestra comunidad y consulte nuestro repositorio GitHub para obtener más información sobre la IA. Explore nuestras páginas de soluciones para leer sobre las aplicaciones de la IA en la agricultura y la visión artificial en la logística. Descubra nuestras opciones de licencia y comience a crear modelos de IA con visión artificial.

Comience su viaje con el futuro del aprendizaje automático