Découvrez les meilleurs modèles de détection d'objets en 2025, avec un aperçu des architectures populaires, des compromis en matière de performances et des facteurs pratiques de déploiement.

Découvrez les meilleurs modèles de détection d'objets en 2025, avec un aperçu des architectures populaires, des compromis en matière de performances et des facteurs pratiques de déploiement.

Au début de cette année, Andrew Ng, pionnier dans le domaine de l'IA et de l'apprentissage automatique, a présenté le concept de détection d'objets par agent. Cette approche utilise un agent raisonneur pour detect à partir d'une invite textuelle, sans nécessiter de grandes quantités de données d'entraînement.

La capacité à identifier des objets dans des images et des vidéos sans avoir besoin d'énormes ensembles de données étiquetées constitue une avancée vers des systèmes de vision par ordinateur plus intelligents et plus flexibles. Cependant, l'IA de vision agentique en est encore à ses débuts.

Bien qu'il puisse traiter des tâches générales, telles que la détection de personnes ou de panneaux de signalisation dans une image, les applications de vision par ordinateur plus précises s'appuient toujours sur des modèles traditionnels de détection d'objets. Ces modèles sont entraînés à partir de grands ensembles de données soigneusement étiquetés afin d'apprendre exactement ce qu'il faut rechercher et où se trouvent les objets.

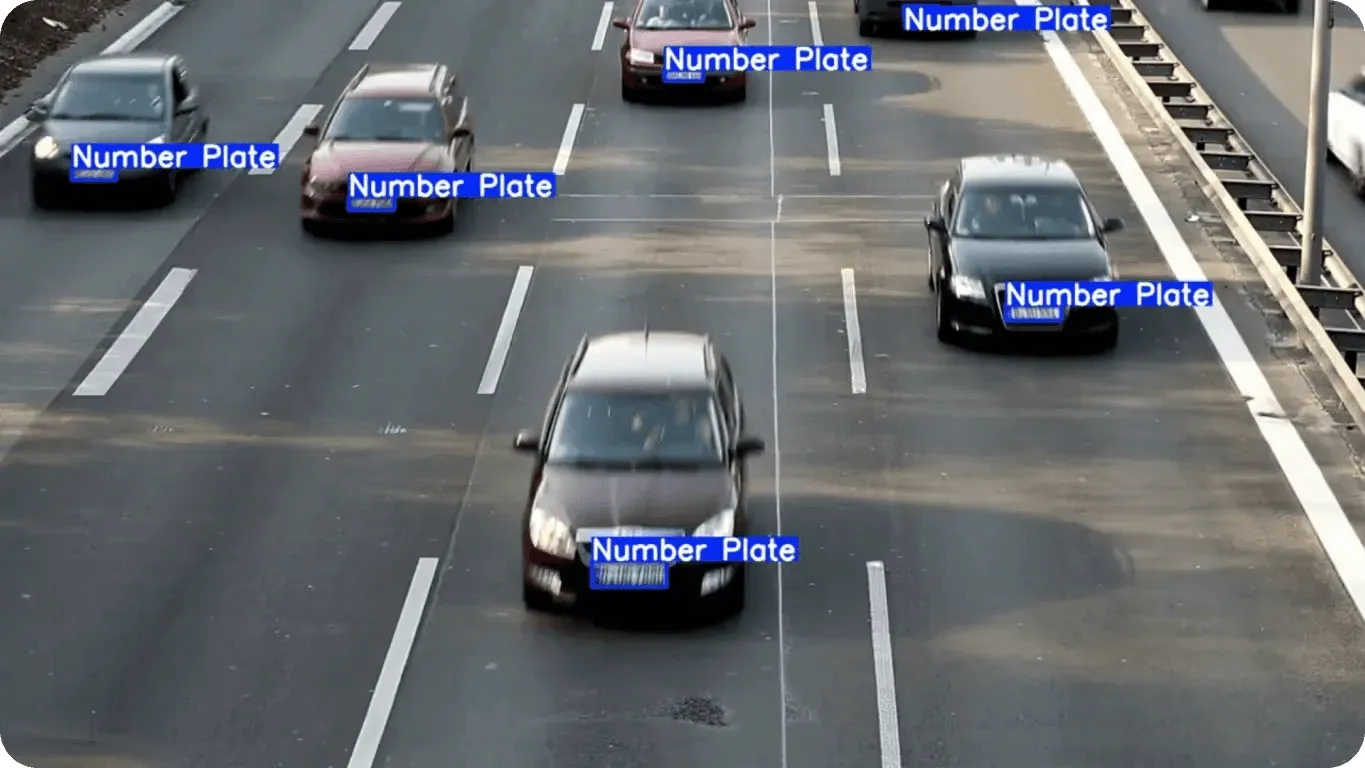

La détection traditionnelle d'objets est essentielle, car elle permet à la fois la reconnaissance (identifier ce qu'est l'objet) et la localisation (déterminer exactement où il se trouve dans l'image). Cette combinaison permet aux machines d'effectuer de manière fiable des tâches complexes dans le monde réel, qu'il s'agisse de véhicules autonomes, d'automatisation industrielle ou de diagnostics médicaux.

Grâce aux progrès technologiques, les modèles de détection d'objets continuent de s'améliorer, devenant plus rapides, plus précis et mieux adaptés aux environnements réels. Dans cet article, nous passerons en revue certains des meilleurs modèles de détection d'objets disponibles à l'heure actuelle. C'est parti !

Les tâches de vision par ordinateur telles que la classification d'images peuvent être utilisées pour déterminer si une image contient une voiture, une personne ou un autre objet. Cependant, elles ne permettent pas de déterminer où se trouve l'objet dans l'image.

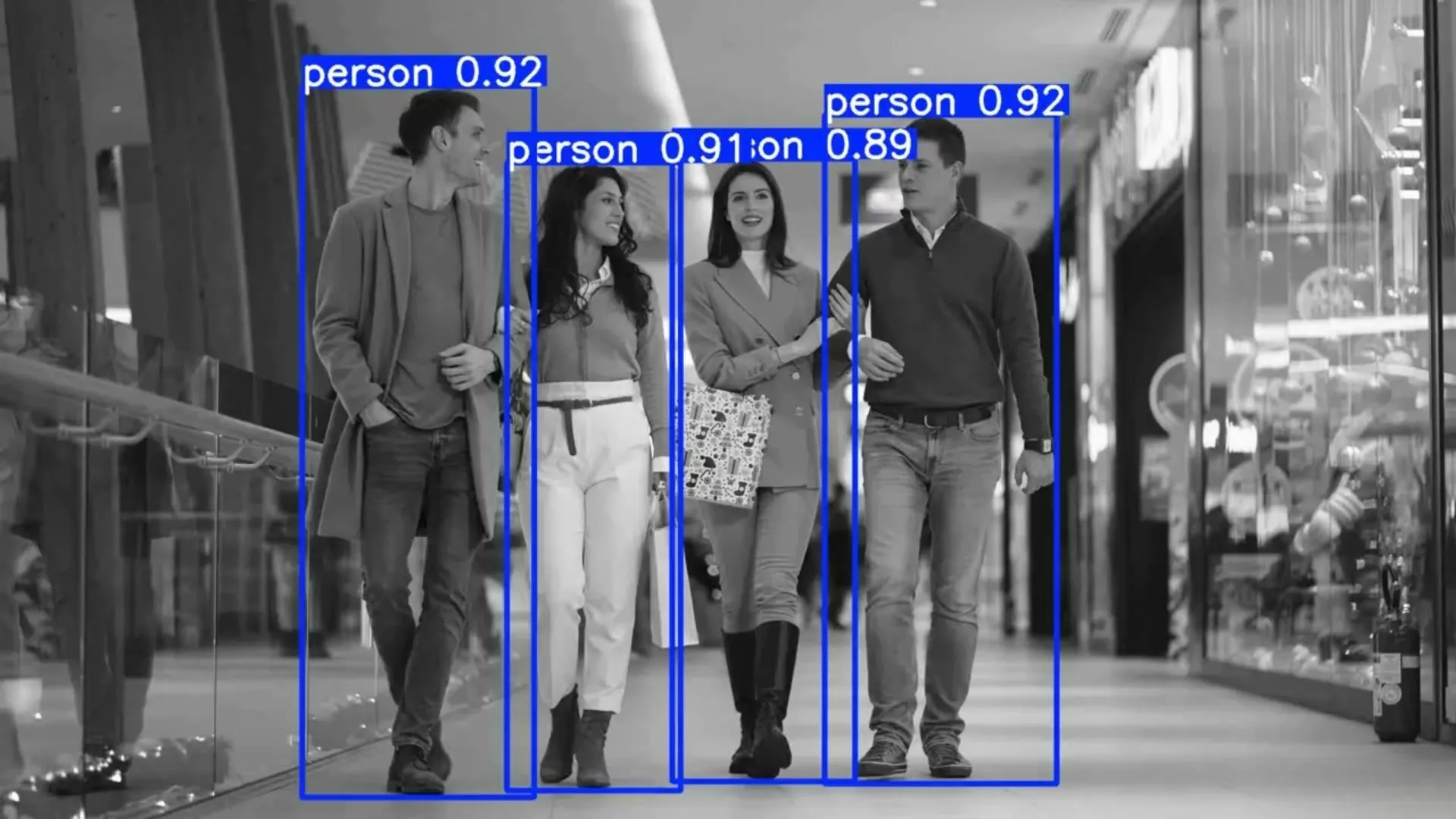

C'est là que la détection d'objets peut s'avérer utile. Les modèles de détection d'objets peuvent identifier les objets présents et localiser leur emplacement exact. Ce processus, appelé localisation, permet aux machines de comprendre les scènes avec plus de précision et de réagir de manière appropriée, qu'il s'agisse d'arrêter une voiture autonome, de guider un bras robotisé ou de mettre en évidence une zone dans l'imagerie médicale.

L'essor du deep learning a transformé la détection d'objets. Au lieu de s'appuyer sur des règles codées manuellement, les modèles modernes apprennent les modèles directement à partir d'annotations et de données visuelles. Ces ensembles de données enseignent aux modèles à quoi ressemblent les objets, où ils apparaissent généralement et comment gérer des défis tels que les petits objets, les scènes encombrées ou les conditions d'éclairage variables.

En fait, les systèmes de détection d'objets à la pointe de la technologie peuvent detect avec précision detect objets à la fois. Cela fait de la détection d'objets une technologie essentielle dans des applications telles que la conduite autonome, la robotique, les soins de santé et l'automatisation industrielle.

L'entrée d'un modèle de détection d'objets est une image, qui peut provenir d'une caméra, d'une image vidéo ou même d'un scan médical. L'image d'entrée est traitée par un réseau neuronal, généralement un réseau neuronal convolutif (CNN), qui est entraîné à reconnaître des modèles dans les données visuelles.

Au sein du réseau, l'image est analysée par étapes. En fonction des caractéristiques qu'il détecte, le modèle prédit quels objets sont présents et où ils apparaissent.

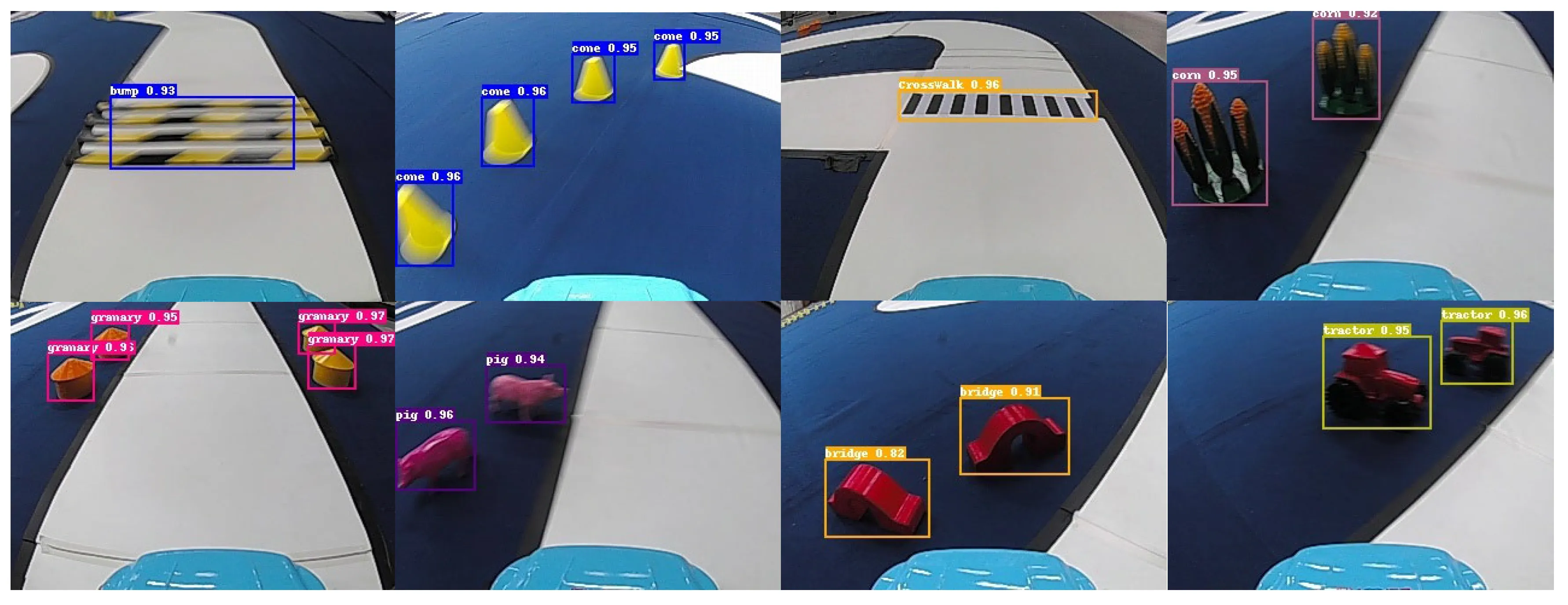

Ces prédictions sont représentées à l'aide de cadres de sélection, qui sont des rectangles dessinés autour de chaque objet détecté. Pour chaque cadre de sélection, le modèle attribue une étiquette de classe (par exemple, voiture, personne ou chien) et un score de confiance indiquant le degré de certitude de la prédiction (ce qui peut également être considéré comme une probabilité).

L'ensemble du processus repose largement sur l'extraction de caractéristiques. Le modèle apprend à identifier des motifs visuels utiles, tels que les contours, les formes, les textures et d'autres caractéristiques distinctives. Ces motifs sont encodés dans des cartes de caractéristiques, qui aident le réseau à comprendre l'image à plusieurs niveaux de détail.

Selon l'architecture du modèle, les détecteurs d'objets utilisent différentes stratégies pour localiser les objets, en équilibrant vitesse, précision et complexité.

De nombreux modèles de détection d'objets, en particulier les détecteurs à deux étapes comme Faster R-CNN, se concentrent sur des parties spécifiques de l'image appelées régions d'intérêt (ROI). En se concentrant sur ces zones, le modèle donne la priorité aux régions plus susceptibles de contenir des objets au lieu d'analyser chaque pixel de manière égale.

D'autre part, les modèles à étape unique, comme YOLO premiers YOLO , ne sélectionnent pas de ROI spécifiques comme le font les modèles à deux étapes. Au lieu de cela, ils divisent l'image en une grille et utilisent des boîtes prédéfinies, appelées boîtes d'ancrage, ainsi que des cartes de caractéristiques pour prédire les objets sur l'ensemble de l'image en un seul passage.

De nos jours, les modèles de détection d'objets de pointe explorent des approches sans ancrage. Contrairement aux modèles traditionnels à étape unique qui s'appuient sur des boîtes d'ancrage prédéfinies, les modèles sans ancrage prédisent l'emplacement et la taille des objets directement à partir de cartes de caractéristiques. Cela permet de simplifier l'architecture, de réduire la charge de calcul et d'améliorer les performances, en particulier pour la détection d'objets de formes et de tailles variables.

Il existe aujourd'hui de nombreux modèles de détection d'objets, chacun étant conçu dans un but précis. Certains sont optimisés pour offrir des performances en temps réel, tandis que d'autres visent à atteindre une précision maximale. Le choix du modèle adapté à une solution de vision par ordinateur dépend souvent de votre cas d'utilisation particulier et de vos exigences en matière de performances.

Ensuite, explorons certains des meilleurs modèles de détection d'objets de 2025.

L'une des familles de modèles de détection d'objets les plus utilisées aujourd'hui est la familleYOLO Ultralytics YOLO . YOLO, qui signifie « You Only Look Once » (vous ne regardez qu'une seule fois), est très populaire dans tous les secteurs d'activité, car il offre des performances de détection élevées tout en étant rapide, fiable et facile à utiliser.

YOLO Ultralytics YOLO comprend Ultralytics YOLOv5, Ultralytics YOLOv8, Ultralytics YOLO11et le prochain Ultralytics , offrant une gamme d'options pour différentes exigences en matière de performances et de cas d'utilisation. Grâce à leur conception légère et à leur optimisation de la vitesse,YOLO Ultralytics YOLO sont idéaux pour la détection en temps réel et peuvent être déployés sur des appareils périphériques avec une puissance de calcul et une mémoire limitées.

Au-delà de la détection d'objets de base, ces modèles sont très polyvalents. Ils prennent également en charge des tâches telles que la segmentation d'instances, qui délimite les objets au niveau des pixels, et l'estimation de la pose, qui identifie les points clés sur les personnes ou les objets. Cette flexibilité faitYOLO Ultralytics une option incontournable pour un large éventail d'applications, de l'agriculture et la logistique au commerce de détail et à la fabrication.

Une autre raison majeure expliquant la popularité desYOLO Ultralytics est le Python Ultralytics , qui offre une interface simple et conviviale pour l'entraînement, le réglage fin et le déploiement des modèles. Les développeurs peuvent commencer avec des poids pré-entraînés, personnaliser les modèles pour leurs propres ensembles de données et les déployer en quelques lignes de code seulement.

RT‑DETR (Real-Time Detection Transformer) et le plus récent RT‑DETRv2 sont des modèles de détection d'objets conçus pour une utilisation en temps réel. Contrairement à de nombreux modèles traditionnels, ils peuvent prendre une image et fournir directement les détections finales sans utiliser la suppression non maximale (NMS).

NMS une étape qui supprime les boîtes qui se chevauchent lorsque un modèle prédit plusieurs fois le même objet. En sautant NMS , le processus de détection NMS plus simple et plus rapide.

Ces modèles combinent les CNN et les transformateurs. Le CNN détecte les détails visuels tels que les contours et les formes, tandis que le transformateur est un type de réseau neuronal capable d'examiner l'image dans son ensemble et de comprendre les relations entre ses différentes parties. Cette compréhension globale permet au modèle detect proches les uns des autres ou qui se chevauchent.

RT‑DETRv2 améliore le modèle original grâce à des fonctionnalités telles que la détection multi-échelle, qui permet de trouver à la fois les petits et les grands objets, et une meilleure gestion des scènes complexes. Ces modifications permettent au modèle de rester rapide tout en améliorant sa précision.

RF‑DETR est un modèle en temps réel basé sur un transformateur, conçu pour combiner la précision des architectures de transformateurs avec la vitesse nécessaire aux applications du monde réel. Tout comme RT‑DETR et RT‑DETRv2, il utilise un transformateur pour analyser l'image dans son ensemble et un CNN pour extraire des caractéristiques visuelles fines telles que les contours, les formes et les textures.

Le modèle prédit les objets directement à partir de l'image d'entrée, en ignorant les boîtes d'ancrage et la suppression non maximale, ce qui simplifie le processus de détection et maintient la rapidité de l'inférence. RF‑DETR prend également en charge la segmentation d'instances, ce qui lui permet de délimiter les objets au niveau des pixels en plus de prédire les boîtes englobantes.

Lancé fin 2019, EfficientDet est un modèle de détection d'objets conçu pour une mise à l'échelle efficace et des performances élevées. Ce qui distingue EfficientDet, c'est la mise à l'échelle composite, une méthode qui adapte simultanément la résolution d'entrée, la profondeur du réseau et la largeur du réseau plutôt que d'ajuster un seul facteur. Cette approche permet au modèle de conserver une précision stable, qu'il soit mis à l'échelle pour des tâches hautes performances ou réduit pour des déploiements légers.

Un autre élément clé d'EfficientDet est son réseau pyramidal efficace (FPN), qui permet au modèle d'analyser les images à plusieurs échelles. Cette analyse multi-échelle est cruciale pour détecter des objets de différentes tailles, permettant à EfficientDet d'identifier de manière fiable les petits et les grands objets dans une même image.

Sorti en 2022, PP-YOLOE+ est un modèle de détection d'objets YOLO, ce qui signifie qu'il détecte et classe les objets en un seul passage sur l'image. Cette approche le rend rapide et adapté aux applications en temps réel, tout en conservant une grande précision.

L'une des principales améliorations apportées à PP-YOLOE+ est l'apprentissage aligné sur les tâches, qui permet aux scores de confiance du modèle de refléter la précision avec laquelle les objets sont localisés. Cela s'avère particulièrement utile pour détecter des objets petits ou qui se chevauchent.

Le modèle utilise également une architecture à tête découplée, qui sépare les tâches de prédiction de l'emplacement des objets et des étiquettes de classe. Cela lui permet de tracer des cadres de sélection plus précis tout en classifiant correctement les objets.

GroundingDINO est un modèle de détection d'objets basé sur un transformateur qui combine la vision et le langage. Au lieu de s'appuyer sur un ensemble fixe de catégories, il permet aux utilisateurs detect à l'aide de commandes textuelles en langage naturel.

En alignant les caractéristiques visuelles d'une image avec des descriptions textuelles, le modèle peut localiser des objets même si ces étiquettes exactes ne figuraient pas dans ses données d'entraînement. Cela signifie que vous pouvez fournir au modèle des descriptions telles que « une personne portant un casque » ou « une voiture rouge près d'un bâtiment », et il générera des cadres de sélection précis autour des objets correspondants.

De plus, grâce à la prise en charge de la détection sans apprentissage, GroundingDINO réduit la nécessité de réentraîner ou d'ajuster le modèle pour chaque nouveau cas d'utilisation, ce qui le rend très flexible pour un large éventail d'applications. Cette combinaison de compréhension du langage et de reconnaissance visuelle ouvre de nouvelles possibilités pour les systèmes d'IA interactifs et adaptatifs.

Lorsque vous comparez différents modèles de détection d'objets, vous vous demandez peut-être comment déterminer lequel est réellement le plus performant. C'est une bonne question, car au-delà de l'architecture du modèle et de la qualité de vos données, de nombreux facteurs peuvent influencer les performances.

Les chercheurs s'appuient souvent sur des benchmarks communs et des mesures de performance standard pour évaluer les modèles de manière cohérente, comparer les résultats et comprendre les compromis entre vitesse et précision. Les benchmarks standard sont particulièrement importants car de nombreux modèles de détection d'objets sont évalués sur les mêmes ensembles de données, tels que COCO .

Voici un aperçu détaillé de certains indicateurs couramment utilisés pour évaluer les modèles de détection d'objets :

Voici quelques-uns des principaux avantages liés à l'utilisation de modèles de détection d'objets dans des applications concrètes :

Malgré ces avantages, il existe des limites pratiques qui peuvent affecter les performances des modèles de détection d'objets. Voici quelques facteurs essentiels à prendre en compte :

Le meilleur modèle de détection d'objets pour votre projet de vision par ordinateur dépend de votre cas d'utilisation, de la configuration de vos données, de vos exigences en matière de performances et des contraintes matérielles. Certains modèles sont optimisés pour la vitesse, tandis que d'autres se concentrent sur la précision, et la plupart des applications réelles nécessitent un équilibre entre les deux. Grâce aux frameworks open source et aux communautés actives sur GitHub, ces modèles sont de plus en plus faciles à évaluer, à adapter et à déployer pour une utilisation pratique.

Pour en savoir plus, explorez notre référentiel GitHub. Rejoignez notre communauté et consultez nos pages Solutions pour découvrir des applications telles que l'IA dans le domaine de la santé et la vision par ordinateur dans l'industrie automobile. Découvrez nos options de licence pour commencer à utiliser Vision AI dès aujourd'hui.

Commencez votre parcours avec l'avenir de l'apprentissage automatique