ナビゲーションソリューションにおけるコンピュータビジョンが、リアルタイムマッピング、物体認識、拡張現実をどのように強化し、よりスマートで安全な移動体験を実現するかをご覧ください。

ナビゲーションソリューションにおけるコンピュータビジョンが、リアルタイムマッピング、物体認識、拡張現実をどのように強化し、よりスマートで安全な移動体験を実現するかをご覧ください。

今日、携帯電話を取り出し、目的地を入力し、ステップごとの指示に従ってそこに着くのは簡単だと感じます。ほんの数秒でできることです。しかし、この日常的な便利さは、長年の技術進歩の結果です。ナビゲーションは、紙の地図やコンパスから、リアルタイムで世界を理解し、対応できるインテリジェントシステムへと大きく進化しました。

この変化の背景にある技術の1つがコンピュータビジョンです。これは、機械が人間のように視覚情報を解釈できるようにする人工知能(AI)の一分野です。最先端のナビゲーションツールは現在、衛星、ドライブレコーダー、および道路レベルのセンサーからのリアルタイム画像を使用して、地図の精度を向上させ、道路状況を監視し、複雑な環境でユーザーを誘導しています。

この記事では、コンピュータビジョンがGPSマップの改善、リアルタイムの交通状況の更新、拡張現実ナビゲーションや自動運転車などのテクノロジーのサポートを通じて、ナビゲーションをどのように強化しているかについて解説します。

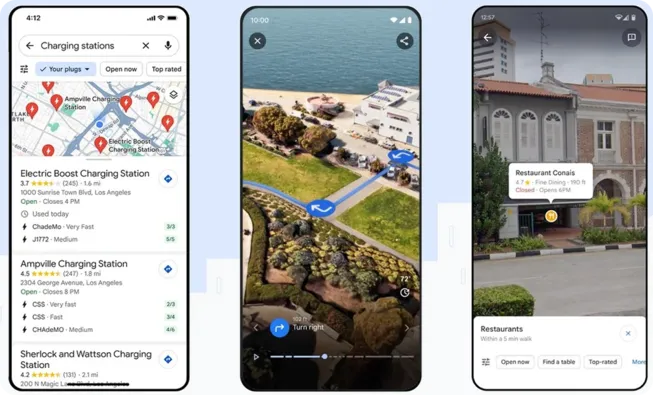

Google マップのようなツールを使って日常生活をナビゲートすることは、街を横断するときでも、近くのカフェを探すときでも、ごく一般的になっている。AI技術がより広く採用されるようになるにつれ、Google 2023年に導入したイマーシブ・ビューのような、3D環境で旅の一部をプレビューできる高度な機能がますます増えている。これは、AI、写真測量、コンピュータ・ビジョンの組み合わせによって実現されている。

すべては、さまざまな特殊機器によって撮影された数十億枚の高解像度画像から始まります。これには、都市を走り回る360度カメラを搭載したStreet Viewカーや、車両が到達できないハイキングコースや狭い路地などで画像をキャプチャするために使用される、カメラを搭載したウェアラブルバックパックであるTrekkerデバイスが含まれます。

これらの画像は、写真測量法を用いて地図データと位置合わせされています。写真測量法とは、異なる角度から撮影された2D写真を繋ぎ合わせて、道路、建物、地形の正確な3Dモデルを作成する技術です。

次に、コンピュータビジョンを使用してこれらのモデルを分析し、物体検出と画像セグメンテーションを使用して、道路標識、歩道、横断歩道、建物の入り口などの重要な機能を識別してラベル付けします。

ラベル付けされたデータは、地域間で視覚的な手がかりがどのように異なるかを認識するAIシステムをトレーニングするために使用されます。たとえば、システムは、米国では通常黄色またはオレンジ色のひし形である「SLOW」標識と、日本では通常赤と白の三角形である同様の標識を簡単に区別できます。このレベルの理解により、ナビゲーション体験がより正確になり、文化的に認識されるようになります。

最後に、没入型ビューはライブナビゲーションパスを3D環境に重ね合わせ、どこに向かっているかを正確に示す、スムーズで直感的な体験を提供します。

Google 指し示す方向がわからず、ぐるぐる回った経験は誰にでもあるだろう。拡張現実(AR)ナビゲーションは、現実世界のカメラビューにデジタル情報を重ね合わせる技術で、まさにその混乱を解決することを目的としている。ARは、市街地や広い屋内のような混雑した場所で、人々が自分の道を見つける方法を変えようとしている。

通常地図は、特にGPS信号が弱い、またはうまく機能しない場合に、追跡が難しいことがあります。ARナビゲーションは、現実世界のライブカメラビューにデジタル方向、矢印、ラベルを直接表示することで、これに対処します。これは、ユーザーが周囲の道路や建物に一致するガイダンスを見ることを意味し、どこに行くべきかをはるかに簡単に把握できます。

ARナビゲーションは、デバイスのカメラを通して環境を理解するために、コンピュータビジョンモデルに依存しています。これには、建物の縁や道路標識などの特徴を検出し、保存された地図と照合する画像ローカリゼーションなどのさまざまなタスクが含まれます。自己位置推定と地図作成(SLAM)は、デバイスのリアルタイムな位置を追跡しながら、環境の地図を作成します。

例えば、チューリッヒ空港は、屋内ナビゲーションのためにGoogle ライブビューを導入した最初の空港である。利用者は携帯電話のカメラを使って、現実の環境に矢印や案内を重ね合わせて見ることができ、ターミナルからゲート、ショップ、サービスへと誘導される。これにより、複雑な屋内空間でのナビゲーションが容易になり、乗客の体験が向上する。

都市の通りは日々混雑しています。道路上の車の増加、混雑した歩道、絶え間ない活動により、交通の流れをスムーズかつ安全に保つことは、ますます困難になっています。この混乱を管理するために、多くの都市がAIとコンピュータビジョンに目を向けています。

交差点や道路沿いに設置されたスマートカメラやセンサーは、安定した映像データを取得する。その映像はリアルタイムで処理され、事故のdetect 、交通流の監視、穴の発見、違法駐車や危険な歩行者の行動などをキャッチする。

興味深い例として、中国の杭州にあるスマート空港高速道路があります。杭州のダウンタウンと蕭山国際空港を結ぶこの20キロメートルの高速道路は、高解像度カメラとミリ波レーダーでアップグレードされました。これらのデバイスは、ビデオとセンサーデータを継続的に収集し、コンピュータビジョンを使用して分析されます。

単に映像を記録するだけでなく、システムは道路上で何が起きているかを解釈する。コンピューター・ビジョンのアルゴリズムは、車両の衝突をdetect し、交通違反を認識し、さらには高速道路の出口付近の歩行者や異常な動きを特定する。これにより、交通関係者は現場にいなくても、数秒以内に事故に対応することができる。

データはまた、デジタルツインにも供給されます。これは、リアルタイムの交通状況、車両の詳細、および発生する渋滞を示す、高速道路のライブ3D仮想モデルです。交通整理員は、この視覚的なインターフェースを監視して、流れを管理し、スマートアラートを発行し、インシデントに迅速かつ正確に対応します。

今日のナビゲーションは、単にポイントAからポイントBに到達するだけではありません。道路上であろうと倉庫内であろうと、人や物を移動させ、商品を管理し、リアルタイムで意思決定を行うインテリジェントシステムにとって、今や不可欠な部分となっています。

これらのシステムの多くの中核となるのはコンピュータビジョンであり、マシンが視覚データを解釈し、周囲の状況に即座に応答できるようにします。このテクノロジーがさまざまな環境でのナビゲーションをどのように変革しているかを確認するために、いくつかの例を見ていきましょう。

ロボットは、特に大規模な倉庫業務において、ロジスティクスの未来に不可欠になりつつあります。eコマースの需要が高まるにつれて、企業は複雑な環境をナビゲートし、アイテムをソートし、コンピュータビジョンを搭載したマシンにますます依存して、在庫を迅速かつ正確に管理しています。

例えば、Amazonのフルフィルメントセンターでは、75万台以上のロボットが人間と協力して業務を効率的に運営しています。これらのロボットは、混雑した倉庫の床を移動し、アイテムを識別し、迅速かつ正確な意思決定を行うために、コンピュータービジョンに大きく依存しています。

そのようなシステムの1つがSequoiaです。これは、在庫処理を迅速化するように設計されたロボットプラットフォームです。高度なコンピュータビジョンを使用して、入荷する製品をスキャン、カウント、および整理し、ストレージと検索のプロセスを効率化します。

同様に、ロボットアームのVulcanは、カメラと画像分析を使用して棚からアイテムを安全に取り出し、各オブジェクトの形状と位置に基づいてグリップを調整し、人間の支援が必要な場合も認識します。一方、別の視覚対応ロボットであるCardinalは、仕分けを専門としています。混在した荷物の山をスキャンし、正しい発送カートに正確に配置します。

これまで、コンピュータビジョンが人々とロボットが環境をナビゲートするのにどのように役立つかを見てきました。しかし、自動運転車のような自律システムにとっても同様に重要であり、ナビゲーションは車両がリアルタイムで見たり理解したりできるものに完全に依存しています。

良い例としては、Tesla Visionシステムがあります。Teslaは、自動運転に対してカメラのみのアプローチを採用し、車の周囲を360度完全に表示するカメラネットワークを優先して、レーダーやその他のセンサーを取り除きました。これらのカメラは、視覚データをFull Self-Driving(FSD)コンピュータに供給し、深層ニューラルネットワークを使用して環境を解釈し、瞬時の運転判断を行います。

システムは、見ているものに基づいて、人間のドライバーが行うように、ステアリング、加速、ブレーキ、または車線変更のタイミングを決定しますが、すべて視覚入力のみを通じて行われます。Teslaは、フリート全体からの大量の実際の運転データを収集し、学習することで、このシステムを継続的に改善しています。

ナビゲーション、特に精度、安全性、リアルタイムの意思決定が不可欠なシステムでコンピュータビジョンを使用する主な利点をいくつかご紹介します。

コンピュータビジョンはナビゲーションに多くの利点をもたらしますが、このようなソリューションを実装する際には、考慮すべき重要な制限事項もいくつかあります。留意すべき主な課題を以下に示します。

コンピュータビジョンは、地図をよりダイナミックに、交通システムをよりスマートに、モビリティをよりアクセスしやすくすることで、ナビゲーションを再構築しています。かつて静的だったルートは、没入型3Dプレビュー、ARガイド付きの道案内、自動輸送技術によって強化された、リアルタイムのインタラクティブな体験になりました。

テクノロジーが進歩するにつれて、これらのシステムをより包括的で、適応性があり、責任あるものにすることに焦点が移る可能性があります。継続的な進歩は、多様な環境での精度の向上、信頼性の高いパフォーマンスの維持、およびユーザーのプライバシーの保護にかかっています。ナビゲーションにおけるコンピュータビジョンの未来は、インテリジェントであるだけでなく、設計と影響において思慮深いソリューションを構築することにあります。

成長を続けるコミュニティに参加しましょう!GitHubリポジトリを探索して、AIについて学び、ライセンスオプションを確認して、Vision AIプロジェクトを始めましょう。小売業におけるAIや農業におけるコンピュータビジョンなどのイノベーションにご興味がありますか?ソリューションページにアクセスして、詳細をご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。