コンピュータ・ビジョンの進歩を促進し、より速く、より賢く、より信頼性の高いAI搭載システムを実現する、未来の物体検出に関する7つのトレンドについてご紹介します。

コンピュータ・ビジョンの進歩を促進し、より速く、より賢く、より信頼性の高いAI搭載システムを実現する、未来の物体検出に関する7つのトレンドについてご紹介します。

ロボットタクシーがサンフランシスコの街を闊歩し、人々はオンラインで答えを探すことから、日常生活の一部としてAIとチャットするようになった。これらのシフトは、人工知能(AI)がかつてないほど速く移動し、日常生活の一部になりつつあることを明らかにしている。

例えば、驚異的なスピードで前進している分野のひとつに、コンピューター・ビジョン技術がある。ビジョンAIとして知られるこの分野は、機械が視覚データを解釈し理解することに焦点を当てたAIのサブフィールドである。

自動化されたレジレーンから送電線を調査するドローンまで、コンピュータ・ビジョンはすでにいたるところで登場している。これらのシステムの多くは、画像や映像内の特定の物体を機械が認識し、位置を特定することを可能にする、コンピュータビジョンの核となるタスクである物体検出を中核としている。

AIの導入が加速するにつれ、高速かつ高精度な物体検出の需要も高まっている。ビジョンAIモデル Ultralytics YOLO11や近日発売予定のUltralytics YOLO26のようなビジョンAIモデルは、このことを念頭に置いて構築されており、リアルタイムの物体検出をこれまで以上に信頼性の高い身近なものにします。

この急速な進歩に伴い、この分野は急速に進化しており、いくつかの新たなトレンドが次世代の物体検出の姿を形作りつつある。この記事では、物体検出の未来を定義する7つの主要トレンドを探る。

今後のオブジェクト検出のトレンドに飛び込む前に、一歩下がって、オブジェクト検出とは何か、それが舞台裏でどのように機能し、長年にわたってどのように発展してきたかを見てみよう。

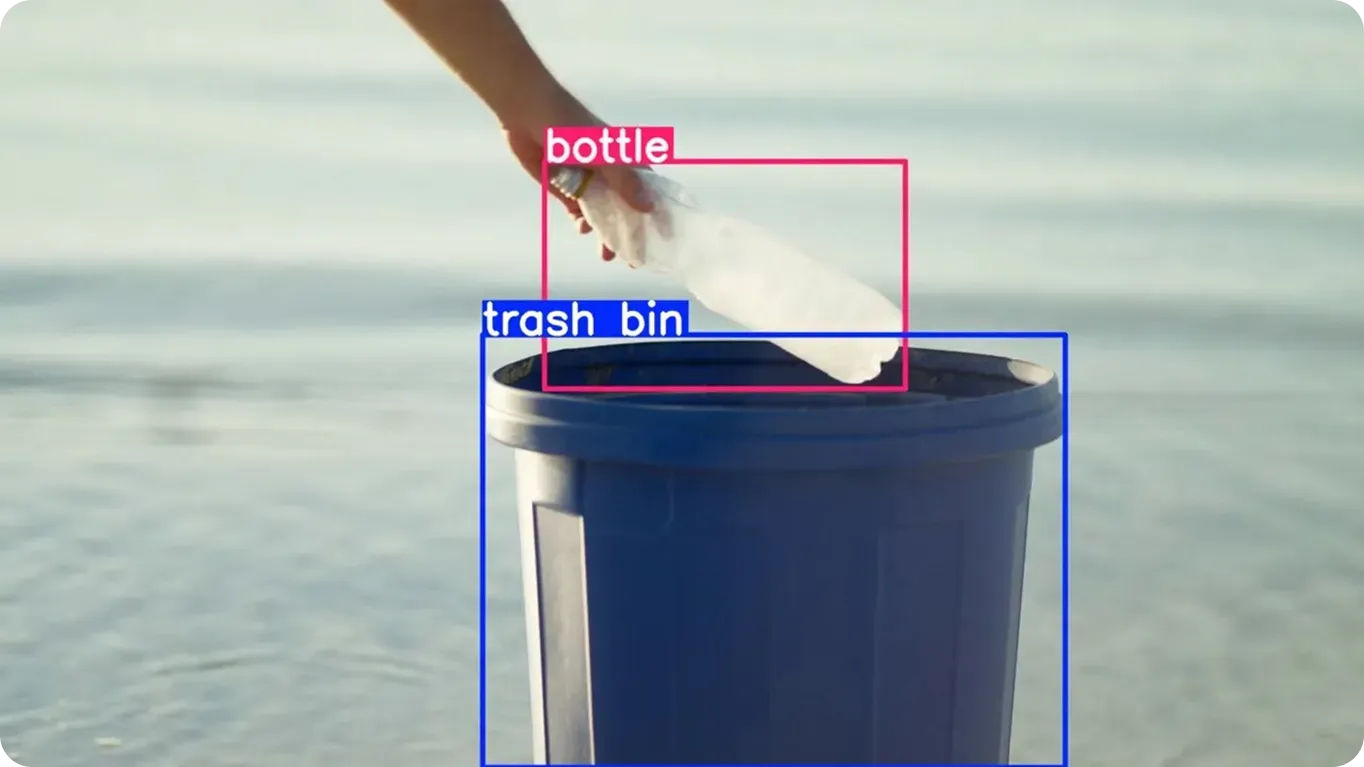

物体検出は、AIシステムが画像に何が写っているかを識別し、各物体がどこに写っているかを正確に判断することを可能にする、コンピュータビジョンの重要な部分である。これを学習するために、モデルは、様々な角度、照明、サイズ、レイアウトなど、多くの異なる条件で物体を示す大規模なラベル付きデータセットで学習される。

時間の経過とともに、モデルはある物体と別の物体を分けるパターンや視覚的な手がかりを拾い上げる。一度訓練されると、Ultralytics YOLO ようなビジョンAIモデルは、画像全体を1回でスキャンし、即座にバウンディングボックスを描き、ラベルを割り当てることができます。このスピードと正確さが、実世界のアプリケーションにおいて物体検出をインパクトのあるものにしています。

例えば、文書分析では、Prezentのような企業がオブジェクト検出を使用して、プレゼンテーションスライドの再設計という困難な作業を自動化しています。従来、このプロセスでは、タイトルの特定、テキストボックスの位置変更、画像の位置合わせ、グラフの再構築など、きれいで一貫性のあるレイアウトを維持しながら、手作業で何時間もかけて調整する必要がありました。

各スライドを画像に変換することで、Ultralytics YOLO モデルは元の構造を保持したまま、タイトル、テキストボックス、画像、detect ことができます。これにより、システムは各要素がどのように配置されているかを正確に理解することができます。この情報により、かつては時間がかかり面倒であった再設計プロセス全体が、わずか数秒で自動化できるようになりました。

ここでは、物体検出が長年にわたってどのように進化してきたかを簡単に見てみよう:

次に、コンピュータビジョンの分野で注目を集め、話題を呼んでいる7つの新たな物体検出のトレンドを探ってみよう。

従来の手作業によるチェックは、生産ラインを遅らせ、欠陥の見逃しの余地を残す可能性がある。このような事態に対処するため、多くの企業が物体検出機能を搭載したAI主導の品質管理システムを導入している。

実際、AIベースの目視検査は生産性を大幅に向上させ、時には50%も向上させ、手作業による検査に比べて欠陥検出率を最大90%向上させることができるという研究結果もある。興味深いことに、この分野や他のVision AIアプリケーションで波紋を広げている新しいトレンドは、この分析がエッジ・コンピューティングを通じてデバイス自体で直接行われるようになっていることだ。

エッジ・コンピューティングにより、インテリジェンスはデータがキャプチャされる場所に近づく。カメラやセンサーはその場で物体検出モデルを実行し、クラウド処理に頼ることなく瞬時に物体を特定し、その位置を決定することができる。これにより、リアルタイムでフレームを分析することができる。

また、ネットワークの遅延を減らし、帯域幅の使用量を削減し、インターネット接続が不安定であったり、利用できなかったりしても、システムが動作し続けることを保証します。製造業のようなペースの速い環境では、このオンデバイス処理へのシフトは、迅速な応答、スムーズなオペレーション、そしてはるかに信頼性の高い結果をもたらします。

医師は見落としがないよう、医療画像の確認に多くの時間を費やすことが多い。現在、多くの病院が、スピードアップのために最先端の物体検出技術を模索し始めている。これは、より早期発見、より迅速な診断、より一貫性のある画像解析をサポートするためにVision AIがますます使用されるようになってきている、ヘルスケアにおける広範な傾向を反映している。

物体検出は、注意を払う必要がありそうな領域を素早く強調するために使用でき、意思決定を強化し、患者の転帰を改善する。例えば、YOLO11 ようなモデルは、医師がMRIスキャンで脳腫瘍を発見するのに役立つ。

YOLO11 MRI検査の微妙なパターンを認識することができるので、小さな腫瘍や早期の腫瘍をより正確に特定することができる。最終的な診断は医師が行うが、YOLO11 ようなツールは、潜在的な懸念をより早く顕在化させ、重要なものを見落とさないようにすることで、医師による検討の効率化をサポートすることができる。

交通量の多い市街地では、自動運転車はカメラとセンサーに頼って周囲の状況を常時監視している。これらのシステムは、歩行者、車両、車線、道路標識をリアルタイムでdetect する。コンピューター・ビジョンと物体検出アルゴリズムの助けを借りて、自律走行車は周囲で起きていることを解釈し、より安全な自律走行の判断を下すことができる。

多様な交通パターンがあり、さまざまな車両が混在する地域では、こうしたシステムはさらに複雑になる。 例えば、最近の研究では Ultralytics YOLOv8のモデルをハイデラバードとバンガロールで収集した交通データで評価した。ハイデラバードでは、自動車、バス、オートバイ、自転車、オートリキシャなど、さまざまな車両がダイナミックかつしばしば予測不可能な方法で道路を共有している。

その結果、YOLOv8 このような困難なシナリオでも高い性能を発揮し、密集した非構造的な交通状況でも幅広い物体を正確に検出した。これは、自律型モビリティにおける増加傾向を浮き彫りにしている:ビジョンAIモデルは、かつて自動運転システムにとって大きな課題であった複雑な実環境に対応できるようになってきている。

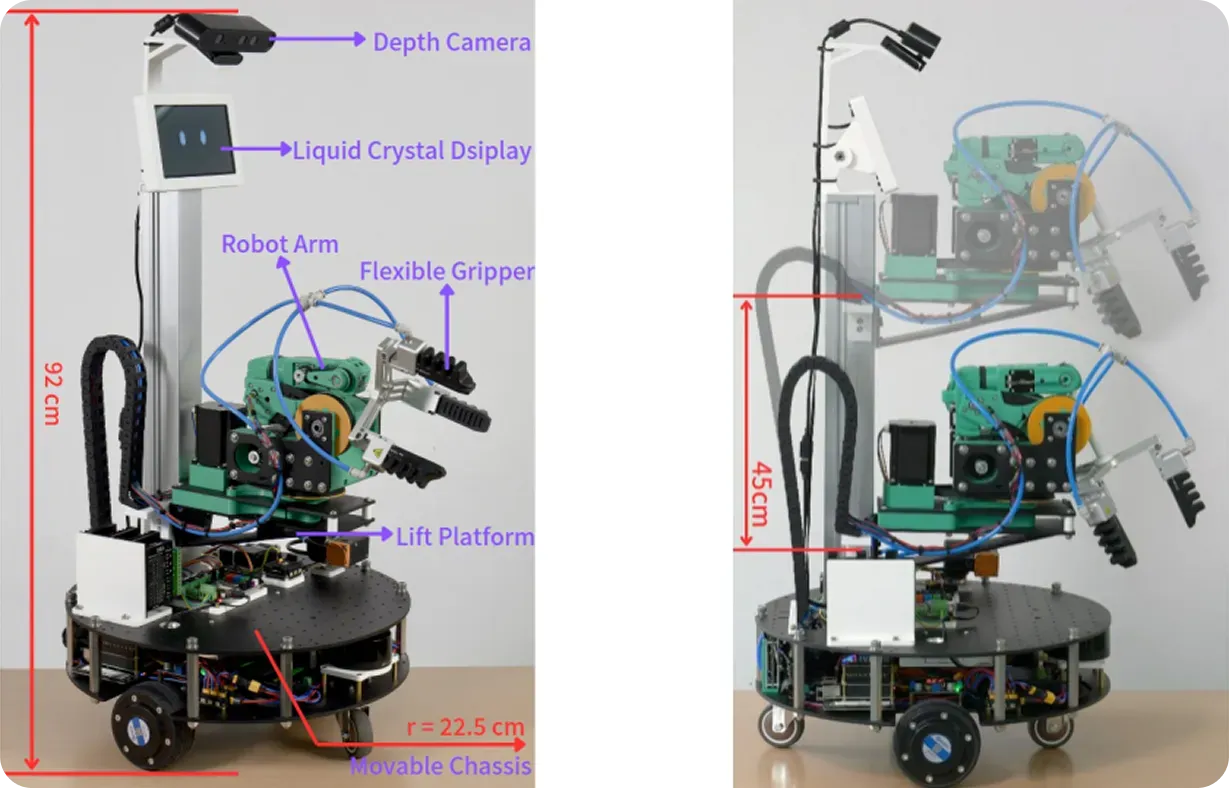

小さな物体を扱ったり、検出された物体や材料を選別したり、散らかった空間を移動したりすることは、ロボットにとって常に挑戦的な課題でした。これらの作業には、迅速な適応と正確な動作が要求されますが、従来の自動化システムでは、予測不可能な環境下で苦労することがよくありました。

ロボット工学の成長トレンドは、ロボットにリアルタイムで周囲の状況を認識し反応する能力を与えるビジョンAIの利用である。このシフトを探るため、研究者グループは最近、室内空間を移動しながら物体を認識し、分類できる家庭用ロボットを開発した。

物体検出にYOLO11 ようなモデルを使用し、深度カメラとフレキシブル・グリッパーを併用することで、ロボットはさまざまな形や大きさのアイテムを識別し、正しい位置に自力で配置することができた。この実験は、コンピュータ・ビジョンとロボット・システムを組み合わせることで、空間認識能力と応答性をいかに向上させることができるかを示している。

また、最先端のAI技術が、時間の経過とともに視覚的なパターンから学習することで、ロボットが不慣れな環境に適応するのに役立っていることも示している。このような進歩により、ロボットはより有能になり、家事支援から倉庫物流、医療支援に至るまで、日常的なタスクに組み込まれるようになってきている。

スマートな監視システムは、異常または危険な活動を発見するために人工知能を急速に採用しています。物体検出モデルにより、カメラは潜在的な問題をリアルタイムで認識し、セキュリティチームにすぐに警告を発することができるため、予防と対応の両方を改善することができます。

例えば、安全上の理由からスマートフォンの使用が制限されている製造施設では、AIシステムが、スマートフォンが現れた瞬間に自動的にdetect し、YOLO その他のビジョンモデルを使ってその動きをtrack することができる。これは、よりプロアクティブに環境を監視し、潜在的なリスクに迅速に対応するためにビジョンAIが使用されているセキュリティの広い傾向を反映している。

検知だけでなく、こうしたシステムを他のテクノロジーと組み合わせて、より完全なセキュリティ・ソリューションを構築するケースも増えている。エッジ・デバイスは、映像をローカルで処理し、遅延を減らしてパフォーマンスの信頼性を維持することを可能にし、入退室管理システムや顔認識などのツールは、検証のレイヤーを追加することができます。これらの技術を組み合わせることで、よりスマートで、実際の状況に迅速かつ効果的に対応できる、より接続性の高い監視ネットワークを構築することができます。

多忙な倉庫や大規模な小売スペースでは、作業員は多くのタスクを同時に管理する必要があります。拡張現実は、デジタルガイダンスを現実世界に直接配置することで役立ちます。物体検出と組み合わせることで、ARシステムは物品を識別し、それらがどこにあるかをtrack し、有用な情報をリアルタイムで表示することができる。これにより、日々の作業がより簡単に、より速く、より直感的になります。

この分野の成長トレンドは、Vision AIを使用して、日常的なデバイスを周囲の状況を理解できるインテリジェントなアシスタントに変えることだ。ARと物体検出の融合が進むにつれて、職場はハンズフリーのガイダンスとより効率的なワークフローをサポートする没入型ツールを採用し始めている。

その好例が、現在開発・テスト中のアマゾンのAI搭載ARメガネだ。このメガネは、物体検出と画像分類を使って荷物を認識し、作業員を正しいルートに沿って誘導し、配達証明を記録する。これにより、より安全でハンズフリーな体験が可能になり、作業員が一日中集中し、効率的に作業できるようになる。

スマート・デバイスは、周囲の環境を見て、理解し、反応できるインテリジェント・システムになった。モノのインターネット(IoT)は、カメラ、センサー、機械、スマートアプリをネットワークに接続し、データの収集とリアルタイム処理を行うことで、この変化を推進している。

IoTが物体検知やエッジコンピューティングと連携することで、デバイスは視覚情報を解釈し、異常を発見し、人間が関与することなく即座に対応することができる。これにより、スマートホーム、産業、都市全体に電力を供給する適応的で効率的なシステムが構築される。

例えば、最近の研究では、IoTベースの野生動物保護システムがYOLOv8 使用して、農地に近づく動物をdetect する方法を示した。検知されると、システムはAIを活用した意思決定を行い、ライトや音などの穏やかな抑止力を発動させ、動物を安全に遠ざけるよう誘導する。これは、作物への被害を防ぐと同時に、地域の野生動物との平和的共存を支援するもので、IoTとコンピューター・ビジョンがいかに農業をより持続可能なものにするかを示している。

これら7つの物体検出トレンド以外に、ビジョンAIの未来を形作る注目すべき動きをいくつか紹介しよう:

物体検出は、基本的な画像認識をはるかに超えて成長し、現在ではリアルタイムで意思決定ができるインテリジェント・システムに使用されている。将来的には、より高い精度と、より深いコンテキストの理解を達成することで、ビジョンAIはさらに信頼性が高く、業界を問わず多用途に利用できるようになるだろう。これらの技術が進歩し続けることで、よりスマートで適応性の高い新世代のコンピューター・ビジョン・システムが形成されるでしょう。

もっと学びたいですか?私たちのコミュニティに参加し、GitHub リポジトリを探索して、AI スペースの他の人とつながりましょう。ロボット工学におけるAIと 農業用コンピュータビジョンのソリューションページをご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。