姿勢推定ツールが画像や動画内のdetect キーポイントdetect 、2Dおよび3D姿勢推定にどのように活用され、様々なビジョンAIアプリケーションを支えるかを学びましょう。

姿勢推定ツールが画像や動画内のdetect キーポイントdetect 、2Dおよび3D姿勢推定にどのように活用され、様々なビジョンAIアプリケーションを支えるかを学びましょう。

人間は本能的に動きを読み取る。誰かが身を乗り出したり、首を傾けたり、腕を上げたりすると、その意図を即座に察知できる。これは静かで、ほとんど無意識のスキルであり、人と関わり、世界を探求する方法を形作っている。

テクノロジーが日常生活のより大きな部分を占めるにつれ、デバイスが人間と同じように滑らかに動きを理解することを望むのは自然なことです。人工知能、特に深層学習に基づく進歩がこれを可能にしています。特にコンピュータビジョンは、機械が画像や動画から意味を抽出することを助け、この進歩を推進しています。

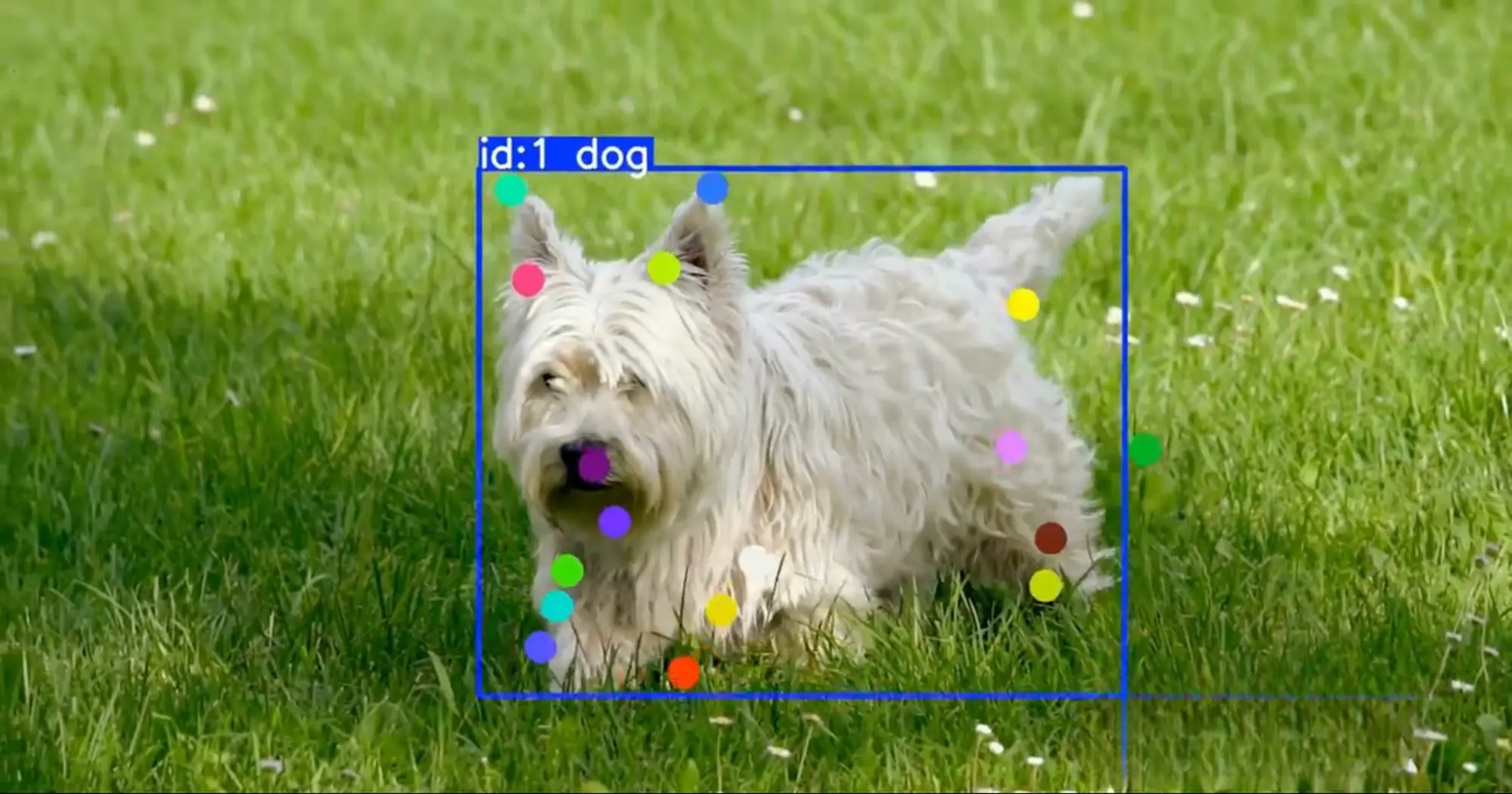

例えば、姿勢推定は一般的なコンピュータビジョン課題であり、画像や動画フレーム内の事前定義された身体キーポイント(肩、肘、腰、膝など)の位置を予測する。これらのキーポイントは固定された骨格定義を用いて接続され、簡略化された姿勢表現を形成する。

コンピュータビジョンモデル(例: Ultralytics YOLO11 および近日Ultralytics 、姿勢推定などのタスクをサポートし、フィットネスやスポーツにおけるフォームフィードバック、安全監視、インタラクティブな拡張現実体験など、リアルタイムアプリケーションの基盤として活用できます。

.webp)

本記事では、姿勢推定ツールについて深く掘り下げ、姿勢推定の仕組み、活用分野、そして現在利用可能な主要モデルやライブラリについて解説します。さっそく始めましょう!

姿勢推定は、画像や動画内における人物や物体の位置関係を理解するコンピュータビジョン技術である。全てのピクセルを均等に分析するのではなく、頭部、肩、肘、腰、膝、足首といった一連の整合性のあるランドマークを予測する。

ほとんどのモデルは、これらのキーポイントの座標と、各予測が正しい可能性を示すスコアを出力します。これらのキーポイントは、あらかじめ定義された骨格レイアウトを用いて接続され、単純な姿勢表現を形成します。

動画に対してフレーム単位で適用すると、得られたキーポイントを時間軸で関連付けることで動きを推定できる。これにより、姿勢チェック、動作解析、ジェスチャーベースのインタラクションといった応用が可能となる。

.webp)

人間の動きには多くの情報が込められている。屈む、手を伸ばす、体重を移動させるといった動作の仕方から、意図や努力、疲労、さらには負傷リスクまでもが読み取れる。これまで、このレベルの細部を捉えるには、通常、特殊なセンサーやモーションキャプチャスーツ、あるいは制御された実験室環境が必要だった。

姿勢推定技術がこれを変える。通常の画像や動画から主要な身体ランドマークを抽出することで、コンピュータは標準カメラを用いて動作を分析できる。これにより動作分析はよりアクセスしやすく、拡張性があり、実環境での実用性が向上する。

姿勢推定が影響を与えるいくつかの方法をご紹介します:

姿勢推定の概念は長年存在してきた。初期のアプローチでは単純な幾何学的モデルと手作業で作成されたルールが用いられ、通常は制御された環境でのみ機能した。

例えば、システムは人が固定位置で静止している時には良好に動作するものの、歩行や旋回、現実世界のシーンにおける物体との相互作用が始まると機能不全に陥ることがある。こうした手法は、自然な動き、変化するカメラアングル、雑然とした背景、部分的な遮蔽に対してしばしば苦戦してきた。

現代の姿勢推定は、これらの課題を処理するために深層学習に依存している。大規模なラベル付きデータセットで畳み込みニューラルネットワークを訓練することで、モデルは視覚パターンを学習し、様々な姿勢、人物、環境においてdetect 信頼性高くdetect できるようになる。

より多くの例を用いることで、モデルは予測精度を向上させ、新たなシーンへの汎化能力を高めます。こうした進歩により、姿勢推定技術は現在、職場監視や人間工学、スポーツ分析など幅広い実用的なユースケースに対応しています。スポーツ分析では、コーチやアナリストが選手の動きを研究する際に活用されています。

姿勢推定には、設定や測定対象に応じていくつかの異なる形式があります。主な種類は以下の通りです:

.webp)

姿勢推定は様々な対象物に適用可能ですが、簡潔にするため、ここでは人間の姿勢推定に焦点を当てます。

ほとんどの人体姿勢推定システムは、大量の画像や動画フレームにわたって主要な身体部位がラベル付けされたアノテーション付きデータセットで学習される。モデルはこれらの例を用いて、肩、肘、腰、膝、足首といった人体のランドマークに関連する視覚パターンを学習し、新しいシーンでもキーポイントを正確に予測できるようにする。

もう一つの重要な側面は、モデルの推論アーキテクチャである。これはキーポイントの検出方法と、それらを完全な姿勢に組み立てる方法を決定する。システムによっては、まずdetect 、その後各人物領域内でキーポイントを推定する。一方、画像全体でdetect 、それらを個人ごとにグループ化するシステムもある。新しいシングルステージ設計では、1回のパスで姿勢を予測でき、リアルタイム利用に向けた速度と精度のバランスを実現している。

次に、様々な姿勢推定手法について詳しく見ていきましょう。

ボトムアップ方式では、モデルは画像全体を観察し、まず頭部、肩、肘、腰、膝、足首といった身体のキーポイントを検出します。この段階では人物の分離を試みるのではなく、シーン全体にわたり姿勢骨格によって定義される全てのキーポイント(身体の関節)を単純に検出します。

その後、システムは点をつなぐ第二段階を実行します。関連するキーポイントを連結し、完全な骨格へとグループ化します。1人につき1つの骨格です。detect 事前にdetect する必要がないため、ボトムアップ手法は、人物が重なり合ったり、異なる大きさで現れたり、部分的に隠れたりする混雑したシーンで効果を発揮することが多いのです。

対照的に、トップダウン方式はまず画像内の各人物を検出することから始める。各個人に境界ボックスを配置し、各ボックスを独立した領域として分析対象とする。

人物が分離されると、モデルはその領域内の身体キーポイントを予測する。この段階的な設定は、特にシーン内の人物が少なく、各人物が明瞭に見える場合に、非常に正確な結果を生むことが多い。

単段モデル(ハイブリッドモデルとも呼ばれる)は、1回のパスで姿勢を予測する。人物検出を最初に実行し、キーポイント推定を後に行う代わりに、人物の位置と身体のキーポイントを同時に出力する。

すべての処理が単一のモジュール内で実行されるため、これらのモデルは高速かつ効率的であり、ライブモーショントラッキングやモーションキャプチャといったリアルタイム用途に最適です。Ultralytics YOLO11 などのモデルはこのコンセプトに基づいて構築YOLO11 、高速処理と信頼性の高いキーポイント予測のバランスを目指しています。

どのような手法を用いるにせよ、姿勢推定モデルは実世界で信頼性を持つ前に、慎重に学習と評価を行う必要がある。通常、身体のキーポイントがラベル付けされた大量の画像(場合によっては動画)から学習し、様々な姿勢、カメラアングル、環境に対応できるようになる。

よく知られている姿勢推定データセットには、COCO 、MPII Human Pose、CrowdPose、OCHumanなどがある。これらのデータセットがモデルがデプロイ時に直面する条件を反映していない場合、エンジニアは対象環境(工場フロア、ジム、診療所など)から追加の画像を収集し、ラベリングを行うことが多い。

.webp)

トレーニング後、モデルの性能は標準的なベンチマークで評価され、精度と頑健性を測定するとともに、実運用に向けたさらなる調整の指針とする。結果はしばしば平均精度(mAP)を用いて報告され、これは予測された姿勢とラベル付けされた真値を比較することで、異なる信頼度閾値における性能を要約する指標である。

多くの姿勢ベンチマークでは、予測姿勢と真の姿勢をオブジェクトキーポイント類似度(OKS)を用いて照合する。OKSは、人物のスケールや各キーポイントの典型的な位置特定難度といった要因を考慮しつつ、予測キーポイントと注釈付きキーポイントの近さを測定する。

Poseモデルは、検出した人物および個々のキーポイントに対して信頼度スコアを出力します。これらのスコアはモデルの信頼度を反映し、予測のランク付けやフィルタリングに使用されます。これは、遮蔽、モーションブラー、または異常なカメラアングルといった困難な条件下において特に重要です。

現在、多くの姿勢推定ツールが利用可能であり、それぞれが速度、精度、使いやすさのバランスを取っています。以下に、最も広く使用されているツールとライブラリの一部を紹介します:

姿勢推定技術は、通常の動画を有用な動作分析に変換するためにますます活用されている。フレーム単位で身体のキーポイントをトラッキングすることで、これらのシステムはカメラ映像から姿勢、動作、身体的行動を推論でき、こうした技術は多くの実環境で実用化されている。

例えば、医療やリハビリテーションの分野では、姿勢追跡技術により臨床医は患者の治療や回復過程における動作を可視化し測定できる。通常の動画記録から身体のランドマークを抽出することで、姿勢、可動域、経時的な動作パターンの評価が可能となる。こうした測定値は従来の臨床評価を支援・最適化するとともに、場合によってはウェアラブルセンサーや特殊機器を必要とせずtrack やすくする。

同様に、スポーツや放送分野では、姿勢推定技術により映像データから直接選手の動きを分析できる。興味深い例として、プロスポーツの審判判定や放送用グラフィックに用いられるカメラベースの追跡システム「ホークアイ」が挙げられる。これはカメラ映像から選手の身体のキーポイントを推定することで、骨格追跡機能も提供する。

適切な姿勢推定ツールの選択は、まずコンピュータビジョンプロジェクトの要件を理解することから始まります。リアルタイム処理速度を優先するアプリケーションもあれば、より高い精度と詳細さを必要とするアプリケーションもあります。

ターゲットとなるデプロイ先デバイスも違いを生む。モバイルアプリやエッジデバイスでは通常、軽量で効率的なモデルが必要となる一方、サーバーやクラウド環境ではより大規模なモデルが適していることが多い。

これに加えて、使いやすさも重要な要素となり得ます。優れたドキュメント、スムーズなデプロイ、カスタムトレーニングのサポートは、プロジェクトを効率化します。

端的に言えば、ツールによって得意分野は異なります。例えば、Ultralytics YOLO 、多くの実世界の姿勢推定アプリケーションにおいて、速度、精度、導入の容易さの面で実用的なバランスを提供します。

姿勢推定は、画像や動画内の身体のキーポイントを検出することで、コンピュータが人間の動きを理解するのを支援します。YOLO11 モデルによりYOLO11 スポーツ、医療、職場の安全、インタラクティブな体験などの分野におけるリアルタイムアプリケーションの構築が容易になります。モデルの高速化と精度向上が続く中、姿勢推定は多くのビジョンAIシステムで一般的な機能となるでしょう。

AIについてもっと知りたいですか?当社のコミュニティと GitHubリポジトリをご覧ください。ロボット工学におけるAIや 製造業におけるコンピュータビジョンについて学ぶには、ソリューションページをご覧ください。ライセンスオプションを確認し、今すぐコンピュータビジョンを活用した開発を始めましょう!

未来の機械学習で、新たな一歩を踏み出しましょう。