大規模な食品組み立て自動化には、多くの可動部品が関わります。大量のトレイがラインに沿って移動し、食材は一日を通して変化し、2つのすくい取りが全く同じになることはありません。これらの要因により、一貫性を維持することが困難になり、手動の組み立てプロセスでは、detect、分量調整、配置に苦労する可能性があります。

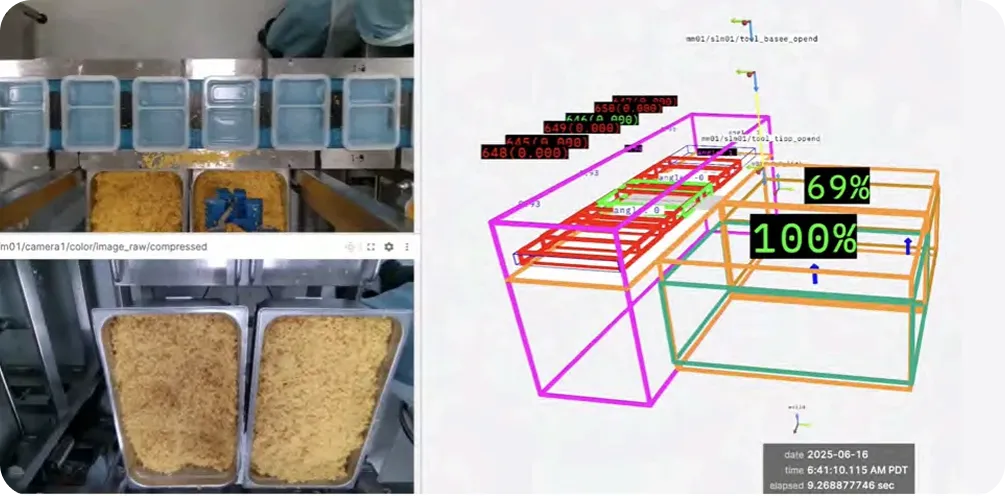

Chef Robotics は、AIとロボットを活用してこれらの課題解決を支援します。ロボット工学とcomputer vision のようなAI技術を組み合わせることで、Chefはロボットが周囲の環境を認識し理解することを可能にします。例えば、Ultralytics YOLOモデル はトレイや食材のdetectおよびsegmentationに利用され、ロボットは多品種少量生産の高速生産ラインにおいて、サブセンチメートル単位の精度でアイテムをピッキング・プレースできます。

ロボティクスとAIを活用した食料生産のスケールアップ サンフランシスコに拠点を置くChef Roboticsは、食品業界が拡大する生産需要に対応できるよう、AI搭載ロボットシステム を構築しています。彼らは特に食品分野に注力しています。なぜなら、米国で110万件以上の未充足求人があるなど、最大の労働力不足に直面しているからです。

この不足は、製造業者が生産量と一貫性を維持することを困難にしています。これらの懸念に対処するため、シェフロボットは機械学習とコンピュータビジョンを使用して、生産環境を解釈し、リアルタイムで意思決定を行います。簡単に言えば、異なる食材、トレイの種類、食事の形式を正確に処理できるということです。

今日、Chefは北米の12以上の都市にシステムを展開し、食品生産者が大量の生産を管理し、手作業への依存を減らし、高速ラインで一貫した品質を維持するのを支援しています。

大規模食品組立における精度のギャップ 大規模な食事の生産には精度と速度が求められますが、実際の生産環境ではそれが困難です。食材は一日を通して見た目が異なる可能性があり、トレイは明るい照明の下で透明または反射する可能性があり、コンベアラインは高速で移動します。

これらの絶え間ない変動は、特に作業員がシフトごとに同じ動作を何千回も繰り返す場合、配置を正確に判断することを困難にします。その結果、手作業による組み立ては、しばしば不均一な分量、時折のこぼれ、そして目標重量外のトレイにつながります。

これにより、食品の廃棄が増加し、追加の清掃が必要となり、盛り付けにばらつきが生じます。レシピが頻繁に変更され、各製品に独自の取り扱い要件がある多品種環境では、この課題はさらに厳しくなります。

図1. 手動の食品組立ラインの様子。

従来の自動化システムは、このレベルの変動性に対応するように設計されていません。材料の変更、迅速な切り替え、および多種多様なSKU(在庫管理単位)に苦慮しています。多くの生産者は、人員不足によって生産ラインの稼働維持が困難になっているにもかかわらず、依然として手作業に大きく依存しています。

例えば、ニューヨーク州ニューウィンザーに拠点を置くインド料理ブランド兼共同製造業者であるCafe Spiceは、これらの課題に日々直面していました。彼らのチームは、手作業で1分あたり約12トレイの食事を組み立てており、需要の増加に伴い生産量が制限されていました。

また、彼らの2区画トレイは、カレーがご飯のセクションにこぼれるのを防ぐために正確な配置を必要としましたが、これは手作業や従来の機器では一貫して維持することが困難でした。これらの制約を認識し、Cafe Spiceはより柔軟で信頼性の高いアプローチを求めてChefに相談しました。

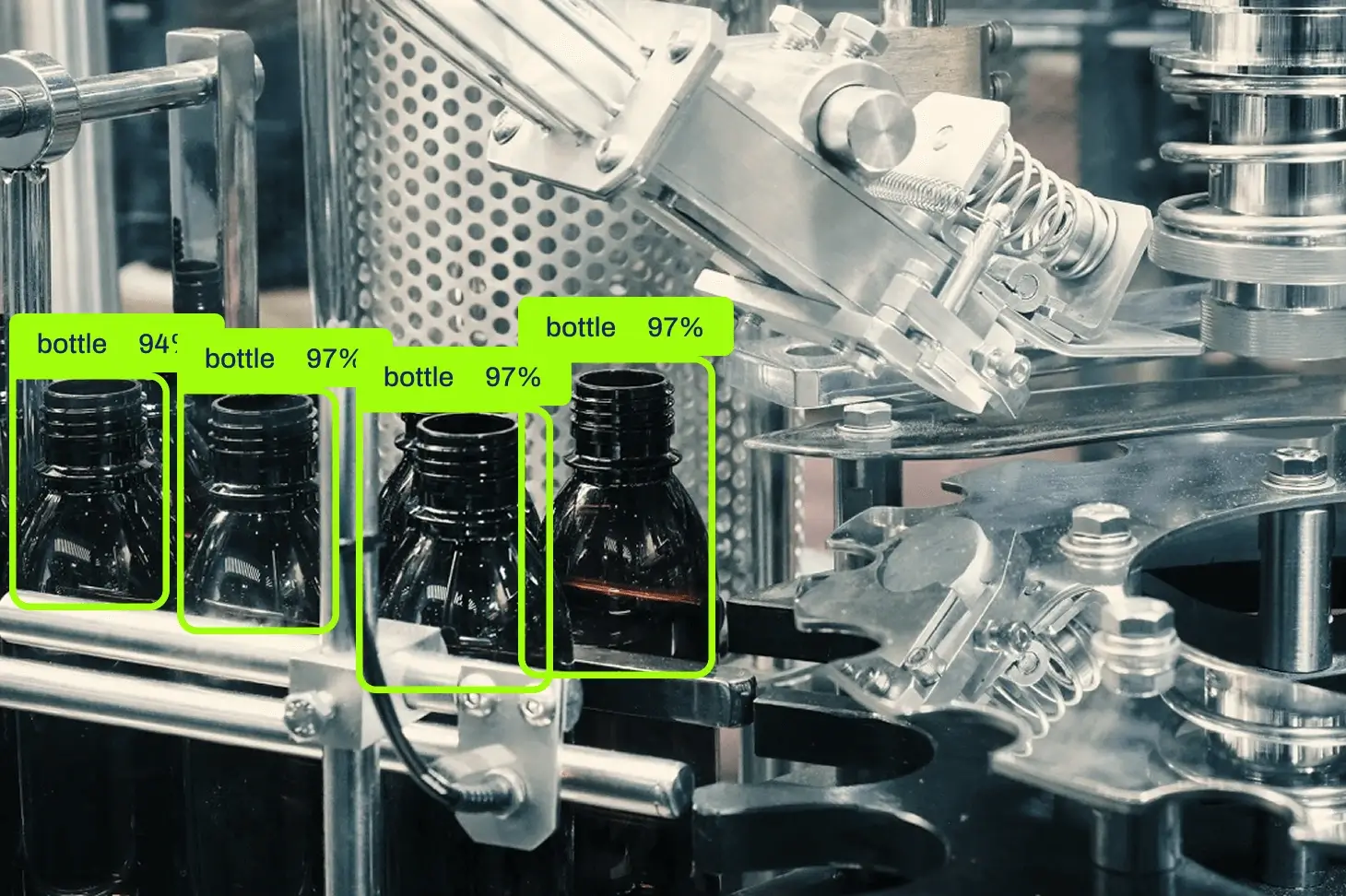

食品組立ライン分析におけるUltralytics YOLOモデルの活用 Cafe Spiceの多品種少量生産の食事製造を自動化するため、シェフはトレイをdetectし、食材を識別し、2区画トレイに必要な精度で食品を配置できるロボットAIシステムを導入しました。このシステムの中心にあるのは、Ultralytics YOLOモデルに基づいて構築されたVision AIパイプラインです。

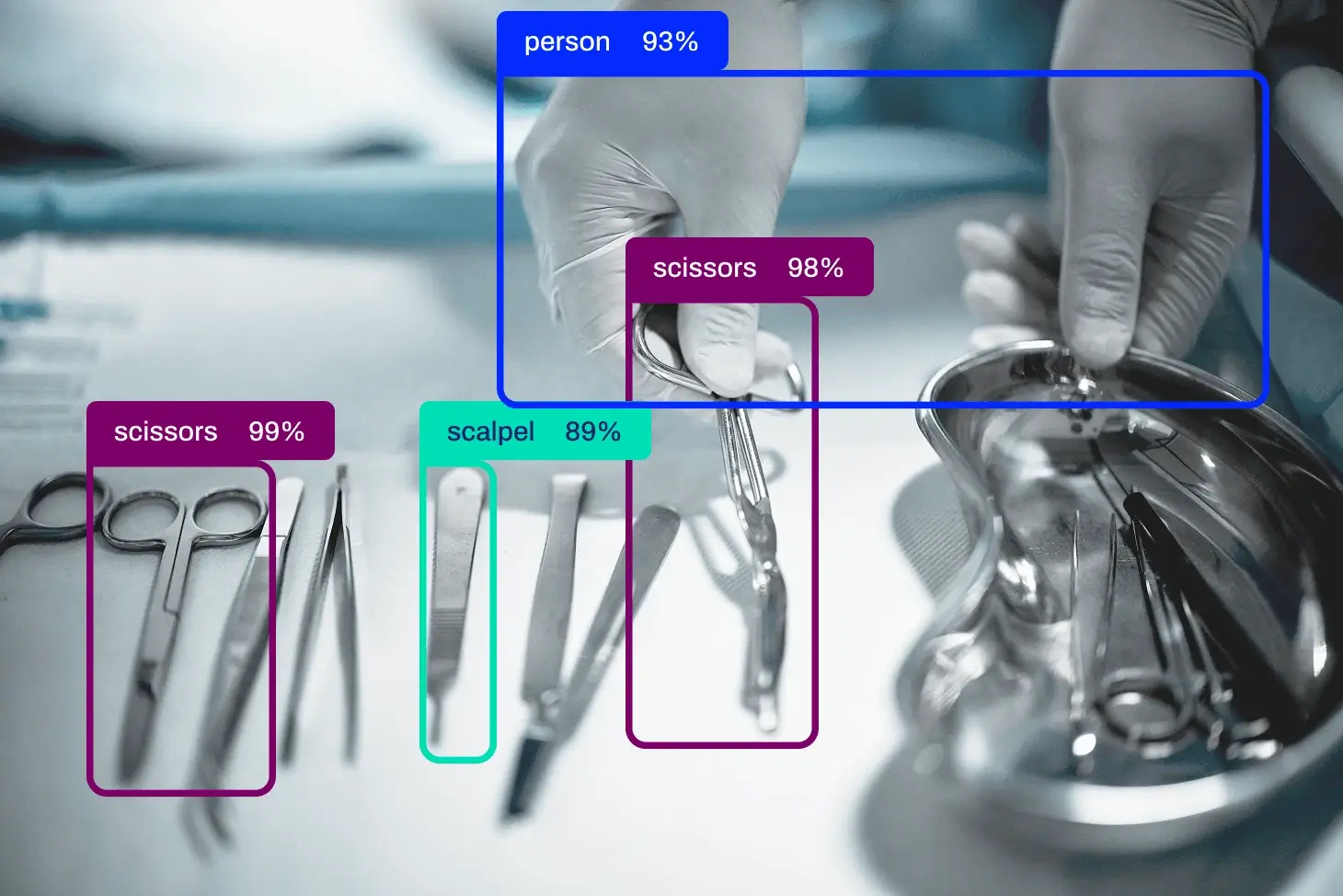

Ultralytics YOLOモデルは、object detection、oriented bounding box (OBB) detection 、インスタンスsegmentation、画像分類といった主要なコンピュータービジョンタスク をサポートします。これらの機能により、Chefロボットは生産ラインのリアルタイムな状況認識を得ることができます。

Cafe Spiceが多くの異なるSKUを生産しているため、Ultralytics YOLOモデルは、彼らの生産環境から直接収集された画像でカスタムトレーニングされています。これにより、ロボットは実際の工場条件下で材料を解釈するのに役立ちます。

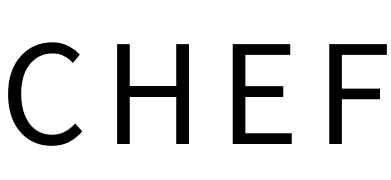

図2. シェフロボットがトレイを認識しdetectする方法 (出典 )

特に、YOLOはコンベアを移動するトレイをdetectし、各材料の正しいコンパートメントを識別するために使用されます。object detectionをさらに一歩進めると、obb detectionにより、システムはボウル、透明なインサート、および向きが変化するトレイを含む、異なる角度で現れるアイテムを理解できるようになります。

なぜUltralytics YOLO モデルを選ぶのか? Ultralytics YOLOモデルは、高速な生産ラインでのリアルタイム食品組み立てに必要な速度と精度をChefに提供します。彼らは、Ultralytics YOLOモデルが生産において約99.5%の精度を実現し、さまざまなトレイ、ボウル、および材料タイプにわたるサブセンチメートル単位のロボット配置に必要な安定したdetectionsを提供することを発見しました。

さらに、Ultralytics Python package は、これらのモデルをトレーニング、ファインチューニング、管理するためのツールを提供し、エンジニアリングチームが迅速に反復作業を行うことを容易にします。例えば、クロスプラットフォーム展開のためのONNXのようなエクスポート形式をサポートしており、これによりChefのチームはロボットシステム全体でモデルをシームレスに変換および展開できます。

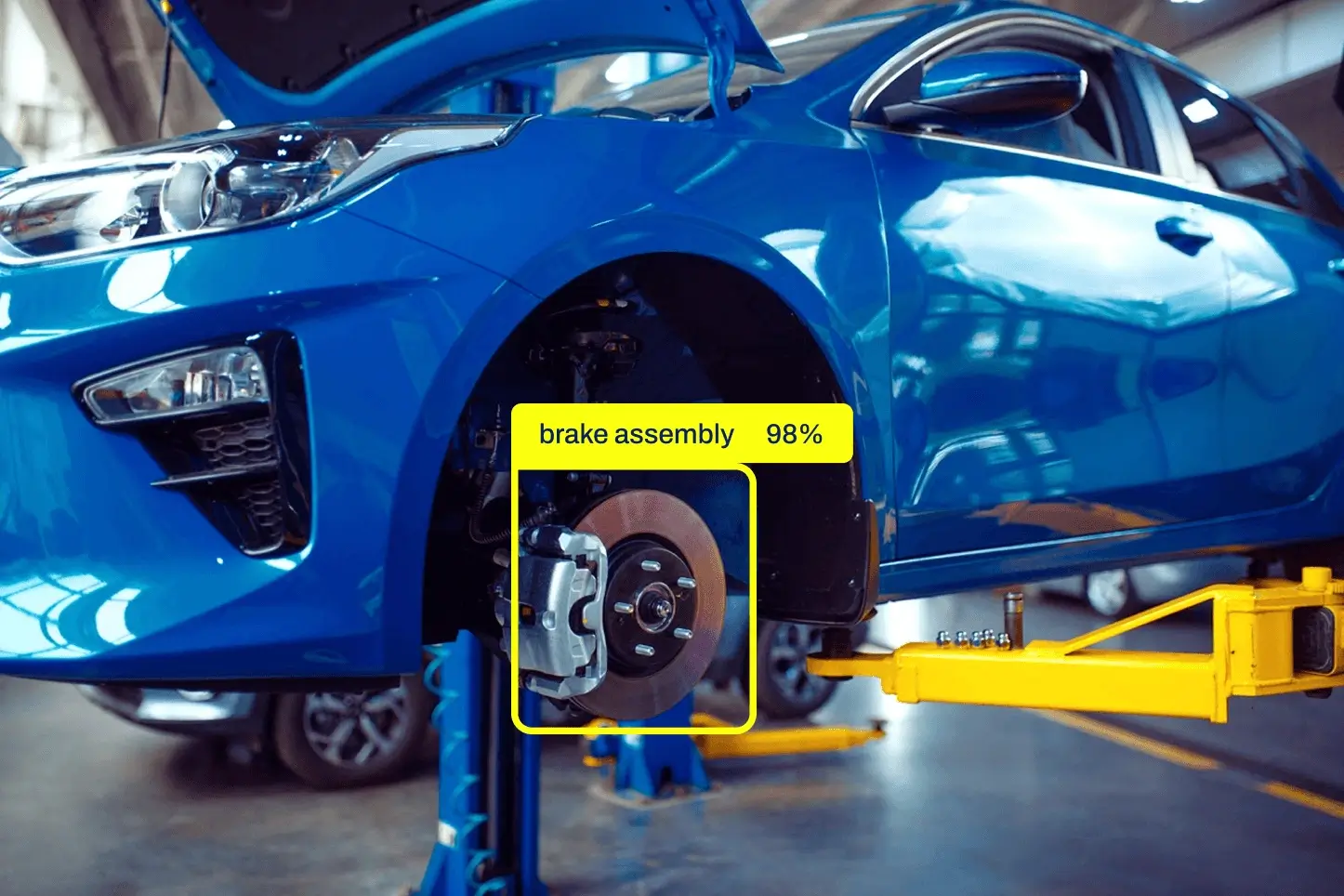

Chef RoboticsとUltralytics YOLOがCafe Spiceの生産量を倍増 Ultralytics YOLOモデルを搭載したChefのAI対応ロボットシステムを統合した後、Cafe Spiceは生産量、労働効率、製品品質において即座に測定可能な改善を達成しました。以前は1分あたり12トレイで稼働していた彼らの生産ラインは、現在平均1分あたり30トレイで稼働しており、更新されたコンベアシステムではピーク時で1分あたり40トレイに達します。これは生産量の2〜3倍の増加に相当します。

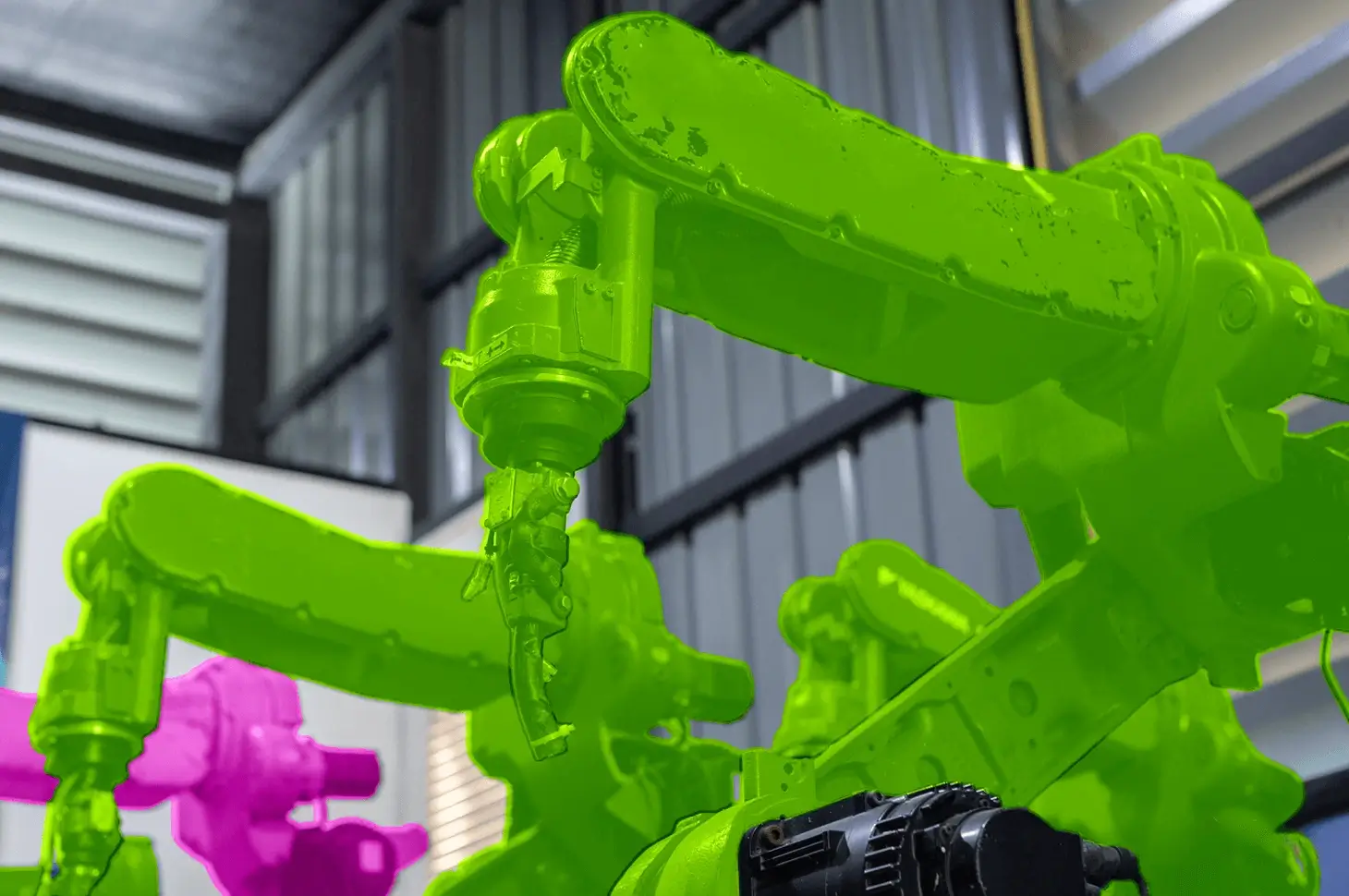

図3. Chef RoboticsとUltralytics YOLOによって稼働するCafe Spiceの食事生産ライン。

労働生産性も向上しました。各ラインは歴史的に8~10人の作業員を必要としていましたが、Chefのロボットはその数を1ラインあたり3~4人に削減し、労働生産性が60%向上しました。削減された人員は、Cafe Spiceが継続的な人手不足により常に人員不足であった他の部署にスタッフを再配置するのに役立ちました。

同様に、品質と歩留まりも大幅に向上しました。自動化前は、軽量品を避けるための過剰な盛り付けが主な原因であった食品廃棄は9.19%でした。ロボットがYOLOベースのdetectionを使用して材料を正確に配置することで、廃棄は3.05%に減少し、67%の削減となりました。これに加えて、受け入れ率も向上しました。ロボットで組み立てられたトレイの91%がCafe Spiceの品質基準を満たし、手作業で組み立てられたトレイの75%と比較して改善が見られました。

大規模な食事生産をよりスマートかつ高精度に Chefが事業を拡大し続けるにつれて、同社は、食品業界全体で使用される多種多様な食材、トレイ、生産設定に、AI搭載システムをさらに適応させることに注力しています。これらの取り組みの主要な推進力は、人間が最も得意とすることを行う能力を人間にもたらすインテリジェントな機械を構築するというChefのミッションです。知覚モデルを進化させ、段取り替えを簡素化し、多品種生産の柔軟性を高めることで、Chefは硬直した機械というよりも、協力的なチームメイトのように機能する自動化を創造しています。

Vision AIにご興味がありますか?プロジェクトにコンピュータービジョンを導入するためのライセンスオプション をご覧ください。GitHubリポジトリ にアクセスし、コミュニティ にご参加ください。ソリューションページでは、ヘルスケアにおけるAI と小売業におけるコンピュータービジョン について詳しくご紹介しています。