Como escolher uma GPU em nuvem para treino de IA de visão na Ultralytics Platform

Aprende a escolher a GPU em nuvem certa para treino de visão computacional na Ultralytics Platform com base em fatores como tamanho do conjunto de dados, complexidade do modelo e custo.

No mês passado, apresentamos a Ultralytics Platform, um ambiente de ponta a ponta projetado para otimizar todo o fluxo de trabalho de visão computacional, desde o gerenciamento de datasets até o treinamento e a implementação de modelos. A Ultralytics Platform reúne tudo o que é necessário para criar e escalar modelos de IA de visão em uma experiência única e unificada.

Uma parte fundamental desse fluxo de trabalho é o treinamento de modelos, onde redes neurais aprendem padrões a partir de dados para fazer previsões precisas, e o acesso aos recursos computacionais certos desempenha um papel crucial. Anteriormente, exploramos como a Ultralytics Platform suporta o treinamento de modelos impulsionado por unidades de processamento gráfico (GPU) em nuvem, permitindo que você treine modelos de visão computacional sem precisar gerenciar infraestrutura local.

Com acesso sob demanda a poderosas GPUs NVIDIA, usuários que vão de estudantes e startups a pesquisadores e grandes organizações podem executar cargas de trabalho de IA de forma mais eficiente do que nunca. Embora começar com o treinamento em nuvem seja simples, escolher a GPU certa envolve considerar fatores como o tamanho do dataset, a complexidade do modelo e o custo.

Com uma ampla gama de opções disponíveis hoje, desde GPUs RTX com bom custo-benefício até hardware NVIDIA H100 de alto desempenho e a próxima geração Blackwell, selecionar a configuração correta pode impactar significativamente tanto o desenvolvimento do modelo quanto o custo.

Neste artigo, veremos o treinamento em GPU em nuvem para visão computacional na Ultralytics Platform e como escolher o hardware certo para sua carga de trabalho. Vamos começar!

Uma visão geral do treinamento em nuvem na Ultralytics Platform

Antes de mergulhar em como selecionar uma GPU para treinamento em nuvem na Ultralytics Platform, vamos dar um passo atrás e ver como o treinamento em nuvem funciona.

O que é o treinamento em GPU em nuvem?

O treinamento em GPU em nuvem refere-se ao uso de GPUs hospedadas em um ambiente de computação em nuvem para treinar modelos de aprendizado de máquina e aprendizado profundo, em vez de depender do seu próprio hardware ou estação de trabalho local. Na Ultralytics Platform, isso permite que você acesse GPUs potentes sob demanda e execute trabalhos de treinamento remotamente, sem precisar da sua própria configuração.

Isso torna fácil escalar seus recursos com base na sua carga de trabalho. Você pode escolher GPUs mais potentes ou aumentar a capacidade conforme necessário, sem ficar limitado pelas capacidades do seu sistema. Pense nisso como acessar máquinas poderosas, ou nós, em data centers remotos, onde você pode escalar para cima ou para baixo conforme necessário.

Isso também elimina a necessidade de configurar e manter hardware caro. Você não precisa comprar GPUs, instalar drivers ou lidar com problemas de compatibilidade.

A Ultralytics Platform gerencia tudo por meio de serviços de nuvem, desde o provisionamento de recursos até a configuração do ambiente, orquestração e execução de trabalhos de treinamento, para que você possa focar no treinamento, experimentação e melhoria dos seus modelos.

Como o treinamento de modelos funciona na Ultralytics Platform

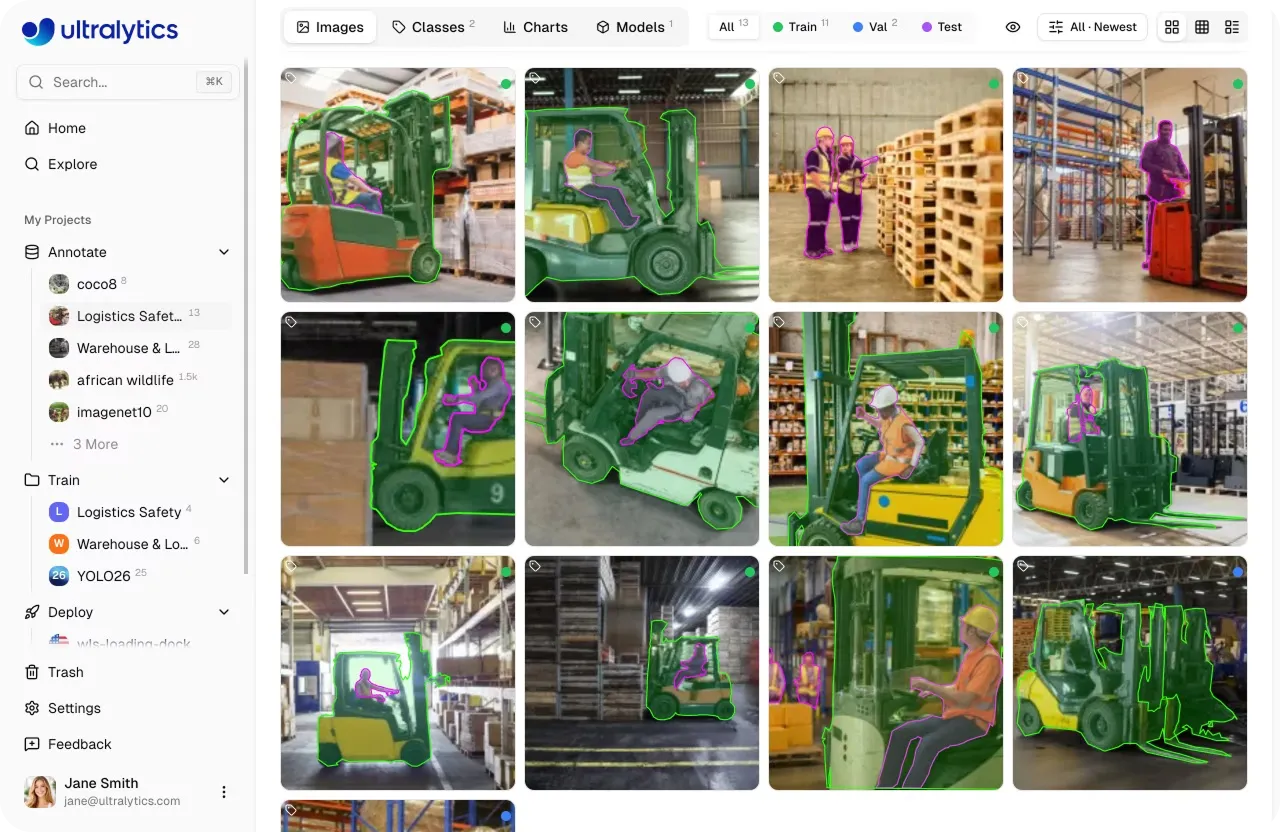

Na Ultralytics Platform, o fluxo de trabalho de treinamento acelerado por GPU é direto. Você pode começar trazendo seu dataset de várias maneiras.

Você pode enviar seus próprios dados, usar datasets públicos disponíveis na plataforma ou clonar datasets compartilhados pela comunidade para basear-se em trabalhos existentes. Clonar um dataset cria uma cópia no seu espaço de trabalho, permitindo que você o edite e expanda mantendo o original inalterado.

Depois de selecionar um dataset, você pode revisar e organizar suas imagens e anotações para garantir que tudo esteja estruturado adequadamente. A plataforma também inclui ferramentas de anotação integradas, permitindo que você rotule dados para tarefas como detecção de objetos, segmentação e classificação, ou acelere o processo com recursos assistidos por IA.

Fig 1. Visualizando um dataset dentro da Ultralytics Platform (Fonte)

Em seguida, você pode selecionar ou criar um projeto para gerenciar suas execuções de treinamento. Os projetos ajudam você a organizar e comparar modelos, rastrear métricas de desempenho e manter experimentos relacionados em um só lugar.

A partir daí, você pode passar para o treinamento em nuvem, onde você escolhe um modelo, configura parâmetros e seleciona uma GPU com base nas suas necessidades de desempenho e orçamento. A plataforma lida com a infraestrutura de nuvem subjacente para você.

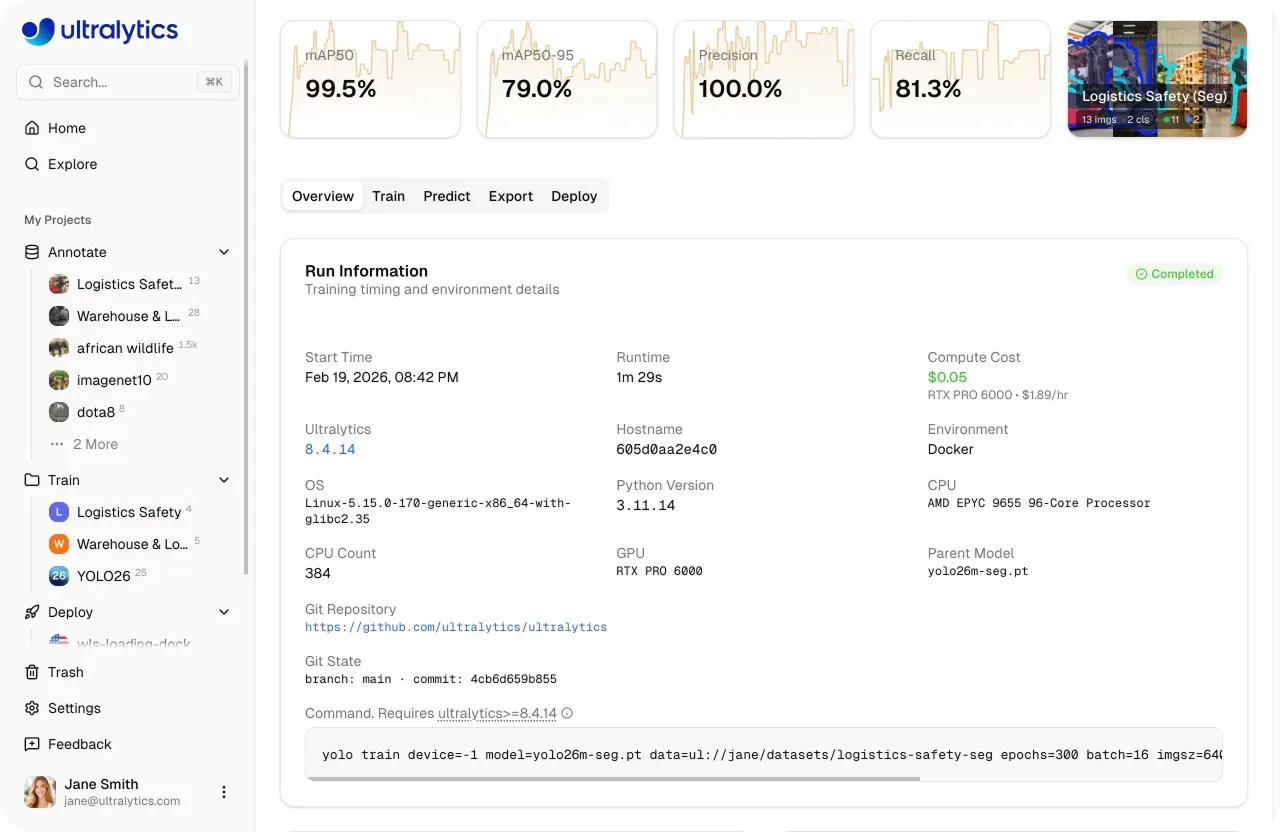

Ela provisiona a instância de GPU selecionada, prepara seu dataset e executa o trabalho de treinamento na nuvem. À medida que o treinamento avança, você pode monitorar métricas, logs e o desempenho do sistema em tempo real, sem precisar gerenciar configurações, ambientes CUDA, frameworks como PyTorch ou TensorFlow, ou hardware.

Principais recursos de treinamento em GPU na Ultralytics Platform

Aqui estão alguns recursos principais do treinamento em GPU em nuvem na Ultralytics Platform:

- Treinamento com um clique: Inicie trabalhos de treinamento com configuração mínima e mova-se rapidamente do dataset para o treinamento do modelo sem configurações complexas.

- GPUs sob demanda: Escolha entre uma variedade de opções de GPU com base nas suas necessidades e dimensione os recursos conforme necessário, sem compromissos de longo prazo.

- Monitoramento em tempo real: Acompanhe o progresso do treinamento com gráficos e logs ao vivo, e visualize métricas do sistema como uso de GPU e memória em tempo real.

- Checkpoints automáticos: O progresso do treinamento é salvo em intervalos regulares, facilitando a retomada ou recuperação do trabalho, se necessário.

- Implementação fácil: Assim que o treinamento estiver concluído, você pode implementar seus modelos treinados e usá-los em aplicações ou fluxos de trabalho por meio de APIs de inferência compartilhadas, endpoints dedicados ou exportando-os para uso em sistemas externos. Essas opções de implementação permitem inferência de baixa latência, tornando possível alimentar aplicações em tempo real, como análise de vídeo, sistemas de automação e soluções de IA interativas.

Diferentes opções de GPU em nuvem na Ultralytics Platform

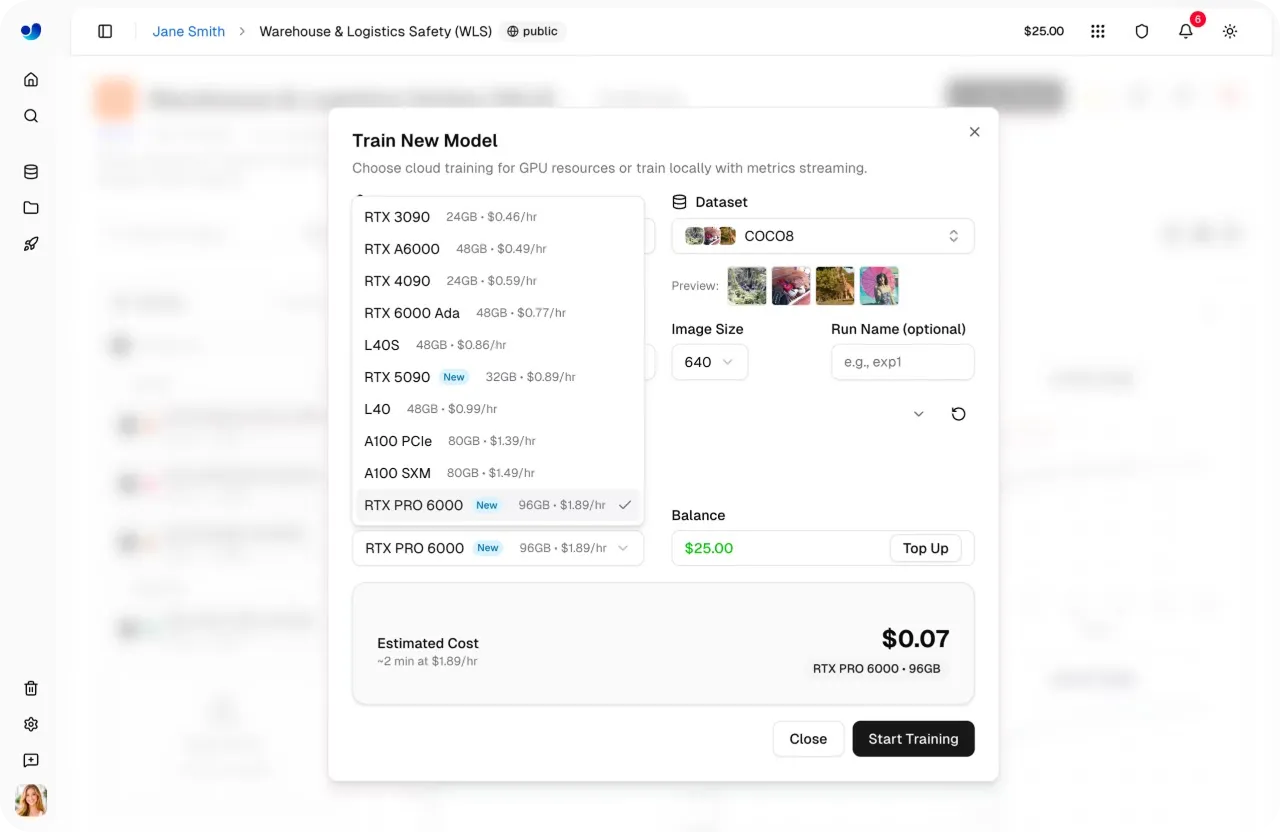

Agora que vimos como o treinamento funciona na plataforma, vamos dar uma olhada nas diferentes opções de GPU disponíveis. A GPU que você escolhe pode afetar a rapidez com que seu modelo treina, o desempenho dele e quanto custa.

A Ultralytics Platform oferece uma ampla gama de GPUs, começando com opções como RTX 2000 Ada e RTX A4500, passando por GPUs como RTX 4000 Ada, RTX A5000, RTX 3090 e RTX A6000, e estendendo-se a opções mais poderosas como a RTX 4090 e RTX PRO 6000.

Fig 2. Um exemplo das diferentes opções de GPU suportadas pela Ultralytics Platform (Fonte)

Para a maioria dos usuários, a RTX PRO 6000 é uma escolha padrão equilibrada. Ela oferece um desempenho confiável em diversas cargas de trabalho sem exigir muitos ajustes. A RTX 4090 é outra opção popular, oferecendo um ótimo desempenho pelo preço.

Para tarefas menores como experimentos rápidos, prototipagem ou trabalho com datasets leves, GPUs como a RTX 2000 Ada e a RTX A4500 são um bom ponto de partida. À medida que sua carga de trabalho cresce, opções como a RTX 4000 Ada, RTX A5000 e RTX 3090 oferecem um desempenho mais consistente para treinamento geral.

No topo da linha, GPUs como a A100 (Ampere), H100 e H200 (Hopper) e B200 (Blackwell) são feitas para cargas de trabalho de grande escala. Elas são mais adequadas para treinar modelos muito grandes, lidar com datasets massivos ou executar trabalhos onde a velocidade e o desempenho são críticos.

Entendendo diferentes tipos de GPU e seus casos de uso

A seguir, vamos ver como diferentes tipos de GPUs se comparam e onde elas se encaixam melhor.

As GPUs RTX da NVIDIA geralmente são mais econômicas e comumente usadas para treinamento diário, experimentação e cargas de trabalho pequenas a médias. Elas oferecem um equilíbrio entre desempenho e acessibilidade, tornando-as adequadas para uma ampla gama de casos de uso.

Em comparação, GPUs como a A100, A40 e L40 são projetadas para cargas de trabalho mais pesadas e treinamento em maior escala. Elas oferecem maior estabilidade e escalabilidade, particularmente ao trabalhar com datasets maiores ou modelos mais complexos.

No topo da linha, GPUs como a H100 e aquelas baseadas na arquitetura Blackwell da NVIDIA representam hardware de IA mais recente. Elas são projetadas para cargas de trabalho de alto desempenho e normalmente são usadas para treinamento em larga escala, pesquisa avançada ou tarefas sensíveis ao tempo.

A gama de opções de GPU disponíveis na Ultralytics Platform oferece flexibilidade em diferentes cargas de trabalho. Dependendo dos seus requisitos, você pode começar com configurações menores e escalar conforme necessário.

Como escolher a GPU em nuvem certa para o seu projeto

Ao selecionar uma GPU para treinamento em nuvem na Ultralytics Platform, há vários fatores a considerar, incluindo o tamanho do dataset, a complexidade do modelo e o custo. Vamos passar por cada um desses fatores.

Combinando o poder da GPU com o tamanho do dataset

Um dos principais fatores na escolha de uma GPU é o tamanho do seu dataset, pois isso afeta o tempo de treinamento e quanto poder computacional você precisa.

Para datasets pequenos, geralmente com menos de 1.000 imagens, uma GPU leve como a RTX 2000 é frequentemente suficiente. Isso funciona bem para experimentos rápidos e execuções de treinamento mais curtas.

Para datasets de médio porte, em torno de 1.000 a 10.000 imagens, GPUs como a RTX 4090 ou RTX A6000 oferecem um melhor equilíbrio de desempenho e eficiência, ajudando você a treinar de forma mais suave, sem longos atrasos.

Para datasets maiores, com mais de 10.000 imagens, você provavelmente precisará de hardware mais poderoso para manter os tempos de treinamento razoáveis. GPUs como as H100 são mais adequadas para lidar com cargas de trabalho mais pesadas e escalar efetivamente.

No geral, trata-se de combinar o tamanho do seu dataset com o nível de poder computacional e capacidade de processamento paralelo que você precisa.

Escolhendo uma GPU com base no tamanho e complexidade do modelo

Outro fator importante na escolha de uma GPU é o tamanho e a complexidade do seu modelo de IA de visão. Modelos de tamanhos diferentes precisarão de quantidades diferentes de poder para computação.

Por exemplo, modelos menores precisam de menos poder de computação da GPU e podem rodar eficientemente em GPUs como a RTX 2000 Ada, RTX A4500 ou até mesmo a RTX 4090 se você quiser resultados mais rápidos. Estas são ideais para experimentos rápidos, prototipagem e tarefas mais simples, permitindo que você itere mais rápido e teste ideias sem altos custos de computação.

Por outro lado, modelos maiores e mais complexos exigem significativamente mais memória e poder de processamento. GPUs como a RTX A6000, RTX PRO 6000 e opções de alta qualidade como a H100 são mais adequadas para essas cargas de trabalho. Elas podem lidar com arquiteturas maiores, reduzir o tempo de treinamento e prevenir problemas de memória, o que é especialmente importante ao trabalhar com imagens de alta resolução, grandes tamanhos de lote ou designs de modelos mais avançados.

Comparando o tamanho do lote e a memória da GPU

Da mesma forma, o tamanho do lote (batch size) desempenha um papel importante no treinamento do modelo. Ele se refere ao número de amostras de treinamento que o modelo processa de uma só vez em uma única etapa.

Tamanhos de lote maiores podem melhorar a eficiência do treinamento processando mais dados de uma vez, mas também exigem mais memória da GPU (VRAM). Em geral, GPUs com maior largura de banda de memória podem suportar lotes maiores, enquanto GPUs com menos memória podem exigir lotes menores.

Por exemplo, GPUs como a RTX A6000, RTX PRO 6000 ou A100 podem lidar com lotes maiores com mais facilidade devido à sua maior memória, enquanto opções como a RTX 4090 ou RTX 2000 Ada podem exigir lotes menores, dependendo da carga de trabalho.

No entanto, usar a maior GPU nem sempre é necessário. GPUs de ponta podem melhorar a velocidade e a capacidade, mas também vêm com custos mais altos. Em muitos casos, ajustar o tamanho do lote em uma GPU menor pode ser uma escolha mais eficiente.

Em última análise, o objetivo é encontrar o equilíbrio certo entre o tamanho do lote, a memória de GPU disponível e o custo, com base no seu modelo e dataset.

O impacto da configuração de treinamento no desempenho da GPU

Outro fator que impacta o desempenho da GPU é a configuração de treinamento. Isso inclui parâmetros como o número de épocas, tamanho da imagem e outras configurações que controlam como um modelo é treinado.

Por exemplo, tamanhos de imagem maiores aumentam a quantidade de computação necessária por etapa. Isso pode diminuir a velocidade do treinamento e pode exigir mais poder computacional ou memória para manter um bom desempenho.

Da mesma forma, aumentar o número de épocas estende o tempo total de treinamento, especialmente em hardware menos poderoso. Uma época refere-se a uma passagem completa por todo o dataset durante o treinamento.

Técnicas como aumento de dados também adicionam processamento extra durante o treinamento. O aumento de dados aplica transformações como inversão, rotação ou redimensionamento para aumentar a diversidade dos dados e melhorar o desempenho do modelo. Embora isso possa melhorar a robustez do modelo, também pode reduzir a velocidade do treinamento.

Em geral, GPUs mais potentes podem lidar com essas demandas crescentes com mais eficiência, mas o impacto dependerá da configuração geral e da carga de trabalho.

Equilibrando custo e tempo de treinamento

Ao escolher uma GPU para seu projeto, muitas vezes há um equilíbrio entre a velocidade de treinamento e o preço da GPU.

A Ultralytics Platform torna fácil estimar e entender esses custos antes de iniciar um trabalho de treinamento. Com base na sua configuração, incluindo tamanho do dataset, modelo e GPU, você pode ver um custo estimado e a duração do treinamento antecipadamente.

Fig 3. A Ultralytics Platform torna os custos de nuvem fáceis de estimar e entender. (Fonte)

GPUs mais rápidas normalmente têm um custo horário mais alto, mas podem reduzir o tempo total de treinamento. GPUs como a RTX 4090, RTX PRO 6000 e H100 geralmente conseguem concluir o treinamento mais rapidamente devido ao seu desempenho superior.

GPUs mais lentas tendem a ter um custo horário menor, mas levam mais tempo para concluir o treinamento. Por exemplo, GPUs como a RTX 2000 Ada e RTX A4500 são frequentemente usadas para cargas de trabalho menores ou trabalhos de longa duração onde o custo mais baixo é priorizado.

Além disso, algumas das GPUs de ponta, como a H200 e B200, estão disponíveis apenas nos planos Pro ou Enterprise, enquanto a maioria das outras opções também são acessíveis no nível Free.

Um olhar sobre estratégias de otimização de custos

Além de escolher a GPU certa, existem algumas maneiras práticas de manter os custos de treinamento sob controle. Uma das abordagens mais eficazes é começar com pequenas execuções de teste antes de escalar.

Em vez de pular direto para o treinamento completo, comece com menos épocas para garantir que sua configuração funcione conforme o esperado. Isso ajuda você a validar rapidamente seus dados, anotações e configuração do modelo, e evita gastar tempo e computação em execuções que podem não produzir resultados úteis.

À medida que o treinamento progride, fique de olho nas suas métricas e pare as execuções cedo se o desempenho estagnar ou parar de melhorar. Monitorar as curvas de treinamento pode ajudá-lo a decidir se continua ou ajusta sua configuração.

Você também pode ajustar parâmetros como o tamanho do lote e o tamanho da imagem. Valores menores reduzem o uso de memória e computação, tornando mais prático experimentar, testar diferentes configurações ou executar simulações em pequena escala antes de aumentar a escala.

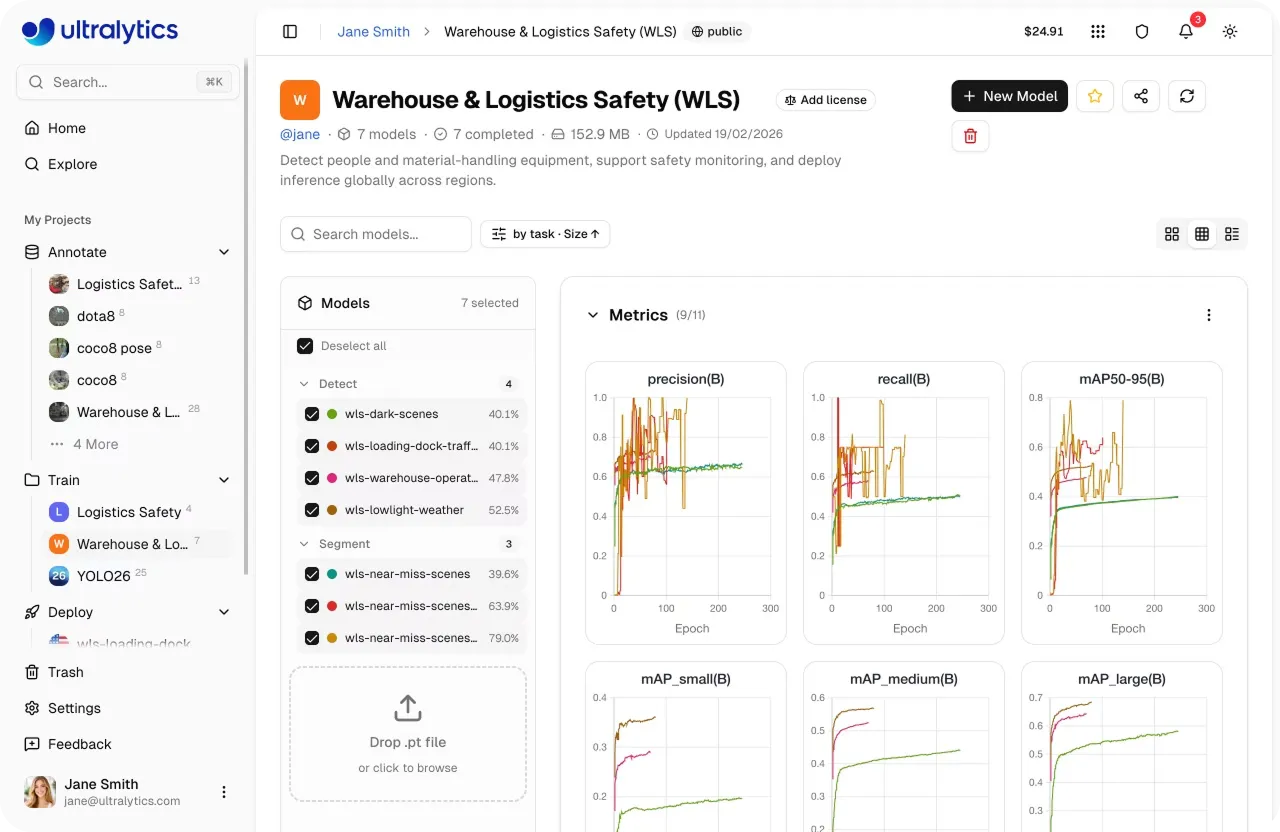

Fig 4. Visualizações das métricas de treinamento na Ultralytics Platform (Fonte)

Além disso, a Ultralytics Platform ajuda a simplificar o gerenciamento de custos. Ela fornece estimativa de custo integrada para que você possa entender as despesas esperadas antes de iniciar um trabalho.

Com um sistema de créditos baseado em pagamento por uso, você paga apenas pelo tempo de computação que realmente usa. Isso torna mais fácil manter-se dentro do orçamento e escalar assim que estiver confiante na sua configuração de treinamento.

Melhores práticas relacionadas ao treinamento em GPU em nuvem para visão computacional

Aqui estão algumas melhores práticas para ter em mente no treinamento em GPU em nuvem na Ultralytics Platform:

- Valide datasets antes de treinar: Certifique-se de que seu dataset esteja limpo, bem anotado e consistente antes de começar. Identificar problemas precocemente ajuda a evitar desperdício de computação e melhora o desempenho do modelo.

- Execute experimentos rápidos primeiro: Comece com execuções de teste pequenas e menos épocas para verificar sua configuração. Isso ajuda a identificar problemas precocemente sem se comprometer com trabalhos de treinamento longos e caros. De certa forma, você está criando um modelo que pode reutilizar e escalar assim que tudo estiver funcionando como esperado.

- Monitore métricas principais: Acompanhe métricas como perda (loss), mAP, precisão e recall durante todo o treinamento. Essas métricas atuam como benchmarks para avaliar o desempenho do modelo e ajudá-lo a decidir quando ajustar ou parar.

- Mantenha os pipelines de processamento de dados eficientes: Garanta que o carregamento e o pré-processamento de dados sejam eficientes, pois essas funções dependem de recursos da CPU e podem se tornar gargalos que impactam o desempenho geral do treinamento.

- Use ferramentas integradas: Use gráficos, logs de console e métricas de sistema para monitorar o treinamento em tempo real e tomar decisões informadas rapidamente.

Principais conclusões

Escolher a GPU em nuvem certa para visão computacional na Ultralytics Platform se resume a entender sua carga de trabalho, incluindo o tamanho do dataset, a complexidade do modelo e a configuração de treinamento. Com uma variedade de opções de GPU disponíveis, impulsionadas por infraestrutura de nuvem e máquinas virtuais, você pode começar com uma escolha equilibrada e escalar conforme suas necessidades de treinamento ou ajuste fino de modelo crescerem. Combinando o hardware certo com boas práticas como monitoramento e controle de custos, você pode treinar modelos de inteligência artificial de última geração de forma eficiente, enquanto aproveita ao máximo a flexibilidade da computação de alto desempenho.

Confira nossa comunidade e repositório no GitHub em crescimento para saber mais sobre visão computacional. Se você está procurando construir soluções de visão, dê uma olhada em nossas opções de licenciamento. Explore nossas páginas de soluções para saber mais sobre os benefícios da visão computacional na manufatura e IA na agricultura.