了解热成像、LiDAR 和红外图像等视觉数据类型如何在各个行业中实现多样化的计算机视觉应用。

了解热成像、LiDAR 和红外图像等视觉数据类型如何在各个行业中实现多样化的计算机视觉应用。

无人机之类的技术过去受到限制,只有研究人员和专家才能使用,但如今,尖端硬件正变得越来越容易被更广泛的受众所接受。这种转变正在改变我们收集视觉数据的方式。借助更容易获得的技术,我们现在可以从各种来源捕获图像和视频,而不仅仅是传统的相机。

与此同时,计算机视觉(人工智能的一个分支)所支持的图像分析技术也在迅速发展,使机器能够更有效地解释和处理视觉数据。这一进步为自动化、物体检测和实时分析带来了新的可能性。现在,机器可以识别模式、track 运动并理解复杂的视觉输入。

一些关键的视觉数据类型包括常用于物体识别的 RGB(红、绿、蓝)图像、有助于在弱光条件下detect 热信号的热成像以及使机器能够理解 3D 环境的深度数据。这些数据类型在视觉人工智能的各种应用(从监控到医疗成像)中都发挥着至关重要的作用。

在本文中,我们将探讨视觉人工智能中使用的主要视觉数据类型,并探讨每种类型如何提高各个行业的准确性、效率和性能。让我们开始吧!

通常,当您使用智能手机拍照或查看闭路电视录像时,您正在使用 RGB 图像。RGB 代表红色、绿色和蓝色,它们是代表数字图像中视觉信息的三个颜色通道。

RGB 图像和视频是计算机视觉中密切相关的视觉数据类型,都是使用标准相机捕获的。主要的区别在于,图像捕获的是单个时刻,而视频是一系列帧,显示事物随时间的变化。

RGB 图像通常用于计算机视觉任务,如物体检测、实例分割和姿势估计 ,并由姿势估计 模型提供支持 Ultralytics YOLO11.这些应用依赖于识别单帧图像中的模式、形状或特定特征。

另一方面,当运动或时间是一个因素时,视频则是必不可少的,例如手势识别、监控或跟踪动作。由于视频可以被视为一系列图像,因此计算机视觉模型(如YOLO11 )可以逐帧处理视频,以了解随时间变化的运动和行为。

例如,YOLO11 可用于分析 RGB 图像或视频,以detect 农田中的杂草并对植物进行计数。这可以加强对作物的监测,帮助track 整个生长周期的变化,从而提高农场管理的效率。

深度数据通过指示物体与相机或传感器的距离,为视觉信息增加了一个维度。与仅捕获颜色和纹理的 RGB 图像不同,深度数据提供了空间背景。它展示了物体与相机之间的距离,从而可以解释场景的 3D 布局。

这种类型的数据是使用 LiDAR、立体视觉(使用两个摄像头来模仿人类的深度感知)和飞行时间(测量光到达物体并返回所需的时间)摄像头等技术捕获的。

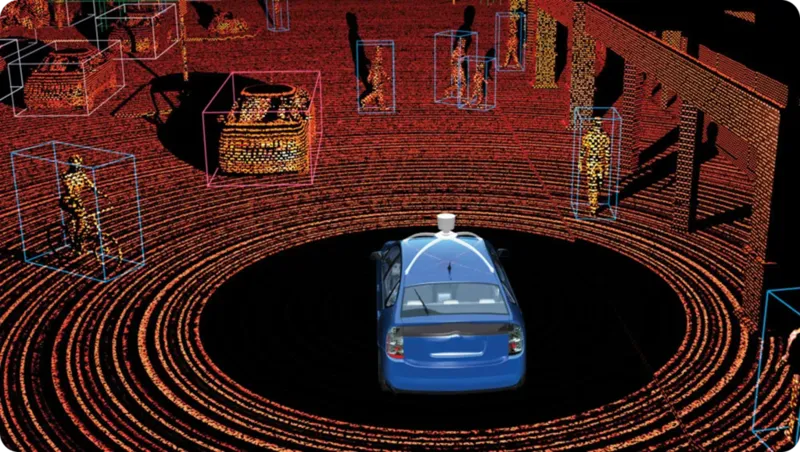

在这些方法中,激光雷达(光探测和测距)通常是深度测量最可靠的方法。它的工作原理是发出快速的激光脉冲,并测量它们反弹回来的时间。结果是一个高度精确的 3D 地图,称为点云,它实时突出显示物体的形状、位置和距离。

激光雷达技术可以分为两种主要类型,每种类型都专为特定应用和环境而设计。 以下是两种类型的详细介绍:

激光雷达数据的一个重要应用是在自动驾驶汽车中,它在车道检测、避撞和识别附近物体等任务中起着关键作用。激光雷达生成详细的实时环境 3D 地图,使车辆能够看到物体、计算其距离并安全导航。

RGB 图像捕获我们在可见光光谱中看到的内容;然而,其他成像技术,如热成像和红外成像,超越了这一点。红外成像捕获物体发射或反射的红外光,使其在低光照条件下非常有用。

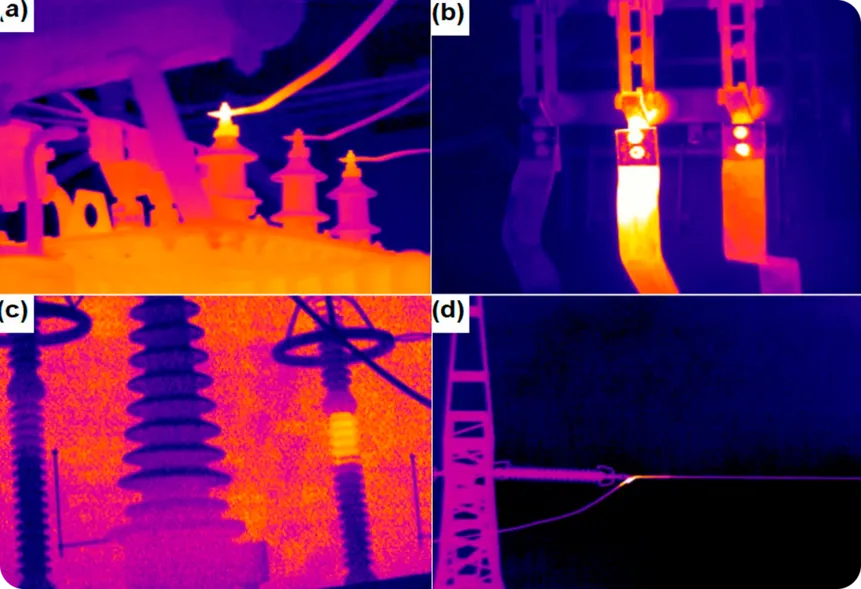

相比之下,热成像检测物体发出的热量并显示温度差异,使其能够在完全黑暗或穿过烟雾、雾气和其他障碍物的情况下工作。这种类型的数据对于监测和检测问题特别有用,尤其是在温度变化可能预示潜在问题的行业中。

一个有趣的例子是使用热成像来监测电气元件,以查找过热迹象。通过检测温度差异,热像仪可以在问题导致设备故障、火灾或代价高昂的损坏之前识别出问题。

同样,红外图像可以通过识别表明气体或液体泄漏的温差,帮助detect 管道或绝缘层的泄漏情况,这对于预防危险情况和提高能源效率至关重要。

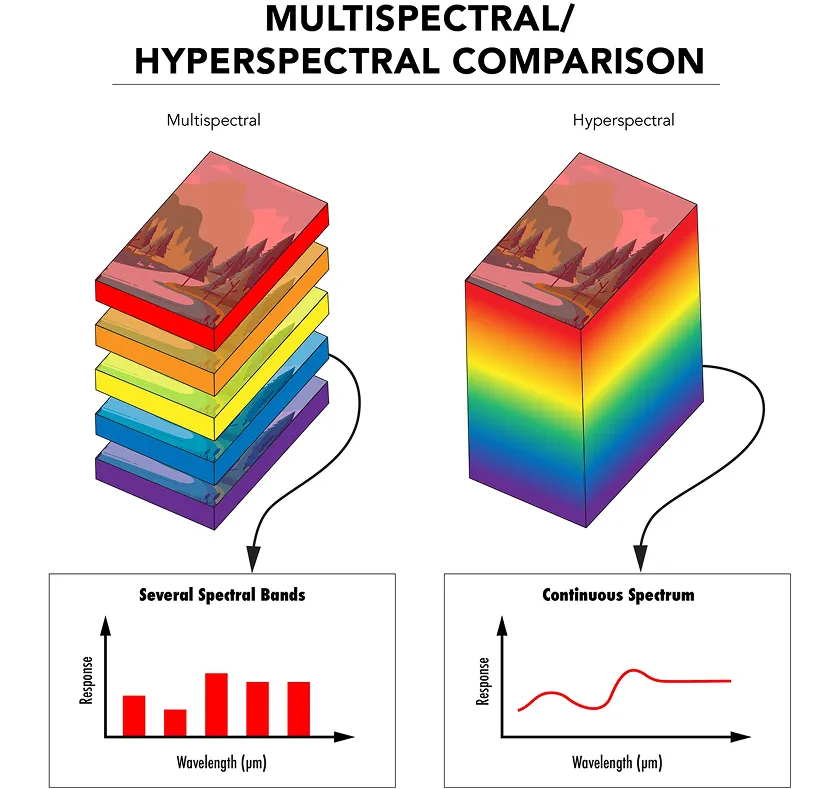

虽然红外和热成像可以捕获电磁波谱的特定方面,但多光谱成像可以从几个选定的波长范围收集光,每个波长范围都针对特定目的而选择,例如检测健康的植被或识别表面材料。

高光谱成像通过捕获数百个非常窄且连续的波长范围内的光,从而更进一步。 这为图像中的每个像素提供了详细的光谱特征,从而可以更深入地了解所观察的任何材料。

多光谱和高光谱成像都使用特殊的传感器和滤镜来捕获不同波长的光。然后将数据组织成一个称为光谱立方体的 3D 结构,每一层代表一个不同的波长。

人工智能模型可以分析这些数据,detect 普通相机或人眼无法看到的特征。例如,在植物表型分析中,高光谱成像可用于监测植物的健康和生长情况,检测植物叶片或茎部的细微变化,如营养缺乏或压力。这有助于研究人员评估植物健康状况,优化农业实践,而无需采用侵入性方法。

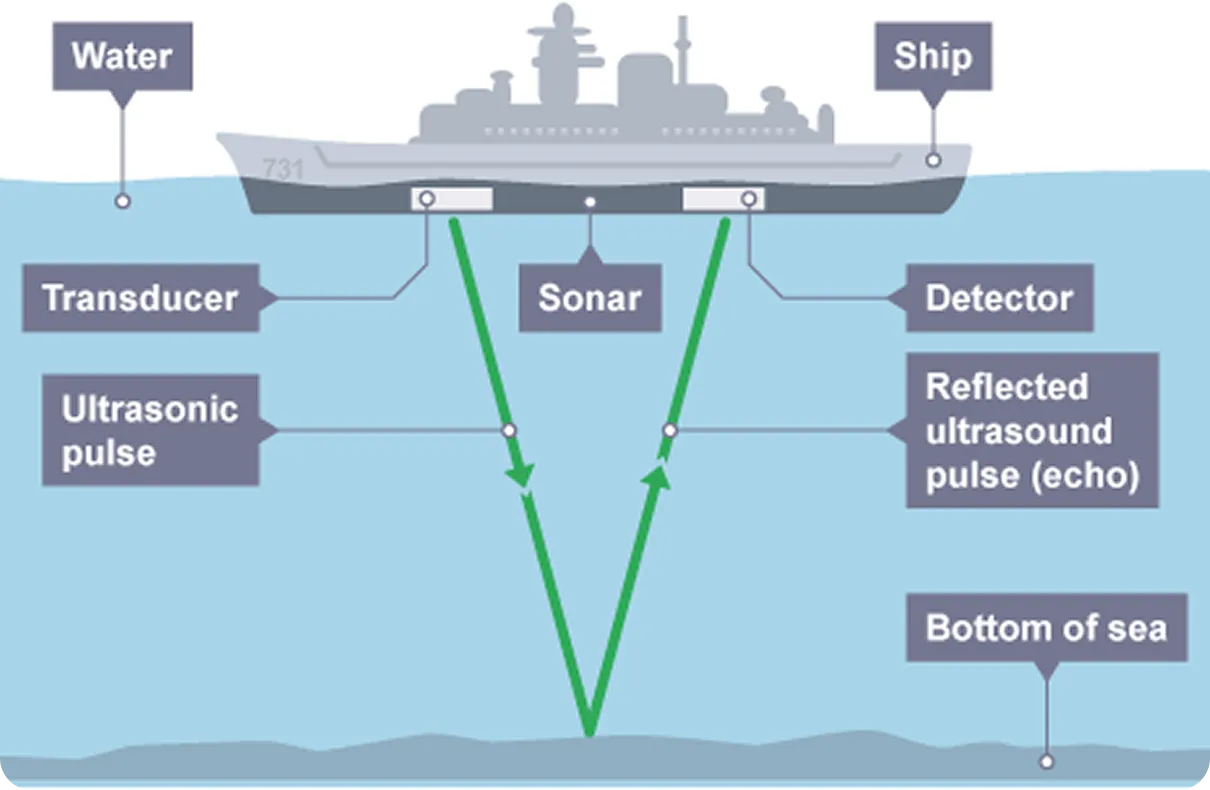

雷达和声纳成像是通过发送信号并分析信号反射来detect 和绘制物体地图的技术,类似于激光雷达。与依靠光波捕捉视觉信息的 RGB 成像不同,雷达使用的是电磁波,通常是无线电波,而声纳使用的是声波。雷达和声纳系统都发射脉冲信号,并测量信号从物体反弹回来所需的时间,从而提供有关物体距离、大小和速度的信息。

雷达成像在能见度较低时尤其有用,例如雾天、雨天或夜间。由于它不依赖光线,因此可以在完全黑暗的环境中detect 飞机、车辆或地形。这使得雷达成为航空、气象监测和自主导航领域的可靠选择。

相比之下,声纳成像常用于光线无法到达的水下环境。它利用声波在水中传播并从水下物体反射,从而能够探测潜艇、绘制海底地图和执行水下救援任务。计算机视觉的进步现在可以通过将声纳数据与智能分析相结合,进一步增强水下探测能力,从而改进探测和决策。

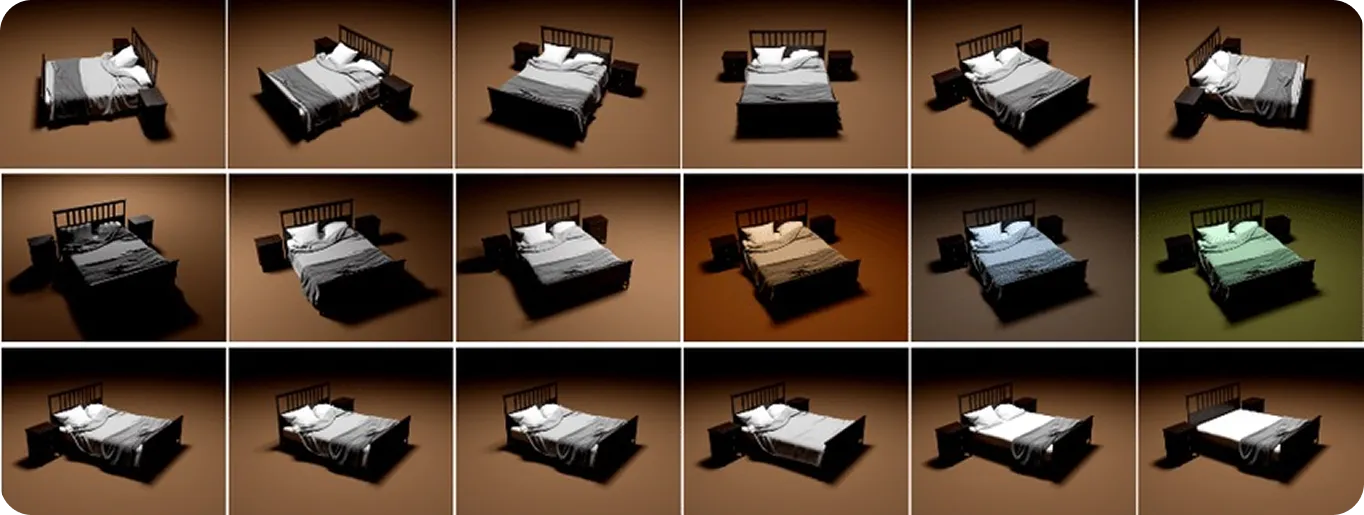

到目前为止,我们讨论的不同类型的数据都是可以从现实世界中收集到的数据。然而,合成和模拟视觉数据都是人工内容类型。合成数据是使用 3D 建模 或生成式人工智能从头开始生成的,以生成逼真的图像或视频。

模拟数据与之类似,但涉及创建虚拟环境,以复制物理世界的行为方式,包括光反射、阴影形成和物体移动。虽然所有模拟的视觉数据都是合成的,但并非所有合成数据都是模拟的。关键区别在于,模拟数据复制的是真实的行为,而不仅仅是外观。

这些数据类型对于训练 计算机视觉模型 非常有用,尤其是在难以收集真实世界数据或需要模拟特定的、罕见的情况下。开发人员可以创建完整的场景,选择对象类型、位置和光照,并自动添加诸如边界框之类的标签以进行训练。这有助于快速构建大型、多样化的数据集,而无需真实的图片或手动标记,从而节省成本和时间。

例如,在医疗保健领域,合成数据可用于训练segment 乳腺癌细胞的模型,而收集和标记大型真实图像数据集是很困难的。合成和模拟数据具有灵活性和可控性,填补了真实世界视觉效果有限的空白。

既然我们已经了解了不同类型的视觉数据如何工作以及它们可以做什么,那么让我们仔细看看哪种数据类型最适合特定任务:

有时,在现实环境中,单一数据类型可能无法提供足够的准确性或上下文信息。这时,多模态传感器融合就变得至关重要。通过将 RGB 与其他数据类型(如热成像、深度或激光雷达)相结合,系统可以克服单个数据类型的局限性,从而提高可靠性和适应性。

例如,在 仓库自动化 中,使用 RGB 进行物体识别,使用深度进行距离测量,使用热成像来检测过热设备,可以使操作更高效、更安全。最终,最好的结果来自根据您的应用程序的特定需求选择或组合数据类型。

在构建视觉 AI 模型时,选择正确的视觉数据类型至关重要。诸如目标检测、分割和运动跟踪之类的任务不仅依赖于算法,还依赖于输入数据的质量。干净、多样且准确的数据集有助于减少噪声并提高性能。

通过结合RGB、深度、热成像和激光雷达等数据类型,AI系统可以更全面地了解环境,从而使其在各种条件下更可靠。随着技术的不断进步,它可能会为视觉AI在各行各业中变得更快、更适应性更强和更具影响力铺平道路。

加入我们的社区,探索我们的GitHub 仓库,以了解更多关于计算机视觉的信息。在我们的解决方案页面上,探索与医疗保健领域的人工智能和零售业中的计算机视觉相关的各种应用。查看我们的许可选项,开始使用 Vision AI。

开启您的机器学习未来之旅