Узнайте, как типы визуальных данных, такие как тепловизионная съемка, LiDAR и инфракрасные изображения, обеспечивают разнообразные приложения компьютерного зрения в различных отраслях.

Узнайте, как типы визуальных данных, такие как тепловизионная съемка, LiDAR и инфракрасные изображения, обеспечивают разнообразные приложения компьютерного зрения в различных отраслях.

Такие технологии, как дроны, раньше были ограничены и доступны только исследователям и специалистам, но в настоящее время передовое оборудование становится все более доступным для широкой аудитории. Этот сдвиг меняет способы сбора визуальных данных. Благодаря более доступным технологиям мы теперь можем получать изображения и видео из различных источников, а не только с традиционных камер.

Параллельно с этим стремительно развивается аналитика изображений, основанная на компьютерном зрении- одной из отраслей искусственного интеллекта (ИИ), позволяющей машинам более эффективно интерпретировать и обрабатывать визуальные данные. Этот прогресс открыл новые возможности для автоматизации, обнаружения объектов и анализа в режиме реального времени. Теперь машины могут распознавать закономерности, track движение и понимать смысл сложных визуальных данных.

К основным типам визуальных данных относятся изображения RGB (красный, зеленый, синий), которые обычно используются для распознавания объектов, тепловизионные изображения, которые помогают detect тепловые сигнатуры в условиях недостаточной освещенности, и данные о глубине, которые позволяют машинам понимать 3D-окружение. Каждый из этих типов данных играет важную роль в различных приложениях Vision AI - от видеонаблюдения до медицинской визуализации.

В этой статье мы рассмотрим основные типы визуальных данных, используемых в Vision AI, и изучим, как каждый из них способствует повышению точности, эффективности и производительности в различных отраслях. Давайте начнем!

Как правило, когда вы используете смартфон для фотосъемки или просмотра видео с камер видеонаблюдения, вы работаете с изображениями RGB. RGB означает красный, зеленый и синий — это три цветовых канала, которые представляют визуальную информацию в цифровых изображениях.

RGB-изображения и видео — это тесно связанные типы визуальных данных, используемые в компьютерном зрении, оба из которых снимаются с помощью стандартных камер. Ключевое различие заключается в том, что изображения фиксируют один момент, а видео — это последовательность кадров, показывающих, как вещи меняются со временем.

RGB-изображения обычно используются для задач компьютерного зрения, таких как обнаружение объектов, сегментация экземпляров и оценка позы, при поддержке таких моделей, как Ultralytics YOLO11. Эти задачи предполагают выявление паттернов, форм или специфических особенностей в одном кадре.

С другой стороны, видеоролики необходимы, когда речь идет о движении или времени, например, для распознавания жестов, наблюдения или отслеживания действий. Поскольку видео можно рассматривать как серию изображений, модели компьютерного зрения, такие как YOLO11 , обрабатывают их кадр за кадром, чтобы понять движение и поведение с течением времени.

Например, YOLO11 можно использовать для анализа RGB-изображений или видеозаписей, чтобы detect сорняки и подсчитать растения на сельскохозяйственных полях. Это улучшает мониторинг урожая и помогает track изменения в течение вегетационного цикла для более эффективного управления фермой.

Данные о глубине добавляют третье измерение к визуальной информации, указывая, как далеко объекты находятся от камеры или датчика. В отличие от RGB-изображений, которые только фиксируют цвет и текстуру, данные о глубине обеспечивают пространственный контекст. Они показывают расстояние между объектами и камерой, позволяя интерпретировать 3D-компоновку сцены.

Этот тип данных собирается с помощью таких технологий, как LiDAR, стереозрение (использование двух камер для имитации человеческого восприятия глубины) и камеры Time-of-Flight (измерение времени, которое требуется свету, чтобы достичь объекта и вернуться обратно).

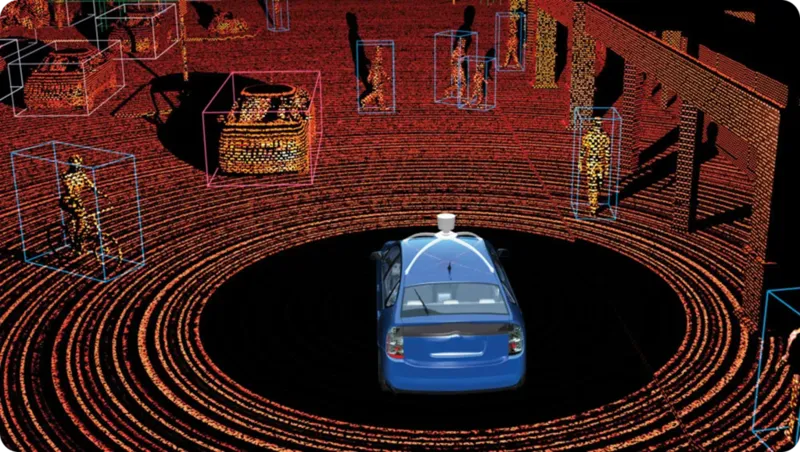

Среди них LiDAR (Light Detection and Ranging) часто является наиболее надежным для измерения глубины. Он работает, отправляя быстрые лазерные импульсы и измеряя время, которое требуется им, чтобы отразиться обратно. Результатом является высокоточная 3D-карта, известная как облако точек, которая выделяет форму, положение и расстояние объектов в режиме реального времени.

Технологию LiDAR можно разделить на два основных типа, каждый из которых предназначен для конкретных приложений и сред. Вот более подробный взгляд на оба типа:

Важным применением данных LiDAR является использование в автономных транспортных средствах, где он играет ключевую роль в таких задачах, как обнаружение полосы движения, предотвращение столкновений и идентификация близлежащих объектов. LiDAR генерирует подробные 3D-карты окружающей среды в режиме реального времени, позволяя транспортному средству видеть объекты, вычислять расстояние до них и безопасно перемещаться.

RGB-изображения фиксируют то, что мы видим в спектре видимого света; однако другие технологии визуализации, такие как тепловая и инфракрасная визуализация, выходят за рамки этого. Инфракрасная визуализация фиксирует инфракрасный свет, который излучается или отражается объектами, что делает ее полезной в условиях низкой освещенности.

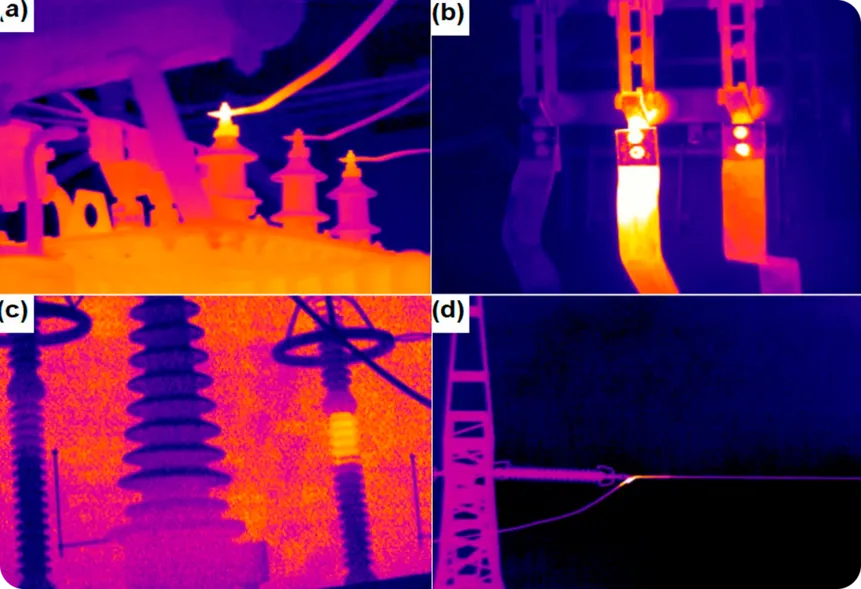

Тепловая визуализация, напротив, обнаруживает тепло, излучаемое объектами, и показывает разницу температур, позволяя ей работать в полной темноте или сквозь дым, туман и другие препятствия. Этот тип данных особенно полезен для мониторинга и выявления проблем, особенно в отраслях, где изменения температуры могут сигнализировать о потенциальных проблемах.

Интересным примером является использование тепловой визуализации для мониторинга электрических компонентов на предмет признаков перегрева. Обнаруживая разницу температур, тепловизионные камеры могут выявлять проблемы до того, как они приведут к отказу оборудования, пожарам или дорогостоящему ущербу.

Аналогичным образом, инфракрасные изображения помогают detect утечки в трубопроводах или изоляции, определяя разницу температур, указывающую на утечку газов или жидкостей, что крайне важно для предотвращения опасных ситуаций и повышения энергоэффективности.

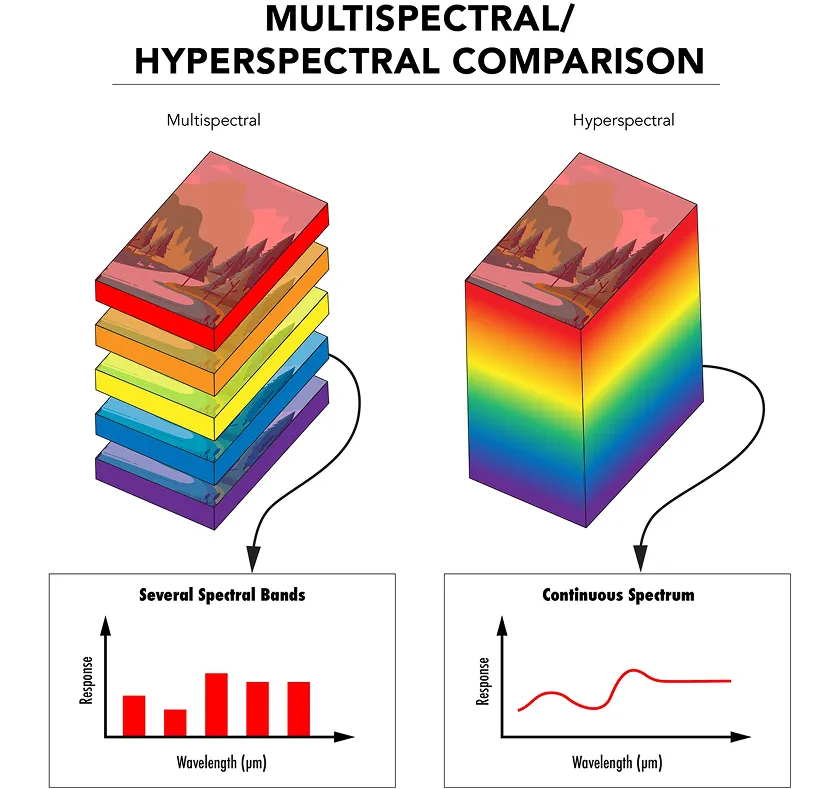

В то время как инфракрасная и тепловая визуализация фиксируют определенные аспекты электромагнитного спектра, мультиспектральная визуализация собирает свет из нескольких выбранных диапазонов длин волн, каждый из которых выбран для определенной цели, например, для обнаружения здоровой растительности или идентификации материалов поверхности.

Гиперспектральная визуализация идет еще дальше, фиксируя свет в сотнях очень узких и непрерывных диапазонов длин волн. Это обеспечивает подробную световую сигнатуру для каждого пикселя в изображении, предлагая гораздо более глубокое понимание любого наблюдаемого материала.

Как мультиспектральная, так и гиперспектральная визуализация используют специальные датчики и фильтры для захвата света на разных длинах волн. Затем данные организуются в трехмерную структуру, называемую спектральным кубом, где каждый слой представляет собой разную длину волны.

Модели искусственного интеллекта могут анализировать эти данные для detect особенностей, которые не видят обычные камеры или человеческий глаз. Например, при фенотипировании растений гиперспектральная съемка может использоваться для мониторинга здоровья и роста растений путем обнаружения едва заметных изменений в их листьях или стеблях, таких как дефицит питательных веществ или стресс. Это помогает исследователям оценивать состояние растений и оптимизировать сельскохозяйственную практику без применения инвазивных методов.

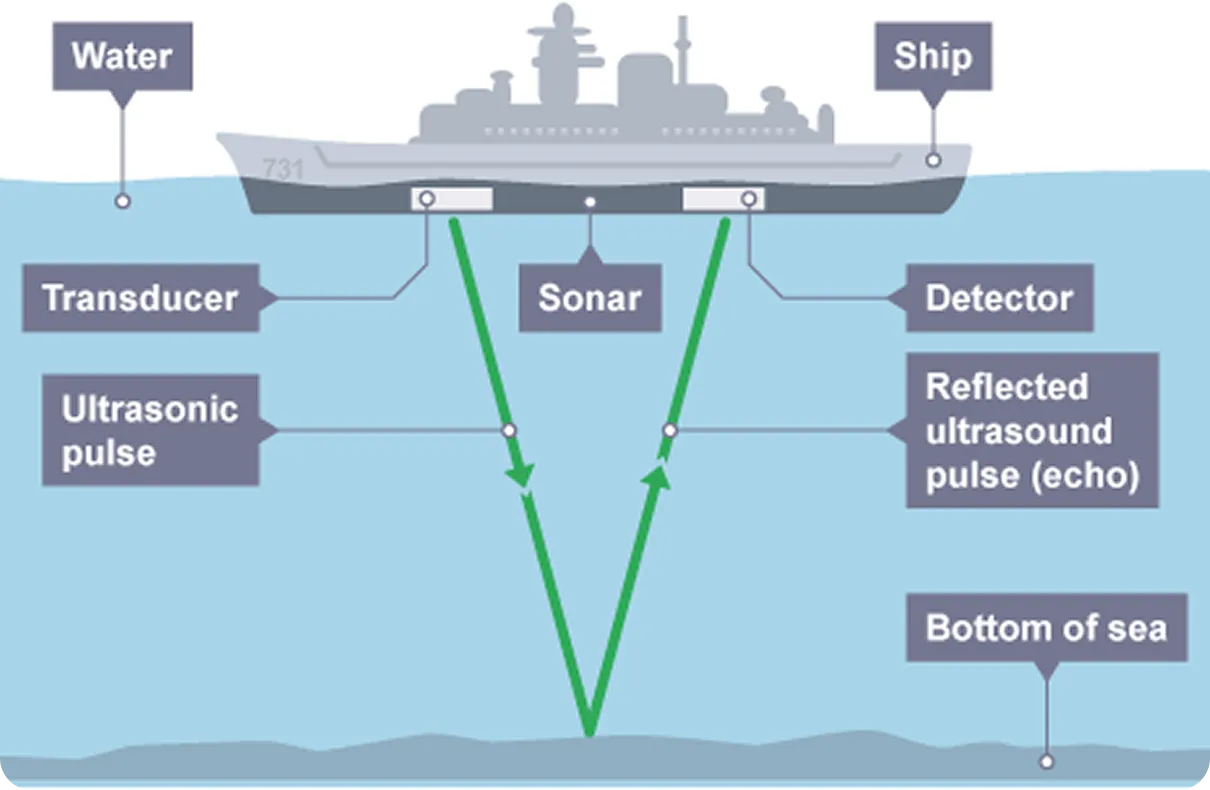

Радар и сонар - это технологии, позволяющие detect и наносить на карту объекты, посылая сигналы и анализируя их отражение, подобно LiDAR. В отличие от RGB-изображения, которое использует световые волны для получения визуальной информации, радар использует электромагнитные волны, как правило, радиоволны, а сонар - звуковые волны. И радар, и сонар излучают импульсы и измеряют время, необходимое для отражения сигнала от объекта, предоставляя информацию о его расстоянии, размере и скорости.

Радарная съемка особенно полезна при плохой видимости, например, во время тумана, дождя или в ночное время. Поскольку радар не полагается на свет, он может detect самолеты, транспортные средства или местность в полной темноте. Это делает радар надежным выбором в авиации, мониторинге погоды и автономной навигации.

В сравнении с этим, гидролокационная визуализация обычно используется в подводных средах, куда не проникает свет. Она использует звуковые волны, которые распространяются в воде и отражаются от подводных объектов, что позволяет обнаруживать подводные лодки, составлять карты морского дна и выполнять подводные спасательные операции. Достижения в области компьютерного зрения в настоящее время позволяют дополнительно улучшить подводное обнаружение путем объединения данных гидролокатора с интеллектуальным анализом для улучшения обнаружения и принятия решений.

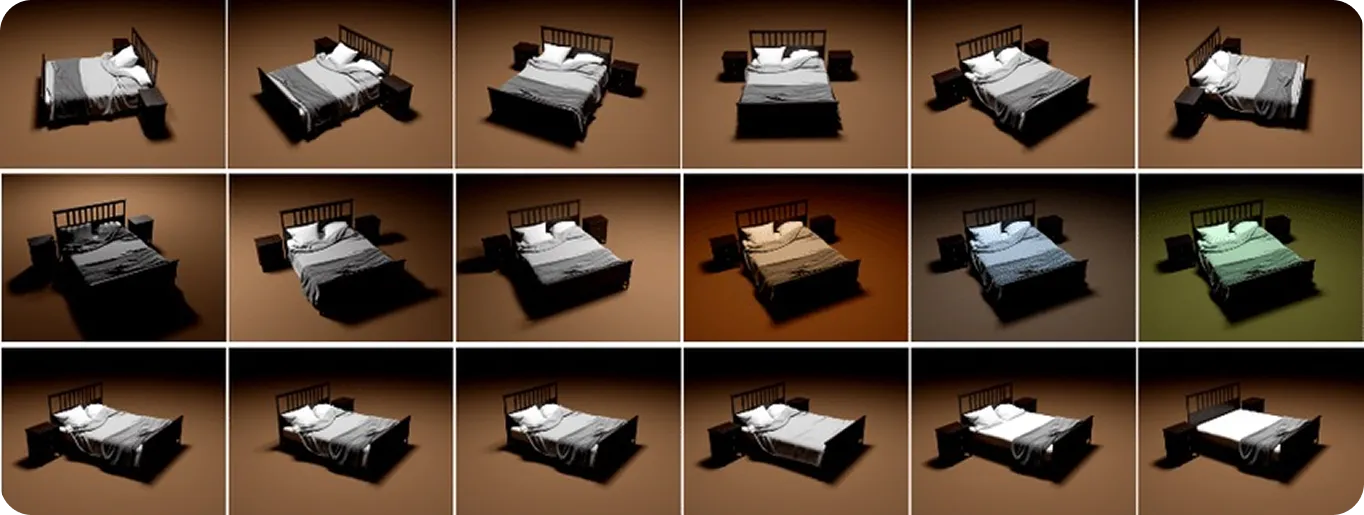

До сих пор различные типы данных, которые мы обсуждали, были теми, которые можно собрать из реального мира. Однако синтетические и смоделированные визуальные данные — это типы искусственного контента. Синтетические данные генерируются с нуля с использованием 3D-моделирования или генеративного ИИ для создания реалистично выглядящих изображений или видео.

Смоделированные данные похожи, но включают в себя создание виртуальных сред, которые воспроизводят поведение физического мира, включая отражение света, формирование теней и движение объектов. Хотя все смоделированные визуальные данные являются синтетическими, не все синтетические данные являются смоделированными. Ключевое различие заключается в том, что смоделированные данные воспроизводят реалистичное поведение, а не только внешний вид.

Эти типы данных полезны для обучения моделей компьютерного зрения, особенно когда реальные данные трудно собрать или когда необходимо смоделировать конкретные, редкие ситуации. Разработчики могут создавать целые сцены, выбирать типы объектов, положения и освещение, а также автоматически добавлять метки, такие как ограничивающие рамки, для обучения. Это помогает быстро создавать большие, разнообразные наборы данных без необходимости использования реальных фотографий или ручной разметки, что может быть дорогостоящим и трудоемким.

Например, в здравоохранении синтетические данные можно использовать для обучения моделей segment клеток рака молочной железы, когда сбор и маркировка больших массивов данных реальных изображений затруднены. Синтетические и симулированные данные обеспечивают гибкость и контроль, заполняя пробелы, когда реальные визуальные данные ограничены.

Теперь, когда мы рассмотрели, как работают различные типы визуальных данных и что они могут делать, давайте подробнее рассмотрим, какие типы данных лучше всего подходят для конкретных задач:

Иногда одного типа данных может быть недостаточно для обеспечения достаточной точности или контекста в реальных ситуациях. Именно здесь ключевым становится мультимодальное объединение датчиков. Объединяя RGB с другими типами данных, такими как тепловые, глубинные или LiDAR, системы могут преодолеть индивидуальные ограничения, повышая надежность и адаптируемость.

Например, в автоматизации складов использование RGB для распознавания объектов, глубины для измерения расстояния и тепловизора для обнаружения перегрева оборудования делает операции более эффективными и безопасными. В конечном счете, наилучшие результаты достигаются за счет выбора или объединения типов данных на основе конкретных потребностей вашего приложения.

При создании моделей Vision AI выбор правильного типа визуальных данных имеет решающее значение. Такие задачи, как обнаружение объектов, сегментация и отслеживание движения, зависят не только от алгоритмов, но и от качества входных данных. Чистые, разнообразные и точные наборы данных помогают уменьшить шум и повысить производительность.

Объединяя типы данных, такие как RGB, глубина, тепловизионные и LiDAR, системы ИИ получают более полное представление об окружающей среде, что делает их более надежными в различных условиях. По мере того, как технологии продолжают совершенствоваться, это, вероятно, откроет путь к тому, что Vision AI станет быстрее, адаптируемее и окажет большее влияние на различные отрасли.

Присоединяйтесь к нашему сообществу и изучите наш репозиторий GitHub, чтобы узнать больше о компьютерном зрении. Откройте для себя различные приложения, связанные с ИИ в здравоохранении и компьютерным зрением в розничной торговле, на страницах наших решений. Ознакомьтесь с нашими вариантами лицензирования, чтобы начать работу с Vision AI.

Начните свой путь в будущее машинного обучения