So wählst du eine Cloud-GPU für das Vision-AI-Training auf der Ultralytics Platform aus

Erfahre, wie du auf der Ultralytics Platform die richtige Cloud-GPU für das Training von Computer Vision auswählst, basierend auf Faktoren wie Datensatzgröße, Modellkomplexität und Kosten.

Letzten Monat haben wir die Ultralytics Platform eingeführt, eine End-to-End-Umgebung, die entwickelt wurde, um den gesamten Workflow für Computer Vision zu optimieren – von der Datensatzverwaltung bis hin zum Modelltraining und der Bereitstellung. Die Ultralytics Platform bündelt alles, was du zum Erstellen und Skalieren von Vision-KI-Modellen benötigst, in einer einzigen, einheitlichen Erfahrung.

Ein wesentlicher Bestandteil dieses Workflows ist das Modelltraining, bei dem neuronale Netzwerke Muster aus Daten lernen, um präzise Vorhersagen zu treffen – und der Zugriff auf die richtigen Rechenressourcen spielt dabei eine entscheidende Rolle. Wir haben bereits untersucht, wie die Ultralytics Platform das Modelltraining mit Cloud-Grafikprozessoren (GPU) unterstützt, sodass du Computer-Vision-Modelle trainieren kannst, ohne lokale Infrastruktur verwalten zu müssen.

Mit dem On-Demand-Zugriff auf leistungsstarke NVIDIA GPUs können Nutzer – von Studierenden und Startups bis hin zu Forschenden und großen Organisationen – KI-Workloads effizienter als je zuvor ausführen. Der Einstieg in das Cloud-Training ist zwar unkompliziert, aber die Auswahl der richtigen GPU erfordert die Berücksichtigung von Faktoren wie Datensatzgröße, Modellkomplexität und Kosten.

Angesichts der heute verfügbaren breiten Palette an Optionen, von kostengünstigen RTX GPUs bis hin zu leistungsstarken NVIDIA H100 und der Blackwell-Hardware der nächsten Generation, kann die Auswahl der richtigen Konfiguration erhebliche Auswirkungen auf die Modellentwicklung und die Kosten haben.

In diesem Artikel betrachten wir das Cloud-GPU-Training für Computer Vision auf der Ultralytics Platform und wie du die richtige Hardware für deinen Workload auswählst. Fangen wir an!

Ein Überblick über das Cloud-Training auf der Ultralytics Platform

Bevor wir uns damit befassen, wie man eine GPU für das Cloud-Training auf der Ultralytics Platform auswählt, machen wir einen Schritt zurück und schauen uns an, wie Cloud-Training funktioniert.

Was ist Cloud-GPU-Training?

Cloud-GPU-Training bedeutet, dass in einer Cloud-Umgebung gehostete GPUs genutzt werden, um Machine-Learning- und Deep-Learning-Modelle zu trainieren, anstatt sich auf die eigene lokale Hardware oder Workstation zu verlassen. Auf der Ultralytics Platform kannst du so auf Knopfdruck auf leistungsstarke GPUs zugreifen und Trainingsjobs remote ausführen, ohne ein eigenes Setup zu benötigen.

Dadurch kannst du deine Ressourcen einfach an deinen Workload anpassen. Du kannst leistungsstärkere GPUs wählen oder die Kapazität nach Bedarf erhöhen, ohne durch die Möglichkeiten deines eigenen Systems eingeschränkt zu sein. Du kannst dir das wie den Zugriff auf leistungsstarke Maschinen oder Knoten in entfernten Rechenzentren vorstellen, die du je nach Bedarf skalieren kannst.

Außerdem entfällt die Notwendigkeit, teure Hardware einzurichten und zu warten. Du musst keine GPUs kaufen, keine Treiber installieren und dich nicht mit Kompatibilitätsproblemen herumschlagen.

Die Ultralytics Platform erledigt alles über verwaltete Cloud-Dienste, von der Bereitstellung der Ressourcen bis hin zum Umgebungs-Setup, der Orchestrierung und der Ausführung von Trainingsjobs, sodass du dich ganz auf das Training, das Experimentieren und die Verbesserung deiner Modelle konzentrieren kannst.

Wie Modelltraining auf der Ultralytics Platform funktioniert

Auf der Ultralytics Platform ist der GPU-beschleunigte Trainingsworkflow sehr einfach. Du kannst damit beginnen, deinen Datensatz auf verschiedene Arten einzubinden.

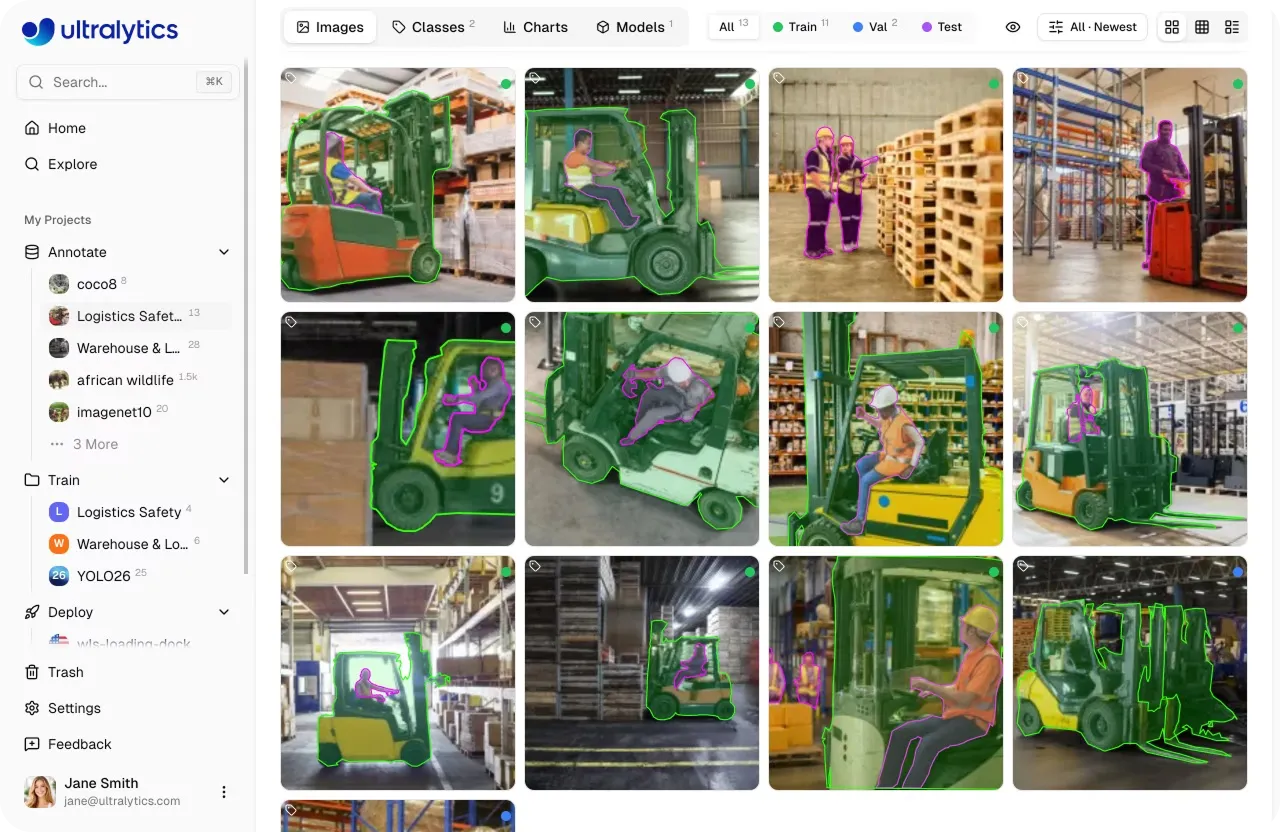

Du kannst deine eigenen Daten hochladen, auf der Plattform verfügbare öffentliche Datensätze nutzen oder von der Community geteilte Datensätze klonen, um auf bestehenden Arbeiten aufzubauen. Durch das Klonen eines Datensatzes wird eine Kopie in deinem Workspace erstellt, die du bearbeiten und erweitern kannst, während das Original unverändert bleibt.

Sobald du einen Datensatz ausgewählt hast, kannst du deine Bilder und Annotationen überprüfen und organisieren, um sicherzustellen, dass alles ordnungsgemäß strukturiert ist. Die Plattform enthält außerdem integrierte Annotations-Tools, mit denen du Daten für Aufgaben wie Objekterkennung, Segmentierung und Klassifizierung labeln oder den Prozess mit KI-gestützten Funktionen beschleunigen kannst.

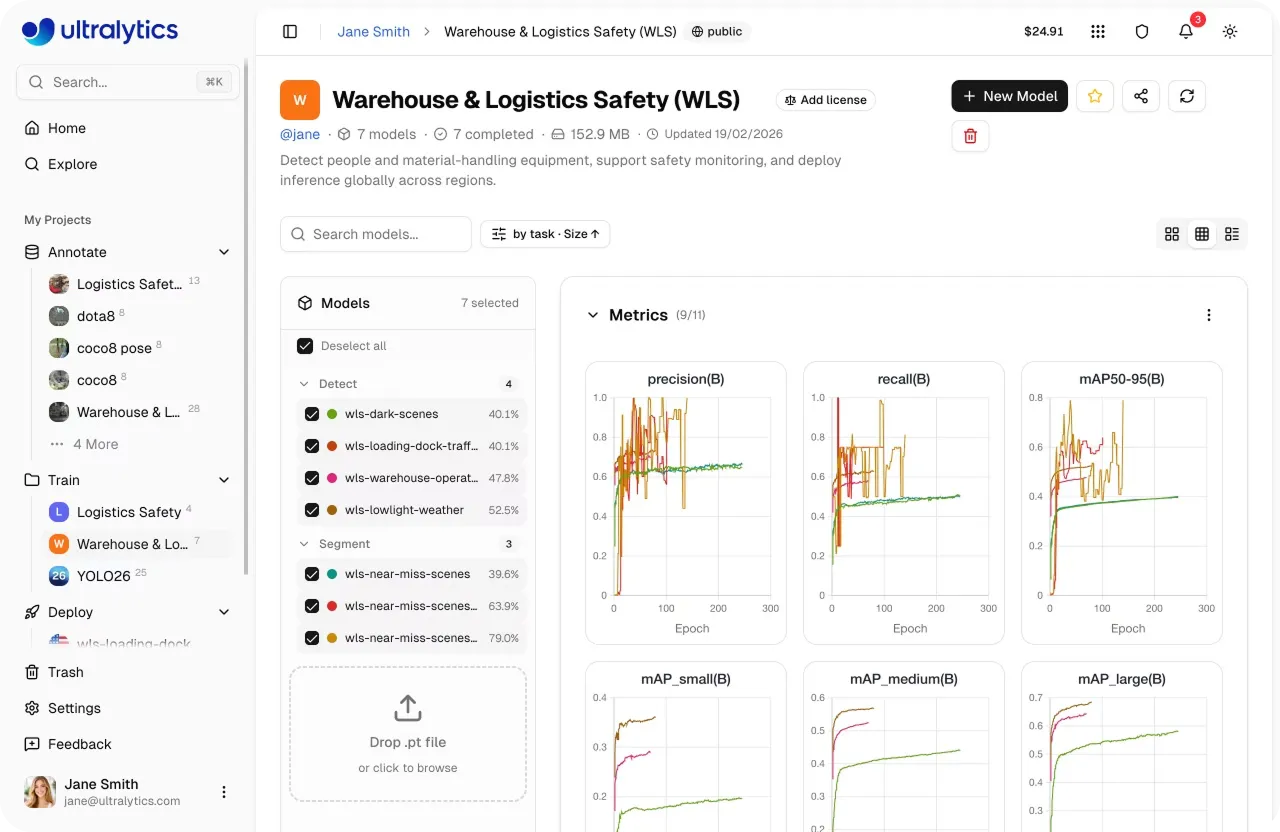

Abb. 1: Ansicht eines Datensatzes innerhalb der Ultralytics Platform (Quelle)

Als Nächstes kannst du ein Projekt auswählen oder erstellen, um deine Trainingsläufe zu verwalten. Projekte helfen dir dabei, Modelle zu organisieren und zu vergleichen, Leistungsmetriken zu verfolgen und verwandte Experimente an einem Ort zu speichern.

Von dort aus kannst du zum Cloud-Training wechseln, wo du ein Modell auswählst, Parameter konfigurierst und eine GPU basierend auf deinen Leistungs- und Budgetanforderungen wählst. Die Plattform kümmert sich für dich um die zugrunde liegende Cloud-Infrastruktur.

Sie stellt die gewählte GPU-Instanz bereit, bereitet deinen Datensatz vor und führt den Trainingsjob in der Cloud aus. Während das Training läuft, kannst du Metriken, Logs und die Systemleistung in Echtzeit überwachen, ohne dich um das Setup, CUDA-Umgebungen, Frameworks wie PyTorch oder TensorFlow oder die Hardware kümmern zu müssen.

Wichtige GPU-Trainingsfunktionen auf der Ultralytics Platform

Hier sind einige wichtige Funktionen des Cloud-GPU-Trainings auf der Ultralytics Platform:

- One-Click-Training: Starte Trainingsjobs mit minimalem Setup und wechsle schnell vom Datensatz zum Modelltraining ohne komplexe Konfiguration.

- On-Demand-GPUs: Wähle aus einer Reihe von GPU-Optionen basierend auf deinen Bedürfnissen und skaliere die Ressourcen nach Bedarf ohne langfristige Verpflichtungen.

- Echtzeit-Überwachung: Verfolge den Trainingsfortschritt mit Live-Diagrammen und Logs und sieh dir Systemmetriken wie GPU-Auslastung und Speicher in Echtzeit an.

- Automatische Checkpoints: Der Trainingsfortschritt wird in regelmäßigen Abständen gespeichert, wodurch es einfach ist, die Arbeit bei Bedarf fortzusetzen oder wiederherzustellen.

- Einfache Bereitstellung: Sobald das Training abgeschlossen ist, kannst du deine trainierten Modelle bereitstellen und sie in Anwendungen oder Workflows über geteilte Inference-APIs, dedizierte Endpunkte oder durch Export zur Verwendung auf externen Systemen nutzen. Diese Bereitstellungsoptionen ermöglichen Inference mit geringer Latenz, was Anwendungen wie Videoanalytik, Automatisierungssysteme und interaktive KI-Lösungen in Echtzeit ermöglicht.

Verschiedene Cloud-GPU-Optionen innerhalb der Ultralytics Platform

Nachdem wir nun gesehen haben, wie das Training auf der Plattform funktioniert, schauen wir uns die verschiedenen verfügbaren GPU-Optionen an. Die von dir gewählte GPU kann beeinflussen, wie schnell dein Modell trainiert, wie gut es abschneidet und wie viel es kostet.

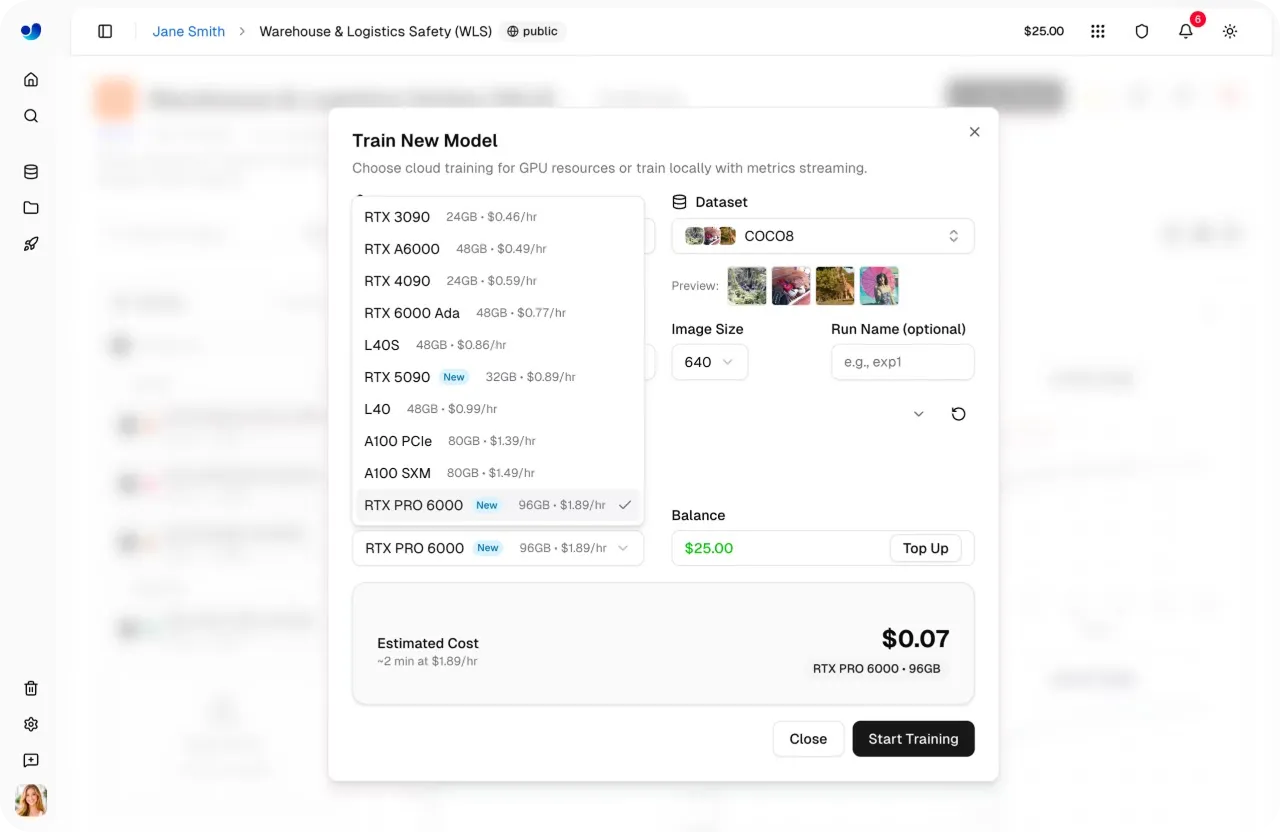

Die Ultralytics Platform bietet eine breite Palette an GPUs an, angefangen bei Optionen wie der RTX 2000 Ada und RTX A4500, über GPUs wie die RTX 4000 Ada, RTX A5000, RTX 3090 und RTX A6000 bis hin zu leistungsstärkeren Optionen wie der RTX 4090 und RTX PRO 6000.

Abb. 2: Ein Beispiel für die verschiedenen GPU-Optionen, die von der Ultralytics Platform unterstützt werden (Quelle)

Für die meisten Nutzer ist die RTX PRO 6000 eine ausgewogene Standardwahl. Sie liefert zuverlässige Leistung bei einer Vielzahl von Workloads, ohne dass viel Tuning erforderlich ist. Die RTX 4090 ist eine weitere beliebte Option, die eine starke Leistung für ihren Preis bietet.

Für kleinere Aufgaben wie schnelle Experimente, Prototyping oder die Arbeit mit leichtgewichtigen Datensätzen sind GPUs wie die RTX 2000 Ada und RTX A4500 ein guter Einstieg. Wenn dein Workload wächst, bieten Optionen wie die RTX 4000 Ada, RTX A5000 und RTX 3090 eine konsistentere Leistung für allgemeine Trainingsaufgaben.

Im High-End-Bereich sind GPUs wie die A100 (Ampere), H100 und H200 (Hopper) sowie B200 (Blackwell) für Workloads im großen Maßstab konzipiert. Diese eignen sich am besten für das Training sehr großer Modelle, die Verarbeitung massiver Datensätze oder die Ausführung von Jobs, bei denen Geschwindigkeit und Leistung entscheidend sind.

Verständnis der verschiedenen GPU-Typen und ihrer Anwendungsfälle

Schauen wir uns als Nächstes an, wie die verschiedenen GPU-Typen im Vergleich abschneiden und wo sie am besten passen.

RTX GPUs von NVIDIA sind im Allgemeinen kostengünstiger und werden häufig für alltägliche Trainingsaufgaben, Experimente sowie kleine bis mittlere Workloads verwendet. Sie bieten ein Gleichgewicht zwischen Leistung und Erschwinglichkeit und sind daher für ein breites Spektrum an Anwendungsfällen geeignet.

Im Vergleich dazu sind GPUs wie die A100, A40 und L40 für intensivere Workloads und Training in größerem Maßstab konzipiert. Sie bieten höhere Stabilität und Skalierbarkeit, insbesondere bei der Arbeit mit größeren Datensätzen oder komplexeren Modellen.

Im High-End-Bereich repräsentieren GPUs wie die H100 und die auf NVIDIAs Blackwell-Architektur basierenden Modelle modernere KI-Hardware. Diese sind für leistungsstarke Workloads ausgelegt und werden typischerweise für Training im großen Maßstab, fortschrittliche Forschung oder zeitkritische Aufgaben eingesetzt.

Die Bandbreite der auf der Ultralytics Platform verfügbaren GPU-Optionen bietet Flexibilität für verschiedene Workloads. Abhängig von deinen Anforderungen kannst du mit kleineren Setups beginnen und bei Bedarf skalieren.

Wie du die richtige Cloud-GPU für dein Projekt auswählst

Bei der Auswahl einer GPU für das Cloud-Training auf der Ultralytics Platform gibt es mehrere Faktoren zu berücksichtigen, darunter Datensatzgröße, Modellkomplexität und Kosten. Gehen wir jeden dieser Faktoren durch.

Anpassung der GPU-Leistung an die Datensatzgröße

Einer der Hauptfaktoren bei der Auswahl einer GPU ist deine Datensatzgröße, da sie beeinflusst, wie lange das Training dauert und wie viel Rechenleistung du benötigst.

Für kleine Datensätze, in der Regel weniger als 1.000 Bilder, reicht eine leichtgewichtige GPU wie die RTX 2000 oft aus. Dies funktioniert gut für schnelle Experimente und kürzere Trainingsläufe.

Für mittelgroße Datensätze, etwa 1.000 bis 10.000 Bilder, bieten GPUs wie die RTX 4090 oder RTX A6000 ein besseres Gleichgewicht zwischen Leistung und Effizienz, was dir hilft, flüssiger zu trainieren, ohne lange Verzögerungen.

Für größere Datensätze, über 10.000 Bilder, wirst du wahrscheinlich leistungsstärkere Hardware benötigen, um die Trainingszeiten in einem vernünftigen Rahmen zu halten. GPUs wie die H100 eignen sich besser für intensivere Workloads und effektive Skalierung.

Insgesamt geht es darum, die Größe deines Datensatzes mit der erforderlichen Rechenleistung und den Möglichkeiten zur parallelen Verarbeitung abzustimmen.

Auswahl einer GPU basierend auf Modellgröße und Komplexität

Ein weiterer wichtiger Faktor bei der Auswahl einer GPU ist die Größe und Komplexität deines Vision-KI-Modells. Modelle unterschiedlicher Größe erfordern unterschiedliche Mengen an Rechenleistung.

Kleinere Modelle benötigen zum Beispiel weniger GPU-Rechenleistung und können effizient auf GPUs wie der RTX 2000 Ada, RTX A4500 oder sogar der RTX 4090 ausgeführt werden, wenn du schnellere Ergebnisse wünschst. Diese sind ideal für schnelle Experimente, Prototyping und einfachere Aufgaben, da sie es dir ermöglichen, schneller zu iterieren und Ideen ohne hohe Rechenkosten zu testen.

Größere und komplexere Modelle erfordern hingegen deutlich mehr Speicher und Rechenleistung. GPUs wie die RTX A6000, RTX PRO 6000 und High-End-Optionen wie die H100 sind für diese Workloads besser geeignet. Sie können größere Architekturen handhaben, die Trainingszeit verkürzen und Speicherprobleme verhindern – was besonders bei der Arbeit mit hochauflösenden Bildern, großen Batch-Größen oder fortgeschritteneren Modelldesigns wichtig ist.

Vergleich von Batch-Größe und GPU-Speicher

Ebenso spielt die Batch-Größe eine wichtige Rolle beim Modelltraining. Sie bezieht sich auf die Anzahl der Trainingsbeispiele, die das Modell gleichzeitig in einem einzigen Schritt verarbeitet.

Größere Batch-Größen können die Trainingseffizienz verbessern, da mehr Daten auf einmal verarbeitet werden, erfordern aber auch mehr GPU-Speicher (VRAM). Im Allgemeinen können GPUs mit höherer Speicherbandbreite größere Batch-Größen unterstützen, während GPUs mit weniger Speicher möglicherweise kleinere Batches erfordern.

Zum Beispiel können GPUs wie die RTX A6000, RTX PRO 6000 oder A100 aufgrund ihres größeren Speichers problemlos größere Batch-Größen handhaben, während Optionen wie die RTX 4090 oder RTX 2000 Ada je nach Workload möglicherweise kleinere Batch-Größen erfordern.

Die Verwendung der größten GPU ist jedoch nicht immer notwendig. High-End-GPUs können zwar Geschwindigkeit und Kapazität erhöhen, sind aber auch mit höheren Kosten verbunden. In vielen Fällen kann die Anpassung der Batch-Größe auf einer kleineren GPU eine effizientere Wahl sein.

Letztlich ist das Ziel, das richtige Gleichgewicht zwischen Batch-Größe, verfügbarem GPU-Speicher und Kosten basierend auf deinem Modell und Datensatz zu finden.

Die Auswirkungen der Trainingskonfiguration auf die GPU-Leistung

Ein weiterer Faktor, der die GPU-Leistung beeinflusst, ist die Trainingskonfiguration. Dazu gehören Parameter wie die Anzahl der Epochen, die Bildgröße und andere Einstellungen, die steuern, wie ein Modell trainiert wird.

Größere Bildgrößen erhöhen beispielsweise die pro Schritt erforderliche Rechenleistung. Dies kann das Training verlangsamen und erfordert möglicherweise mehr Rechenleistung oder Speicher, um eine gute Leistung aufrechtzuerhalten.

Ebenso verlängert die Erhöhung der Anzahl der Epochen die Gesamttrainingszeit, insbesondere auf weniger leistungsstarker Hardware. Eine Epoche bezieht sich auf einen vollständigen Durchlauf durch den gesamten Datensatz während des Trainings.

Techniken wie Datenaugmentation erfordern während des Trainings zusätzliche Verarbeitung. Bei der Datenaugmentation werden Transformationen wie Spiegeln, Rotieren oder Skalieren angewendet, um die Datenvielfalt zu erhöhen und die Modellleistung zu verbessern. Während dies die Robustheit des Modells erhöhen kann, kann es auch die Trainingsgeschwindigkeit verringern.

Im Allgemeinen können leistungsstärkere GPUs diese erhöhten Anforderungen effizienter bewältigen, aber die Auswirkungen hängen von der Gesamtkonfiguration und dem Workload ab.

Abwägung von Kosten und Trainingszeit

Bei der Auswahl einer GPU für dein Projekt gibt es oft einen Kompromiss zwischen Trainingsgeschwindigkeit und GPU-Preis.

Die Ultralytics Platform macht es einfach, diese Kosten vor dem Start eines Trainingsjobs abzuschätzen und zu verstehen. Basierend auf deiner Konfiguration, einschließlich Datensatzgröße, Modell und GPU, kannst du vorab die geschätzten Kosten und die Trainingsdauer einsehen.

Abb. 3: Die Ultralytics Platform macht Cloud-Kosten leicht abschätzbar und verständlich (Quelle)

Schnellere GPUs haben normalerweise höhere Kosten pro Stunde, können aber die Gesamttrainingszeit verkürzen. GPUs wie die RTX 4090, RTX PRO 6000 und H100 können das Training aufgrund ihrer höheren Leistung in der Regel schneller abschließen.

Langsamere GPUs haben meist niedrigere Stundensätze, benötigen aber länger für das Training. GPUs wie die RTX 2000 Ada und RTX A4500 werden beispielsweise oft für kleinere Workloads oder länger laufende Jobs verwendet, bei denen niedrigere Kosten priorisiert werden.

Darüber hinaus sind einige der leistungsstärksten GPUs wie die H200 und B200 nur in Pro- oder Enterprise-Plänen verfügbar, während die meisten anderen Optionen auch im Free-Tarif zugänglich sind.

Ein Blick auf Strategien zur Kostenoptimierung

Über die Auswahl der richtigen GPU hinaus gibt es einige praktische Möglichkeiten, die Trainingskosten im Griff zu behalten. Einer der effektivsten Ansätze besteht darin, mit kleinen Testläufen zu beginnen, bevor man hochskaliert.

Anstatt direkt in das vollständige Training einzusteigen, beginne mit weniger Epochen, um sicherzustellen, dass dein Setup wie erwartet funktioniert. Dies hilft dir, deine Daten, Annotationen und Modellkonfiguration schnell zu validieren und vermeidet es, Zeit und Rechenressourcen für Läufe zu verschwenden, die möglicherweise keine nützlichen Ergebnisse liefern.

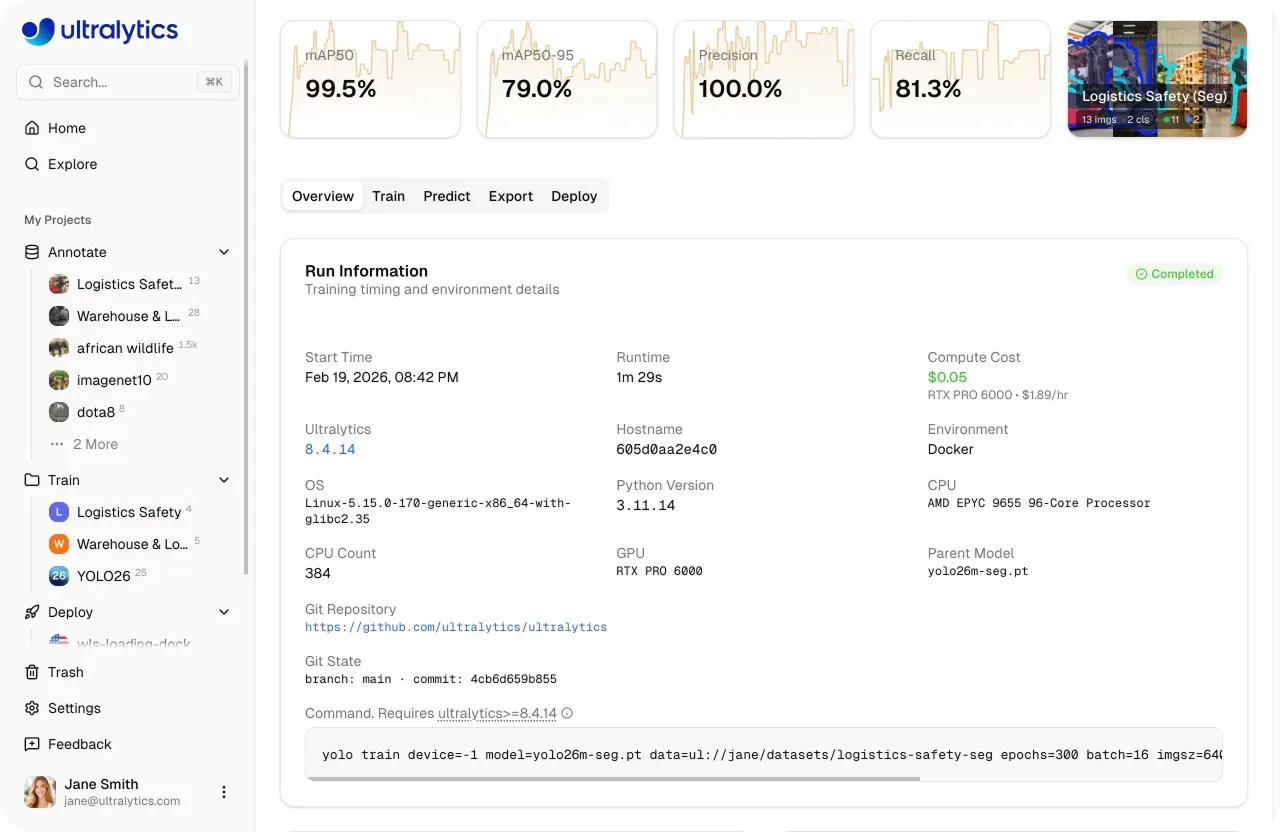

Behalte während des Trainings deine Metriken im Auge und stoppe Läufe frühzeitig, wenn die Leistung stagniert oder sich nicht mehr verbessert. Die Überwachung von Trainingskurven kann dir bei der Entscheidung helfen, ob du weitermachen oder dein Setup anpassen solltest.

Du kannst auch Parameter wie Batch-Größe und Bildgröße anpassen. Kleinere Werte reduzieren den Speicher- und Rechenaufwand, was es praktikabler macht, zu experimentieren, verschiedene Konfigurationen zu testen oder klein angelegte Simulationen auszuführen, bevor du skalierst.

Abb. 4: Visualisierung der Trainingsmetriken auf der Ultralytics Platform (Quelle)

Darüber hinaus hilft die Ultralytics Platform dabei, das Kostenmanagement zu vereinfachen. Sie bietet eine integrierte Kostenschätzung, damit du die erwarteten Ausgaben vor Beginn eines Jobs nachvollziehen kannst.

Mit einem Pay-per-Use-System auf Kreditbasis zahlst du nur für die Rechenzeit, die du tatsächlich nutzt. Dies macht es einfacher, innerhalb des Budgets zu bleiben und hochzuskalieren, sobald du dir bei deinem Trainings-Setup sicher bist.

Best Practices für das Cloud-GPU-Training für Computer Vision

Hier sind einige Best Practices für das Cloud-GPU-Training auf der Ultralytics Platform, die du im Hinterkopf behalten solltest:

- Validierung der Datensätze vor dem Training: Stelle sicher, dass dein Datensatz sauber, gut annotiert und konsistent ist, bevor du beginnst. Das frühzeitige Erkennen von Problemen hilft, verschwendete Rechenressourcen zu vermeiden und die Modellleistung zu verbessern.

- Führe zuerst schnelle Experimente durch: Starte mit kleinen Testläufen und weniger Epochen, um dein Setup zu verifizieren. Dies hilft, Probleme frühzeitig zu identifizieren, ohne sich auf lange, kostspielige Trainingsjobs festzulegen. In gewisser Weise erstellst du so eine Vorlage, die du wiederverwenden und skalieren kannst, sobald alles wie erwartet funktioniert.

- Überwache wichtige Metriken: Verfolge Metriken wie Loss, mAP, Precision und Recall während des gesamten Trainings. Diese Metriken dienen als Benchmarks zur Bewertung der Modellleistung und helfen dir zu entscheiden, wann Anpassungen erforderlich sind oder das Training gestoppt werden sollte.

- Halte Datenverarbeitungspipelines effizient: Stelle sicher, dass das Laden und die Vorverarbeitung von Daten effizient sind, da diese Funktionen auf CPU-Ressourcen basieren und zu Engpässen werden können, die die gesamte Trainingsleistung beeinträchtigen.

- Nutze integrierte Tools: Verwende Diagramme, Konsolen-Logs und Systemmetriken, um das Training in Echtzeit zu überwachen und schnell fundierte Entscheidungen zu treffen.

Wichtige Erkenntnisse

Die Wahl der richtigen Cloud-GPU für Computer Vision auf der Ultralytics Platform hängt davon ab, deinen Workload zu verstehen, einschließlich Datensatzgröße, Modellkomplexität und Trainingskonfiguration. Mit einer Reihe von verfügbaren GPU-Optionen, die durch Cloud-Infrastruktur und virtuelle Maschinen unterstützt werden, kannst du mit einer ausgewogenen Wahl beginnen und skalieren, wenn deine Anforderungen an das Modelltraining oder Fine-Tuning wachsen. Durch die Kombination der richtigen Hardware mit bewährten Methoden wie Überwachung und Kostenkontrolle kannst du modernste KI-Modelle effizient trainieren und gleichzeitig die Flexibilität von Hochleistungsrechnen optimal nutzen.

Sieh dir unsere wachsende Community und unser GitHub-Repository an, um mehr über Computer Vision zu erfahren. Wenn du Vision-Lösungen entwickeln möchtest, wirf einen Blick auf unsere Lizenzoptionen. Erkunde unsere Lösungsseiten, um mehr über die Vorteile von Computer Vision in der Fertigung und KI in der Landwirtschaft zu erfahren.