Erfahren Sie, wie Ultralytics mithilfe von KI die Annotation automatisiert, große Datensätze verwaltet, die Konsistenz verbessert und die Entwicklung im Bereich Computer Vision beschleunigt.

Erfahren Sie, wie Ultralytics mithilfe von KI die Annotation automatisiert, große Datensätze verwaltet, die Konsistenz verbessert und die Entwicklung im Bereich Computer Vision beschleunigt.

Computer-Vision-Lösungen, die Bilder und Videos analysieren, werden in vielen Branchen – von der Fertigung bis zur medizinischen Bildgebung – zunehmend zum festen Bestandteil von Arbeitsabläufen. In der Fertigung beispielsweise hängt die Erkennung von Oberflächenfehlern an Produkten, die auf einem Förderband transportiert werden, von Computer-Vision-Modellen ab, die selbst feinste Muster erkennen können.

Damit solche Modelle gut funktionieren, müssen sie anhand von beschrifteten Daten trainiert werden, bei denen jeder Fehler eindeutig gekennzeichnet ist. Dadurch können diese Modelle lernen, worauf sie achten müssen, und ähnliche Muster erkennen.

Der Prozess der Erstellung dieser Beschriftungen wird als Datenannotation bezeichnet. Insbesondere bei der Bild- und Videoannotation werden Begrenzungsrahmen eingezeichnet, Formen umrandet oder bestimmte Bereiche innerhalb von Bildern und Videobildern beschriftet.

Während dies bei kleinen Datensätzen noch überschaubar ist, wird es mit zunehmendem Datenvolumen schnell schwieriger zu bewältigen. Die Beschriftung von Tausenden von Bildern erfordert einen ständigen manuellen Aufwand, wodurch die Annotation zu einem erheblichen Engpass wird. Herkömmliche Tools sind oft langsam, fragmentiert und schwer zu skalieren.

Ultralytics , eine All-in-One-Plattform für visuelle KI, hilft bei der Bewältigung dieser Herausforderungen durch KI-gestützte Annotation. Durch den Einsatz von KI zur automatischen Generierung erster Beschriftungen, die schnell überprüft und verfeinert werden können, reduziert sie den manuellen Aufwand und steigert die Effizienz.

In diesem Artikel werden wir uns damit befassen, wie die KI-gestützte Annotation innerhalb Ultralytics funktioniert und wie sie den Annotationsprozess verbessert. Los geht’s!

Bevor wir uns damit befassen, wie die KI-gestützte Annotation auf Ultralytics funktioniert, wollen wir uns zunächst einmal genauer mit der Datenannotation beschäftigen.

Die Datenannotation, auch als Datenkennzeichnung bekannt, ist der Prozess, bei dem Rohdaten strukturierte Kennzeichnungen zugewiesen werden, damit sie zum Trainieren von Modellen des maschinellen Lernens verwendet werden können. In der Bildverarbeitung definieren diese Kennzeichnungen die Objekte, Bereiche oder Merkmale von Interesse innerhalb von Bildern oder Videos.

Während des Trainings lernen Modelle oder Algorithmen, Eingabedaten diesen Labels zuzuordnen, weshalb die Qualität der Annotation ein entscheidender Faktor für die Modellleistung ist. Genaue und konsistente, mit Labels versehene Datensätze ermöglichen es dem Modell, korrekte Muster zu erlernen, während mangelhafte oder inkonsistente Annotationen zu unzuverlässigen Vorhersagen führen können.

In einem Anwendungsfall zur Fehlererkennung kann beispielsweise ein Bild eines Produkts auf einem Förderband mit Anmerkungen versehen werden, indem die Stellen markiert werden, an denen Fehler auftreten, und angegeben wird, um welche Art von Fehler es sich handelt. So lernt das Modell, wie Fehler aussehen, und kann sie in neuen Bildern erkennen.

Als Nächstes wollen wir uns einige gängige Methoden zur Annotation von Bildern in der Bildverarbeitung ansehen. Diese Methoden werden verwendet, um visuelle Daten für Aufgaben wie Objekterkennung, Instanzsegmentierung und Bildklassifizierung zu kennzeichnen. Jede Annotationsmethode erfüllt eine andere Funktion, beispielsweise das Lokalisieren von Objekten, das Erfassen von Formen oder das Identifizieren wichtiger Strukturen.

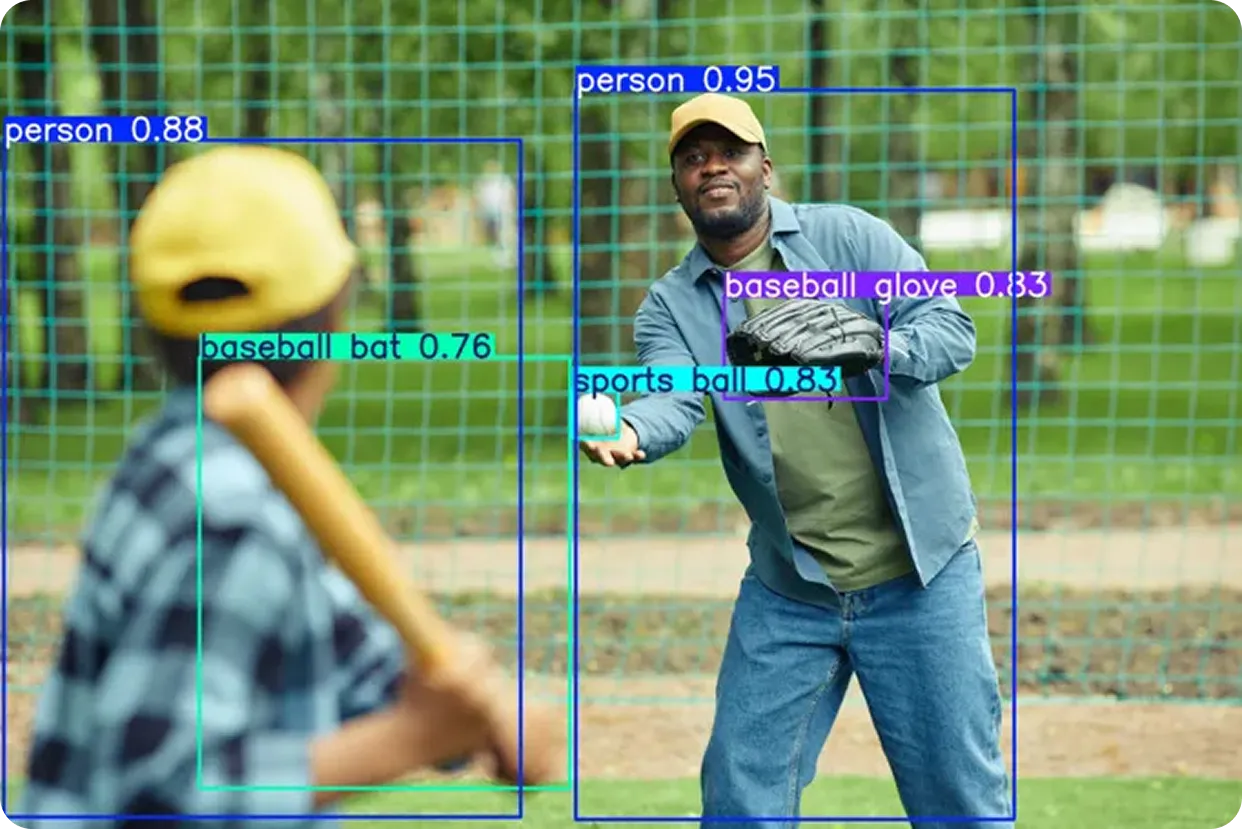

Begrenzungsrahmen sind einfache Rechtecke, die um Objekte in einem Bild gezeichnet werden, um deren Position anzuzeigen. Sie gehören zu den gängigsten Methoden zur Kennzeichnung von Daten in der Bildverarbeitung.

Durch das Training anhand von Bildern mit diesen Markierungen lernen Objekterkennungsmodelle, verschiedene Objekte zu erkennen und deren Position innerhalb eines Bildes zu bestimmen. So können sie detect Objekte gleichzeitig detect und feststellen, wo sich jedes einzelne befindet.

Nehmen wir zum Beispiel ein Baseballspiel, das mithilfe von Computer Vision analysiert wird. In jedem Einzelbild können Rahmen um die Spieler, den Schläger und den Ball gezogen werden, sodass das Modell diese Objekte während des gesamten Spiels detect identifizieren detect .

Polygone, auch als Segmentierungsmasken bezeichnet, gehen einen Schritt weiter als Begrenzungsrahmen, da sie Objekte auf Pixelebene kennzeichnen. Anstatt ein grobes Rechteck zu zeichnen, erfassen sie die genaue Form und die Kanten jedes Objekts in einem Bild. Dadurch eignen sie sich besonders für Aufgaben, die ein detaillierteres Verständnis erfordern.

Im Bereich des autonomen Fahrens werden Segmentierungsmasken beispielsweise bei Aufgaben wie der semantischen Segmentierung eingesetzt, bei der jedem Pixel eine Kategorie wie „Straße“ oder „Himmel“ zugewiesen wird, sowie bei der Instanzsegmentierung, bei der einzelne Objekte wie Fahrzeuge oder Fußgänger separat identifiziert werden.

Sie werden auch für Aufgaben wie das Entfernen des Hintergrunds verwendet, bei denen ein Objekt, beispielsweise eine Person, vom Rest des Bildes abgesetzt werden muss.

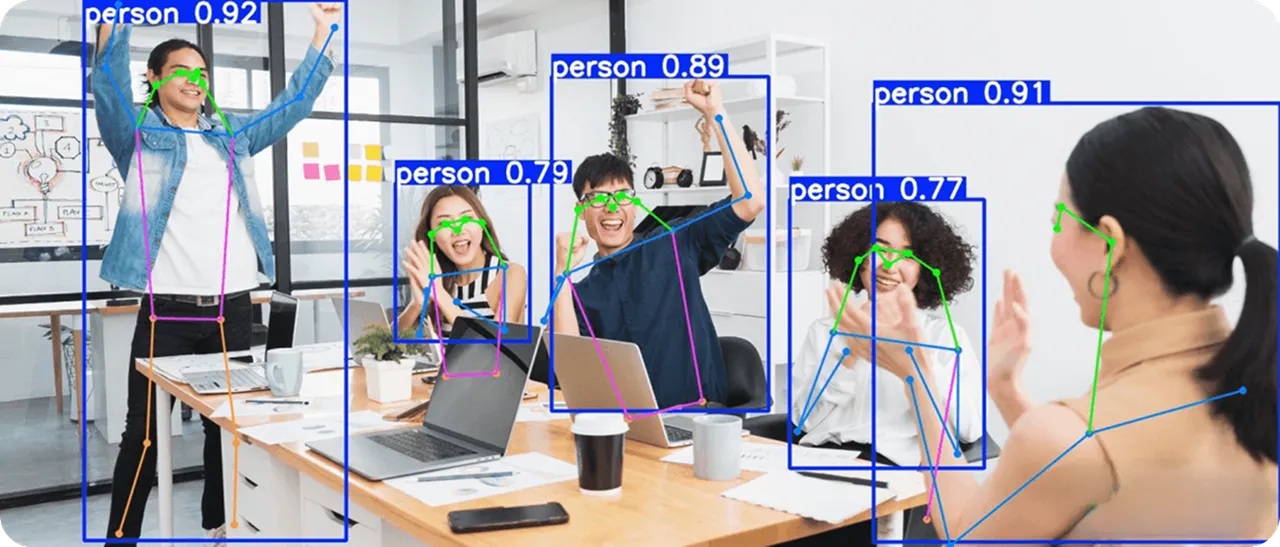

Anhand von Orientierungspunkten werden bestimmte Stellen an einem Objekt markiert, beispielsweise Gelenke am menschlichen Körper oder Körperteile eines Tieres. Durch die Identifizierung dieser Punkte können Modelle die Struktur eines Objekts erfassen und nachvollziehen, wie dessen Teile zueinander positioniert sind.

In der Bildverarbeitung wird dies als Posenschätzung bezeichnet, wobei das Ziel darin besteht, die Position dieser Schlüsselpunkte zu ermitteln und zu verstehen, in welcher Beziehung sie zueinander stehen. Durch die Verfolgung dieser Punkte über einen bestimmten Zeitraum hinweg lassen sich Bewegungen und Veränderungen der Körperhaltung analysieren.

Ein gängiges Beispiel ist die Markierung von Körpergelenken in einem Video, um menschliche Bewegungen zu analysieren. Indem sie sich auf diese Schlüsselpunkte konzentrieren, können Modelle erfassen, wie eine Person positioniert ist und wie sich ihre Körperhaltung im Laufe der Zeit verändert.

Nicht alle Objekte in einem Bild sind perfekt ausgerichtet. In vielen realen Situationen erscheinen Objekte geneigt, gedreht oder werden aus unterschiedlichen Blickwinkeln betrachtet.

Herkömmliche Begrenzungsrahmen haben in solchen Fällen oft Schwierigkeiten, da sie unnötigen Hintergrund mit einbeziehen oder nicht genau an das Objekt angepasst sind. Orientierte Begrenzungsrahmen lösen dieses Problem durch die Verwendung gedrehter Rechtecke, die sich an der Ausrichtung des Objekts orientieren. Dies führt zu präziseren und genaueren Anmerkungen.

Dieser Ansatz wird bei der Erkennung orientierter Begrenzungsrahmen (OBB) verwendet, bei der Modelle sowohl die Position eines Objekts als auch dessen Ausrichtung ermitteln. Ein Beispiel hierfür sind Luftbilder, auf denen Objekte wie Gebäude, Schiffe oder Fahrzeuge oft aus unterschiedlichen Blickwinkeln zu sehen sind. Durch gedrehte Rahmen lässt sich ihre tatsächliche Form und Ausrichtung innerhalb der Szene leichter erfassen.

Klassifizierungsbezeichnungen unterscheiden sich von anderen Annotationsmethoden dadurch, dass sie einem gesamten Bild eine einzige Bezeichnung zuweisen, anstatt bestimmte Objekte oder Bereiche zu markieren. Sie kommen zum Einsatz, wenn das Ziel darin besteht, zu ermitteln, was in einem Bild zu sehen ist, ohne dabei den Fokus darauf zu legen, wo es sich befindet.

Beispielsweise kann ein Bild anhand seines Gesamtinhalts als „Katze“ oder „Hund“ gekennzeichnet werden. Dadurch eignet sich die Bildklassifizierung besonders für Aufgaben, bei denen ein allgemeines Verständnis des Bildes ausreicht.

Viele herkömmliche Tools zur Datenannotation basieren auf mehrstufigen Prozessen und unzusammenhängenden Arbeitsabläufen. KI-Entwicklungsteams müssen häufig zwischen verschiedenen Plattformen für die Annotation, Speicherung und Validierung wechseln, was KI-Projekte verlangsamt.

Die meisten Tools unterstützen nur eine begrenzte Auswahl an Annotationstypen und Datentypen, sodass Teams letztendlich verschiedene Tools für Begrenzungsrahmen, Segmentierung und Schlüsselpunkte verwenden müssen. Diese fragmentierte Konfiguration kann schwierig zu verwalten sein, insbesondere für Teams, die noch keine Erfahrung mit Computer Vision haben.

Eine weitere große Herausforderung ist der manuelle Aufwand. Während die Annotation eines einzelnen Bildes vielleicht nur wenige Minuten dauert, wird die Arbeit mit großen Datensätzen schnell sehr zeitaufwendig, insbesondere wenn ähnliche Bilder repetitive Aufgaben erfordern.

Mit zunehmender Größe der Datensätze müssen Teams zudem Dateien verwalten, track und die Konsistenz der Annotationen sicherstellen. Dies erhöht den Arbeitsaufwand, sodass mehr Zeit für die Datenverwaltung aufgewendet wird und weniger Zeit für die Verbesserung der Modellleistung bleibt.

Ein effizienterer Ansatz ist die Nutzung der KI-gestützten Annotation innerhalb der Ultralytics , die mithilfe von KI Labels generiert und verfeinert. Dadurch wird der manuelle Aufwand reduziert und gleichzeitig die Geschwindigkeit und Konsistenz verbessert – und das alles in einer einzigen Umgebung, die Datenmanagement, Annotation, Modelltraining, Bereitstellung und Überwachung vereint.

Ultralytics vereinfacht die Annotation, indem sie diese direkt in den übrigen Workflow der Computer Vision einbindet. Anstatt auf separate Tools zurückgreifen zu müssen, können Teams Daten, Annotationen und Modelle in einer einzigen Umgebung bearbeiten.

Es unterstützt eine Reihe von Aufgaben im Bereich der Bildverarbeitung, darunter Objekterkennung, Bildklassifizierung, Instanzsegmentierung, Posenabschätzung und die Erkennung orientierter Begrenzungsrahmen.

In diesem Umfeld stehen verschiedene Möglichkeiten zur Annotation zur Verfügung. Teams können Daten manuell kennzeichnen, um die volle Kontrolle zu behalten, die SAM intelligente Annotation für eine interaktive, punktbasierte Kennzeichnung nutzen oder die YOLO intelligente Annotation anwenden, um automatisch Annotationen zu generieren, die anschließend überprüft und verfeinert werden können. Diese Flexibilität erleichtert die Arbeit mit unterschiedlichen Datensätzen und Annotationsanforderungen.

Da KI-gestützte und manuelle Annotationen in die Verwaltung von Datensätzen und das Modelltraining integriert sind, können Teams nahtlos von der Datenkennzeichnung zur Organisation von Datensätzen und zum Training von Modellen übergehen. Dadurch bleiben die Arbeitsabläufe strukturiert, und es entfällt die Notwendigkeit, zwischen verschiedenen Tools zu wechseln oder Annotationen neu zu formatieren.

Die Plattform unterstützt außerdem Ultralytics YOLO wie Ultralytics YOLO11 und Ultralytics , wodurch annotierte Daten direkt für das Training und Testen verwendet werden können. Dies erleichtert es, Lücken in Datensätzen zu identifizieren, Annotationen zu verfeinern und Modelle durch kontinuierliche Iteration neu zu trainieren.

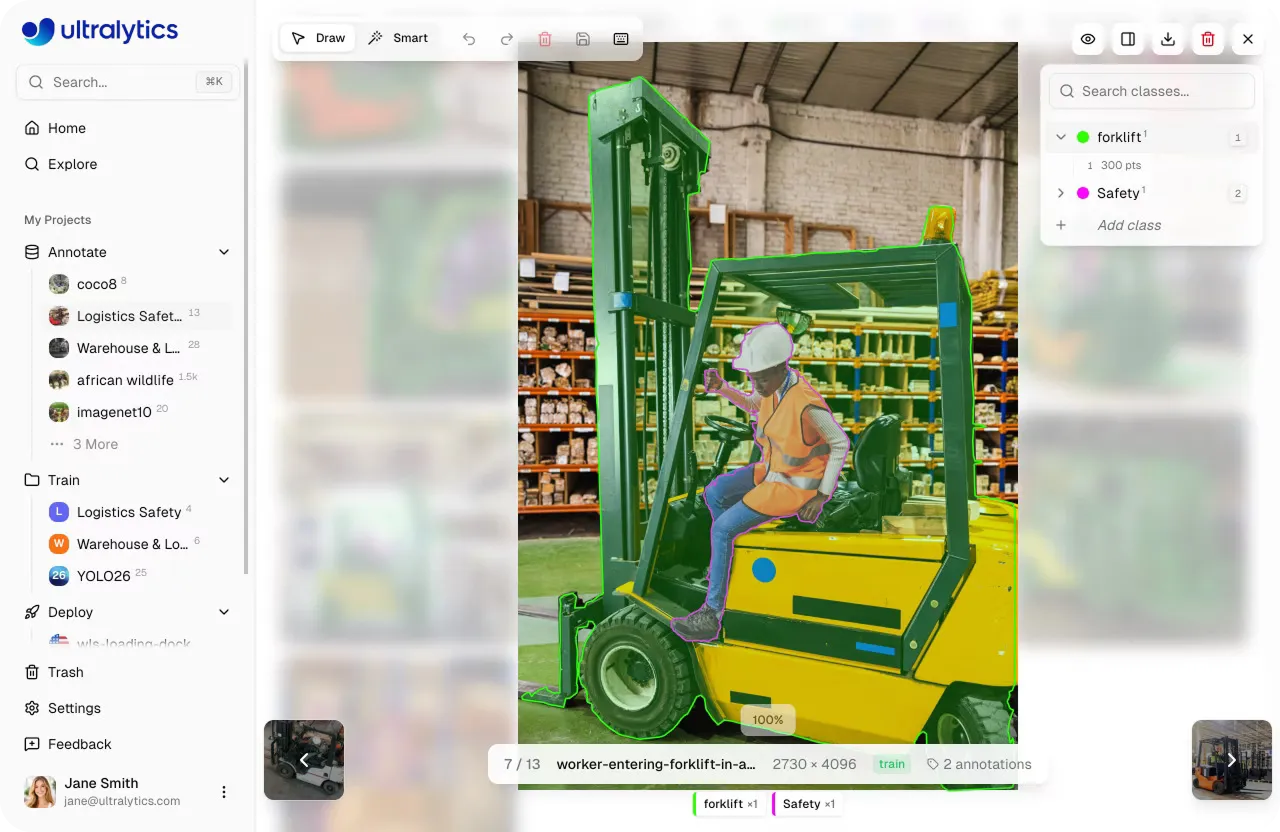

Die SAM intelligente Annotation auf Ultralytics wurde entwickelt, um die Annotation für Aufgaben wie Objekterkennung, Instanzsegmentierung und Oriented Bounding Box (OBB) zu beschleunigen.

Die Plattform bietet mehrere SAM , darunter SAM .1 Tiny, SAM .1 Small, SAM .1 Base, SAM .1 Large und SAM , sodass Nutzer zwischen Geschwindigkeit und Genauigkeit wählen können.

Kleinere Modelle wie „Tiny“ und „Small“ sind schneller und eignen sich gut für schnelle Annotationsabläufe, während größere Modelle wie „Large“ und SAM bei komplexeren Szenen eine höhere Genauigkeit bieten. Beim Wechsel zwischen den Modellen wird das Annotationsverhalten sofort aktualisiert.

Sobald im Annotationseditor ein SAM ausgewählt wurde, können menschliche Annotatoren in den Smart-Modus wechseln, um mit der Kennzeichnung zu beginnen. Anstatt Formen manuell zu zeichnen, wird das Modell anhand einfacher punktbasierter Eingaben gesteuert.

Ein Klick mit der linken Maustaste fügt einen positiven Punkt hinzu, um einen Bereich einzuschließen, während ein Klick mit der rechten Maustaste einen negativen Punkt hinzufügt, um unerwünschte Bereiche auszuschließen. Auf Grundlage dieser Eingaben erstellt das Modell in Echtzeit eine präzise Maske.

Um den Arbeitsablauf zu beschleunigen, kann der Modus „Automatisch anwenden“ aktiviert werden. Ist dieser Modus aktiv, wird bei jedem Klick automatisch eine Anmerkung erstellt und gespeichert, ohne dass eine manuelle Bestätigung erforderlich ist. Bei komplexeren Objekten können Anmerker entweder die Umschalttaste gedrückt halten, um mehrere Punkte zu setzen, bevor die Maske angewendet wird, oder den Modus „Automatisch anwenden“ deaktivieren, um Punkte frei hinzuzufügen und anschließend die Eingabetaste zu drücken, um die Maske anzuwenden.

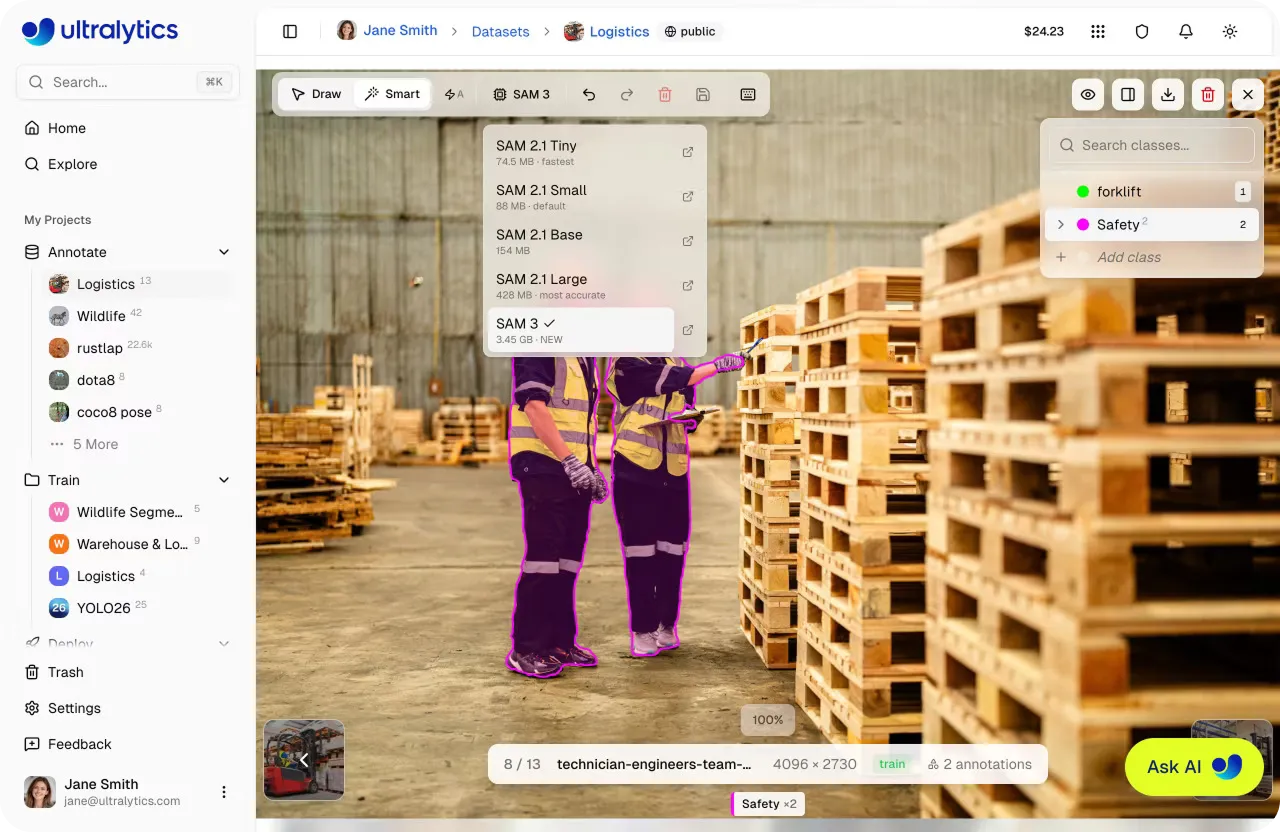

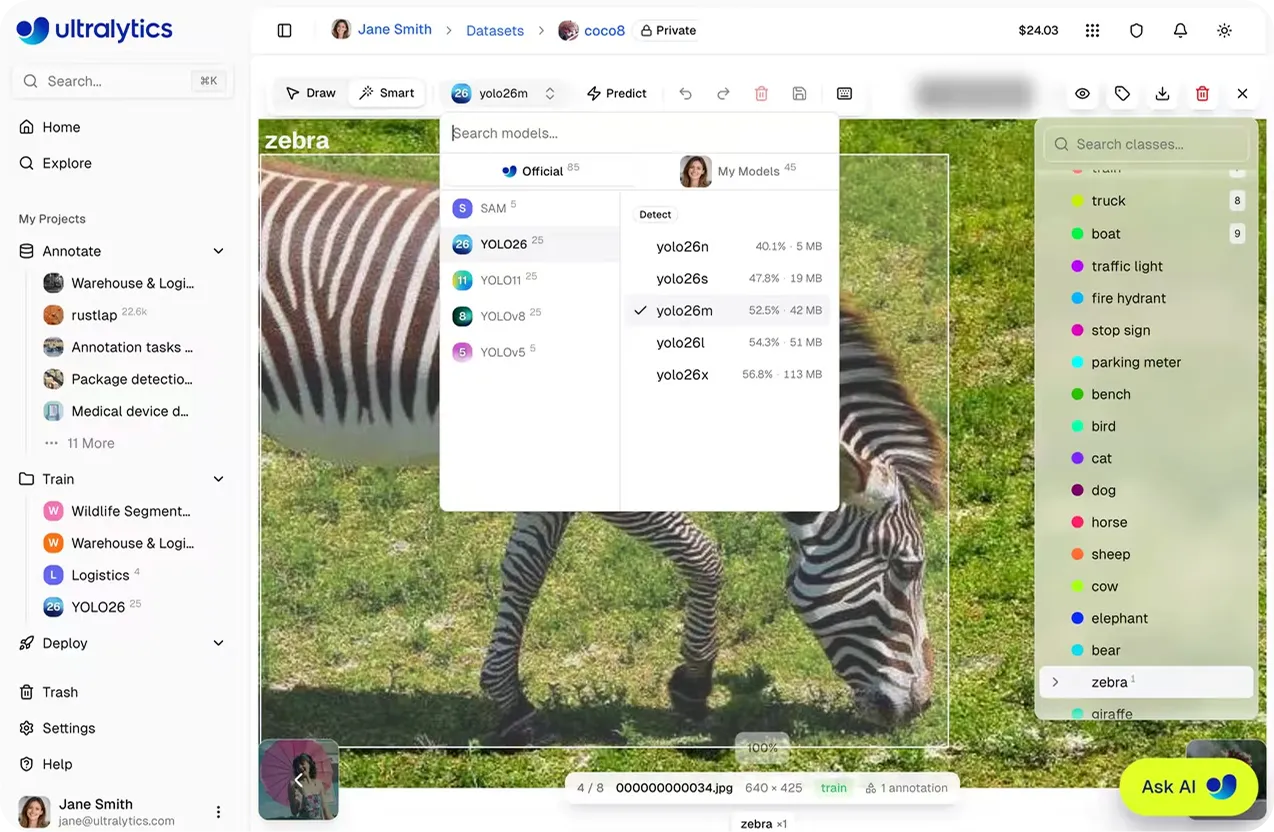

Ähnlich wie die SAM intelligente Annotation nutzt auch die YOLO Annotation auf der Ultralytics KI, um den Annotationsprozess zu beschleunigen. Anstatt das Modell durch Klicks zu steuern, werden anhand der Modellvorhersagen automatisch Annotationen generiert.

Dieser Ansatz unterstützt Aufgaben wie Objekterkennung, Instanzsegmentierung und die Annotation mit orientierten Begrenzungsrahmen (OBB). Er funktioniert speziell mitYOLO Ultralytics , einschließlich der von Ultralytics bereitgestellten vortrainierten Modelle Ultralytics benutzerdefiniert trainierten YOLO .

Im Annotationseditor können Annotatoren den Smart-Modus aufrufen, im Modellauswahlfenster ein YOLO auswählen und auf „Vorhersagen“ klicken. Das Modellauswahlfenster zeigt nur YOLO an, die zur aktuellen Datensatzaufgabe passen, wodurch sichergestellt wird, dass die generierten Annotationen kompatibel sind.

Das Modell analysiert das Bild und generiert auf der Grundlage seiner Vorhersagen Annotationen, die dann direkt in das Bild eingefügt werden. Wenn sich Vorhersagen mit bestehenden Annotationen derselben Klasse überschneiden, werden Duplikate automatisch übersprungen, sobald die Überschneidung einen festgelegten Schwellenwert überschreitet. Dies trägt dazu bei, saubere und konsistente Beschriftungen zu gewährleisten.

Sobald die Vorhersagen erstellt wurden, können Annotatoren im „Human-in-the-Loop“-Verfahren diese nach Bedarf überprüfen, anpassen oder entfernen. Dies erleichtert die schnelle Annotation großer Datensätze, da man mit den vom Modell generierten Annotationen beginnt und diese verfeinert, anstatt alles manuell zu annotieren.

Im Laufe der Zeit können verbesserte YOLO wiederverwendet werden, um genauere Vorhersagen zu generieren, was einen iterativen Workflow zur automatischen Klassifizierung unterstützt.

Sehen wir uns nun anhand einiger Beispiele an, wie die Ultralytics die Datenannotation in realen Anwendungsfällen ermöglicht.

Autonome Fahrzeuge, die mit Computer-Vision-Modellen ausgestattet sind, benötigen gut annotierte Bilddaten, um ihre Umgebung in Echtzeit zu erfassen. Mit diesen Daten trainierte Modelle können segment , Fußgänger, Verkehrszeichen und Straßenbegrenzungen detect segment .

Segmentierungsaufgaben erfordern präzise, pixelgenaue Begrenzungen, was die Annotation sowohl entscheidend als auch zeitaufwendig macht. Die manuelle Kennzeichnung großer Mengen von Sensordaten kann schnell zu einem Engpass werden, insbesondere in komplexen Fahrsituationen.

Ultralytics optimiert diesen Prozess durch KI-gestützte Annotation unter Verwendung von SAM YOLO . Die SAM intelligente Annotation ermöglicht eine schnelle, per Mausklick durchgeführte Segmentierung mit präzisen Masken, während YOLO zur automatischen Generierung von Annotationen über mehrere Bilder hinweg eingesetzt werden können.

Zusammen erleichtern diese Ansätze die Bearbeitung komplexer Szenen mit sich überlappenden Objekten.

Da die Annotation direkt mit dem Modelltraining verknüpft ist, können aktualisierte, umfangreiche Datensätze sofort zum erneuten Trainieren und Bewerten von Modellen genutzt werden. So können Teams die Leistung kontinuierlich verbessern und sich effizienter an neue Fahrbedingungen anpassen.

In der Fertigung hängt die Aufrechterhaltung einer konsistenten Qualitätskontrolle davon ab, dass Fehler während der Produktion präzise erkannt werden. Oft werden Modelle der Bildverarbeitung eingesetzt, um Probleme in Echtzeit zu identifizieren, doch ihre Leistungsfähigkeit hängt davon ab, wie gut die Trainingsdaten die tatsächlichen Produktionsbedingungen widerspiegeln.

Veränderungen in der Fertigungsumgebung, wie etwa Schwankungen bei den Rohstoffen, den Maschineneinstellungen oder der Beleuchtung, können neue und seltene Fehlerarten hervorrufen, die in den ursprünglichen Trainingsdaten nicht enthalten waren. Dadurch entsteht eine Diskrepanz zwischen dem, was das Modell gelernt hat, und dem, was in der Produktionslinie auftritt.

Um auf dem neuesten Stand zu bleiben, müssen Datensätze regelmäßig mit hochwertigen, intern erstellten Annotationen aktualisiert werden. Ultralytics erleichtert die Aktualisierung von Annotationen und die Erweiterung von Datensätzen, sobald neue Fehlermuster auftreten. Diese aktualisierten Datensätze können dann zum erneuten Trainieren von Modellen verwendet werden, wodurch Teams sich schneller an veränderte Produktionsbedingungen anpassen können.

Baustellen sind dynamische Umgebungen mit zahlreichen Teams, mobilen Maschinen und sich ständig ändernden Grundrissen. Die Gewährleistung der Sicherheit unter diesen Bedingungen hängt von klaren, gut kommentierten visuellen Daten ab.

Genaue Annotationen können die Datenqualität verbessern und KI-Systemen dabei helfen, Mitarbeiter, Ausrüstung, Schutzausrüstung und potenzielle Risiken unter verschiedenen Bedingungen vor Ort zu erkennen, darunter überfüllte Umgebungen, wechselnde Hintergründe und unterschiedliche Lichtverhältnisse.

Ultralytics unterstützt dies, indem sie es ermöglicht, Anmerkungen ganz einfach zu aktualisieren und anzupassen, wenn sich die Bedingungen vor Ort ändern. Neue Bilder können aufgenommen und dem Datensatz hinzugefügt werden, sobald sie verfügbar sind, sodass dieser stets mit den realen Gegebenheiten übereinstimmt.

Eine hochwertige Annotation ist für die Entwicklung zuverlässiger Computer-Vision- und KI-Modelle unerlässlich, doch herkömmliche Arbeitsabläufe bremsen Teams oft aus. Ultralytics optimiert diesen Prozess durch automatisierte Annotationstools und einen skalierbaren Arbeitsablauf. Dadurch können Teams schneller von den Daten zum Modell gelangen und dabei Genauigkeit und Konsistenz gewährleisten.

Schauen Sie sich unsere wachsende Community und unser GitHub-Repository an, um mehr über Computer Vision zu erfahren. Wenn Sie Bildverarbeitungslösungen entwickeln möchten, informieren Sie sich über unsere Lizenzoptionen. Auf unseren Lösungsseiten erfahren Sie mehr über die Vorteile von Computer Vision in der Fertigung und von KI im Gesundheitswesen.

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens