Voici Florence-2, le modèle de langage visuel de Microsoft qui permet d'améliorer la détection d'objets, la segmentation et la prise de vue zéro avec une grande efficacité.

Voici Florence-2, le modèle de langage visuel de Microsoft qui permet d'améliorer la détection d'objets, la segmentation et la prise de vue zéro avec une grande efficacité.

En juin 2024, Microsoft a présenté Florence-2, un modèle de langage visuel multimodal (VLM) conçu pour gérer un large éventail de tâches, notamment la détection d'objets, la segmentation, le sous-titrage d'images et la mise à la terre. Florence-2 établit une nouvelle référence en matière de performances "zero-shot", ce qui signifie qu'il peut exécuter des tâches sans formation spécifique préalable, et qu'il dispose d'un modèle de plus petite taille que les autres modèles de langage visuel de pointe.

Plus qu'un simple modèle, la polyvalence et les performances améliorées de Florence-2 ont le potentiel d'avoir un impact significatif sur diverses industries en améliorant la précision et en réduisant le besoin d'une formation approfondie. Dans cet article, nous explorerons les fonctionnalités innovantes de Florence-2, comparerons ses performances avec d'autres VLM et discuterons de ses applications potentielles.

Florence-2 peut gérer une variété de tâches au sein d'un cadre unifié unique. Les capacités impressionnantes du modèle sont en partie dues à son ensemble de données d'entraînement massif appelé FLD-5B. FLD-5B comprend 5,4 milliards d'annotations sur 126 millions d'images. Cet ensemble de données complet a été créé spécifiquement pour doter Florence-2 des capacités nécessaires pour gérer un large éventail de tâches de vision avec une précision et une efficacité élevées.

Voici un aperçu plus détaillé des tâches prises en charge par Florence-2 :

.png)

Le modèle prend en charge les tâches textuelles et régionales. Des jetons de localisation spéciaux sont ajoutés au vocabulaire du modèle pour les tâches impliquant des régions spécifiques d'une image. Ces jetons aident le modèle à comprendre différentes formes, telles que les rectangles autour des objets (représentation de boîte), les formes à quatre côtés (représentation de boîte quad) et les formes à plusieurs côtés (représentation de polygone). Le modèle est entraîné à l'aide d'une méthode appelée perte d'entropie croisée, qui l'aide à apprendre en comparant ses prédictions aux réponses correctes et en ajustant ses paramètres internes en conséquence.

L'ensemble de données FLD-5B comprend différents types d'annotations : descriptions textuelles, paires de régions et de textes, et combinaisons de textes, de phrases et de régions. Il a été créé grâce à un processus en deux étapes comprenant la collecte de données et l'annotation. Les images proviennent d'ensembles de données populaires tels que ImageNet, Object 365, Open Images, Conceptual Captions et LAION. Les annotations de l'ensemble de données FLD-5B sont pour la plupart synthétiques, c'est-à-dire qu'elles ont été générées automatiquement plutôt qu'étiquetées manuellement.

.png)

Initialement, des modèles spécialisés et compétents dans des tâches spécifiques, telles que la détection d'objets ou la segmentation, ont créé ces annotations. Ensuite, un processus de filtrage et d'amélioration a été utilisé pour s'assurer que les annotations étaient détaillées et précises. Après avoir supprimé tout bruit, l'ensemble de données a subi un affinement itératif, où les sorties de Florence-2 ont été utilisées pour mettre à jour et améliorer continuellement les annotations.

L'architecture du modèle de Florence-2 suit une approche d'apprentissage séquence à séquence. Cela signifie que le modèle traite une séquence d'entrée (comme une image avec une invite textuelle) et génère une séquence de sortie (comme une description ou une étiquette) étape par étape. Dans le cadre séquence à séquence, chaque tâche est traitée comme un problème de traduction : le modèle prend une image d'entrée et une invite spécifique à la tâche et génère la sortie correspondante.

.png)

Au cœur de l'architecture du modèle se trouve un transformateur encodeur-décodeur multi-modalité, qui combine un encodeur d'image et un encodeur-décodeur multi-modalité. L'encodeur d'image, appelé DaViT (Data-efficient Vision Transformer), traite les images d'entrée en les convertissant en embeddings de jetons visuels - des représentations compactes de l'image qui capturent à la fois les informations spatiales (où se trouvent les choses) et sémantiques (ce que sont les choses). Ces jetons visuels sont ensuite combinés avec des embeddings de texte (représentations du texte), ce qui permet au modèle de fusionner de manière transparente les données textuelles et visuelles.

Florence-2 se distingue des autres modèles de langage visuel en raison de ses impressionnantes capacités zéro-shot. Contrairement aux modèles comme PaliGemma, qui s'appuient sur un réglage fin approfondi pour s'adapter à diverses tâches, Florence-2 fonctionne bien dès le départ. De plus, Florence-2 est capable de rivaliser avec des modèles plus grands comme GPT-4V et Flamingo, qui ont souvent beaucoup plus de paramètres mais ne correspondent pas toujours aux performances de Florence-2. Par exemple, Florence-2 obtient de meilleurs résultats zéro-shot que Kosmos-2, bien que Kosmos-2 ait plus de deux fois plus de paramètres.

Dans les tests de référence, Florence-2 a montré des performances remarquables dans des tâches telles que le sous-titrage COCO et la compréhension des expressions de référence. Elle a surpassé des modèles tels que PolyFormer et UNINEXT dans les tâches de détection et de segmentation d'objets sur l'ensemble de donnéesCOCO . Il s'agit d'un choix très compétitif pour les applications réelles où les performances et l'efficacité des ressources sont cruciales.

Florence-2 peut être utilisé dans de nombreux secteurs différents, tels que le divertissement, l'accessibilité, l'éducation, etc. Examinons quelques exemples pour mieux comprendre.

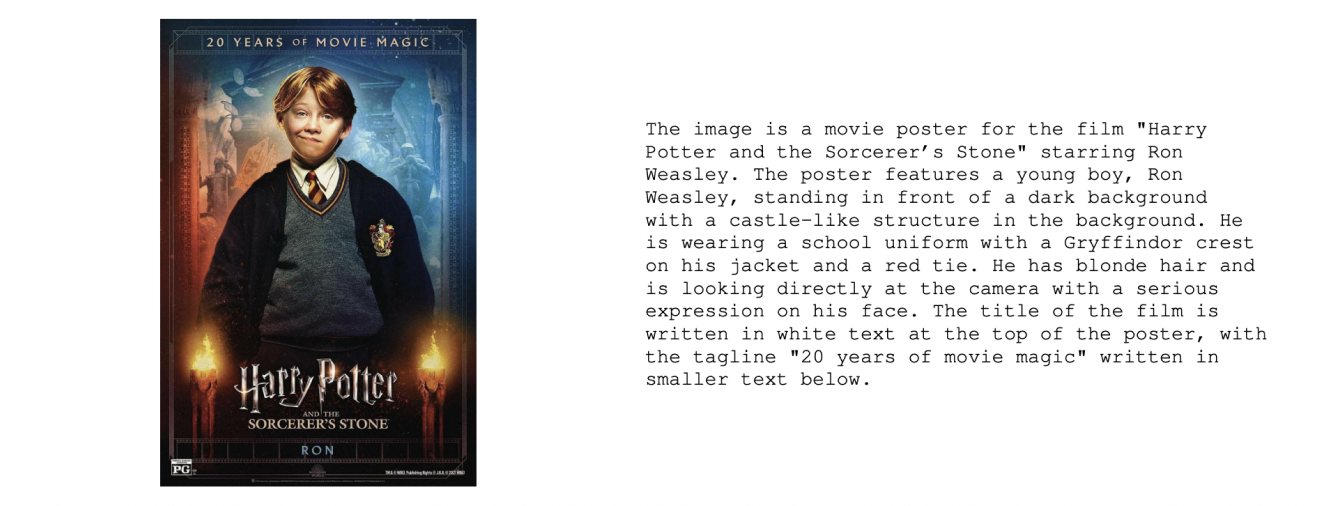

Lorsque vous êtes sur une plateforme de streaming et que vous essayez de décider quoi regarder, vous pouvez lire un résumé d'un film pour vous aider à choisir. Et si la plateforme pouvait également fournir une description détaillée de l'affiche du film ? Florence-2 peut rendre cela possible grâce à la légende d'images, qui génère un texte descriptif pour les images. Florence-2 peut générer des descriptions détaillées des affiches de films, ce qui rend les plateformes de streaming plus inclusives pour les utilisateurs malvoyants. En analysant les éléments visuels d'une affiche, tels que les personnages, les paysages et le texte, Florence-2 peut créer des descriptions détaillées qui transmettent le contenu et l'ambiance de l'affiche. L'image ci-dessous montre le niveau de détail que Florence-2 peut fournir dans sa description.

Voici d'autres exemples de situations où la légende d'image peut être utile :

Florence-2 peut également être utilisé pour enrichir les expériences culinaires. Par exemple, un livre de cuisine en ligne pourrait utiliser Florence-2 pour ancrer visuellement et étiqueter les parties d'une image de recette complexe. L'ancrage visuel est utile ici en reliant des parties spécifiques de l'image au texte descriptif correspondant. Chaque ingrédient et chaque étape peuvent être étiquetés et expliqués avec précision, ce qui permet aux cuisiniers amateurs de suivre plus facilement la recette et de comprendre le rôle de chaque composant dans le plat.

.png)

La reconnaissance optique de caractères (OCR) avec traitement basé sur les régions, qui se concentre sur l'extraction de texte à partir de zones spécifiques d'un document, peut être très utile dans des domaines tels que la comptabilité. Des zones désignées des documents financiers peuvent être analysées pour extraire automatiquement des informations importantes telles que les détails des transactions, les numéros de compte et les dates d'échéance. En réduisant le besoin de saisie manuelle des données, elle minimise les erreurs et accélère les délais de traitement. Les institutions financières peuvent l'utiliser pour rationaliser des tâches telles que le traitement des factures, le rapprochement des reçus et la compensation des chèques, ce qui permet d'accélérer les transactions et d'améliorer le service à la clientèle.

.png)

La segmentation basée sur les régions, qui consiste à diviser une image en parties significatives pour une analyse ciblée et une inspection détaillée, peut alimenter des applications industrielles qui améliorent la précision et l'efficacité de divers processus. En se concentrant sur des zones spécifiques d'une image, cette technologie permet une inspection et une analyse détaillées des composants et des produits. En ce qui concerne le contrôle de la qualité, elle peut identifier les défauts ou les incohérences dans les matériaux, tels que les fissures ou les désalignements, garantissant ainsi que seuls les produits de qualité supérieure atteignent le marché.

.png)

Il améliore également les chaînes d'assemblage automatisées en guidant les bras robotisés vers des pièces spécifiques et en optimisant le placement et l'assemblage des composants. De même, dans la gestion des stocks, elle permet de track et de contrôler l'état et l'emplacement des marchandises, ce qui rend la logistique plus efficace et réduit les temps d'arrêt. Dans l'ensemble, la segmentation par région améliore la précision et la productivité, ce qui permet de réduire les coûts et d'améliorer la qualité des produits dans les environnements industriels.

Nous commençons à observer une tendance où les modèles d'IA deviennent plus légers tout en conservant des performances élevées. Florence-2 marque une avancée majeure en termes de modèles de langage visuel. Il peut gérer diverses tâches telles que la détection d'objets, la segmentation, la légende d'images et l'ancrage avec des performances impressionnantes en zero-shot. Malgré sa taille réduite, Florence-2 est efficace et multifonctionnel, ce qui le rend extrêmement utile en termes d'applications dans différents secteurs. Les modèles comme Florence-2 apportent davantage de possibilités, élargissant ainsi le potentiel des innovations en matière d'IA.

Explorez davantage l'IA en visitant notre dépôt GitHub et en rejoignant notre communauté. Consultez nos pages de solutions pour en savoir plus sur les applications de l'IA dans la fabrication et l'agriculture. 🚀

Commencez votre parcours avec l'avenir de l'apprentissage automatique