Ultralytics YOLO26 vs YOLO11 vs YOLOv8: quale dovresti usare?

Esplora Ultralytics YOLO26 vs Ultralytics YOLO11 vs Ultralytics YOLOv8 e scopri quale modello di computer vision dovresti scegliere per i tuoi progetti.

I sistemi di computer vision all'avanguardia, spesso basati su reti neurali convoluzionali (CNN), consentono alle macchine di analizzare e interpretare dati visivi da immagini e video, e vengono ora distribuiti in una vasta gamma di ambienti.

Dall'agricoltura alla produzione e alla vendita al dettaglio, questi sistemi operano in diversi ambienti di distribuzione, inclusi dispositivi edge, hardware embedded, dispositivi Internet of Things (IoT), elaborazione on-device e pipeline cloud su larga scala che supportano applicazioni in tempo reale.

Nell'uso reale, distribuire questi modelli non è sempre semplice. Spesso devono essere eseguiti con risorse di calcolo limitate, soddisfare requisiti di latenza rigorosi ed essere scalabili senza aumentare significativamente i costi. Questi vincoli rendono le prestazioni un problema multidimensionale piuttosto che una questione di sola precisione.

Sebbene la precisione rimanga importante, è altrettanto fondamentale che un modello funzioni in modo efficiente in produzione. Fattori come velocità, utilizzo delle risorse e scalabilità giocano un ruolo importante nel modo in cui un sistema si comporta nel tempo.

I modelli di computer vision come i modelli Ultralytics YOLO si sono evoluti tenendo a mente questo equilibrio. Ad esempio, Ultralytics YOLOv8 ha stabilito una base solida e versatile, Ultralytics YOLO11 ha fatto un ulteriore passo avanti con maggiore velocità e precisione, e Ultralytics YOLO26 costruisce su questo essendo più leggero, veloce ed efficiente che mai.

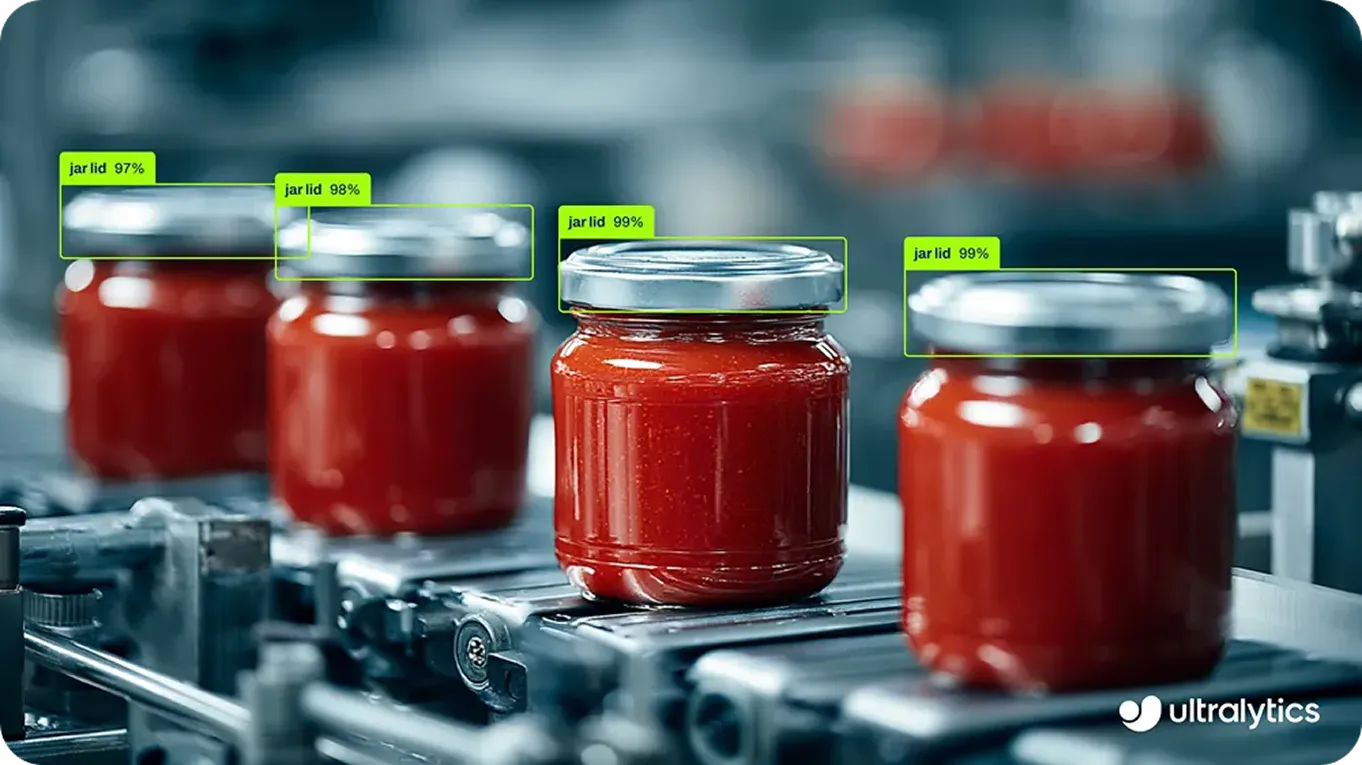

Fig 1. Utilizzo di Ultralytics YOLO26 per rilevare oggetti in un'immagine (Fonte)

In questo articolo, confronteremo Ultralytics YOLO26, YOLO11 e YOLOv8 per aiutarti a scegliere il modello giusto per il tuo progetto di computer vision. Cominciamo!

Link to this sectionComprendere come si sono evoluti i modelli Ultralytics YOLO#

Ogni iterazione dei modelli Ultralytics YOLO ha introdotto miglioramenti per soddisfare meglio i requisiti del mondo reale e rendere la computer vision più accessibile. Questi aggiornamenti hanno reso i modelli più veloci, più efficienti e più facili da distribuire, supportando la crescita dell'ecosistema della vision AI.

Sono inoltre basati su PyTorch, il che li rende facili da addestrare, personalizzare e integrare in flussi di lavoro di machine learning intelligenti. Pronti all'uso, i modelli Ultralytics YOLO sono disponibili come modelli pre-addestrati, spesso addestrati su dataset come il dataset COCO, consentendo ai team di iniziare rapidamente e perfezionarli per casi d'uso specifici.

Oltre a questo, il pacchetto Python di Ultralytics semplifica la distribuzione fornendo supporto integrato per l'esportazione di modelli in formati come ONNX e TensorRT. Questo rende più semplice integrare i modelli su diverse piattaforme hardware, dai dispositivi edge ai sistemi accelerati da GPU.

Link to this sectionPassando da Ultralytics YOLOv5 a Ultralytics YOLO26#

Il primo modello Ultralytics YOLO, Ultralytics YOLOv5, è diventato molto popolare per le sue affidabili capacità di rilevamento oggetti. Basato su un approccio di rilevamento a uno stadio, ha consentito previsioni rapide in tempo reale in un unico passaggio, rendendolo ben adatto ai flussi di lavoro di produzione.

Aggiornamenti successivi hanno introdotto varianti anchor-free, dove il modello prevede le posizioni degli oggetti direttamente invece di utilizzare anchor box predefinite, rendendo il rilevamento più flessibile. Tuttavia, il modello originale è rimasto focalizzato principalmente sui compiti di rilevamento oggetti.

Costruendo su questa base, YOLOv8 ha ampliato l'ambito della famiglia di modelli. Invece di concentrarsi solo sul rilevamento oggetti, ha aggiunto il supporto per molteplici attività di computer vision come la segmentazione di istanze, la classificazione delle immagini, la stima della posa e il rilevamento con box di delimitazione orientati (OBB). Ha anche apportato miglioramenti architettonici, inclusi design avanzati di backbone e neck, che hanno migliorato l'estrazione delle caratteristiche e le prestazioni complessive di rilevamento.

Oltre a questo, varianti come YOLOv8n (Nano), YOLOv8s (Small), YOLOv8m (Medium), YOLOv8l (Large) e YOLOv8x (Extra Large) hanno dato agli sviluppatori la flessibilità di bilanciare velocità, precisione e utilizzo delle risorse in base alle proprie esigenze. Questa capacità più ampia, combinata con la sua facilità d'uso, lo ha reso una scelta ideale per un'ampia gamma di applicazioni di visione.

Fig 2. I modelli YOLO come YOLOv8, YOLO11 e YOLO26 supportano una serie di attività di visione.

In seguito, YOLO11 si è concentrato sul miglioramento delle prestazioni nei flussi di lavoro reali, offrendo una maggiore precisione insieme a velocità di inferenza più elevate. Con un'architettura più leggera, funziona bene sia in ambienti edge che cloud, pur essendo compatibile con le pipeline YOLOv8 esistenti.

L'ultima aggiunta alla famiglia di modelli Ultralytics YOLO, YOLO26, è un modello all'avanguardia che stabilisce un nuovo standard per la vision AI edge-first, offrendo un approccio più leggero, veloce ed efficiente alla distribuzione nel mondo reale. È progettato per funzionare in modo efficiente su CPU e sistemi embedded semplificando la distribuzione e migliorando le prestazioni in tempo reale in una vasta gamma di applicazioni.

Link to this sectionConfronto tra YOLO26, YOLO11 e YOLOv8#

Quando lavori su progetti di computer vision, potresti imbatterti in diversi modelli Ultralytics e chiederti quale sia quello giusto per il tuo progetto. Esaminiamo come si confrontano YOLO26, YOLO11 e YOLOv8 in scenari reali.

YOLOv8 è stato rilasciato nel 2023 ed è stato ampiamente utilizzato dalla comunità di computer vision da allora. Il suo forte supporto della comunità e la facilità d'uso lo hanno reso un modello di riferimento per molti team in passato. Se stai cercando un modello ben documentato con una vasta gamma di tutorial, guide e risorse della comunità, YOLOv8 è un ottimo punto di partenza.

Nel 2024, YOLO11 è stato introdotto con miglioramenti sia nelle prestazioni che nell'efficienza. Offre velocità e precisione migliori rispetto a YOLOv8, pur mantenendo un'architettura più piccola e ottimizzata. È un modello più equilibrato che funziona in modo affidabile in produzione senza aumentare significativamente l'utilizzo delle risorse.

Quest'anno è stato rilasciato YOLO26 come l'ultima iterazione, concentrandosi sulla distribuzione efficiente su larga scala. Offre un'inferenza CPU più veloce e un migliore utilizzo delle risorse, consentendo ai team di eseguire più carichi di lavoro sullo stesso hardware.

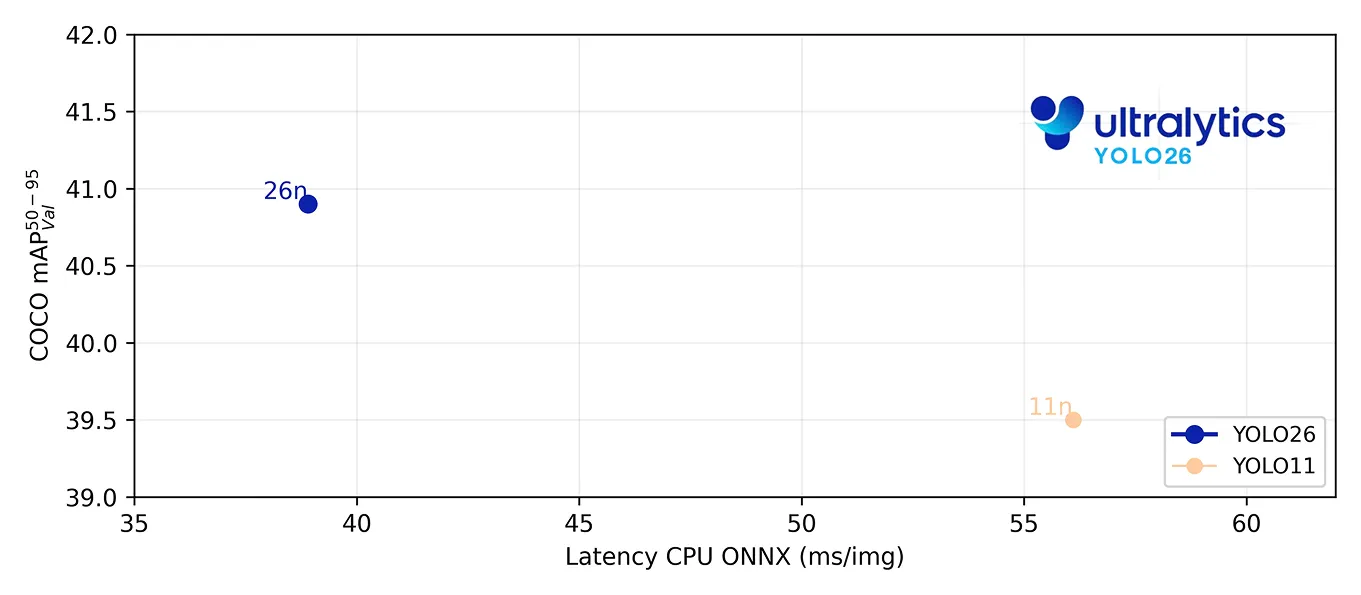

Ad esempio, il modello YOLO26 nano può ottenere un'inferenza fino al 43% più veloce rispetto a YOLO11 sulle unità di elaborazione centrale (CPU), rendendolo un'ottima opzione per ambienti edge e con risorse limitate. Questo è particolarmente importante perché le configurazioni tradizionali si basano spesso pesantemente sulle unità di elaborazione grafica (GPU), che possono essere costose e più difficili da scalare.

Fig 3. Benchmarking delle prestazioni di YOLO26 su CPU (Fonte)

Nel complesso, YOLO26 è una scelta solida per team e individui che cercano di ottimizzare i compromessi tra prestazioni, costi e scalabilità.

Link to this sectionUno sguardo più da vicino a Ultralytics YOLO26#

YOLO26 è un modello all'avanguardia progettato per la distribuzione nel mondo reale, dove efficienza, velocità e scalabilità contano tanto quanto la precisione. Invece di concentrarsi solo sul miglioramento delle prestazioni nei benchmark, introduce cambiamenti architettonici e di addestramento che rendono i modelli più facili da eseguire, più veloci da distribuire e più affidabili in diversi ambienti hardware.

Questi miglioramenti sono particolarmente importanti per i sistemi edge e di produzione, dove risorse di calcolo limitate, vincoli di latenza e considerazioni sui costi giocano un ruolo chiave. Semplificando l'inferenza e ottimizzando le prestazioni, YOLO26 consente agli appassionati di AI di costruire e scalare applicazioni di visione in modo più efficiente.

Ecco uno sguardo più da vicino ad alcune delle caratteristiche chiave di YOLO26:

- Inferenza end-to-end senza NMS: Uno dei cambiamenti cruciali è il suo design privo di Non-Maximum Suppression (NMS), che elimina la necessità di post-elaborazione. In termini semplici, il modello produce previsioni finali direttamente. Di conseguenza, la latenza diventa più prevedibile e la distribuzione diventa più semplice.

- Rimozione di DFL: YOLO26 si allontana dal modulo Distribution Focal Loss (DFL) verso un approccio di previsione delle bounding box più semplice. Questo cambiamento si allinea con il suo design end-to-end senza NMS, riducendo la complessità della pipeline e migliorando la coerenza della distribuzione.

- Ottimizzatore MuSGD: Gli ultimi modelli Ultralytics YOLO introducono MuSGD, un ottimizzatore ibrido che combina la discesa del gradiente stocastica (SGD) con aggiornamenti ispirati a Muon. Ciò migliora la stabilità e la convergenza dell'addestramento, portando a un'ottimizzazione più fluida e a un comportamento più coerente tra le diverse dimensioni dei modelli.

- ProgLoss e STAL: Queste innovazioni nell'addestramento, Progressive Loss Balancing (ProgLoss) e Small-Target-Aware Label Assignment (STAL), rendono il modello più stabile e affidabile. ProgLoss aiuta il modello a imparare dai dataset in fasi nel tempo, mentre STAL assicura che gli oggetti piccoli non vengano ignorati durante l'addestramento, migliorando il rilevamento in scene complesse.

Link to this sectionPrecisione vs efficienza: oltre i benchmark, verso le prestazioni nel mondo reale#

Per contestualizzare le differenze tra YOLO26, YOLO11 e YOLOv8, comprendiamo meglio i fattori che guidano le prestazioni del modello nell'uso reale.

La precisione, spesso misurata da metriche di prestazione come la mean average precision (mAP), è da tempo un modo importante per valutare i modelli di computer vision. Indica quanto bene un modello si comporta in condizioni standardizzate ed è utile quando si confrontano versioni diverse.

Tuttavia, una volta che i modelli passano dal test alla distribuzione reale, la sola precisione non è sufficiente. Le prestazioni in produzione dipendono da fattori come la dimensione del modello, il tempo di inferenza o la latenza, l'utilizzo delle risorse di calcolo e la capacità di un sistema di scalare in diversi ambienti.

A differenza dei benchmark controllati, gli ambienti reali sono spesso imprevedibili. Le condizioni di illuminazione possono cambiare, gli oggetti possono essere parzialmente visibili e i dati di input possono variare significativamente rispetto a quelli su cui il modello è stato addestrato. Queste variazioni possono influire sulla coerenza delle prestazioni di un modello nella pratica.

Fig 4. Un esempio di YOLO26 utilizzato in un ambiente imprevedibile, come un cantiere edile.

Ad esempio, considera una configurazione con centinaia di telecamere in una smart city, un negozio al dettaglio o un magazzino. Ogni flusso deve essere elaborato in tempo reale, richiedendo spesso frame rate costanti (frame al secondo, o FPS) per evitare ritardi o frame persi.

Un modello meno efficiente può gestire meno flussi simultanei su un dato sistema, il che significa che la scalabilità richiede in genere hardware aggiuntivo e aumenta i costi dell'infrastruttura.

Modelli più efficienti, come YOLO26, possono elaborare più flussi sullo stesso hardware, sfruttando meglio le risorse disponibili. Ciò migliora l'efficienza complessiva del sistema e facilita la scalabilità delle distribuzioni nel tempo.

Per approfondire YOLO26, YOLO11 e YOLOv8, consulta la documentazione ufficiale di Ultralytics.

Link to this sectionPunti chiave#

La serie di modelli Ultralytics YOLO si è evoluta per corrispondere meglio alle esigenze di distribuzione nel mondo reale. Ogni versione si basa sulla precedente, con una crescente attenzione all'efficienza, alla scalabilità e alla facilità di distribuzione. In altre parole, se stai costruendo un'applicazione di rilevamento in tempo reale che deve funzionare in modo affidabile su larga scala, Ultralytics YOLO26 è la scelta perfetta.

Vuoi portare la vision AI nelle tue operazioni? Dai un'occhiata alle nostre opzioni di licenza. Puoi anche visitare le nostre pagine sulle soluzioni per vedere come l'AI nella produzione sta trasformando le fabbriche e come l'AI di visione nella robotica sta plasmando il futuro. Unisciti alla nostra crescente comunità ed esplora il nostro repository GitHub per risorse AI.