Ultralytics Platformが、テストから本番環境対応のAPIまで、コンピュータビジョンモデルのデプロイに必要なすべてをどのように統合しているかをご覧ください。

Ultralytics Platformが、テストから本番環境対応のAPIまで、コンピュータビジョンモデルのデプロイに必要なすべてをどのように統合しているかをご覧ください。

Ultralyticsは長年にわたりコンピュータビジョンコミュニティと協力し、誰もがビジョンAIをより利用しやすくするモデルとツールを開発してきました。Ultralytics Platformにより、当社はさらに一歩進んで、データセット管理とアノテーションからモデルのトレーニング、検証、デプロイメントまで、コンピュータビジョン開発ワークフロー全体を単一の統合環境に統合しています。

特に、私たちはコンピュータビジョンモデルのデプロイをより簡単にすることに興奮しています。コンピュータビジョンが現実世界のアプリケーションに進出し続けるにつれて、制御された環境外で画像やビデオを分析することは依然として複雑です。

条件が予測可能なテスト設定とは異なり、実世界のシナリオでは、さまざまな照明、変化する入力、予測不可能なワークロードが伴うため、デプロイメントはビジョンワークフローの中で最も困難な部分の1つとなっています。

デプロイは、モデルを利用可能にするだけではありません。実世界のデータを処理できるプロセスを構築し、利用が増え、プロジェクトがスケールするにつれて、すべてがスムーズに実行されるようにする必要があります。

チームはまた、時間の経過とともにパフォーマンスをtrackし、信頼性を維持する必要があります。これは多くの場合、テスト、統合、デプロイ、および監視のために異なるAIツール間を切り替えることを意味し、モデル開発を遅らせ、不必要な複雑さを加える可能性があります。

ワークフローは断片化されがちです。Ultralytics Platformは、このプロセスを統合し、簡素化します。

単一の環境内でモデルのサービング、テスト、監視に対する組み込みサポートを提供します。チームはブラウザベースの推論を使用してモデルを検証し、共有推論サービスを通じてアプリケーションに統合し、パフォーマンス監視機能を備えた専用エンドポイントにデプロイできます。

本記事では、Ultralytics Platformがテストと統合から本番環境へのデプロイと監視まで、コンピュータービジョンモデルのデプロイをどのように再定義するかを探ります。早速始めましょう!

機械学習ライフサイクルにおいて、モデルデプロイメントは、モデルが実験段階から実世界での使用へと移行する段階です。ディープラーニングと畳み込みニューラルネットワークを使用して構築されたコンピュータービジョンモデルの場合、これは一般的に、画像や動画をリアルタイムで処理できるようにすることを意味します。

デプロイされると、これらのモデルは新しいデータを取り込み、そのデータは通常、リサイズ、正規化、フォーマットなどの前処理ステップを経ます。処理されたデータはその後モデルに渡され、モデルはトレーニング中に学習したパターンを適用して高精度の予測を生成します。

ユースケースに応じて、これは様々なコンピュータービジョンタスクを含む場合があります。例えば、Ultralytics YOLO26のようなUltralytics YOLOモデルは、物体detect、画像分類、インスタンスsegment、姿勢推定、およびoriented bounding box (obb) detectを含む幅広いビジョンタスクをサポートしています。

これを実世界のアプリケーションで実用的にするためには、モデルは前処理と推論の両方を効率的に処理できるシステムに統合される必要があることがよくあります。ここでデプロイメントインフラストラクチャが不可欠になります。

本番環境では、モデルは通常、REST APIまたはモデルサービングシステムを介してアクセスされます。これらのインターフェースにより、アプリケーションはプログラムによってデータを送信し、予測を受け取ることができ、リアルタイムの視覚的理解に依存する外部アプリケーション、IoTデバイス、またはロボットシステムとの統合が容易になります。

コンピュータビジョンモデルのデプロイは簡単そうに聞こえるかもしれませんが、これまでは実際にはかなり異なっていました。一般的なセットアップを考えてみましょう。データはまずカメラやセンサーから取得され、推論のためにモデルに送られ、その後、予測としてアプリケーションに返されます。

実際には、これらの各ステップは、多くの場合、個別のツールやサービスによって処理されます。あるシステムがデータキャプチャを処理し、別のシステムがモデルサービングを管理し、追加のツールがスケーリング、監視、ロギングに使用されます。これらのコンポーネントを接続し、確実に実行し続けることは、すぐに複雑になる可能性があります。

使用量が増加するにつれて、この複雑さも増大します。インフラストラクチャの管理、依存関係の処理、エンドツーエンドのパイプライン全体での一貫したパフォーマンスの維持は、開発を遅らせ、コンピュータービジョンモデルを実世界のアプリケーションにデプロイすることをより困難にする可能性があります。

Ultralytics Platformは、これらのコンポーネントを単一の統合環境にまとめます。これにより、デプロイワークフロー全体をより一貫性のある方法で管理でき、同時に、大規模なパフォーマンスと信頼性をサポートします。

モデルのデプロイプロセスを統合することに加え、Ultralytics Platformはモデルのデプロイ方法と使用方法にも柔軟性をもたらします。

コンピュータービジョンモデルのデプロイのさまざまな段階をサポートするため、プラットフォームは、即時推論を伴うブラウザベースのテスト、開発用のAPIを介した共有推論、グローバル地域にわたるスケーラブルな本番デプロイ用の専用エンドポイント、および外部インフラストラクチャまたはエッジデバイスでモデルを実行するためのモデルエクスポートという4つのオプションを提供します。

それでは、これらの各オプションがどのように機能するかを詳しく見ていきましょう。

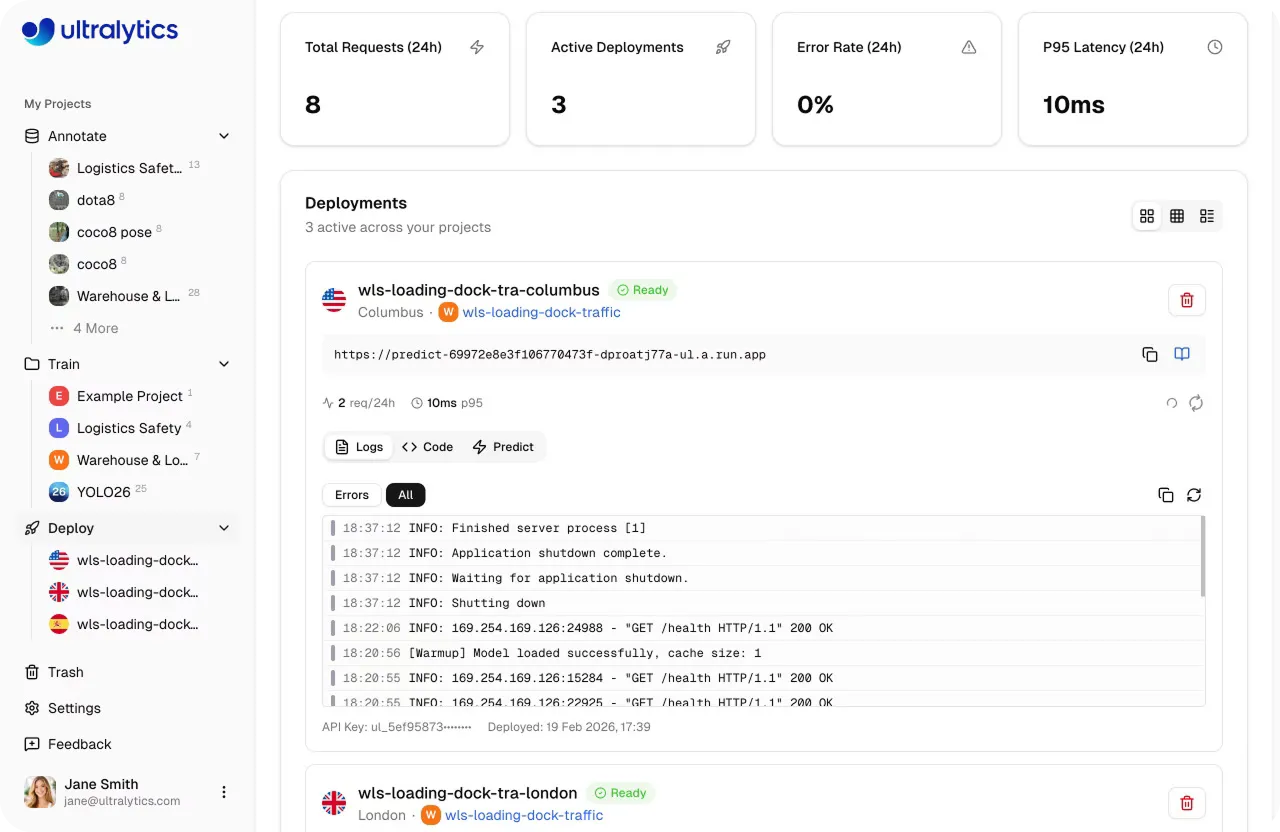

モデルを本番環境に移行する前に、新しい未知のデータに対してどのように動作するかを理解することが重要です。Ultralytics Platformには、組み込みの「Predict」タブがあり、セットアップ、インフラ、依存関係なしにブラウザで直接推論を実行できます。

「予測」タブにより、モデルの検証を迅速かつインタラクティブに行うことができます。画像をアップロードしたり、事前に読み込まれたサンプルを使用したり、ウェブカメラで入力をキャプチャしたりでき、データが提供されるとすぐに推論が自動的に実行されます。

結果は、視覚的なオーバーレイ、信頼度スコア、および詳細な出力とともに瞬時に表示され、モデルの動作を明確に把握できます。

これは、数回のクリックで、デプロイメントに移行する前に、単一のインターフェース内でさまざまな入力を試したり、パラメータを調整したり、パフォーマンスを評価したりできることを意味します。

例えば、モデルをトレーニングし、「予測」タブを使用して検証したとします。次のステップは、多くの場合、そのモデルをアプリケーションまたはワークフローに統合することです。

インフラストラクチャをセットアップしたり、サーバーを管理したりする代わりに、Ultralytics Platformは共有推論サービスを提供し、シンプルなREST APIを通じてモデルにデータを送信し、予測を受け取ることができます。

舞台裏では、共有推論はいくつかのコアリージョンにまたがるマルチテナントシステムで実行され、リクエストは自動的に最も近い利用可能なサービスにルーティングされます。これにより、応答性の高いパフォーマンスを維持しつつ、異なる場所にいるユーザーがモデルに一貫してアクセスできるようになります。

標準のHTTPリクエストを使用して入力を送信し、構造化された出力を受け取ることができます。これにより、モデルをアプリケーション、スクリプト、または自動化ワークフローに簡単に接続できます。この設定は、よりスケーラブルな本番デプロイメントに移行する前の、開発、テスト、統合、またはより軽い使用に適したオプションです。

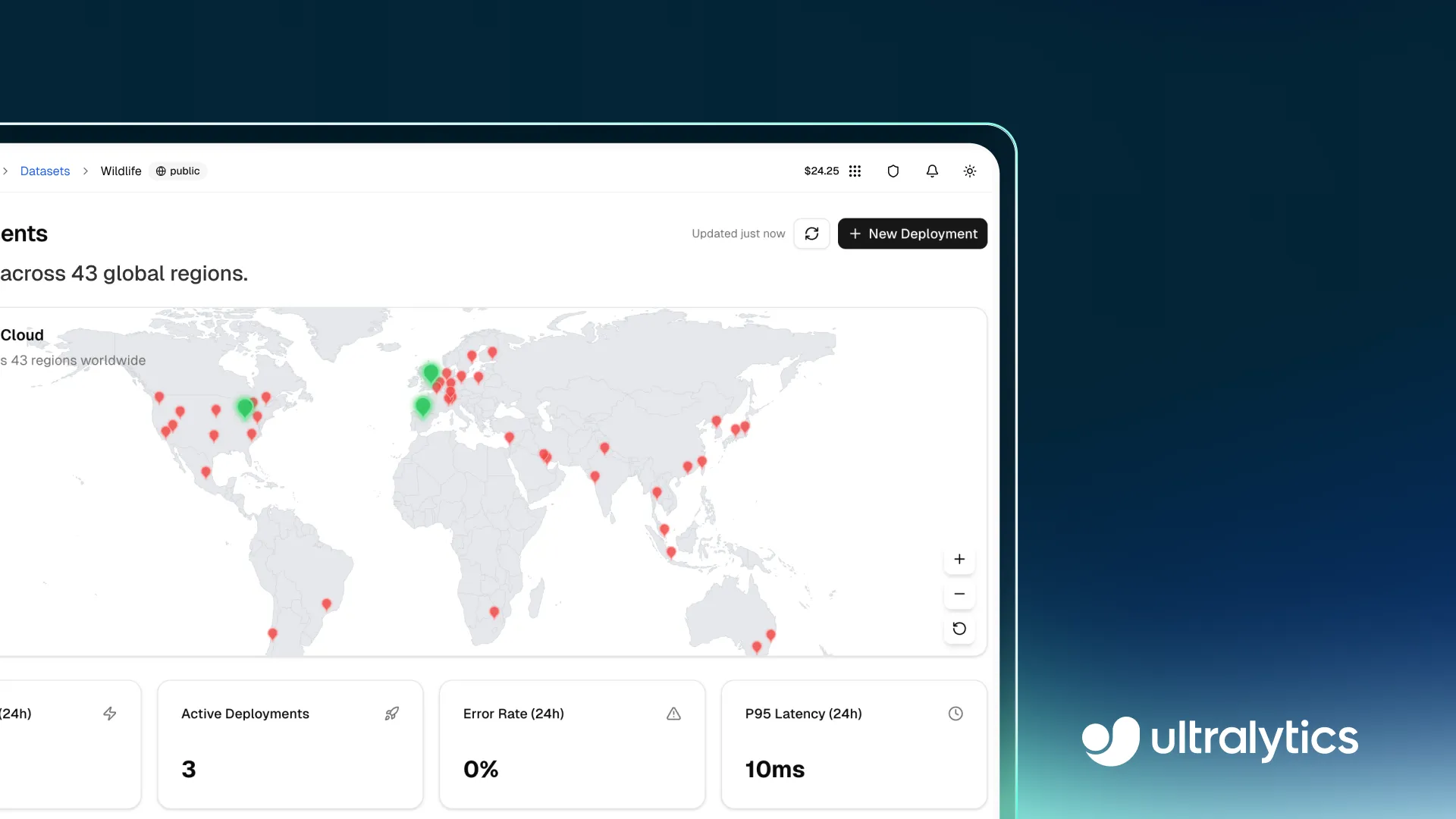

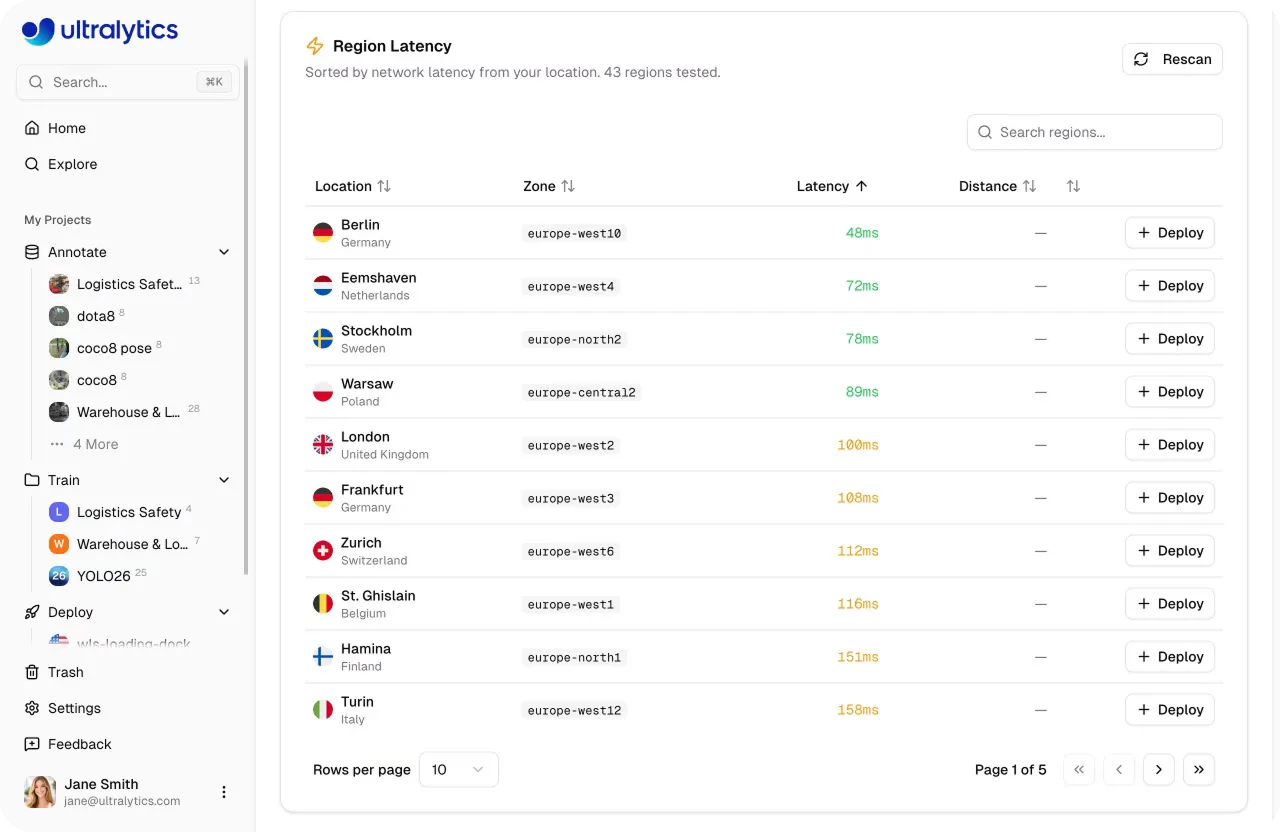

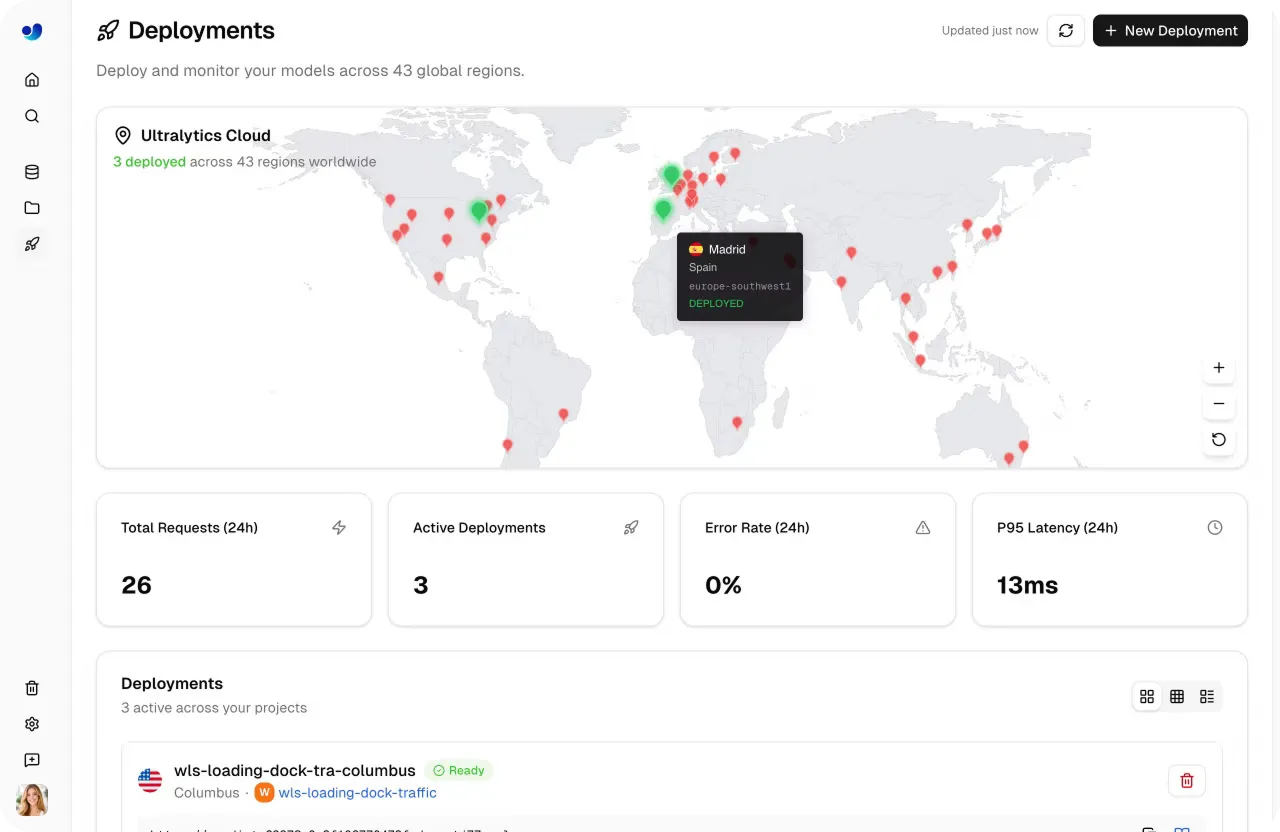

モデルが本番環境に対応したら、実際のトラフィックを信頼性高く、かつ大規模に処理する必要があります。Ultralytics Platformは、モデルが世界43地域にわたるシングルテナントサービスとして実行される専用エンドポイントでこれをサポートします。エンドユーザーに近い場所にデプロイすることで、レイテンシを削減し、異なる場所間で一貫したパフォーマンスを維持するのに役立ちます。

各エンドポイントは、独自の割り当てられた計算リソースと、推論リクエスト用のユニークなURLで実行されます。このレベルの制御により、軽量なユースケースから、より多くの計算リソースを必要とする要求の厳しい高スループットアプリケーションまで、パフォーマンスのニーズに基づいてデプロイメントを簡単に調整できます。

しかし、専用エンドポイントは、受信トラフィックに基づいてリソースを調整するオートスケーリングにより、変化するワークロード自体を処理するように設計されています。需要が高い期間にはスケールアップし、使用量が減少するとスケールダウンします。デフォルトでスケール・トゥ・ゼロが有効になっているため、アイドル状態のエンドポイントは自動的にシャットダウンし、新しいリクエストが到着すると再起動するため、手動介入なしにリソース使用量を最適化するのに役立ちます。

今日では、より多くのアプリケーションがスマートフォン、カメラ、組み込みシステムなどのデバイス上でモデルを直接実行することに依存しているため、エッジAIはますます不可欠になっています。モデルをローカルで実行することは、画像やビデオストリームなどの機密データが外部サーバーに送信されることなくデバイス上で直接処理できるため、データプライバシー要件への対応にも役立ちます。

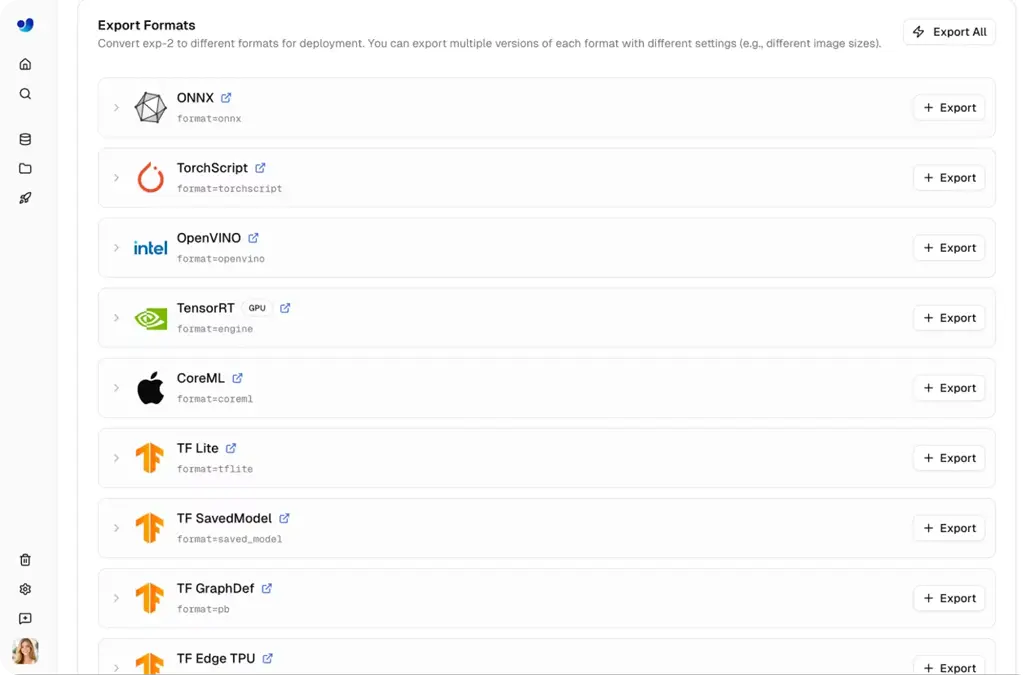

これらのシナリオでは、モデルはUltralytics Platformの外部で実行する必要があり、モデルのエクスポートがデプロイプロセスにおいて重要な部分となります。Ultralytics YOLOモデルは、しばしばPythonとPyTorchを使用してトレーニングされ、その後、ONNX、TensorRT、CoreML、OpenVINOを含む17以上の異なるフォーマットにエクスポートできます。

この幅広いフォーマットは、高性能GPUからモバイルデバイスや組み込みデバイスまで、多様なハードウェアとの互換性を保証します。さらに、エクスポートにより特定の環境向けにパフォーマンスチューニングが可能になります。

フォーマットに応じて、モデルはより速い推論速度を達成できます。例えば、TensorRTによるGPU性能の向上や、ONNXとOpenVINOによる最適化されたCPU実行などです。FP16やINT8量子化のようなオプションは、モデルサイズをさらに削減し、スループットを向上させることができ、これはエッジデプロイメントに特に有用です。

Ultralytics Platformでは、エクスポートがワークフローに直接組み込まれており、数クリックで最適化されたモデルを迅速に生成できます。チームは、余分なオーバーロードを追加することなく、トレーニングから外部システムでのモデル実行へと移行できます。

Ultralytics Platformの各デプロイメントオプションは、初期テストから本番利用まで、ワークフローの異なる段階をサポートします。それぞれをいつ使用するかについての概要を以下に示します。

チームはこれらのオプションを段階的に進めることがよくあります。検証から統合、そして最終的な本番環境へのデプロイまで、これらすべてをプラットフォーム内で完結させます。

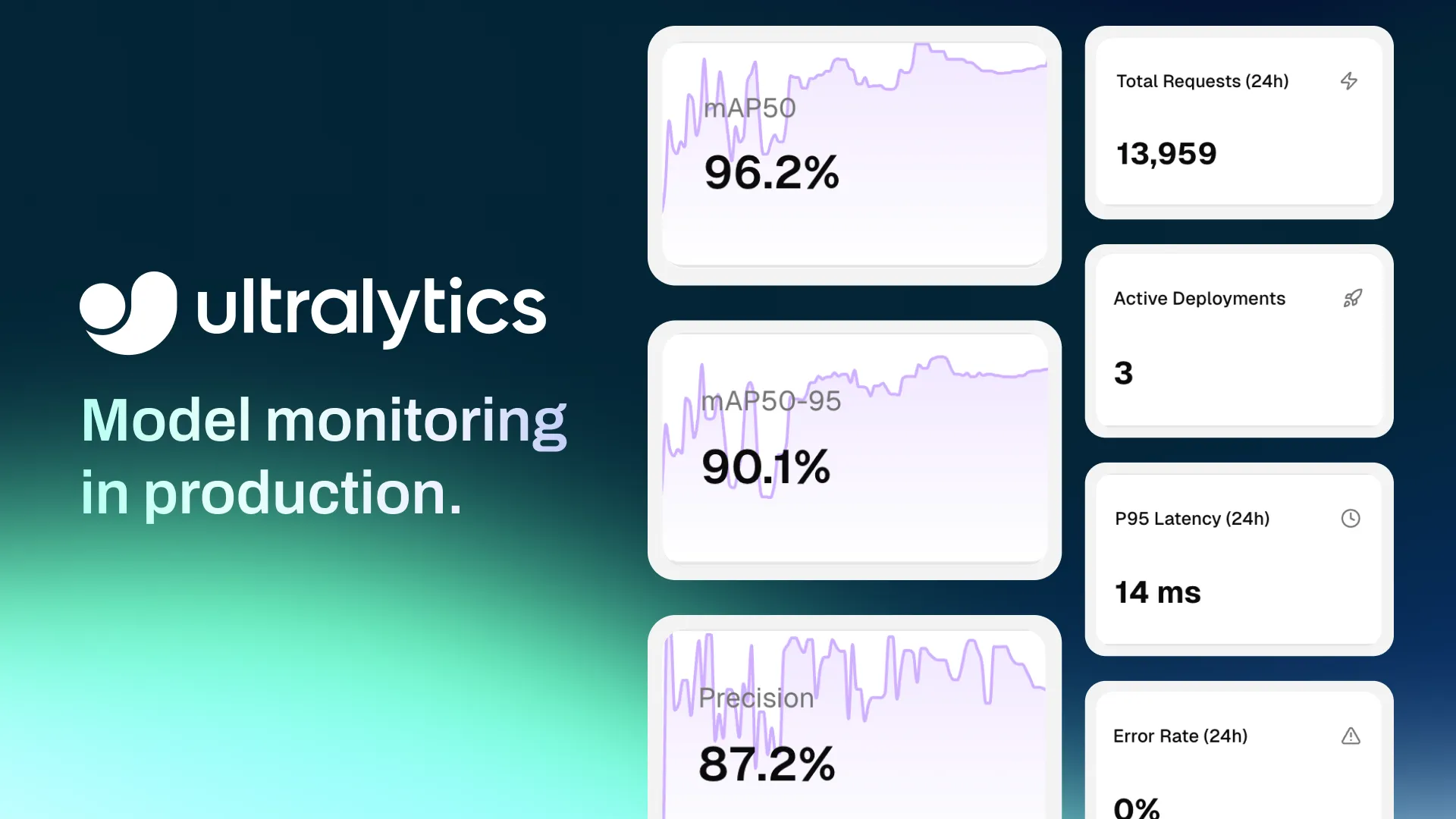

デプロイメントが重要であるのと同様に、ビジョンパイプラインはそこで終わりではありません。モデルが本番環境で稼働し始めたら、時間の経過とともに確実に信頼性の高いパフォーマンスを発揮するために、継続的な監視が重要です。

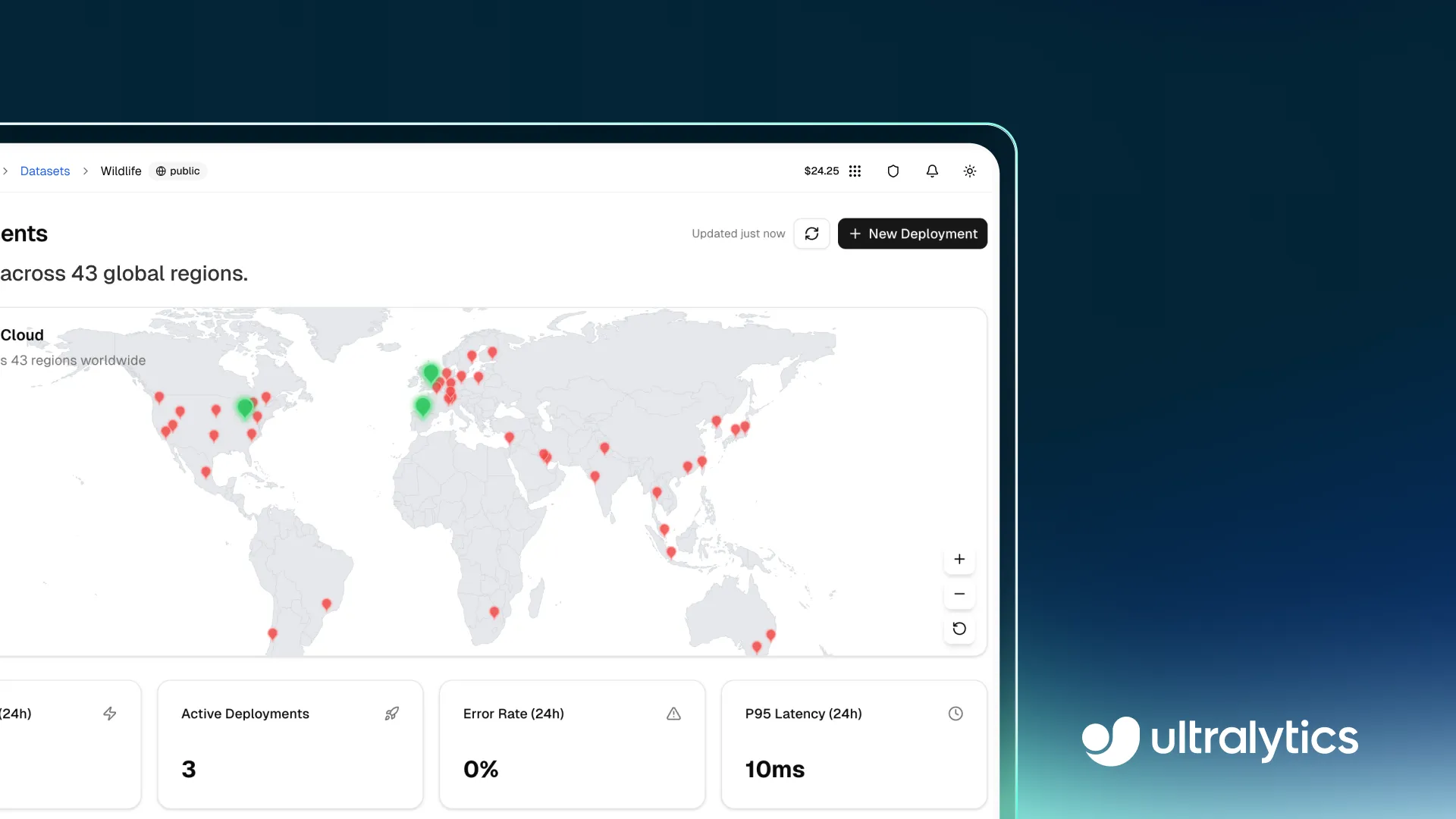

Ultralytics Platformは、チームがビジョンAIモデルの経時的な動作を明確に可視化できる組み込みの監視ツールを提供し、より構造化された機械学習オペレーション(MLOps)ワークフローをサポートします。

デプロイページには、総リクエスト数、アクティブなデプロイメント、応答レイテンシ、エラー率などの主要なメトリクスを追跡するダッシュボードが含まれています。これらの洞察は、チームが使用パターンを理解し、システム応答性を評価し、さまざまなワークロードで低レイテンシのパフォーマンスを確保するのに役立ちます。

各専用エンドポイントは、個別のデプロイメントビューを通じて詳細な可観測性も提供します。これには、ログ、モデルの健全性ステータス、リアルタイムのパフォーマンスデータへのアクセスが含まれます。ログは、問題のデバッグ、失敗したリクエストの追跡、依存関係やインフラストラクチャに関連する潜在的な問題の特定に使用できます。

生産環境が進化するにつれて、入力データの変化、スケーリングの要求、使用パターンのシフトなどの要因がモデルの精度と堅牢性に影響を与える可能性があります。パフォーマンスメトリクスを継続的に監視することで、チームは異常を検出し、ボトルネックを特定し、モデルの最適化やリソース調整などの是正措置を講じて、一貫した信頼性の高いモデル提供を維持できます。

コンピュータービジョンシステムをスケールアップすることは、従来、一体として機能するように設計されていないワークフローとフレームワークを組み合わせることを意味していました。データパイプライン、トレーニングループ、デプロイメントインフラストラクチャ、および監視システムは、多くの場合、別々の場所に存在し、あらゆる段階で摩擦を生み出します。

モデルを構築するだけでなく、それらを継続的に運用し続けることが真の課題です。データから本番環境への移行、新しい入力への適応、増大する需要への対応、そして速度を落とさずに継続的に改善することです。

Ultralytics Platformの際立った特徴は、この一連の動きが組み込まれていることです。各ステージを個別のステップとして扱うのではなく、それらを連続的なループに接続し、同じ環境内でモデルの開発、デプロイ、監視、更新が行えるようにします。

その変化は、チームがスケールする方法を変えます。もはやツールやインフラのオーケストレーションではなく、システムが成長するにつれて勢いを維持することに重点が置かれます。

コンピュータービジョンモデルのような機械学習モデルを実世界のアプリケーションに導入するには、信頼性、スケーラビリティ、管理の容易さが求められます。Ultralytics Platformは、モデルサービング、デプロイ、モニタリングといった様々な機能を統合された単一環境にまとめることで、このプロセスを簡素化します。柔軟なデプロイオプションと組み込みツールにより、チームは実験段階から本番環境への移行をより迅速かつ少ない複雑性で実現できます。

詳細については、当社のコミュニティとGitHubリポジトリをご覧ください。ソリューションページで、ヘルスケアにおけるAIやロジスティクスにおけるコンピュータービジョンなど、さまざまなアプリケーションをご覧ください。当社のライセンスオプションをご覧になり、今すぐ構築を始めましょう!

未来の機械学習で、新たな一歩を踏み出しましょう。