Ultralytics Platformによるポリゴンアノテーション・ガイド

ポリゴンアノテーションの概要、精密なオブジェクトセグメンテーションを実現する方法、そしてUltralytics Platformで簡単にアノテーションを作成する方法をご紹介します。

最先端のAI技術は、自動運転から精密農業まで、幅広い業界に浸透しつつあります。例えば、酪農家はAIと画像解析を活用して牛の病気を検知しています。歩行や姿勢の変化(背中のアーチや左右非対称の動きなど)を観察することで、跛行(はこう)といった健康上の懸念を監視することが可能です。

図1:AIと画像解析を用いて牛を監視する例。

コンピュータビジョンは人工知能の一分野であり、マシンが視覚データを解釈・分析できるようにすることで、このようなアプリケーションを実現します。特に、インスタンスセグメンテーションは、画像内の各オブジェクトをピクセルレベルで特定・セグメント化するコンピュータビジョンのタスクであり、個々の動物を正確に検知・分析することを可能にします。

ポリゴンアノテーションは、このプロセスにおいて重要な役割を果たします。これは、画像内のオブジェクトのエッジに沿って点を配置することで、その正確な形状を慎重になぞるデータアノテーション手法です。単純なバウンディングボックスのアノテーションとは異なり、このアプローチはオブジェクトの本来の輪郭に沿うため、より高精度なトレーニングデータの作成に役立ち、ビジョンAIモデルがオブジェクトの境界をより深く理解できるようにします。

現在、ポリゴンアノテーションを作成するためのツールは数多く存在します。しかし、それらの選択肢は断片化していることが多く、特に異なるタイプのアノテーションに対するサポートが一貫していなかったり限定的であったりする場合、単一のワークフロー内で多様なラベリングニーズを管理するのが難しくなります。

Ultralytics Platformは、データセット管理、アノテーション、トレーニング、デプロイ、監視の間のギャップを埋める、新しいエンドツーエンドのビジョンAIワークスペースです。複数のアノテーションタイプやAI支援ワークフローを一つのシームレスなワークスペースでサポートすることで、アノテーションプロセス全体を簡素化し、これらの課題を解決します。

この記事では、ポリゴンアノテーションとは何か、そしてUltralytics Platformを使用してそれを作成する方法について解説します。早速始めましょう!

Link to this sectionポリゴンアノテーションの詳細#

Ultralytics Platformとそのポリゴンアノテーション機能について掘り下げる前に、まずは一歩立ち止まって、ポリゴンアノテーションとは何かを理解しましょう。

画像アノテーションとは、AIモデルが視覚データを認識できるようにするためにラベルを付与するプロセスです。通常、これには画像内のオブジェクトを特定し、モデルが学習できるようにマークを付ける作業が含まれます。

最も一般的な手法の一つは、オブジェクトの周囲に長方形の箱を描く「バウンディングボックス」です。しかし、バウンディングボックスはオブジェクトの大まかな輪郭しか提供しません。ポリゴンアノテーションは、より精密なアプローチです。

これは、箱の中に収めるのではなく、オブジェクトの境界線をポイントごとにトレースすることで機能します。これを実現するために、アノテーターはオブジェクトのエッジに沿って複数の頂点(点)を配置し、全体の形状がカバーされるまでその輪郭をなぞります。

これらの連結された点は、オブジェクトの自然な輪郭を反映するポリゴンを形成します。形状がオブジェクトの境界に密接に沿っているため、従来のアノテーション手法では見落とされがちな詳細までキャプチャできます。これは、葉、人のシルエット、重なり合うオブジェクトなど、不規則な形状や複雑なエッジを持つオブジェクトに対して特に有効です。

データにおけるこのような精度は、機械学習モデルがトレーニング中に効果的に学習するのに役立ちます。アノテーションがオブジェクトの真の境界を正確に捉えていると、モデルはピクセルレベルでオブジェクトのパターンをより良く理解できるようになります。これにより、高い精度が求められるセグメンテーションタスクにおいて、モデルの性能が向上します。

Link to this sectionコンピュータビジョンワークフローにおけるポリゴンアノテーションの役割#

では、ポリゴンアノテーションは実際どのように使用されるのでしょうか?それらは、インスタンスセグメンテーションのような画像セグメンテーションタスクをサポートするビジョンAIモデルと密接に関連しています。

多くのコンピュータビジョンアプリケーションにおいて、画像やビデオフレーム内で各オブジェクトが占める正確な領域を知ることは不可欠です。製造業における自動車部品検知がその好例です。この場合、モデルはドア、窓、ヘッドライトなどの部品が重なり合っていたり複雑な形状をしていたりしても、それらを特定し正確に輪郭をなぞる必要があります。

ここでインスタンスセグメンテーションの出番です。これにより、モデルは各オブジェクトを検出し、その正確な境界をピクセルレベルでマッピングできるようになります。これは、バウンディングボックスを使用する基本的なオブジェクト検知とは異なります。

図2:インスタンスセグメンテーションは、車の損傷した部品を識別するのにも役立ちます。(ソース)

バウンディングボックスは、オブジェクトの周囲の大まかな長方形の領域を提供するだけで、余分な背景を含んでしまうことも多いため、不規則な形状を捉えたり、重なり合ったアイテムを分離したりするのが困難です。

ポリゴンアノテーションは、このレベルの精度を実現する上で重要な役割を果たします。データセット画像内の各オブジェクトの正確な形状をなぞることで、真のオブジェクト境界を反映した高品質なトレーニングデータが作成されます。これらの詳細なアノテーションは、Ultralytics YOLO26のようなモデルが各コンポーネントの構造をより深く理解する助けとなり、結果としてより正確なセグメンテーションを実現します。

Link to this section従来の画像アノテーションツールの制限#

次に、Ultralytics Platformのようなより効率的でスケーラブルなソリューションの必要性を理解するために、従来のアノテーションツールの限界について見ていきましょう。

従来型のポリゴンアノテーションツールを使用する際にアノテーターが直面する一般的な課題は以下の通りです。

- アノテーションタイプのサポートが限定的: 一部のツールは単一のアノテーション手法に特化しているため、ポリゴン、バウンディングボックス、キーポイントといった異なるタイプを一つの場所で扱うのが困難です。

- 複雑なアノテーション処理の非効率性: 細部まで精密にアノテーションを行うための機能が不足している場合があります。

- AI支援機能の欠如: 多くのツールは完全に手動での作業に依存しており、アノテーションを高速化するための組み込みAIサポートがありません。

- データセット管理の断片化: ツールが一元化されたワークスペースを提供していない場合、データセット、バージョン、アノテーションの管理が困難になることがあります。

Ultralytics Platformは、Segment Anything Models (SAM) とYOLOモデルの両方を活用したAI支援アノテーション機能によって、これらの懸念に対処します。SAMにより、ユーザーはクリックのようなシンプルな入力から高品質なセグメンテーションマスクを生成でき、それを精密なポリゴンアノテーションに調整することができます。

同様に、YOLOベースのスマートアノテーションは、事前学習済みまたはカスタム学習済みのYOLOモデルを使用して画像に対して推論を実行し、バウンディングボックス、セグメンテーションマスク、回転バウンディングボックスなどの予測結果をアノテーションとして追加します。これらは必要に応じて確認および調整が可能です。これらの機能が合わさることで、アノテーションプロセスはより迅速、一貫性があり、スケーリングが容易になります。

Link to this sectionUltralytics Platformがサポートする様々なアノテーションタイプ#

Ultralytics Platformには、統合されたアノテーションエディタが含まれており、ワークスペース内で直接画像にアノテーションを付けることができます。これにより、別々の時間のかかるデータラベリングツールに頼ることなく、データセットを構築・管理しやすくなります。

ポリゴンアノテーションに加えて、Ultralytics Platformは他のいくつかのタイプのアノテーションをサポートしています。概要は以下の通りです。

- バウンディングボックス: アノテーターはオブジェクトの周囲に単純な長方形の箱を描くことができ、画像内の検知を容易にします。

- キーポイント: この手法は、姿勢推定のようなタスクのために、体の関節やランドマークなどの特定の点をマークするのに使用されます。

- 回転バウンディングボックス (OBBs): これにより、標準的なバウンディングボックスと比較して、回転したり角度がついたりしたオブジェクトをより正確にキャプチャできます。

- 分類ラベル: より単純なタスクでは、個々のオブジェクトをマークする代わりに、画像全体にラベルを割り当てることができます。

Link to this sectionUltralytics Platformでのポリゴンによるオブジェクトのアノテーション#

それでは、Ultralytics Platform上で、手動またはAI支援ツールを使用してポリゴンアノテーションを作成する方法を見ていきましょう。

Link to this sectionUltralytics Platformでの手動によるポリゴンアノテーション作成#

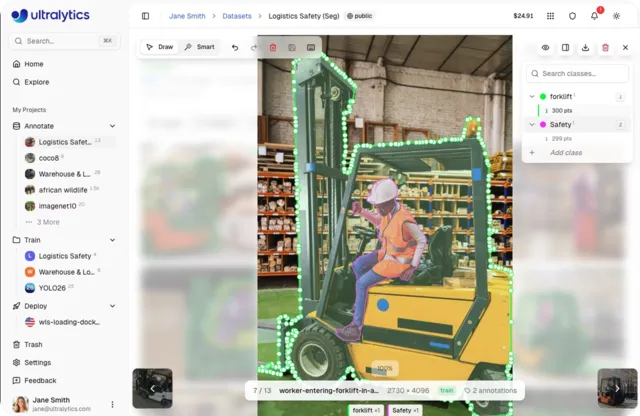

手動でポリゴンアノテーションを作成するための簡単なステップバイステップガイドです。

- ステップ 1 - データセットに移動する: アノテーションしたい画像が含まれているデータセットを開きます。ここで画像とアノテーションが保存・管理されます。

- ステップ 2 - 画像を開く: 画像をクリックしてアノテーションインターフェースで開きます。アノテーションワークフローはデータセットのタスクに依存します。例えば、インスタンスセグメンテーションデータセットでは、アノテーションはポリゴンマスクを使用して作成されます。

- ステップ 3 - マスクの作成を開始する: 画像をクリックしてアノテーションを開始します。クリックするたびに、オブジェクト境界に沿って頂点が追加されます。

- ステップ 4 - オブジェクトの輪郭をなぞる: オブジェクトの形状を定義するために、エッジに沿ってクリックを続けます。

- ステップ 5 - ポリゴンを完成させる: 「Enter」キーを押すか、最初の点をクリックしてポリゴンを完成させ、クラスラベルを割り当てます。

- ステップ 6 - 追加のアノテーションを追加する: プロセスを繰り返して、画像内の他のオブジェクトに対してもポリゴンを作成します。

- ステップ 7 - アノテーションの保存: アノテーションは作成されると同時に自動的に保存されます。

図3:Ultralytics Platformで手動でポリゴンアノテーションを作成する様子。(ソース)

Link to this sectionUltralytics Platformでのスマートポリゴンアノテーション#

次に、アノテーションプロセスを高速化するUltralytics PlatformのAI支援ラベリング機能を見ていきましょう。

このプラットフォームは、スマートアノテーションに対して二つのアプローチを提供します。一つは対話型のクリックベースアノテーション生成を行うSegment Anything Models (SAM) によるもので、もう一つはモデルの予測結果を直接アノテーションとして追加するYOLOモデルによるものです。どちらのアプローチもスマートポリゴンアノテーションに使用できます。

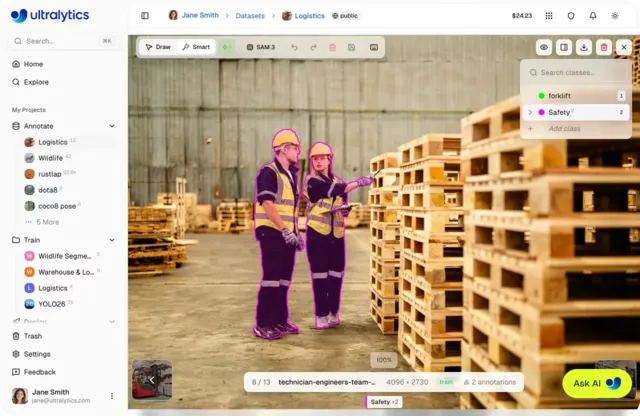

Link to this sectionUltralytics Platform内でのSAMを使用したスマートアノテーション#

Ultralytics PlatformでのSAM支援アノテーションは、Segment Anything Model (SAM) を使用して最小限の入力でセグメンテーションマスクを生成することで、手動ラベリングを簡素化します。ポイントごとにオブジェクトをなぞる代わりに、ユーザーは画像に対してクリックなどの簡単なプロンプトを使用して、何を含めるか、何を除外するかを指定できます。

プラットフォームはSAM 2.1やSAM 3を含む複数のSAMモデルをサポートしており、ユーザーはニーズに応じて高速性能か高精度かを選択できます。SAMはユーザーの入力に基づいてリアルタイムでピクセルレベルのマスクを生成します。これらのマスクは調整可能であり、ポリゴンアノテーションとして使用できるため、プロセスがより迅速、一貫性があり、スケーリングが容易になります。

Ultralytics PlatformでSAMを使用してポリゴンアノテーションを行う手順は以下の通りです。

- ステップ 1 - 画像を開く: データセットに移動し、画像をクリックしてフルスクリーンビューアを起動します。

- ステップ 2 - アノテーションモードに入る: 「Edit」をクリックし、Smartモードに切り替えます(または「S」キーを押す)と、SAMが有効になります。

- ステップ 3 - SAMモデルを選択する: スピードと精度のニーズに合わせて、ツールバーからSAMモデルを選択します。

- ステップ 4 - プロンプトを入力する: 左クリックで正の点(領域を含める)を、右クリックで負の点(領域を除外する)を追加します。

- ステップ 5 - マスクを生成・適用する: SAMがリアルタイムでセグメンテーションマスクを予測します。「Enter」キーを押す(または自動適用を使用する)と、アノテーションが適用されます。

- ステップ 6 - アノテーションを調整する: 保存する前に、必要に応じて点を追加したり結果を微調整したりして精度を向上させます。

図4:Ultralytics Platform内でのSAM支援ポリゴンアノテーション。(ソース)

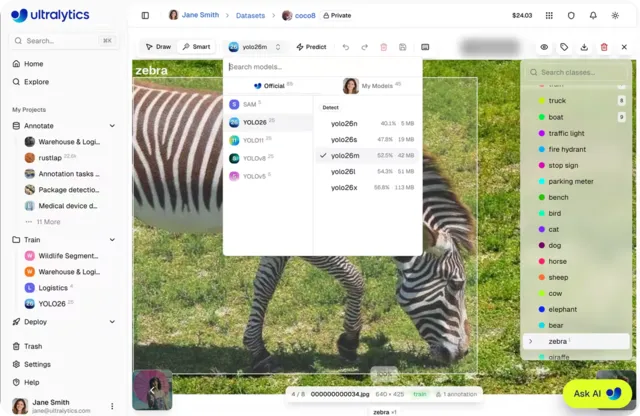

Link to this sectionUltralytics Platform内でのYOLOを使用したスマートアノテーション#

Ultralytics PlatformでのYOLOベースのスマートアノテーションは、事前学習済みのUltralytics YOLOモデルや微調整されたYOLOモデルを使用して画像上で予測を行い、それらをアノテーションとして追加することで、ラベリングを加速させます。これらの予測には、データセットタスクに応じて、バウンディングボックス、セグメンテーションマスク、回転バウンディングボックスが含まれます。

その後、ユーザーは必要に応じてこれらのアノテーションを確認・調整できます。Ultralytics PlatformでYOLOベースのスマートアノテーションを使用する手順の概要は以下の通りです。

- ステップ 1 - 画像を開く: データセットに移動し、画像を選択してフルスクリーンビューアで開きます。

- ステップ 2 - アノテーションモードに入る: 「Edit」をクリックし、Smartモードに切り替えます(または「S」キーを押します)。

- ステップ 3 - YOLOモデルを選択する: ツールバーのモデルピッカーからYOLOモデルを選択します。

- ステップ 4 - 予測を実行する: 「Predict」をクリックして、モデルに自動的にアノテーションを生成させます。

- ステップ 5 - アノテーションを確認する: 画像に追加された予測バウンディングボックス、セグメンテーションマスク、またはOBBを点検します。

- ステップ 6 - 調整して保存する: 必要に応じて不正確なアノテーションを編集、調整、削除し、最終的なラベルを保存します。

図5:YOLOスマートアノテーションの使用例。(ソース)

Link to this sectionポリゴンアノテーションの実際のユースケース#

ポリゴンアノテーションは、製造業における品質管理から農業やヘルスケアまで、幅広い業界で真のインパクトをもたらしています。主要な実際のアプリケーションをいくつか見てみましょう。

Link to this sectionコンピュータビジョンによる害虫検知の識別#

農業において、収穫量を向上させ損失を減らすには、作物の健康状態を監視することが重要です。作物の葉における害虫被害の領域を検知することは、これらの領域が不規則な形状で境界が不明確な場合が多いため、難しい場合があります。

このような問題には、セマンティックセグメンテーション(特定のクラスに属する全ピクセルをラベル付けする)や、オブジェクトの輪郭をより正確に分離するインスタンスセグメンテーションといった画像セグメンテーション手法でアプローチできます。

Ultralytics Platformを使用することで、ユーザーはポリゴンアノテーションを使ってこれらの被害領域の正確な形状をなぞることができます。これは、より正確なデータセットの作成に役立ち、ビジョンAIアルゴリズムが農業環境における微細なパターンを検知しやすくします。

結果として、チームはモデルが害虫被害の発生箇所を正確に特定するのに役立つ、より優れたトレーニングデータを構築できます。これは、影響を受けていない葉の部分まで含んでしまう可能性があるバウンディングボックスを使用するよりも効果的です。

Link to this sectionインスタンスセグメンテーションを活用した医療画像解析#

農業における害虫検知と同様に、境界線のわずかな違いが、がんのような疾患の分析結果に影響を与える可能性があります医療画像。これは、CTスキャンにおいて腫瘍などのヘルスケア上の異常を特定する際に特に重要です。

従来のアノテーション手法では、細かいエッジを見逃したり、周囲の組織を含めてしまったりして、精度が低下する場合があります。Ultralytics Platformを使用すると、チームはポリゴンアノテーションを使用してトレーニングデータ内のこれらの領域を正確になぞることができ、モデルがより正確で信頼性の高い腫瘍セグメンテーションを実現する助けとなります。

Link to this section主な要点#

モデルが高精度で画像内のオブジェクト形状を理解する必要がある場合、ポリゴンアノテーションが鍵となります。特にUltralytics Platformを使用する場合、複雑な形状をより正確に表現するのに役立ちます。精度と強力なツールを組み合わせることで、チームはより信頼性が高く高性能なAIモデルを構築できます。

プロジェクトにビジョンAIを取り入れる準備はできていますか?私たちのコミュニティに参加し、自動車業界におけるAIやロボティクスにおけるビジョンAIについて学びましょう。詳細については、私たちのGitHubリポジトリを探索してください。今すぐ始めるには、ライセンスオプションをチェックしてください!