Ultralytics PlatformでのビジョンAI学習用クラウドGPUの選び方

データセットのサイズ、モデルの複雑さ、コストなどの要素に基づき、Ultralytics Platformでのコンピュータビジョン学習に適したクラウドGPUの選び方を学びます。

Last month, we introduced Ultralytics Platform, an end-to-end environment designed to streamline the entire computer vision workflow, from dataset management to model training and deployment. Ultralytics Platform brings together everything needed to build and scale vision AI models into a single and unified experience.

このワークフローの重要な部分はモデルの学習です。ニューラルネットワークはデータからパターンを学習し、正確な予測を行います。この際、適切な計算リソースへのアクセスが極めて重要な役割を果たします。以前、私たちはUltralytics Platformがクラウドのグラフィックス処理ユニット(GPU)を活用したモデル学習をどのようにサポートし、ユーザーがローカルのインフラを管理することなくコンピュータビジョンモデルを学習できるかについて紹介しました。

強力なNVIDIA GPUへのオンデマンドアクセスにより、学生やスタートアップから研究者、大企業まで、幅広いユーザーがこれまで以上に効率的にAIワークロードを実行できます。クラウド学習を始めるのは簡単ですが、適切なGPUを選択するには、データセットのサイズ、モデルの複雑さ、コストなどの要素を考慮する必要があります。

コスト効率の高いRTX GPUから高性能なNVIDIA H100、次世代のBlackwellハードウェアまで、今日では幅広い選択肢が用意されており、適切な構成を選択することはモデル開発とコストの両面に大きな影響を与えます。

この記事では、Ultralytics Platformにおけるコンピュータビジョン向けのクラウドGPU学習と、ワークロードに最適なハードウェアの選び方について解説します。それでは始めましょう!

Ultralytics Platformでのクラウド学習の概要

Ultralytics Platformでのクラウド学習に最適なGPUの選び方を掘り下げる前に、まずは一歩引いて、クラウド学習の仕組みについて見ていきましょう。

クラウドGPU学習とは?

クラウドGPU学習とは、自身のローカルハードウェアやワークステーションに依存する代わりに、クラウドコンピューティング環境でホストされたGPUを使用して機械学習およびディープラーニングモデルを学習させることを指します。Ultralytics Platformでは、強力なGPUにオンデマンドでアクセスし、自身のセットアップを必要とせず、リモートで学習ジョブを実行できます。

これにより、ワークロードに基づいてリソースを簡単にスケールできます。システムの能力に制限されることなく、必要に応じてより強力なGPUを選択したり、キャパシティを増強したりできます。これは、リモートデータセンター内の強力なマシンやノードにアクセスし、必要に応じてスケールアップやスケールダウンができるものと考えてください。

また、高価なハードウェアをセットアップや保守する必要もなくなります。GPUを購入したり、ドライバーをインストールしたり、互換性の問題に対処したりする必要はありません。

Ultralytics Platformは、リソースのプロビジョニングから環境構築、オーケストレーション、学習ジョブの実行まで、管理されたクラウドサービスを通じてすべてを処理するため、ユーザーはモデルの学習、実験、改善に集中できます。

Ultralytics Platformでのモデル学習の仕組み

Ultralytics PlatformでのGPUアクセラレーションによる学習ワークフローはシンプルです。まずは、いくつかの方法でデータセットを取り込むことから始められます。

独自のデータをアップロードしたり、プラットフォーム上で利用可能な公開データセットを使用したり、コミュニティによって共有されたデータセットをクローンして既存の成果をベースに構築したりできます。データセットをクローンするとワークスペース内にコピーが作成され、元データを変更せずに編集や拡張を行うことができます。

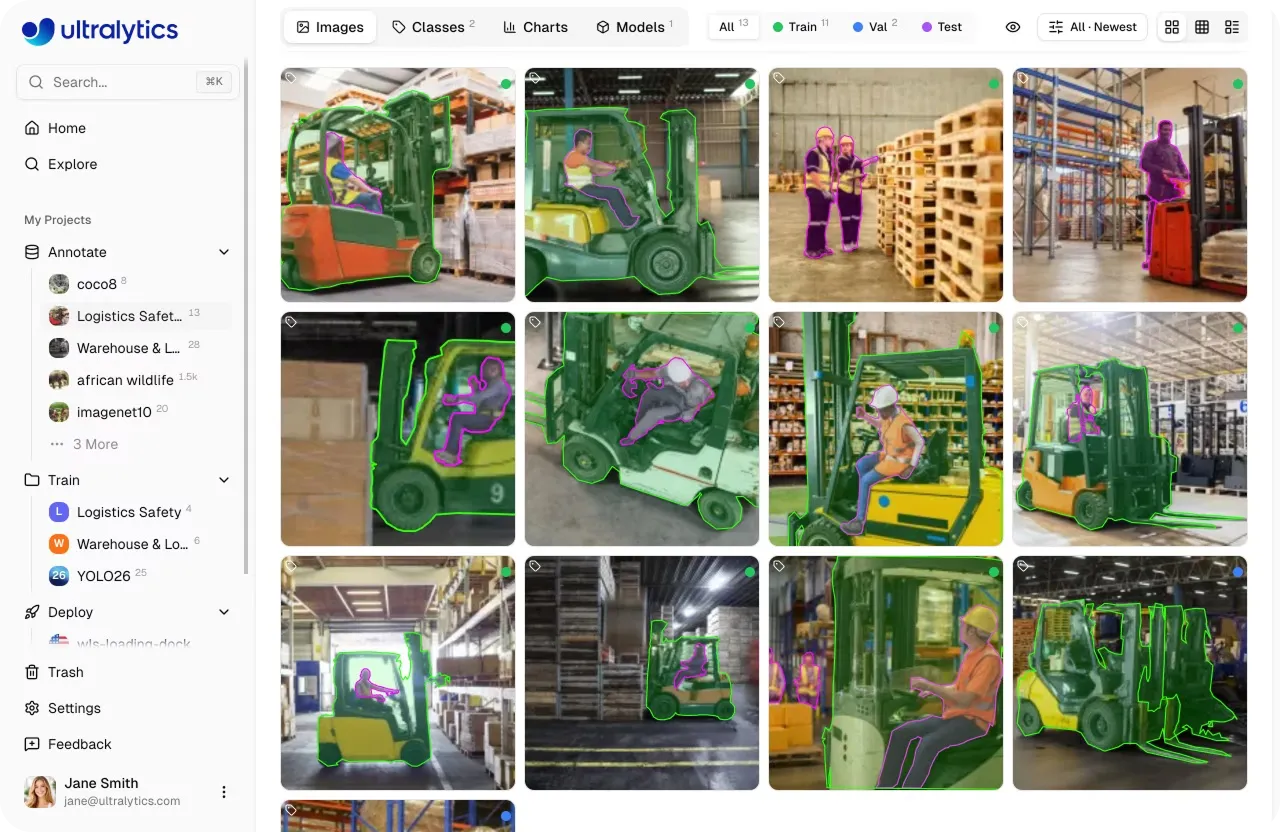

データセットを選択したら、画像とアノテーションを確認・整理し、適切に構造化されているかを確認できます。プラットフォームにはアノテーションツールが組み込まれており、物体検出、セグメンテーション、分類などのタスク用にデータにラベルを付けたり、AI支援機能を使用してプロセスをスピードアップしたりすることが可能です。

図1:Ultralytics Platformでデータセットを表示 (ソース)

次に、学習実行を管理するためのプロジェクトを選択または作成します。プロジェクトを使用すると、モデルの整理や比較、パフォーマンスメトリクスの追跡、関連する実験の一元管理が容易になります。

そこからクラウド学習へ進み、モデルを選択し、パラメータを設定し、パフォーマンスと予算のニーズに基づいてGPUを選択します。プラットフォームが基盤となるクラウドインフラを処理します。

選択されたGPUインスタンスをプロビジョニングし、データセットを準備し、クラウドで学習ジョブを実行します。学習が進むにつれ、CUDA環境、PyTorchやTensorFlowなどのフレームワーク、ハードウェアを管理することなく、メトリクス、ログ、システムパフォーマンスをリアルタイムで監視できます。

Ultralytics PlatformにおけるGPU学習の主要機能

以下は、Ultralytics PlatformでのクラウドGPU学習の主要機能です:

- ワンクリック学習: 最小限のセットアップで学習ジョブを開始し、複雑な構成なしでデータセットからモデル学習へと迅速に移行できます。

- オンデマンドGPU: ニーズに合わせてさまざまなGPUオプションから選択し、長期契約なしで必要に応じてリソースをスケールできます。

- リアルタイム監視: ライブチャートやログで学習の進捗を追跡し、GPU使用率やメモリなどのシステムメトリクスをリアルタイムで表示できます。

- 自動チェックポイント: 学習の進捗が一定間隔で保存されるため、必要に応じて作業を簡単に再開または復元できます。

- 簡単なデプロイ:学習が完了したら、学習済みモデルをデプロイし、共有推論API、専用エンドポイント、または外部システムで使用するためのエクスポートを通じて、アプリケーションやワークフローで活用できます。これらのデプロイオプションにより低遅延推論が可能になり、ビデオ分析、自動化システム、対話型AIソリューションなどのリアルタイムアプリケーションを実現できます。

Ultralytics PlatformにおけるさまざまなクラウドGPUオプション

プラットフォームでの学習の仕組みがわかったところで、利用可能なGPUオプションを見ていきましょう。選択するGPUは、モデルの学習速度、パフォーマンス、コストに影響を与えます。

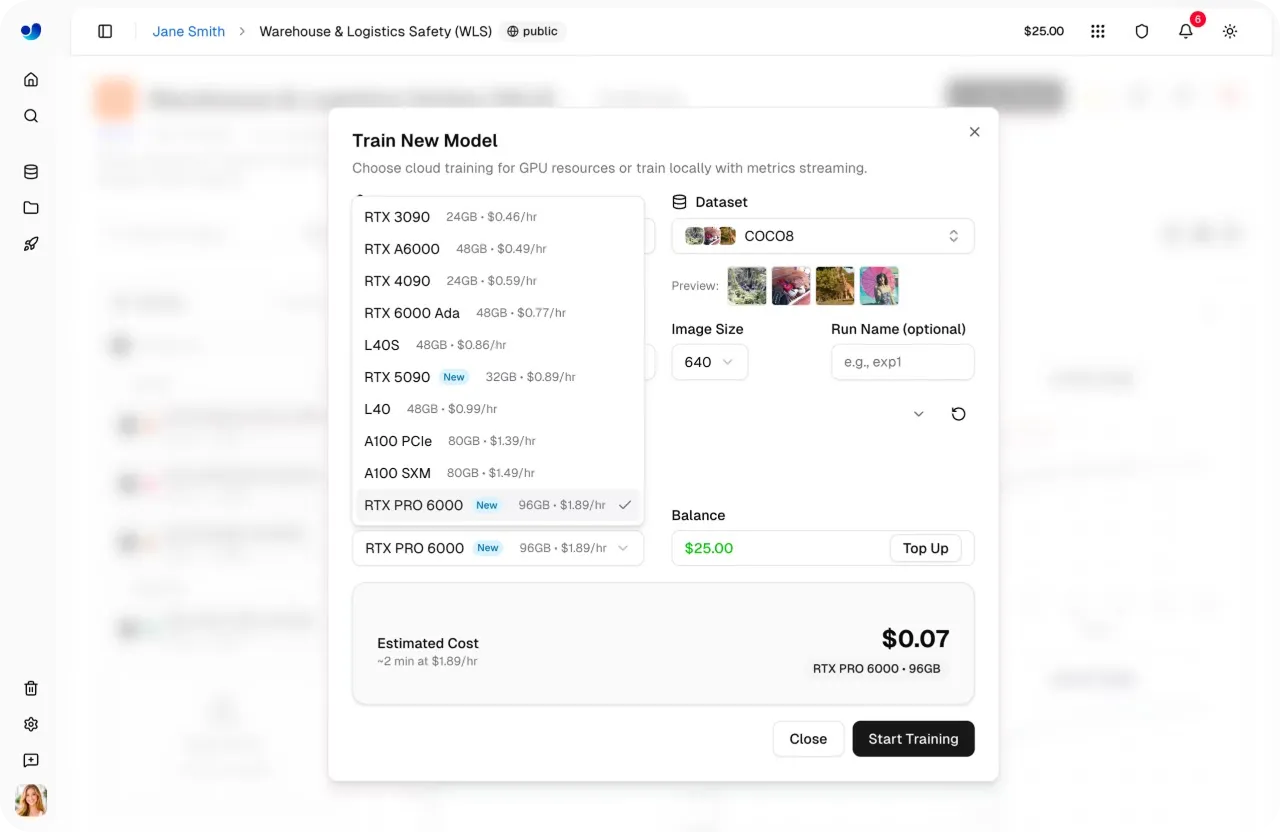

Ultralytics Platformでは、RTX 2000 AdaやRTX A4500などのオプションから始まり、RTX 4000 Ada、RTX A5000、RTX 3090、RTX A6000といったGPUを経て、RTX 4090やRTX PRO 6000といったさらに強力なオプションまで、幅広いGPUを取り揃えています。

図2:Ultralytics PlatformでサポートされるさまざまなGPUオプションの例 (ソース)

多くのユーザーにとって、RTX PRO 6000はバランスの取れた標準的な選択肢です。このGPUは、ほとんど調整を必要とせず、さまざまなワークロードにおいて安定したパフォーマンスを発揮します。RTX 4090も人気のオプションであり、価格に対して優れたパフォーマンスを提供します。

迅速な実験やプロトタイピング、軽量なデータセットを扱うといった小規模なタスクには、RTX 2000 AdaやRTX A4500のようなGPUが適しています。ワークロードが拡大するにつれて、RTX 4000 Ada、RTX A5000、RTX 3090といったオプションが、一般的な学習においてより一貫したパフォーマンスを提供します。

ハイエンドでは、A100 (Ampere)、H100やH200 (Hopper)、B200 (Blackwell)といったGPUが大規模ワークロード向けに設計されています。これらは、非常に大きなモデルの学習、膨大なデータセットの処理、または速度とパフォーマンスが不可欠なジョブの実行に最適です。

GPUの種類とその用途についての理解

次に、GPUのタイプごとの比較と最適な用途について見ていきましょう。

NVIDIAのRTX GPUは、一般的にコスト効率が高く、日常的な学習や実験、小規模から中規模のワークロードによく使用されます。パフォーマンスとアクセシビリティのバランスが取れており、幅広い用途に適しています。

それに対し、A100、A40、L40などのGPUは、より負荷の高いワークロードや大規模な学習向けに設計されています。特に大規模なデータセットやより複雑なモデルを扱う際に、高い安定性とスケーラビリティを提供します。

ハイエンドでは、H100やNVIDIAのBlackwellアーキテクチャベースのGPUが、最新のAIハードウェアを代表する存在です。これらは高パフォーマンスなワークロード向けに設計されており、一般的に大規模な学習、高度な研究、または時間的制約のあるタスクで使用されます。

Ultralytics Platformで利用可能なGPUオプションは、さまざまなワークロードに対して柔軟性を提供します。要件に応じて、小さなセットアップから始めて、必要に応じてスケールアップすることができます。

プロジェクトに適したクラウドGPUの選び方

Ultralytics Platformでのクラウド学習用にGPUを選択する際には、データセットサイズ、モデルの複雑さ、コストなど、考慮すべき要素がいくつかあります。それぞれの要素について詳しく見ていきましょう。

データセットサイズに合わせたGPUパワーの適合

GPU選びの主要な要素の一つはデータセットのサイズです。これは学習時間と必要な計算量に影響するためです。

1,000画像未満の小規模なデータセットであれば、RTX 2000のような軽量なGPUで十分な場合が多いです。これは迅速な実験や短時間の学習実行に適しています。

1,000から10,000画像程度の中規模データセットには、RTX 4090やRTX A6000のようなGPUがパフォーマンスと効率のより良いバランスを提供し、長時間の遅延なしにスムーズな学習を助けます。

10,000画像を超える大規模なデータセットでは、学習時間を妥当な範囲に収めるために、より強力なハードウェアが必要になる可能性が高いです。H100のようなGPUは、より負荷の高いワークロードを処理し、効果的にスケールさせるのに適しています。

全体として、データセットのサイズを、必要な計算パワーと並列処理能力のレベルに合わせることが重要です。

モデルのサイズと複雑さに基づいたGPUの選択

GPUを選択する際のもう一つの重要な要素は、ビジョンAIモデルのサイズと複雑さです。モデルのサイズによって、計算に必要なパワーが異なります。

例えば、小型モデルは必要なGPU計算パワーが少なく、RTX 2000 Ada、RTX A4500、あるいはより高速な結果を求めるならRTX 4090のようなGPUで効率的に実行できます。これらは迅速な実験、プロトタイピング、単純なタスクに最適で、高い計算コストをかけずに反復的な試行やアイデアの検証が可能です。

一方で、大規模で複雑なモデルには、より多くのメモリと処理能力が要求されます。RTX A6000、RTX PRO 6000、そしてH100のようなハイエンドのオプションが、こうしたワークロードには適しています。これらはより大きなアーキテクチャを処理し、学習時間を短縮し、メモリ不足の問題を防ぐことができます。これは高解像度画像、大きなバッチサイズ、あるいはより高度なモデル設計を扱う際に特に重要です。

バッチサイズとGPUメモリの比較

同様に、バッチサイズもモデル学習において重要な役割を果たします。バッチサイズとは、モデルが単一のステップで一度に処理する学習サンプルの数を指します。

バッチサイズを大きくすると、一度に処理するデータ量が増え学習効率が向上しますが、その分より多くのGPUメモリ(VRAM)が必要になります。一般的に、メモリ帯域幅の広いGPUはより大きなバッチサイズをサポートできますが、メモリ容量の少ないGPUでは小さなバッチサイズが必要になる場合があります。

例えば、RTX A6000、RTX PRO 6000、A100のようなGPUは、その大容量メモリにより大きなバッチサイズを扱いやすい一方で、RTX 4090やRTX 2000 Adaのようなオプションでは、ワークロードに応じて小さなバッチサイズが必要になる場合があります。

しかし、必ずしも最高スペックのGPUが必要というわけではありません。ハイエンドのGPUは速度やキャパシティを向上させますが、その分コストも高くなります。多くの場合、小型のGPUでバッチサイズを調整する方が効率的な選択となることもあります。

最終的には、モデルとデータセットに基づき、バッチサイズ、利用可能なGPUメモリ、そしてコストの適切なバランスを見つけることが目標です。

学習構成がGPUパフォーマンスに与える影響

GPUパフォーマンスに影響を与えるもう一つの要素は学習構成です。これにはエポック数、画像サイズ、モデルの学習方法を制御するその他の設定が含まれます。

例えば、画像サイズを大きくすると、ステップあたりの計算量が増加します。これにより学習が遅くなり、良好なパフォーマンスを維持するために、より多くの計算能力やメモリが必要になる場合があります。

同様に、エポック数を増やすと、特に性能の低いハードウェアでは全体の学習時間が長くなります。エポックとは、学習中にデータセット全体を一通りパスすることを指します。

データオーグメンテーションのような手法も、学習中の処理負荷を増加させます。データオーグメンテーションは、反転、回転、スケーリングなどの変換を適用することでデータの多様性を高め、モデルのパフォーマンスを向上させます。これはモデルの堅牢性を高める一方、学習速度を低下させる可能性があります。

一般的に、強力なGPUほどこれらの増加した負荷をより効率的に処理できますが、その影響は全体の構成とワークロードに依存します。

コストと学習時間のバランス

プロジェクト用のGPUを選択する際には、多くの場合、学習速度とGPU価格の間でトレードオフが発生します。

Ultralytics Platformでは、学習ジョブを開始する前にこれらのコストを見積もり、把握することができます。データセットサイズ、モデル、GPUを含む構成に基づいて、推定コストと学習時間を事前に確認できます。

図3:Ultralytics Platformはクラウドコストの見積もりと把握を容易にします。 (ソース)

高速なGPUは通常、時間あたりのコストが高くなりますが、全体の学習時間を短縮できます。RTX 4090、RTX PRO 6000、H100などのGPUは、一般的にその高いパフォーマンスにより、学習をより迅速に完了させることができます。

低速なGPUは時間あたりのコストが低い傾向にありますが、学習完了までに時間がかかります。例えば、RTX 2000 AdaやRTX A4500のようなGPUは、コスト低減を優先する場合や、長時間実行されるジョブ、小規模なワークロードでよく使用されます。

加えて、H200やB200のような最高クラスのGPUの一部はProまたはEnterpriseプランでのみ利用可能ですが、その他のほとんどのオプションはFreeティアでも利用可能です。

コスト最適化戦略についての考察

適切なGPUを選択することに加えて、学習コストを抑えるための実用的な方法がいくつかあります。最も効果的なアプローチの一つは、スケールアップする前に小さなテスト実行から始めることです。

いきなり本格的な学習に飛び込むのではなく、まずは少ないエポック数でセットアップが期待通りに動作するかを確認してください。これにより、データ、アノテーション、モデル構成を迅速に検証でき、有用な結果を得られない可能性のある実行に時間と計算リソースを費やすことを防げます。

学習が進むにつれてメトリクスを注視し、パフォーマンスが横ばいになったり、改善が止まったりした場合は、早期に実行を停止してください。学習曲線を監視することは、継続すべきか、それともセットアップを調整すべきかを判断する助けになります。

バッチサイズや画像サイズといったパラメータを調整することも可能です。値を小さくすることでメモリと計算の使用量が減り、スケーリングする前に、実験や異なる構成のテスト、小規模なシミュレーションを実行することがより実用的になります。

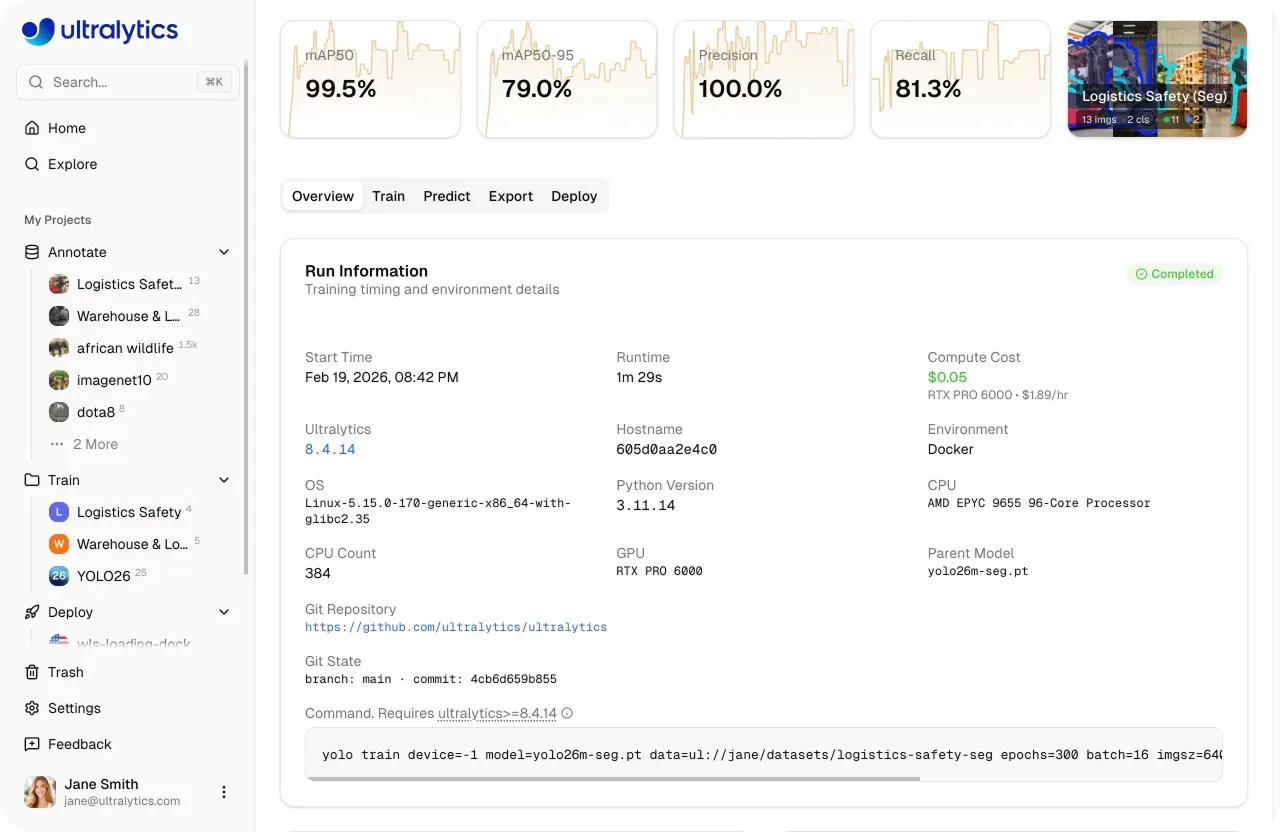

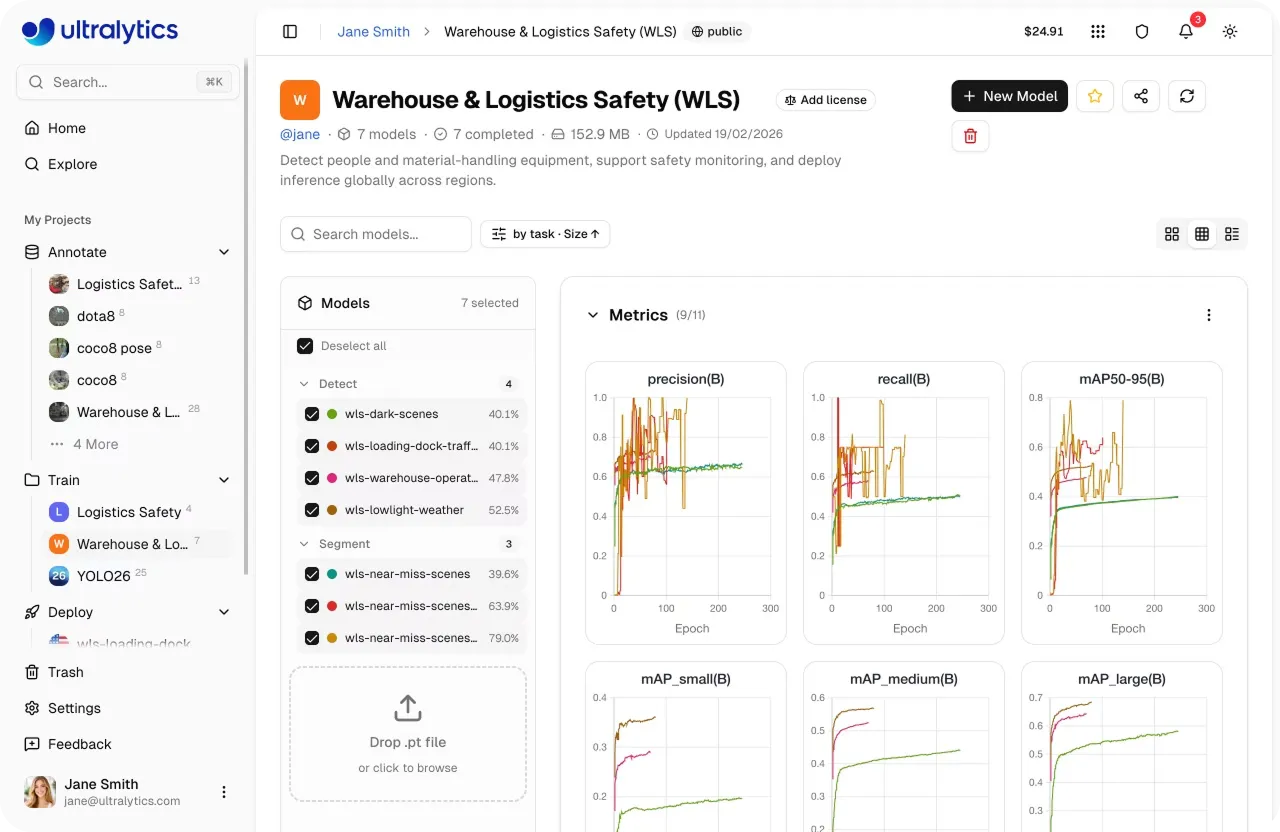

図4:Ultralytics Platformでの学習メトリクスの可視化 (ソース)

さらに、Ultralytics Platformはコスト管理を簡素化します。組み込みのコスト見積もり機能が提供されているため、ジョブを開始する前に予想される費用を把握できます。

従量課金制のクレジットベースのシステムにより、実際に使用した計算時間に対してのみ料金が発生します。これにより、予算内に収めやすく、学習セットアップに自信が持てた段階でスケールアップすることが容易になります。

コンピュータビジョンのためのクラウドGPU学習に関するベストプラクティス

Ultralytics PlatformでのクラウドGPU学習について、覚えておくべきベストプラクティスをいくつか紹介します:

- 学習前にデータセットを検証: 開始前にデータセットがクリーンで、適切にアノテーションされ、一貫性があることを確認してください。早期に問題を発見することで、無駄な計算を防ぎ、モデルのパフォーマンスを向上させることができます。

- まずはクイックな実験を実行: 小さなテスト実行や少ないエポック数から開始して、セットアップを検証してください。これにより、長く高価な学習ジョブにコミットすることなく、早期に問題を特定できます。ある意味で、すべてが期待通りに動作した後に再利用・スケール可能なテンプレートを作成していると言えます。

- 主要なメトリクスを監視: 学習全体を通じて、損失(loss)、mAP、精度(precision)、再現率(recall)などのメトリクスを追跡してください。これらのメトリクスはモデルのパフォーマンスを評価するベンチマークとして機能し、調整や停止のタイミングを判断する助けになります。

- データ処理パイプラインを効率的に保つ: データローディングと前処理が効率的であることを確認してください。これらの機能はCPUリソースに依存するため、ボトルネックとなって学習パフォーマンス全体に悪影響を及ぼす可能性があります。

- 組み込みツールを使用: チャート、コンソールログ、システムメトリクスを使用してリアルタイムで学習を監視し、迅速に情報に基づいた意思決定を行ってください。

重要なポイント

Ultralytics Platformでコンピュータビジョン用の適切なクラウドGPUを選択することは、データセットサイズ、モデルの複雑さ、学習構成を含むワークロードを理解することに集約されます。クラウドインフラと仮想マシンによって提供される幅広いGPUオプションにより、バランスの取れた選択から始めて、モデルの学習やファインチューニングのニーズが拡大するにつれてスケールアップが可能です。適切なハードウェアと、監視やコスト管理といった優れた実践を組み合わせることで、最先端の人工知能モデルを効率的に学習させつつ、高性能コンピューティングの柔軟性を最大限に活用することができます。

コンピュータビジョンの詳細については、成長を続けるコミュニティとGitHubリポジトリをチェックしてください。ビジョンソリューションの構築を検討されている場合は、ライセンスオプションをご覧ください。製造分野におけるコンピュータビジョンや農業におけるAIの利点について詳しく知るには、ソリューションページをご確認ください。