Ultralytics 、プログレッシブ損失バランス調整、小目標対応ラベル割り当て、およびMuSGDオプティマイザーを用いて、より信頼性の高いトレーニングを実現する方法を学びましょう。

.webp)

Ultralytics 、プログレッシブ損失バランス調整、小目標対応ラベル割り当て、およびMuSGDオプティマイザーを用いて、より信頼性の高いトレーニングを実現する方法を学びましょう。

.webp)

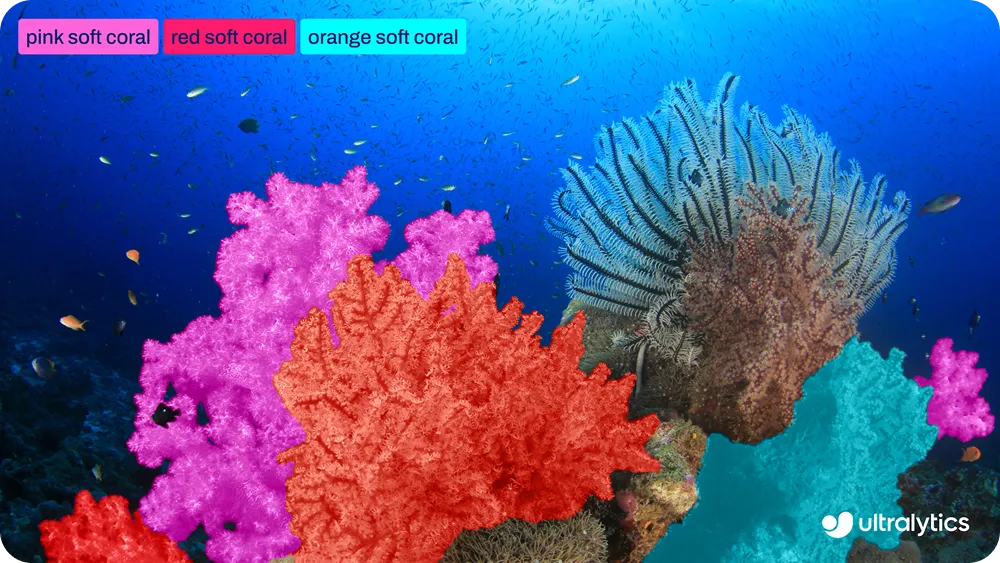

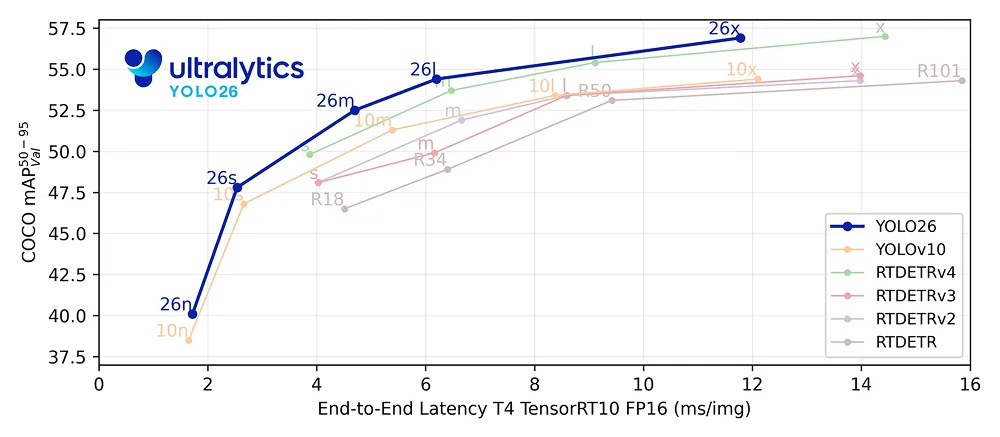

先週、Ultralytics リリースし、エッジファーストのリアルタイムコンピュータビジョンモデルにおける新たな基準を確立しました。Ultralytics YOLO と同様に、例えば Ultralytics YOLO11と同様に、YOLO26はユーザーが慣れ親しんだコアなコンピュータビジョンタスク、すなわち物体検出、インスタンスセグメンテーション、姿勢推定をサポートします。

しかし、YOLO26は単なる段階的な更新ではない。サポートされるタスクは既に見覚えがあるように見えるかもしれないが、この新しいモデルはコンピュータビジョンモデルの訓練方法において革新的な前進を意味する。YOLO26では、推論効率を超え、訓練の安定性向上に焦点が当てられている。

YOLO26は、トレーニングのライフサイクル全体を考慮して設計されました。これにより、収束が早くなり、トレーニングの実行がより信頼性高く、モデル挙動が一貫します。これらの改善は、トレーニングの信頼性がモデルの反復と展開の速度に直接影響する実世界のワークフローにおいて特に重要です。

これを実現するため、YOLO26ではプログレッシブ損失バランス調整(ProgLoss)、小目標対応ラベル割り当て(STAL)、MuSGD最適化アルゴリズムといった複数の特化型トレーニング手法を導入した。これらの変更により、学習損失のバランス調整方法、ラベルの割り当て方法、および時間経過に伴う最適化挙動が改善される。

本記事では、これらの各メカニズムがどのように機能し、Ultralytics の学習を容易にし、大規模環境での信頼性を高める理由について探ります。さっそく始めましょう!

Ultralytics 、非最大抑制などの後処理ステップへの依存を排除することで、推論パイプライン全体をネイティブに効率化します。多数の重複する予測を生成して後からフィルタリングする代わりに、YOLO26はネットワークから直接最終的な検出結果を出力します。

これによりYOLO26はエンドツーエンドモデルとなり、予測、重複解決、最終出力のすべてがネットワーク内部で学習される。これにより展開が簡素化され推論効率が向上すると同時に、トレーニング中のモデルの学習方法も形作られる。

このようなエンドツーエンドのシステムでは、学習と推論は密接に結びついています。予測を後から修正する外部後処理段階が存在しないため、モデルは学習段階そのものにおいて明確で確信に満ちた判断を下すことを学ばねばなりません。

これにより、学習目標と推論行動の整合性が特に重要となる。モデルの学習方法と推論時の使用方法の間に不一致があると、学習が不安定になったり収束が遅くなったりする可能性がある。

YOLO26は、最初から実世界の使用を想定したトレーニングプロセスを設計することでこの課題に対処します。推論速度のみに焦点を当てるのではなく、トレーニングシステムは長時間の安定した学習、NanoからExtra Largeまでのモデルサイズにおける一貫した収束、そして多様なデータセットでの堅牢な性能をサポートするように構築されています。

Ultralytics 主要なトレーニング革新の一つは、YOLO 二つのヘッドを用いたトレーニング手法を発展させたものです。物体検出モデルにおいて、ヘッドとは予測を行うネットワークの構成要素を指します。

言い換えれば、検出ヘッドは画像内の物体の位置と物体そのものを予測することを学習する。これはバウンディングボックス座標を回帰することで実現され、入力画像内の各物体の位置とサイズを推定することを学習することを意味する。

学習中、モデルは損失を最小化することで学習します。損失とは、モデルの予測が正解または真値からどれだけ離れているかを数値的に測る指標です。損失が小さいほどモデルの予測は真値に近く、損失が大きいほど誤差が大きいことを示します。損失の計算は、学習中にモデルがパラメータを更新する方法を導きます。

YOLO26は学習時に2つの検出ヘッドを使用し、これらは同じ基盤モデルを共有するが異なる目的を果たす。1対1ヘッドは推論時に使用されるヘッドである。各オブジェクトを単一の信頼性の高い予測と関連付けることを学習し、これはYOLO26のエンドツーエンドでNMS設計に不可欠である。

一方、1対多のヘッドは学習時のみ使用される。これにより同一オブジェクトに対して複数の予測を関連付けられ、より密な教師情報を提供する。この豊富な学習信号は、特に初期段階で学習の安定化と精度向上に寄与する。

YOLO26では、両方のヘッドがボックス回帰と分類に対して同一の損失計算を使用する。以前の実装では、学習全体を通じてこれら2つの損失信号の間に固定のバランスを適用していた。

しかし実際には、各要素の重要性は時間とともに変化する。初期段階では密な監督が最も有用であり、学習が進むにつれて推論行動との整合性がより重要となる。YOLO26はこの知見に基づいて設計されており、学習が進むにつれて学習信号のバランスを再調整する仕組みに直接つながっている。

では、Ultralytics トレーニング中のこうした変化する学習ニーズをどのように処理するのでしょうか? それは、学習信号の重み付けを時間経過とともに調整する「漸進的損失バランス調整」を採用しています。

ProgLossは、学習が進むにつれて各ヘッドが総損失に占める割合を動的に変化させることで機能します。初期段階では、学習の安定化と再現性の向上を図るため、一対多ヘッドに重点が置かれます。学習が進むにつれ、そのバランスは徐々に一対一ヘッドへと移行し、学習過程を推論動作により密接に整合させます。

この段階的な移行により、YOLO26は適切な順序で学習できます。競合する目的関数を一度に最適化させる代わりに、Progressive Loss Balancingは学習の各段階で最も有用な学習信号を優先します。その結果、収束がより滑らかになり、不安定な学習実行が減少し、最終的な性能がより一貫したものとなります。

Ultralytics 一つの興味深い学習改善点は、モデルが予測に対して学習ターゲットを割り当てる方法、すなわちラベル割り当てと呼ばれるプロセスにあります。これは、真の物体(ground truth objects)を予測候補(しばしばアンカーと呼ばれる)に一致させる役割を担っています。

これらの一致が、どの予測が監視対象となり損失関数に寄与するかを決定する。YOLO26は、既存のラベル割り当て手法であるタスクアラインメント学習(TAL)を基盤として構築されており、これは学習中の分類と位置特定をより適切に整合させるために設計されたものである。

TALはほとんどのオブジェクトに対して良好に機能するが、トレーニングにより重要な制限が明らかになった。マッチング処理において、非常に小さなオブジェクトが完全に除外される可能性がある。実際、640ピクセルの入力画像において約8ピクセル未満のオブジェクトは、アンカー割り当てを全く受けられないことが頻繁に発生した。この場合、モデルはそれらのオブジェクトに対してほとんど、あるいは全く教師情報を得られないため、detect 確実にdetect 学習することが困難となる。

この問題に対処するため、YOLO26はSmall-Target-Aware Label Assignment(STAL)を導入する。STALは割り当てプロセスを修正し、トレーニング中に小さな物体が無視されないようにする。具体的には、8ピクセル未満の物体に対して最低4つのアンカー割り当てを強制する。これにより、微小な物体であっても一貫してトレーニング損失に寄与することが保証される。

STALは小型ターゲットに対する監視を強化することで、小型または遠方の物体が頻繁に存在するシナリオにおける学習の安定性と検出性能を向上させます。この改善は、航空写真、ロボティクス、モノのインターネット(IoT)システムなど、物体が小型・遠方・部分的にしか見えないことが多く、信頼性の高い検出が極めて重要なエッジファーストYOLO26アプリケーションにおいて 特に重要です。

より安定かつ予測可能なトレーニングを支援するため、Ultralytics と呼ばれる新しいオプティマイザを導入しました。このオプティマイザは、特にモデルサイズとトレーニングの複雑さが増す中で、エンドツーエンド検出モデルの収束性とトレーニングの信頼性を向上させるよう設計されています。

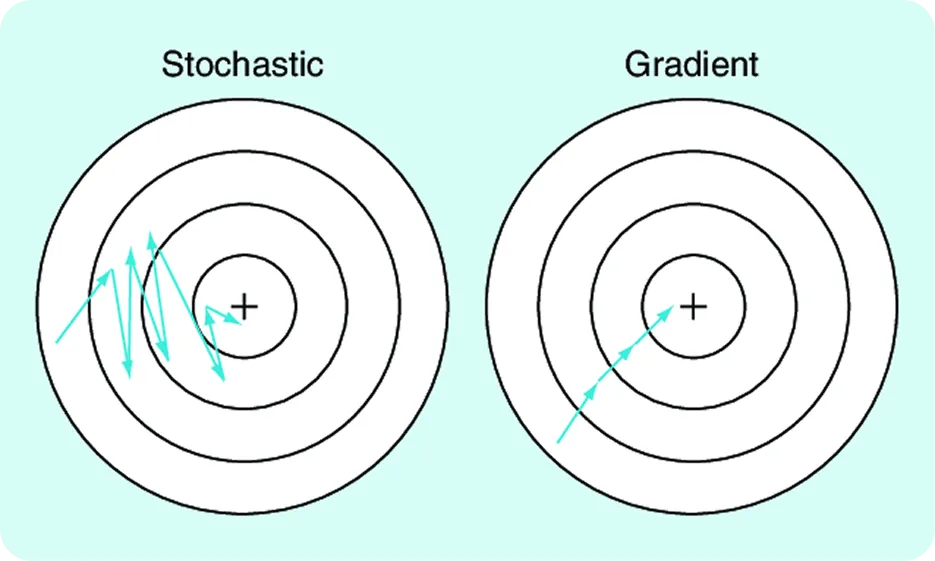

ニューラルネットワークが学習し、その結果として重みを適切に変更するためには、トレーニング中に誤差(損失とも呼ばれる)を計算する。したがってモデルは、損失値を用いて予測の誤りを測定し、パラメータがどのように変化すべきかを示す勾配を計算し、その後誤差を減少させるためにそれらのパラメータを更新する。確率的勾配降下法(SGD)は、これらの更新を実行する広く用いられる最適化アルゴリズムであり、トレーニングを効率的かつスケーラブルにする。

MuSGDは、大規模言語モデル訓練で用いられる手法であるMuonに着想を得た最適化アイデアを取り入れることで、この既知の基盤をさらに発展させます。これらのアイデアは、より構造化されたパラメータ更新を通じて改良された訓練挙動を示したMoonshot AIのKimi K2など、近年の進歩に影響を受けています。

YOLO26はハイブリッド更新戦略を採用している。一部のパラメータはミューオンインスパイアードSGD組み合わせた方法で更新され、他のパラメータSGD を用いて更新される。これにより、YOLO26は最適化プロセスに追加の構造を導入しつつ、SGD を支えてきた頑健性と汎化特性を維持することが可能となる。

その結果、モデルサイズを問わず、より滑らかな最適化、より速い収束、より予測可能な学習挙動が実現され、MuSGDがYOLO26の学習容易性と大規模環境での信頼性向上に重要な役割を果たしている理由となっています。

Ultralytics トレーニング革新技術は、エンドツーエンド設計、NMS、エッジファースト設計といった主要機能と相まって、モデルのトレーニングを容易にし、大規模環境での信頼性を高めます。では、これがコンピュータビジョンアプリケーションにとって具体的に何を意味するのか、疑問に思われるかもしれません。

実際の運用では、コンピュータービジョンを実際に稼働する場所に導入する作業が大幅に容易になります。モデルのトレーニングはより予測可能になり、サイズを問わず一貫したスケーラビリティを発揮し、新たなデータセットへの適応も簡素化されます。これにより、実験とデプロイメントの間の摩擦が軽減され、特に信頼性と効率性が純粋な性能と同等に重視される環境において効果を発揮します。

例えば、ロボティクスや産業用ビジョンアプリケーションでは、環境やセンサー、タスクの変化に伴いモデルを頻繁に再学習させる必要がある。YOLO26を用いることで、チームは不安定なトレーニング実行やモデルサイズ間での挙動の不一致を気にすることなく、より迅速に反復作業を進められる。

信頼性の高いコンピュータビジョンシステムは、モデルの推論時の性能と同様に、その学習方法にも依存する。YOLO26は、学習信号のバランス調整、微小物体の処理方法、最適化プロセスの進め方を改善することで、トレーニングの安定性とスケーラビリティを向上させた。この信頼性の高いトレーニングへの注力は、特にエッジファーストアプリケーションにおいて、実験段階から実環境への展開を円滑に進めることを可能にする。

AIについて学びたいですか?詳細については当社のGitHubリポジトリをご覧ください。活発なコミュニティに参加し、物流分野のAIや 自動車産業におけるビジョンAIなどの分野における革新について知ることができます。今すぐコンピュータービジョンを始めるには、当社のライセンスオプションをご確認ください。

未来の機械学習で、新たな一歩を踏み出しましょう。