Détection des contours dans le traitement des images. Apprenez les algorithmes de Sobel, Canny et autres algorithmes de détection des contours afin de detect avec précision detect contours et d'obtenir une reconnaissance robuste des contours.

Détection des contours dans le traitement des images. Apprenez les algorithmes de Sobel, Canny et autres algorithmes de détection des contours afin de detect avec précision detect contours et d'obtenir une reconnaissance robuste des contours.

En tant qu'humains, nous reconnaissons naturellement les bords des objets, suivons leurs courbes et remarquons les textures sur leurs surfaces lorsque nous regardons une image. Pour un ordinateur, cependant, la compréhension commence au niveau des pixels individuels.

Un pixel, la plus petite unité d'une image numérique, stocke la couleur et la luminosité en un seul point. En suivant les variations des valeurs de ces pixels sur l'ensemble de l'image, un ordinateur peut detect motifs qui révèlent des détails essentiels.

En particulier, le traitement d'image utilise les données des pixels pour mettre en évidence les caractéristiques essentielles et supprimer les distractions. Une technique courante de traitement d'image est la détection des contours, qui identifie les points où la luminosité ou la couleur change brusquement pour délimiter les objets, marquer les frontières et ajouter de la structure.

Cela permet aux ordinateurs de séparer les formes, de mesurer les dimensions et d'interpréter la façon dont les parties d'une scène se connectent. La détection des contours est souvent la première étape de l'analyse d'image avancée.

Dans cet article, nous examinerons ce qu'est la détection de contours, comment elle fonctionne et ses applications concrètes. Commençons !

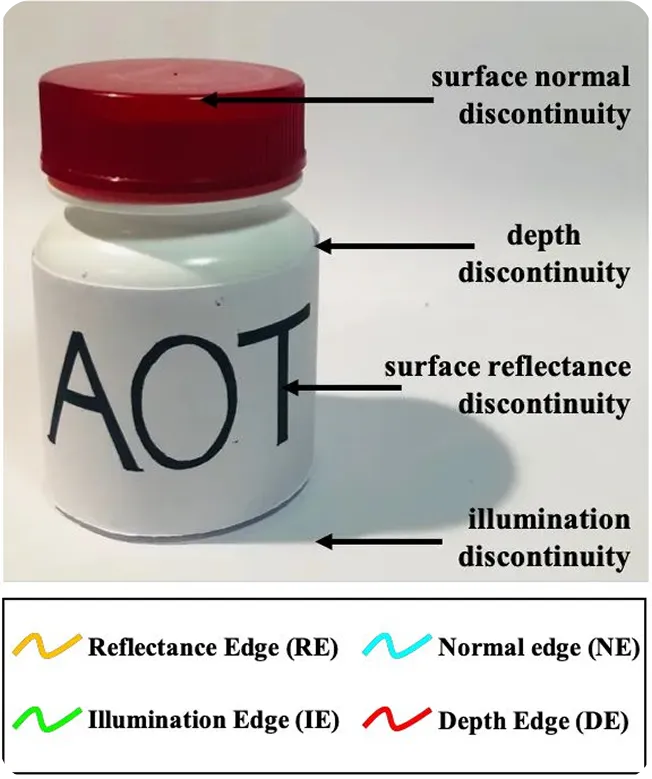

La détection des contours consiste à rechercher les endroits d'une image où la luminosité ou la couleur change sensiblement d'un point à l'autre. Si le changement est faible, la zone apparaît lisse. Si le changement est brusque, il marque souvent la limite entre deux régions différentes.

Voici quelques-unes des raisons pour lesquelles ces changements de pixels se produisent :

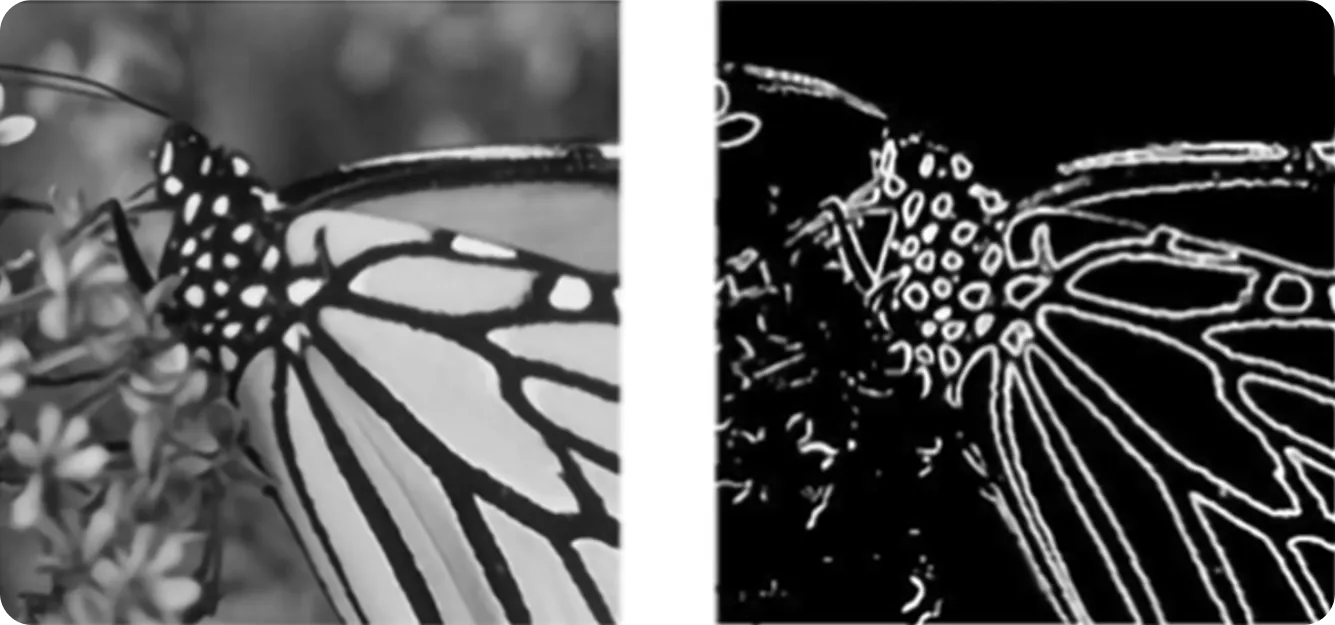

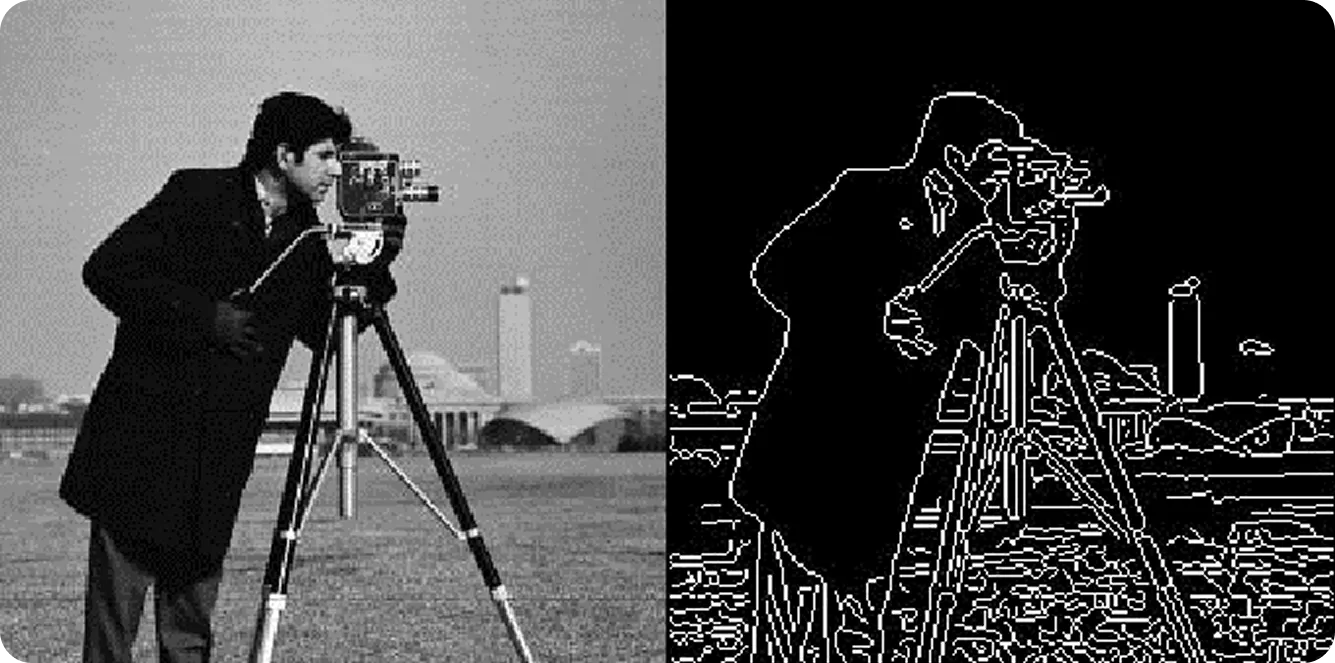

La détection des contours commence généralement par la transformation d'une image couleur en une image en niveaux de gris, de sorte que chaque point ne montre que la luminosité. Il est ainsi plus facile pour l'algorithme de se concentrer sur les différences de lumière et d'obscurité plutôt que sur la couleur.

Ensuite, des filtres spéciaux peuvent scanner l'image pour trouver les endroits où la luminosité change soudainement. Ces filtres calculent la pente de variation de la luminosité, appelée gradient. Un gradient plus élevé est causé par une plus grande différence entre les points proches, ce qui signale souvent un bord.

L'algorithme continue ensuite d'affiner l'image, en supprimant les petits détails et en ne conservant que les lignes et les formes les plus importantes. Le résultat est un contour clair et une image de sortie qui peuvent être utilisés pour une analyse plus approfondie.

Avant de nous plonger plus en détail dans la détection des contours, discutons de son évolution au fil du temps.

Le traitement d'image a commencé avec des méthodes simples basées sur des règles, telles que le seuillage et le filtrage, pour nettoyer et améliorer les images. À l'ère analogique, cela signifiait travailler avec des photographies ou des films en utilisant des filtres optiques, des loupes ou des traitements chimiques pour faire ressortir les détails.

Des techniques telles que l'ajustement du contraste, la réduction du bruit, le réglage de l'intensité de l'image et la détection de base des contours ont permis de rendre les images d'entrée plus claires et de mettre en évidence les formes et les textures. Dans les années 1960 et 1970, le passage du traitement analogique au traitement numérique a ouvert la voie à l'analyse moderne dans des domaines tels que l'astronomie, l'imagerie médicale et la surveillance par satellite.

Dans les années 1980 et 1990, des ordinateurs plus rapides ont permis de s'attaquer à des tâches plus complexes telles que l'extraction de caractéristiques, la détection de formes et la reconnaissance d'objets de base. Des algorithmes comme l'opérateur de Sobel et Canny ont offert une détection des bords plus précise, tandis que la reconnaissance de formes a trouvé des applications dans tous les domaines, de l'automatisation industrielle à la lecture de textes imprimés grâce à la reconnaissance optique de caractères.

Aujourd'hui, les progrès constants de la technologie ont conduit au développement de la vision par ordinateur. La vision artificielle, ou vision par ordinateur, est une branche de l'IA qui se concentre sur l'apprentissage des machines pour interpréter et comprendre les informations visuelles.

Alors que le traitement d'image traditionnel, comme le double seuillage (qui rend les images plus claires en conservant les bords forts et en supprimant les bords faibles) et la détection de contours, suivait des règles fixes et ne pouvait traiter que des tâches spécifiques, la vision par ordinateur utilise des modèles basés sur les données qui peuvent apprendre à partir d'exemples et s'adapter à de nouvelles situations.

De nos jours, les systèmes d'imagerie vont bien au-delà de la simple amélioration des images ou de la détection des contours. Ils peuvent reconnaître des objets, track mouvements et comprendre le contexte d'une scène entière.

L'une des techniques clés qui rend cela possible est la convolution. Une opération de convolution est un processus où de petits filtres (également appelés noyaux) scannent une image pour trouver des motifs importants comme les bords, les coins et les textures. Ces motifs deviennent les éléments de base que les modèles de vision par ordinateur utilisent pour reconnaître et comprendre les objets.

Par exemple, des modèles de vision par ordinateur comme Ultralytics YOLO11 utilisent ces caractéristiques basées sur la convolution pour effectuer des tâches avancées telles que la segmentation d'instances. Cette tâche est étroitement liée à la détection des contours, car la segmentation des instances nécessite de délimiter avec précision les frontières de chaque objet d'une image.

Alors que la détection des contours se concentre sur les changements d'intensité dans les pixels des contours pour marquer les contours des objets, la segmentation des instances s'appuie sur cette idée pour detect contours, classify et séparer chaque objet dans sa propre région.

Même avec l'essor de la vision par ordinateur, le traitement d'image reste un élément important de nombreuses applications. En effet, la vision par ordinateur s'appuie souvent sur des étapes de prétraitement d'image de base.

Avant de détecter des objets ou de comprendre une scène, les systèmes nettoient généralement l'image, réduisent le bruit et trouvent les contours pour faire ressortir les détails clés. Ces étapes rendent les modèles avancés plus précis et efficaces.

Ensuite, nous allons explorer quelques-uns des algorithmes de traitement d'image les plus couramment utilisés pour detect contours et leur fonctionnement.

La détection de contours de Sobel est une méthode clé utilisée pour trouver les contours des objets dans une image. Au lieu d'analyser chaque détail à la fois, elle se concentre sur les zones où la luminosité change brusquement d'un pixel au pixel voisin.

Ces changements soudains marquent généralement le point où un objet se termine et où un autre commence, ou où un objet rencontre l'arrière-plan. En isolant ces bords, Sobel transforme une image complexe en un contour plus propre, plus facile à traiter par d'autres systèmes pour des tâches telles que le suivi des mouvements, la détection des formes ou la reconnaissance des objets.

Vous pouvez considérer la détection de contours de Sobel comme un détecteur de gradient qui mesure la façon dont l'intensité change à travers une image. Au fond, cela fonctionne par le biais d'une opération de convolution : faire glisser de petites matrices, appelées noyaux, sur l'image et calculer les sommes pondérées des valeurs des pixels voisins.

Ces noyaux sont conçus pour accentuer les variations de luminosité le long des directions horizontales et verticales. Contrairement aux modèles d'apprentissage profond, où les noyaux sont appris à partir des données, Sobel utilise des noyaux fixes pour mettre en évidence efficacement les contours sans nécessiter d'entraînement.

Voici un aperçu plus détaillé du fonctionnement de la méthode de détection des contours de Sobel :

La détection des contours de Canny est une autre méthode populaire pour trouver les contours d'une image. Elle est connue pour produire des contours nets et précis. Contrairement aux techniques de détection de contours de base, elle suit une série d'étapes soigneusement conçues pour filtrer le bruit, affiner les limites et se concentrer sur les contours les plus importants.

Voici un bref aperçu du fonctionnement d'un détecteur de contours de Canny :

Parce qu'elle fournit des résultats précis tout en filtrant le bruit, la détection des contours de Canny est largement utilisée dans les domaines où la précision est importante. Par exemple, elle est utilisée dans des secteurs tels que l'imagerie médicale, la cartographie par satellite, la numérisation de documents et la vision robotique.

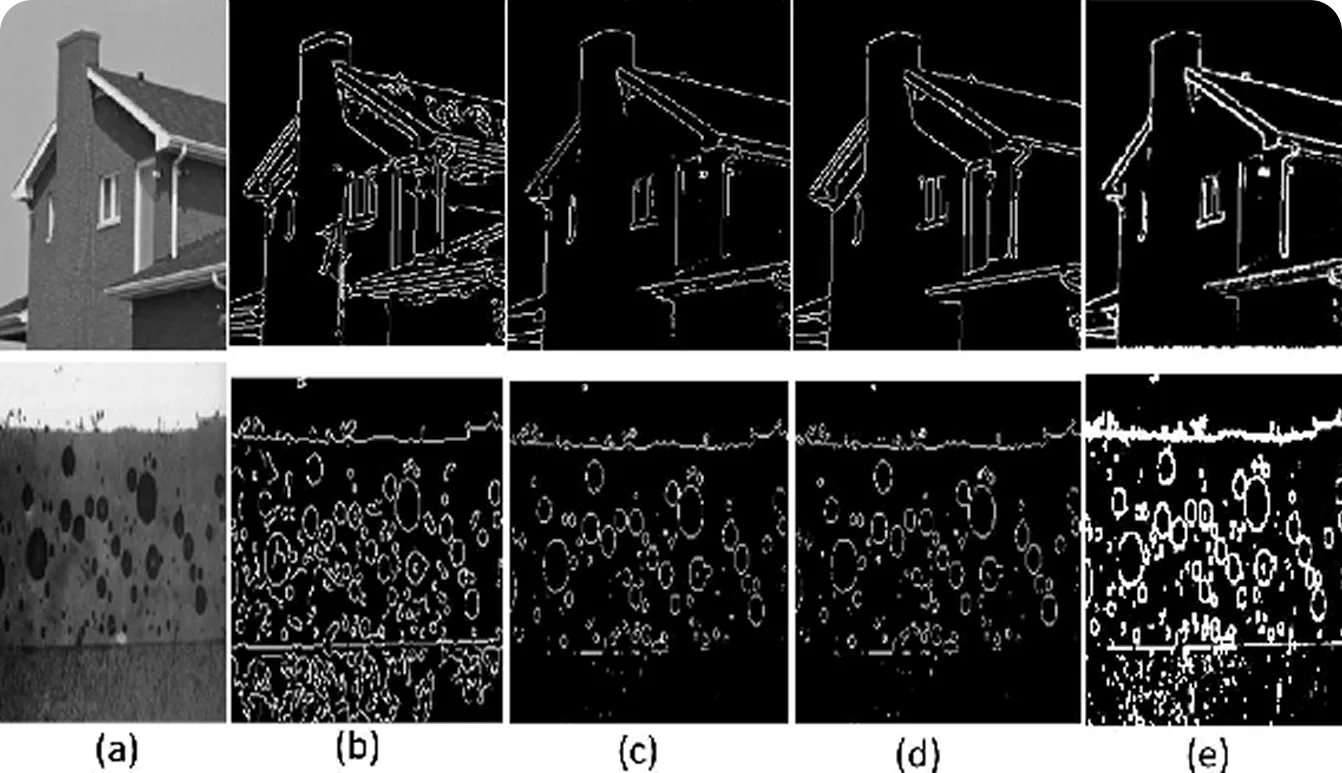

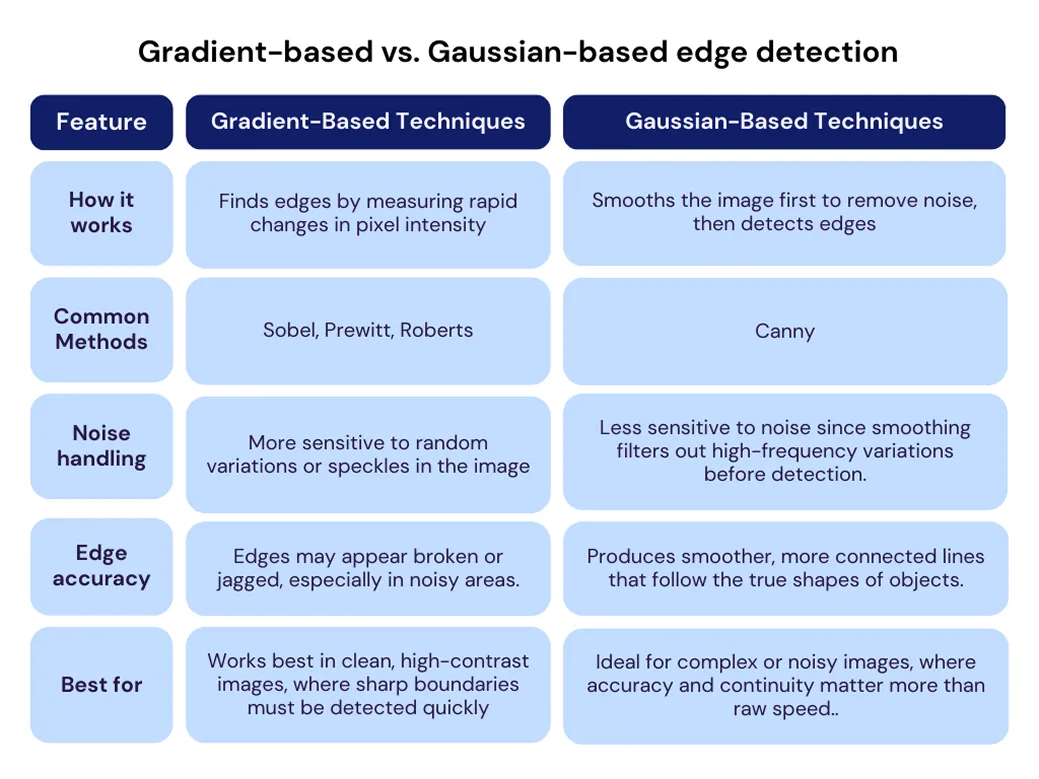

Jusqu'à présent, les deux exemples de détection de contours que nous avons examinés sont Sobel et Canny. Bien que les deux visent à trouver des contours, ils abordent le problème différemment.

Les méthodes basées sur le gradient (comme Sobel, Prewitt et Scharr) detect contours en recherchant les changements brusques de luminosité, connus sous le nom de gradient. Elles balayent l'image et marquent les endroits où ce changement est le plus fort. Ces méthodes sont simples, rapides et fonctionnent bien lorsque les images sont claires. Cependant, elles sont sensibles au bruit : de minuscules variations de luminosité peuvent être confondues avec des contours.

Les méthodes basées sur la gaussienne (comme Canny ou le laplacien du gaussien) ajoutent une étape supplémentaire pour résoudre ce problème : le floutage de l'image au préalable. Ce lissage, souvent effectué avec un filtre gaussien, réduit les petites variations qui pourraient créer de faux bords. Après le lissage, ces méthodes recherchent toujours des changements brusques de luminosité, mais les résultats sont plus propres et plus précis pour les images bruitées ou de faible qualité.

Maintenant que nous comprenons mieux le fonctionnement de la détection de contours, explorons ses applications concrètes.

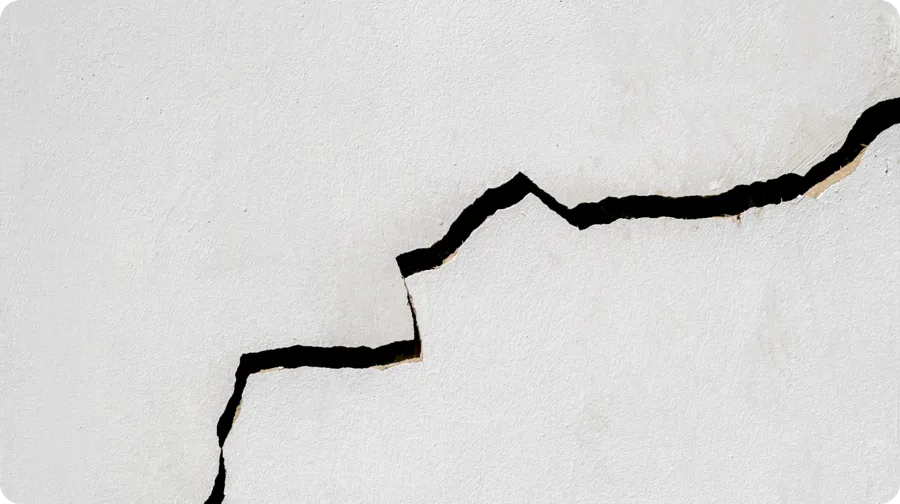

L'inspection de grandes structures en béton, telles que les ponts et les immeubles de grande hauteur, est souvent une tâche difficile et dangereuse. Ces structures peuvent s'étendre sur de longues distances ou atteindre de hautes altitudes, ce qui rend les inspections traditionnelles lentes, coûteuses et risquées. Ces inspections nécessitent généralement des échafaudages, un accès par corde, des mesures manuelles de près ou de la photographie.

Une approche intéressante a été explorée en 2019, lorsque des chercheurs ont testé une méthode plus sûre et plus rapide utilisant des drones équipés de caméras haute résolution pour capturer des images d'entrée détaillées des surfaces en béton. Ces images ont ensuite été traitées avec diverses techniques de détection de contours pour identifier automatiquement les fissures.

L'étude a montré que cette méthode réduisait considérablement la nécessité d'un accès humain direct aux zones dangereuses et accélérait les inspections. Cependant, sa précision dépendait toujours de facteurs tels que les conditions d'éclairage, la clarté de l'image et le fonctionnement stable du drone. Dans certains cas, un examen humain était encore nécessaire pour éliminer les faux positifs.

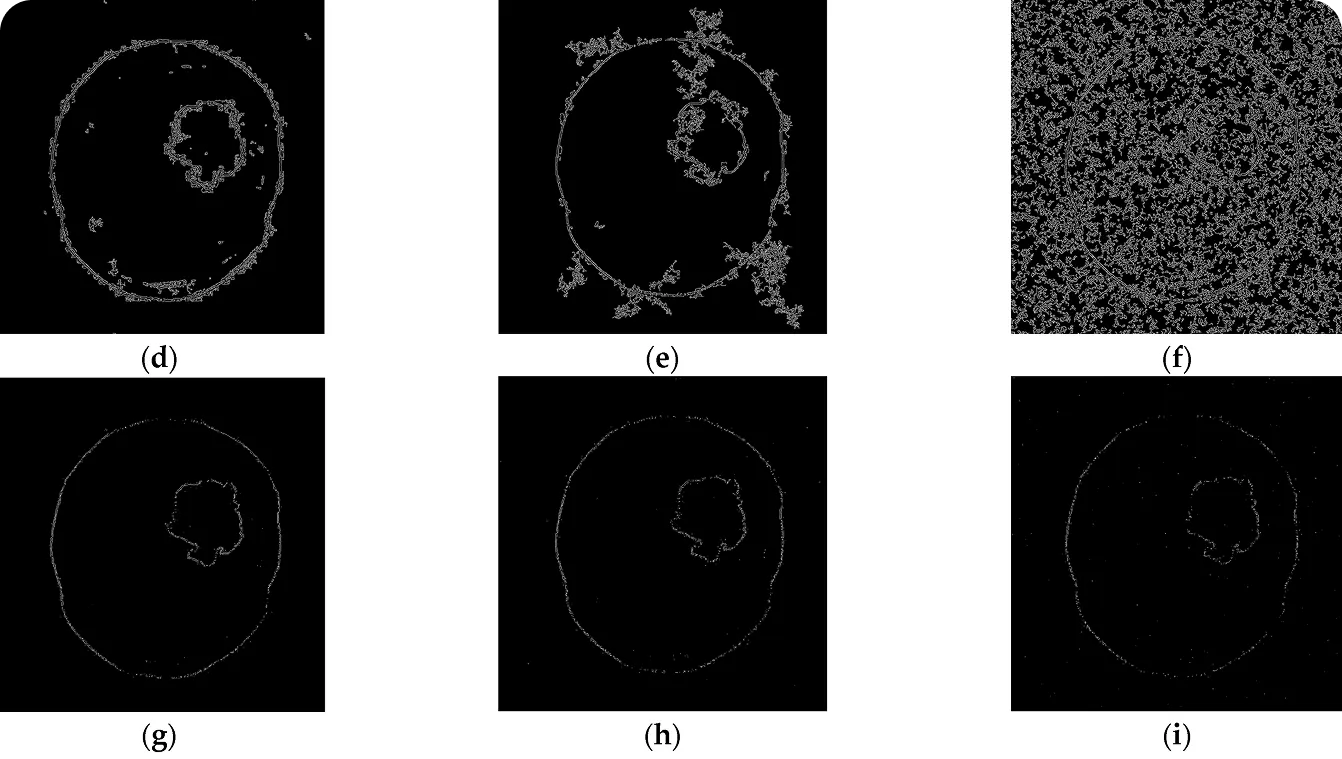

Les radiographies et les IRM contiennent souvent des perturbations visuelles appelées bruit, qui peuvent rendre les détails fins plus difficiles à voir. Cela devient un défi pour les médecins lorsqu'ils essaient de repérer les bords d'une tumeur, de tracer le contour d'un organe ou de surveiller des changements subtils au fil du temps.

Une étude récente d'imagerie médicale a testé la performance des méthodes courantes de détection de contours, telles que Sobel, Canny, Prewitt et Laplacian, sur des images bruitées. Les chercheurs ont ajouté différents types et niveaux de bruit aux images et ont vérifié avec quelle précision chaque méthode pouvait délimiter les caractéristiques importantes.

Canny produisait généralement les contours les plus nets, même en cas de bruit important, mais ce n'était pas le meilleur dans tous les cas. Certaines méthodes fonctionnaient mieux avec certains types de bruit, il n'y a donc pas de solution unique parfaite.

Ceci souligne l'importance des technologies telles que la vision par ordinateur. En combinant des algorithmes avancés et des modèles d'IA de vision, ces solutions peuvent aller au-delà de la simple détection de contours pour fournir des résultats plus précis et fiables, même dans des conditions difficiles.

Voici quelques-uns des avantages de l'utilisation de la détection de contours et du traitement d'image :

Bien qu'il existe de nombreux avantages à la détection de contours dans le traitement d'images, elle s'accompagne également de quelques défis. Voici quelques-unes des principales limitations à prendre en compte :

La détection des contours s'inspire de la façon dont nos yeux et notre cerveau travaillent ensemble pour donner un sens au monde. En ce qui concerne la vision humaine, des neurones spécialisés du cortex visuel sont très sensibles aux contours, aux lignes et aux limites.

Ces indices visuels nous aident à déterminer rapidement où un objet se termine et où un autre commence. C'est pourquoi même un simple dessin au trait peut être instantanément reconnaissable : notre cerveau s'appuie fortement sur les contours pour identifier les formes et les objets.

La vision par ordinateur vise à imiter cette capacité, mais va plus loin. Des modèles comme Ultralytics YOLO11 vont au-delà de la simple mise en évidence des contours et de l'amélioration de l'image. Ils sont capables de detect objets, d'en tracer les contours avec précision et de track mouvements en temps réel. Ce niveau de compréhension plus approfondi les rend essentiels dans les scénarios où la détection des contours ne suffit pas.

Voici quelques tâches clés de vision par ordinateur prises en charge par YOLO11 , qui s'appuient sur la détection des contours et vont au-delà :

La détection des fissures dans les infrastructures et les biens industriels est un bon exemple d'amélioration par vision artificielle d'une application qui s'appuyait traditionnellement sur la détection des contours. Les modèles de vision par ordinateur tels que YOLO11 peuvent être entraînés à identifier avec précision les fissures sur les routes, les ponts et les oléoducs. La même technique peut également être appliquée à la maintenance des avions, à l'inspection des bâtiments et au contrôle de la qualité de la fabrication, ce qui permet d'accélérer les inspections et d'améliorer la sécurité.

La détection des contours a parcouru un long chemin, des premières méthodes simples aux techniques avancées capables de repérer même les limites subtiles dans des images complexes. Elle permet de faire ressortir les détails importants, de mettre en évidence les zones clés et de préparer les images à une analyse plus approfondie, ce qui en fait un élément essentiel du traitement d'image.

En vision par ordinateur, la détection des contours joue un rôle important dans la définition des formes, la séparation des objets et l'extraction d'informations utiles. Elle est utilisée dans de nombreux domaines tels que l'imagerie médicale, les inspections industrielles, la conduite autonome et la sécurité pour fournir une compréhension visuelle précise et fiable.

Rejoignez notre communauté et explorez notre dépôt GitHub pour en savoir plus sur l'IA. Si vous cherchez à démarrer votre propre projet d'IA de vision, consultez nos options de licence. Découvrez plus d'applications telles que l'IA dans le secteur de la santé et l'IA de vision dans le commerce de détail en visitant nos pages de solutions.

Commencez votre parcours avec l'avenir de l'apprentissage automatique