Choisir le bon périphérique de périphérie pour ton projet de vision par ordinateur

Découvre comment choisir le bon appareil edge pour ton projet de vision par ordinateur en fonction des performances, de l'efficacité énergétique et des exigences de déploiement.

L'Edge AI devient rapidement l'une des tendances les plus importantes de l'intelligence artificielle et de la vision par ordinateur. Elle apporte l'intelligence en temps réel directement sur les appareils, au lieu de dépendre du cloud computing, où les données sont envoyées à un autre endroit pour être traitées. En fait, le marché mondial de l'Edge AI devrait atteindre environ 143,06 milliards de dollars d'ici 2034.

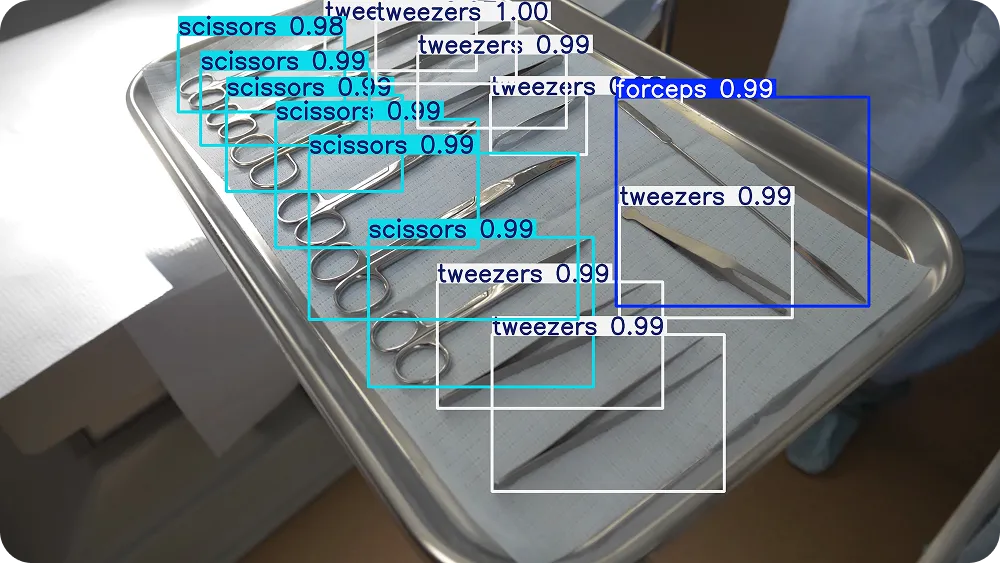

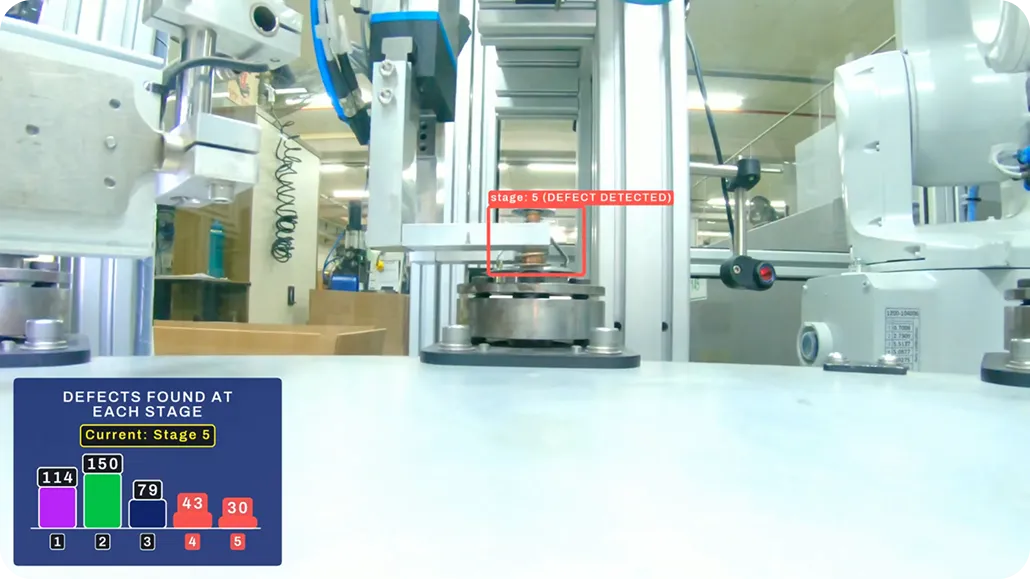

Grâce aux récentes avancées technologiques, l'Edge AI redéfinit l'automatisation en temps réel basée sur la vision dans de nombreuses industries. L'inspection qualité dans la fabrication en est un excellent exemple.

Ici, les caméras de vision par IA analysent en continu les produits sur un tapis roulant. Elles peuvent être utilisées pour détecter rapidement des défauts et des anomalies. C'est particulièrement crucial dans les secteurs qui exigent une grande précision, comme la fabrication d'instruments chirurgicaux.

Fig 1. Un exemple d'utilisation de la vision par IA pour détecter des instruments chirurgicaux

Mais que sont exactement les appareils de périphérie (edge devices) ? Ce sont des systèmes matériels capables d'exécuter des modèles d'IA et des modèles de vision par ordinateur, tels que Ultralytics YOLO26, à l'endroit ou près de l'endroit où les données sont générées.

Cela peut être dans un atelier d'usine, à l'intérieur d'une caméra intelligente ou à bord de véhicules autonomes. En effectuant l'inférence localement, ces appareils permettent des temps de réponse plus rapides. Ils réduisent également l'utilisation de la bande passante car les données visuelles n'ont pas besoin d'être diffusées vers le cloud.

Cependant, choisir le bon appareil de périphérie pour ton projet de vision par ordinateur peut être délicat. Le matériel qui fonctionne bien dans un environnement peut ne pas être adapté à un autre.

Par exemple, un appareil qui fonctionne de manière fiable dans une usine pourrait ne pas convenir aux inspections par drone, où les contraintes de poids et d'alimentation sont très différentes. Choisir le mauvais appareil peut augmenter les coûts, ralentir les déploiements et compliquer la mise à l'échelle.

C'est pourquoi les équipes devraient évaluer des facteurs tels que la taille de l'appareil, l'enveloppe énergétique, les limites thermiques et la disponibilité industrielle, plutôt que de se concentrer uniquement sur la puissance de calcul. Dans cet article, nous explorerons l'Edge AI et comment choisir le bon appareil pour ton application de vision par ordinateur. Commençons !

Principaux avantages de l'utilisation d'appareils de périphérie

Avant de plonger dans la façon de choisir le bon appareil pour ton projet spécifique de vision par IA, prenons un peu de recul pour discuter de certains des avantages de l'utilisation d'appareils de périphérie pour les projets de vision par IA.

Voici quelques-uns des principaux avantages du déploiement de la vision par IA à la périphérie :

- Performances en temps réel : Les données sont traitées à l'endroit ou près de l'endroit où la caméra est déployée, permettant des réponses instantanées pour des cas d'usage comme la détection de défauts, le contrôle de sécurité et la robotique. Ce traitement local favorise la prise de décision en temps réel, permettant aux systèmes de réagir immédiatement aux conditions changeantes sans dépendre d'une connexion cloud.

- Réduction des coûts de bande passante : Au lieu de diffuser des vidéos brutes vers le cloud, les appareils de périphérie transmettent uniquement des métadonnées, des alertes ou des informations pertinentes. Cela réduit considérablement la charge réseau et les frais de stockage cloud.

- Fonctionne hors ligne : La plupart des systèmes de périphérie peuvent continuer à fonctionner même avec une connexion internet instable ou limitée, ce qui est fréquent dans les usines, les entrepôts et les environnements distants.

- Meilleure confidentialité : Les données vidéo restent sur place, facilitant le respect des exigences en matière de confidentialité et de conformité tout en réduisant l'exposition d'informations sensibles.

- Mise à l'échelle facile sur de nombreux sites : Les architectures de périphérie réduisent la dépendance vis-à-vis d'une infrastructure cloud centralisée. Cela permet aux équipes de reproduire la même configuration sur plusieurs sites avec des performances cohérentes.

Comprendre les exigences de ton application

La première étape pour choisir le bon appareil de périphérie est de comprendre ce dont ton application a réellement besoin. Le matériel que tu sélectionnes doit correspondre à ce que le système est censé faire, à la vitesse à laquelle il doit fonctionner et à l'endroit où il sera déployé.

Tu peux commencer par définir les exigences de performance. Alors que certaines solutions nécessitent une inférence d'IA en temps réel à un FPS (images par seconde) élevé, d'autres peuvent traiter des images par groupes ou par lots.

La complexité et la taille du modèle jouent également un rôle important. Les modèles légers de détection d'objets peuvent souvent s'exécuter sur des appareils plus petits et à faible consommation, tandis que des modèles plus complexes et lourds ou des pipelines en plusieurs étapes nécessitent plus de puissance de calcul et de mémoire.

Ensuite, examine ta configuration de données. Cela inclut la résolution de la caméra, la fréquence d'images, le nombre de flux parallèles et les types de capteurs comme RGB, thermique ou de profondeur. Ces facteurs affectent directement la bande passante, le débit, l'utilisation de la mémoire et la charge globale du système.

Le compromis précision vs latence

Au-delà des exigences matérielles et de données, la sélection du modèle joue un rôle essentiel dans les performances globales du système. La plupart des déploiements en périphérie impliquent un compromis entre latence et précision. Les modèles de haute précision sont généralement plus intensifs en calcul et peuvent augmenter le temps d'inférence.

Les modèles plus rapides, en revanche, peuvent sacrifier un peu de précision. L'objectif est de trouver le bon équilibre entre vitesse et précision en fonction de ton cas d'usage spécifique et de tes contraintes opérationnelles.

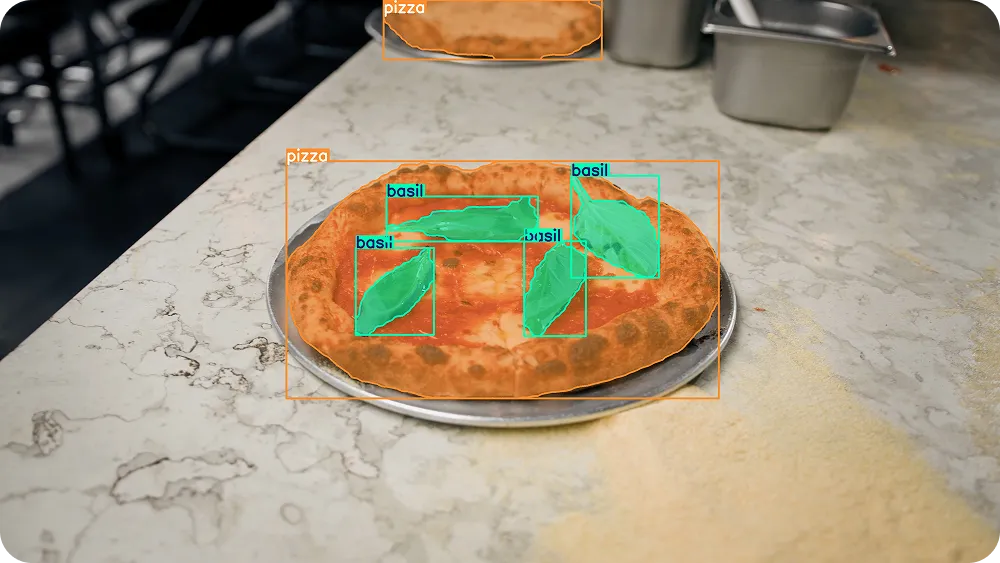

Par exemple, dans les chaînes de production alimentaire automatisées, les systèmes de vision par ordinateur sont utilisés pour inspecter les produits avant qu'ils ne soient emballés et expédiés. Ces systèmes doivent fonctionner en temps réel pour éviter de ralentir le tapis roulant.

Considère une chaîne de montage de pizzas, où le système doit vérifier que chaque pizza possède les bons ingrédients. Un modèle comme Ultralytics YOLO26 peut détecter la pizza et ses ingrédients en temps réel, identifiant les éléments manquants ou incorrects. Dans ce scénario, le modèle doit être suffisamment précis pour détecter les erreurs tout en étant suffisamment rapide pour suivre les vitesses de production sur le matériel de périphérie.

Fig 2. Utilisation de Ultralytics YOLO26 pour détecter et segmenter une pizza et ses ingrédients.

Considère la taille de l'appareil de périphérie

Outre les performances de calcul, la taille physique de l'appareil est un autre facteur important dans la planification du déploiement. Le facteur de forme de l'appareil (sa taille physique, sa forme, son style de montage et ses interfaces d'extension) influence directement sa facilité d'intégration dans l'environnement et ses performances dans des conditions réelles.

Types d'appareils Edge AI et leurs facteurs de forme

Le matériel d'Edge AI se décline en de nombreux facteurs de forme, allant des serveurs montés en rack et des cartes accélératrices Peripheral Component Interconnect Express (PCIe) aux modules M.2 compacts, plates-formes System-on-Module (SoM), ordinateurs monocarte (SBC), caméras intelligentes et même capteurs de vision intelligents avec traitement IA sur puce. Chaque format offre différents compromis en termes de performance, d'efficacité énergétique, de conception thermique et de complexité d'intégration.

La taille de l'appareil est étroitement liée aux exigences de refroidissement, à la disponibilité de l'énergie et à l'architecture globale du système. Les systèmes plus grands, tels que les PC industriels montés en rack ou les stations de travail en tour, prennent généralement en charge les GPU PCIe pleine hauteur, plusieurs cartes d'extension et un refroidissement actif. Ces plates-formes sont bien adaptées au traitement multi-caméras, aux hubs de périphérie centralisés ou à l'analyse vidéo à haut débit.

En revanche, les facteurs de forme compacts tels que les accélérateurs M.2, les SoM montés sur des cartes porteuses personnalisées, les SBC ou les caméras intelligentes tout-en-un sont conçus pour les environnements à espace restreint. Ces petits appareils privilégient souvent l'efficacité énergétique et le refroidissement passif, ce qui les rend idéaux pour les systèmes embarqués, les robots mobiles, les drones, les kiosques et les unités d'inspection distribuées.

À l'extrême de la miniaturisation, certains déploiements reposent sur des capteurs de vision intelligents ou des plates-formes basées sur microcontrôleur (TinyML), où l'inférence s'exécute directement sur le capteur d'image ou le processeur basse consommation. Ces systèmes réduisent considérablement l'encombrement physique et la consommation d'énergie, mais sont généralement adaptés à des charges de travail plus étroites et hautement optimisées.

Ces différences de taille, de modularité et de modèle d'intégration mènent généralement à deux catégories courantes de déploiement en périphérie : les déploiements évolutifs et les déploiements à espace restreint. Chaque approche répond à différentes contraintes de performance, d'énergie et environnementales tout en façonnant la maintenabilité à long terme et la conception du système.

Déploiements évolutifs

Les accélérateurs PCIe et les ordinateurs personnels (PC) montés en rack ou industriels sont couramment utilisés lorsqu'un projet nécessite une puissance de calcul élevée ou doit traiter les données de plusieurs caméras simultanément. Un accélérateur PCIe est une carte matérielle installée à l'intérieur d'un ordinateur plus grand via un emplacement PCIe.

Il ajoute des ressources de calcul dédiées, telles qu'une unité de traitement graphique (GPU) ou un autre accélérateur d'IA, pour augmenter la capacité du système à gérer les charges de travail IA. C'est similaire à la façon dont une carte graphique améliore les performances d'un ordinateur de bureau.

Les PC montés en rack ou industriels sont des systèmes plus grands et renforcés, conçus pour un fonctionnement continu dans des environnements tels que les usines, les zones de production ou les salles de contrôle. Ils offrent plus d'espace pour le refroidissement, l'extension matérielle et les composants à plus haute puissance, ce qui les rend bien adaptés aux charges de travail exigeantes telles que l'inspection qualité multi-caméras ou l'analyse vidéo à grande échelle.

Déploiements à espace restreint

Les déploiements à espace restreint sont courants dans les environnements où un appareil de périphérie doit fonctionner dans des limites physiques, thermiques ou énergétiques étroites. Cela inclut souvent les caméras intelligentes montées sur les lignes de production, les robots mobiles, les drones, les kiosques ou les systèmes d'inspection compacts.

Dans ces cas-là, le matériel doit être petit, léger et économe en énergie tout en offrant des performances d'IA fiables. Deux options matérielles courantes pour ces déploiements sont les modules M.2 et les ordinateurs monocarte.

Un module M.2 est une carte d'extension compacte qui s'insère dans un emplacement M.2 à l'intérieur d'un système hôte. Bien que M.2 soit simplement un facteur de forme et une norme d'interface, certains modules sont conçus spécifiquement pour l'accélération IA.

Ces modules accélérateurs d'IA permettent aux petits appareils d'exécuter des modèles de vision par ordinateur plus efficacement sans augmenter de manière significative la taille ou la consommation d'énergie. Les accélérateurs M.2 sont souvent intégrés dans des systèmes embarqués où l'ajout d'une carte d'extension PCIe pleine taille ne serait pas pratique.

Pendant ce temps, un ordinateur monocarte est un ordinateur complet construit sur une seule carte de circuit imprimé. Il intègre le CPU, la mémoire, les interfaces de stockage et les connexions d'entrée/sortie (E/S) dans un facteur de forme compact. Comme tout est contenu sur une seule carte, les SBC sont largement utilisés dans les applications embarquées et de périphérie où l'espace est limité et la simplicité importante.

Bien que les systèmes à espace restreint offrent généralement moins de performances de calcul brutes que les systèmes plus grands montés en rack, ils permettent une inférence sur l'appareil proche de l'endroit où les données sont générées. Cela réduit la latence, diminue l'utilisation de la bande passante et améliore la flexibilité de déploiement dans les environnements où le matériel plus grand ne pourrait pas tenir.

Accélération d'IA dédiée pour la vision embarquée

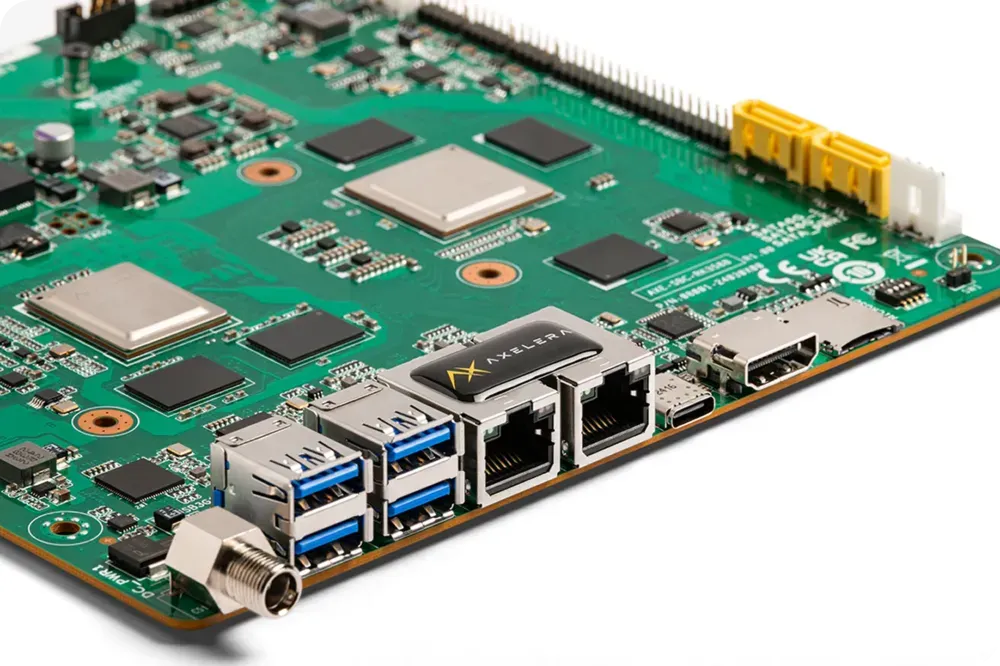

De nombreux fournisseurs de matériel se concentrent spécifiquement sur l'accélération d'IA compacte et économe en énergie pour la vision embarquée. Par exemple, Axelera AI propose des accélérateurs Metis® AI Processing Unit (AIPU) dans plusieurs facteurs de forme, notamment des cartes PCIe, des modules M.2 et des cartes de calcul intégrées pour les déploiements à espace restreint.

Grâce à une intégration avec Ultralytics, les modèles YOLO pris en charge tels que Ultralytics YOLOv8 et YOLO26 peuvent être exportés au format Axelera en utilisant le package Python Ultralytics et optimisés via le Voyager SDK, qui gère la compilation et la quantification INT8 pour une inférence efficace en périphérie.

Fig 3. Un aperçu de l'unité de traitement IA Metis d'Axelera AI (Source)

Prends en compte la consommation d'énergie

La consommation d'énergie est également une contrainte clé dans les déploiements en périphérie car elle affecte directement la génération de chaleur et les exigences de refroidissement. Elle détermine si le système peut fonctionner de manière fiable à l'intérieur d'enceintes scellées ou de boîtiers industriels compacts.

Cela devient particulièrement vital dans les environnements alimentés par batterie tels que les robots mobiles, les drones ou les stations de surveillance distantes, où chaque watt (W) impacte l'autonomie et la stabilité globale du système.

La plupart des appareils de périphérie appartiennent à trois grands paliers de puissance. Voici un examen plus approfondi de chacun d'eux :

- Appareils basse consommation (<10W) : Ils sont généralement utilisés dans les systèmes embarqués où une taille compacte et un refroidissement passif sont requis.

- Appareils milieu de gamme (10–50W) : Ces appareils sont courants dans les passerelles de périphérie et les points de terminaison d'usine qui nécessitent un débit plus élevé tout en fonctionnant dans des limites thermiques contrôlées.

- Appareils haute puissance (>50W) : Ces appareils sont généralement des accélérateurs PCIe ou des PC industriels conçus pour le traitement multi-caméras et les lourdes charges de travail. Ils sont souvent associés à un refroidissement actif et à des boîtiers plus grands.

Il est important de garder à l'esprit que les caractéristiques de la charge de travail jouent un rôle majeur dans la détermination du palier de puissance approprié. Des fréquences d'images plus élevées, des modèles de vision plus grands et plusieurs flux de caméra parallèles augmentent tous la demande de calcul, ce qui à son tour augmente la consommation d'énergie.

De nos jours, de nombreux fournisseurs de matériel se concentrent sur l'accélération d'IA économe en énergie. Par exemple, les modules de périphérie de DEEPX sont conçus pour une inférence basse consommation dans les déploiements en périphérie. Les processeurs Intel offrent également des fonctionnalités de gestion et de mise à l'échelle de l'énergie qui permettent d'ajuster les performances en fonction des exigences environnementales et de charge de travail.

Tiens compte de la disponibilité industrielle et du support du cycle de vie

Disons que tu as terminé avec succès un déploiement pilote. Le modèle fonctionne bien, le matériel répond aux exigences de performance et le système fonctionne de manière fiable lors des tests.

Le défi suivant est de passer cette solution en production complète. C'est là que la disponibilité industrielle et le support du cycle de vie deviennent critiques.

La plupart des systèmes de périphérie sont censés fonctionner en continu pendant des années. Sélectionner du matériel qui pourrait être abandonné peu après le déploiement introduit un risque important. Même si un appareil fonctionne bien pendant un projet pilote, il peut devenir une responsabilité s'il atteint sa fin de vie ou devient difficile à approvisionner une fois la production lancée.

Les cycles de vie courts sur le marché peuvent créer des perturbations de la chaîne d'approvisionnement, augmenter les coûts de maintenance et forcer des refontes inattendues. Dans les déploiements sur plusieurs sites, le remplacement de composants indisponibles peut ralentir l'expansion et compliquer la gestion du système.

Le matériel conçu pour un usage industriel offre généralement des délais de production plus longs, des politiques de cycle de vie plus claires et un support continu pour le micrologiciel ou les logiciels. Cette stabilité facilite la mise à l'échelle des déploiements sans changements matériels majeurs en milieu de cycle.

Avant de finaliser un appareil de périphérie, les équipes peuvent examiner la feuille de route du fabricant, ses engagements en matière de cycle de vie et sa stratégie de support à long terme.

L'importance de l'expertise de l'équipe et de la facilité d'utilisation

Le choix et le déploiement d'un appareil de périphérie dépendent également de l'expérience de ton équipe. Certaines plates-formes sont plus faciles à prendre en main et fournissent une documentation claire, des étapes d'installation simples et des outils prêts à l'emploi. D'autres offrent un meilleur contrôle sur les performances mais nécessitent des connaissances techniques plus approfondies et plus de temps consacré à l'optimisation et au débogage.

Par exemple, le package Python Ultralytics permet d'entraîner, de tester et de déployer facilement des modèles comme YOLO26. Il simplifie les tâches courantes et prend également en charge l'exportation des modèles vers différents formats utilisés dans les déploiements en périphérie. Cela permet aux équipes de passer plus facilement du développement au matériel réel sans avoir à reconstruire leur flux de travail à partir de zéro.

Pour les équipes qui débutent avec l'Edge AI, un écosystème logiciel solide et bien documenté peut réduire le temps de développement et limiter les risques de déploiement. Les équipes plus expérimentées peuvent préférer les plates-formes qui permettent une personnalisation et un réglage plus poussés, surtout dans les applications nécessitant un traitement multi-caméras ou des exigences strictes en matière de latence.

En résumé, les écosystèmes de fournisseurs et les outils peuvent faire une différence significative. Une documentation claire, un support actif et des options de déploiement flexibles aident les équipes à passer plus facilement des projets pilotes aux systèmes de production complets.

Facteurs clés de déploiement en périphérie qui ont tendance à être négligés

Maintenant que nous avons couvert les principaux facteurs impliqués dans le choix d'un appareil de périphérie, passons en revue quelques détails pratiques qui peuvent faire une grande différence dans les déploiements réels. Ces considérations peuvent ne pas sembler urgentes au premier abord, mais elles jouent souvent un rôle essentiel dans la prise de décision et façonnent le bon déroulement d'un projet une fois qu'il dépasse le stade du pilote.

E/S, bande passante et compatibilité logicielle

La connectivité et la compatibilité des E/S sont souvent parmi les premiers défis pratiques des déploiements en périphérie. En règle générale, un appareil de périphérie doit prendre en charge ta configuration de caméra et de capteur, y compris les interfaces courantes comme USB 3.0, GigE avec Power over Ethernet (PoE) et MIPI.

Les systèmes de vision industriels peuvent également nécessiter des déclencheurs matériels, des signaux de synchronisation ou un support de synchronisation spécifique pour garantir un fonctionnement fiable.

La bande passante est un autre facteur critique, en particulier dans les configurations multi-caméras. Même de petits écarts entre la sortie de la caméra et la capacité d'entrée de l'appareil peuvent réduire le débit ou introduire une latence supplémentaire.

La compatibilité logicielle joue également un rôle crucial. Certains déploiements reposent sur des frameworks d'inférence légers tels que NCNN et MNN, qui sont couramment utilisés dans les environnements mobiles et embarqués.

Dans les déploiements de capteurs intelligents, des appareils comme le Sony IMX500 intègrent le traitement IA directement sur le capteur d'image, réduisant ainsi le transfert de données et la latence. Dans ces cas-là, la compatibilité des modèles et le support d'exportation deviennent particulièrement importants, car le modèle doit être converti dans un format pris en charge par la chaîne d'outils du capteur.

Par exemple, le package Python Ultralytics prend en charge l'exportation de modèles tels que Ultralytics YOLO11 vers des formats compatibles avec les pipelines de déploiement en périphérie, y compris les plates-formes construites autour d'appareils comme le Sony IMX500.

Fiabilité thermique et environnementale

Lorsque les appareils de périphérie traitent continuellement des données visuelles, la fiabilité thermique et environnementale devient un facteur critique. Dans ce contexte, la fiabilité signifie que l'appareil peut fonctionner pendant de longues périodes sans surchauffe ni défaillance, même dans des conditions difficiles telles que la poussière, les vibrations ou les températures extrêmes.

À mesure que les charges de travail Edge AI deviennent plus exigeantes, l'efficacité thermique est devenue un facteur déterminant dans la conception du système. Cette importance accordée aux performances thermiques a été mise en avant au CES 2026 à Las Vegas, où DeepX a fait fonctionner des charges de travail IA identiques sur plusieurs puces avec un petit morceau de beurre placé sur le dessus.

Alors que les puces concurrentes généraient suffisamment de chaleur pour faire fondre le beurre, l'appareil de périphérie DeepX ne l'a pas fait, illustrant comment une consommation d'énergie plus faible et une stabilité thermique plus forte peuvent directement affecter la fiabilité dans le monde réel.

La conception du refroidissement joue un rôle central dans le maintien de performances stables. À mesure que les processeurs travaillent plus dur, ils génèrent de la chaleur, et cette chaleur doit être gérée efficacement.

Dans de nombreux environnements industriels, le refroidissement passif est préféré car les ventilateurs mécaniques peuvent s'user ou tomber en panne avec le temps, surtout dans les environnements poussiéreux ou à fortes vibrations. Les dissipateurs thermiques en aluminium sans ventilateur sont couramment utilisés pour dissiper la chaleur sans dépendre de pièces mobiles, ce qui améliore la durabilité à long terme.

Les conditions environnementales peuvent également avoir un impact. Chaque appareil a une plage de température de fonctionnement nominale, et les déploiements dans des armoires scellées ou des emplacements extérieurs peuvent piéger la chaleur ou exposer le matériel à des fluctuations de température. Dans ces cas-là, la conception de l'enceinte et le flux d'air deviennent tout aussi importants que la puissance de calcul brute.

Écosystème logiciel et préparation au déploiement

Lors de la sélection du bon appareil de périphérie, la force de son écosystème logiciel est tout aussi critique que ses spécifications matérielles. Un appareil peut offrir de bonnes performances de calcul sur le papier, mais sans outils fiables et support de plate-forme, le passage du prototype à la production peut devenir lent et complexe.

Une plate-forme bien prise en charge rationalise l'ensemble du chemin de déploiement, de la préparation du modèle à l'inférence optimisée sur le matériel cible. Les écosystèmes qui fournissent des outils intégrés pour la quantification, le réglage des performances et le débogage facilitent la validation des modèles sous des charges de travail réelles et réduisent les problèmes inattendus lors du déploiement.

Par exemple, les modèles Ultralytics YOLO comme YOLO26 peuvent être exportés directement au format OpenVINO, permettant une inférence optimisée sur les CPU Intel, les GPU intégrés et les unités de traitement neuronal (NPU). OpenVINO fournit des optimisations de performances telles que la conversion de modèle, la quantification (y compris FP16 et INT8) et l'exécution hétérogène sur le matériel Intel pris en charge.

En utilisant le package Python Ultralytics, les équipes peuvent exporter des modèles avec une simple commande et exécuter l'inférence soit via l'interface de haut niveau d'Ultralytics, soit directement avec le runtime natif OpenVINO, créant un flux de travail de déploiement rationalisé et prêt pour la production pour les systèmes de périphérie basés sur Intel.

Performances réelles sous charge

De nombreux appareils de périphérie semblent impressionnants sur le papier, mais les performances peuvent changer une fois qu'ils exécutent un pipeline de vision complet. Dans les déploiements réels, le système ne se contente pas d'exécuter l'inférence.

Il gère également le prétraitement, le post-traitement et parfois plusieurs flux de caméra en même temps. Pour cette raison, il est important de regarder au-delà de la moyenne des images par seconde.

Une latence constante est souvent plus importante qu'une performance de pointe. Surveiller les goulots d'étranglement de la mémoire et vérifier la stabilité du système sous une charge constante donne une image plus claire de ses performances en production.

Il est utile de tester le temps de démarrage à froid, la haute performance à long terme sur des heures de fonctionnement et le comportement de l'appareil lorsque d'autres tâches s'exécutent parallèlement à l'inférence, comme l'encodage, la journalisation ou la gestion réseau. Dans la plupart des cas réels, une performance stable et prévisible est plus vitale que des pics de vitesse occasionnels.

Sécurité, cycle de vie et gestion après déploiement

Les déploiements en périphérie doivent rester sécurisés et fiables au fil du temps, surtout dans des environnements comme la fabrication, où les systèmes doivent fonctionner en continu. Des fonctionnalités telles que le démarrage sécurisé, le stockage chiffré et les mises à jour régulières des fournisseurs aident à protéger les appareils contre les altérations et réduisent le risque de vulnérabilités ou de temps d'arrêt inattendus.

La gestion des appareils après déploiement est tout aussi importante que la sélection du matériel approprié. Les capacités de surveillance et de mise à jour à distance permettent aux équipes de maintenir les logiciels, le micrologiciel et les modèles sans avoir besoin d'un accès physique à chaque appareil. Cela devient de plus en plus crucial à mesure que les projets passent d'un petit pilote à un déploiement à plus grande échelle.

À mesure que les déploiements se développent, la gestion centralisée du parc aide à garder tout organisé. Cela facilite le suivi de l'état des appareils, la gestion des mises à jour, la surveillance des performances et le dépannage des problèmes sur plusieurs sites pour les équipes. Sans une stratégie de gestion claire, maintenir des dizaines, voire des centaines de systèmes en périphérie peut rapidement devenir difficile.

Applications réelles courantes de la vision par ordinateur et de l'IA en périphérie

Alors que tu considères les facteurs impliqués dans la sélection du bon appareil en périphérie, tu te demandes peut-être où ces systèmes sont réellement utilisés. Aujourd'hui, l'IA en périphérie alimente des applications dans presque tous les secteurs, de la fabrication et du commerce de détail à la robotique et aux infrastructures intelligentes.

Voici cinq cas d'utilisation courants de l'apprentissage profond où les appareils en périphérie permettent une faible latence, une réduction de la consommation de bande passante et un traitement fiable sur l'appareil :

- Surveillance de la sécurité sur les sites industriels : Les pipelines de vision par ordinateur déployés sur du matériel informatique en périphérie peuvent fournir des alertes instantanées pour la conformité aux équipements de protection individuelle (EPI), ce qui signifie qu'ils détectent automatiquement si les travailleurs portent l'équipement de sécurité requis comme des casques, des gants, des gilets de sécurité ou des lunettes, en plus d'identifier les comportements dangereux. Cela améliore la fiabilité opérationnelle en réduisant les incidents sur le lieu de travail tout en gardant les données vidéo sensibles traitées en toute sécurité sur place.

- Analytique de détail : Les appareils en périphérie peuvent traiter les données visuelles localement pour la gestion des stocks, la disponibilité en rayon et la détection des files d'attente, réduisant ainsi la bande passante et les coûts cloud tout en restant rentables et évolutifs dans de nombreux magasins.

- Robotique : En robotique, l'IA sur l'appareil permet la détection d'objets en temps réel et la navigation autonome. Par exemple, les appareils en périphérie NVIDIA Jetson peuvent fournir des plateformes informatiques compactes accélérées par GPU qui permettent aux robots d'exécuter des modèles de vision par ordinateur comme YOLO26 localement, offrant des performances à faible latence tout en maintenant l'efficacité énergétique.

- Villes intelligentes et surveillance du trafic : Les déploiements de villes intelligentes peuvent utiliser des processeurs de vision par ordinateur en périphérie pour l'analyse du flux de trafic en temps réel, la détection d'incidents et la surveillance de la sécurité des piétons. En évitant le streaming vidéo continu vers le cloud, ces systèmes réduisent les besoins en bande passante et améliorent les temps de réponse.

- Inspection de qualité dans la fabrication : Sur les lignes de production, les appareils en périphérie peuvent inspecter les produits en temps réel pour détecter les défauts, les composants manquants ou les erreurs d'assemblage avant que les articles ne poursuivent sur le tapis roulant. Ces systèmes peuvent exécuter des modèles tels que YOLO26 sur des CPU, des GPU ou des accélérateurs d'IA dédiés, en fonction du débit et des contraintes énergétiques.

Fig 4. YOLO26 peut être déployé en périphérie pour détecter des défauts dans des usines de fabrication.

Points clés

Sélectionner le bon appareil en périphérie pour ton projet de vision par ordinateur implique d'équilibrer la performance, l'efficacité énergétique, la fiabilité et la disponibilité à long terme. Plutôt que de se concentrer uniquement sur les spécifications de pointe, les équipes devraient évaluer les conditions réelles, la maturité de l'écosystème logiciel et le support du cycle de vie. En validant ta configuration avec un déploiement pilote avant de passer à l'échelle, tu peux réduire les risques, contrôler les coûts et assurer un passage plus fluide du prototype à la production.

Rejoins notre communauté et explore notre dépôt GitHub. Consulte nos pages de solutions pour découvrir diverses applications comme l'IA en agriculture et la vision par ordinateur dans les soins de santé. Découvre nos options de licence et commence avec l'IA de vision dès aujourd'hui !