データミスマッチからレイテンシーまで、コンピュータービジョンモデルが本番環境で失敗する理由と、チームが実際のビジョンAIシステムでモデルパフォーマンスを向上させる方法を学びます。

データミスマッチからレイテンシーまで、コンピュータービジョンモデルが本番環境で失敗する理由と、チームが実際のビジョンAIシステムでモデルパフォーマンスを向上させる方法を学びます。

コンピュータービジョンは、現在、ほとんどの産業で採用されている主要な人工知能技術であり、機械がさまざまなタスクのために視覚データを解釈・分析することを可能にします。これらのシステムは、医用画像処理やロボット工学から製造業や小売業の自動化まで、多くの実世界アプリケーションをサポートしています。

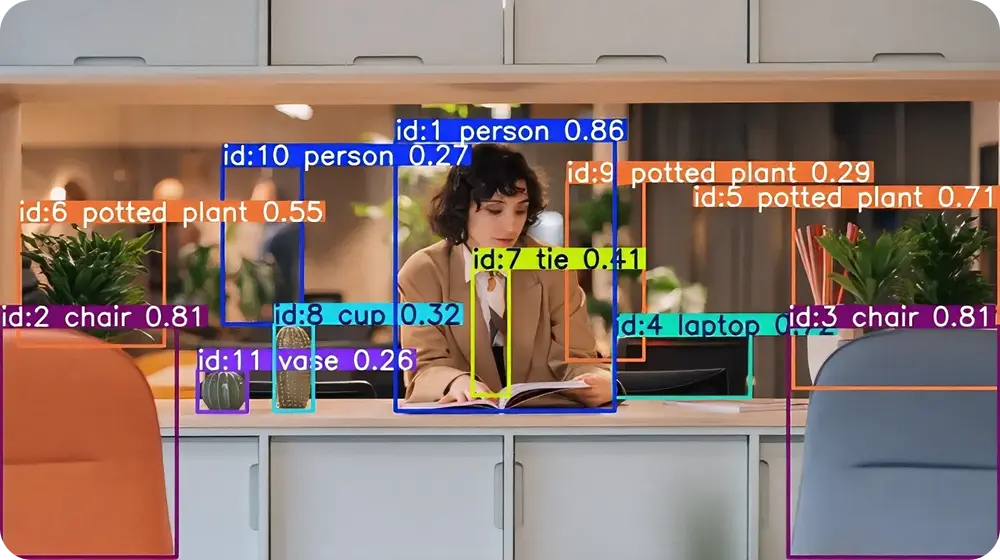

しかし、コンピュータビジョンシステムの構築は常に簡単ではありません。通常、画像や動画内のパターンを識別するように学習されたビジョンAIモデルの開発が含まれ、オブジェクトdetectやtrackなどのタスクをサポートします。

長年にわたって高度化が進んでいるにもかかわらず、コンピュータービジョンモデルは、開発中と実環境でのデプロイ後では異なる振る舞いをすることがあります。これは、管理された開発設定外でモデルをデプロイすると、新しく、しばしば予期せぬ課題が生じるためです。

データセットの多様性の欠如、不十分なモデル監視、インフラストラクチャの制約などの要因により、デプロイ後に同じモデルが実世界で異なる動作をする可能性があります。

本記事では、コンピュータービジョンモデルが本番環境でパフォーマンスを発揮できない可能性のある5つの一般的な理由を探ります。早速始めましょう!

モデルトレーニングは通常、管理された環境で行われます。この段階で、AI開発者は慎重に準備されたトレーニングデータセットを使用します。

これらの膨大な視覚データコレクションには、各画像の内容を記述する、構造化されたアノテーション、つまりラベルが含まれています。トレーニングも一貫した条件下で行われるため、ビジョンAIモデルが視覚パターンを効果的に学習することが可能になります。

これらのパターンが正しく学習されることを確実にするには、モデルは開発中に標準的な評価指標とベンチマークデータセットを使用して体系的に評価できます。トレーニングデータセットと同様に、これらのベンチマークデータセットも慎重に準備されます。

しかし、現実世界のコンピュータービジョンシステムが遭遇するデータは、トレーニングおよび評価中に使用されたデータとは大きく異なる場合があります。デプロイされると、これらのモデルは制御された条件下で動作することはめったにありません。

これらは、照明が常に変化し、カメラアングルが移動し、背景が時間とともに変化する予測不可能な環境からの画像やビデオを処理することになる可能性があります。例えば、交通detect用にトレーニングされたビジョンAIモデルは、主に日中の画像でトレーニングおよび評価された場合、夜間の車両をdetectするのに苦労する可能性があります。

開発と実運用間のこの違いが、学習と本番環境のギャップです。このギャップにより、多くのモデルの不具合はデプロイ後に初めて顕在化するため、より信頼性と堅牢性の高いコンピュータビジョンシステムを構築するには、早期の認識が不可欠です。

次に、コンピュータービジョンモデルが本番環境で失敗する5つの一般的な理由を詳しく見ていきましょう。

データセットは、コンピュータービジョンモデルのトレーニングにおいて中心的な役割を果たします。これは、トレーニング中にモデルが何を学習するか、またデプロイ後に実世界の入力にどのように応答するかを決定するためです。特に教師あり学習では、モデルが各画像が何を表すかを示すラベル付きの例から学習するため、この点は非常に重要です。

畳み込みニューラルネットワーク (CNN) を含む多くの深層学習モデルは、視覚データ内のパターンを認識するためにこれらのラベル付きの例に依存しています。しかし、トレーニングデータセットが現実世界の条件を反映していない場合、モデルは、トレーニングデータ外でオブジェクトがどのように現れるかを完全に表現しないパターンを学習する可能性があります。

例えば、大きな亀裂欠陥のデータセットでトレーニングされたモデルは、実際の製造ワークフローでまれな種類の小さな亀裂をdetectできない場合があります。同様に、アノテーションの品質もモデルの動作に影響を与える可能性があります。ラベル付けされたデータにおける不整合なラベルや詳細の欠落は、トレーニング中にモデルが誤った情報を学習する原因となる可能性があります。

全体として、トレーニングデータの品質と多様性は極めて重要であり、モデルが実世界のアプリケーションでどの程度うまく機能するかを決定します。データセットが代表的で正確にラベル付けされている場合、モデルは展開後に一般により信頼性の高いパフォーマンスを発揮します。

ビジョンモデルのような機械学習モデルは、トレーニングデータセットからパターンを学習します。しかし、モデルが少数のパターンに過度に依存してしまうことがあります。

より広範な視覚的関係を学習する代わりに、訓練データからの限られたパターンを記憶してしまう可能性があります。この挙動は過学習として知られています。

過学習は通常、トレーニングデータセットが小さい場合や、十分なデータ多様性がない場合に発生します。そのような場合、モデルはすでに見た画像を認識することには優れていますが、新しいデータやなじみのない入力を解釈することに困難を抱えます。

このため、モデルはテスト入力(トレーニングデータに類似しているため)ではうまく機能するかもしれませんが、デプロイ後の新しい条件下では異なる動作をする可能性があります。そのため、汎化の概念は非常に重要です。簡単に言えば、モデルがトレーニング中に学習したことを新しいシナリオにどれだけうまく適用できるかということです。

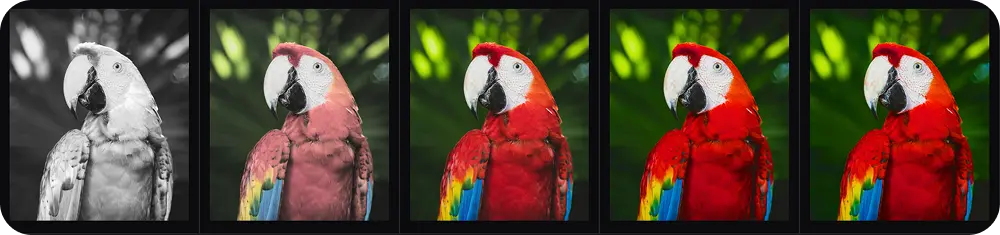

過学習を減らすため、AI愛好家はしばしば、より多様なデータセットでモデルをトレーニングし、トレーニング画像をわずかに変更してデータに多様性を持たせるデータ拡張を適用します。これらの考慮事項がないと、システムが実環境で動作を開始すると、モデルのパフォーマンスは急速に低下する可能性があります。

コンピュータービジョンモデルが新しいデータに対して良好に汎化する場合でも、実世界の環境では予期せぬエッジケースが発生する可能性があります。これらは、モデルがトレーニング中に学習する典型的なパターンとは異なる、特殊な状況です。

これらのシナリオの多くは、稀に発生したり、再現が難しかったり、トレーニングデータとして収集するのが高価であったりするため、開発中にキャプチャするのが困難です。例えば、オブジェクトは異常な形状で現れたり、予測不能に動いたり、他のオブジェクトの背後に部分的に隠れたりすることがあります。

照明、カメラアングル、または背景条件の変化も、認識をより困難にする状況を生み出す可能性があります。これらのエッジケースは、システムが実世界のアプリケーションにデプロイされた後に初めて顕著になることがよくあります。

例えば、ロボティクスや製造自動化では、品目が予想とは異なる方法で配置または位置決めされることがあり、モデルが処理するように設計されていない状況が生じます。最終的に、テスト中に信頼できると思われた予測は、システムが実環境で動作すると一貫性が低下する可能性があります。

ビジョンAIモデルの開発に加えて、そのパフォーマンスを監視し改善することが不可欠です。しかし、システムが稼働すると、焦点は時間経過に伴うパフォーマンスを綿密にtrackするよりも、単に稼働状態を維持することに移りがちです。その結果、モデルの動作の変化が見過ごされる可能性があります。

同時に、入力データの変化、カメラの設定、または動作環境などの要因は、モデルがオブジェクトをdetectまたは分類する精度に徐々に影響を与える可能性があります。これらの変化は常に明白であるとは限らず、日常の運用中に見過ごされることがあります。

モデルの出力とシステム全体の挙動を監視することは、チームがこれらの問題を早期に特定するのに役立ちます。定期的なチェック、検証ルーチン、デバッグワークフローにより、チームは異常な結果を調査し、その原因を理解することができます。

製造業のような分野を考えてみましょう。カメラ構成の変更後、モデルが組み立てライン上の物体を突然誤って識別する可能性があります。デプロイされたビジョンAIシステムの動作をtrackすることで、これらの変更に対応し、現実世界の環境で安定したパフォーマンスを維持することが容易になります。

多くのコンピュータービジョンシステムはリアルタイムで実行する必要があり、これはハードウェア、ネットワーク、および処理パイプラインに大きな負荷をかける可能性があります。リソースが限られている場合、計算遅延やネットワーク遅延が発生する可能性があり、予測の到着が遅くなり、システム全体のパフォーマンスに影響を与えます。

場合によっては、高度な深層学習モデルがインフラストラクチャの課題を生み出すこともあります。例えば、トランスフォーマーベースのアーキテクチャは、大量の視覚データを処理し、画像内の複雑な関係を学習するように設計されていますが、しばしばかなりの計算リソースを必要とします。これらのモデルを実行するには、より強力または高価なハードウェアが必要になる場合があります。

適切な最適化がなければ、テスト中に高速に動作するモデルでさえ、デプロイ後に速度が低下したり、一貫性のない動作をしたりする可能性があります。これに対処するため、チームはしばしばパイプラインを最適化し、可能な限りモデルの複雑さを軽減し、精度と速度のバランスを取ります。

これには、大規模モデルを軽量バージョンに圧縮したり、より効率的なアーキテクチャを使用したり、システムが利用可能なハードウェアでスムーズに動作するように画像を低解像度で処理したりすることが含まれます。多くの場合、チームはデプロイメントの制約を満たすために、Ultralytics YOLO26のような軽量で高速なモデルを選択します。

コンピュータービジョンモデルを本番環境に展開する際に、失敗を減らすのに役立ついくつかのベストプラクティスを以下に示します。

コンピュータビジョンモデルが失敗するのは、アルゴリズム自体が弱いからではありません。ほとんどの場合、真の課題はこれらのシステムが動作する環境にあります。トレーニング中に良好なパフォーマンスを示すモデルでも、予測不可能な実世界の条件に遭遇し、その動作に影響を与えることがあります。

だからこそ、信頼性の高いビジョンAIシステムを構築するには、単にモデルをトレーニングするだけでは不十分です。データセットを慎重に準備し、デプロイ後にモデルのパフォーマンスを監視し、システムを現実世界の状況に継続的に適応させることも含まれます。

ビジョンAIをさらに探求したいですか?当社のコミュニティに参加し、自動車産業におけるAIやロジスティクスにおけるコンピュータビジョンのようなアプリケーションについてお読みください。コンピュータビジョンプロジェクトを始めるには、当社のライセンスオプションをご確認ください。詳細については、当社のGitHubリポジトリをご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。