Axelera AIとの連携により、Ultralytics Pythonパッケージがサポートする新しいエクスポート統合についてご紹介します。これにより、効率的な高性能エッジAIが実現されます。

Axelera AIとの連携により、Ultralytics Pythonパッケージがサポートする新しいエクスポート統合についてご紹介します。これにより、効率的な高性能エッジAIが実現されます。

Ultralyticsでは、AIの普及に伴い、コンピュータービジョンモデルをエッジデバイス上で直接実行する傾向が強まっていると認識しています。コンピュータービジョンコミュニティとのオンラインおよび最近の技術カンファレンスでの対話を通じて、当社のチームは、データが生成される場所により近い場所でビジョンAIを展開することへの関心が高まっていることを確認しています。

スマートリテール環境や産業オートメーションからロボティクスまで、リアルタイムのインサイトが不可欠になりつつあり、クラウドのみに依存するだけではもはや十分ではありません。

簡単に言えば、エッジAIは、データを集中サーバーに送信して処理する代わりに、デバイス上でAIモデルをローカルに実行することを伴います。これにより、レイテンシを削減し、信頼性を向上させ、現実世界のイベントにリアルタイムで対応することが可能になります。

しかし、これらの環境で高性能モデルをデプロイすることには、限られた計算リソースと電力制約により、モデルが効率的であり、実行されるハードウェアに最適化されている必要があるため、独自の課題が伴います。

Ultralytics YOLO26のようなUltralytics YOLOモデルはリアルタイムコンピュータービジョン向けに設計されていますが、エッジでその可能性を最大限に引き出すには、ソフトウェアとハードウェアの適切な組み合わせが必要です。だからこそ、Axelera AIとの協業を発表できることを嬉しく思います。

Axelera AIと提携し、更新されたエクスポート統合を導入しました。これにより、Metis® AI処理ユニット (AIPU)上でのUltralytics YOLOモデルの効率的かつ高性能なデプロイが可能になります。

本記事では、Ultralytics YOLOモデルがMetisデプロイメント向けにどのように簡単にコンパイルできるかを探ります。早速始めましょう!

コンピュータービジョンアプリケーションが進化し続けるにつれて、より高速で効率的な処理の必要性がますます重要になっています。従来のクラウドベースのアプローチは、遅延を引き起こし、安定した接続に依存し、多くのインテリジェントビジョンユースケースのリアルタイム要件を満たせない可能性があります。

エッジAIは、モデルをローカルデバイスで直接実行できるようにすることで、これらの課題に対処し、データをその発生源に近い場所で処理できるようにします。例えば、捜索救助活動で使用されるビジョン搭載ドローンを考えてみましょう。

これらのシステムは、人、障害物、または危険をdetectするためにビデオフィードをリアルタイムで分析する必要がありますが、多くの場合、インターネット接続が限られているかまったくない遠隔地で行われます。コンピュータービジョンモデルをドローン上で直接実行することで、エッジAIはクラウドインフラストラクチャに依存することなく、より迅速な意思決定とより信頼性の高いパフォーマンスを可能にします。

この変化は、様々な産業で新たな可能性を切り開いています。小売業におけるリアルタイムのobject detection、製造業における自動品質検査、ロボット工学における知覚などのアプリケーションはすべて、応答時間の高速化と信頼性の向上から恩恵を受けています。

エッジAIは、実環境でスケーラブルかつ応答性の高いコンピュータービジョンシステムを展開するための重要なイネーブラーとして急速に台頭しています。

新しいエクスポート統合について詳しく説明する前に、まず一歩引いて、Axelera AIのMetis AI Processing Unitsと、効率的なエッジAIを実現する上でのその役割について詳しく学びましょう。

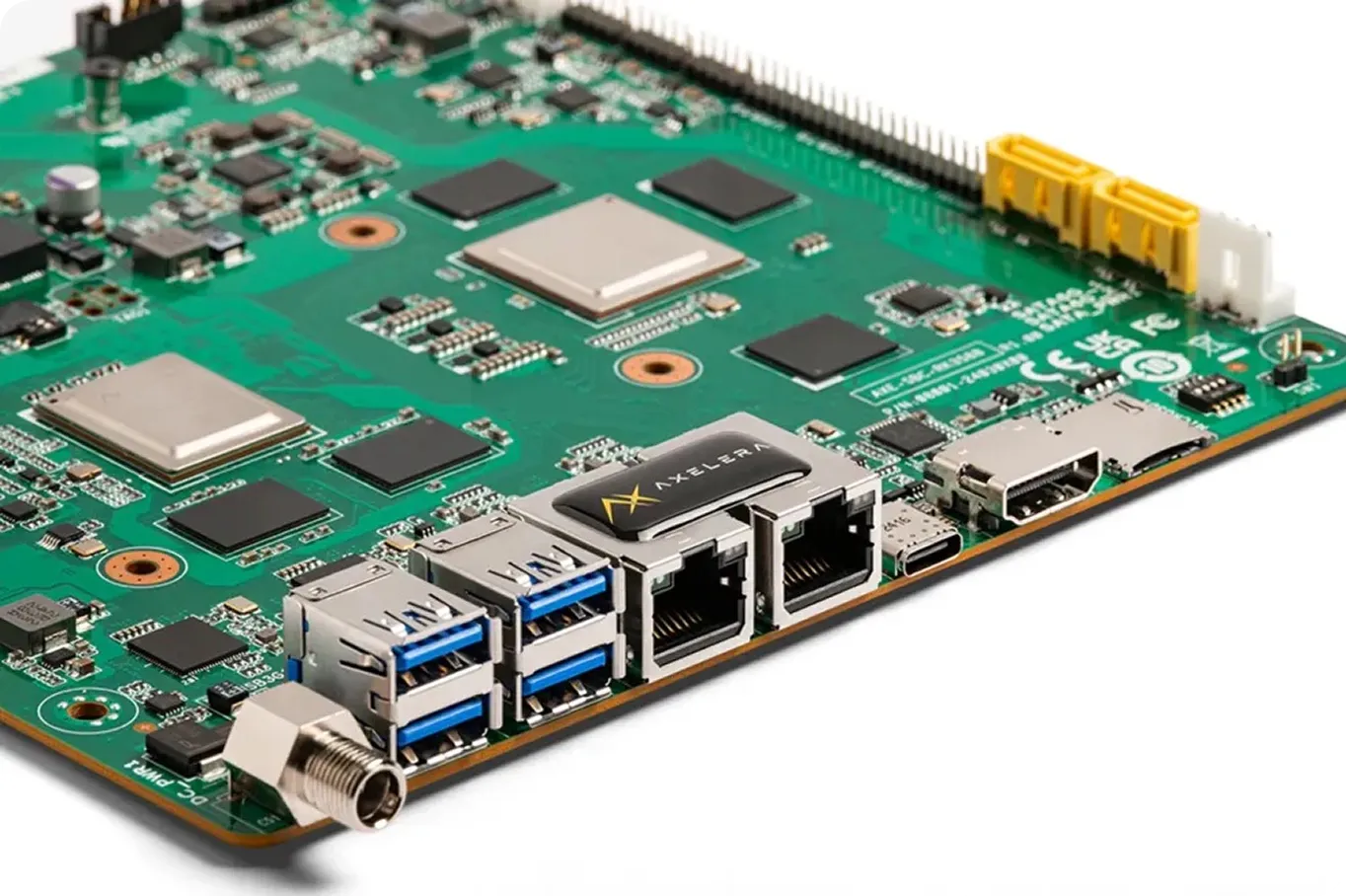

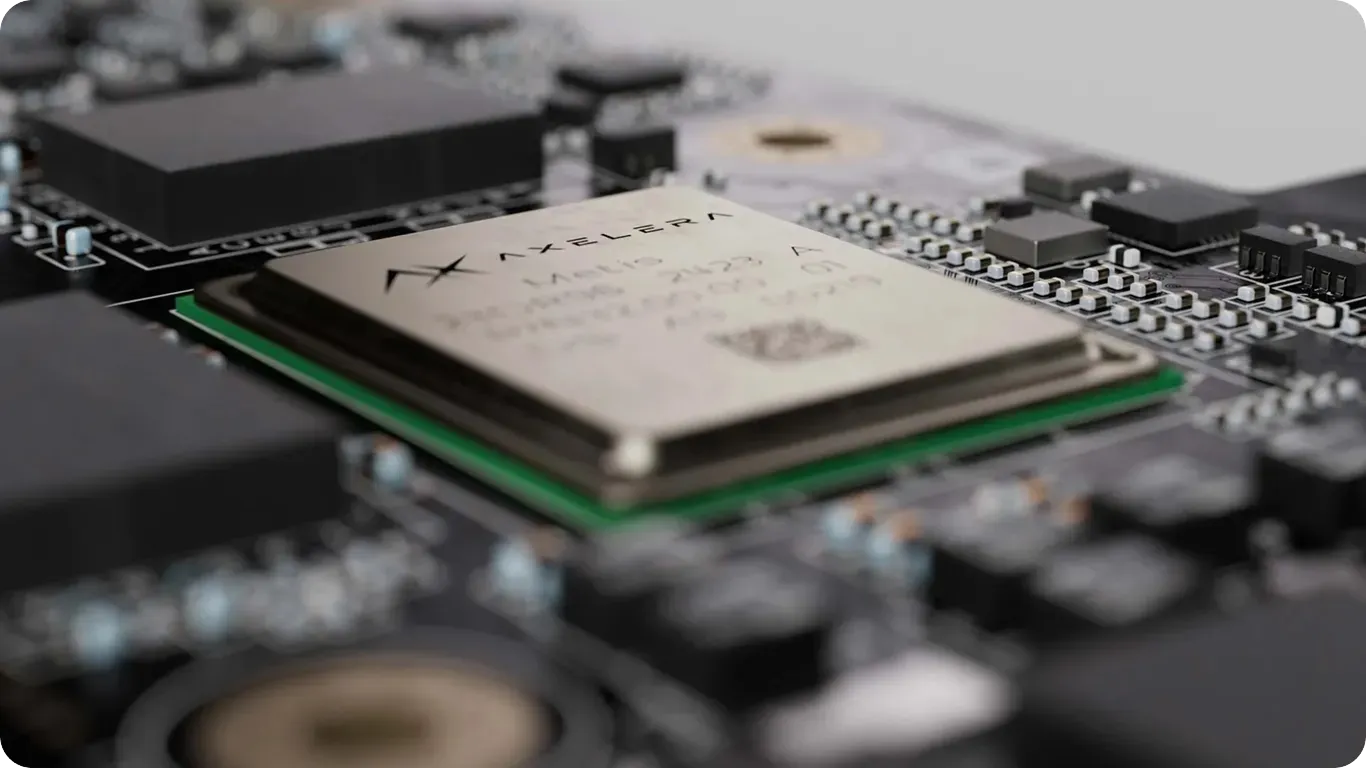

Axelera AIは、エッジでのAI推論を高速化するために特別に設計された専用ハードウェアを開発しています。その主要な部分がMetis AIPU、すなわちAI処理ユニットであり、エッジデバイス上でニューラルネットワークを効率的に実行するために構築された特殊なプロセッサです。

汎用中央処理装置 (CPU) やグラフィックス処理装置 (GPU) とは異なり、AIPUはAIワークロードの特定の計算パターンを処理するように設計されています。これにより、低消費電力を維持しながら高いパフォーマンスを発揮でき、リソースが限られていることが多いエッジ環境にとって重要です。

Axelera AIのアプローチが特に革新的なのは、そのフルスタック設計にあります。Metisは、デジタルインメモリコンピューティング(D-IMC)とRISC-Vで構築されており、エッジコンピューティングが要求するエネルギー効率と高いパフォーマンスを実現します。Metisの4つのコアは独立してプログラマブルであり、これにより、1つのチップで4つのモデルを並行して実行できます。ハードウェアに加えて、Voyager SDKにはコンパイラとランタイムが含まれており、これらが連携してデプロイメント向けにモデルを最適化します。

これにより、開発者は訓練済みモデルから本番環境対応の推論へと、より効率的に移行できるようになります。具体的には、Metis AIPUは、Ultralytics YOLOモデルのような高度なコンピュータビジョンモデルを、企業、小売、ヘルスケア、製造環境から農業および産業機器、衛星に至るまで、エッジデバイス上で直接実行することを可能にします。

Ultralytics Pythonパッケージは、さまざまなコンピュータービジョンタスクにおけるYOLOモデルのトレーニング、評価、デプロイのための統一されたインターフェースを提供します。YOLOモデルは通常、実験とモデル開発に適したPyTorchを使用して開発およびトレーニングされます。

しかし、これらのモデルを特殊なエッジハードウェアにデプロイする際、ターゲットデバイスに最適化された形式に変換する必要があります。ここで、Ultralytics Pythonパッケージがサポートするエクスポート統合が役立ちます。

Ultralyticsは、デプロイメントターゲットに応じてYOLOモデルをONNX、TensorRT、その他のハードウェア固有のバックエンドなどの異なるフォーマットに変換できる様々なエクスポートオプションを提供しています。これらの統合により、必要な最適化と変換ステップを処理することで、実世界アプリケーション向けにモデルを準備するプロセスが簡素化されます。

これに基づき、UltralyticsはAxelera AIとの更新されたエクスポート統合を導入し、YOLOモデルをMetis AIPUへのデプロイメント向けにエクスポートできるようにしました。

エクスポート中、モデルはAxeleraハードウェア用に特別に設計された最適化された表現にコンパイルおよび量子化されます。このプロセスにより、「.axm」形式のコンパイル済みモデルと、デプロイおよび推論に必要なメタデータが生成されます。

この統合は、Ultralytics YOLOv8、Ultralytics YOLO11、およびUltralytics YOLO26モデルにわたる、物体detect、姿勢推定、インスタンスsegmentation、oriented bounding box (OBB) detect、画像分類を含む幅広いコンピュータービジョンタスクをサポートします。ほとんどのタスクはエクスポートワークフローを通じて直接サポートされますが、YOLO26 segmentationはVoyager SDKと連携してモデルzooを通じて使用できます。

この拡張されたサポートにより、開発者はアプリケーションに応じて、リアルタイムでのオブジェクトのdetectから、シーンの理解、動きのtrack、複雑な視覚データの分析まで、さまざまなタイプのビジョンモデルを柔軟にデプロイできます。

エクスポートされると、モデルは推論時にPyTorchに依存することなくデプロイおよび実行できます。代わりに、Voyager SDKランタイムを使用して実行されます。これは、ビデオ処理、リアルタイムdetect、trackなどのタスク向けのエンドツーエンドパイプラインをエッジデバイス上で直接構築することをサポートします。

新しいエクスポート統合について理解が深まったところで、Ultralytics YOLOモデルをこのカスタム形式にエクスポートし、エッジのMetisハードウェアで実行する方法を見ていきましょう。

開始するには、まずUltralytics pythonパッケージをインストールする必要があります。これは、YOLOモデルのトレーニング、評価、およびエクスポートのためのシンプルで一貫したインターフェースを提供します。

ターミナルまたはコマンドプロンプトで以下のコマンドを実行することで、pipを使用してインストールできます。

pip install ultralytics

インストールまたはエクスポート中に問題が発生した場合は、公式のUltralyticsドキュメントとよくある問題ガイドがトラブルシューティングに役立つ優れたリソースとなります。

Axeleraハードウェアでモデルをエクスポートして実行するには、AxeleraドライバーとVoyager SDKもインストールする必要があります。この手順により、Metis AIPUとの通信が可能になり、必要なランタイムおよびコンパイラツールが提供されます。

以下の手順は、Axelera AI MetisハードウェアにアクセスできるLinux環境で実行する必要があります。システム上でターミナルを開くか、互換性のあるローカルセットアップでJupyter Notebookを実行している場合はノートブックセルを使用し、以下のコマンドを実行してください。

まず、Axeleraリポジトリキーを次のように追加します。

sudo sh -c "curl -fsSL https://software.axelera.ai/artifactory/api/security/keypair/axelera/public | gpg --dearmor -o /etc/apt/keyrings/axelera.gpg"

次に、以下に示すように、Axeleraリポジトリをシステムに追加します。

sudo sh -c "echo 'deb [signed-by=/etc/apt/keyrings/axelera.gpg] https://software.axelera.ai/artifactory/axelera-apt-source/ ubuntu22 main' > /etc/apt/sources.list.d/axelera.list"

次に、Voyager SDKをインストールし、Metisドライバーを以下のようにロードします。

sudo apt update

sudo apt install -y metis-dkms=1.4.16

sudo modprobe metis

これらのステップが完了すると、システムはAxelera AI MetisデバイスでUltralytics YOLOモデルをエクスポートおよび実行する準備が整います。

Ultralyticsパッケージがインストールされると、YOLOモデルをロードし、Metis用のコンパイル済みパッケージとしてエクスポートできます。このプロセスにより、モデルはAxelera AI Metisハードウェアへのデプロイメントに最適化された形式に変換されます。

以下の例では、事前学習済みのYOLO26 nanoモデルを使用し、Metis用にエクスポートします。エクスポートされたモデルは「/yolo26n_axelera_model」という名前のディレクトリに保存されます。

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

model.export(format="axelera")

モデルをエクスポートした後、それをロードし、未見の画像やビデオストリームに対して推論を実行できます。これにより、Axelera AI Metisデバイス上でリアルタイムのコンピュータビジョンタスクを直接実行できます。

例えば、以下のコードスニペットは、エクスポートされたモデルをロードし、公開されているURLで推論を実行する方法を示しています。

axelera_model = YOLO("yolo26n_axelera_model")

results = axelera_model("https://ultralytics.com/images/bus.jpg", save=True)

この場合、モデルは入力画像を分析し、オブジェクトをdetectし、結果を「runs/detect/predict」ディレクトリに保存します。

次に、Ultralytics YOLOモデルがAxelera AIハードウェアに実世界のシナリオでデプロイできる、いくつかの一般的なエッジAIアプリケーションについて説明します。

Axelera AIのMetis AIPUは、組み込みシステムや産業用PCからロボット工学、エッジサーバーまで、幅広い展開環境向けに設計されています。高性能でエネルギー効率の高い推論により、コンピュータービジョンアプリケーションを様々な業界でデバイス上で直接実行できます。Voyager SDKには、MLおよびAPPエンジニアがエッジ向けモデルを製品化するためのパイプラインビルダーも含まれています。

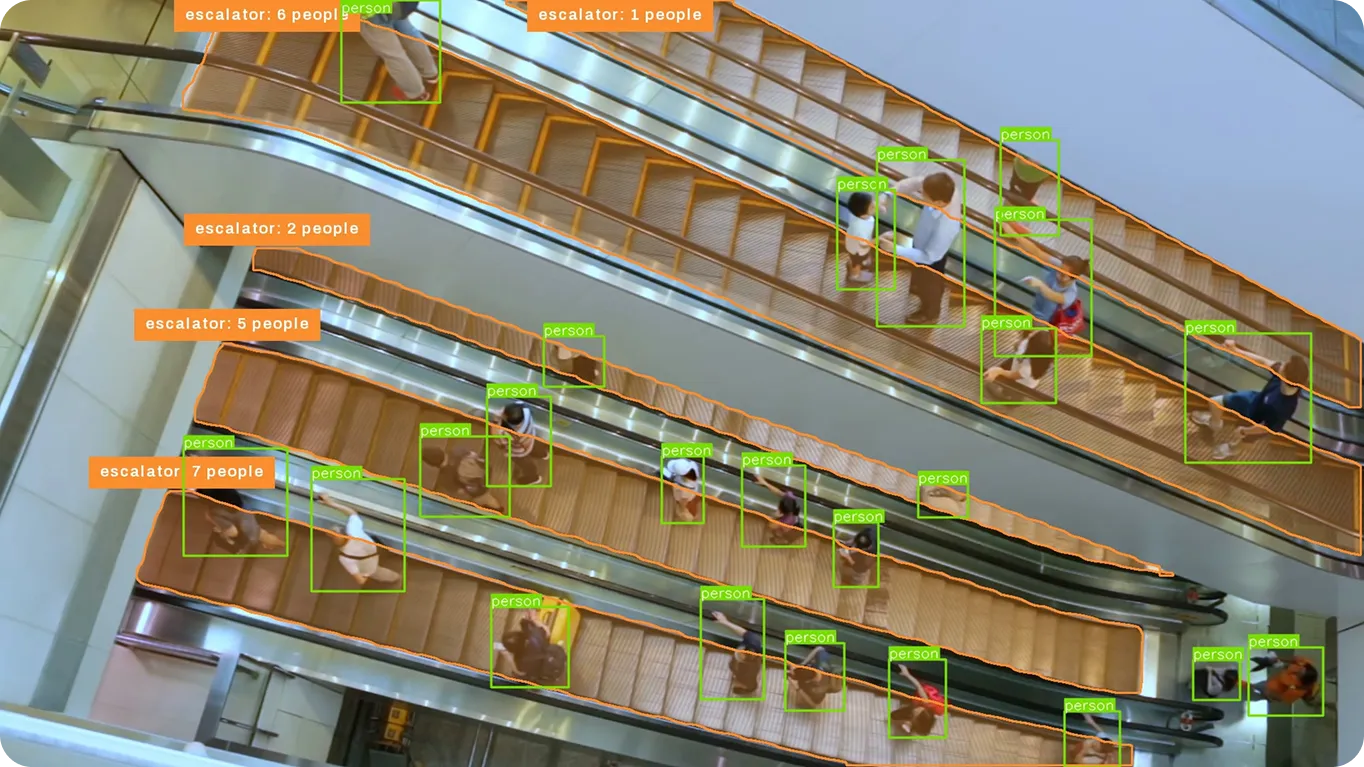

小売環境では、顧客の行動をリアルタイムで理解することが、大きな違いを生み出すことができます。

Axelera AIハードウェア上で実行されるUltralytics YOLOモデルを使用することで、店舗は来店客数を監視し、人数をカウントし、店内の移動パターンをリアルタイムで分析できます。すべてがオンデバイスで実行されるため、クラウド接続に依存することなく即座にインサイトを生成でき、データプライバシーを維持しながらチームがより迅速に対応できるよう支援します。

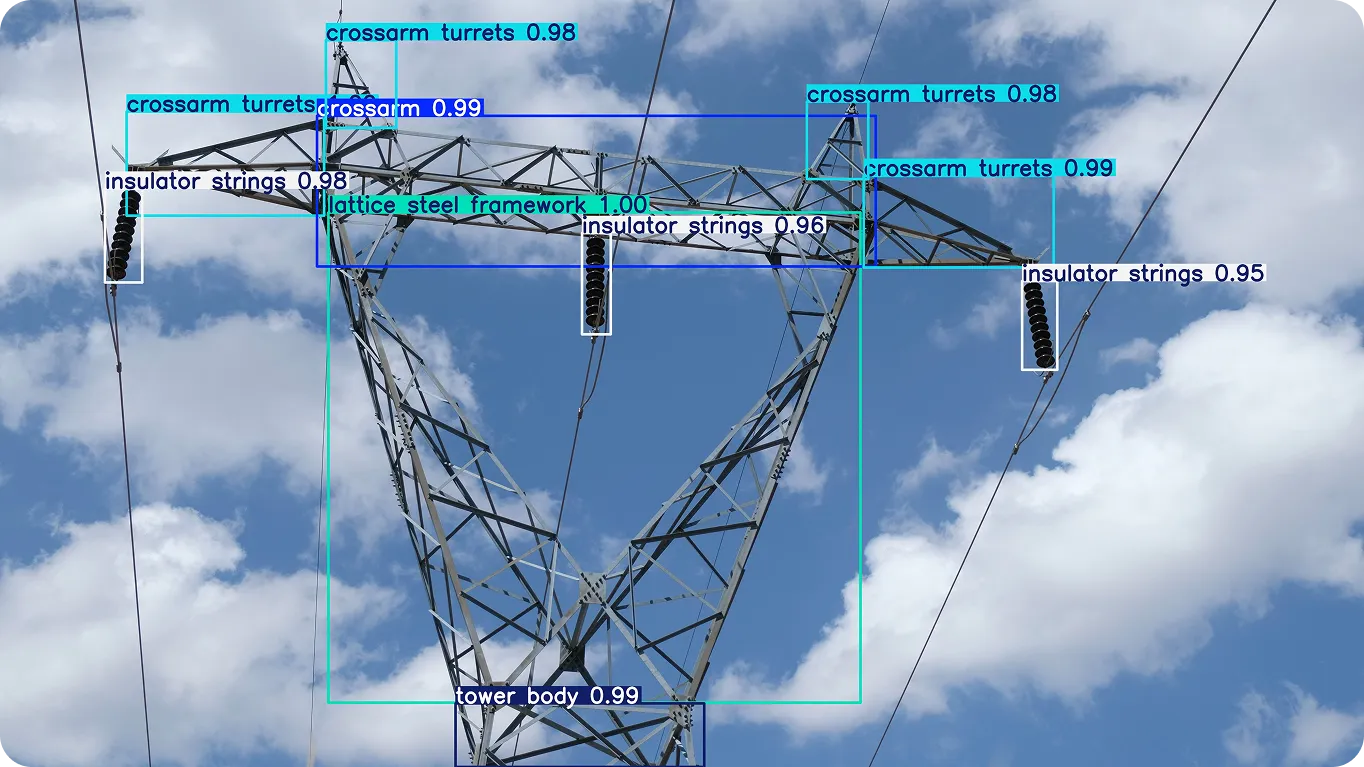

送電線のような大規模インフラの維持は複雑で、多大なリソースを要します。これらのネットワークは広大な距離に及ぶことが多く、検査は時間と費用がかかり、潜在的に危険です。故障や初期の摩耗の兆候が見過ごされると、停電、機器の損傷、または安全上のリスクに発展する可能性があります。

ドローンは検査効率を向上させるためにますます使用されています。長距離をカバーし、到達困難なエリアにアクセスし、重要な資産の高解像度画像をキャプチャできます。

ドローンとエッジAIを組み合わせることで、これらのワークフローはさらに強化されます。Axelera AIハードウェア上で動作するUltralytics YOLOモデルは、検査中にリアルタイム分析を可能にし、現場で故障を特定し、コンポーネントをclassifyし、異常をdetectします。これにより、手動レビューの必要性が減り、より迅速で信頼性の高いインフラ監視がサポートされます。

ロボット工学において、速度と応答性は極めて重要です。倉庫内を移動する場合でも、動的な産業環境で作業する場合でも、ロボットは周囲の状況を即座に解釈する必要があります。

Axelera AIハードウェア上で動作するUltralytics YOLOモデルは、ロボットが障害物のdetectから人物のtrack、オブジェクトの識別まで、周囲の状況をリアルタイムで解釈することを可能にします。これにより、システムはより安全に移動し、動的な状況に適応し、常時クラウド接続に依存することなく、より高い自律性で動作できるようになります。

新しい統合を使用して、Axelera AIのMetisハードウェアにUltralytics YOLOモデルを展開することの主要な利点をいくつかご紹介します。

Ultralytics YOLOモデルとAxelera AIのMetis AIPUは、高性能なコンピュータービジョンをエッジにもたらすことを容易にします。展開を簡素化し、特殊なハードウェア向けにモデルを最適化することで、この統合は開発と実世界アプリケーション間のギャップを埋めるのに役立ちます。

エッジAIが成長し続けるにつれて、効率的でスケーラブルなデプロイメントオプションを持つことが、応答性が高く信頼性の高いシステムを構築するための鍵となります。この協力は、高度なビジョンAIを業界全体でよりアクセスしやすくするための一歩です。

AIについてもっと知りたいですか?GitHubリポジトリを探索し、コミュニティと繋がり、ライセンスオプションをチェックして、コンピュータビジョンプロジェクトを始めましょう。小売におけるAIやヘルスケアにおけるコンピュータビジョンなどのイノベーションが、未来をどのように形作っているかをご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。