最高の物体検出モデルで、よりスマートなiOSアプリを構築しましょう。iPhoneやiPadなどのiOSデバイスで、高速、高精度、リアルタイムのパフォーマンスを実現するモデルについて学びます。

最高の物体検出モデルで、よりスマートなiOSアプリを構築しましょう。iPhoneやiPadなどのiOSデバイスで、高速、高精度、リアルタイムのパフォーマンスを実現するモデルについて学びます。

AndroidデバイスやiPhoneは、日常生活に不可欠なものとなっています。人々はこれらを使って、買い物、ナビゲーション、写真撮影、製品スキャン、そして一日中アプリとのやり取りを行っています。

人工知能の急速な成長に伴い、多くのスマートフォンには、デバイスのカメラで撮影された画像や動画を理解できる機能が搭載されています。これらの機能を効率的に実行できるかどうかは、主に基盤となるハードウェアに依存します。

例えば、Appleエコシステムでは、iPhone、iPad、Macなどのデバイスは、AシリーズやMシリーズを含むApple Siliconチップを搭載しています。これらのシステムオンチップ (SoC) 設計は、中央処理装置 (CPU)、グラフィックス処理装置 (GPU)、および専用の機械学習アクセラレータを統合し、AIワークロード向けのオンデバイス推論を可能にします。

特に、画像分析機能はコンピュータビジョンによって可能になります。これは、object detectionのようなタスクを使用して、機械が画像やビデオから視覚情報を解釈し理解することを可能にするAIの分野です。

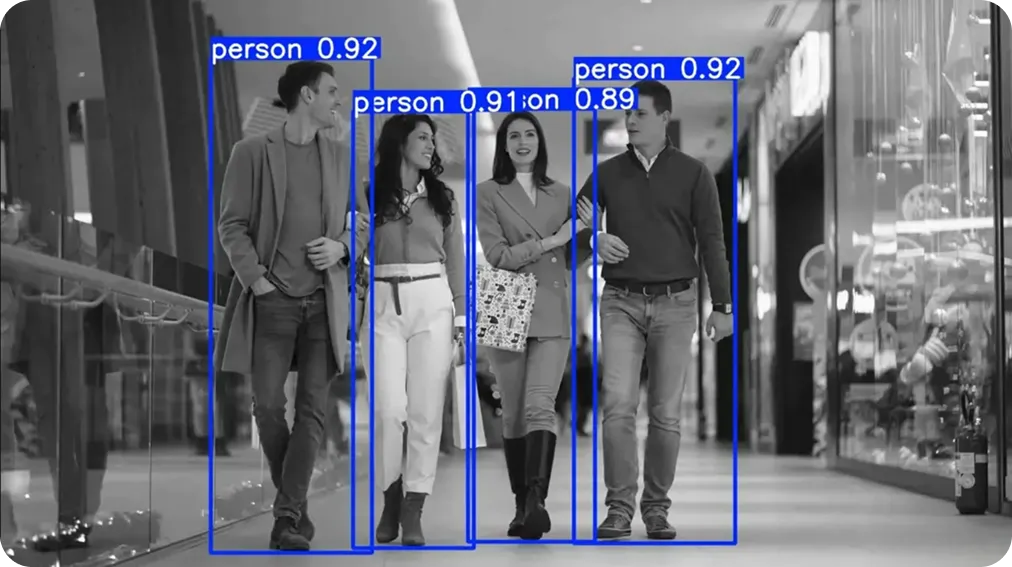

具体的には、object detectionモデルは画像を分析し、オブジェクトの周囲にバウンディングボックスを描画することでオブジェクトを識別します。これらのモデルは、Apple Siliconチップなどのモバイルハードウェア上で効率的に実行されるように最適化でき、iOSデバイス上でデバイス上で直接リアルタイムの視覚分析を可能にします。

本記事では、高速でリアルタイムなiOSアプリを構築するための、最高のオブジェクトdetectモデルのいくつかを探ります。早速始めましょう!

オブジェクト検出は、アプリが画像内のオブジェクトを認識し、位置を特定するのに役立ちます。アプリが入力画像を処理する際、オブジェクト検出モデルはシーンを分析し、バウンディングボックスで囲み、ラベルを割り当てることで、異なるオブジェクトを識別できます。

ほとんどのobject detectionシステムは、トレーニングデータ内のパターンを認識できるニューラルネットワークに依存しています。画像タスクの場合、これらのモデルは大規模なトレーニングデータセットからピクセルレベルの情報を分析することによって、視覚的表現を学習します。

畳み込みニューラルネットワーク(CNN)は、物体検出モデルのバックボーンとして頻繁に利用されます。CNNは、エッジ、形状、テクスチャなどの階層的な視覚的特徴を学習するため、画像予測に優れており、モデルがシーン内の物体を認識するのに役立ちます。

研究者たちは、コンピュータービジョンタスク向けにTransformerベースのアーキテクチャも探求しています。これらのモデルは、画像の異なる領域間の関係を分析し、シーン全体のより広範な文脈情報を捉えます。

モデルアーキテクチャの種類だけでなく、iOSデバイス上でのobject detectionにおいては効率性が重要な考慮事項です。これらのモデルはモバイルデバイス上で直接実行されるため、限られた計算リソースを使用しながら画像を迅速に処理する必要があります。

効率的なモデルは、低レイテンシを維持し、モバイルアプリでのリアルタイムな物体detectをサポートします。特に連続的なカメラ入力を分析する場合に重要です。

iOS向けの最高のobject detectionモデルのいくつかについて詳しく説明する前に、まず一歩引いて、モバイルアプリケーションに適したモデルとは何かを理解しましょう。

iOSアプリにとって理想的なobject detectionモデルは、性能、効率、信頼性のバランスが取れています。iOS展開に適した強力なモデルを定義する主要な要素を以下に示します。

次に、iOSデバイスで最も広く使用されているいくつかのオブジェクトdetectモデルを見ていきましょう。

Ultralytics YOLOモデルは、リアルタイムのコンピュータービジョンアプリケーション向けに設計された、人気の高いobject detectionモデルのファミリーです。長年にわたり、UltralyticsはUltralytics YOLOv5、Ultralytics YOLOv8、Ultralytics YOLO11、そして最新の最先端モデルであるUltralytics YOLO26といったビジョンモデルをリリースしてきました。

新しいリリースごとに、detect精度、モデル効率、ランタイムパフォーマンスが向上しています。これらの更新により、Ultralytics YOLOモデルはスマートフォンなどのエッジデバイスにますます適したものになっています。

iOSアプリにUltralytics YOLOモデルを使用する主な利点の1つは、Ultralytics pythonパッケージを通じて提供されるCoreML統合です。このオープンソースライブラリは、開発者がシンプルなワークフローでUltralytics YOLOモデルをトレーニング、テスト、およびエクスポートするのに役立ちます。

このパッケージは、trainedモデルをCoreMLにエクスポートすることをサポートしています。CoreMLは、Appleの機械学習フォーマットであり、iOSデバイスにモデルをデプロイするために使用されます。エクスポート後、CoreMLモデルはアプリに統合され、CPU、GPU、Apple Neural Engineなどのハードウェアを使用してデバイス上で直接実行できます。

これにより、開発者はモデル推論をデバイス上で実行したまま、リアルタイム物体検出をiOSアプリに統合することが容易になります。

モデルそのものだけでなく、Ultralyticsエコシステムは、Apple SiliconチップへのYOLOモデルのデプロイを容易にする様々なオプションを提供しています。

例えば、Ultralyticsは最近、データセット管理、モデルトレーニング、検証、デプロイメントを単一の環境に統合するUltralytics Platformを導入しました。この統合されたワークフローにより、複数のツールの必要性が減り、実験から実世界のアプリケーションへの道のりを効率化するのに役立ちます。

プラットフォームの一部として、学習済みモデルはAppleデバイス用のCoreMLを含む複数の形式にエクスポートできます。これにより、数クリックでUltralytics YOLOモデルをオンデバイス推論用にエクスポートすることが可能になります。

エクスポート機能に加えて、Ultralyticsは、iOS向けにオープンソースのSwift(iOSアプリ構築に使用されるAppleのプログラミング言語)実装を提供しています。これには、Swiftで書かれたすぐに使えるYOLO iOSアプリが含まれており、CoreMLモデルを統合し、カメラ入力で実行し、リアルタイムのobject detectionに利用する方法を示しています。

Ultralytics YOLOモデルがiOSアプリケーション構築に最適な選択肢となるその他の主要な特徴をいくつかご紹介します。

EfficientDetは、2019年にGoogleの研究者によって導入された物体detectアーキテクチャです。これは、detect精度と計算効率のバランスを取るように設計されており、リソースが限られた環境に適しています。

EfficientDetの重要なアイデアの1つは、複合スケーリングとして知られるスケーリング手法です。ネットワークの深さや画像解像度など、モデルの1つの部分だけを増やすのではなく、このアプローチではアーキテクチャの複数のコンポーネントを同時にスケーリングします。

これらの要素を同時に調整することで、モデルは高精度向けに構成されているか、軽量デプロイメント向けに最適化されているかに関わらず、安定したパフォーマンスを維持します。

このアーキテクチャは、EfficientDet-D0からEfficientDet-D7まで、いくつかのバリアントで利用可能です。小さいモデルはより高速な推論と低いリソース使用量のために設計されており、一方、大きいバージョンはより高い検出精度を達成することに重点を置いています。

MobileNet SSDは、モバイルおよびエッジデバイスで効率的に動作するように設計された軽量な物体検出モデルです。2017年頃に人気を集めました。

このモデルは、効率的な特徴抽出に焦点を当てたMobileNetバックボーンと、オブジェクトをdetectするためのSSD(Single Shot Detector)アプローチを組み合わせています。SSD手法は、単一の順方向パスでオブジェクトをdetectし、バウンディングボックスを生成します。

この設計により、モデルは比較的高速かつシンプルに保たれ、迅速なdetect結果を必要とするアプリケーションに有用です。MobileNet SSDは、モデルサイズが小さく、推論速度が速いことが重要な状況でよく使用されます。

MobileNetアーキテクチャは、必要な計算量を削減し、処理能力が限られたデバイスでモデルを実行しやすくします。MobileNet SSDは、一部の新しいdetectアーキテクチャと同じレベルの精度を達成できない場合がありますが、多くの一般的なobject detectionタスクで依然として優れた性能を発揮します。

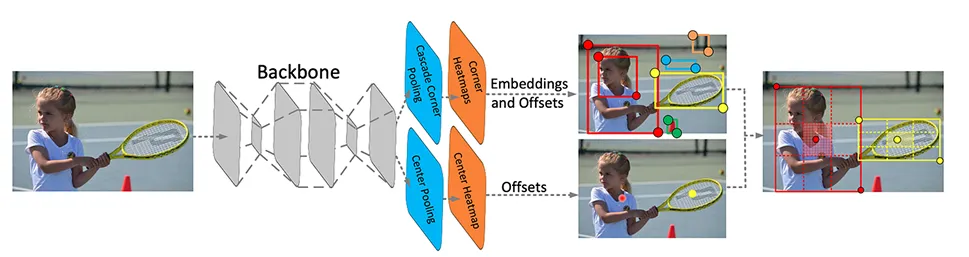

CenterNetは、オブジェクトの中心点を予測することでオブジェクトを識別する物体検出モデルです。2019年に導入されました。

多くの候補領域を生成する代わりに、モデルはオブジェクトの中心を検出し、その周囲のバウンディングボックスのサイズを予測します。このアプローチは検出パイプラインを簡素化し、推論中に必要なステップ数を削減します。

CenterNetはリアルタイムのdetectタスクに使用でき、一部の多段階検出器と比較して比較的シンプルなアーキテクチャで知られています。ResNetバックボーンを持つCenterNetのようなバリアントは、さまざまなコンピュータービジョンアプリケーションで一般的に使用されています。

その効率的な設計により、CenterNetはiOSデバイスで動作するアプリケーションを含め、高速なobject detectionを必要とするシステムに適しています。

NanoDetは、エッジおよびモバイルデバイスでのリアルタイムアプリケーション向けに設計された軽量な物体検出モデルです。モデルサイズと計算要件を非常に低く抑えながら、効率的な物体検出を提供することを目標として2020年に導入されました。

このモデルは、シングルステージのdetectアーキテクチャを使用しており、ネットワークを1回通過するだけでオブジェクトの位置とカテゴリを予測できます。この設計により、モデルは高速に動作し、ハードウェアリソースが限られたシステムに適しています。

NanoDetは、コンパクトなバックボーンと最適化された検出ヘッドを使用して、推論中に必要なパラメーターと計算の数を削減します。これらの設計上の選択により、速度と効率を優先しながら、合理的な検出精度を維持するのに役立ちます。

iOSアプリ向けのオブジェクトdetectモデルの選択は、多くの場合、ユースケースの特定の要件に依存します。これらのモデルはiPhoneやiPadなどのデバイス上で直接実行されるため、どのオプションが最適であるかを決定するいくつかの要因があります。

いくつかの重要な考慮事項を以下に示します。

オブジェクト検出モデルは、スマートモバイルアプリに高度なコンピュータービジョン機能をもたらします。iOSデバイス上で直接実行されることで、これらのモデルは、アプリがデバイスのカメラからの画像やビデオをリアルタイムで分析することを可能にします。適切なモデルを選択することで、開発者は信頼性の高いリアルタイムパフォーマンスを提供する、応答性の高いビジョン駆動型モバイルアプリを構築できます。

成長中のコミュニティに参加し、実践的なAIリソースについては、私たちのGitHubリポジトリをご覧ください。今すぐVision AIで構築を始めるには、私たちのライセンスオプションをご覧ください。ソリューションページをご覧になり、農業AIが農業をどのように変革しているか、そしてロボティクスにおけるVision AIが未来をどのように形作っているかをご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。