Ultralytics において、共有型推論と比較してスケーラブルかつ低遅延なビジョンAIを展開するために、専用推論エンドポイントを選択すべきタイミングについてご確認ください。

Ultralytics において、共有型推論と比較してスケーラブルかつ低遅延なビジョンAIを展開するために、専用推論エンドポイントを選択すべきタイミングについてご確認ください。

先日、当社は「Ultralytics 」を発表しました。これは、データセットの準備やモデルのトレーニングから、推論、デプロイ、モニタリングに至るまで、コンピュータビジョンのワークフロー全体を一元管理できるエンドツーエンドのソリューションです。

コンピュータビジョンコミュニティからのフィードバックを基に構築されたこのプラットフォームは、ビジョンAIアプリケーションのライフサイクル全体をサポートする統合機能を提供することで、開発の各段階を簡素化するよう設計されています。

例えば、モデルのトレーニングが完了したら、次のステップとして、実世界のアプリケーションで推論を実行し、予測を行うために、そのモデルをデプロイする必要があります。このプラットフォームでは、複数のデプロイオプションを用意することで、このプロセスを簡単に行えるようにしています。

モデルをエクスポートして自身の環境で実行したり、共有推論機能を利用して迅速にテストを行ったり、スケーラブルで本番環境対応のアプリケーション向けに専用のエンドポイントをデプロイしたりすることができます。これらのデプロイメントオプションはいずれもAI推論を実行可能ですが、それぞれ異なる段階やユースケースに合わせて設計されています。

モデルのエクスポート機能により、自社インフラ上でモデルを完全に制御して実行できます。共有推論機能を使えば、設定の手間なく簡単にテストや実験を行うことができ、専用エンドポイントは、信頼性の高い大規模な本番環境ワークロード向けに構築されています。

一見すると、共有推論と専用エンドポイントはよく似ているように思えるかもしれません。どちらもモデルにAPIリクエストを送信し、構造化された予測結果を受け取ることができるため、ビジョンAIをアプリケーションに簡単に統合できます。

しかし、ワークロードが増加し、コンピュータビジョンアプリケーションがリアルタイムの推論リクエストを処理するようになると、これらの選択肢の違いがより重要になってきます。本記事では、共有推論と専用エンドポイントについて詳しく解説し、両者の比較、それぞれの適切な使用場面、そしてアプリケーションの規模拡大に伴い専用エンドポイントがより良い選択肢となる理由について説明します。

Shared Inferenceは、インフラのGPU 、フレームワークの統合、実行時の設定などを気にすることなく、モデルでAI推論を実行できるシンプルな方法です。モデルのトレーニングや微調整が完了すれば、プラットフォームを通じて直接予測を行うことができます。

この構成では、モデルは米国、欧州、アジア太平洋など、主要なリージョンをまたがる共有のマルチテナント型コンピューティングリソース上で実行されます。リクエストは利用可能なサービスに自動的にルーティングされるため、GPU 実行環境の設定を行う必要はありません。すべてが自動的に処理されるため、簡単に利用を開始できます。

共有推論を使用する場合、Python CLI Python REST API モデルにリクエストを送信し、検出されたオブジェクト、信頼度スコア、その他の予測詳細など、構造化されたJSON形式の出力を受け取ります。これにより、モデルのテストやアプリケーションへの統合がスムーズに行えます。

このシステムは共有環境であるため、開発、テスト、および軽度の利用を想定して設計されています。予測の検証や初期段階の統合構築には適しています。一方で、システムの負荷によってパフォーマンスが変動する可能性があり、またAPIキーごとに1分あたり20リクエストというレート制限が設けられているため、高スループットが求められる本番環境のワークロードにはあまり適していません。

総じて言えば、共有推論は、大規模なアプリケーションへの展開に移行する前に、モデルの理解と改善に重点を置く開発の初期段階に最も適しています。

専用エンドポイントは、単一テナント型の推論サービスであり、お客様のビジョンAIモデルが隔離されたコンピューティングリソース上で実行されます。インフラストラクチャを共有するのではなく、各エンドポイントは独自のランタイムを持ち、CPU リソースを自由に設定できるため、パフォーマンスをより細かく制御できます。

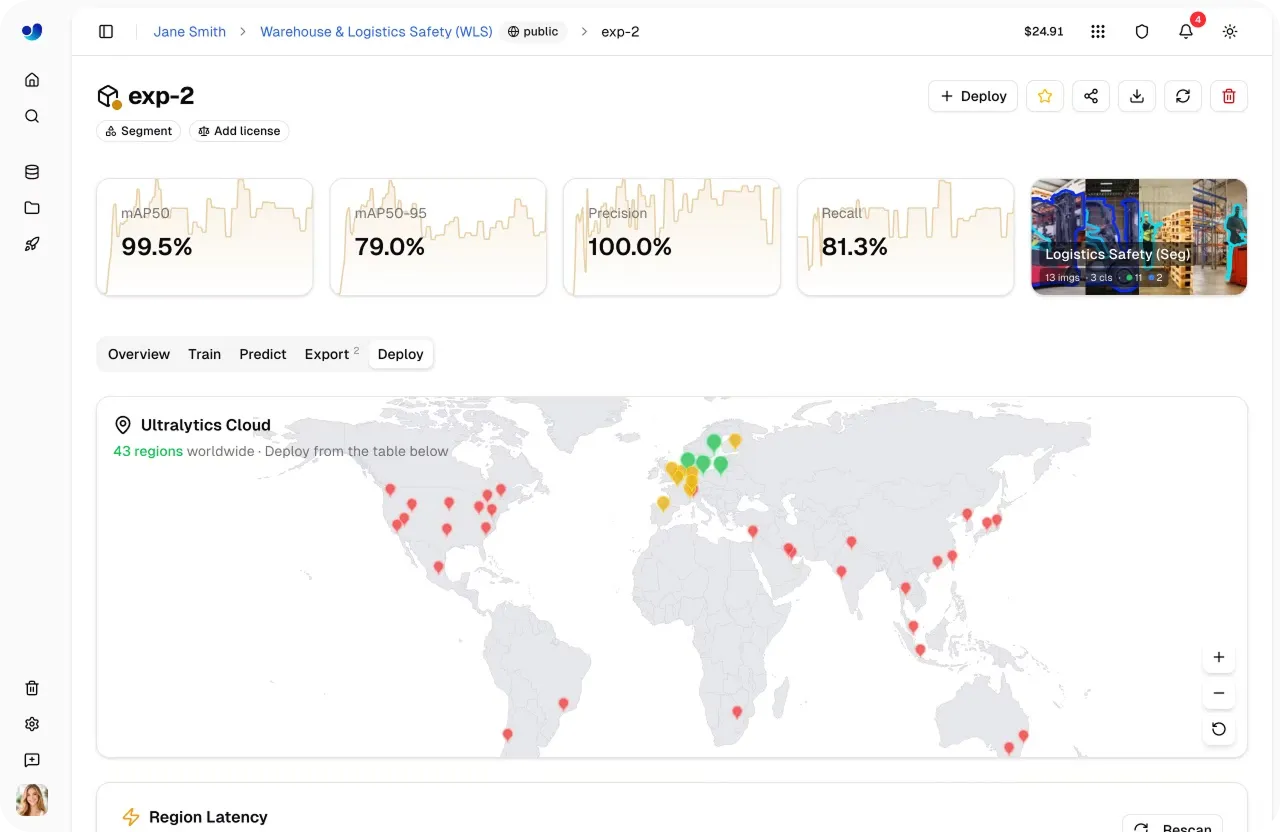

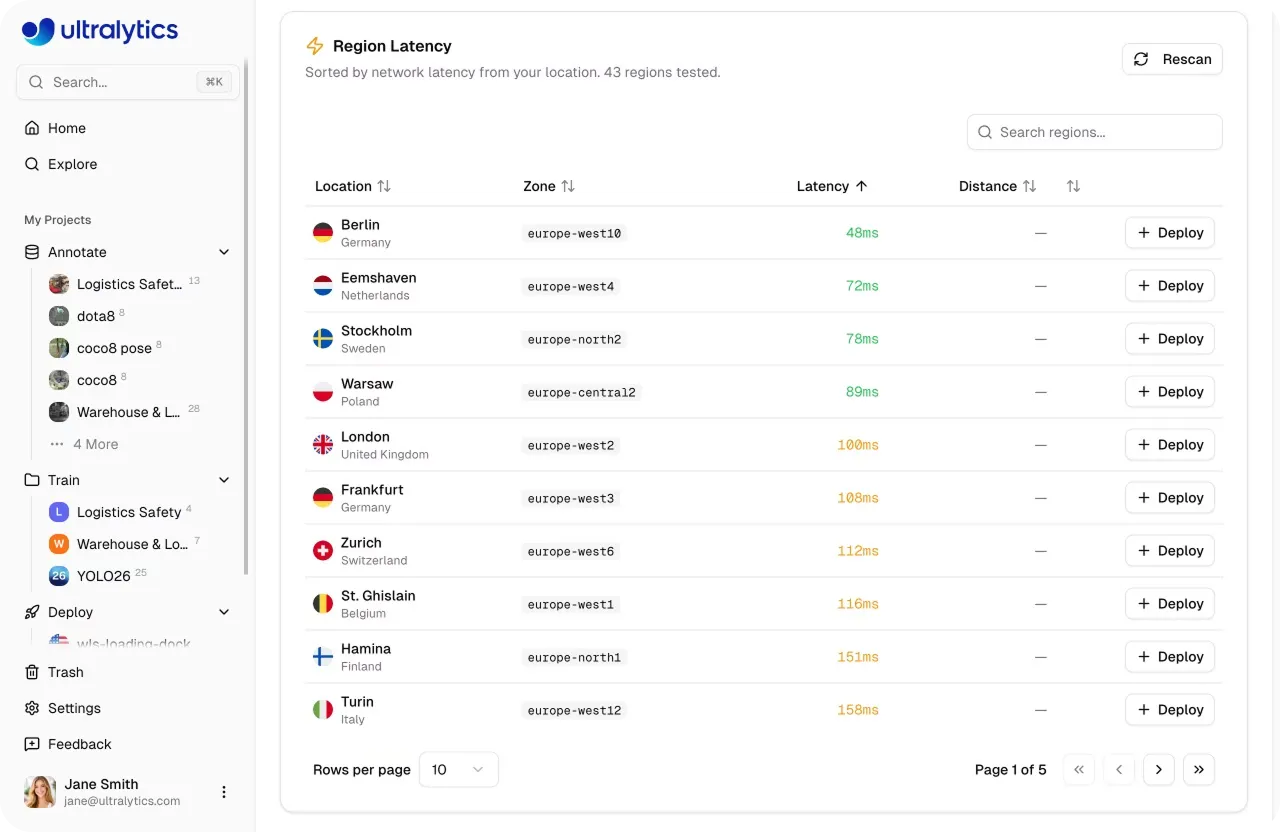

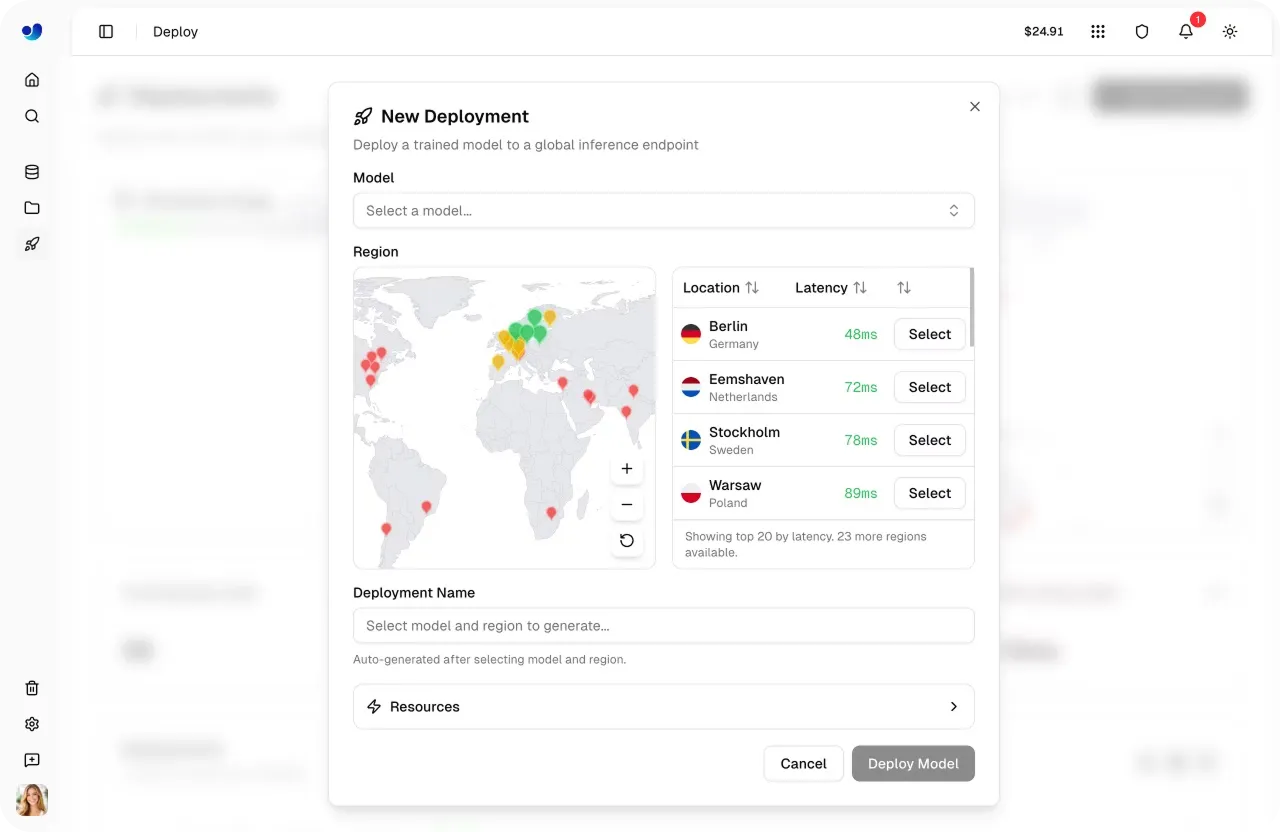

モデルを専用エンドポイントとしてデプロイすると、一意のAPI URLが割り当てられ、認証にはAPIキーが使用されるため、アプリケーションへの統合が容易になります。これらのエンドポイントは世界43のリージョンにデプロイできるため、ユーザーに近い場所で推論を実行し、レイテンシを低減することができます。

主な利点の一つは、オートスケーリングです。エンドポイントは受信リクエストに応じて自動的に調整され、トラフィックが増加した際にはスケールアップし、需要が低下した際にはスケールダウンします。デフォルトで「スケール・トゥ・ゼロ」が有効になっているため、エンドポイントはアイドル状態のときはシャットダウンし、必要に応じて再起動することができ、リソースの使用効率を最適化します。

つまり、専用エンドポイントは本番環境のワークロード向けに設計されています。共有型推論と比較して、一貫して低いレイテンシ、より高いスループット、そしてより高い信頼性を提供します。

また、専用エンドポイントにはレート制限がありません。リクエストはエンドポイントに直接送信されるため、処理可能なトラフィック量は固定の制限ではなく、設定やスケーリングによって決まります。

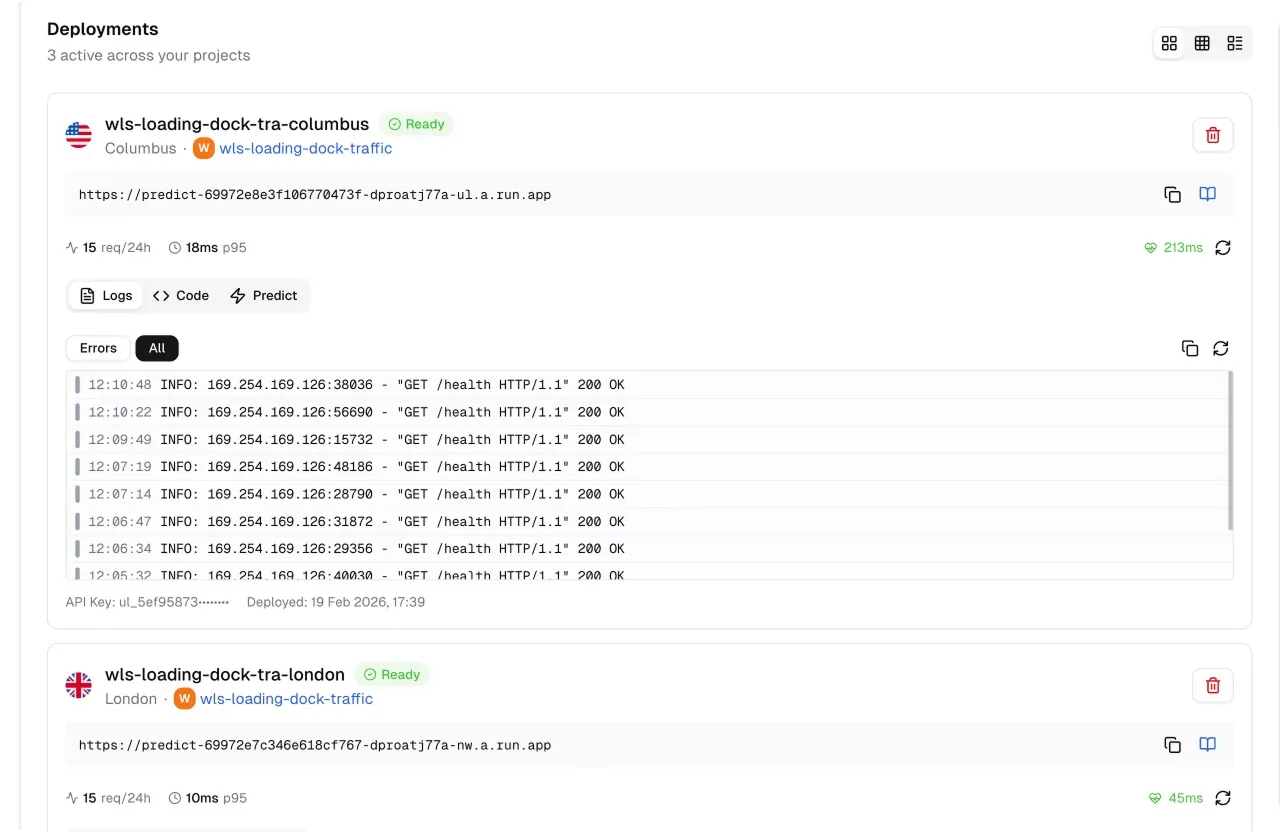

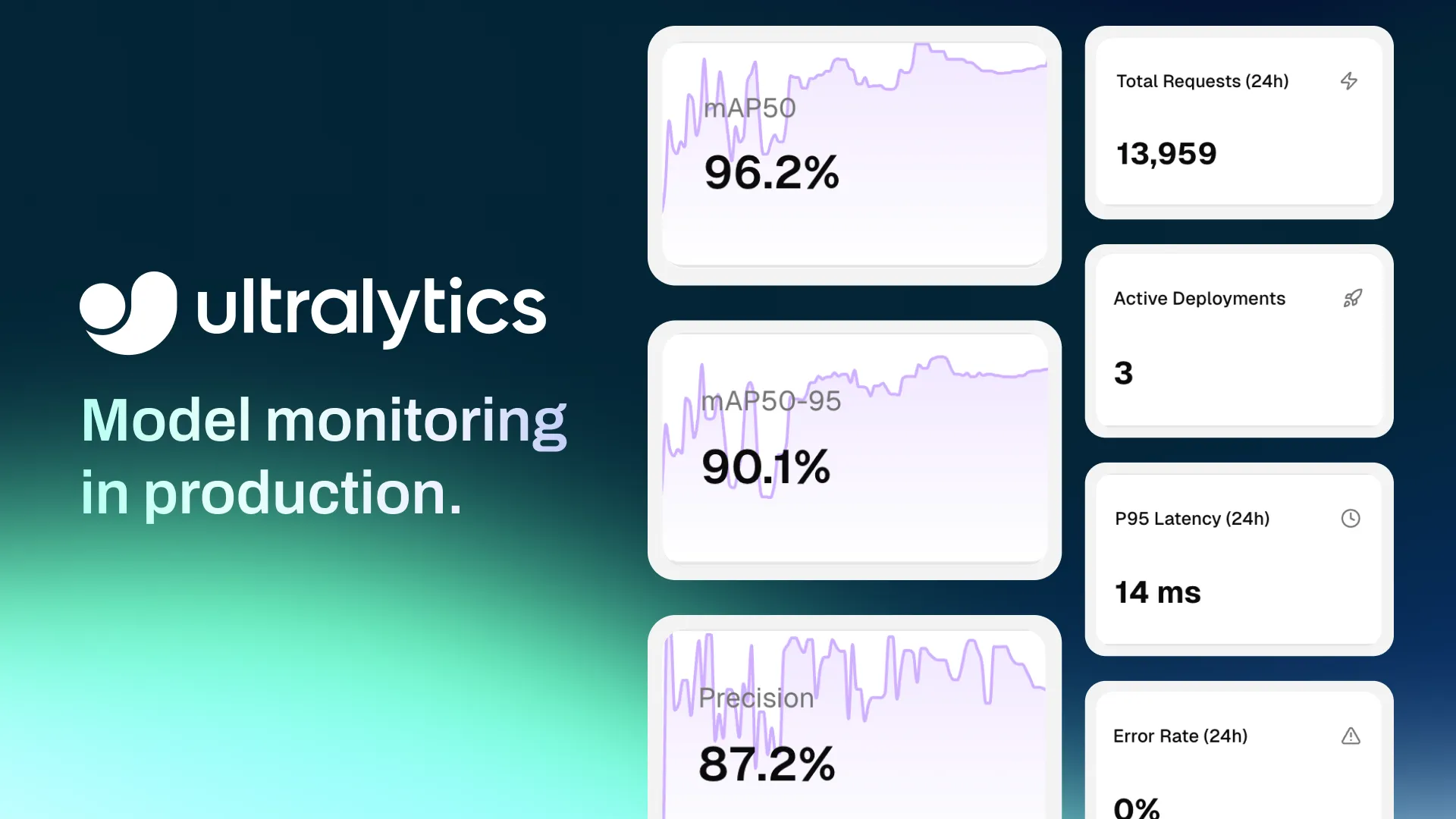

さらに、組み込みのモニタリング機能、ログ、ヘルスチェック、そして予測可能な実行時および起動時の動作により、すべてのプランにおいてtrack や安定したデプロイメントの維持が容易になります。Freeプランでは、コールドスタートに通常5~45秒かかりますが、Proプランのエンドポイントはウォーム状態を維持するため、より高速で予測可能な推論パフォーマンスが得られます。

端的に言えば、専用エンドポイントは、信頼性が高く、スケーラブルで、高性能な推論を必要とするリアルタイムのビジョンAIアプリケーションに最適です。

共有推論と専用エンドポイントの比較について、詳しく見ていきましょう:

AIや機械学習のアプリケーションがテスト段階から実運用へと移行するにつれ、パフォーマンス、スケーラビリティ、信頼性が不可欠となります。そのため、専用エンドポイントは共有型推論に比べて明らかな利点があります。

専用エンドポイントを使用すると、事前学習済みモデルやカスタムモデルが専用のコンピューティングリソース上で実行されるため、他のユーザーの影響を受けることなくパフォーマンスを維持できます。これにより、レイテンシを低くかつ安定した状態に保つことができ、動画分析や監視システムなどのリアルタイムアプリケーションにおいて重要です。

例えば、複数の店舗のライブ映像を処理する小売分析システムを考えてみましょう。世界43の地域にエンドポイントを配置することで、各店舗の近くで推論処理を実行できるようになり、遅延を低減し、応答時間を短縮できます。

リソースが共有され、処理領域が制限される共有推論では、負荷の高い時間帯にパフォーマンスが変動する可能性があります。

専用エンドポイントは、より多くのトラフィックを処理できるほか、需要に応じて自動的にスケールアウトします。組み込みのモニタリング、ログ、ヘルスチェック機能により、より予測可能なパフォーマンスを提供するため、大規模かつ継続的なAIワークロードに最適です。

共有推論と専用エンドポイントの違いについて検討する中で、共有推論がコンピュータビジョンのワークフロー全体の中でどのような位置づけにあるのか、疑問に思われるかもしれません。

小売分析の例をもう一度見てみましょう。複数の店舗にビジョンソリューションを導入する前に、チームは通常、実際のデータを用いてその性能をテストし、その結果に基づいてソリューションを改良する必要があります。

共有推論機能を利用すれば、店舗のカメラからサンプル画像や動画フレームを送信し、インフラを構築することなく予測結果を即座に確認できるため、このプロセスが簡素化されます。これは、モデルの挙動をテストしたり、誤った予測をデバッグしたり、照明や店舗レイアウトの変化など、さまざまな条件下での結果を検証したりする際に特に役立ちます。

このように反復作業を行うことで、チームは本番環境への移行前にモデルの精度と信頼性を向上させることができます。これらのテストシナリオでモデルが良好なパフォーマンスを発揮すれば、専用のエンドポイントにデプロイし、複数の拠点でリアルタイムに利用できるようになります。

共有推論は、利用頻度が低い、あるいは利用回数が少ないアプリケーションにおいても有効です。例えば、小規模な小売店では、大規模な展開を行うことなく、時折来店客数を分析したり、特定の時間帯の顧客動向を確認したりするために、この機能を活用できるでしょう。こうしたケースにおいて、共有推論はオンデマンドで推論を実行するための、シンプルかつ費用対効果の高い手段となります。

AIアプリケーションがテスト段階を超えて展開されるにつれ、導入方法の選択がパフォーマンス、スケーラビリティ、そしてユーザー体験に直接的な影響を及ぼすようになります。専用エンドポイントは、安定したパフォーマンス、低遅延、そして大規模なワークロードを処理する能力を備えているため、幅広い業界で広く活用されています。

以下に、専用エンドポイントが実際のアプリケーションでどのように活用されるかを示す、一般的な使用例をいくつか紹介します:

Ultralytics 主な利点の一つは、アプリケーションの規模拡大に伴い、共有型推論環境から専用エンドポイント環境へ移行するのが非常に簡単であるという点です。ツールを切り替えたり、環境を再構築したりする必要はなく、同じ環境内で本番環境向けのデプロイメントへ移行することができます。

共有推論でモデルをテストした後、専用エンドポイントへの移行は簡単な次のステップです。同じモデルをエンドポイントにデプロイし、希望するリージョンとコンピューティングリソースを選択して、アプリケーション内のエンドポイントURLを更新するだけです。全体的な統合方法はほぼ同じであるため、リクエストの送信方法やレスポンスの処理方法に変更はほとんどありません。

つまり、わずか数回のクリックでテスト環境から本番環境へと移行できます。ワークロードの増加や、アプリケーションにより安定したパフォーマンスが求められるようになった場合でも、既存のワークフローを中断することなく、専用エンドポイントへ移行することが可能です。

Ultralytics での専用エンドポイントを使用したモデルのデプロイについて詳しくは、Ultralytics の公式ドキュメントをご覧ください。

共有推論は、テストや実験を行う上で優れた出発点となりますが、本番環境のワークロードには、より高い一貫性と拡張性が求められます。アプリケーションが拡大するにつれ、専用エンドポイントは実運用を支えるために必要なパフォーマンスと信頼性を提供します。そのため、専用エンドポイントは、ほとんどの本番環境での導入において最適な選択肢となります。

ぜひコミュニティに参加し、GitHubリポジトリを閲覧して、コンピュータビジョンモデルについて詳しく学んでください。ソリューションページでは、農業分野でのAI活用やロボット工学におけるコンピュータビジョンなどの応用事例を紹介しています。ライセンスオプションをご確認の上、ビジョンAIの活用を始めてみましょう。

未来の機械学習で、新たな一歩を踏み出しましょう。