Ultralytics YOLO モデルが、正確で精度の高い検出を提供することで、車両再識別ソリューションにどのような役割を果たすことができるかをご覧ください。

Ultralytics YOLO モデルが、正確で精度の高い検出を提供することで、車両再識別ソリューションにどのような役割を果たすことができるかをご覧ください。

F1レースを観戦するとき、お気に入りのチームのマシンを見つけるのは簡単だ。フェラーリの真っ赤なマシンやメルセデスのシルバーのマシンは、周回を重ねるごとに目立ってくる。

クリーンなレーストラックではなく、交通量の多い混雑した市街地でマシンに同じことを求めるのは、はるかに困難だ。だからこそ、車両再識別(vehicle re-ID)が最近AI分野で注目を集めているのだ。

車両再同定は、多視点または非重複カメラにまたがって同じ車両を認識する能力を機械に与える。また、一時的なオクルージョン(車両が部分的に隠れている場合)や照明や視点の移動の後でも車両を識別することを目的としています。

車両の再ID化を支える中核技術は、コンピュータ・ビジョンである。コンピュータ・ビジョンは人工知能の一分野であり、画像やビデオなどの視覚情報を理解し解釈するよう機械に教えることに重点を置いている。この技術を使用することで、AIシステムは車両の特徴を分析し、都市監視や交通監視などのアプリケーションのために、大規模なカメラネットワーク全体で車両を確実にtrack ことができる。

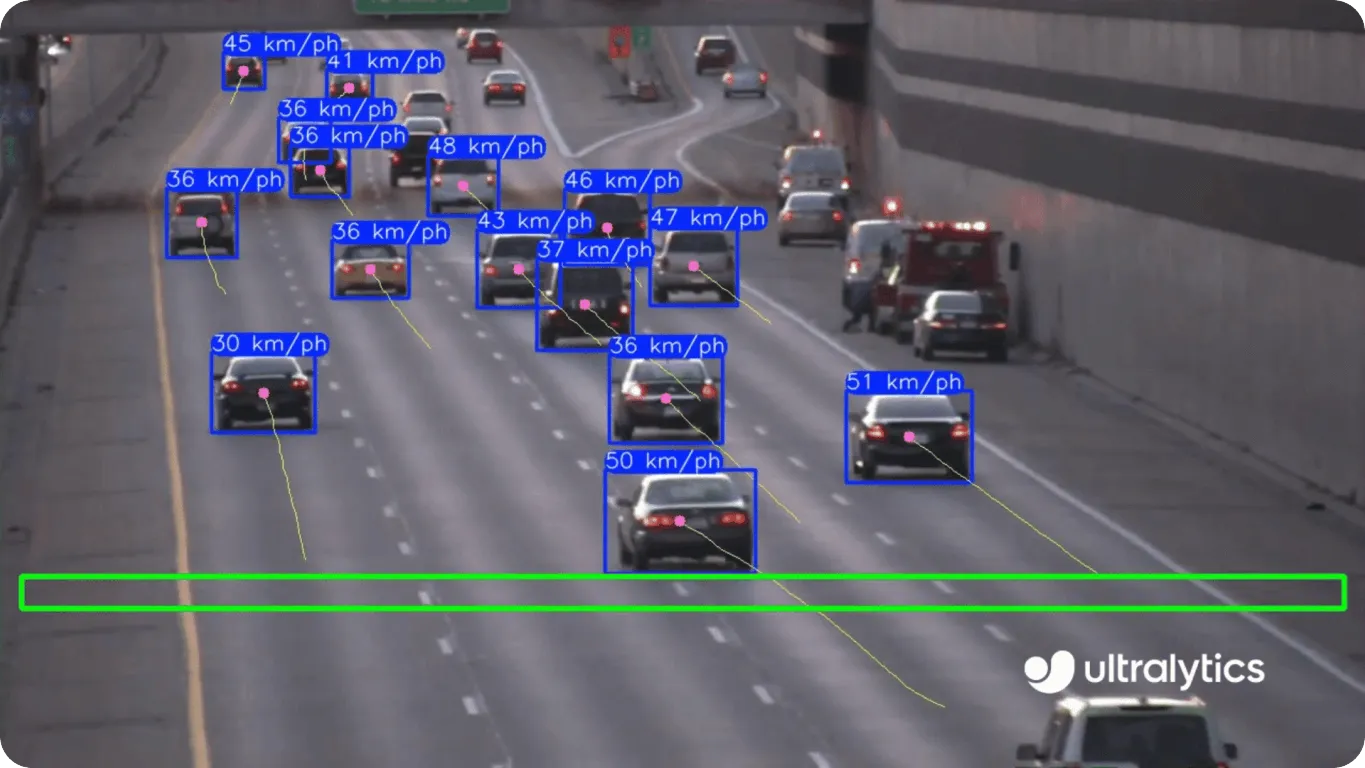

特に、以下のようなVision AIモデルは、そのようなAIモデルである。 Ultralytics YOLO11やUltralytics YOLO26のようなビジョンAIモデルは、物体検出や追跡のようなタスクをサポートします。これらのモデルは、各フレーム内の車両を素早く特定し、シーン内の動きを追跡することができます。これらのモデルを車両再同定ネットワークと組み合わせると、ビューや照明条件が変わっても、異なるカメラフィード間で同じ車両を認識することができます。

この記事では、車両再識別がどのように機能するのか、それを可能にする技術、そしてインテリジェント交通システムでどのように使用されているのかを見ていく。始めよう!

車両の再同定は、コンピュータ・ビジョンにおける重要なアプリケーションである。これは、異なる、重複しないカメラにまたがって現れる同じ車両を認識することに重点を置き、都市内を移動する際にその同一性を一貫して保つ。これは、各カメラが車両を異なる角度から、異なる照明下で、または部分的なオクルージョンで撮影する可能性があるため、困難である。

ある交差点を通過した青いセダンが、別のカメラによって別の通りに現れた場合を考えてみよう。角度、照明、背景はすべて変わり、他の車が一瞬視界を遮るかもしれない。にもかかわらず、車両再認識システムは同じ車両であると判断する必要がある。

ディープラーニング、特に畳み込みニューラルネットワーク(CNN)とトランスフォーマーベースのモデルにおける最近の進歩は、このプロセスをはるかに正確なものにしている。これらのモデルは、意味のある視覚的パターンを抽出し、そっくりな車を区別しながらも、正しい車を識別することができる。

インテリジェント交通システムにおいて、この機能は継続的なモニタリング、ルート再構築、都市全体の交通解析をサポートし、スマートシティシステムに車両の動きをより明確に把握させる。安全性と効率性の向上に役立つ。

通常、交差点、パーキングエリア、高速道路などのビデオ映像は、車両再識別技術を使用して分析され、異なるカメラに同じ車両が映っているかどうかを判断する。このコンセプトは、システムが複数のビューにわたって個人をtrack する人物再同定と似ているが、ここでは人間の外見ではなく車両固有の特徴を分析することに重点が置かれている。

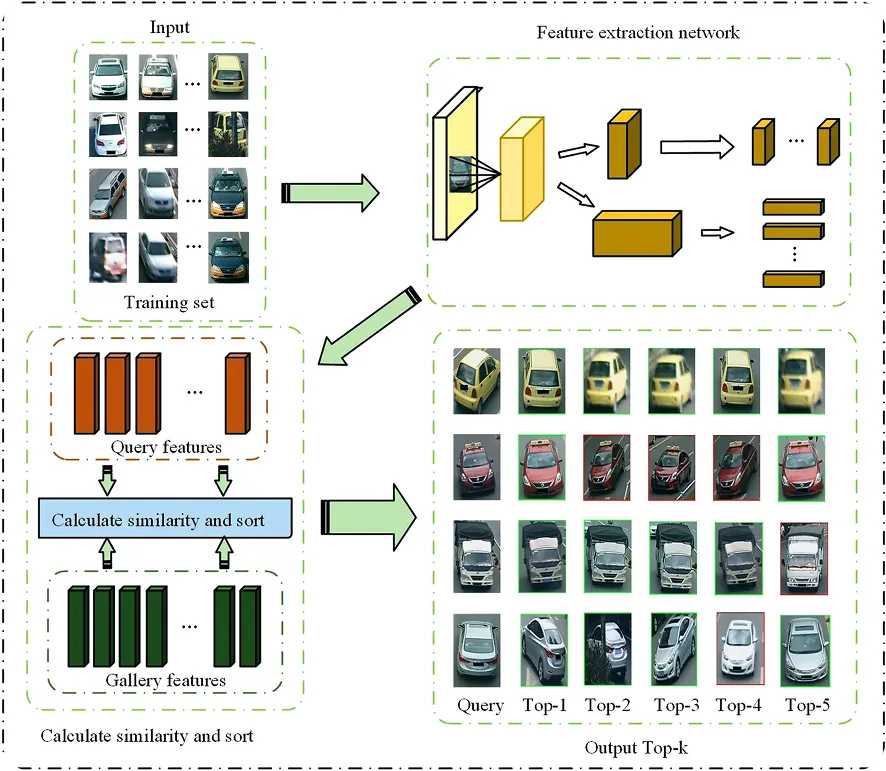

このプロセスにはいくつかの重要なステップがあり、それぞれシステムが車両をdetect し、視覚的特徴を抽出し、異なる視点間で確実に照合できるように設計されている。

高度なレベルでは、システムはまず各フレームで車両を検出し、次に色、形、テクスチャなどの特徴を抽出して、それぞれ固有のデジタル表現(エンベッディング)を作成する。これらのエンベッディングは、多くの場合、オブジェクト追跡や時空間チェックによってサポートされながら、時間やカメラ間で比較され、2つの目撃情報が同じ車両に属するかどうかを決定する。

このプロセスを詳しく見てみよう:

Ultralytics YOLO モデルは、車両の再識別パイプラインにおいて重要な補助的役割を果たします。YOLOモデルはそれ自体で再同定を行うわけではありませんが、高速検出や安定したトラッキングなど、再同定ネットワークが正確なクロスカメラマッチングに依存するその他の重要な機能を提供します。

次に、YOLO11 ようなUltralytics YOLO モデルが、車両再識別システムをどのように強化できるかを詳しく見てみよう。

車両再識別システムの基本は、正確な物体検出です。YOLO11 ようなUltralytics YOLO モデルは、部分的なオクルージョン、激しい交通量、変化する照明条件などの混雑したシーンでも、各フレームで車両を素早くdetect できるため、このような場合に最適です。

また、カスタムトレーニングも可能です。つまり、独自のデータセットでモデルを微調整し、タクシー、配送バン、フリート車両など、特定の車両タイプを認識するように学習させることができます。これは、ソリューションがより専門的な検出を必要とする場合に特に便利です。Ultralytics YOLO モデルは、クリーンで正確なバウンディングボックスを提供することで、Re-IDネットワークに高品質な入力を与え、カメラ間でより信頼性の高いマッチングを実現します。

車両が検出されると、YOLO11 ようなモデルは、単一のカメラビュー内で安定したオブジェクトトラッキングをサポートすることもできます。オブジェクトトラッキングとは、検出された車両を連続したフレームで追跡し、その移動に合わせて一貫したIDを割り当てるプロセスです。

Ultralytics Python パッケージのByteTrackやBoT-SORTのようなトラッキングアルゴリズムのビルトインサポートにより、YOLO11 車両がシーン内を移動する際に一貫したIDを維持することができます。この安定したトラッキングにより、Re-IDシステムが引き継ぐ前にIDが切り替わることが少なくなり、結果的にクロスカメラマッチングの精度が向上します。

標準的なモーション・ベースのトラッキングに加え、Ultralytics Python パッケージには、BoT-SORTトラッカー内にオプションで外観ベースのRe-ID機能が含まれています。これは、トラッカーが2つの検出が同じ車両に属するかどうかを判断するために、モーションパターンやバウンディングボックスのオーバーラップだけでなく、視覚的な外観の特徴を使用できることを意味します。

有効にすると、BoT-SORTは検出器またはYOLO11 分類モデルから軽量の外観埋め込みを抽出し、それを使ってフレーム間の同一性を検証します。この追加的な外観の手がかりは、短時間のオクルージョン、接近して通過する車両、カメラの動きによるわずかなシフトなどの困難な状況において、トラッカーがより安定したIDを維持するのに役立ちます。

このビルトイン Re-ID は、完全なクロスカメラ車両再識別に取って代わることを意図しているわけではありませんが、単一カメラビュー内での識別の一貫性を改善し、下流の Re-ID モジュールが信頼できるよりクリーンなトラックレットを生成します。これらの外観ベースのトラッキング機能を使用するには、BoT-SORT トラッカー設定ファイルで "with_reid" を "True" に設定し、外観機能を提供するモデルを選択することで Re-ID を有効にするだけです。

詳細については、オブジェクト追跡に関する Ultralytics ドキュメントページで、利用可能なRe-IDオプションとその設定方法を説明しています。

トラッキング中のアイデンティティの安定性を向上させるだけでなく、YOLO モデルはRe-IDネットワーク自体にクリーンな視覚入力を準備する上でも重要な役割を果たしている。

車両が検出された後、そのバウンディングボックスは通常切り取られ、照合に必要な視覚的特徴を抽出する再識別ネットワークに送られる。再識別モデルはこれらの切り抜き画像に大きく依存するため、不鮮明な画像、位置のずれた画像、不完全な切り抜き画像などの入力が悪いと、埋め込みが弱くなり、カメラ間の照合の信頼性が低くなります。

Ultralytics YOLO モデルは、対象車両を完全にキャプチャする、きれいで整列したバウンディングボックスを一貫して生成することで、これらの問題を軽減するのに役立ちます。より明確で正確なクロップにより、Re-IDネットワークは、色、形状、テクスチャ、その他の識別特徴などの意味のある詳細に焦点を当てることができます。高品質な入力は、カメラビュー全体にわたって、より信頼性が高く正確なRe-IDパフォーマンスにつながります。

Ultralytics YOLO モデルは、それ自体では再識別を実行しませんが、異なるカメラビュー間で車両を比較するために再識別ネットワークが必要とする重要な情報を提供します。YOLO11 ようなモデルは、各カメラ内で車両の位置特定と追跡を行うことができますが、Re-IDモデルは異なる場所から撮影された2つの車両が同じIDに属するかどうかを判断します。

検出と追跡のためのYOLO 、特徴抽出のための専用エンベッディングモデル、これらのコンポーネントが一緒に働くと、完全なマルチカメラ車両照合パイプラインが形成されます。これにより、より大きなカメラネットワークを移動する同じ車両を関連付けることが可能になります。

例えば、最近の研究では、研究者はオンライン・マルチカメラ・トラッキング・システムの車両検出器として軽量のYOLO11 モデルを使用しました。この研究では、YOLO11 使用することで、精度を犠牲にすることなく検出時間を短縮することができ、ダウンストリームトラッキングとクロスカメラマッチングの全体的なパフォーマンスが向上することがわかりました。

Ultralytics YOLO モデルがどのように車両の再識別をサポートできるかを理解したところで、特徴抽出とマッチングのステップを処理するディープラーニングモデルを詳しく見てみましょう。これらのモデルは、車両の外観を学習し、ロバストな埋め込みを作成し、異なるカメラビュー間で視覚的に類似した車両を区別する役割を担っています。

以下は、物体再識別システムで使用されるコアとなる深層学習コンポーネントの例である:

これらのアーキテクチャ構成要素に加えて、メトリック学習が車両再識別モデルの学習において重要な役割を果たす。トリプレットロス、コントラストロス、クロスエントロピーロスなどのロス関数は、同じ車両の画像を引き寄せ、異なる画像を引き離すことで、システムが強力で識別性の高い埋め込みを学習するのに役立ちます。

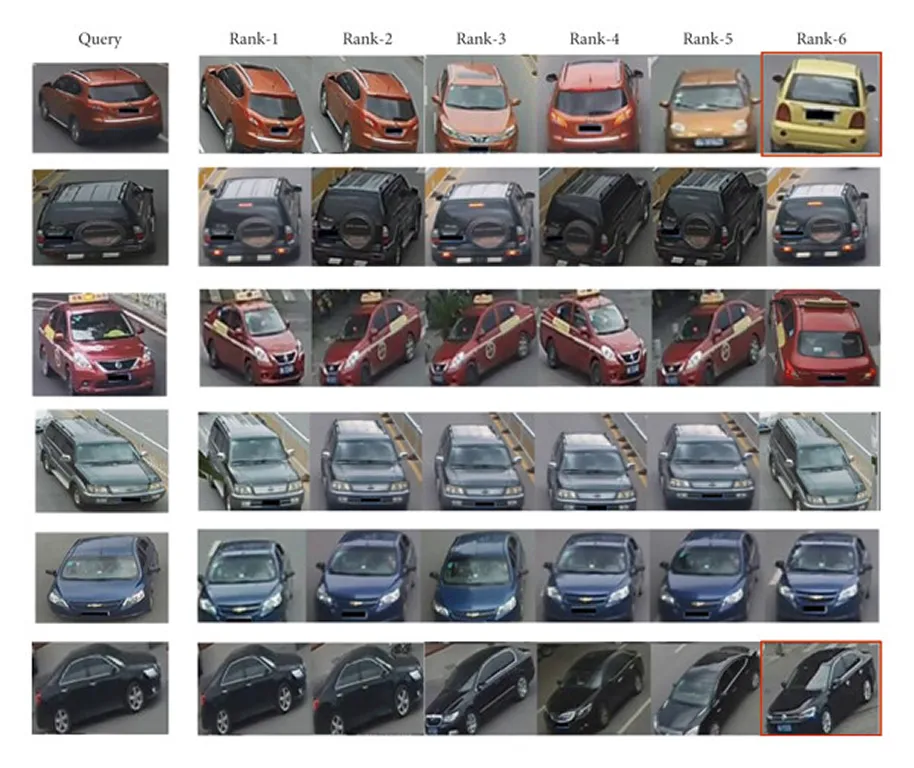

コンピュータ・ビジョンの研究において、データセットの質は、導入後のモデルの性能に大きな影響を与える。データセットは、モデルが学習するラベル付きの画像や動画を提供する。

車両の再識別のためには、これらの最先端のデータセットは、照明、視点の変化、天候の変化などの多様な条件を捕捉する必要がある。この多様性は、モデルが実世界の交通環境の複雑さを処理するのに役立つ。

ここでは、車両再識別モデルのトレーニング、最適化、評価をサポートする一般的なデータセットを紹介します:

これらのデータセットにおけるモデルの性能は、通常、平均平均精度mAP)やRank-1またはRank-5の精度などのメトリクスを用いて評価される。mAP 、モデルが与えられた車両に関連するすべてのマッチをどれだけ正確に検索したかを測定し、Rank-1およびRank-5のスコアは、正しいマッチが結果リストの最上位に表示されるか、最初の数回の予測内に表示されるかを示す。

これらのベンチマークは、研究者が異なるアプローチを比較するための一貫した方法を提供し、実世界で使用するためのより正確で信頼性の高い車両再識別システムの開発を導く上で重要な役割を果たす。

さて、基本的なことを説明したところで、車両再識別が実用的な輸送、モビリティ、監視ワークフローをサポートする実際のユースケースをいくつか見ていこう。

交通量の多い市街地の道路は常に流動的であり、交通カメラはしばしば、異なるエリア間を移動する同じ車両をtrack するのに苦労する。照明の変化、混雑したシーン、ほとんど同じに見える車両によって、カメラ間で同一性が失われることがある。

車両の再識別は、車両を明確に検出し、特徴的な特徴を抽出し、低解像度や混雑した映像でも一貫したIDを維持することによって、この問題に対処します。その結果、ネットワーク全体にわたってよりスムーズで継続的な追跡が可能になり、交通チームは車両が市街地をどのように移動しているかをより明確に把握できるようになり、渋滞や事故に対してより迅速で十分な情報に基づいた対応ができるようになります。

スマートパーキング施設は、入出庫、アクセス制御、スペース割り当てを管理するために、一貫した車両識別に依存しています。しかし、このような環境でのカメラは、地下駐車場、日陰の場所、夕暮れの屋外駐車場など、通常とは異なる角度や厳しい照明の下で車両を撮影することがよくあります。

このような状況では、異なるゾーンで同じ車両が目撃されているかどうかの確認が難しくなる。IDが一貫していない場合、駐車記録が破損する可能性があり、アクセス制御の信頼性が低下し、ドライバーは遅延を経験する可能性がある。そのため、多くのスマートパーキングシステムは、施設内を移動する各車両のIDを安定的に維持するために、車両再識別モデルを組み込んでいる。

交通監視に加え、車両の再同定も法執行や科学捜査において重要な役割を果たしている。多くの場合、警官が複数のカメラで車両を追跡する必要があるが、ナンバープレートが読めなかったり、欠けていたり、意図的に隠されていたりすることがある。

混雑したシーン、低視認性、部分的なオクルージョンにより、異なる車両が欺瞞的に類似して見えることがあり、手作業による識別は時間がかかり、信頼性に欠ける。車両再同定は、ナンバープレートだけに頼るのではなく、視覚的特徴を分析することにより、重複しないカメラネットワークを横断して車両の動きを追跡するために使用することができる。

これは、捜査官がより簡単に車両の動きを追跡し、異なる場所にいつ現れたかを理解し、事件の前後にその経路を確認できることを意味します。AIを搭載した車両再IDは、容疑車両の追跡、事件映像の確認、事件前後の車両の走行方向の決定などの作業もサポートします。

フリートやロジスティクスのオペレーションは、車両の動きをtrack するためにGPS、RFIDタグ、手動のログに頼ることが多いが、これらのツールは、ローディングベイ、倉庫のヤード、内部の道路ネットワークなど、セキュリティカメラやヤードカメラでカバーされている領域ではギャップを残す。

車両は、重複しないカメラ間を頻繁に移動したり、構造物の陰に隠れたり、他の車両とほとんど同じに見えたりするため、同じ車両が異なる場所で目撃されているかどうかを確認することが困難です。車両再識別システムは、視覚的な詳細とタイミング情報を分析し、施設内を移動する各車両の一貫した識別を維持することで、このようなギャップを埋めるのに役立ちます。

これにより、フリート管理者はハブ内の活動をより完全に把握できるようになり、配送経路の確認、異常な動きの特定、車両が予定された経路を確実に走行することなどの作業をサポートできる。

AIを活用した車両再識別の主なメリットは以下の通り:

車両再識別には多くの利点がある一方で、考慮すべき限界もある。ここでは、実環境における信頼性に影響するいくつかの要因を紹介する:

技術の進化に伴い、車両の再識別は進歩し続けている。IEEE、CVPR、arXivから最近発表された論文や、国際会議での発表は、複数のデータソースとより高度な特徴推論を組み合わせた、よりリッチなモデルへの明確なシフトを強調している。この分野での今後の研究は、より頑健で、効率的で、実世界の変動性をスケールで処理できるシステムの構築に焦点が当てられるだろう。

例えば、1つの有望な方向性は、変換器ベースのモデルとグラフ集約ネットワークの使用である。トランスフォーマーは画像全体を分析し、すべての視覚的詳細がどのように組み合わされているかを理解することができるため、角度や照明が変わってもシステムが同じ車両を認識するのに役立つ。

グラフベースのモデルは、異なる車両部品やカメラビューをネットワーク内の接続点として扱うことで、これをさらに一歩進めます。これにより、システムはこれらのキーポイント間の相関関係を理解し、車両の識別や識別特徴についてより良い判断を下すことができる。

もうひとつの重要な進歩は、マルチモーダルデータフュージョンとフィーチャーフュージョンである。最新のシステムでは、画像だけに頼るのではなく、視覚情報をGPSデータやセンサーからのモーション・パターンなどの他のマルチメディア信号と組み合わせている。車両が部分的に遮られたり、照明が悪かったり、カメラの角度が突然変わったりした場合でも、このような追加的なコンテキストによって、システムは正確性を維持しやすくなる。

車両の再同定は、インテリジェント交通システムにおける重要な手法となりつつあり、都市が異なるカメラ間で車両をより確実にtrack のに役立っている。ディープラーニングの進歩と、より豊富で多様なデータセットを用いた検証の改善により、これらのシステムはより正確で、実環境で実用的なものになりつつある。

テクノロジーが進化するにつれ、プライバシー、セキュリティ、倫理に関わる責任ある慣行とイノベーションのバランスをとることが重要になってくる。全体として、これらの進歩は、よりスマートで、より安全で、より効率的な輸送ネットワークへの道を開いている。

GitHubリポジトリにアクセスし、私たちのコミュニティに参加することで、AIについてさらに詳しく調べることができます。ロボット工学におけるAIと 製造業におけるコンピュータビジョンについては、ソリューションページをご覧ください。今すぐVision Aを使い始めるためのライセンスオプションをご覧ください!

未来の機械学習で、新たな一歩を踏み出しましょう。