Baue ein kamerabasiertes Bildinspektionssystem ohne KI-Expertise

Erfahre, wie du ohne KI-Expertise ein kamerabasiertes Bildinspektionssystem mit der Ultralytics Plattform aufbaust – von der Etikettierung bis zum Deployment.

Jedes Produkt, das wir nutzen, sei es ein Telefon, ein verpackter Artikel oder ein Autoteil, durchläuft eine Form der Qualitätsprüfung, bevor es uns, den Endverbraucher, erreicht. Dies geschah traditionell durch manuelle Kontrollen oder einfache regelbasierte Systeme. Obwohl diese Methoden funktionieren, sind sie oft langsam, inkonsistent und bei steigender Produktion schwer zu skalieren.

Um den Prozess der Qualitätsprüfung zu verbessern, setzen viele Branchen auf Computer Vision, einen Zweig der künstlichen Intelligenz, der Maschinen hilft, Bilder und Videos zu verstehen. Zum Beispiel können Vision-KI-Modelle wie Ultralytics YOLO26 helfen, Defekte mit hoher Genauigkeit zu erkennen, zu klassifizieren und zu lokalisieren.

In realen Produktionsumgebungen können diese Modelle verwendet werden, um Bilder zu analysieren, die direkt von Hochgeschwindigkeits-Fertigungslinien stammen. Während Produkte verschiedene Stadien durchlaufen, verfolgen Industriekameras sie, und das System prüft auf Probleme wie Kratzer, fehlende Teile oder Fehlstellungen. Dies macht die Defekterkennung schneller und konsistenter und unterstützt gleichzeitig eine Prüfung mit hohem Durchsatz.

Früher erforderte der Aufbau dieser Systeme mehrere Tools und fundiertes technisches Know-how, was den Prozess komplex und zeitaufwendig machte. Die Ultralytics Platform, unsere neue End-to-End-Lösung für Computer Vision, vereinfacht dies, indem sie Datenvorbereitung, Annotation, Modelltraining und Bereitstellung an einem Ort vereint.

In diesem Artikel zeigen wir dir, wie du die Ultralytics Platform nutzen kannst, um praktische, kamerabasierte Bildverarbeitungssysteme ohne tiefgreifendes KI-Expertenwissen aufzubauen. Fangen wir an!

Link to this sectionDie Rolle von Computer Vision bei der Qualitätskontrolle#

Bevor wir uns damit befassen, wie die Ultralytics Platform den Bau von Prüfsystemen erleichtert, lass uns einen Schritt zurücktreten und die Rolle von Computer Vision bei der Qualitätsprüfung verstehen.

Die Prüfung ist ein zentraler Bestandteil des Fertigungsprozesses, der sicherstellt, dass Produkte Qualitätsstandards erfüllen und frei von Defekten sind. Die Ergebnisse können jedoch variieren, insbesondere während langer Schichten oder bei hochvolumiger Produktion.

Um die Prüfung zuverlässiger zu machen, nutzen viele Industrien Computer Vision, auch bekannt als Machine Vision, um Bilder aus der Produktionslinie zu analysieren und Defekte zu identifizieren. Diese Systeme nutzen Deep Learning, bei dem Modelle und Algorithmen Muster aus großen Mengen hochwertiger, gekennzeichneter Bilder lernen.

Während des Modelltrainings werden dem Modell Beispiele sowohl von normalen Produkten als auch von verschiedenen Arten von Defekten gezeigt. Mit der Zeit lernt es, diese Muster selbstständig zu erkennen. Sobald es trainiert ist, kann ein Modell große Mengen an Produkten prüfen und dieselben Kriterien konsistent anwenden, was die Genauigkeit verbessert.

Link to this sectionGängige Computer-Vision-Aufgaben in der Qualitätsprüfung#

Machine-Vision-Anwendungen werden durch Computer-Vision-Modelle wie Ultralytics YOLO Modelle ermöglicht, die verschiedene Arten von Vision-Aufgaben unterstützen. Hier ist ein Überblick, wie diese Vision-KI-Aufgaben für automatisierte Prüfabläufe genutzt werden:

- Bildklassifizierung: Diese Aufgabe wird verwendet, um einem gesamten Bild ein einzelnes Label zuzuweisen, wie „gut“ oder „defekt“. Sie bietet eine grundlegende Einschätzung der Produktqualität, ohne den Ort der Defekte anzugeben.

- Objekterkennung: Sie hilft dabei, Defekte in einem Bild zu identifizieren und sie mithilfe von Bounding Boxes zu lokalisieren. Dies ermöglicht es, Probleme wie Risse, Kratzer oder fehlende Komponenten zu erkennen und zu verorten.

- Instanz-Segmentierung: Ein Schritt weiter als die Objekterkennung, sagt sie pixelgenaue Masken für jeden erkannten Defekt voraus. Dies unterstützt eine präzise Analyse von Form, Größe und Grenzen von Defekten.

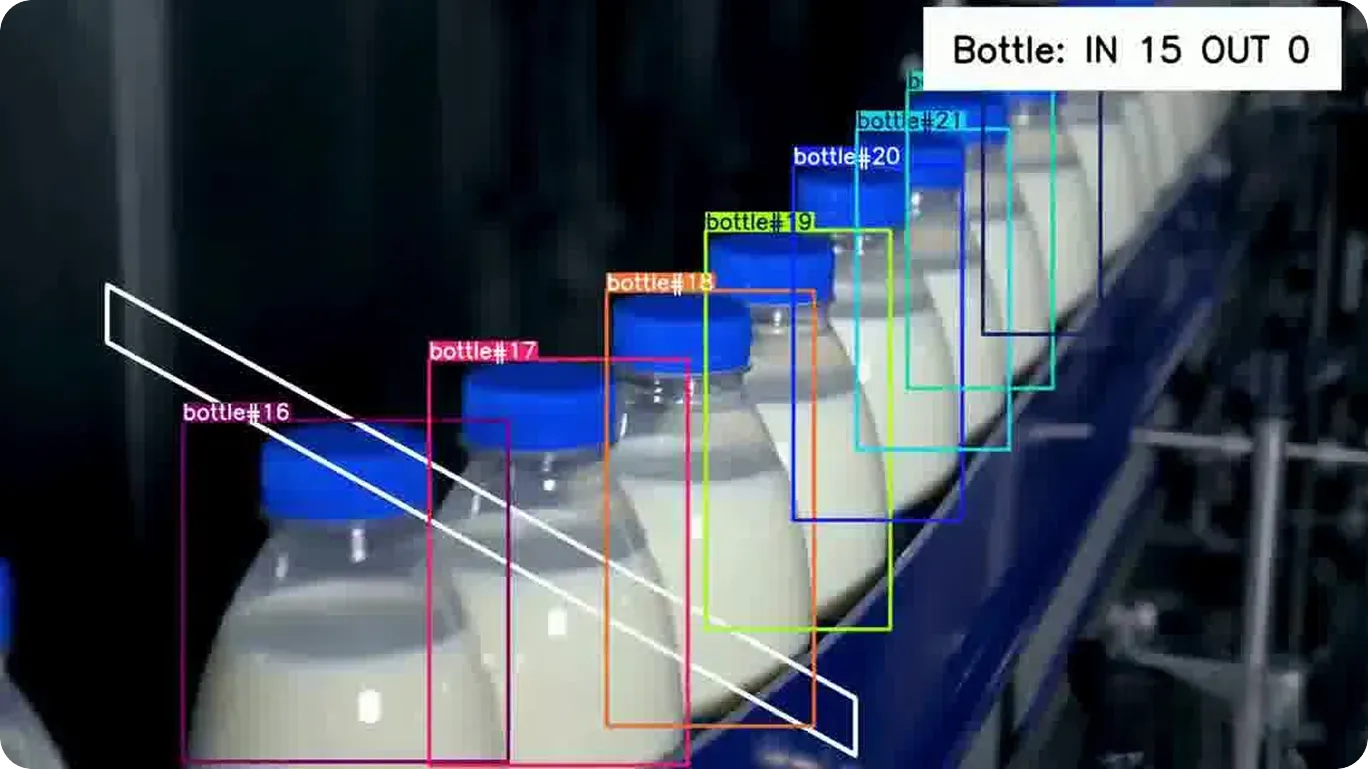

- Objektverfolgung: Beim Verfolgen von Produkten über mehrere Frames hinweg, folgt sie den Artikeln, während sie sich durch die Produktionslinie bewegen. Dies wahrt die Konsistenz und stellt sicher, dass Defekte nicht übersehen werden.

- Oriented Bounding Box (OBB) Erkennung: Diese Aufgabe erkennt Objekte mithilfe gedrehter Bounding Boxes anstelle von achsenparallelen. Sie ist besonders nützlich, wenn Defekte oder Komponenten in verschiedenen Winkeln erscheinen, was eine genauere Lokalisierung ermöglicht.

Link to this sectionEin Blick auf Anwendungen der Qualitätsprüfung über verschiedene Branchen hinweg#

Computer Vision wird in vielen Branchen breit eingesetzt, um die Produktqualität aufrechtzuerhalten, Standards zu erfüllen und den Bedarf an manueller Prüfung zu reduzieren. Es übernimmt Schlüsselfunktionen wie Defekterkennung, Klassifizierung, Objekterkennung, Messung und Anomalieerkennung.

Abb. 1. Ein Beispiel für die Erkennung und Verfolgung von Produkten mithilfe von Machine-Vision-Systemen (Quelle)

Hier sind einige Beispiele für reale Anwendungsfälle, in denen es eingesetzt wird:

- Fertigung: Die Erkennung von Oberflächendefekten wird verwendet, um Probleme wie Kratzer, Dellen, Risse und Verfärbungen zu identifizieren, indem Bilder von Produkten auf der Produktionslinie für eine In-Line-Defekterkennung analysiert werden. Es kann auch fehlende Teile oder Montagefehler in Echtzeit erkennen und eine kontinuierliche Prüfung unterstützen.

- Automobilindustrie: Computer-Vision-Systeme analysieren Motorteile und Karosserieteile, um die Ausrichtung zu überprüfen und Schäden zu erkennen. Sie sind besonders effektiv bei der Inspektion komplexer Formen und schwer zugänglicher Bereiche und arbeiten oft mit Robotersystemen für präzise Positionierung und automatisierte Prüfung zusammen.

- Elektronik und Halbleiter: Diese Systeme erkennen kleine Defekte in Komponenten wie Leiterplatten (PCBs), einschließlich Lötproblemen, Mikrorissen und beschädigten Schaltkreisen. Mit hochauflösender Bildanalyse können selbst sehr feine Defekte erkannt werden, die bei einer manuellen Prüfung oft übersehen werden.

- Verpackung und Logistik: Visuelle Systeme führen Barcode-Scans durch, lesen Produktetiketten und prüfen die Verpackungsqualität. Sie stellen sicher, dass Produkte korrekt verpackt, versiegelt und versandfertig sind, was Fehler reduziert.

- Lebensmittel und Getränke: Prüfsysteme, die durch Vision-Kameras oder Vision-Sensoren unterstützt werden, analysieren das Erscheinungsbild von Produkten, um Probleme wie unsachgemäße Versiegelung, Kontaminationsrisiken, falsche Etikettierung oder visuelle Inkonsistenzen zu identifizieren, was hilft, Qualität und Sicherheit zu wahren.

- Pharmazeutik: Computer Vision wird verwendet, um Tabletten, Ampullen und Verpackungen auf Defekte wie Risse, Kontaminationen, falsche Etikettierung oder Unstimmigkeiten beim Füllstand zu prüfen, um die Einhaltung strenger regulatorischer Standards sicherzustellen und die Produktsicherheit zu gewährleisten.

Link to this sectionOptimierung von visuellen Inspektionsabläufen mit der Ultralytics Platform#

Stell dir eine Fertigungslinie vor, auf der Produkte verschiedene Stadien durchlaufen, während Kameras kontinuierlich Bilder für die Prüfung erfassen. Diese Bilder werden verwendet, um auf Defekte wie Kratzer, fehlende Teile oder Fehlstellungen zu prüfen.

Bisher erforderte der Aufbau und die Verwaltung solcher Prüfsysteme mehrere Tools und ein gewisses Maß an technischem Fachwissen.

Tatsächlich haben wir bei Ultralytics konsistentes Feedback aus der Vision-KI-Community erhalten, wie fragmentiert und zeitaufwendig dieser Prozess sein kann, wobei häufige Engpässe verstreute Werkzeuge, komplexe Umgebungseinrichtung, ineffiziente Daten-Labeling-Workflows, Verzögerungen beim Modelltraining und Herausforderungen bei der Bereitstellung sind. Dieses Feedback spielte eine Schlüsselrolle bei der Gestaltung der Ultralytics Platform.

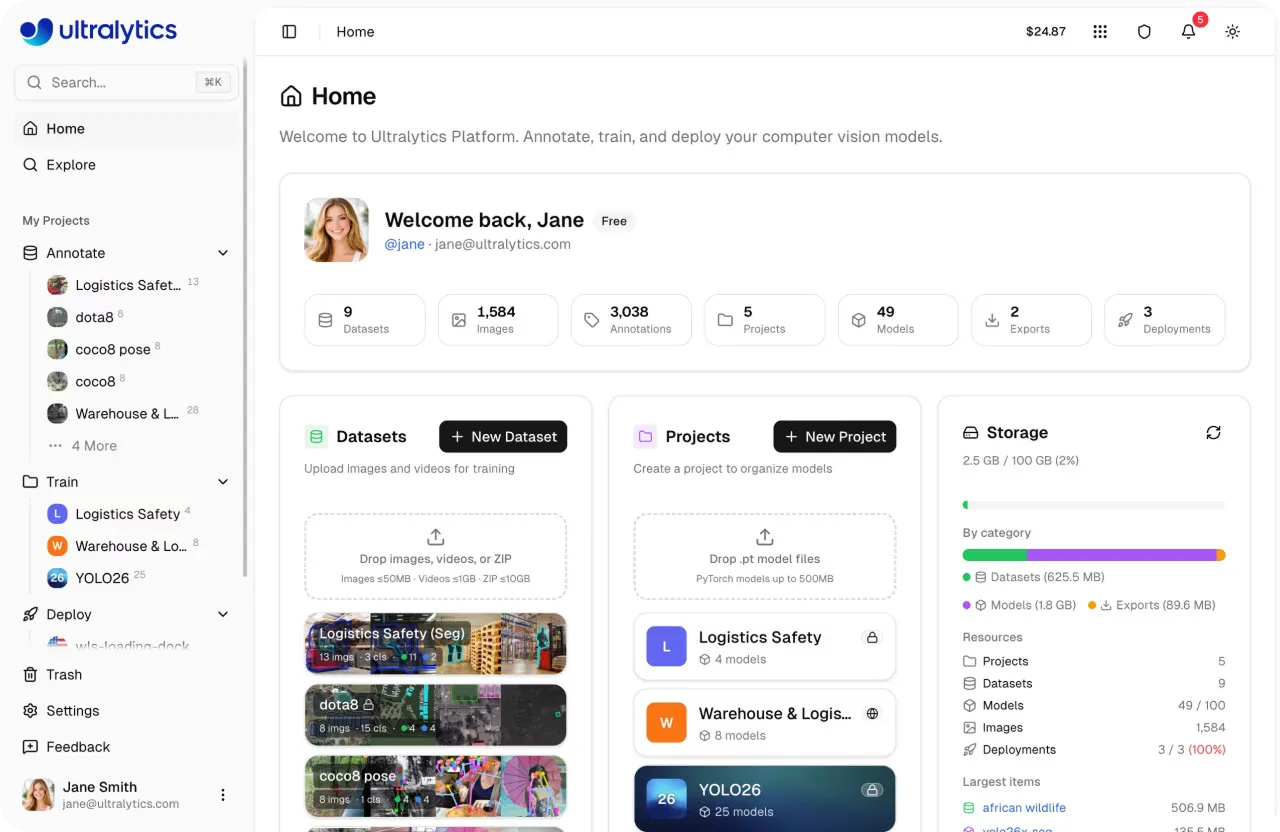

Abb. 2. Ein Einblick in die Ultralytics Platform (Quelle)

Mit der Ultralytics Platform kann der gesamte Entwicklungs- und Bereitstellungsprozess an einem Ort abgewickelt werden. Rohdaten können hochgeladen und annotiert werden, um Trainingsdatensätze zu erstellen, die dann verwendet werden, um Modelle für die Defekterkennung zu trainieren. Sobald sie trainiert sind, können diese Modelle bereitgestellt werden, um neue Bilder aus der Produktionslinie zu analysieren, wobei integrierte Tools zur Überwachung der Leistung im Laufe der Zeit vorhanden sind.

Zusätzlich dazu, dass der gesamte Workflow an einem Ort zusammengeführt wird, ist die Ultralytics Platform benutzerfreundlich gestaltet. Selbst Anwender mit begrenzter Machine-Learning-Erfahrung können schnell von der Idee bis zur Produktion gelangen.

Link to this sectionDie Ultralytics Platform zum Labeln von Defekten in Bildern nutzen#

Nachdem wir nun gesehen haben, wie die Ultralytics Platform den Workflow zusammenführt, gehen wir Schritt für Schritt durch, wie du sie in jeder Phase der Vision-KI-Pipeline verwendest, beginnend mit dem Datenupload und dem Labeln von Defekten.

Link to this sectionVerwaltung von Prüfdatensätzen auf der Ultralytics Platform#

Der erste Schritt besteht darin, Daten auf die Plattform zu bringen. Du kannst Bilder, Videos oder Datensatz-Archive wie ZIP, TAR oder GZ-Dateien hochladen. Gängige Datensatzformate wie YOLO und COCO werden unterstützt, sodass bestehende Datensätze ohne zusätzliche Schritte importiert werden können.

Du kannst auch schneller starten, indem du Datensätze verwendest, die von der Community geteilt wurden. Diese Datensätze können durchsucht und in deinen Arbeitsbereich geklont werden, sodass du auf vorhandenen Daten aufbauen kannst, anstatt bei Null anzufangen. Sobald sie geklont sind, können sie aktualisiert und für deinen spezifischen Anwendungsfall erweitert werden.

Wenn du an verschiedenen Experimenten arbeitest, können Datensätze wiederverwendet werden, indem sie als NDJSON-Dateien importiert werden, was es einfacher macht, sie ohne zusätzliche Konvertierung neu zu erstellen oder zu teilen.

Nachdem die Daten hochgeladen wurden, bereitet die Plattform sie automatisch vor. Sie prüft Dateiformate, verarbeitet Annotationen, skaliert Bilder bei Bedarf und generiert grundlegende Datensatzstatistiken. Videos werden in Einzelbilder zerlegt, damit sie für das Training verwendet werden können, und Bilder werden für ein einfacheres Browsing und eine schnellere Analyse optimiert.

Link to this sectionDatenannotation powered by Ultralytics Platform#

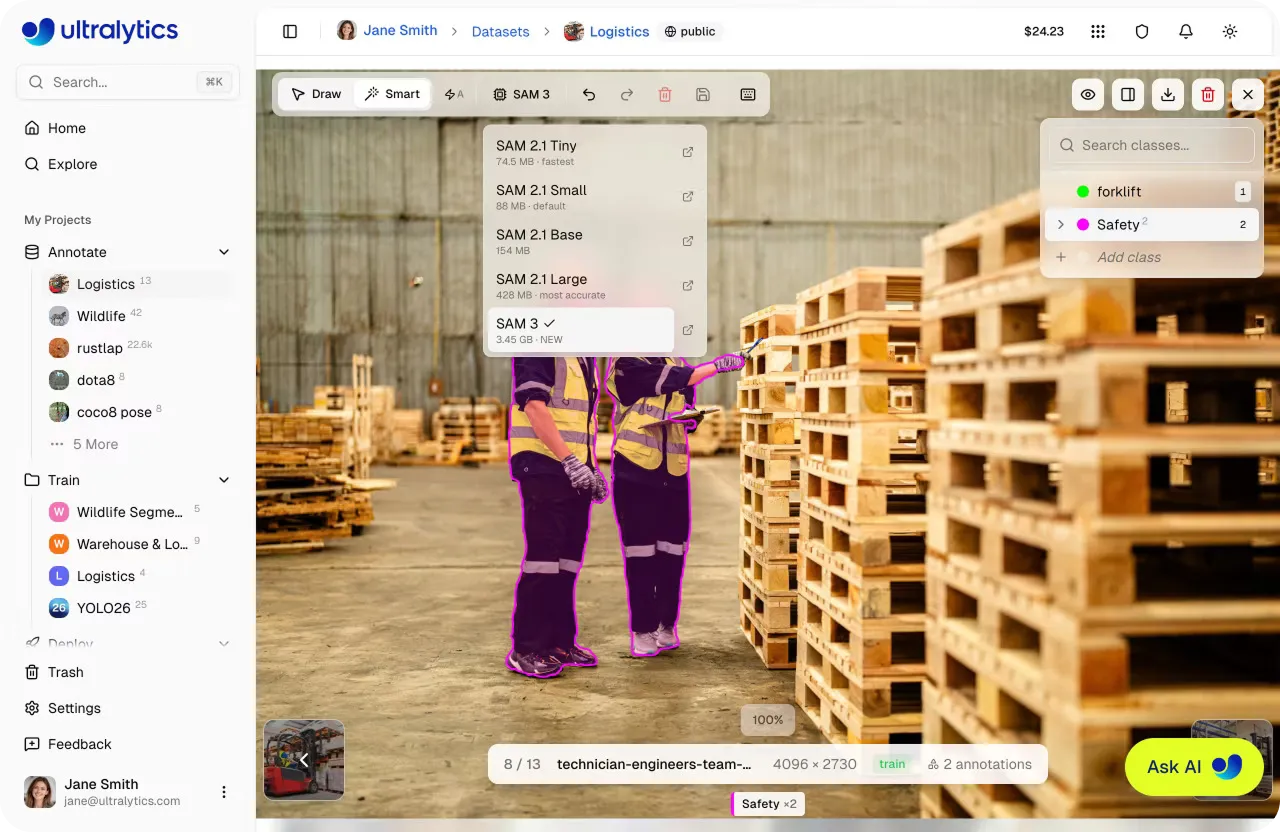

Sobald die Daten bereit sind, ist der nächste Schritt die Datenannotation. Hier werden Defekte gelabelt, damit das Modell lernt, was es erkennen soll. Die Ultralytics Platform beinhaltet einen integrierten Annotations-Editor, der Aufgaben wie Objekterkennung, Instanz-Segmentierung, Bildklassifizierung, Pose-Schätzung und die Erkennung von gedrehten Bounding Boxes unterstützt.

Du kannst Daten manuell mit Tools wie Bounding Boxes, Polygonen oder Keypoints labeln, je nach deinem Anwendungsfall. Um den Prozess zu beschleunigen, bietet die Plattform auch KI-unterstützte Annotation.

Zum Beispiel ermöglicht SAM-basierte intelligente Annotation das Labeln von Objekten mit einfachen Klicks. Durch die Auswahl von Bereichen, die ein- oder ausgeschlossen werden sollen, generiert das System in Echtzeit eine Maske, die bei Bedarf angepasst werden kann.

Abb. 3. SAM-basierte intelligente Annotation innerhalb der Ultralytics Platform (Quelle)

Darüber hinaus kann YOLO-basierte intelligente Annotation Labels automatisch mithilfe von Modellvorhersagen generieren. Diese können überprüft und verfeinert werden, was die Arbeit mit großen Datensätzen erleichtert, ohne alles manuell labeln zu müssen.

Der Annotations-Editor enthält außerdem Funktionen wie Klassenverwaltung, Annotationsbearbeitung, Tastenkombinationen sowie Rückgängig- und Wiederherstellen-Optionen. Diese erleichtern es, konsistent zu bleiben und Annotationen zu überprüfen, während dein Datensatz wächst.

Während du Daten labelst, liefert die Plattform Einblicke wie Klassenverteilung und Annotationszahlen. Dies hilft, Lücken zu identifizieren, Inkonsistenzen zu beheben und die Qualität des Datensatzes zu verbessern, bevor es mit dem Training weitergeht.

Link to this sectionTraining von YOLO26 für die Defekterkennung auf der Ultralytics Platform#

Der nächste Schritt ist das Trainieren eines Modells, um Defekte mithilfe der gelabelten Daten automatisch zu erkennen. Die Ultralytics Platform unterstützt das Training mit Ultralytics YOLO Modellen, einschließlich YOLO26, die für Aufgaben wie Objekterkennung, Instanz-Segmentierung und Bildklassifizierung verwendet werden können.

Das Training wird über ein einheitliches Dashboard verwaltet, in dem du Trainingsaufträge konfigurieren, ausführen und überwachen kannst. Um zu beginnen, wählst du einen Datensatz aus, einschließlich eines von dir hochgeladenen, auf der Plattform annotierten, aus öffentlichen Quellen oder aus der Community geklonten Datensatzes.

Sobald er ausgewählt ist, wird der Datensatz automatisch mit dem Trainingslauf verknüpft, was es einfacher macht, Experimente zu verfolgen und die Konsistenz zu wahren.

Als Nächstes kannst du Trainingsparameter wie die Anzahl der Epochen, Batch-Größe, Bildgröße und Lernrate konfigurieren. Diese Einstellungen steuern, wie das Modell lernt, und beeinflussen direkt sowohl die Trainingszeit als auch die Leistung.

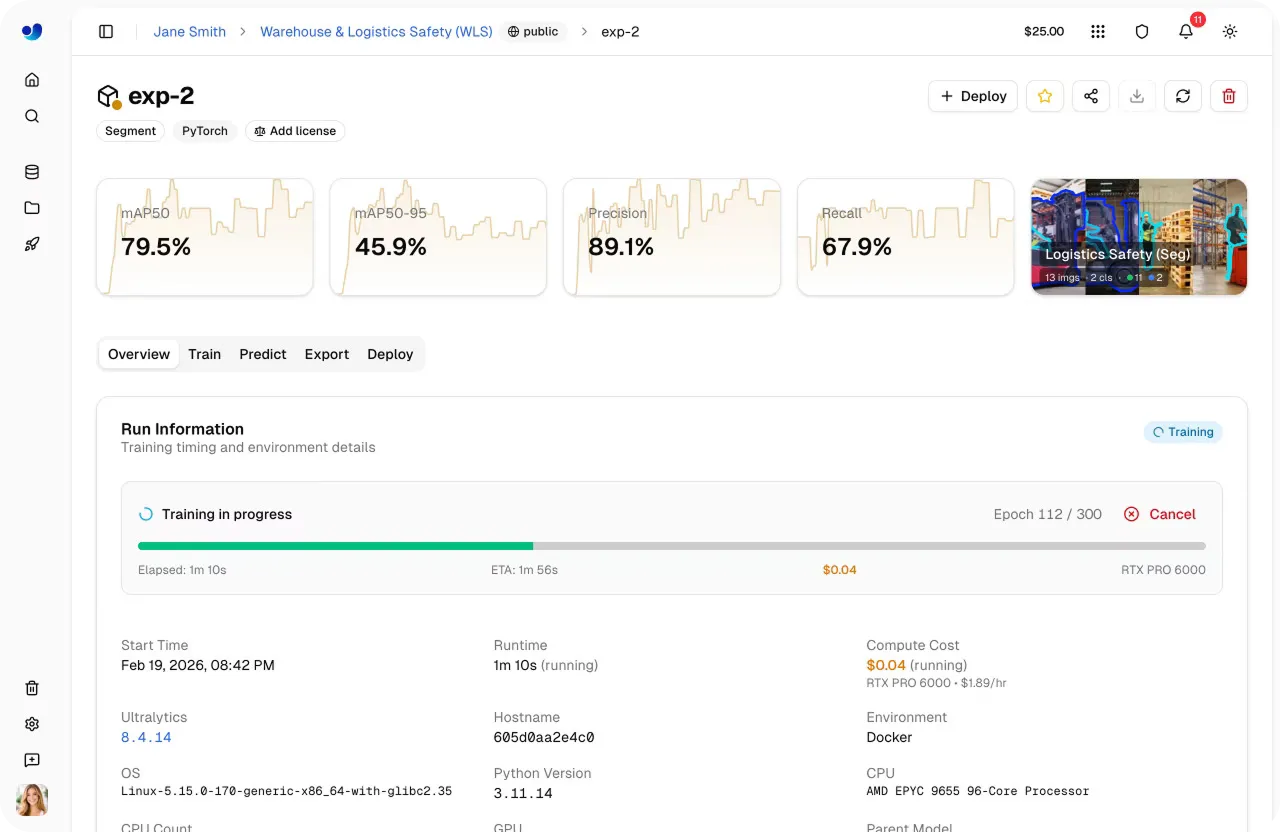

Link to this sectionTraining ausführen und überwachen#

Du kannst dann wählen, wie das Training ausgeführt werden soll. Die Plattform unterstützt Cloud-Training auf verwalteten GPUs, lokales Training auf eigener Hardware und browserbasierte Workflows durch Umgebungen wie Google Colab.

Beim Cloud-Training kannst du aus einer Reihe von GPU-Optionen wählen, wie z.B. RTX 2000 Ada und RTX A4500 für kleinere Experimente, RTX 4090 oder RTX A6000 für anspruchsvollere Workloads und High-Performance-Optionen wie A100 oder H100 für groß angelegtes Training.

Wenn das Training beginnt, kann der Fortschritt direkt auf der Plattform überwacht werden. Das Dashboard bietet Echtzeit-Einblicke in wichtige Metriken wie Verlustkurven und Leistungsmetriken sowie Systemauslastung und Trainingslogs. Dies macht es nahtlos, zu verstehen, wie das Modell lernt, und potenzielle Probleme frühzeitig zu identifizieren.

Abb. 4. Du kannst den Trainingsfortschritt einfach mit der Ultralytics Platform überwachen (Quelle)

Wenn du mehrere Experimente durchführst, verfolgt die Plattform Konfigurationen, Datensätze und Ergebnisse an einem Ort. Dies macht es unkompliziert, verschiedene Trainingsläufe zu vergleichen, die Leistung anhand von Metriken wie Präzision, Recall und mAP zu bewerten und das leistungsstärkste Modell für die Bereitstellung auszuwählen.

Link to this sectionBereitstellung eines Vision-Modells über die Ultralytics Platform#

Nach dem Training ist der nächste Schritt die Validierung, wie das trainierte Modell mit neuen, ungesehenen Daten abschneidet, bevor es zur Bereitstellung geht. Die Ultralytics Platform enthält einen integrierten Predict-Tab, der es erlaubt, Modelle direkt im Browser ohne Einrichtung zu testen.

Du kannst Bilder hochladen, Beispieldaten verwenden oder Eingaben über eine Webcam erfassen; die Ergebnisse erscheinen sofort mit visuellen Overlays und Konfidenzwerten. Das bedeutet, du kannst die Modellleistung schnell prüfen und Probleme identifizieren, bevor du es in reale Systeme integrierst.

Sobald das Modell validiert ist, kann es je nach Anwendungsfall mit verschiedenen Optionen bereitgestellt werden. Hier ist ein genauerer Blick auf die Modell-Bereitstellungsoptionen, die von der Ultralytics Platform unterstützt werden:

- Geteiltes Inference: Diese Option ermöglicht den Zugriff auf das Modell über eine REST API, was die Integration in Anwendungen oder Workflows einfach macht. Es läuft auf einem Multi-Tenant-System in einigen Kernregionen, wobei Anfragen automatisch an den nächstgelegenen verfügbaren Dienst geroutet werden. Dies macht es gut geeignet für Entwicklung, Tests und leichtere Nutzung, bevor es in die Produktion geht.

- Dedizierte Endpunkte: Für den Produktionseinsatz können Modelle als dedizierte Endpunkte mit eigenen Rechenressourcen bereitgestellt werden. Diese laufen als Single-Tenant-Dienste in 43 globalen Regionen, was hilft, die Latenz durch Bereitstellung näher an den Endnutzern zu reduzieren. Sie unterstützen auch Autoscaling und Scale-to-Zero, wodurch Ressourcen automatisch basierend auf dem Traffic angepasst werden können.

- Modell-Export: Modelle können exportiert und außerhalb der Plattform auf lokalen Systemen oder Edge-Geräten ausgeführt werden. Die Plattform unterstützt 17 Formate, darunter ONNX, TensorRT, OpenVINO, CoreML und TensorFlow Lite. Exportoptionen unterstützen auch Optimierungen wie FP16 und INT8-Quantisierung, um die Modellgröße zu reduzieren und die Inference-Geschwindigkeit für verschiedene Hardwareumgebungen zu verbessern.

Link to this sectionÜberwachung bereitgestellter Modelle mit der Ultralytics Platform#

Der Lebenszyklus einer Bildverarbeitungs- oder Computer-Vision-Lösung endet nicht mit der Modellbereitstellung. Das gilt auch für Bildverarbeitungssysteme zur Qualitätskontrolle. Sobald ein Modell in Produktion läuft, muss es kontinuierlich überwacht werden, um sicherzustellen, dass es bei sich ändernden Bedingungen zuverlässig funktioniert.

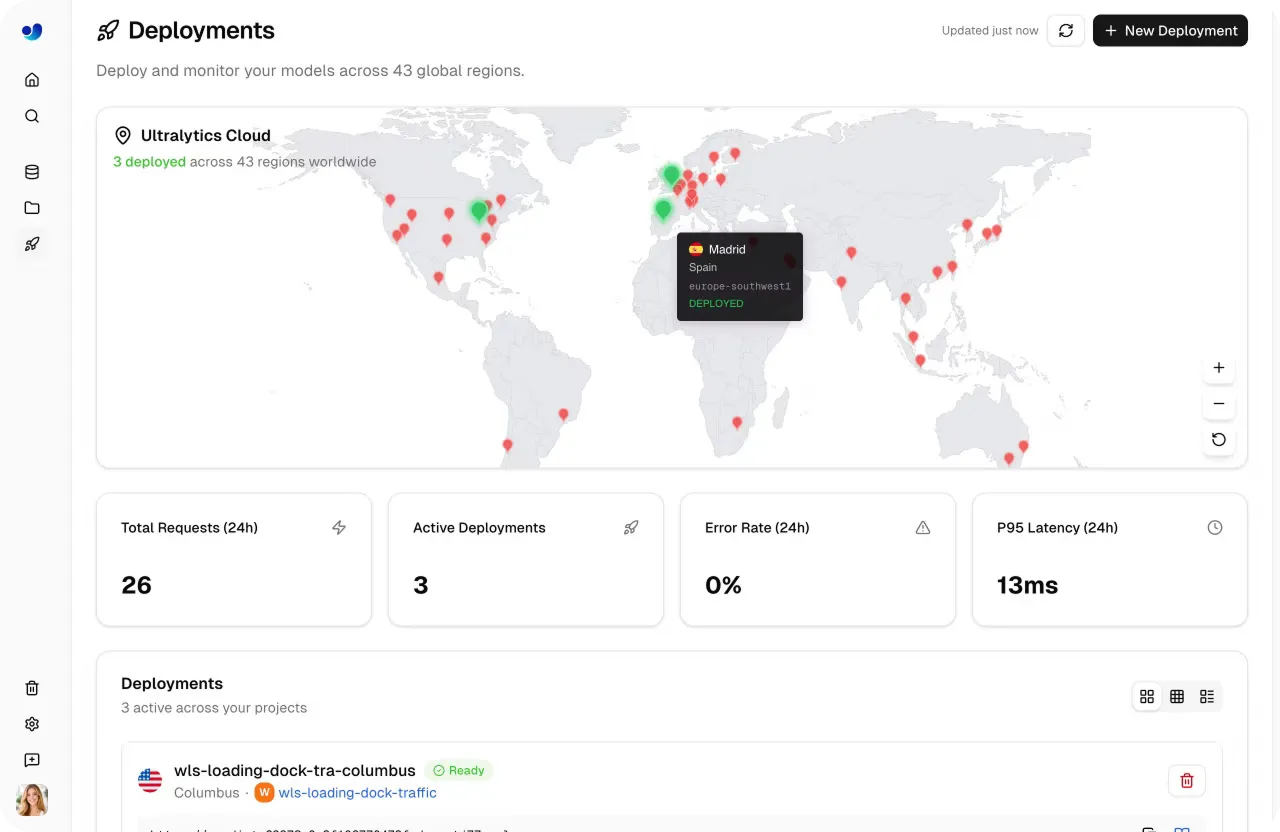

Die Ultralytics Platform bietet ein integriertes Monitoring-Dashboard, das einen klaren Blick darauf gibt, wie bereitgestellte Modelle abschneiden. Von einer einzigen Oberfläche aus kannst du die Anfragenaktivität verfolgen, Logs einsehen und den Gesundheitsstatus jeder Bereitstellung prüfen. Du kannst nachvollziehen, wie Modelle genutzt werden und wie sie sich im Laufe der Zeit verhalten.

Das Dashboard enthält wichtige Metriken wie Gesamtanfragen, Fehlerraten und Latenz, die dir helfen, Leistung und Reaktionsfähigkeit zu bewerten. Diese Metriken werden regelmäßig aktualisiert und bieten Einblicke sowohl in Nutzungsmuster als auch in die Systemzuverlässigkeit.

Eine integrierte Weltkarte zeigt, wo Anfragen und Bereitstellungen über Regionen hinweg verteilt sind. Mit der Unterstützung für Bereitstellungen an mehreren globalen Standorten hilft diese Ansicht, die Nutzung geografisch zu verfolgen und zu verstehen, wie Modelle in verschiedenen Umgebungen funktionieren.

Abb. 5. Überwachung bereitgestellter Modelle auf der Ultralytics Platform (Quelle)

Für eine tiefergehende Analyse enthält jede Bereitstellung detaillierte Logs mit Zeitstempeln, Anfragedetails und Fehlermeldungen. Logs können nach Schweregrad gefiltert werden, was es einfach macht, Probleme zu debuggen und Ausfälle schnell zu identifizieren. Zusätzlich bieten Health-Checks Echtzeit-Statusindikatoren, die zeigen, ob eine Bereitstellung wie erwartet läuft oder Aufmerksamkeit benötigt.

Überwachung spielt auch eine wichtige Rolle bei der Optimierung. Wenn sich Eingabedaten, Traffic oder Nutzungsmuster ändern, kann die Leistung variieren. Durch das Verfolgen von Metriken und Logs kannst du Probleme wie hohe Latenz, erhöhte Fehlerraten oder Skalierungseinschränkungen identifizieren und Maßnahmen ergreifen, um eine konsistente Leistung aufrechtzuerhalten.

Link to this sectionVorteile der Nutzung der Ultralytics Platform zum Bau von Vision-Lösungen#

Hier sind einige der wichtigsten Vorteile der Nutzung der Ultralytics Platform für den Aufbau und die Skalierung von Bildverarbeitungssystemen zur Qualitätsprüfung:

- Optimiert für reale Anwendungen: Funktionen wie autoskalierende Endpunkte, Edge-Bereitstellung und Modell-Export stellen sicher, dass das System zuverlässig in Produktionsumgebungen laufen kann.

- Schnellere Entwicklungszyklen: Integrierte Tools und Standardkonfigurationen helfen, effizienter von Rohdaten zu einem funktionierenden System zu gelangen.

- Benutzerfreundlichkeit: Intuitive Oberflächen, optimierte Workflows und minimale Einrichtungsanforderungen machen die Plattform sowohl für Anfänger als auch für erfahrene Benutzer zugänglich.

- Weniger manuelle Arbeit: Funktionen wie KI-unterstützte Annotation und automatisierte Datenverarbeitung reduzieren die Zeit für repetitive Aufgaben.

- Skalierbar im Laufe der Zeit: Wenn sich Anforderungen ändern, kann das System durch Hinzufügen neuer Daten und Nachtraining von Modellen aktualisiert werden, was die Anpassung an neue Defekttypen, Bedingungen und Multi-Kamera-Setups ermöglicht.

Link to this sectionWichtige Erkenntnisse#

Der Aufbau eines kamerabasierten Bildverarbeitungssystems zur Qualitätskontrolle muss nicht komplex sein oder tiefes KI-Know-how erfordern. Mit der Ultralytics Platform kannst du von Rohdaten zu einem funktionierenden System gelangen und dessen Leistung an einem Ort überwachen. Dies optimiert, wie Prüfsysteme in realen Umgebungen gebaut, verbessert und betrieben werden.

Tritt unserer Community bei und erkunde unser GitHub Repository, um mehr über Vision-KI zu erfahren. Schau dir unsere Lizenzoptionen an, um deine Computer-Vision-Projekte zu starten. Interessiert an Innovationen wie KI in der Fertigung oder Computer Vision in der Automobilindustrie? Besuche unsere Lösungsseiten, um mehr zu entdecken.