Florence-2: el último modelo de lenguaje de visión de Microsoft

Conozca Florence-2, el modelo de lenguaje visual de Microsoft que ofrece detección de objetos mejorada, segmentación y rendimiento de disparo cero con gran eficacia.

Conozca Florence-2, el modelo de lenguaje visual de Microsoft que ofrece detección de objetos mejorada, segmentación y rendimiento de disparo cero con gran eficacia.

En junio de 2024, Microsoft presentó Florence-2, un modelo de lenguaje visual (VLM) multimodal diseñado para realizar una amplia gama de tareas, como detección de objetos, segmentación, subtitulado de imágenes y grounding. Florence-2 establece un nuevo hito en cuanto a rendimiento cero, lo que significa que puede realizar tareas sin formación específica previa, y potencia un tamaño de modelo menor que el de otros modelos de visión-lenguaje de última generación.

Es más que un simple modelo, la versatilidad y el rendimiento mejorado de Florence-2 tienen el potencial de impactar significativamente en varias industrias al mejorar la precisión y reducir la necesidad de una formación exhaustiva. En este artículo, exploraremos las características innovadoras de Florence-2, compararemos su rendimiento con otros VLM y discutiremos sus posibles aplicaciones.

Florence-2 puede manejar una variedad de tareas dentro de un único marco unificado. Las impresionantes capacidades del modelo se deben en parte a su enorme conjunto de datos de entrenamiento llamado FLD-5B. FLD-5B incluye 5.4 mil millones de anotaciones en 126 millones de imágenes. Este conjunto de datos completo se creó específicamente para habilitar a Florence-2 con las capacidades necesarias para manejar una amplia gama de tareas de visión con alta precisión y eficiencia.

Aquí tiene un análisis más detallado de las tareas que admite Florence-2:

.png)

El modelo admite tareas basadas en texto y en regiones. Se añaden tokens de ubicación especiales al vocabulario del modelo para las tareas que implican regiones específicas de una imagen. Estos tokens ayudan al modelo a comprender diferentes formas, como rectángulos alrededor de objetos (representación de caja), formas de cuatro lados (representación de caja cuádruple) y formas de muchos lados (representación de polígono). El modelo se entrena utilizando un método llamado pérdida de entropía cruzada, que le ayuda a aprender comparando sus predicciones con las respuestas correctas y ajustando sus parámetros internos en consecuencia.

El conjunto de datos FLD-5B incluye distintos tipos de anotaciones: descripciones de texto, pares de regiones y texto, y combinaciones de texto, frases y regiones. Se creó mediante un proceso en dos fases que incluía la recopilación de datos y la anotación. Las imágenes proceden de bases de datos populares como ImageNet, Object 365, Open Images, Conceptual Captions y LAION. Las anotaciones del conjunto de datos FLD-5B son en su mayoría sintéticas, es decir, generadas automáticamente en lugar de etiquetadas manualmente.

.png)

Inicialmente, modelos especializados y capacitados en tareas específicas, como la detección de objetos o la segmentación, crearon estas anotaciones. A continuación, se utilizó un proceso de filtrado y mejora para garantizar que las anotaciones fueran detalladas y precisas. Tras eliminar cualquier ruido, el conjunto de datos se sometió a un perfeccionamiento iterativo, en el que las salidas de Florence-2 se utilizaron para actualizar y mejorar continuamente las anotaciones.

La arquitectura del modelo de Florence-2 sigue un enfoque de aprendizaje de secuencia a secuencia. Esto significa que el modelo procesa una secuencia de entrada (como una imagen con un mensaje de texto) y genera una secuencia de salida (como una descripción o una etiqueta) de forma gradual. En el marco de secuencia a secuencia, cada tarea se trata como un problema de traducción: el modelo toma una imagen de entrada y un mensaje específico de la tarea y genera la salida correspondiente.

.png)

En el núcleo de la arquitectura del modelo se encuentra un transformador encoder-decoder multimodal, que combina un encoder de imagen y un encoder-decoder multimodal. El encoder de imagen, llamado DaViT (Data-efficient Vision Transformer), procesa las imágenes de entrada convirtiéndolas en embeddings de tokens visuales: representaciones compactas de la imagen que capturan tanto la información espacial (dónde están las cosas) como la semántica (qué son las cosas). Estos tokens visuales se combinan luego con embeddings de texto (representaciones del texto), lo que permite al modelo fusionar a la perfección datos textuales y visuales.

Florence-2 se distingue de otros modelos de lenguaje visual debido a sus impresionantes capacidades de zero-shot. A diferencia de modelos como PaliGemma, que dependen de un ajuste fino extenso para adaptarse a diversas tareas, Florence-2 funciona bien desde el primer momento. Además, Florence-2 puede competir con modelos más grandes como GPT-4V y Flamingo, que a menudo tienen muchos más parámetros pero no siempre igualan el rendimiento de Florence-2. Por ejemplo, Florence-2 logra mejores resultados de zero-shot que Kosmos-2, a pesar de que Kosmos-2 tiene más del doble de parámetros.

En pruebas comparativas, Florence-2 ha mostrado un rendimiento notable en tareas como el subtitulado COCO y la comprensión de expresiones de referencia. Superó a modelos como PolyFormer y UNINEXT en tareas de detección y segmentación de objetos en el conjunto de datosCOCO . Es una opción muy competitiva para aplicaciones reales en las que tanto el rendimiento como la eficiencia de recursos son cruciales.

Florence-2 se puede utilizar en muchas industrias diferentes, como entretenimiento, accesibilidad, educación, etc. Repasemos algunos ejemplos para comprenderlo mejor.

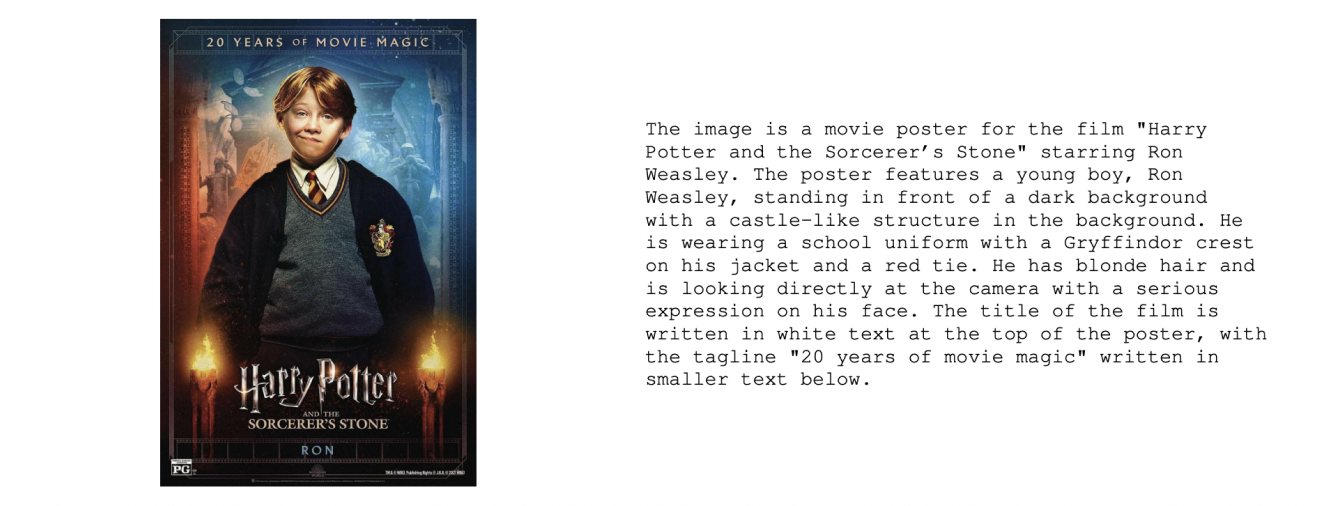

Cuando está en una plataforma de streaming tratando de decidir qué ver, puede leer un resumen de una película para ayudarle a elegir. ¿Qué pasaría si la plataforma también pudiera proporcionar una descripción detallada del cartel de la película? Florence-2 puede hacer eso posible a través de la descripción de imágenes, que genera texto descriptivo para las imágenes. Florence-2 puede generar descripciones detalladas de los carteles de películas, lo que hace que las plataformas de streaming sean más inclusivas para los usuarios con discapacidad visual. Al analizar los elementos visuales de un cartel, como los personajes, el escenario y el texto, Florence-2 puede crear descripciones detalladas que transmitan el contenido y el ambiente del cartel. La imagen de abajo muestra el nivel de detalle que Florence-2 puede proporcionar en su descripción.

Estos son otros ejemplos de dónde la descripción de imágenes puede ser útil:

Florence-2 también se puede utilizar para enriquecer las experiencias culinarias. Por ejemplo, un libro de cocina en línea podría usar Florence-2 para anclar visualmente y etiquetar partes de una imagen de receta compleja. El anclaje visual ayuda aquí al vincular partes específicas de la imagen con el texto descriptivo correspondiente. Cada ingrediente y paso se puede etiquetar y explicar con precisión, lo que facilita a los cocineros caseros seguir la receta y comprender el papel de cada componente en el plato.

.png)

El OCR con procesamiento basado en regiones, que se centra en extraer texto de áreas específicas dentro de un documento, puede ser muy útil en campos como la contabilidad. Se pueden analizar áreas designadas de documentos financieros para extraer automáticamente información importante, como detalles de transacciones, números de cuenta y fechas de vencimiento. Al reducir la necesidad de la entrada manual de datos, minimiza los errores y acelera los tiempos de procesamiento. Las instituciones financieras pueden utilizarlo para agilizar tareas como el procesamiento de facturas, la conciliación de recibos y la compensación de cheques, lo que conduce a transacciones más rápidas y a un mejor servicio al cliente.

.png)

La segmentación basada en regiones, que implica dividir una imagen en partes significativas para un análisis enfocado y una inspección detallada, puede impulsar aplicaciones industriales que mejoran la precisión y la eficiencia en diversos procesos. Al centrarse en áreas específicas dentro de una imagen, esta tecnología permite una inspección y un análisis detallados de los componentes y productos. Con respecto al control de calidad, puede identificar defectos o inconsistencias en los materiales, como grietas o desalineaciones, asegurando que solo los productos de alta calidad lleguen al mercado.

.png)

También mejora las líneas de montaje automatizadas guiando los brazos robóticos hacia piezas específicas y optimizando la colocación y el montaje de los componentes. Del mismo modo, en la gestión de inventarios, ayuda a track y supervisar el estado y la ubicación de las mercancías, lo que conduce a una logística más eficiente y a la reducción del tiempo de inactividad. En general, la segmentación por regiones aumenta la precisión y la productividad, lo que permite ahorrar costes y mejorar la calidad de los productos industriales.

Estamos empezando a ver una tendencia en la que los modelos de IA se están volviendo más ligeros sin dejar de mantener un alto rendimiento. Florence-2 marca un gran paso adelante en términos de modelos de lenguaje visual. Puede manejar varias tareas como la detección de objetos, la segmentación, la descripción de imágenes y la conexión a tierra con un rendimiento impresionante de cero disparos. A pesar de su menor tamaño, Florence-2 es eficiente y multifuncional, lo que lo hace extremadamente útil en términos de aplicaciones en diferentes industrias. Modelos como Florence-2 están trayendo más posibilidades a la mesa, ampliando el potencial de las innovaciones de la IA.

Explore más sobre la IA visitando nuestro repositorio de GitHub y uniéndose a nuestra comunidad. Consulte nuestras páginas de soluciones para leer sobre las aplicaciones de la IA en la fabricación y la agricultura. 🚀

Comience su viaje con el futuro del aprendizaje automático