データ品質、データ拡張、学習戦略、評価、デプロイに関する実践的なヒントを用いて、小さなオブジェクトに対するモデルのmAPを改善する方法を学びましょう。

データ品質、データ拡張、学習戦略、評価、デプロイに関する実践的なヒントを用いて、小さなオブジェクトに対するモデルのmAPを改善する方法を学びましょう。

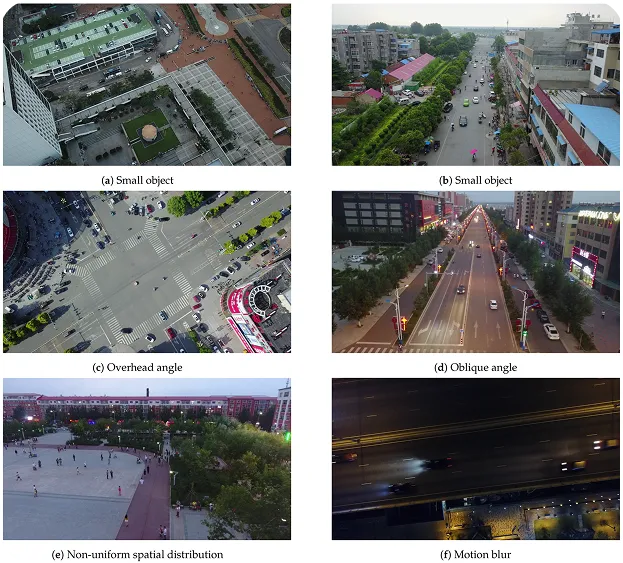

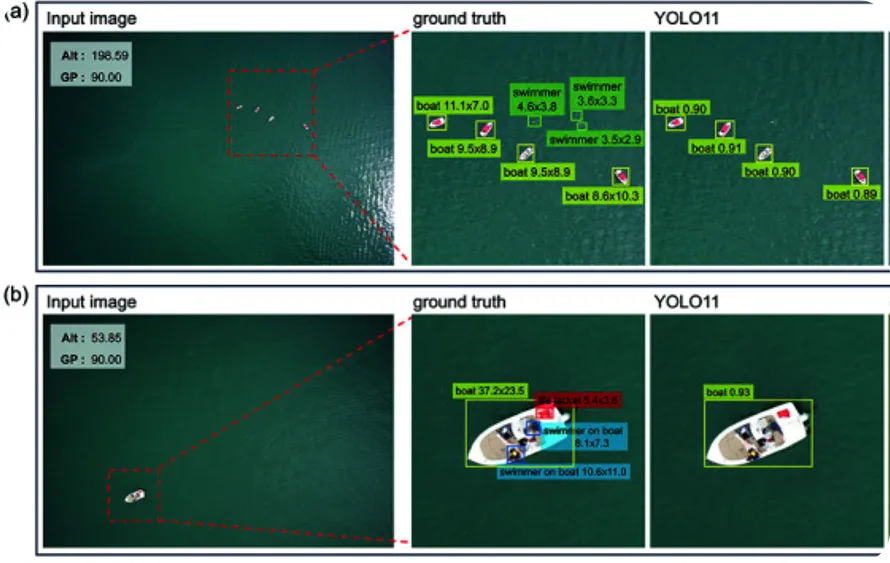

人工知能(AI)、機械学習、そしてコンピュータービジョンの導入が拡大し続けるにつれて、object detection(物体検出)システムはスマート交通カメラからドローン、小売分析ツールまで、あらゆる場所で利用されています。これらのシステムは、カメラに近い大型トラックであろうと、遠く離れた小さな歩行者であろうと、あらゆるサイズのobjectをdetect(検出)することが求められることがよくあります。

通常、大きくてはっきりと見える物体を detect するのはより簡単です。対照的に、小さな物体を detect するのはより困難です。

オブジェクトが画像のほんの一部しか占めていない場合、利用できる視覚情報はごくわずかです。交通フィード内の遠くの歩行者や、航空写真から捉えられた小さな車両は、数ピクセルしか含まないかもしれませんが、それらのピクセルは重要な情報を含んでいる可能性があります。

Ultralytics YOLOモデルのようなコンピュータービジョンモデルは、オブジェクトを認識するために視覚パターンに依存しており、それらのパターンが限定的であったり不明瞭であったりすると、パフォーマンスが低下します。処理中に重要な詳細が失われる可能性があり、予測が位置特定エラーに対してより敏感になります。バウンディングボックスのわずかなずれでも、正しいdetectionが見逃しになることがあります。

このギャップは、モデルの性能を見ると明らかになります。ほとんどのdetectおよびsegmentモデルは、中規模および大規模なオブジェクトをうまく処理しますが、小さなオブジェクトはしばしば全体の精度を低下させます。

深層学習の性能は、通常、平均適合率、すなわちmAPを用いて測定されます。この指標は、検出の精度と、予測されたボックスが実際のオブジェクトとどれだけ一致しているかの両方を反映しています。

これは、異なる信頼度レベルとIoU(Intersection over Union、予測されたバウンディングボックスが真のバウンディングボックスとどれだけ重なっているかを測定する指標)の閾値において、予測されたオブジェクトがどれだけ正しいかを示す精度と、実際のオブジェクトがどれだけ成功裏にdetectされたかを示す再現率を組み合わせたものです。

これまで、私たちは小物体検出と、それがコンピュータビジョンモデルにとってなぜこれほど困難な問題なのかを探求してきました。この記事では、その基礎の上に構築し、小物体が関与する場合にmAPを改善する方法に焦点を当てます。始めましょう!

オブジェクト検出器を伴うアプリケーションの場合、小さなオブジェクトは、人間の目にはどれほど小さく見えるかではなく、画像内でどれだけのスペースを占めるかによって定義されます。画像のごく一部しか占めない場合、視覚情報が非常に少ないため、コンピュータービジョンアルゴリズムが正確にdetectすることが難しくなります。

扱えるピクセルが少ない場合、エッジ、形状、テクスチャなどの重要なディテールが不明瞭になったり、簡単に失われたりする可能性があります。モデルによって画像が処理される際、有用なパターンを強調するためにリサイズされ、簡素化されます。

これによりモデルはシーン全体を理解しやすくなりますが、微細なディテールがさらに失われる可能性もあります。小さなオブジェクトの場合、これらのディテールは正確な detect に不可欠であることがよくあります。

これらの課題は、評価指標を見るとさらに顕著になります。小さなオブジェクトは特に位置特定エラーに敏感です。わずかにずれたバウンディングボックスであっても、必要なIoU(Intersection over Union)閾値を下回る可能性があります。

そのような場合、妥当に見える予測が誤りとしてカウントされることがあります。これにより、precisionとrecallの両方が低下し、最終的に平均平均精度、すなわちmAPが減少します。

これらの要因は密接に関連しているため、性能向上には、しばしばシステム全体を考慮する必要があります。それは、小さな視覚的詳細がよりよく保持され、解釈されるように、画像解像度、特徴抽出、モデル設計、および評価設定を慎重にバランスさせることを意味します。

小さなオブジェクトのdetectに関して言えば、データセットの品質がパフォーマンスに最も大きな影響を与えることがよくあります。小さなオブジェクトは画像のごく一部しか占めないため、モデルが学習できる視覚情報が非常に少ないことを意味します。このため、トレーニングデータは特に重要になります。データセットに十分な明確で代表的な例が含まれていない場合、オブジェクトdetectモデルは一貫したパターンを認識するのに苦労します。

小さな物体検出に効果的なデータセットは、通常、高解像度の画像、小さなターゲットの頻繁な出現、および一貫した視覚条件を含んでいます。COCOデータセットのような汎用データセットは有用な出発点となりますが、特定の実世界のユースケースのスケール、密度、またはコンテキストに合致しないことがよくあります。そのような場合、モデルのパフォーマンスを向上させるためには、ドメイン固有のトレーニングデータを収集することが必要になります。

アノテーションの品質も重要な役割を果たします。アノテーションは、モデルが予測するように学習する正しいオブジェクトラベルとバウンディングボックスの位置を指定することで、グラウンドトゥルースを確立します。

小さなオブジェクトの場合、バウンディングボックスは慎重かつ一貫して描画する必要があります。小さなオブジェクトはピクセルレベルのシフトに非常に敏感であるため、ボックス配置のわずかな違いでも、位置特定精度に顕著な影響を与える可能性があります。

不適切または一貫性のないアノテーションは、mAPを大幅に低下させる可能性があります。オブジェクトが誤ってラベル付けされている場合、モデルは誤ったパターンを学習し、誤検知(false positives)が増加する可能性があります。

画像内にオブジェクトが存在するにもかかわらず正解データから欠落している場合、正しいdetectが評価中に誤検知としてカウントされることがあります。どちらの状況も全体的なパフォーマンスを低下させます。

興味深いことに、最近の研究によると、小さなオブジェクトの平均精度は、標準的なベンチマークで20%から40%の間にとどまることが多く、これはより大きなオブジェクトと比較して著しく低い値です。このギャップは、全体的な検出精度におけるデータセットの設計とアノテーションの一貫性の重要性を浮き彫りにしています。

データセットの品質とアノテーションの一貫性の重要性をより深く理解した上で、オブジェクト detect モデルが既存のデータからより効果的に学習する方法を見ていきましょう。追加の画像収集が困難または高価な場合でも、既存のデータをより有効活用することでパフォーマンスを向上させる方法はまだあります。

最も実用的なアプローチの1つは、データ拡張です。小さなオブジェクトはモデルが学習するための視覚的特徴が少ないため、小さなオブジェクトの検出において特に重要な役割を果たします。トレーニング中に制御されたバリエーションを導入することで、データ拡張は新たなデータ収集を必要とせずに、モデルの汎化性能を向上させます。

効果的なデータ拡張は、小さなオブジェクトを明確に視認できるようにすることに焦点を当てています。制御されたリサイズ、軽いクロッピング、画像タイリングなどの手法により、小さなオブジェクトの形状と外観を保ちながら、より目立たせることができます。目標は、モデルが小さなオブジェクトをより頻繁に、わずかに異なる条件下で認識できるようにすることであり、実際の状況での見た目を変更することなく行われます。

しかし、データ拡張は慎重に適用する必要があります。一部の変換は、小さなオブジェクトの視認性を低下させたり、実際のデータでは発生しにくい方法で外観を変更したりする可能性があります。このような場合、モデルは正確なオブジェクト境界を学習するのに苦労する可能性があります。

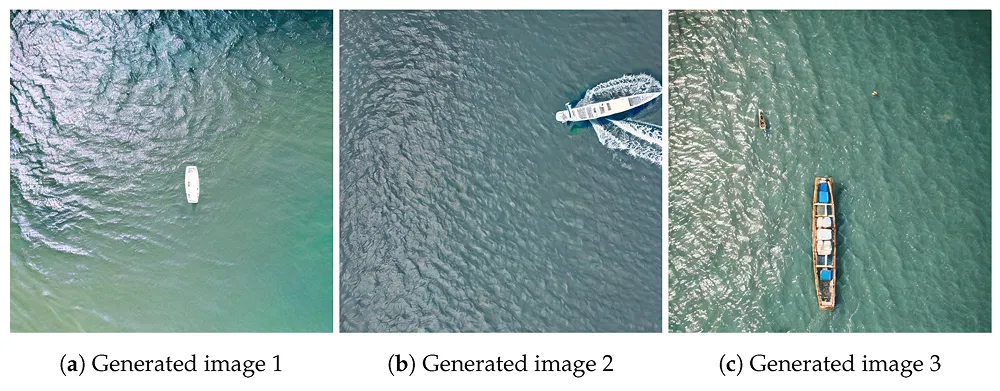

より人気が高まっているもう一つの興味深いデータ拡張の種類は、生成AIを使用して合成トレーニングデータを作成することです。手動で収集およびラベル付けされた画像に頼る代わりに、チームは特定の環境、オブジェクトサイズ、照明条件、背景のバリエーションをシミュレートするリアルなシーンを生成できるようになりました。

このアプローチは、現実世界の例を一貫してキャプチャするのが難しい小さな物体detectに特に役立ちます。合成画像における小さな物体の出現方法(スケール、密度、配置の調整など)を制御することで、モデルをより広範なトレーニングシナリオにさらすことが可能になります。

実際のデータと慎重に組み合わせることで、合成拡張は、モデルの堅牢性を向上させ、データ収集コストを削減し、より的を絞ったパフォーマンス改善をサポートできます。

データセットの品質とアノテーションの一貫性だけでなく、モデルトレーニングの選択も小さいオブジェクトの検出性能に大きな影響を与えます。

考慮すべき主なトレーニング戦略をいくつかご紹介します。

小さな物体検出タスクに汎用的な物体検出モデルを使用することもできますが、小さな物体検出の改善に特化して設計されたモデルアーキテクチャも存在します。例えば、Ultralytics YOLOv8モデルには、微細な空間的詳細を保持するために最適化されたP2モデルバリアントがあります。

YOLOv8は、ネットワークの奥に進むにつれて画像を徐々に縮小することで、複数のスケールで画像を処理します。これにより、モデルはシーン全体を理解するのに役立ちますが、細かいディテールも失われます。

オブジェクトがすでに非常に小さい場合、このプロセス中に重要な視覚情報が失われる可能性があります。Ultralytics YOLOv8のP2バリアントは、特徴ピラミッドでストライド2を使用することで、この問題に対処しています。

特徴ピラミッドは、モデルが画像を複数の内部解像度で分析し、異なるサイズのオブジェクトをdetectできるようにする部分です。ストライド2の場合、この段階で画像はより段階的に縮小され、元のピクセルレベルの詳細がより多く保持されます。

より多くの空間的詳細が保持されるため、小さなオブジェクトはネットワーク内でより多くの可視構造を保持します。これにより、モデルは数ピクセルしか占めないオブジェクトを局所化し、detectしやすくなり、小さなオブジェクトのmAP向上に貢献します。

平均平均精度はモデル全体のパフォーマンスを要約しますが、モデルが異なるサイズのオブジェクトをどれだけうまく処理するかを常に示すわけではありません。小さなオブジェクトの場合、パフォーマンスは分類のみではなく、ローカリゼーション精度によって制約されることが多く、わずかなバウンディングボックスのずれが結果に大きく影響する可能性があります。

言い換えれば、モデルはオブジェクトのクラスを正しく識別できるかもしれませんが、予測されたバウンディングボックスがわずかにずれている場合、そのdetectは依然として不正確と見なされる可能性があります。小さなオブジェクトは少数のピクセルしか占めないため、ボックス配置のわずかなずれでも、予測ボックスとグラウンドトゥルースの間の重なりを大幅に減少させる可能性があります。その結果、オブジェクトが正しく識別された場合でも評価スコアが低下する可能性があります。

より情報量の多いアプローチは、オブジェクトサイズ別にパフォーマンスを評価することです。広く使用されているほとんどのベンチマークでは、小、中、大オブジェクトごとに平均精度が個別に報告されます。

このサイズ別の内訳は、モデルがどこで良好に機能し、どこで苦戦しているかをより明確に示します。実際には、small-object APは全体のmAPに遅れをとることが多く、集計されたメトリクスでは明らかにならないローカライゼーションの課題を浮き彫りにします。

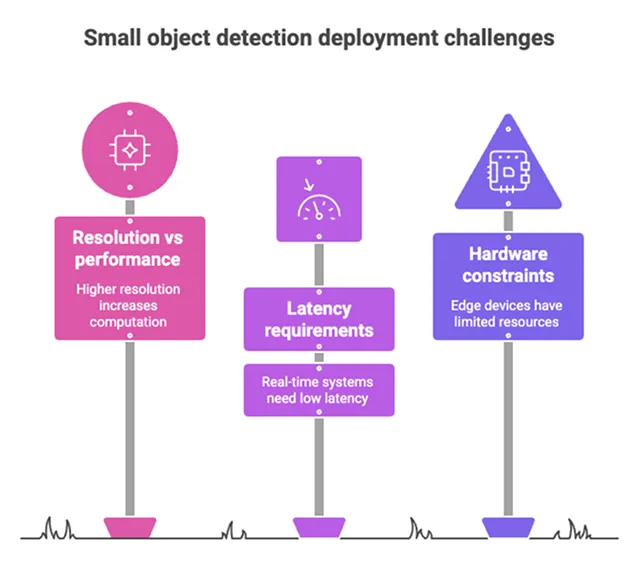

モデルのパフォーマンスは、管理されたテスト環境から実世界のデプロイメントに移行する際に変化することがよくあります。画像解像度、処理速度、利用可能なハードウェアなどの要因は、小さなオブジェクトのdetectに直接影響を与えるトレードオフをもたらします。

例えば、入力解像度を上げることで、小さなターゲットがより多くのピクセルを占め、より多くの詳細を保持するため、小さなオブジェクトのmAPを改善できます。しかし、高解像度はメモリ使用量と処理時間も増加させます。これにより、推論が遅くなり、運用コストが上昇する可能性があります。

ハードウェアの選択は、これらのトレードオフを管理する上で重要な役割を果たします。より強力なGPUは、より大きなモデルと高速な処理を可能にしますが、展開環境、特にエッジデバイスでは、計算リソースとメモリリソースが限られていることがよくあります。

リアルタイムアプリケーションには別の制約が加わります。低遅延を維持するためには、モデルサイズや入力解像度を削減する必要がある場合があり、これは小さなオブジェクトのrecallに悪影響を及ぼす可能性があります。最終的に、デプロイメントの決定は、detect性能とハードウェアの制限、速度要件、および全体的なコストのバランスを取る必要があります。

小さなオブジェクトdetectの改善には、特に実環境で作業する場合、実用的で構造化されたアプローチが必要です。考慮すべき主要なステップの概要を以下に示します。

小さなオブジェクトのmAPを改善するには、ランダムな調整ではなく、構造化されたデータ駆動型のアプローチが必要です。真の改善は、質の高いデータ、一貫したアノテーション、慎重なトレーニング、適切な評価方法を組み合わせることで実現します。実世界のプロジェクトでは、継続的なテストと小さく測定可能な変更が、時間とともに、より優れた信頼性の高い小さなオブジェクトdetectにつながります。

成長中のコミュニティに参加し、実践的なAIリソースについては、私たちのGitHubリポジトリをご覧ください。今すぐVision AIで構築を始めるには、私たちのライセンスオプションをご覧ください。ソリューションページをご覧になり、農業AIが農業をどのように変革しているか、そしてロボティクスにおけるVision AIが未来をどのように形作っているかをご覧ください。

未来の機械学習で、新たな一歩を踏み出しましょう。