ポーズ推定におけるUltralytics YOLO26と他のUltralytics YOLOモデルの比較

非人型のキーポイントサポートの強化、より高速な収束、オクルージョン処理の改善、効率的なリアルタイムデプロイにより、Ultralytics YOLO26がどのようにポーズ推定を向上させるかを紹介します。

誰かの姿勢を見たとき、猫背であったり、前かがみであったり、あるいは真っ直ぐ立っているのかを判別するのは容易です。人間は、身体の各部位がどのように関連しているかを直感的に素早く理解できます。

これは、私たちが日常生活で動きやボディランゲージを解釈する際の根源的な能力です。しかし、マシンにとってこの種の視覚的理解は自動的なものではありません。システムに動きや構造を認識させるには、高度なディープラーニングとコンピュータビジョン技術を用いて、画像を意味のある形で解釈できるようにする必要があります。

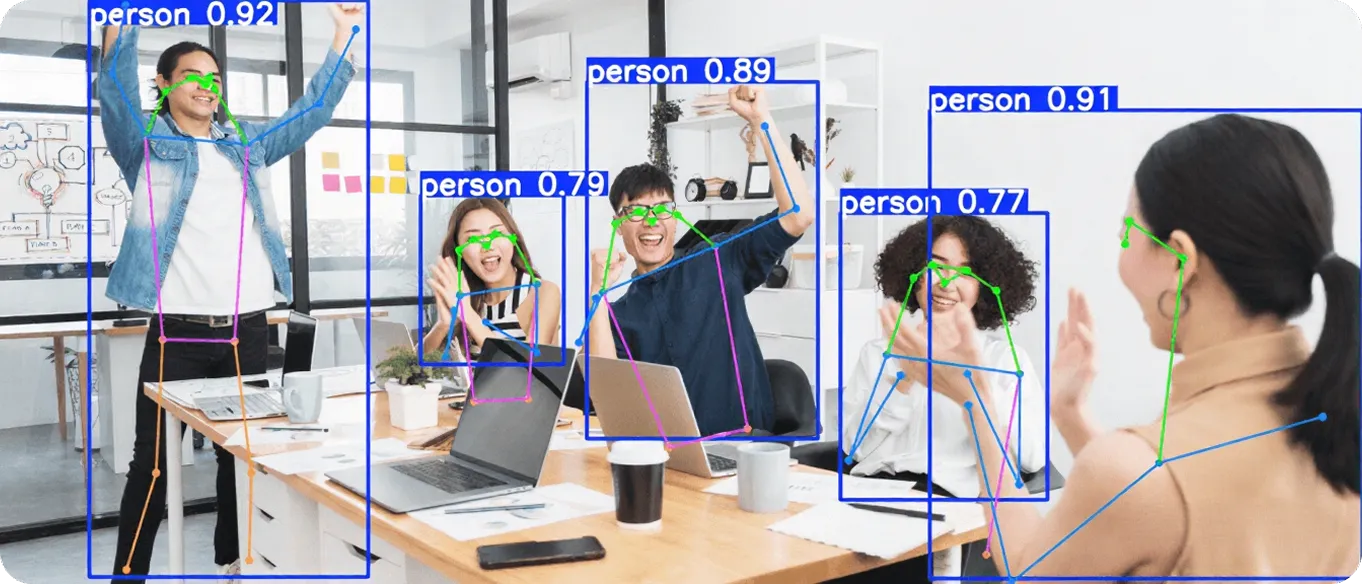

特に、ポーズ推定は、コンピュータビジョンモデルが同様の理解を実現するためのビジョンAI技術です。単に画像内のオブジェクトを検出するのではなく、重要な構造的ランドマークを表すキーポイントをモデルが予測します。

これらのキーポイントは、身体の関節、動物の手足、機械のコンポーネント、あるいはコートの角のような固定点に対応します。これらの点を特定し追跡することで、システムは位置、アライメント、動きを構造的かつ測定可能な方法で理解できます。

ポーズ推定がより多くの現実世界で応用されるにつれ、モデルは非人間的なキーポイント、複雑なシーン、そしてカスタムデータセットをより効果的に扱う必要が出てきました。例えば、Ultralytics YOLO26のような最新モデルは、ポーズ推定などのコンピュータビジョンタスクをサポートしており、柔軟性と全体的なパフォーマンスを向上させるために設計されたアーキテクチャおよびトレーニングの改良によって、以前のYOLOポーズモデルを強化しています。

図1:YOLOにより実現されたポーズ推定の例(ソース)

本記事では、YOLO26-poseを過去のUltralytics YOLOポーズモデルと比較し、複雑なシーンにおける柔軟性、収束速度、パフォーマンスがどのように改善されたのかを探ります。それでは始めましょう!

Link to this sectionポーズ推定とは何ですか?#

Ultralytics YOLOポーズモデルの比較に入る前に、コンピュータビジョンの文脈におけるポーズ推定の意味を詳しく見ていきましょう。

ポーズ推定とは、画像やビデオフレーム内の特定のキーポイントを検出・追跡するために使用される技術です。これらのキーポイントは、人間の身体の関節、動物の手足、機械の部品、あるいはシーン内の固定基準点など、重要な構造的ランドマークを表すことができます。

図2:人間のポーズ推定を用いた作業者の姿勢推定(ソース)

これらの点の座標を特定することで、モデルはオブジェクトがどのように配置され、時間とともにどのように動くかを理解できます。画像全体に単一のラベルを割り当てる画像分類や、オブジェクトの周囲にバウンディングボックスを描くことに重点を置くオブジェクト検出モデルとは異なり、ポーズ推定は構造や動きに関するより詳細な空間情報を提供します。

Link to this sectionYOLO26-poseの概要#

YOLO26-poseには、軽量なYOLO26n-poseから、より大型のYOLO26m-pose、YOLO26l-pose、YOLO26x-poseまで、複数のモデルバリエーションやサイズが用意されています。これにより、チームはハードウェアとパフォーマンスのニーズに応じて、速度と精度の最適なバランスを選択できます。

また、Ultralyticsは、人間のポーズ推定のためのCOCO-Pose(COCOキーポイント)アノテーションなど、大規模で汎用的なデータセットでトレーニングされた事前学習済みポーズモデルも提供しているため、ゼロから始める必要はありません。ほとんどの場合、チームは特定のキーポイント、レイアウト、または環境に適応させるために、独自のデータセットでこれらのモデルをファインチューニングします。

これには通常、構造化された形式でキーポイント座標とクラスラベルを定義するカスタムアノテーションファイルの準備が必要です。これらのアノテーションはキーポイントを各画像内の特定のピクセル座標にマッピングし、モデルがトレーニング中に正確な空間関係を学習できるようにします。

事前学習済みモデルを使用することで、トレーニングが高速化され、データ要件が削減され、プロジェクトをより効率的に本番環境へ移行できるようになります。

Link to this section人間のポーズ推定の現実的な応用#

ここでは、ポーズ推定が重要な役割を果たす現実的なユースケースをいくつか紹介します。

- ヘルスケアとリハビリテーション: 臨床医はポーズモデルを使用して、姿勢の評価、回復状況の監視、理学療法中の動きのパターンの分析を行うことができます。

- 自律システム: ドローンやスマートカメラは、ポーズ情報を使用して、動的なシーンにおけるオブジェクトの向きや動きをよりよく理解できます。

- 職場の安全性: 組織は身体のポジショニングや反復運動を監視し、潜在的な安全上のリスクを特定するのに役立てることができます。

- フィットネスとパーソナルトレーニング: フィットネスアプリはポーズ推定を使用して、運動フォームの追跡、反復回数のカウント、およびフィットネスチュートリアル中に維持される姿勢や動きに対するリアルタイムのフィードバックを提供します。

図3:ポーズ推定は、運動中に主要な身体ポイントを追跡するのに役立ちます。(ソース)

Link to this sectionUltralytics YOLO26のポーズ推定サポートを探る#

Ultralytics YOLO26は、トレーニングとデプロイをより実用的にするためのアップデートを加え、これまでのUltralytics YOLOモデルを基盤として構築されています。

以前のバージョンと同様に、統一されたフレームワークの一部としてポーズ推定をサポートしています。主な違いは、YOLO26がより幅広い現実世界のユースケースに対して、より柔軟かつ安定するように構築されている点です。

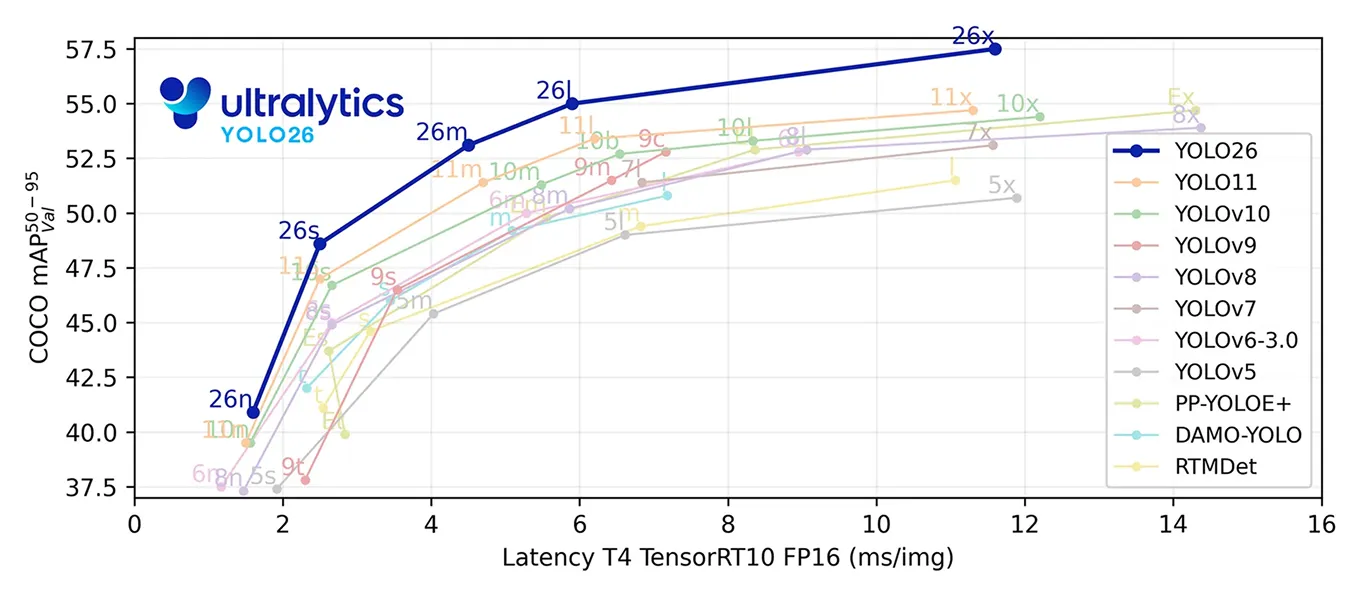

図4:YOLO26のベンチマーク(ソース)

初期のUltralytics YOLOポーズモデルは、人間のポーズデータセットの影響を強く受けており、旧来の手法の一部は人間の関節構造に最適化されていました。YOLO26では、それらの人間特有の前提条件を排除しました。

その結果、テニスコートの角やその他のカスタム構造ランドマークを検出するなど、人間以外のキーポイントに最適化されています。これは重要です。なぜなら、デフォルトの事前学習済みYOLO26-poseモデルは、COCO-poseのようなデータセットで学習されており、データセットのアノテーションで定義された人間のキーポイントを予測するからです。

しかし、機械のコンポーネント、スポーツフィールドのマーカー、インフラストラクチャのポイントなど、異なる種類のランドマークを検出したい場合、モデルは通常、それらの特定のキーポイントがアノテーションされたカスタムデータセットでファインチューニングする必要があります。

YOLO26は人間の関節構造に関する前提に縛られていないため、ファインチューニング中に効果的に適応できます。この柔軟性により、カスタムキーポイントレイアウトをより確実に学習でき、独自のキーポイント構成を持つデータセットで検証する際に、評価指標の向上が見込めます。

また、YOLO26-poseは、オブジェクトの一部が隠れていたり、非常に小さいスケールで表示されていたりする場合でも、キーポイントのローカライズを改善するように設計されています。遠方の被写体やドローン映像、あるいは小さなオブジェクトを扱う現実世界のシーンにおいて、これにより以前のポーズモデルよりも正確なキーポイント予測が可能になります。

もう一つの重要なアップデートは、トレーニング中に使用される損失計算式(ロスフォーミュレーション)の改良です。損失関数は、モデルが学習中にいかにして間違いを修正するかを決定します。

YOLO26-poseにおいて、このプロセスはより効率的であり、モデルがより速く学習し、より少ないエポック数(ここでエポックとは、トレーニングデータセット全体に対する1回の完全なパスを指します)で強力な精度に到達するのに役立ちます。

全体として、YOLO26-poseは、以前のUltralytics YOLOポーズモデルを基盤にしつつ、使い慣れたワークフローを維持しながら、人間以外のキーポイントサポートとトレーニング収束において明確な改善を実現しています。

Link to this sectionYOLO26-poseとUltralytics YOLOv5の比較#

最も初期のUltralytics YOLOモデルであるUltralytics YOLOv5は、主にオブジェクト検出のために構築されました。YOLOv5は後にインスタンスセグメンテーションをサポートするように拡張されましたが、公式のUltralyticsフレームワーク内に専用のネイティブなポーズ推定ヘッドは含まれていません。

キーポイント検出を必要とするチームは、通常、個別の実装やカスタム修正に依存していました。Ultralytics YOLO26には、ポーズ推定が組み込みタスクとして含まれており、キーポイントを予測するために特別に設計された専用のアーキテクチャヘッドが搭載されています。

これは、YOLO26-poseモデルが検出やセグメンテーションと同じ統一されたワークフロー内でトレーニング、検証、デプロイできることを意味します。構造化されたキーポイント検出に焦点を当てたプロジェクトにとって、YOLO26はYOLOv5が備えていないネイティブなポーズサポートとタスク固有のアーキテクチャを提供します。

Link to this section主な違い:YOLO26-pose vs Ultralytics YOLOv8-pose#

Ultralytics YOLOv8は、統一されたUltralyticsフレームワーク内でネイティブなポーズ推定を導入し、検出やセグメンテーションと同じワークフローを使用してキーポイントモデルを簡単にトレーニングおよびデプロイできるようにしました。これは、非最大値抑制(NMS)を用いた従来のポストプロセッシングパイプラインに依存し、バウンディングボックスの回帰やトレーニングには以前の損失計算式を使用しています。

YOLO26は、ポーズ推定に直接影響を与えるアーキテクチャおよびトレーニングのアップデートによって、この基盤の上に構築されています。一つの大きな違いはエンドツーエンドの設計です。YOLO26は推論中に外部のNMSを必要としないため、デプロイが簡素化され、特にCPUやエッジデバイスにおけるレイテンシの一貫性が向上します。

もう一つの重要な改善点は、トレーニング方法論です。YOLO26は、最新の損失戦略とともにMuSGDオプティマイザーを導入しました。ポーズタスク向けには、キーポイントの不確実性がどのようにモデル化されるかを改善する残差対数尤度推定(Residual Log-Likelihood Estimation)を統合しています。これらの変更を組み合わせることで、特に複雑なシーンや部分的に遮蔽されたシーンにおいて、収束の高速化とより安定したキーポイント予測が可能になります。

要約すると、YOLOv8-poseは強力で汎用性の高いベースラインを確立しました。YOLO26-poseは、トレーニング効率の向上、遮蔽への対応能力の向上、そして現実世界の人間以外のポーズアプリケーションに対する柔軟性を高めることで、そのベースラインを洗練させています。

Link to this sectionYOLO26-pose vs Ultralytics YOLO11-pose:何が改善されたか?#

Ultralytics YOLO11は、バックボーンと特徴抽出層を洗練させることでUltralytics YOLOv8を基盤として構築されました。FLOPsを削減し、パラメーター効率を改善し、強力なリアルタイムパフォーマンスを維持しつつ、より高いmAPを実現しました。ポーズタスクにおいては、これはより軽量なアーキテクチャでより優れたキーポイント精度を意味しました。

YOLO26-poseは、より根本的なアーキテクチャのシフトにより、その進化を継続しています。端的に言えば、YOLO11はYOLOv8の効率と精度を洗練させたものであり、YOLO26はその基盤の上に、より速い収束、より安定した推論、複雑なシナリオにおけるポーズ精度の向上を目指したアーキテクチャおよびトレーニングのアップデートを加えて構築されています。

Link to this sectionなぜポーズ推定にYOLO26モデルを使い始めるべきなのか?#

Ultralytics YOLOモデルの違いを探る中で、YOLO26-poseに移行すべきかどうか迷っているかもしれません。

簡潔に言えば、移行は簡単です。すでにUltralytics YOLOv8-poseやUltralytics YOLO11-poseを使用している場合、YOLO26-poseへの切り替えは通常、パイプラインを再構築することではなく、モデルバージョンを変更するだけで済みます。

同じUltralyticsフレームワーク内に留まりながら、人間以外のキーポイントに対する優れたサポート、トレーニング中の高速な収束、遮蔽されたポイントの取り扱いの改善というメリットを享受できます。新規および既存のほとんどのポーズプロジェクトにとって、YOLO26-poseへの移行は最小限の労力でこれらの改善を得るための簡単な方法です。

さらに、YOLO26-poseはUltralytics Pythonパッケージ内で完全にサポートされており、これはPyTorch上に構築されているため、トレーニング、検証、デプロイがシンプルです。モデルはONNX、TensorRT、OpenVINO、CoreML、TFLiteなどの形式にエクスポートできるため、全体的なワークフローを変更することなく、GPU、CPU、およびエッジデバイス間で簡単にデプロイできます。

Link to this section重要なポイント#

Ultralytics YOLO26-poseは、特に人間以外のキーポイントや複雑なシーンを扱う際に、ポーズ推定をより柔軟で信頼性の高いものにします。トレーニングはより速く、遮蔽への対応能力も向上し、異なるデータセット間でより一貫した結果を提供します。すでにUltralytics YOLOポーズモデルを使用しているチームにとって、YOLO26は既存のワークフローを変更することなく明確な改善を提供します。

AIについてもっと知りたいですか?私たちのコミュニティとGitHubリポジトリをチェックしてください。ロボティクスにおけるAIや農業におけるコンピュータビジョンについて学ぶには、ソリューションページを探索してください。ライセンスのオプションを確認し、今日からコンピュータビジョンで構築を始めましょう!