Ultralytics YOLO26 vs YOLO11 vs YOLOv8: どれを選ぶべきか?

Ultralytics YOLO26、Ultralytics YOLO11、Ultralytics YOLOv8を比較し、プロジェクトに最適なコンピュータビジョンモデルを見つけましょう。

畳み込みニューラルネットワーク(CNN)をベースとした最先端のコンピュータビジョンシステムは、機械による画像や動画からの視覚データの解析・解釈を可能にし、現在では幅広い環境で展開されています。

農業から製造業、小売業に至るまで、これらのシステムはエッジデバイス、組み込みハードウェア、IoTデバイス、オンデバイス処理、そしてリアルタイムアプリケーションを支える大規模なクラウドパイプラインなど、さまざまな展開環境で動作します。

実運用において、これらのモデルのデプロイは必ずしも容易ではありません。限られた計算リソースで動作させ、厳格なレイテンシ要件を満たし、コストを大幅に増やすことなくスケーリングする必要があるためです。こうした制約により、パフォーマンスは単なる精度だけでなく、多次元的な課題となっています。

精度は依然として重要ですが、モデルが本番環境で効率的に動作することも同様に重要です。速度、リソース使用率、スケーラビリティといった要素が、長期的なシステムパフォーマンスを大きく左右します。

Ultralytics YOLOモデルのようなコンピュータビジョンモデルは、このバランスを考慮して進化してきました。例えば、Ultralytics YOLOv8は堅牢で汎用性の高い基盤を確立し、Ultralytics YOLO11は速度と精度を向上させて一歩前進しました。そしてUltralytics YOLO26は、これまでのモデルより軽量、高速、かつ効率的になることで、その基盤の上に成り立っています。

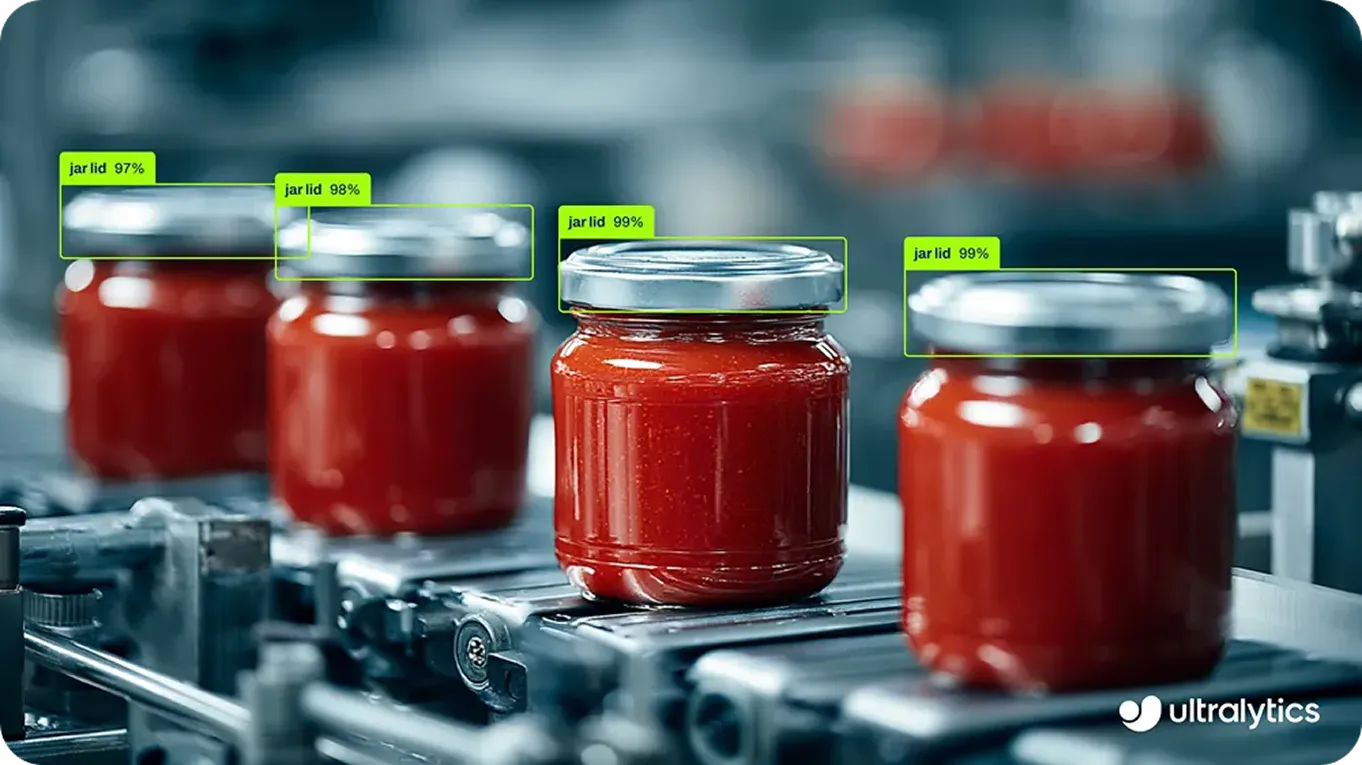

図1. 画像内のオブジェクトを検出するUltralytics YOLO26 (ソース)

本記事では、コンピュータビジョンプロジェクトに最適なモデルを選択できるよう、Ultralytics YOLO26、YOLO11、YOLOv8を比較します。それでは始めましょう!

Link to this sectionUltralytics YOLOモデルの進化を理解する#

Ultralytics YOLOモデルは各バージョンアップで改善を重ね、現実世界の要件を満たし、コンピュータビジョンをより利用しやすくしてきました。これらのアップデートにより、モデルの高速化、効率化、そしてデプロイの簡素化が実現し、ビジョンAIエコシステムの成長を支えています。

また、これらのモデルはPyTorchをベースに構築されており、学習、カスタマイズ、インテリジェントな機械学習ワークフローへの統合が容易です。Ultralytics YOLOモデルは最初から事前学習済みモデルとして利用可能であり、多くの場合COCOデータセットなどで学習されているため、チームは素早く開発を開始し、特定のユースケースに合わせてファインチューニングを行うことができます。

さらに、Ultralytics Pythonパッケージは、ONNXやTensorRTといった形式へのモデルエクスポートをサポートしているため、デプロイが簡略化されます。これにより、エッジデバイスからGPUアクセラレーションシステムまで、さまざまなハードウェアプラットフォーム間でのモデル統合が容易になります。

Link to this sectionUltralytics YOLOv5からUltralytics YOLO26へ#

最初のUltralytics YOLOモデルであるUltralytics YOLOv5は、その信頼性の高いオブジェクト検出機能により広く普及しました。1ステージ検出アプローチを採用することで、単一パスでの高速なリアルタイム予測が可能となり、本番ワークフローに最適でした。

その後のアップデートでは、事前定義されたアンカーボックスを使わずにオブジェクト位置を直接予測するアンカーフリーのバリエーションが導入され、検出の柔軟性が高まりました。ただし、当初のモデルは主にオブジェクト検出タスクに重点を置いていました。

この基盤を基に、YOLOv8ではモデルファミリーの対象範囲が拡大されました。オブジェクト検出だけでなく、インスタンスセグメンテーション、画像分類、姿勢推定、回転ボックス(OBB)検出といった複数のコンピュータビジョンタスクをサポートするようになりました。また、高度なバックボーンやネック設計などのアーキテクチャ改良が施され、特徴抽出能力と全体的な検出パフォーマンスが向上しました。

さらに、YOLOv8n(Nano)、YOLOv8s(Small)、YOLOv8m(Medium)、YOLOv8l(Large)、YOLOv8x(Extra Large)といったバリエーションにより、開発者はニーズに応じて速度、精度、リソース使用量を調整できるようになりました。この幅広い機能と使いやすさにより、YOLOv8は多種多様なビジョンアプリケーションの有力な選択肢となりました。

図2. YOLOv8、YOLO11、YOLO26のようなYOLOモデルは、さまざまなビジョンタスクをサポートしています。

続いて登場したYOLO11は、実運用ワークフローでのパフォーマンス向上に注力し、推論速度の高速化とともに精度の向上を実現しました。軽量化されたアーキテクチャにより、エッジおよびクラウドの両環境でうまく機能し、既存のYOLOv8パイプラインとの互換性も維持しています。

Ultralytics YOLOモデルファミリーの最新モデルであるYOLO26は、エッジファーストなビジョンAIの新たな基準を打ち立てる最先端モデルであり、実運用においてより軽量、高速、かつ効率的なアプローチを提供します。CPUや組み込みシステムで効率的に実行できるよう設計されており、デプロイを簡素化し、幅広いアプリケーションでリアルタイムパフォーマンスを向上させます。

Link to this sectionYOLO26 vs YOLO11 vs YOLOv8の比較#

コンピュータビジョンプロジェクトに取り組む際、さまざまなUltralyticsモデルが存在し、どれが最適か迷うことがあるかもしれません。ここでは、YOLO26、YOLO11、YOLOv8を実環境でどのように比較すべきかを見ていきましょう。

YOLOv8は2023年にリリースされ、それ以来コンピュータビジョンコミュニティで広く使用されてきました。その強力なコミュニティサポートと使いやすさにより、多くのチームにとって頼りになるモデルでした。チュートリアル、ガイド、コミュニティリソースが充実したモデルを探しているなら、YOLOv8は最適な出発点です。

2024年に導入されたYOLO11は、パフォーマンスと効率の両面で改善されました。YOLOv8と比較して、より小型で最適化されたアーキテクチャを維持しつつ、優れた速度と精度を提供します。リソース使用量を大幅に増やすことなく、本番環境で確実に動作するバランスの取れたモデルです。

今年リリースされた最新版のYOLO26は、大規模なデプロイの効率化に焦点を当てています。CPUでの推論が高速化され、リソース利用率が向上したため、同じハードウェアでより多くのワークロードを実行できるようになりました。

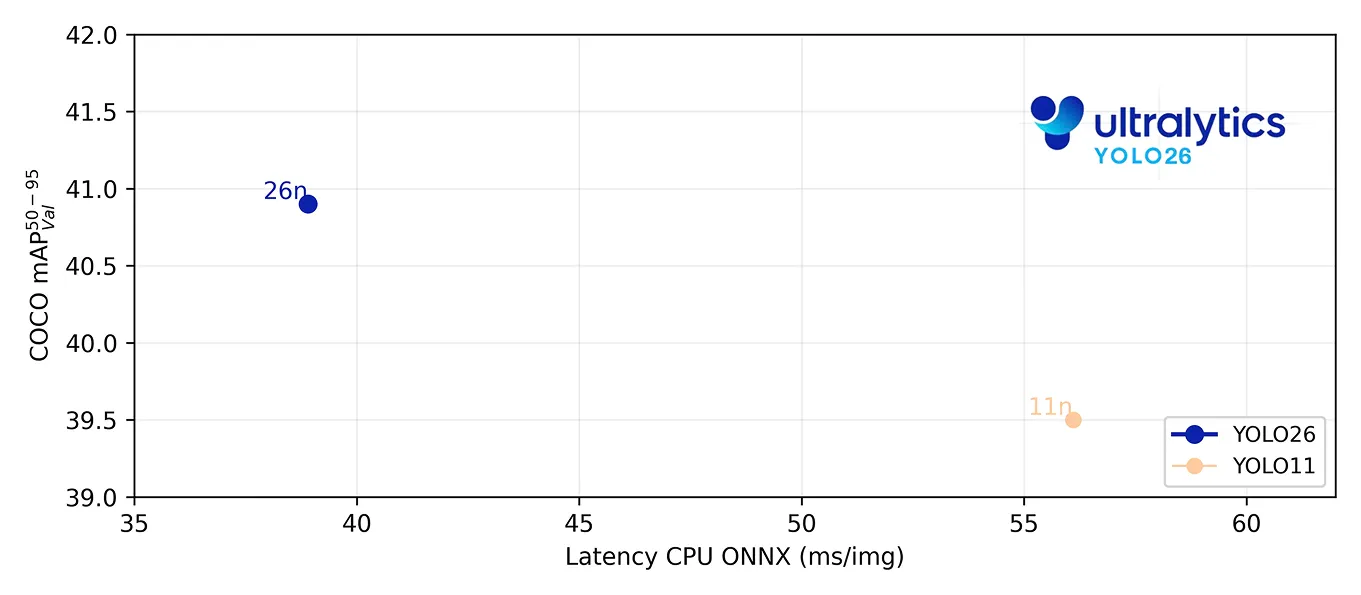

例えば、YOLO26のnanoモデルは、CPU上でYOLO11よりも最大43%高速な推論が可能であり、エッジやリソースが制限された環境にとって優れた選択肢となります。従来のシステムは高コストでスケーリングが困難なGPUに大きく依存することが多いため、これは非常に重要です。

図3. CPU上でのYOLO26のパフォーマンスベンチマーク (ソース)

全体として、YOLO26は、パフォーマンス、コスト、スケーラビリティのトレードオフを最適化したいと考えているチームや個人にとって確実な選択肢です。

Link to this sectionUltralytics YOLO26の詳細#

YOLO26は、精度と同じくらい効率性、速度、スケーラビリティが重要となる実運用環境向けに設計された最先端モデルです。ベンチマークスコアの向上だけに集中するのではなく、モデルの実行の容易さ、デプロイの迅速さ、そして多様なハードウェア環境での信頼性を高めるためのアーキテクチャおよび学習上の変更が導入されています。

これらの改善は、限られたコンピューティングリソース、レイテンシの制約、コストへの配慮が不可欠なエッジシステムや本番環境において特に重要です。YOLO26は推論を簡素化しパフォーマンスを最適化することで、AI開発者がビジョンアプリケーションをより効率的に構築・拡張できるよう支援します。

YOLO26の主な特徴を詳しく見ていきましょう。

- エンドツーエンドのNMSフリー推論: 重要な変更点の1つは、非最大値抑制(NMS)不要の設計です。これにより後処理が不要になり、モデルが直接最終的な予測結果を出力します。その結果、レイテンシが予測しやすくなり、デプロイが容易になります。

- DFLの削除: YOLO26は、Distribution Focal Loss(DFL)モジュールから離れ、よりシンプルなバウンディングボックス予測アプローチを採用しています。この変更はエンドツーエンドのNMSフリー設計と整合しており、パイプラインの複雑さを軽減し、デプロイの一貫性を向上させます。

- MuSGDオプティマイザー: 最新のUltralytics YOLOモデルでは、Stochastic Gradient Descent(SGD)とMuonに着想を得たアップデートを組み合わせたハイブリッドオプティマイザー「MuSGD」を導入しています。これにより学習の安定性と収束性が向上し、最適化がスムーズになり、モデルサイズに関わらず一貫した挙動が得られます。

- ProgLossとSTAL: これらの学習技術の革新、すなわちProgressive Loss Balancing(ProgLoss)とSmall-Target-Aware Label Assignment(STAL)は、モデルの安定性と信頼性を高めます。ProgLossはデータセットから段階的に学習するのに役立ち、STALは学習中に小さなオブジェクトが無視されないようにすることで、複雑なシーンでの検出精度を向上させます。

Link to this section精度と効率のトレードオフ:ベンチマークを超えた実運用パフォーマンスへ#

YOLO26、YOLO11、YOLOv8の違いを理解するために、実環境でのモデルパフォーマンスを左右する要因について詳しく掘り下げます。

mean average precision (mAP) などのパフォーマンスメトリクスで測定される精度は、コンピュータビジョンモデルを評価する上で長い間重要な指標とされてきました。これは標準化された条件下でのモデルの性能を示すものであり、異なるバージョンを比較する際に有用です。

しかし、モデルをテストから実運用に移す場合、精度だけでは不十分です。本番環境のパフォーマンスは、モデルサイズ、推論時間(レイテンシ)、計算リソースの使用量、そしてシステムが異なる環境間でどの程度スケーリングできるかといった要因に依存します。

管理されたベンチマークとは異なり、実世界は往々にして予測不可能です。照明条件の変化、オブジェクトの遮蔽、そしてモデル学習時とは大きく異なる入力データが発生する可能性があります。こうした変動が、実環境でのモデルの一貫したパフォーマンスに影響を与えることがあります。

図4. 工事現場のような予測不可能な環境でYOLO26が使用されている例。

例えば、スマートシティ、小売店、倉庫などで数百台のカメラを設置するケースを考えてみましょう。各ストリームをリアルタイムで処理する必要があり、遅延やフレーム欠落を防ぐためには安定したフレームレート(FPS)が求められます。

効率の低いモデルでは、同じシステムで処理できる同時ストリーム数が少なくなります。つまり、スケーリングには追加のハードウェアが必要となり、インフラコストが増大することを意味します。

YOLO26のように効率的なモデルは、同じハードウェアでより多くのストリームを処理でき、利用可能なリソースを最大限に活用します。これによりシステム全体の効率が向上し、長期的なデプロイのスケーリングが容易になります。

YOLO26、YOLO11、YOLOv8のより深い比較については、公式Ultralyticsドキュメントをご覧ください。

Link to this section重要なポイント#

Ultralytics YOLOモデルシリーズは、現実世界のデプロイニーズに合わせる形で進化してきました。各バージョンは前作を基盤とし、効率性、スケーラビリティ、そしてデプロイの容易さに焦点を当てています。つまり、スケールを維持しながら信頼性の高いリアルタイム検出アプリケーションを構築したい場合、Ultralytics YOLO26は完璧な選択肢です。

ビジョンAIを業務に導入したいとお考えですか?ライセンスオプションをご確認ください。製造現場でのAIがいかに工場を変革しているか、またロボティクスにおけるビジョンAIがいかに未来を形成しているかについては、ソリューションページをご覧ください。成長を続けるコミュニティに参加し、AIリソースについてはGitHubリポジトリを探索してください。