プロンプト可能なコンセプトsegmentation、それが従来の方法とどう異なるか、そしてYOLOE-26のような関連モデルがどのようにオープンボキャブラリ機能を可能にするかを探ります。

プロンプト可能なコンセプトsegmentation、それが従来の方法とどう異なるか、そしてYOLOE-26のような関連モデルがどのようにオープンボキャブラリ機能を可能にするかを探ります。

Vision AIは急速に進歩しており、現実世界の環境で画像やビデオを分析するために広く使用されています。例えば、交通管理システムから小売分析に至るまでのアプリケーションが、コンピュータービジョンモデルと統合されています。

これらの多くのアプリケーションでは、物体検出モデルなどのビジョンモデルが、車両、人物、機器を含む事前定義されたオブジェクトセットを認識するように訓練されます。訓練中、これらのモデルには多数のラベル付けされた例が示され、各オブジェクトがどのように見えるか、およびシーン内の他のオブジェクトと区別する方法を学習できます。

segmentタスクの場合、モデルはこれらのオブジェクトの周囲に正確なピクセルレベルの輪郭を生成することで、さらに一歩進みます。これにより、システムは画像内の各オブジェクトがどこに位置しているかを正確に理解できるようになります。

これは、システムが学習した内容のみを認識する必要がある限りはうまく機能します。しかし、現実世界の環境では、そのようなケースは稀です。

視覚シーンは通常動的です。新しいオブジェクトや視覚的概念が出現し、条件が変化し、ユーザーはしばしば、元のトレーニング設定の一部ではなかったオブジェクトをsegmentしたいと考えます。

これらの制限は、segmentationに関して特に明らかです。Vision AIが進化し続けるにつれて、繰り返し再トレーニングすることなく新しい概念に適応できる、より柔軟なsegmentationモデルへのニーズが高まっています。それが、プロンプト可能なコンセプトsegmentation (PCS) が注目を集めている理由です。

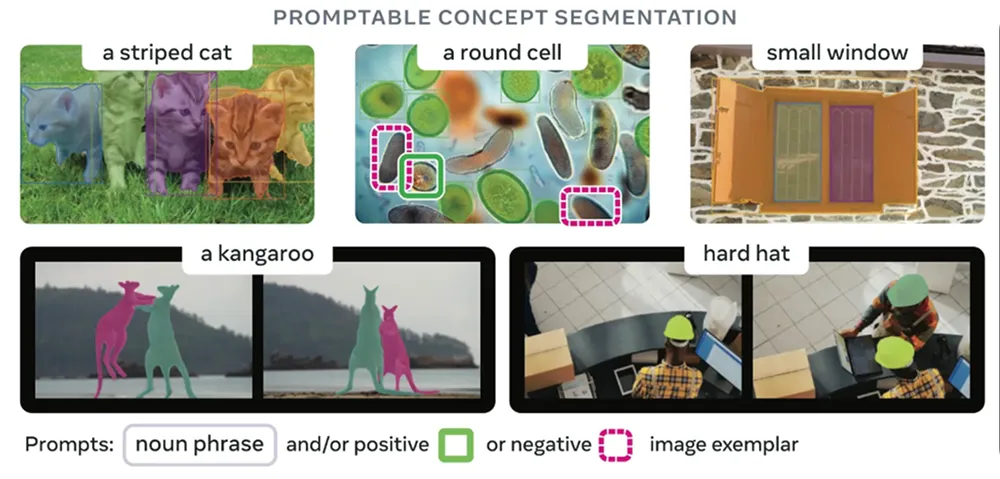

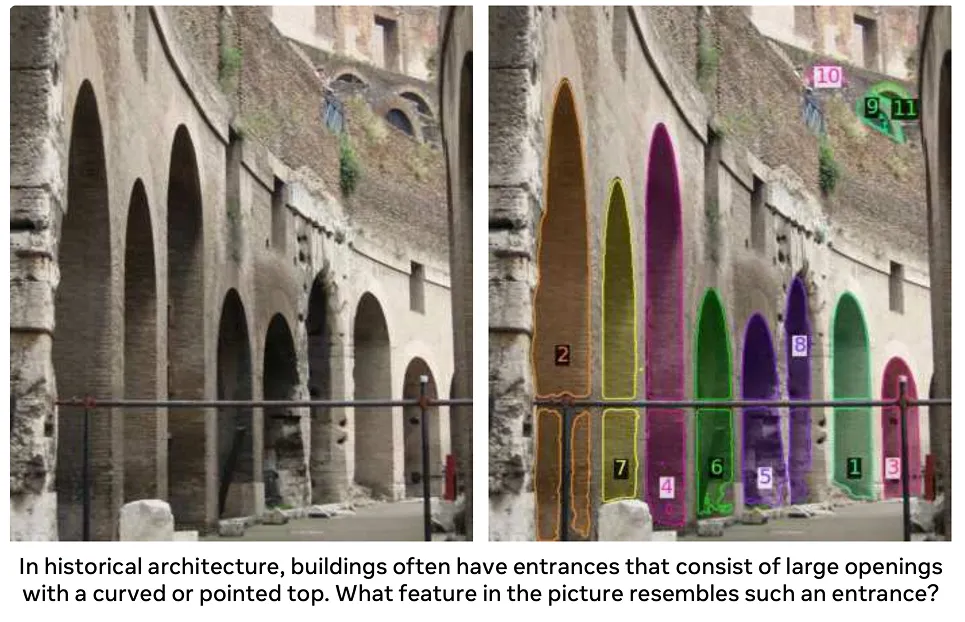

固定されたオブジェクトカテゴリのリストに依存する代わりに、ユーザーは、テキスト、視覚的なプロンプト、またはサンプル画像を使用して、セグメント化したいものを記述できます。これらのモデルは、記述された概念がトレーニング中に明示的に含まれていなかったとしても、それに一致するすべての領域を識別し、セグメント化できます。

本記事では、プロンプト可能なコンセプトsegmentationがどのように機能し、従来のアプローチとどう異なり、今日どこで使用されているかを探ります。

ほとんどの場合、segmentationモデルは少数のオブジェクトタイプを認識するように訓練されます。これは、ビジョンAIシステムが特定のオブジェクトセットをdetectしsegmentするだけでよい場合にうまく機能します。

しかし、実世界のアプリケーションでは、視覚シーンは動的です。新しいオブジェクトが出現し、タスク要件が変化し、ユーザーは元のラベルセットに含まれていなかったコンセプトをsegmentする必要があることがよくあります。このような状況をサポートするには、通常、新しい高品質なデータとアノテーションを収集し、モデルを再学習する必要があり、これによりコストが増加し、デプロイメントが遅くなります。

プロンプト可能なコンセプトsegmentationは、ユーザーが固定されたラベルのリストから選択する代わりに、モデルに何を探すべきかを伝えることを可能にすることで、この問題を解決します。ユーザーが探しているオブジェクトやアイデアを記述すると、モデルは画像内のすべての一致する領域をハイライト表示します。これにより、ユーザーの意図を画像内の実際のピクセルに結びつけることがはるかに容易になります。

プロンプト可能な概念セグメンテーションをサポートするモデルは、さまざまな種類の入力を受け入れることができるため、柔軟性があります。言い換えれば、テキスト記述、視覚的ヒント、または例示画像を通じて、モデルに何を探すべきかを伝える方法は複数あります。

各アプローチについて詳しく見ていきましょう。

プロンプト可能なコンセプトセグメンテーションがどのように機能するかを深く掘り下げる前に、まずさまざまな従来のオブジェクトセグメンテーション手法と比較してみましょう。

PCSはオープンボキャブラリーでプロンプト駆動型のモデルを可能にします。プロンプトを通じて記述された新しいアイデアに対応できますが、従来のセグメンテーションはできません。従来のセグメンテーションアプローチにはいくつかの異なるタイプがあり、それぞれに独自の仮定と限界があります。

従来のsegmentationの主要な種類をいくつか見ていきましょう。

これらのアプローチはすべて、事前に定義されたオブジェクトカテゴリのリストに依存しています。その範囲内ではうまく機能しますが、その範囲外の概念にはあまりうまく対処できません。新しい特定のオブジェクトをsegmentする必要がある場合、通常、追加のトレーニングデータとモデルのファインチューニングが必要です。

PCSはそれを変えることを目指しています。事前定義されたカテゴリに縛られるのではなく、推論時に画像内で segment したいものを記述できます。

次に、segmentモデルがプロンプト可能なコンセプトsegmentへとどのように進化したかを見ていきましょう。

segmentationにおける転換点となった人気のある基盤モデルは、SAM、すなわちSegment Anything Modelでした。これは2023年に導入されました。事前定義されたオブジェクトカテゴリに依存するのではなく、SAMはユーザーが点やバウンディングボックスなどのシンプルな視覚的プロンプトを使用してsegmentationをガイドすることを可能にしました。

SAMを使用すると、ユーザーはラベルを選択する必要がなくなりました。オブジェクトがどこにあるかを simply 示すだけで、モデルがそのマスクを生成します。これにより segmentation はより柔軟になりましたが、ユーザーは依然としてモデルにどこを見るべきかを示す必要がありました。

2024年にリリースされたSAM 2は、より複雑なシーンに対応し、プロンプト可能なsegmentationを動画に拡張することで、このアイデアを基盤としました。さまざまな照明条件、オブジェクトの形状、動きに対して堅牢性を向上させつつも、segmentationをガイドするために主に視覚的なプロンプトに依存しています。

SAM 3モデルは、この進化における最新のステップです。昨年リリースされたこの統合モデルは、視覚的理解と言語ガイダンスを組み合わせることで、画像および動画のsegmentationタスク全体で一貫した動作を可能にします。

SAM 3では、ユーザーはポインティングや描画プロンプトに限定されません。代わりに、テキストを使用して segment したいものを記述でき、モデルはその記述に一致する領域を画像またはビデオフレーム内で検索します。

segmentは固定されたオブジェクトカテゴリではなく、概念によって導かれ、異なるシーンや時間を通じてオープンボキャブラリの使用をサポートします。実際、SAM 3は、Wikidataなどのソースから派生したオントロジーに基づき、大規模な学習データを通じて拡張された、広範な学習済み概念空間上で動作します。

幾何学的プロンプトに主に依存していた以前のバージョンと比較して、SAM 3はより柔軟で概念駆動型のsegmentationへの一歩を示します。これにより、関心のあるオブジェクトやアイデアが変化し、常に事前に定義できるとは限らない実世界での応用により適しています。

プロンプト可能な概念セグメンテーションはどのように機能するのでしょうか?これは、大規模な事前学習済みビジョンモデルとビジョン言語モデルに基づいて構築されています。これらのモデルは、膨大な画像コレクション、多くの場合、それに対応するテキストで学習されており、一般的な視覚パターンと意味論的意味を学習することができます。

ほとんどのPCSモデルはTransformerベースのアーキテクチャを使用しており、画像全体を一度に処理して、異なる領域が互いにどのように関連しているかを理解します。ビジョントランスフォーマーは画像から視覚的特徴を抽出し、テキストエンコーダーは単語をモデルが扱える数値表現に変換します。

トレーニング中、これらのモデルは、正確なオブジェクト境界を定義するピクセルレベルのマスク、オブジェクトを大まかに特定するバウンディングボックス、および画像に何が表示されているかを記述する画像レベルのラベルなど、さまざまな種類の教師あり学習から学習できます。さまざまな種類のラベル付きデータを使用してトレーニングすることで、モデルは細かい詳細とより広範な視覚的概念の両方を捉えることができます。

推論時、つまりモデルが実際に予測を行うために使用されるとき、PCSはプロンプト駆動型プロセスに従います。ユーザーはテキスト記述、点やボックスのような視覚的なヒント、または例の画像を通じてガイダンスを提供します。モデルはプロンプトと画像の両方を共有の内部表現または埋め込みにエンコードし、記述された概念と一致する領域を識別します。

マスクデコーダは、この共有表現を正確なピクセルレベルのsegmentationマスクに変換します。モデルは視覚的特徴と意味的意味を関連付けているため、トレーニング中に明示的に含まれていなかった新しい概念でもsegmentできます。

また、多くの場合、プロンプトを調整したり、追加のガイダンスを加えたりすることで出力を洗練でき、これによりモデルが複雑または曖昧なシーンを処理するのに役立ちます。この反復プロセスは、デプロイメント中の実用的な最適化をサポートします。

プロンプト可能なコンセプトsegmentationモデルは、通常、以前に見たことのないコンセプトをどれだけうまくsegmentできるか、そして異なるシーンでどれだけ堅牢に機能するかという点に基づいて評価されます。ベンチマークはしばしば、マスク品質、汎化性能、計算効率に焦点を当て、これらは現実世界の展開要件を反映しています。

次に、プロンプト可能なコンセプトsegmentがすでにどこで使われ、実際に影響を与え始めているかを見てみましょう。

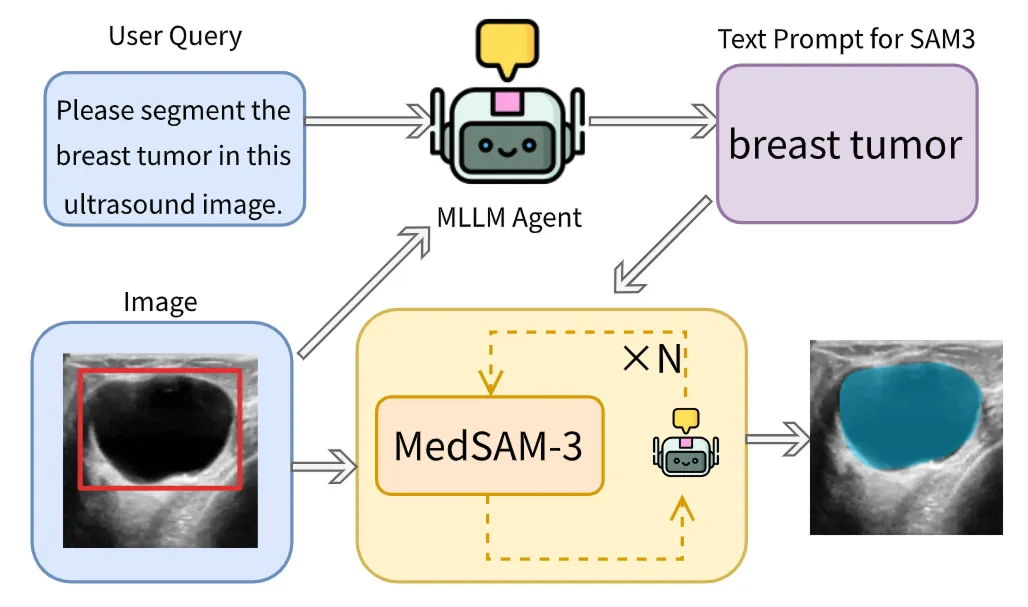

医用画像には多くの生物学的構造、疾患、スキャンタイプが含まれており、毎日新しい症例が発生します。従来のsegmentationモデルは、この多様性に対応するのに苦労しています。

PCSは、短い固定されたリストから選択するのではなく、臨床医が探したいものを記述できるため、この分野に自然に適合します。テキストフレーズや視覚的なプロンプトを使用して、PCSは新しいタスクごとにモデルを再トレーニングすることなく、臓器や懸念領域を直接 segment するために使用できます。これにより、多様な臨床ニーズへの対応が容易になり、手動でのマスク描画の必要性が減り、多くの画像タイプで機能します。

素晴らしい例の1つはMedSAM-3です。これは、医用画像におけるテキストプロンプト可能なPCS向けにSAM 3アーキテクチャを適応させたものです。このモデルは、肝臓や腎臓のような臓器名、腫瘍や病変のような病変関連の概念など、明示的な解剖学的および病理学的用語でプロンプトできます。プロンプトが与えられると、モデルは医用画像内の対応する領域を直接segmentします。

MedSAM-3は、テキストと画像の両方で推論できるマルチモーダル大規模言語モデル (MLLMまたはマルチモーダルLLM) も統合しています。これらのモデルは、エージェント・イン・ザ・ループ設定で動作し、より困難なケースでの精度を向上させるために結果が反復的に洗練されます。

MedSAM-3は、X線、MRI、CT、超音波、およびビデオデータ全体で優れた性能を発揮し、PCSが実際の臨床現場でより柔軟で効率的な医用画像ワークフローをどのように実現できるかを強調しています。

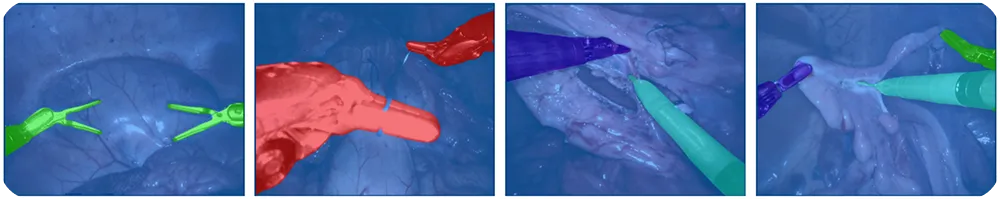

ロボット手術では、ツールをtrackし、急速に変化する手術シーンを理解するためにビジョンシステムが不可欠です。器具は素早く動き、照明は変化し、新しいツールがいつでも現れる可能性があるため、事前定義されたラベルシステムの維持は困難になります。

PCSを使用すると、ロボットはリアルタイムでツールを track し、カメラを誘導し、手術手順を追跡できます。これにより手動でのラベリングが減り、システムをさまざまな手順に簡単に適応させることができます。外科医や自動化システムは、「グリッパー」、「メス」、「カメラツール」などのテキストプロンプトを使用して、画像内で何を segment すべきかを示すことができます。

プロンプト可能な概念セグメンテーションに関連するもう一つの興味深い最先端モデルは、当社のUltralytics YOLOE-26です。当社のモデルは、オープンボキャブラリー、プロンプト駆動型セグメンテーションをUltralytics YOLOモデルファミリーにもたらします。

YOLOE-26はUltralytics YOLO26アーキテクチャに基づいて構築されており、オープンボキャブラリーのinstance segmentをサポートしています。YOLOE-26は、ユーザーがいくつかの方法でsegmentをガイドすることを可能にします。

短く視覚的に根拠のあるフレーズでターゲットオブジェクトを指定できるテキストプロンプトと、画像の手がかりに基づいて追加のガイダンスを提供するビジュアルプロンプトをサポートしています。さらに、YOLOE-26には、ユーザープロンプトを必要とせずに、モデルが組み込みの語彙からオブジェクトをdetectおよびsegmentするゼロショット推論用のプロンプトフリーモードが含まれています。

YOLOE-26は、オブジェクトカテゴリが変化する可能性があるが、低レイテンシと信頼性の高いスループットが不可欠であるビデオ分析、ロボティクス知覚、エッジベースシステムなどのアプリケーションに最適です。また、アノテーションプロセスの一部を自動化することでワークフローを効率化するため、データラベリングとデータセットキュレーションにも特に役立ちます。

プロンプト可能なコンセプトsegmentationを使用する主なメリットをいくつかご紹介します。

PCSには明確な利点がありますが、考慮すべきいくつかの制限があります。

プロンプト可能segmentationを探求する際、それがどのアプリケーションに最適なのか、またYOLO26のような従来のコンピュータービジョンモデルが解決しようとしている問題により適しているのはどのような場合なのか疑問に思うかもしれません。プロンプト可能segmentationは一般的なオブジェクトにはうまく機能しますが、非常に正確で一貫した結果を必要とするユースケースには適していません。

欠陥検出は良い例です。製造業では、欠陥は小さな傷、へこみ、位置ずれ、表面の不規則性など、しばしば微細で目立たないものです。また、材料、照明、生産条件によって大きく異なる場合があります。

これらの問題は、単純なプロンプトで記述するのが難しく、汎用モデルが確実にdetectすることはさらに困難です。全体的に、プロンプトベースのモデルは欠陥を見逃したり、不安定な結果を生成したりする傾向がある一方、欠陥データで特別にトレーニングされたモデルは、実際の検査システムにおいて遥かに信頼性が高いです。

プロンプト可能なコンセプトsegmentationは、常に新しいオブジェクトやアイデアが出現する現実世界にビジョンシステムを適応させやすくします。固定されたラベルに縛られる代わりに、ユーザーはsegmentしたいものを記述するだけで、残りはモデルに任せることができます。これにより、時間が節約され、手作業が削減されます。まだ限界はありますが、PCSはすでにsegmentationの実践的な使用方法を変えており、将来のビジョンシステムの中核となる可能性が高いです。

当社のGitHubリポジトリを訪れ、コミュニティに参加して、AIについてさらに探求してください。ソリューションページで、ロボット工学におけるAIと製造業におけるコンピュータービジョンについて学びましょう。今すぐVision AIを始めるための当社のライセンスオプションを発見してください!

未来の機械学習で、新たな一歩を踏み出しましょう。