Come scegliere una GPU cloud per l'addestramento di Vision AI su Ultralytics Platform

Scopri come scegliere la giusta GPU cloud per l'addestramento di computer vision su Ultralytics Platform in base a fattori come le dimensioni del dataset, la complessità del modello e il costo.

Il mese scorso abbiamo introdotto Ultralytics Platform, un ambiente end-to-end progettato per semplificare l'intero flusso di lavoro della computer vision, dalla gestione dei dataset all'addestramento e al deployment dei modelli. Ultralytics Platform riunisce tutto ciò che serve per costruire e scalare modelli di vision AI in un'esperienza unica e unificata.

Una parte fondamentale di questo flusso di lavoro è l'addestramento dei modelli, dove le reti neurali imparano schemi dai dati per fare previsioni accurate, e l'accesso alle giuste risorse di calcolo gioca un ruolo cruciale. In precedenza, abbiamo esplorato come Ultralytics Platform supporti l'addestramento di modelli tramite cloud GPU, permettendoti di addestrare modelli di computer vision senza dover gestire l'infrastruttura locale.

Grazie all'accesso on-demand a potenti GPU NVIDIA, utenti che vanno da studenti e startup a ricercatori e grandi organizzazioni possono eseguire carichi di lavoro AI in modo più efficiente che mai. Sebbene iniziare con l'addestramento in cloud sia semplice, scegliere la GPU giusta implica considerare fattori come la dimensione del dataset, la complessità del modello e i costi.

Con una vasta gamma di opzioni disponibili oggi, dalle convenienti GPU RTX all'hardware NVIDIA H100 ad alte prestazioni e alla prossima generazione Blackwell, selezionare la configurazione corretta può avere un impatto significativo sia sullo sviluppo del modello che sui costi.

In questo articolo, esamineremo l'addestramento tramite cloud GPU per la computer vision sulla Ultralytics Platform e come scegliere l'hardware adatto al tuo carico di lavoro. Iniziamo!

Una panoramica dell'addestramento in cloud sulla Ultralytics Platform

Prima di immergerci in come selezionare una GPU per l'addestramento in cloud sulla Ultralytics Platform, facciamo un passo indietro e vediamo come funziona l'addestramento in cloud.

Cos'è l'addestramento tramite cloud GPU?

L'addestramento tramite cloud GPU si riferisce all'utilizzo di GPU ospitate in un ambiente di cloud computing per addestrare modelli di machine learning e deep learning, invece di fare affidamento sul proprio hardware o workstation locale. Sulla Ultralytics Platform, questo ti permette di accedere a potenti GPU su richiesta ed eseguire lavori di addestramento da remoto, senza dover configurare nulla per conto tuo.

Questo rende semplice scalare le tue risorse in base al tuo carico di lavoro. Puoi scegliere GPU più potenti o aumentare la capacità secondo necessità, senza essere limitato dalle capacità del tuo sistema. Puoi immaginarlo come accedere a macchine potenti, o nodi, in data center remoti, dove puoi scalare verso l'alto o verso il basso a seconda del bisogno.

Elimina inoltre la necessità di installare e mantenere hardware costoso. Non devi comprare GPU, installare driver o gestire problemi di compatibilità.

La Ultralytics Platform gestisce tutto tramite servizi cloud gestiti, dal provisioning delle risorse alla configurazione dell'ambiente, dall'orchestrazione all'esecuzione dei lavori di addestramento, così tu puoi concentrarti sull'addestramento, sulla sperimentazione e sul miglioramento dei tuoi modelli.

Come funziona l'addestramento dei modelli sulla Ultralytics Platform

Sulla Ultralytics Platform, il flusso di lavoro di addestramento accelerato da GPU è semplice. Puoi iniziare caricando il tuo dataset in diversi modi.

Puoi caricare i tuoi dati, utilizzare dataset pubblici disponibili sulla piattaforma o clonare dataset condivisi dalla community per basarti sul lavoro esistente. Clonare un dataset crea una copia nel tuo spazio di lavoro, permettendoti di modificarlo ed espanderlo mantenendo intatto l'originale.

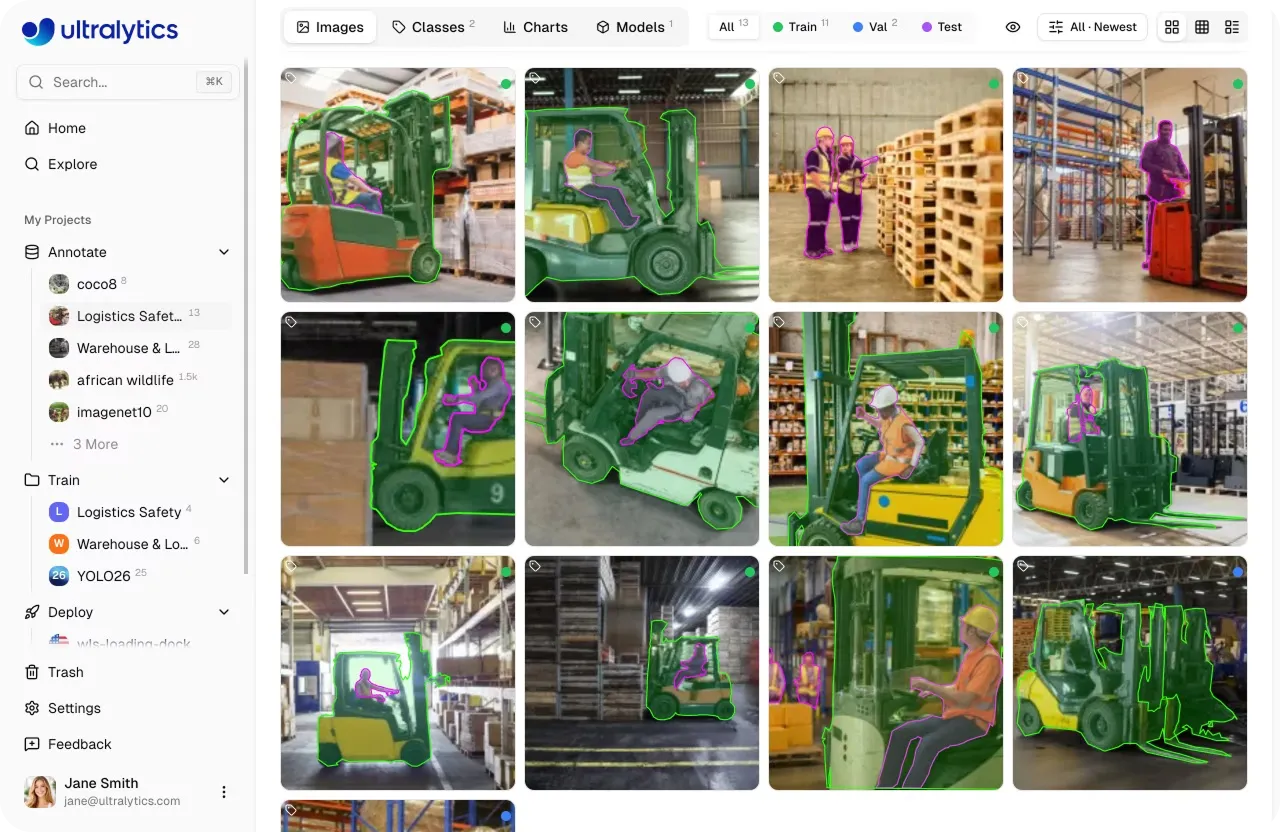

Una volta selezionato un dataset, puoi revisionare e organizzare le tue immagini e annotazioni per assicurarti che tutto sia strutturato correttamente. La piattaforma include anche strumenti di annotazione integrati, che ti permettono di etichettare i dati per compiti come object detection, segmentazione e classificazione, o di velocizzare il processo con funzionalità assistite dall'AI.

Fig 1. Visualizzazione di un dataset all'interno della Ultralytics Platform (Fonte)

Successivamente, puoi selezionare o creare un progetto per gestire i tuoi cicli di addestramento. I progetti ti aiutano a organizzare e confrontare modelli, tracciare metriche di performance e tenere insieme gli esperimenti correlati in un unico posto.

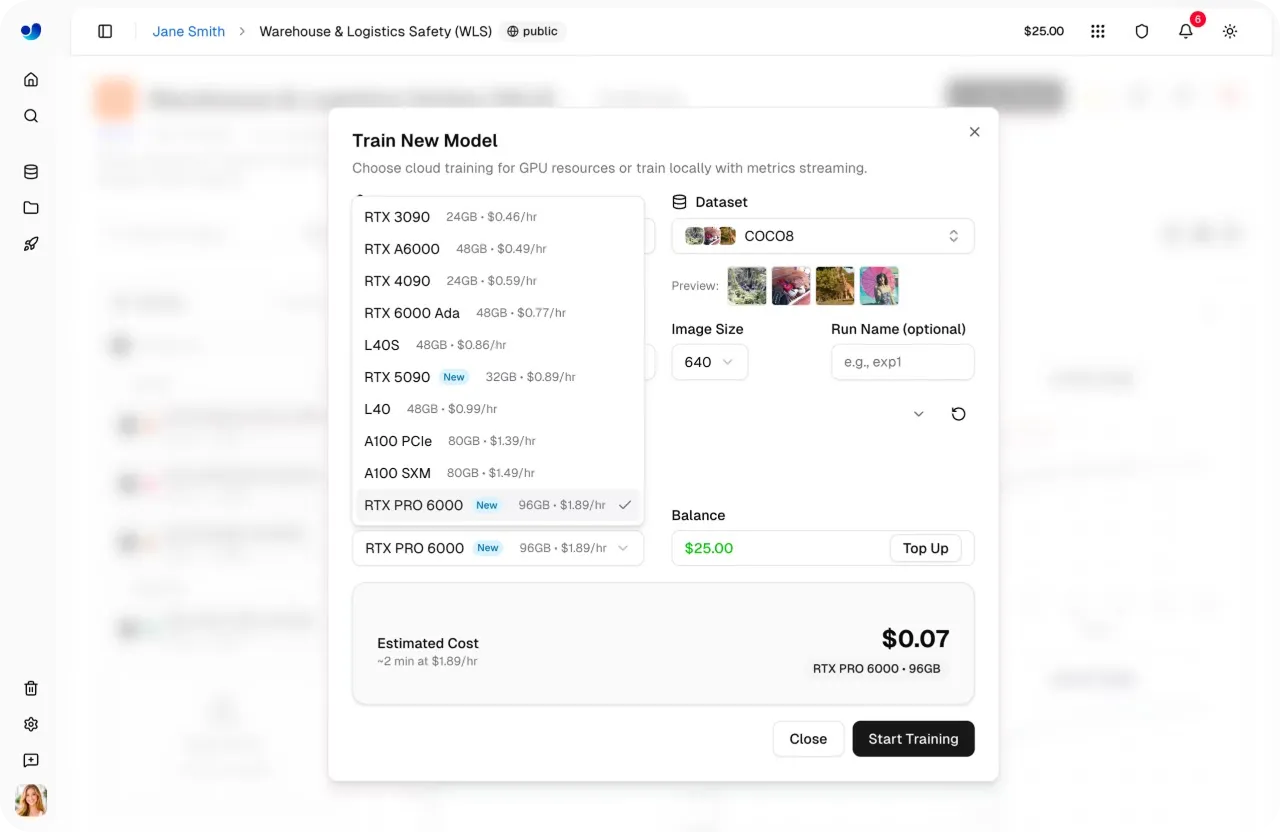

Da lì, puoi passare all'addestramento in cloud, dove scegli un modello, configuri i parametri e selezioni una GPU in base alle tue esigenze di performance e budget. La piattaforma gestisce l'infrastruttura cloud sottostante per te.

Esegue il provisioning dell'istanza GPU selezionata, prepara il tuo dataset ed esegue il lavoro di addestramento nel cloud. Man mano che l'addestramento procede, puoi monitorare metriche, log e performance del sistema in tempo reale, senza dover gestire configurazioni, ambienti CUDA, framework come PyTorch o TensorFlow, o hardware.

Funzionalità chiave dell'addestramento su GPU sulla Ultralytics Platform

Ecco alcune funzionalità chiave dell'addestramento tramite cloud GPU sulla Ultralytics Platform:

- Addestramento one-click: Avvia i lavori di addestramento con una configurazione minima e passa rapidamente dal dataset all'addestramento del modello senza configurazioni complesse.

- GPU on-demand: Scegli tra una serie di opzioni GPU in base alle tue necessità e scala le risorse come richiesto senza impegni a lungo termine.

- Monitoraggio in tempo reale: Traccia il progresso dell'addestramento con grafici e log live e visualizza metriche di sistema come l'utilizzo della GPU e la memoria in tempo reale.

- Checkpoint automatici: Il progresso dell'addestramento viene salvato a intervalli regolari, rendendo semplice riprendere o recuperare il lavoro, se necessario.

- Deployment semplice: Una volta completato l'addestramento, puoi distribuire i tuoi modelli addestrati e utilizzarli in applicazioni o flussi di lavoro tramite API di inferenza condivise, endpoint dedicati o esportandoli per l'uso su sistemi esterni. Queste opzioni di deployment abilitano un'inferenza a bassa latenza, rendendo possibile alimentare applicazioni in tempo reale come video analytics, sistemi di automazione e soluzioni AI interattive.

Diverse opzioni di GPU cloud all'interno della Ultralytics Platform

Ora che abbiamo visto come funziona l'addestramento sulla piattaforma, diamo un'occhiata alle diverse opzioni GPU disponibili. La GPU che scegli può influenzare la velocità di addestramento del tuo modello, la sua efficacia e quanto costa.

La Ultralytics Platform offre una vasta gamma di GPU, iniziando con opzioni come la RTX 2000 Ada e RTX A4500, passando attraverso GPU come la RTX 4000 Ada, RTX A5000, RTX 3090 e RTX A6000, ed estendendosi a opzioni più potenti come la RTX 4090 e RTX PRO 6000.

Fig 2. Un esempio delle diverse opzioni GPU supportate dalla Ultralytics Platform (Fonte)

Per la maggior parte degli utenti, la RTX PRO 6000 è una scelta bilanciata predefinita. Offre prestazioni affidabili su una varietà di carichi di lavoro senza richiedere molta ottimizzazione. La RTX 4090 è un'altra opzione popolare, che offre ottime prestazioni in rapporto al prezzo.

Per compiti più piccoli come esperimenti rapidi, prototipazione o lavoro con dataset leggeri, GPU come la RTX 2000 Ada e RTX A4500 sono un buon punto di partenza. Man mano che il tuo carico di lavoro cresce, opzioni come RTX 4000 Ada, RTX A5000 e RTX 3090 forniscono performance più costanti per l'addestramento generale.

Nella fascia alta, GPU come la A100 (Ampere), H100 e H200 (Hopper) e B200 (Blackwell) sono costruite per carichi di lavoro su larga scala. Sono le più adatte per addestrare modelli molto grandi, gestire dataset massicci o eseguire lavori dove velocità e performance sono critiche.

Comprendere i diversi tipi di GPU e i loro casi d'uso

Ora, vediamo come si confrontano i diversi tipi di GPU e dove si adattano meglio.

Le GPU RTX di NVIDIA sono generalmente più convenienti e comunemente utilizzate per l'addestramento quotidiano, la sperimentazione e carichi di lavoro medio-piccoli. Offrono un equilibrio tra performance e accessibilità, rendendole adatte a un'ampia gamma di casi d'uso.

In confronto, GPU come A100, A40 e L40 sono progettate per carichi di lavoro più pesanti e addestramenti su larga scala. Forniscono maggiore stabilità e scalabilità, particolarmente quando si lavora con dataset più ampi o modelli più complessi.

Nella fascia alta, GPU come la H100 e quelle basate sull'architettura Blackwell di NVIDIA rappresentano l'hardware AI più recente. Sono progettate per carichi di lavoro ad alte prestazioni e sono tipicamente utilizzate per addestramenti su larga scala, ricerca avanzata o compiti sensibili al tempo.

La gamma di opzioni GPU disponibili sulla Ultralytics Platform fornisce flessibilità su diversi carichi di lavoro. A seconda dei tuoi requisiti, puoi iniziare con configurazioni più piccole e scalare verso l'alto come necessario.

Come scegliere la GPU cloud giusta per il tuo progetto

Quando selezioni una GPU per l'addestramento in cloud sulla Ultralytics Platform, ci sono diversi fattori da considerare, inclusi la dimensione del dataset, la complessità del modello e il costo. Esaminiamo ciascuno di questi fattori.

Abbinare la potenza della GPU alla dimensione del dataset

Uno dei fattori principali nella scelta di una GPU è la dimensione del tuo dataset, poiché influisce sul tempo necessario per l'addestramento e sulla quantità di calcolo di cui hai bisogno.

Per dataset piccoli, solitamente meno di 1.000 immagini, una GPU leggera come la RTX 2000 è spesso sufficiente. Funziona bene per esperimenti rapidi e cicli di addestramento più brevi.

Per dataset di medie dimensioni, da circa 1.000 a 10.000 immagini, GPU come RTX 4090 o RTX A6000 offrono un equilibrio migliore tra performance ed efficienza, aiutandoti ad addestrare in modo più fluido senza lunghi ritardi.

Per dataset più grandi, oltre 10.000 immagini, avrai probabilmente bisogno di hardware più potente per mantenere ragionevoli i tempi di addestramento. GPU come le H100 sono più adatte a gestire carichi di lavoro pesanti e a scalare efficacemente.

Nel complesso, si tratta di abbinare la dimensione del tuo dataset con il livello di potenza di calcolo e la capacità di elaborazione parallela di cui hai bisogno.

Scegliere una GPU in base alla dimensione e alla complessità del modello

Un altro fattore importante nella scelta di una GPU è la dimensione e la complessità del tuo modello di vision AI. Modelli di dimensioni diverse richiederanno quantità differenti di potenza per il calcolo.

Per esempio, modelli più piccoli necessitano di meno potenza di calcolo GPU e possono girare efficientemente su GPU come RTX 2000 Ada, RTX A4500 o anche la RTX 4090 se desideri risultati più veloci. Queste sono ideali per esperimenti rapidi, prototipazione e compiti più semplici, permettendoti di iterare più velocemente e testare idee senza alti costi di calcolo.

D'altra parte, modelli più grandi e complessi richiedono significativamente più memoria e potenza di elaborazione. GPU come la RTX A6000, RTX PRO 6000 e opzioni di fascia alta come la H100 sono più adatte a questi carichi di lavoro. Possono gestire architetture più grandi, ridurre il tempo di addestramento e prevenire problemi di memoria, il che è particolarmente importante quando si lavora con immagini ad alta risoluzione, batch size grandi o design di modelli più avanzati.

Confronto tra batch size e memoria della GPU

Analogamente, la batch size gioca un ruolo importante nell'addestramento del modello. Si riferisce al numero di campioni di addestramento che il modello elabora contemporaneamente in un unico passaggio.

Batch size più grandi possono migliorare l'efficienza dell'addestramento elaborando più dati in una volta sola, ma richiedono anche più memoria GPU (VRAM). In generale, le GPU con una larghezza di banda di memoria maggiore possono supportare batch size più grandi, mentre le GPU con meno memoria potrebbero richiedere batch più piccoli.

Per esempio, GPU come RTX A6000, RTX PRO 6000 o A100 possono gestire batch size più grandi più facilmente grazie alla loro maggiore memoria, mentre opzioni come RTX 4090 o RTX 2000 Ada potrebbero richiedere batch size più piccoli a seconda del carico di lavoro.

Tuttavia, utilizzare la GPU più grande non è sempre necessario. Le GPU di fascia alta possono migliorare velocità e capacità, ma comportano anche costi maggiori. In molti casi, regolare la batch size su una GPU più piccola può essere una scelta più efficiente.

In definitiva, l'obiettivo è trovare il giusto equilibrio tra batch size, memoria GPU disponibile e costi in base al tuo modello e al tuo dataset.

L'impatto della configurazione di addestramento sulla performance della GPU

Un altro fattore che influisce sulla performance della GPU è la configurazione dell'addestramento. Questo include parametri come il numero di epoche, la dimensione dell'immagine e altre impostazioni che controllano come un modello viene addestrato.

Per esempio, dimensioni dell'immagine maggiori aumentano la quantità di calcolo richiesto per passaggio. Questo può rallentare l'addestramento e potrebbe richiedere più potenza di calcolo o memoria per mantenere buone prestazioni.

Allo stesso modo, aumentare il numero di epoche estende il tempo totale di addestramento, specialmente su hardware meno potente. Un'epoca si riferisce a un passaggio completo attraverso l'intero dataset durante l'addestramento.

Tecniche come la data augmentation aggiungono ulteriore elaborazione durante l'addestramento. La data augmentation applica trasformazioni come ribaltamento, rotazione o ridimensionamento per aumentare la diversità dei dati e migliorare le performance del modello. Sebbene questo possa migliorare la robustezza del modello, può anche ridurre la velocità di addestramento.

In generale, GPU più potenti possono gestire queste richieste crescenti in modo più efficiente, ma l'impatto dipenderà dalla configurazione complessiva e dal carico di lavoro.

Bilanciare costi e tempo di addestramento

Quando scegli una GPU per il tuo progetto, c'è spesso un compromesso tra velocità di addestramento e prezzi delle GPU.

La Ultralytics Platform rende semplice stimare e comprendere questi costi prima di avviare un lavoro di addestramento. In base alla tua configurazione, inclusi dimensione del dataset, modello e GPU, puoi vedere un costo stimato e la durata dell'addestramento in anticipo.

Fig 3. La Ultralytics Platform rende semplice stimare e comprendere i costi cloud. (Fonte)

GPU più veloci hanno tipicamente un costo orario più elevato ma possono ridurre il tempo complessivo di addestramento. GPU come RTX 4090, RTX PRO 6000 e H100 sono generalmente in grado di completare l'addestramento più rapidamente grazie alle loro performance superiori.

GPU più lente tendono ad avere un costo orario inferiore ma impiegano più tempo per completare l'addestramento. Per esempio, GPU come RTX 2000 Ada e RTX A4500 sono spesso usate per carichi di lavoro minori o lavori a lunga durata dove viene data priorità a un costo inferiore.

In aggiunta a ciò, alcune delle GPU di fascia più alta, come la H200 e B200, sono disponibili solo nei piani Pro o Enterprise, mentre la maggior parte delle altre opzioni sono accessibili anche nel piano Free.

Uno sguardo alle strategie di ottimizzazione dei costi

Oltre a scegliere la GPU giusta, ci sono alcuni modi pratici per tenere sotto controllo i costi di addestramento. Uno degli approcci più efficaci è iniziare con piccoli test prima di scalare verso l'alto.

Invece di passare direttamente all'addestramento completo, inizia con meno epoche per assicurarti che la tua configurazione funzioni come previsto. Questo ti aiuta a convalidare rapidamente i tuoi dati, le annotazioni e la configurazione del modello, ed evita di sprecare tempo e calcolo su cicli che potrebbero non produrre risultati utili.

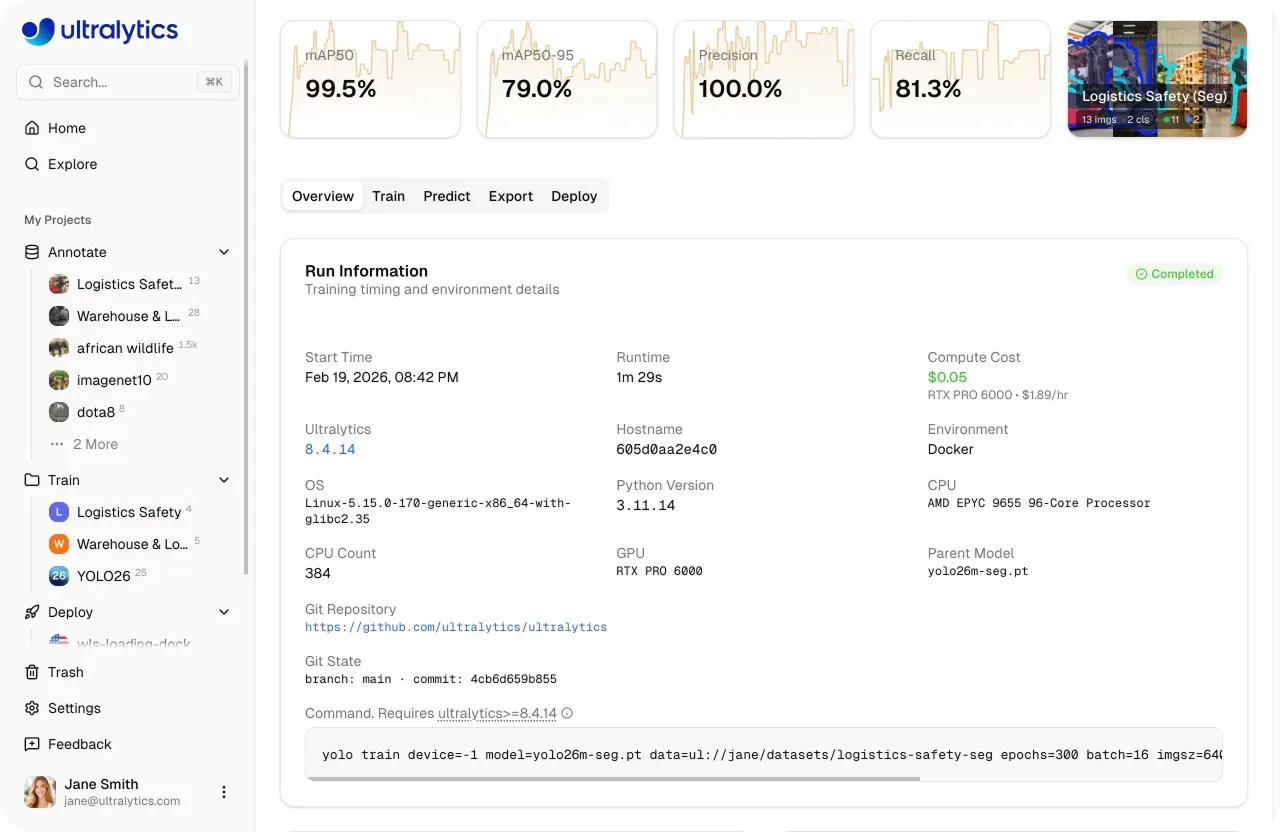

Man mano che l'addestramento procede, tieni d'occhio le tue metriche e ferma i cicli in anticipo se la performance si stabilizza o smette di migliorare. Monitorare le curve di addestramento può aiutarti a decidere se continuare o aggiustare la tua configurazione.

Puoi anche regolare parametri come batch size e dimensione dell'immagine. Valori più piccoli riducono l'uso di memoria e calcolo, rendendo più pratico sperimentare, testare configurazioni diverse o eseguire simulazioni su piccola scala prima di scalare.

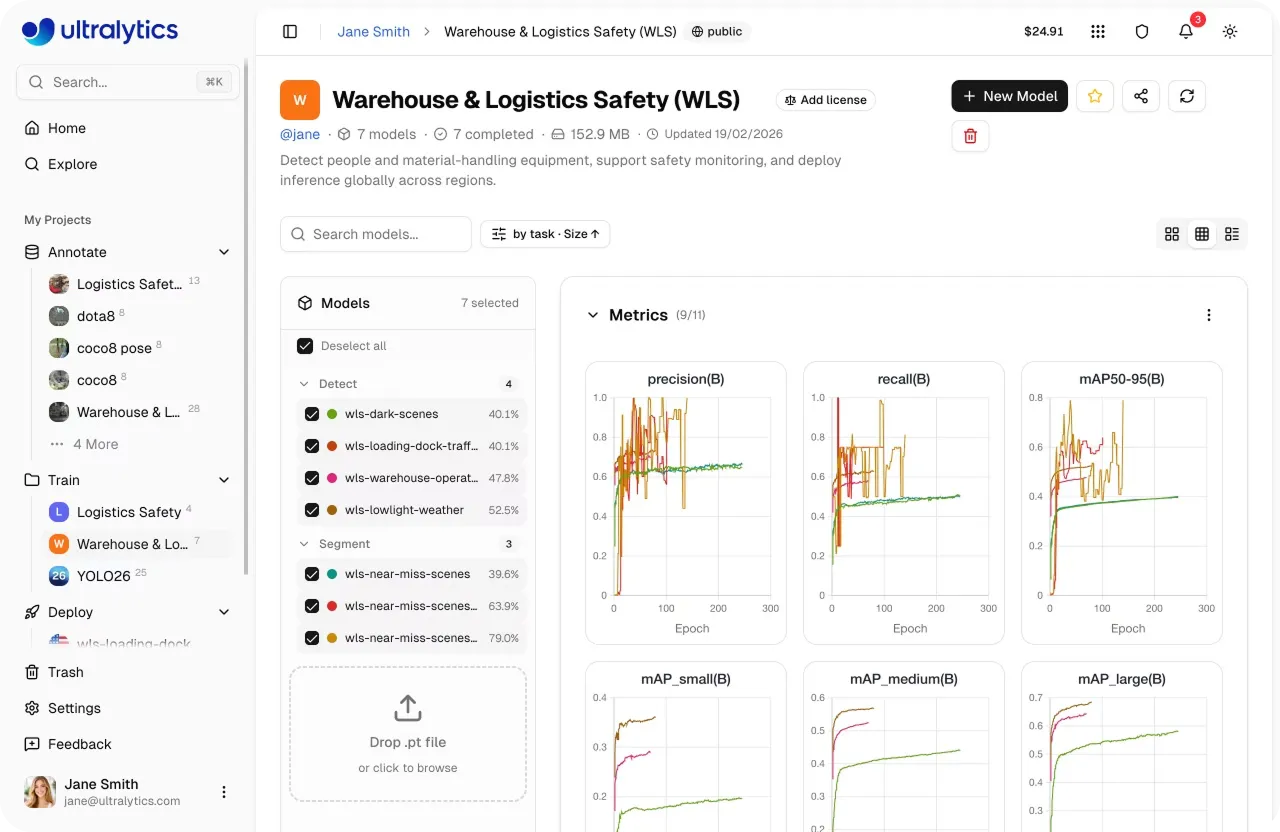

Fig 4. Visualizzazioni delle metriche di addestramento sulla Ultralytics Platform (Fonte)

Oltre a questo, la Ultralytics Platform aiuta a semplificare la gestione dei costi. Fornisce una stima dei costi integrata così puoi comprendere le spese previste prima di avviare un lavoro.

Con un sistema pay-per-use basato su crediti, paghi solo per il tempo di calcolo che utilizzi realmente. Questo rende più semplice rimanere nel budget e scalare verso l'alto una volta che sei sicuro della tua configurazione di addestramento.

Best practice relative all'addestramento su cloud GPU per la computer vision

Ecco alcune best practice da tenere a mente per l'addestramento su cloud GPU sulla Ultralytics Platform:

- Convalida i dataset prima dell'addestramento: Assicurati che il tuo dataset sia pulito, ben annotato e coerente prima di iniziare. Individuare i problemi tempestivamente aiuta a evitare sprechi di calcolo e migliora la performance del modello.

- Esegui prima esperimenti rapidi: Inizia con piccoli test e meno epoche per verificare la tua configurazione. Questo aiuta a identificare i problemi tempestivamente senza impegnarsi in lavori di addestramento lunghi e costosi. In un certo senso, stai creando un modello che puoi riutilizzare e scalare una volta che tutto funziona come previsto.

- Monitora le metriche chiave: Traccia metriche come loss, mAP, precision e recall durante l'addestramento. Queste metriche fungono da benchmark per valutare la performance del modello e aiutarti a decidere quando aggiustare o fermarti.

- Mantieni efficienti le pipeline di elaborazione dati: Assicurati che il caricamento e la pre-elaborazione dei dati siano efficienti, poiché queste funzioni si basano sulle risorse CPU e possono diventare colli di bottiglia che influenzano la performance complessiva dell'addestramento.

- Usa gli strumenti integrati: Usa grafici, log della console e metriche di sistema per monitorare l'addestramento in tempo reale e prendere decisioni informate rapidamente.

Punti chiave

Scegliere la GPU cloud giusta per la computer vision sulla Ultralytics Platform si riduce alla comprensione del tuo carico di lavoro, inclusa la dimensione del dataset, la complessità del modello e la configurazione dell'addestramento. Con una gamma di opzioni GPU disponibili, alimentate da infrastruttura cloud e macchine virtuali, puoi iniziare con una scelta bilanciata e scalare verso l'alto man mano che crescono le tue esigenze di addestramento o fine-tuning del modello. Combinando l'hardware giusto con buone pratiche come il monitoraggio e il controllo dei costi, puoi addestrare modelli di intelligenza artificiale all'avanguardia in modo efficiente, sfruttando al contempo la flessibilità dell'high-performance computing.

Dai un'occhiata alla nostra community in crescita e al nostro repository GitHub per saperne di più sulla computer vision. Se stai cercando di costruire soluzioni di visione, dai un'occhiata alle nostre opzioni di licenza. Esplora le nostre pagine di soluzioni per saperne di più sui benefici della computer vision nella produzione e dell'AI nell'agricoltura.