Cómo Ultralytics simplifica la implementación de modelos de visión artificial

Descubre cómo Ultralytics reúne todo lo necesario para la implementación de modelos de visión artificial, desde las pruebas hasta las API listas para producción.

Descubre cómo Ultralytics reúne todo lo necesario para la implementación de modelos de visión artificial, desde las pruebas hasta las API listas para producción.

Ultralytics años colaborando con la comunidad de visión artificial, creando modelos y herramientas que hacen que la IA aplicada a la visión sea más accesible para todos. Con Ultralytics , damos un paso más allá al reunir todo el flujo de trabajo de desarrollo de visión artificial en un único entorno unificado, que abarca desde la gestión y anotación de conjuntos de datos hasta el entrenamiento, la validación y la implementación de modelos.

En particular, nos complace facilitar la implementación de modelos de visión artificial. A pesar de que la visión artificial sigue abriéndose paso en aplicaciones del mundo real, el análisis de imágenes y vídeos fuera de entornos controlados sigue siendo complejo.

A diferencia de los entornos de prueba, en los que las condiciones son predecibles, los escenarios reales implican condiciones de iluminación variables, entradas cambiantes y cargas de trabajo impredecibles, lo que convierte la implementación en una de las partes más complejas del flujo de trabajo de visión artificial.

La implementación implica mucho más que simplemente poner un modelo a disposición de los usuarios. Requiere establecer procesos capaces de gestionar datos del mundo real y garantizar que todo funcione correctamente a medida que aumenta el uso y los proyectos se amplían.

Los equipos también deben track y garantizar la fiabilidad a lo largo del tiempo. Esto suele implicar alternar entre diferentes herramientas de IA para las fases de prueba, integración, implementación y supervisión, lo que puede ralentizar el desarrollo de los modelos y añadir una complejidad innecesaria.

Los flujos de trabajo acaban fragmentándose. Ultralytics unifica y simplifica este proceso.

Ofrece compatibilidad integrada para la puesta en servicio, las pruebas y la supervisión de modelos en un único entorno. Los equipos pueden validar los modelos mediante inferencias basadas en navegador, integrarlos en aplicaciones a través de servicios de inferencia compartidos e implementarlos en terminales dedicados con capacidades de supervisión del rendimiento.

En este artículo, veremos cómo Ultralytics redefine la implementación de modelos de visión artificial , desde las pruebas y la integración hasta la puesta en producción y la supervisión. ¡Empecemos!

En el ciclo de vida del aprendizaje automático, la implementación del modelo es la etapa en la que este pasa de la fase experimental al uso en el mundo real. En el caso de los modelos de visión artificial creados mediante aprendizaje profundo y redes neuronales convolucionales, esto suele implicar ponerlos a disposición para procesar imágenes y vídeos en tiempo real.

Una vez implementados, estos modelos procesan nuevos datos, que suelen someterse a pasos de preprocesamiento como el redimensionamiento, la normalización o el formateo. A continuación, los datos procesados se envían al modelo, que aplica los patrones aprendidos durante el entrenamiento para generar predicciones de alta precisión.

Dependiendo del caso de uso, esto puede incluir diferentes tareas de visión artificial. Por ejemplo,YOLO Ultralytics , como Ultralytics , admiten una amplia gama de tareas de visión, entre las que se incluyen la detección de objetos, la clasificación de imágenes, la segmentación de instancias, la estimación de la pose y la detección de cajas delimitadoras orientadas (OBB).

Para que esto resulte viable en aplicaciones del mundo real, a menudo es necesario integrar los modelos en sistemas capaces de gestionar de manera eficiente tanto el preprocesamiento como la inferencia. Aquí es donde la infraestructura de implementación cobra un papel fundamental.

En entornos de producción, el acceso a los modelos suele realizarse a través de API REST o de sistemas de publicación de modelos. Estas interfaces permiten a las aplicaciones enviar datos y recibir predicciones mediante programación, lo que facilita la integración con aplicaciones externas, dispositivos IoT o sistemas robóticos que dependen de la comprensión visual en tiempo real.

La implementación de modelos de visión artificial puede parecer sencilla, pero hasta ahora la realidad ha sido muy diferente. Pensemos en una configuración habitual: primero se recogen los datos mediante cámaras o sensores, se envían a un modelo para su inferencia y, a continuación, se devuelven a una aplicación en forma de predicciones.

En realidad, cada uno de estos pasos suele gestionarse mediante herramientas y servicios independientes. Un sistema puede encargarse de la captura de datos, otro de la puesta a disposición de los modelos, mientras que se utilizan herramientas adicionales para el escalado, la supervisión y el registro. Mantener estos componentes conectados y funcionando de forma fiable puede resultar rápidamente complicado.

A medida que aumenta el uso, esta complejidad se acentúa. La gestión de la infraestructura, el manejo de las dependencias y el mantenimiento de un rendimiento constante a lo largo de todo el proceso pueden ralentizar el desarrollo y dificultar la implementación de modelos de visión artificial en aplicaciones del mundo real.

Ultralytics reúne todos estos componentes en un único entorno unificado. Esto permite gestionar de forma más coherente todo el flujo de trabajo de implementación, al tiempo que garantiza el rendimiento y la fiabilidad a gran escala.

Además de unificar el proceso de implementación de modelos, Ultralytics también ofrece flexibilidad en cuanto a la forma en que se implementan y utilizan los modelos.

Para facilitar las distintas fases de la implementación de modelos de visión artificial, la plataforma ofrece cuatro opciones: pruebas basadas en navegador con inferencia instantánea, inferencia compartida a través de API para el desarrollo, puntos de acceso dedicados para implementaciones de producción escalables en todas las regiones del mundo, y exportación de modelos para ejecutarlos en infraestructuras externas o dispositivos periféricos.

Veamos con más detalle cómo funciona cada una de estas opciones.

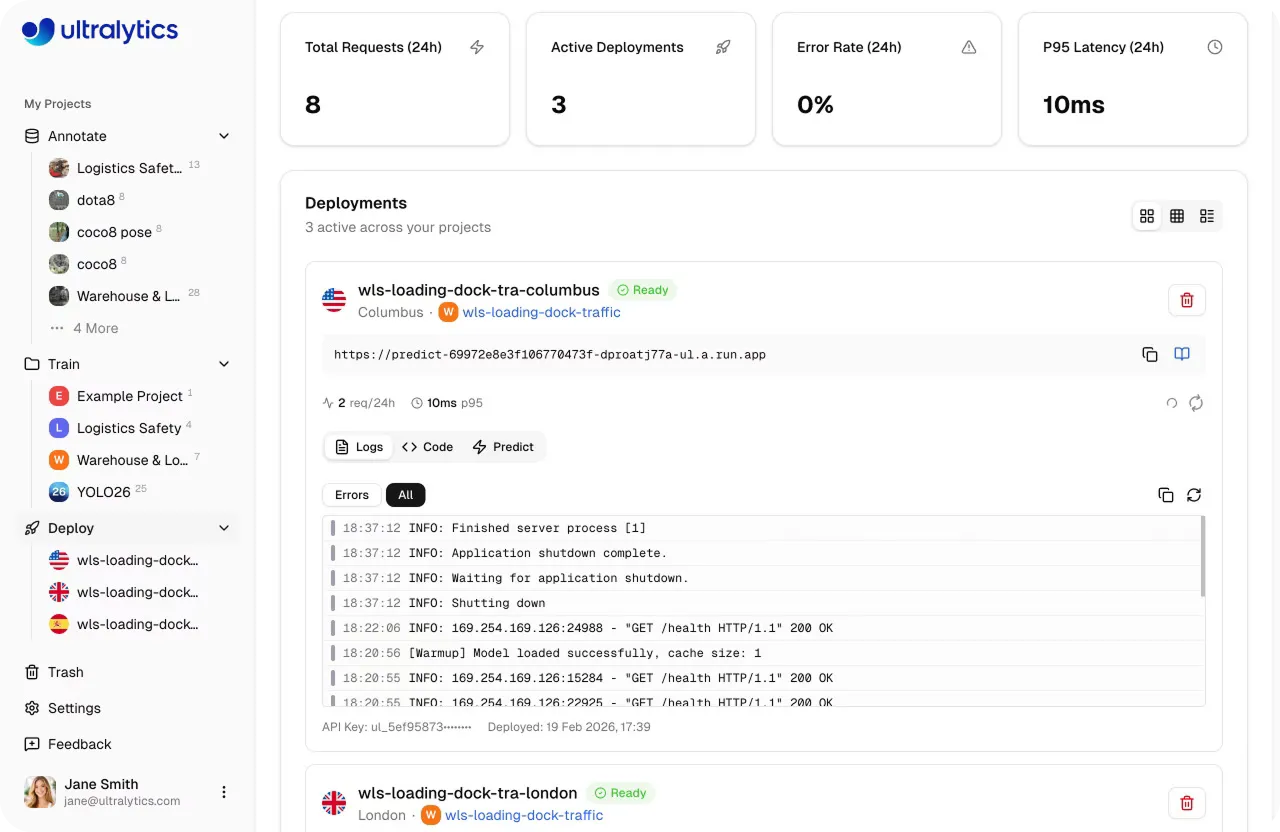

Antes de llevar un modelo a producción, es importante comprender cómo se comporta con datos nuevos y desconocidos. Ultralytics incluye una pestaña «Predict» integrada que permite ejecutar inferencias directamente en el navegador sin necesidad de configuración, infraestructura ni dependencias.

La pestaña «Predict» permite validar los modelos de forma rápida e interactiva. Puedes subir imágenes, utilizar ejemplos preconfigurados o capturar datos de entrada con una cámara web, y la inferencia se ejecuta automáticamente en cuanto se proporcionan los datos.

Los resultados aparecen al instante con superposiciones visuales, índices de confianza y resultados detallados, lo que te ofrece una visión clara del comportamiento del modelo.

Esto significa que, con solo unos clics, puedes probar diferentes entradas, ajustar parámetros y evaluar el rendimiento en una única interfaz antes de pasar a la implementación.

Supongamos que has entrenado un modelo y lo has validado mediante la pestaña «Predict». El siguiente paso suele ser empezar a integrar ese modelo en una aplicación o en un flujo de trabajo.

En lugar de instalar infraestructura o gestionar servidores, Ultralytics ofrece servicios de inferencia compartidos que te permiten enviar datos a tu modelo y recibir predicciones a través de sencillas API REST.

Entre bastidores, la inferencia compartida se ejecuta en un sistema multitenant que abarca varias regiones principales, donde las solicitudes se redirigen automáticamente al servicio disponible más cercano. Esto contribuye a mantener un rendimiento ágil y permite que los usuarios de diferentes ubicaciones accedan a los modelos de forma coherente.

Puedes enviar datos de entrada mediante solicitudes HTTP estándar y recibir a cambio resultados estructurados, lo que facilita la integración de los modelos en aplicaciones, scripts o flujos de trabajo automatizados. Esta configuración es una opción ideal para el desarrollo, las pruebas, las integraciones o un uso más ligero antes de pasar a implementaciones de producción más escalables.

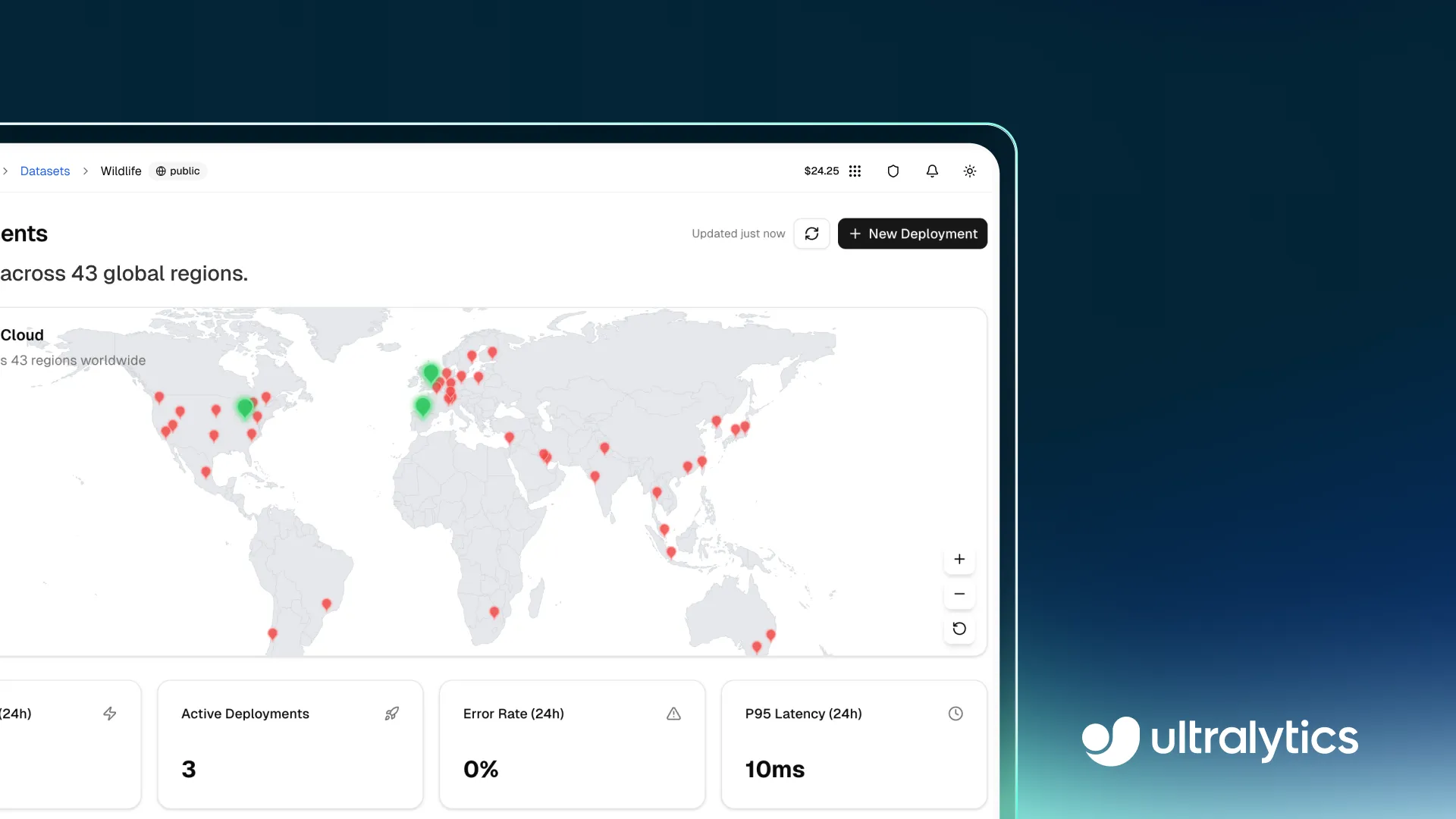

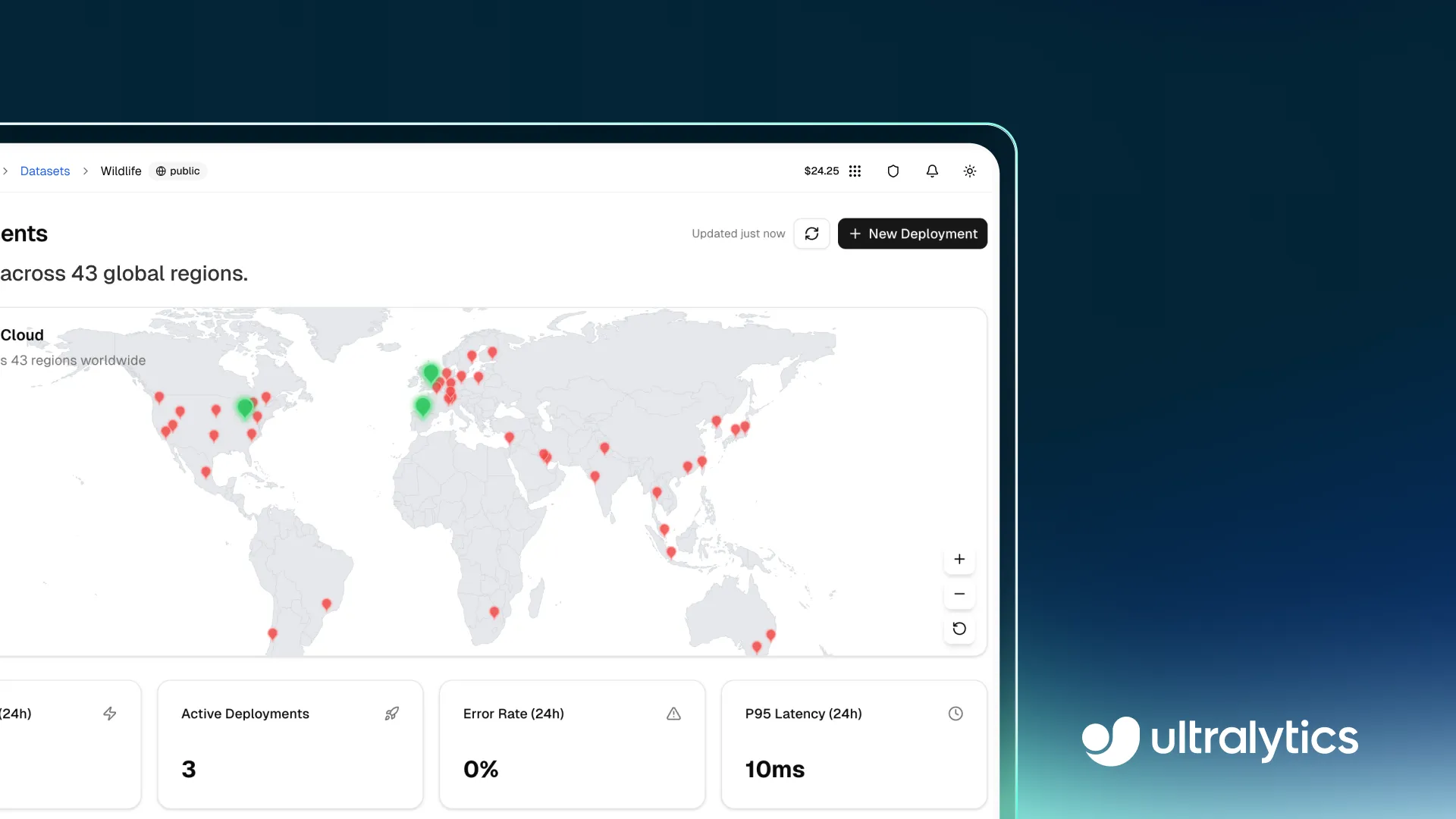

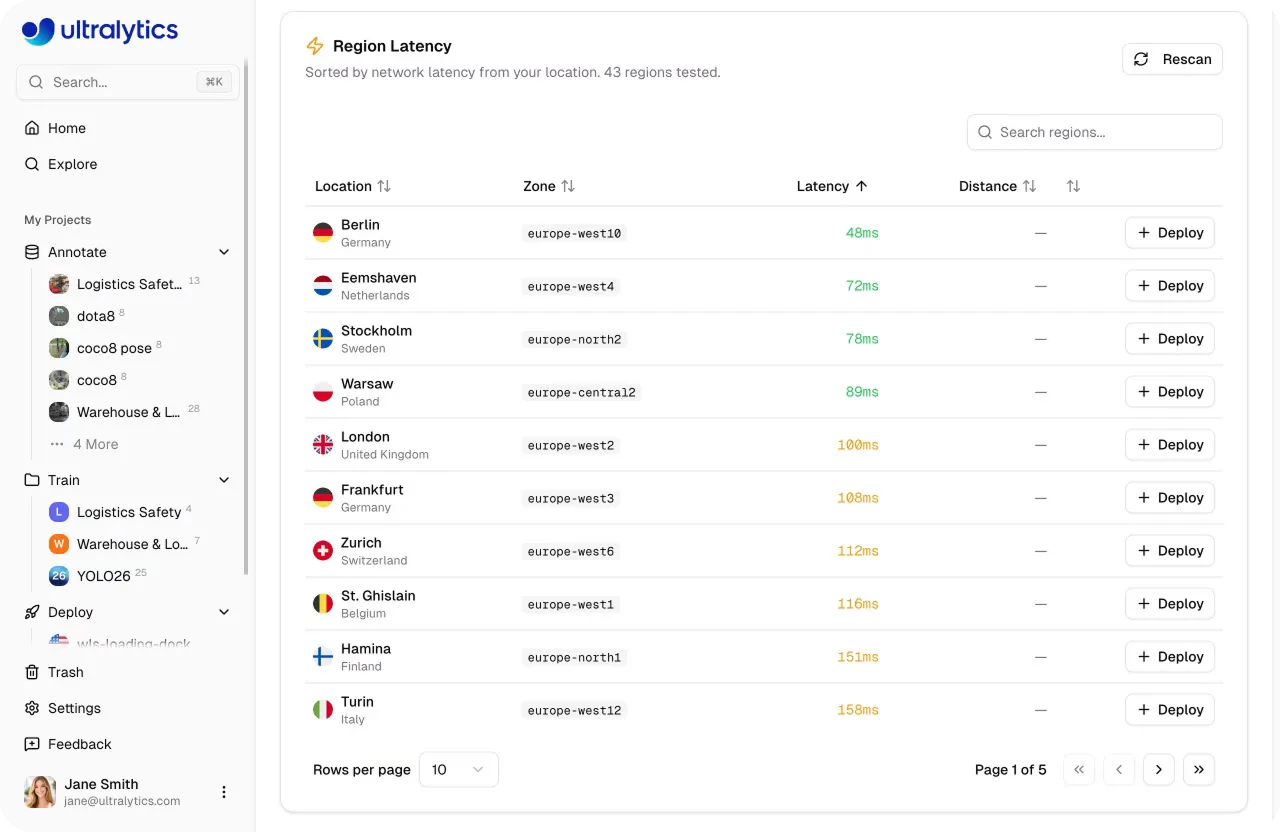

Una vez que un modelo está listo para su puesta en producción, debe gestionar el tráfico real de forma fiable y a gran escala. Ultralytics lo hace posible gracias a puntos de acceso dedicados, en los que los modelos se ejecutan como servicios de uso exclusivo en 43 regiones de todo el mundo. La implementación más cerca de los usuarios finales ayuda a reducir la latencia y a mantener un rendimiento constante en las distintas ubicaciones.

Cada nodo ejecutivo funciona con sus propios recursos de computación asignados y una URL única para las solicitudes de inferencia. Este nivel de control facilita el ajuste de las implementaciones en función de las necesidades de rendimiento, desde casos de uso sencillos hasta aplicaciones más exigentes y de alto rendimiento que requieren más recursos computacionales.

Sin embargo, los puntos finales dedicados están diseñados para gestionar por sí mismos las cargas de trabajo variables, gracias a un escalado automático que ajusta los recursos en función del tráfico entrante. Aumentan su capacidad durante los periodos de alta demanda y la reducen cuando el uso disminuye. Con la opción «escalado a cero» activada de forma predeterminada, los puntos finales inactivos se apagan automáticamente y se reinician cuando llegan nuevas solicitudes, lo que ayuda a optimizar el uso de los recursos sin necesidad de intervención manual.

Hoy en día, la IA en el borde se está volviendo cada vez más imprescindible, ya que cada vez más aplicaciones dependen de la ejecución de modelos directamente en dispositivos como teléfonos inteligentes, cámaras y sistemas integrados. La ejecución de modelos a nivel local también puede ayudar a cumplir los requisitos de privacidad de los datos, ya que los datos confidenciales, como imágenes o transmisiones de vídeo, pueden procesarse directamente en el dispositivo sin necesidad de enviarlos a servidores externos.

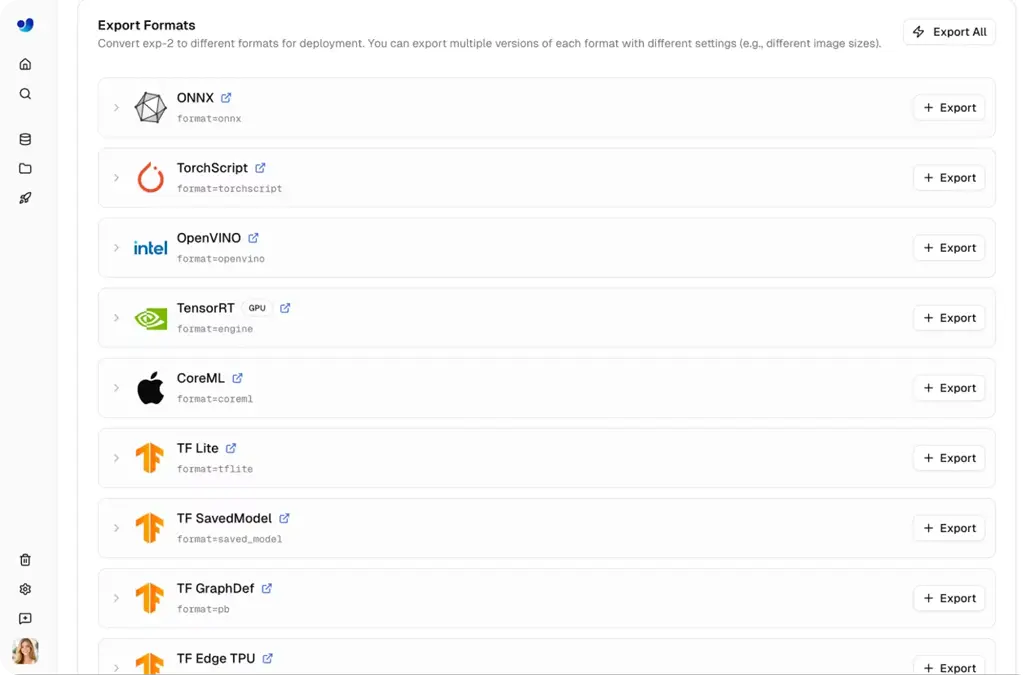

En estos casos, los modelos deben ejecutarse fuera de Ultralytics , por lo que la exportación de modelos se convierte en una parte fundamental del proceso de implementación.YOLO Ultralytics suelen entrenarse con Python PyTorch, y luego pueden exportarse a más de 17 formatos diferentes, entre los que se incluyen ONNX, TensorRT, CoreML y OpenVINO.

Esta amplia gama de formatos garantiza la compatibilidad con diversos tipos de hardware, desde unidades de procesamiento gráfico (GPU) de alto rendimiento hasta dispositivos móviles y embebidos. Además, la exportación permite optimizar el rendimiento para entornos específicos.

Dependiendo del formato, los modelos pueden alcanzar velocidades de inferencia más rápidas, como GPU mejor GPU con TensorRT CPU optimizada CPU con ONNX OpenVINO. Opciones como la cuantificación FP16 e INT8 pueden reducir aún más el tamaño del modelo y mejorar el rendimiento, lo cual resulta especialmente útil para implementaciones en el borde.

En Ultralytics , la exportación está integrada directamente en el flujo de trabajo, lo que permite generar modelos optimizados rápidamente con solo unos clics. Los equipos pueden pasar del entrenamiento a la ejecución de modelos en sistemas externos sin añadir una carga de trabajo adicional.

Cada opción de implementación de Ultralytics está pensada para una fase diferente del flujo de trabajo, desde las primeras pruebas hasta el uso en producción. A continuación, te ofrecemos una descripción general de cuándo puedes utilizar cada una de ellas:

Los equipos suelen seguir estas etapas paso a paso, pasando de la validación a la integración y, finalmente, a la implementación en producción, todo ello dentro de la plataforma.

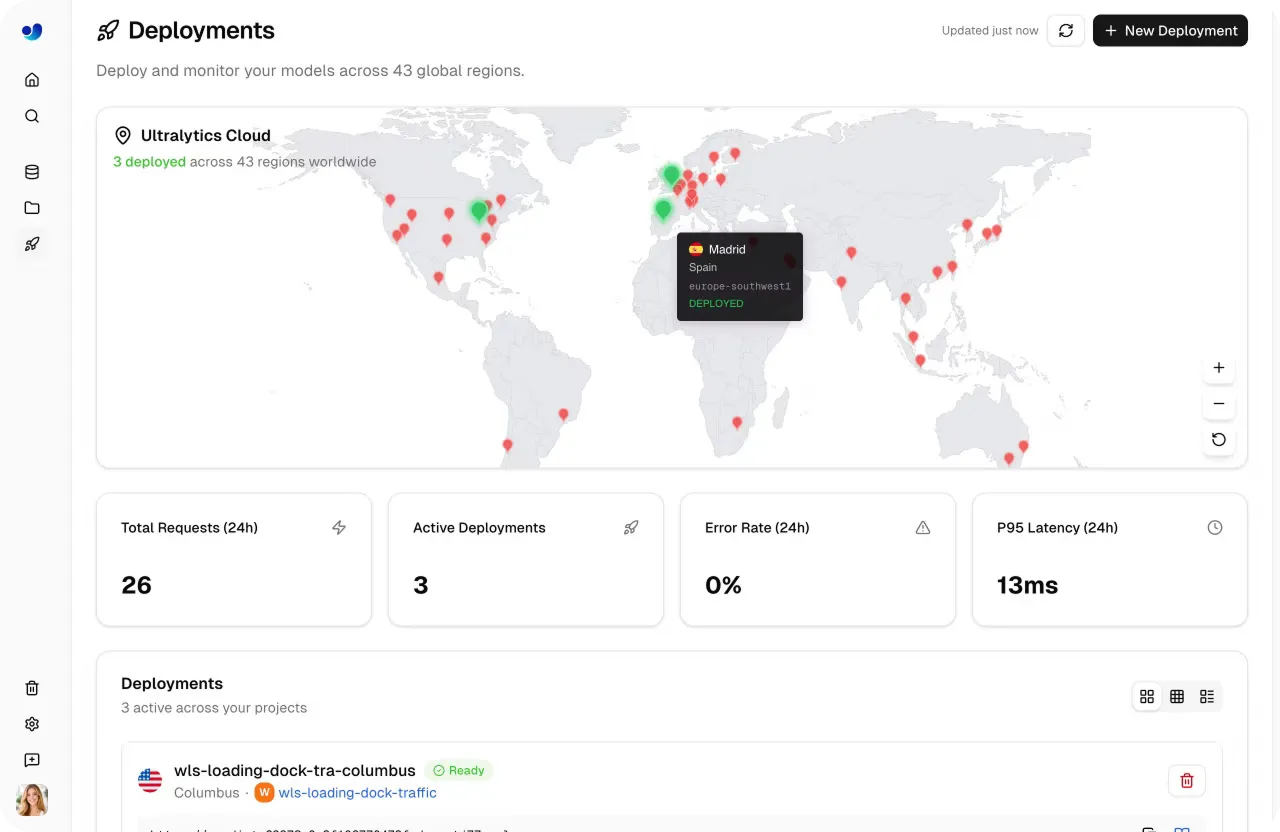

Por muy importante que sea la implementación, el proceso de visión no termina ahí. Una vez que el modelo está en funcionamiento en producción, la supervisión continua es fundamental para garantizar que funcione de forma fiable a lo largo del tiempo.

Ultralytics ofrece herramientas de supervisión integradas que proporcionan a los equipos una visión clara del comportamiento de sus modelos de IA visual a lo largo del tiempo, lo que permite un flujo de trabajo de operaciones de aprendizaje automático (MLOps) más estructurado.

La página «Implementación» incluye un panel de control que realiza un seguimiento de métricas clave, como el número total de solicitudes, las implementaciones activas, la latencia de respuesta y las tasas de error. Esta información ayuda a los equipos a comprender los patrones de uso, evaluar la capacidad de respuesta del sistema y garantizar un rendimiento de baja latencia en diferentes cargas de trabajo.

Cada punto final dedicado ofrece además una visibilidad detallada a través de vistas de implementación individuales. Esto incluye acceso a los registros, al estado de salud del modelo y a datos de rendimiento en tiempo real. Los registros pueden utilizarse para depurar incidencias, rastrear solicitudes fallidas e identificar posibles problemas relacionados con las dependencias o la infraestructura.

A medida que evolucionan los entornos de producción, factores como los cambios en los datos de entrada, las exigencias de escalabilidad o la evolución de los patrones de uso pueden afectar a la precisión y la solidez de los modelos. Mediante la supervisión continua de los indicadores de rendimiento, los equipos pueden detect , identificar cuellos de botella y adoptar medidas correctivas, como la optimización de los modelos o el ajuste de los recursos, para mantener un servicio de modelos constante y fiable.

La ampliación de los sistemas de visión artificial ha supuesto tradicionalmente la combinación de flujos de trabajo y marcos que nunca se diseñaron para funcionar como un todo. Los flujos de datos, los ciclos de entrenamiento, la infraestructura de implementación y los sistemas de supervisión suelen encontrarse en lugares distintos, lo que genera fricciones en cada etapa.

El verdadero reto no consiste solo en crear modelos, sino en mantenerlos en funcionamiento. Pasar de los datos a la producción, adaptarse a nuevos datos, gestionar la creciente demanda y mejorar continuamente sin perder ritmo.

Lo que destaca de Ultralytics es que este proceso está integrado. En lugar de tratar cada fase como un paso independiente, las conecta en un ciclo continuo en el que los modelos pueden desarrollarse, implementarse, supervisarse y actualizarse dentro del mismo entorno.

Ese cambio transforma la forma en que los equipos se adaptan al crecimiento. Ya no se trata de coordinar herramientas o infraestructura, sino de mantener el impulso a medida que los sistemas crecen.

Para incorporar modelos de aprendizaje automático, como los de visión artificial, a aplicaciones del mundo real, es necesario que sean fiables, escalables y fáciles de gestionar. Ultralytics simplifica este proceso al combinar diversas funciones, como la puesta en servicio, la implementación y la supervisión de modelos, en un único entorno unificado. Gracias a las opciones de implementación flexibles y a las herramientas integradas, los equipos pueden pasar de la fase de experimentación a la de producción con mayor rapidez y menor complejidad.

Echa un vistazo a nuestra comunidad y explora nuestro repositorio de GitHub para obtener más información. Explora nuestras páginas de soluciones para ver diversas aplicaciones, como la inteligencia artificial en el sector sanitario y la visión artificial en la logística. ¡Descubre nuestras opciones de licencia y empieza a desarrollar hoy mismo!

Comience su viaje con el futuro del aprendizaje automático