Monitorización de modelos de visión artificial desplegados en Ultralytics Platform

Descubre cómo monitorizar modelos de visión artificial en producción con Ultralytics Platform. Rastrea métricas, detecta problemas y mejora la fiabilidad.

Probar modelos de visión artificial que analizan imágenes y vídeo no siempre es lo mismo que ejecutarlos en producción. Durante el desarrollo, estos modelos o algoritmos se prueban en conjuntos de datos limpios y bien preparados donde las condiciones son controladas y predecibles.

Una vez desplegados, las cosas se vuelven más dinámicas. Los modelos se exponen al tráfico del mundo real, donde los volúmenes de solicitudes pueden variar, los tiempos de respuesta pueden cambiar y pueden ocurrir fallos ocasionales.

En esta etapa, el enfoque cambia a si el sistema funciona de forma fiable, con puntos finales que se mantienen disponibles, receptivos y estables bajo condiciones cambiantes.

Por eso la monitorización es esencial. Proporciona una visión clara de cómo se comportan los puntos finales desplegados en producción mediante métricas como el volumen de solicitudes, la latencia, las tasas de error y la salud general del sistema.

Para facilitar esto, contar con las herramientas adecuadas se vuelve tan importante como el propio modelo. Recientemente, Ultralytics presentó Ultralytics Platform, nuestro nuevo entorno integral que reúne todo el flujo de trabajo de visión artificial, desde los datos y el entrenamiento hasta el despliegue y la monitorización.

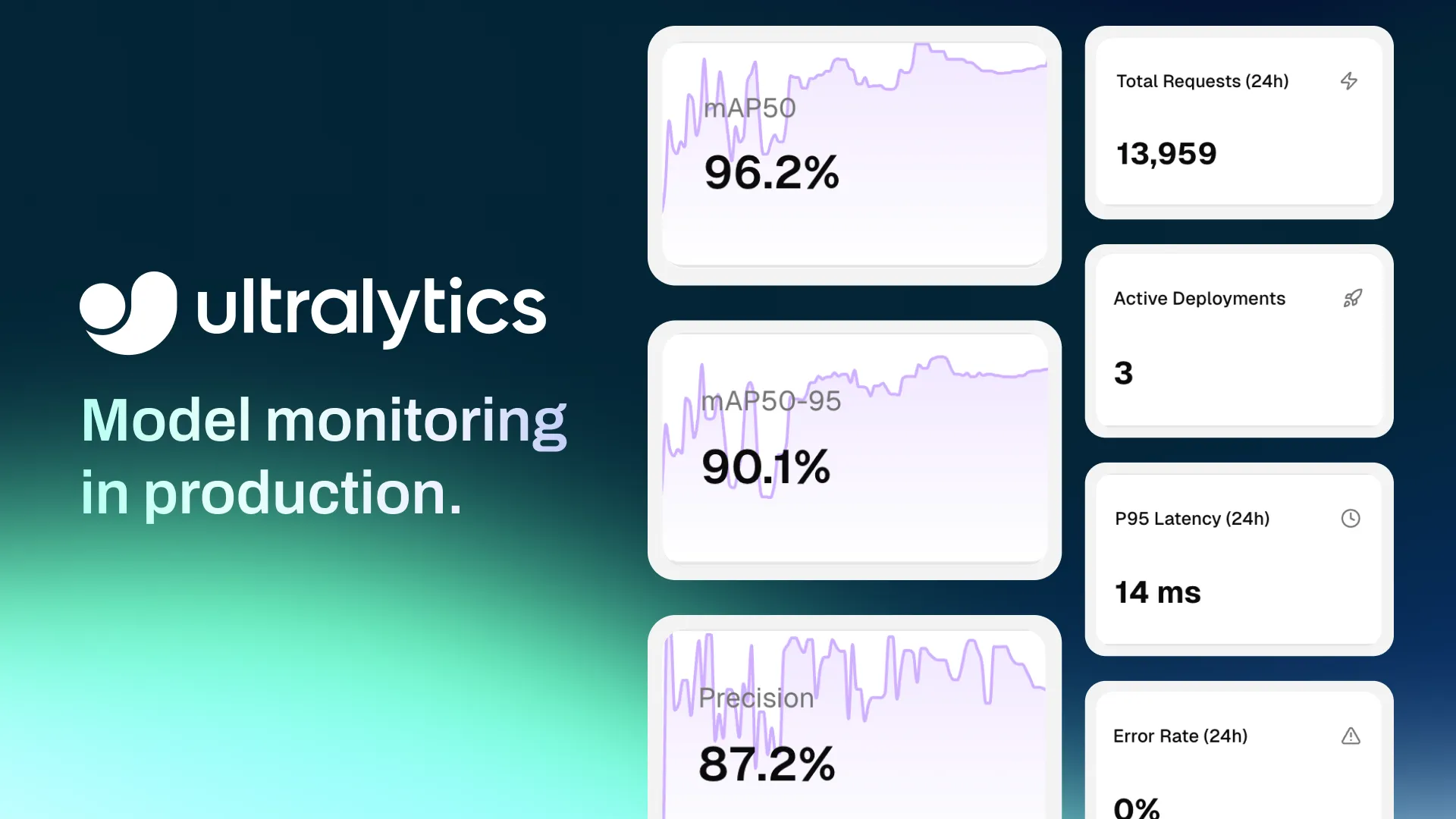

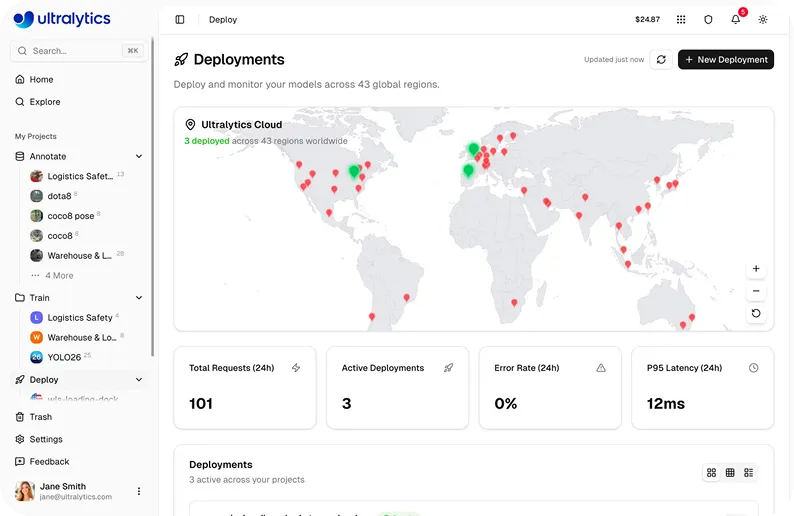

Fig 1. Panel de despliegue de Ultralytics Platform con funciones de monitorización (Fuente)

Con la monitorización integrada directamente en este flujo de trabajo, los usuarios pueden rastrear la salud del punto final, inspeccionar el comportamiento de las solicitudes y mantener sistemas fiables sin depender de herramientas separadas. En este artículo, exploraremos cómo usar Ultralytics Platform para monitorizar puntos finales de modelos desplegados y mantener los sistemas de producción funcionando sin problemas. ¡Empecemos!

Link to this sectionUna visión general de la monitorización de modelos de IA#

En el ciclo de vida de un modelo de IA, la monitorización se refiere a observar cómo se comportan los sistemas desplegados una vez que el modelo está activo y atendiendo solicitudes del mundo real. Mientras que el entrenamiento y la validación muestran cómo funciona un modelo de aprendizaje automático (modelo ML) en conjuntos de datos preparados, la monitorización se centra en cómo opera el punto final desplegado en un entorno de producción.

Una parte crucial de la monitorización es rastrear las métricas a nivel de sistema que reflejan la fiabilidad y la capacidad de respuesta. Métricas como la latencia y el tiempo de actividad ayudan a indicar qué tan bien está manejando el sistema las solicitudes entrantes. La latencia mide cuánto tiempo lleva procesar una solicitud y devolver una respuesta, mientras que el tiempo de actividad destaca la consistencia con la que el punto final permanece disponible.

Otro aspecto clave es la observabilidad, que proporciona visibilidad sobre cómo se manejan las solicitudes. Cada vez que una entrada, como una imagen o un fotograma de vídeo, se envía a un modelo desplegado, se procesa como una solicitud de inferencia.

Los registros capturan estas solicitudes junto con detalles como marcas de tiempo, tiempos de respuesta y códigos de estado. Estos registros facilitan el seguimiento de las solicitudes, la depuración de problemas y la investigación de fallos cuando ocurren. Son especialmente útiles para identificar patrones como errores repetidos, respuestas lentas o comportamientos inesperados del sistema.

Al combinar métricas y registros, la monitorización ayuda a los usuarios a comprender cómo operan sus sistemas en producción y a responder rápidamente a los problemas a medida que surgen.

Link to this sectionUn vistazo a las métricas de rendimiento del modelo frente a las métricas del sistema#

Antes de sumergirnos en la monitorización de producción, analicemos la diferencia entre las métricas de rendimiento del modelo y las métricas del sistema.

Normalmente, la monitorización del modelo se asocia con métricas de evaluación, también conocidas como métricas del modelo, tales como precisión, recall y mAP (precisión media). Estas métricas se utilizan para describir el comportamiento del modelo y evaluar la calidad de las predicciones, a menudo en relación con datos de producción o datos de entrada. Pueden ser particularmente útiles para identificar casos límite o valores atípicos en nuevos datos.

Sin embargo, esto es diferente de monitorizar un sistema desplegado en producción. En este contexto, la monitorización se centra en cómo funciona el sistema en lugar de evaluar directamente las predicciones del modelo.

En lugar de métricas del modelo, la monitorización del despliegue se basa en señales a nivel de sistema como el volumen de solicitudes, la latencia, las tasas de error y el tiempo de actividad. Estas métricas proporcionan visibilidad sobre cómo los puntos finales manejan los datos de entrada, qué tan consistentemente responden y cómo operan en entornos de producción.

Link to this sectionEl papel de la monitorización de modelos en proyectos de visión artificial#

A continuación, veamos un ejemplo del mundo real que destaca la necesidad de un sistema de monitorización en los despliegues de visión artificial.

Considera una solución de visión que utiliza estimación de poses, una tarea de visión artificial que se utiliza para identificar y analizar los movimientos del cuerpo humano, para monitorizar a los trabajadores de la construcción en cuanto al cumplimiento de la seguridad. Durante el despliegue inicial del modelo, un sistema de este tipo podría funcionar bien en condiciones controladas con una visibilidad clara y escenarios estándar.

Sin embargo, las obras de construcción reales introducen complejidad adicional. Los volúmenes de solicitudes pueden variar a lo largo del día, las condiciones de la red pueden ser inconsistentes y múltiples cámaras o puntos finales pueden enviar datos al mismo tiempo. Estos factores pueden conducir a respuestas más lentas o fallos ocasionales si el sistema no se monitoriza adecuadamente.

Fig 2. Estimación de poses utilizada para monitorizar a trabajadores en una obra de construcción (Fuente)

En un entorno de producción como este, se vuelve importante entender con qué fiabilidad está operando el sistema. La monitorización proporciona visibilidad sobre si los puntos finales están disponibles, qué tan rápido responden a las solicitudes entrantes y qué tan consistentemente manejan el tráfico a lo largo del tiempo.

Por ejemplo, un aumento en la latencia puede apuntar a una mayor carga o limitaciones de recursos, mientras que un aumento en las tasas de error puede indicar problemas con el manejo de solicitudes o la estabilidad del sistema. Los registros añaden más contexto al mostrar cómo se procesan las solicitudes individuales y dónde ocurren los fallos.

Al rastrear estas señales, los entusiastas de la IA y los científicos de datos pueden identificar problemas tempranamente, solucionar problemas de manera más efectiva y garantizar que sus sistemas continúen funcionando de forma fiable a medida que cambian las condiciones del mundo real.

Link to this sectionUso de Ultralytics Platform para monitorizar modelos de visión desplegados#

En muchos flujos de trabajo de aprendizaje profundo, la monitorización a menudo se maneja utilizando herramientas separadas para registros, métricas y salud del sistema. Esta configuración fragmentada puede dificultar la obtención de una visión clara de cómo están operando los puntos finales desplegados en producción y añade complejidad a la gestión de los despliegues.

Ultralytics Platform simplifica esto al llevar la monitorización directamente a un entorno unificado que cubre todo el flujo de trabajo de visión artificial, desde la ingesta y anotación de datos hasta el entrenamiento, el despliegue y la monitorización.

Con esta configuración integrada, los usuarios pueden rastrear cómo sus puntos finales desplegados manejan el tráfico del mundo real sin configurar sistemas de registro externos o paneles adicionales. Todo está disponible en un solo lugar, lo que facilita observar el comportamiento del sistema y mantener despliegues fiables a lo largo del tiempo.

Se puede acceder a las funciones de monitorización directamente desde la pestaña de despliegue (Deploy). Desde un único panel, los usuarios pueden rastrear métricas clave, analizar el comportamiento a nivel de solicitud y visualizar tendencias. Estas visualizaciones integradas facilitan la comprensión de cómo están funcionando las soluciones sin tener que cambiar entre herramientas.

Al reunir la monitorización, el despliegue y la gestión de modelos dentro del flujo de trabajo más amplio, la plataforma reduce la complejidad. Esto hace que sea más fluido centrarse en la gestión de los despliegues, la optimización del rendimiento del sistema y el mantenimiento de la fiabilidad.

Link to this sectionFunciones de monitorización integradas de Ultralytics Platform#

En los despliegues del mundo real, la monitorización depende de tener una visibilidad clara de cómo funcionan los sistemas a medida que las condiciones cambian con el tiempo. Va más allá de rastrear unas pocas métricas e implica entender cómo se comportan los puntos finales desplegados en todos los entornos y gestionar múltiples despliegues de manera efectiva.

Inspirada por los comentarios de la comunidad de visión artificial sobre los desafíos comunes, Ultralytics Platform incluye varias capacidades que hacen que la monitorización sea más práctica y escalable.

Aquí tienes una descripción general de algunas de estas características clave:

- Visibilidad global del despliegue: La página de despliegue (Deploy) incluye un mapa mundial interactivo que muestra las regiones de despliegue con indicadores visuales para puntos finales activos y en progreso, lo que permite a los usuarios monitorizar la distribución geográfica y la actividad regional.

- Vistas de panel flexibles: El panel de despliegue proporciona múltiples modos de visualización, incluyendo vista de tarjeta, cuadrícula compacta y vista de tabla con columnas ordenables como nombre, región, estado y solicitudes, apoyando la monitorización estructurada y la comparación.

- Monitorización de múltiples puntos finales: El panel agrega datos de monitorización en todos los despliegues utilizando tarjetas de visión general y listas de despliegue.

- Políticas de retención de datos: Los datos de monitorización se conservan durante un período definido, con métricas disponibles durante 30 días y registros durante 7 días, lo que respalda el análisis de rendimiento reciente y los flujos de trabajo de depuración.

- Soporte de monitorización externa: Los puntos finales de despliegue se pueden monitorizar utilizando herramientas externas como Datadog, New Relic y servicios de monitorización de tiempo de actividad, o acceder a ellos a través de puntos finales de API para monitorización personalizada y comprobaciones de salud.

A continuación, repasaremos algunas de estas funciones con más detalle y veremos cómo se pueden usar para monitorizar puntos finales desplegados en producción.

Link to this sectionCómo rastrear métricas clave de rendimiento usando Ultralytics Platform#

Una vez que se despliega un modelo, la monitorización comienza con el seguimiento de las métricas clave del sistema. Si bien las métricas como la precisión y el recall son útiles durante el desarrollo, la monitorización de producción se centra en señales a nivel de sistema como el tiempo de respuesta y las tasas de error, que proporcionan información medible sobre cuán fiablemente están manejando los puntos finales el tráfico del mundo real.

Ultralytics Platform proporciona un panel centralizado que ofrece una visión clara de la actividad del punto final y el comportamiento del sistema. En particular, el panel de despliegue incluye cuatro métricas clave que muestran cómo se utilizan los puntos finales y cómo responden a las solicitudes entrantes.

Aquí tienes un vistazo más detallado a estas métricas:

- Total de solicitudes: El número total de solicitudes realizadas en todos los puntos finales durante un período de 24 horas. Esto ayuda a identificar patrones de uso y la demanda general.

- Despliegues activos: El número de puntos finales que actualmente se están ejecutando y atendiendo solicitudes.

- Latencia P95: El tiempo de respuesta en el que se completan el 95% de las solicitudes. Esto da una visión más realista del rendimiento al tener en cuenta las respuestas más lentas.

- Tasa de error: Es el porcentaje de solicitudes fallidas del número total de solicitudes. Esta métrica ayuda a identificar problemas y se puede utilizar para detectar anomalías.

En pocas palabras, estas métricas proporcionan una visión clara de cómo operan los puntos finales desplegados en producción. Al analizar los patrones de uso, los equipos y las personas pueden entender la distribución del tráfico, identificar períodos de carga máxima y garantizar que los sistemas sigan siendo receptivos y fiables a medida que crece el uso.

Link to this sectionEntender el comportamiento del despliegue del modelo a través de registros#

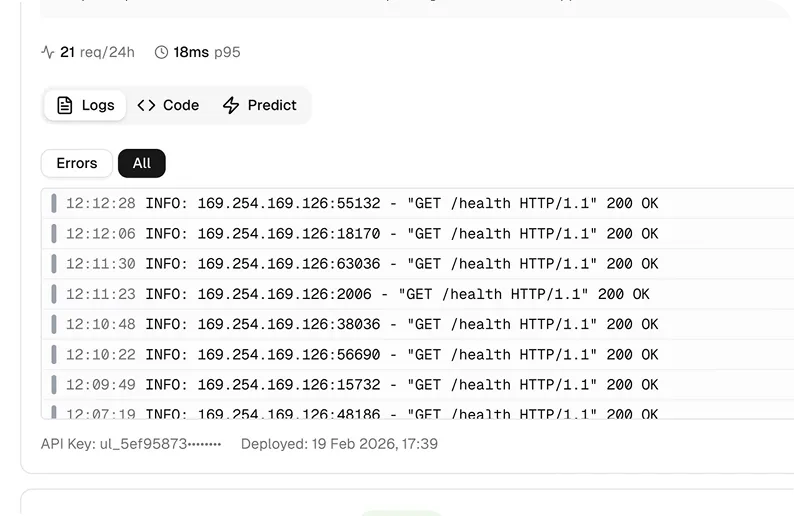

Aunque las métricas proporcionan una visión de alto nivel del rendimiento del sistema, los registros ofrecen una mirada más detallada sobre cómo los puntos finales desplegados manejan las solicitudes individuales. Los registros graban cada solicitud enviada a un punto final junto con la respuesta correspondiente.

Son útiles para rastrear problemas, inspeccionar fallos y entender cómo se procesan las solicitudes. Dentro de Ultralytics Platform, puedes seleccionar cualquier despliegue para ver sus detalles, incluyendo los registros.

Fig 3. Un ejemplo de registros dentro de Ultralytics Platform (Fuente)

Una entrada de registro en la plataforma se muestra en un formato estructurado, lo que facilita entender qué sucedió durante cada solicitud. Cada entrada incluye un nivel de gravedad, que indica qué tan importante es el evento, junto con una marca de tiempo que muestra cuándo ocurrió.

También contiene un mensaje que describe el evento y detalles relacionados con HTTP como códigos de estado y latencia. Esta información ayuda a rastrear solicitudes, apoyar la resolución de problemas y depurar fallos de manera más efectiva. Además, los registros están agrupados por gravedad, por lo que los usuarios pueden priorizar los despliegues que necesitan atención.

Link to this sectionAnalizar la salud y la fiabilidad del punto final en Ultralytics Platform#

La monitorización también implica entender la salud general de los puntos finales desplegados, incluyendo si se están ejecutando correctamente, respondiendo a tiempo y manejando solicitudes constantemente sin errores. Ultralytics Platform proporciona una visión clara del estado de salud de cada despliegue, lo que hace que sea sencillo verificar que los puntos finales operan como se espera.

La plataforma incluye indicadores visuales de salud para cada despliegue, que se muestran en tarjetas de despliegue individuales.

Por ejemplo, un indicador verde muestra que el punto final está saludable y responde normalmente, mientras que un indicador rojo señala problemas o tiempo de inactividad. Un icono de carga indica que el sistema está verificando activamente el estado del despliegue.

Al rastrear la salud del punto final a lo largo del tiempo, es posible detectar problemas tempranamente, mantener un rendimiento constante y garantizar una experiencia estable para las aplicaciones que se ejecutan en producción.

Link to this sectionLa conexión entre los datos de monitorización y la mejora del rendimiento#

La monitorización del modelo no consiste solo en rastrear métricas. Crea un bucle de retroalimentación que apoya la mejora continua con el tiempo. A medida que los puntos finales manejan el tráfico del mundo real, comienzan a surgir patrones en las métricas y los registros que pueden revelar problemas como una mayor latencia, tasas de error más altas o un comportamiento inconsistente del sistema.

La monitorización destaca las áreas que necesitan atención. Por ejemplo, una latencia constantemente alta puede indicar la necesidad de una mejor asignación de recursos o escalado, mientras que una tasa de error creciente puede señalar problemas con el manejo de solicitudes o la estabilidad del sistema.

Una vez identificados estos problemas, se pueden tomar medidas para mejorar la fiabilidad. Esto puede implicar ajustar la infraestructura, escalar recursos o solucionar problemas en cómo se procesan las solicitudes. Después de estos cambios, los sistemas pueden seguir siendo monitorizados para confirmar que el rendimiento ha mejorado.

Al vincular la monitorización con mejoras continuas, los usuarios pueden mantener sistemas robustos a medida que crece el uso y cambian las condiciones.

Link to this sectionExploración de un ejemplo real: Monitorización del manejo de equipaje en aviación#

Para comprender mejor el impacto de la monitorización en un escenario real, exploremos cómo se aplica a la automatización de operaciones terrestres en aviación.

Considera un sistema de visión diseñado para monitorizar la carga y descarga de equipaje durante las operaciones terrestres de aeronaves. En esta configuración, un modelo de detección de objetos como Ultralytics YOLO26 puede utilizarse para detectar si el equipaje se cae de las cintas transportadoras o del equipo de manipulación.

Durante las pruebas y el despliegue inicial, el sistema en tiempo real puede funcionar bien, identificando con precisión el equipaje y respondiendo rápidamente.

Sin embargo, en un entorno aeroportuario real, las condiciones son mucho menos predecibles. La iluminación cambia a lo largo del día, múltiples cámaras transmiten datos al mismo tiempo y los volúmenes de solicitudes aumentan durante los períodos de mayor actividad. Estos factores pueden causar que la latencia aumente o que aparezcan errores, y sin visibilidad del sistema, estos problemas pueden pasar desapercibidos fácilmente.

Aquí es donde la monitorización se vuelve valiosa. Al rastrear métricas como el volumen de solicitudes, la latencia y las tasas de error junto con registros detallados, los equipos pueden ver rápidamente cuándo un punto final se está ralentizando o fallando. Si la latencia aumenta durante las horas punta, puede indicar la necesidad de escalar los recursos, mientras que un aumento repentino de errores puede apuntar a problemas con cámaras específicas o con el manejo de solicitudes. Actuar sobre estas señales ayuda a mantener la fiabilidad del sistema, por lo que el manejo del equipaje puede seguir monitorizándose con precisión incluso a medida que cambian las condiciones.

Link to this sectionConclusiones clave#

La monitorización es lo que mantiene fiables a los modelos de visión artificial desplegados una vez que abandonan las condiciones controladas del desarrollo y comienzan a manejar el tráfico del mundo real. Al centrarse en señales a nivel de sistema como el volumen de solicitudes, la latencia, las tasas de error y el tiempo de actividad, junto con registros detallados, la monitorización proporciona la visibilidad necesaria para detectar problemas tempranamente y mantener los sistemas de producción funcionando sin problemas.

Con la monitorización integrada directamente en el flujo de trabajo de despliegue, Ultralytics Platform facilita el seguimiento de la salud del punto final, la inspección del comportamiento de las solicitudes y el mantenimiento de sistemas fiables sin depender de herramientas separadas. Al reunir los datos, el entrenamiento, el despliegue y la monitorización en un solo lugar, la plataforma ayuda a los equipos a pasar de la experimentación a despliegues fiables en el mundo real.

Únete a nuestra creciente comunidad y explora nuestro repositorio de GitHub para aprender más sobre IA de visión. Para construir con IA de visión hoy, consulta nuestras opciones de licencia. Descubre cómo la IA en la fabricación y la IA en la sanidad están dando forma al futuro visitando nuestras páginas de soluciones.