Costruisci un sistema di ispezione visiva basato su telecamera senza competenze di IA

Scopri come costruire un sistema di ispezione visiva basato su telecamera senza competenze di IA utilizzando la piattaforma Ultralytics, dall'etichettatura al deployment.

Ogni prodotto che utilizziamo, che sia un telefono, un articolo confezionato o un componente automobilistico, viene sottoposto a una qualche forma di ispezione di qualità prima di arrivare a noi, il consumatore finale. Tradizionalmente, questo veniva fatto tramite controlli manuali o semplici sistemi basati su regole. Sebbene questi metodi funzionino, sono spesso lenti, incoerenti e difficili da scalare all'aumentare della produzione.

Per migliorare il processo di ispezione della qualità, molti settori si stanno rivolgendo alla computer vision, un ramo dell'intelligenza artificiale che aiuta le macchine a comprendere immagini e video. Ad esempio, modelli di vision AI come Ultralytics YOLO26 possono aiutare a rilevare, classificare e localizzare i difetti con un elevato livello di precisione.

In ambienti di produzione reali, questi modelli possono essere utilizzati per analizzare immagini catturate direttamente da linee di assemblaggio ad alta velocità. Man mano che i prodotti avanzano attraverso le varie fasi, le telecamere industriali li tracciano e il sistema verifica la presenza di problemi come graffi, parti mancanti o disallineamenti. Questo rende il rilevamento dei difetti più rapido e coerente, supportando al contempo un'ispezione ad alto rendimento.

In passato, costruire questi sistemi richiedeva molteplici strumenti e solide competenze tecniche, il che rendeva il processo complesso e dispendioso in termini di tempo. Ultralytics Platform, la nostra nuova soluzione end-to-end per la computer vision, semplifica tutto questo riunendo preparazione dei dati, annotazione, addestramento del modello e distribuzione in un unico posto.

In questo articolo, esploreremo come puoi utilizzare Ultralytics Platform per costruire pratici sistemi di ispezione visiva basati su telecamera senza aver bisogno di profonde competenze AI. Iniziamo!

Link to this sectionIl ruolo della computer vision nel controllo qualità#

Prima di immergerci in come Ultralytics Platform renda più semplice la costruzione di sistemi di ispezione, facciamo un passo indietro e comprendiamo il ruolo della computer vision nell'ispezione di qualità.

L'ispezione è una parte fondamentale del processo di produzione che garantisce che i prodotti soddisfino gli standard di qualità e siano privi di difetti. Tuttavia, i risultati possono variare, specialmente durante lunghi turni o produzioni ad alto volume.

Per rendere l'ispezione più affidabile, molti settori utilizzano la computer vision, nota anche come machine vision, per analizzare le immagini provenienti dalla linea di produzione e identificare i difetti. Questi sistemi utilizzano il deep learning, dove modelli e algoritmi apprendono pattern da ampi set di immagini etichettate di alta qualità.

Durante l'addestramento, a un modello vengono mostrati esempi sia di prodotti normali che di diversi tipi di difetti. Nel tempo, impara a riconoscere questi pattern autonomamente. Una volta addestrato, un modello può ispezionare grandi volumi di prodotti e applicare gli stessi criteri in modo coerente, migliorando la precisione.

Link to this sectionAttività comuni di computer vision utilizzate nell'ispezione di qualità#

Le applicazioni di machine vision sono rese possibili da modelli di computer vision come i modelli Ultralytics YOLO che possono supportare diversi tipi di attività visive. Ecco una panoramica di come queste attività di vision AI vengono utilizzate per i flussi di lavoro di ispezione automatizzata:

- Classificazione delle immagini: Questa attività viene utilizzata per assegnare un'unica etichetta a un'intera immagine, come “buono” o “difettoso”. Fornisce una valutazione di alto livello della qualità del prodotto senza indicare la posizione dei difetti.

- Rilevamento di oggetti (Object detection): Aiuta a identificare i difetti all'interno di un'immagine e a localizzarli utilizzando dei bounding box. Questo rende possibile rilevare e localizzare problemi come crepe, graffi o componenti mancanti.

- Segmentazione delle istanze (Instance segmentation): Facendo un passo oltre il rilevamento di oggetti, prevede maschere a livello di pixel per ogni difetto rilevato. Questo supporta un'analisi precisa della forma, della dimensione e dei contorni dei difetti.

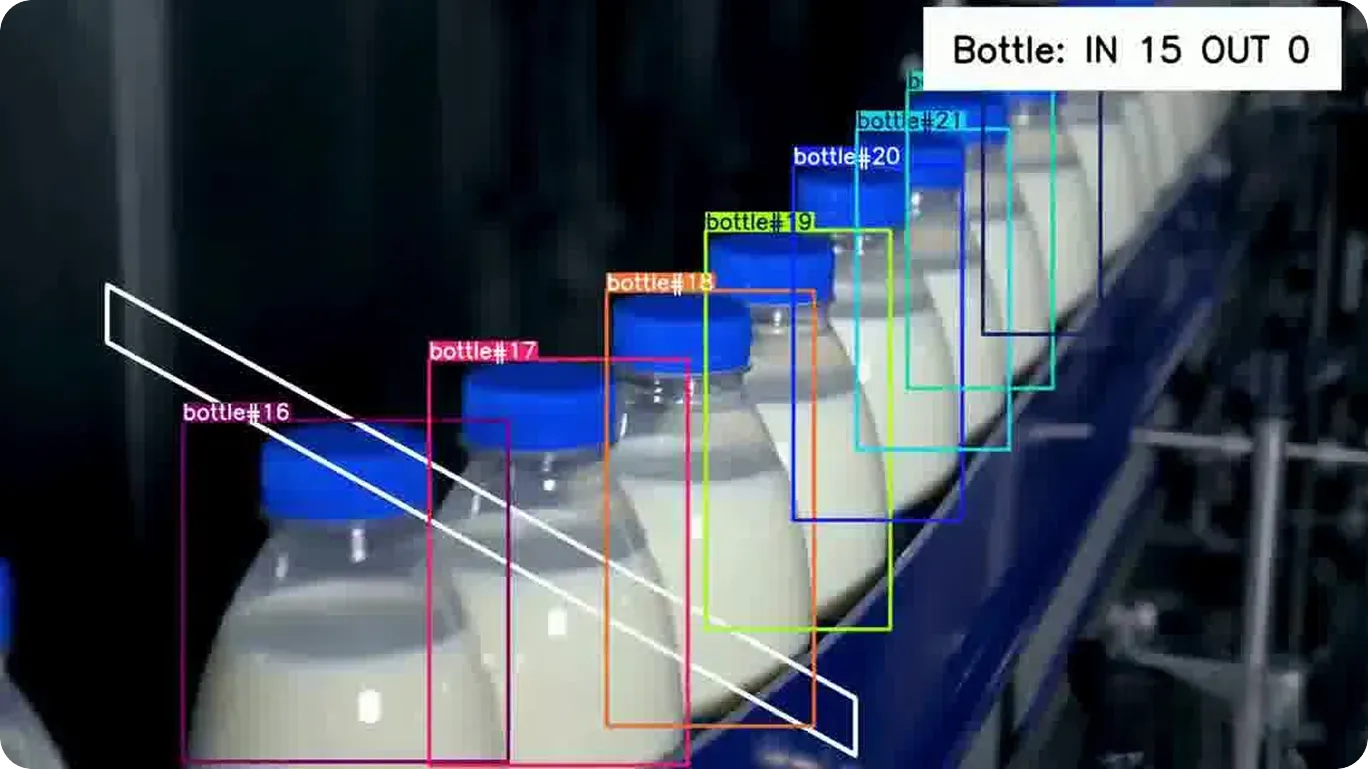

- Tracciamento di oggetti (Object tracking): Quando si tracciano i prodotti su più fotogrammi, segue gli articoli mentre si muovono lungo la linea di produzione. Questo mantiene la coerenza e assicura che i difetti non vengano tralasciati.

- Rilevamento di bounding box orientati (OBB): Questa attività rileva gli oggetti utilizzando bounding box ruotati invece di quelli allineati agli assi. È particolarmente utile quando i difetti o i componenti appaiono ad angolazioni diverse, consentendo una localizzazione più accurata.

Link to this sectionUno sguardo alle applicazioni di ispezione di qualità nei vari settori#

La computer vision è ampiamente utilizzata in tutti i settori per mantenere la qualità del prodotto, soddisfare gli standard e ridurre la necessità di ispezioni manuali. Svolge funzioni chiave come il rilevamento dei difetti, la classificazione, il riconoscimento di oggetti, la misurazione e il rilevamento di anomalie.

Fig 1. Un esempio di rilevamento e tracciamento di prodotti utilizzando sistemi di machine vision (Fonte)

Ecco alcuni esempi di casi d'uso nel mondo reale in cui viene applicata:

- Produzione: Il rilevamento dei difetti superficiali viene utilizzato per identificare problemi come graffi, ammaccature, crepe e scolorimento analizzando le immagini dei prodotti sulla linea di produzione per il rilevamento dei difetti in linea. Può anche rilevare parti mancanti o errori di assemblaggio in tempo reale, supportando un'ispezione continua.

- Automobilistico: I sistemi di computer vision analizzano le parti del motore e i pannelli della carrozzeria per verificare l'allineamento e rilevare danni. Sono particolarmente efficaci per ispezionare forme complesse e aree difficili da raggiungere, lavorando spesso insieme a sistemi robotici per un posizionamento preciso e un'ispezione automatizzata.

- Elettronica e semiconduttori: Questi sistemi rilevano piccoli difetti in componenti come circuiti stampati (PCB), inclusi problemi di saldatura, micro-crepe e circuiti danneggiati. Grazie all'analisi delle immagini ad alta risoluzione, è possibile rilevare anche difetti molto sottili che spesso sfuggono durante l'ispezione manuale.

- Packaging e logistica: I sistemi visivi eseguono la scansione dei codici a barre, leggono le etichette dei prodotti e controllano la qualità dell'imballaggio. Assicurano che i prodotti siano adeguatamente imballati, sigillati e pronti per la spedizione, riducendo gli errori.

- Cibo e bevande: I sistemi di ispezione potenziati da telecamere o sensori visivi analizzano l'aspetto del prodotto per identificare problemi come sigillatura impropria, rischi di contaminazione, etichettatura errata o incoerenze visive, aiutando a mantenere la qualità e la sicurezza.

- Prodotti farmaceutici: La computer vision viene utilizzata per ispezionare compresse, fiale e imballaggi per rilevare difetti come crepe, contaminazione, etichettatura errata o incoerenze nel livello di riempimento, garantendo la conformità a rigidi standard normativi e mantenendo la sicurezza del prodotto.

Link to this sectionSemplificare i flussi di lavoro di ispezione visiva con Ultralytics Platform#

Considera una linea di produzione in cui i prodotti si spostano attraverso diverse fasi mentre le telecamere catturano continuamente immagini per l'ispezione. Queste immagini vengono utilizzate per verificare la presenza di difetti come graffi, parti mancanti o disallineamenti.

Fino ad ora, costruire e gestire tali sistemi di ispezione ha richiesto molteplici strumenti e una buona dose di competenze tecniche.

Infatti, in Ultralytics, abbiamo ricevuto feedback costanti dalla comunità di vision AI su quanto questo processo possa essere frammentato e dispendioso in termini di tempo, con colli di bottiglia comuni che includono strumenti sparsi, configurazione complessa dell'ambiente, flussi di lavoro di etichettatura dei dati inefficienti, ritardi nell'addestramento del modello e sfide nella distribuzione. Questo feedback ha avuto un ruolo chiave nel definire Ultralytics Platform.

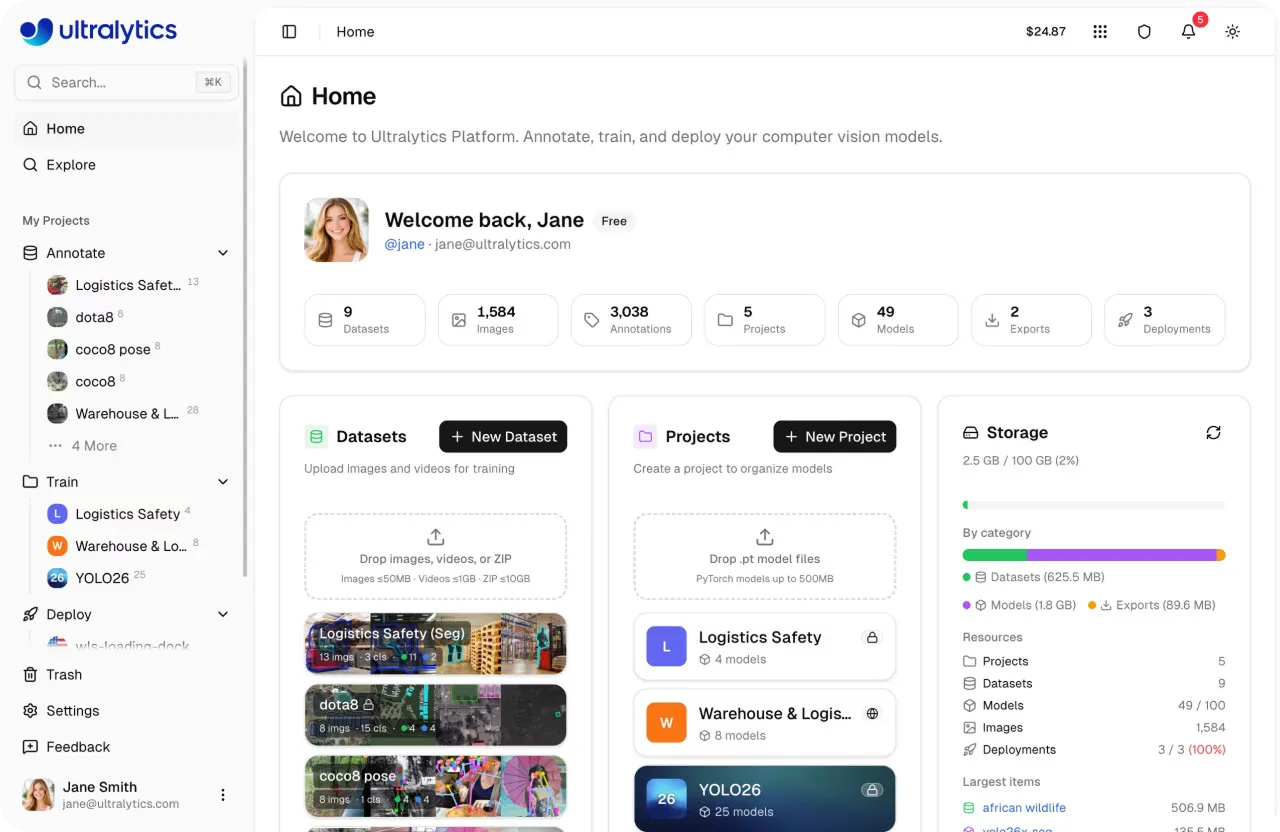

Fig 2. Uno sguardo a Ultralytics Platform (Fonte)

Con Ultralytics Platform, l'intero processo di sviluppo e distribuzione può essere gestito in un unico posto. I dati grezzi possono essere caricati e annotati per creare dataset di addestramento, che vengono poi utilizzati per addestrare modelli a rilevare difetti. Una volta addestrati, questi modelli possono essere distribuiti per analizzare nuove immagini provenienti dalla linea di produzione, con strumenti integrati per monitorare le prestazioni nel tempo.

Oltre a riunire l'intero flusso di lavoro in un unico posto, Ultralytics Platform è progettata per essere facile da usare. Anche gli utenti con limitata esperienza di machine learning possono passare rapidamente dall'idea alla produzione.

Link to this sectionUtilizzare Ultralytics Platform per etichettare i difetti nelle immagini#

Ora che abbiamo visto come Ultralytics Platform riunisce il flusso di lavoro, vediamo come utilizzarla in ogni fase della pipeline di vision AI, iniziando dal caricamento dei dati e dall'etichettatura dei difetti.

Link to this sectionGestione del dataset di ispezione su Ultralytics Platform#

Il primo passo è portare i dati sulla piattaforma. Puoi caricare immagini, video o archivi di dataset come file ZIP, TAR o GZ. Sono supportati formati di dataset comuni come YOLO e COCO, quindi i dataset esistenti possono essere importati senza passaggi aggiuntivi.

Puoi anche iniziare più velocemente utilizzando i dataset condivisi dalla comunità. Questi dataset possono essere esplorati e clonati nel tuo spazio di lavoro, permettendoti di costruire su dati esistenti invece di ricominciare da zero. Una volta clonati, possono essere aggiornati ed estesi per il tuo caso d'uso specifico.

Se stai lavorando su vari esperimenti, i dataset possono essere riutilizzati importandoli come file NDJSON, rendendo più semplice ricrearli o condividerli senza conversioni aggiuntive.

Dopo che i dati sono stati caricati, la piattaforma li prepara automaticamente. Controlla i formati dei file, elabora le annotazioni, ridimensiona le immagini se necessario e genera statistiche di base del dataset. I video vengono suddivisi in fotogrammi in modo che possano essere utilizzati per l'addestramento e le immagini vengono ottimizzate per una navigazione e un'analisi più semplici.

Link to this sectionAnnotazione dei dati potenziata da Ultralytics Platform#

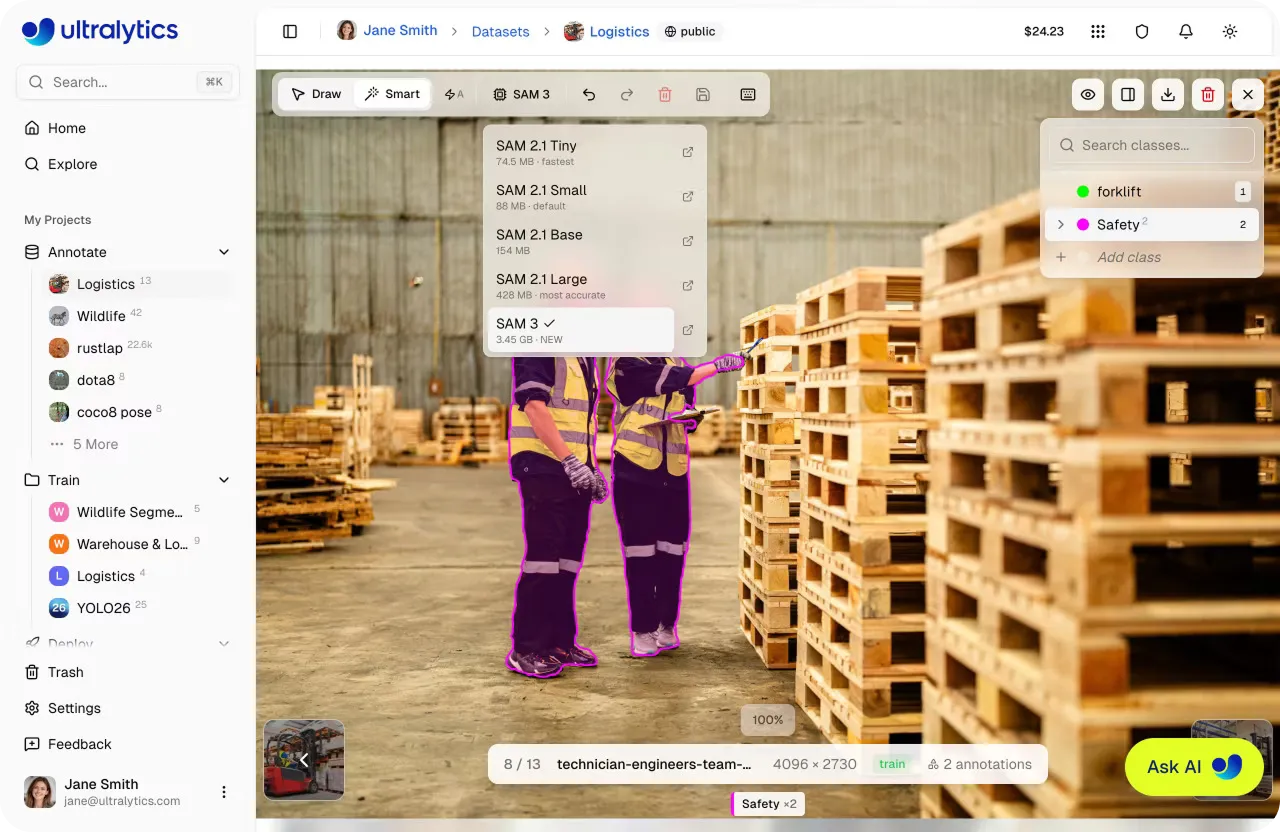

Una volta che i dati sono pronti, il passo successivo è l'annotazione dei dati. È qui che i difetti vengono etichettati in modo che il modello possa imparare cosa rilevare. Ultralytics Platform include un editor di annotazione integrato che supporta attività come rilevamento di oggetti, segmentazione delle istanze, classificazione delle immagini, stima della posa e rilevamento con bounding box orientati.

Puoi etichettare i dati manualmente utilizzando strumenti come bounding box, poligoni o punti chiave, a seconda del tuo caso d'uso. Per velocizzare le cose, la piattaforma offre anche l'etichettatura assistita dall'AI.

Ad esempio, l'annotazione intelligente basata su SAM ti consente di etichettare oggetti utilizzando semplici clic. Selezionando le regioni da includere o escludere, il sistema genera una maschera in tempo reale, che può poi essere regolata se necessario.

Fig 3. Annotazione intelligente guidata da SAM all'interno di Ultralytics Platform (Fonte)

Inoltre, l'annotazione intelligente basata su YOLO può generare etichette automaticamente utilizzando le previsioni del modello. Queste possono essere riviste e perfezionate, rendendo più semplice lavorare su grandi dataset senza dover etichettare tutto manualmente.

L'editor di annotazione include anche funzionalità come la gestione delle classi, la modifica delle annotazioni, scorciatoie da tastiera e opzioni di annulla o ripristina. Queste rendono più semplice mantenere la coerenza e rivedere le annotazioni man mano che il tuo dataset cresce.

Mentre etichetti i dati, la piattaforma fornisce approfondimenti come la distribuzione delle classi e il conteggio delle annotazioni. Questo aiuta a identificare lacune, correggere incoerenze e migliorare la qualità del dataset prima di passare all'addestramento.

Link to this sectionAddestramento di YOLO26 per il rilevamento dei difetti su Ultralytics Platform#

Il passo successivo è addestrare un modello per rilevare automaticamente i difetti utilizzando i dati etichettati. Ultralytics Platform supporta l'addestramento con i modelli Ultralytics YOLO, incluso YOLO26, che può essere utilizzato per attività come rilevamento di oggetti, segmentazione delle istanze e classificazione delle immagini.

L'addestramento è gestito tramite una dashboard unificata dove puoi configurare, eseguire e monitorare i lavori di addestramento in un unico posto. Per iniziare, puoi selezionare un dataset, inclusi quelli che hai caricato, annotato sulla piattaforma, provenienti da dataset pubblici disponibili sulla piattaforma o clonati dalla comunità.

Una volta selezionato, il dataset viene collegato automaticamente all'esecuzione dell'addestramento, rendendo più semplice tracciare gli esperimenti e mantenere la coerenza.

Successivamente, puoi configurare i parametri di addestramento come il numero di epoche, la dimensione del batch, la dimensione dell'immagine e il learning rate. Queste impostazioni controllano come il modello impara e hanno un impatto diretto sia sul tempo di addestramento che sulle prestazioni.

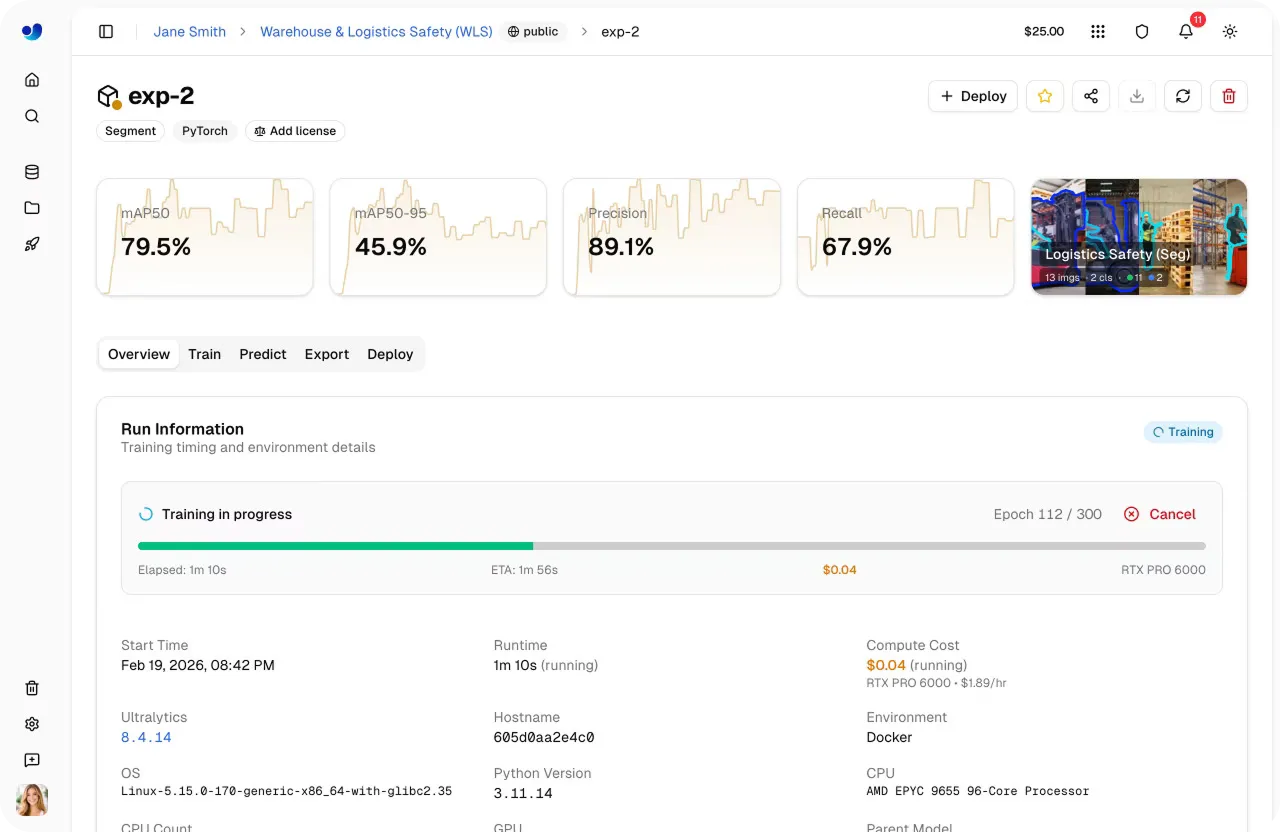

Link to this sectionEsecuzione e monitoraggio dell'addestramento#

Puoi quindi scegliere come eseguire l'addestramento. La piattaforma supporta l'addestramento nel cloud su GPU gestite, l'addestramento locale utilizzando il tuo hardware e flussi di lavoro basati su browser tramite ambienti come Google Colab.

Quando utilizzi l'addestramento nel cloud, puoi scegliere tra una gamma di opzioni GPU come RTX 2000 Ada e RTX A4500 per esperimenti più piccoli, RTX 4090 o RTX A6000 per carichi di lavoro più impegnativi e opzioni ad alte prestazioni come A100 o H100 per l'addestramento su larga scala.

Quando l'addestramento ha inizio, il progresso può essere monitorato direttamente all'interno della piattaforma. La dashboard fornisce visibilità in tempo reale su metriche chiave come le curve di perdita e le metriche di prestazione, insieme all'utilizzo del sistema e ai log di addestramento. Questo rende fluido comprendere come il modello sta imparando e identificare tempestivamente potenziali problemi.

Fig 4. Puoi monitorare facilmente il progresso dell'addestramento utilizzando Ultralytics Platform (Fonte)

Mentre esegui più esperimenti, la piattaforma tiene traccia di configurazioni, dataset e risultati in un unico posto. Questo rende semplice confrontare diverse esecuzioni di addestramento, valutare le prestazioni utilizzando metriche come precisione, recall e mAP e selezionare il modello con le migliori prestazioni per la distribuzione.

Link to this sectionDistribuzione di un modello di visione tramite Ultralytics Platform#

Dopo l'addestramento, il passaggio successivo è convalidare le prestazioni del modello addestrato su dati nuovi e mai visti prima di procedere alla distribuzione. Ultralytics Platform include una scheda Predict integrata che ti consente di testare i modelli direttamente nel browser senza alcuna configurazione.

Puoi caricare immagini, utilizzare dati di esempio o catturare input tramite una webcam e i risultati appaiono istantaneamente con sovrapposizioni visive e punteggi di confidenza. Ciò significa che puoi verificare rapidamente le prestazioni del modello e identificare eventuali problemi prima di integrarlo in sistemi del mondo reale.

Una volta convalidato il modello, può essere distribuito utilizzando diverse opzioni a seconda del tuo caso d'uso. Ecco uno sguardo più approfondito alle opzioni di distribuzione del modello supportate da Ultralytics Platform:

- Inferenza condivisa: Questa opzione ti consente di accedere al modello tramite una REST API, rendendo facile l'integrazione in applicazioni o flussi di lavoro. Funziona su un sistema multi-tenant in alcune regioni centrali, dove le richieste vengono instradate automaticamente verso il servizio disponibile più vicino. Questo lo rende una buona soluzione per lo sviluppo, i test e un utilizzo più leggero prima di passare alla produzione.

- Endpoint dedicati: Per l'uso in produzione, i modelli possono essere distribuiti come endpoint dedicati con le proprie risorse di calcolo. Questi vengono eseguiti come servizi single-tenant in 43 regioni globali, aiutando a ridurre la latenza distribuendoli più vicino agli utenti finali. Supportano anche l'autoscaling e lo scale-to-zero, consentendo alle risorse di adattarsi automaticamente in base al traffico.

- Esportazione del modello: I modelli possono essere esportati ed eseguiti al di fuori della piattaforma su sistemi locali o dispositivi edge. La piattaforma supporta 17 formati, inclusi ONNX, TensorRT, OpenVINO, CoreML e TensorFlow Lite. Le opzioni di esportazione supportano anche ottimizzazioni come la quantizzazione FP16 e INT8 per ridurre le dimensioni del modello e migliorare la velocità di inferenza per diversi ambienti hardware.

Link to this sectionMonitoraggio dei modelli distribuiti utilizzando Ultralytics Platform#

Il ciclo di vita di una soluzione di elaborazione delle immagini o di computer vision non termina con la distribuzione del modello. Questo vale anche per i sistemi di ispezione visiva. Una volta che un modello è in esecuzione in produzione, deve essere monitorato continuamente per assicurarsi che funzioni in modo affidabile al variare delle condizioni.

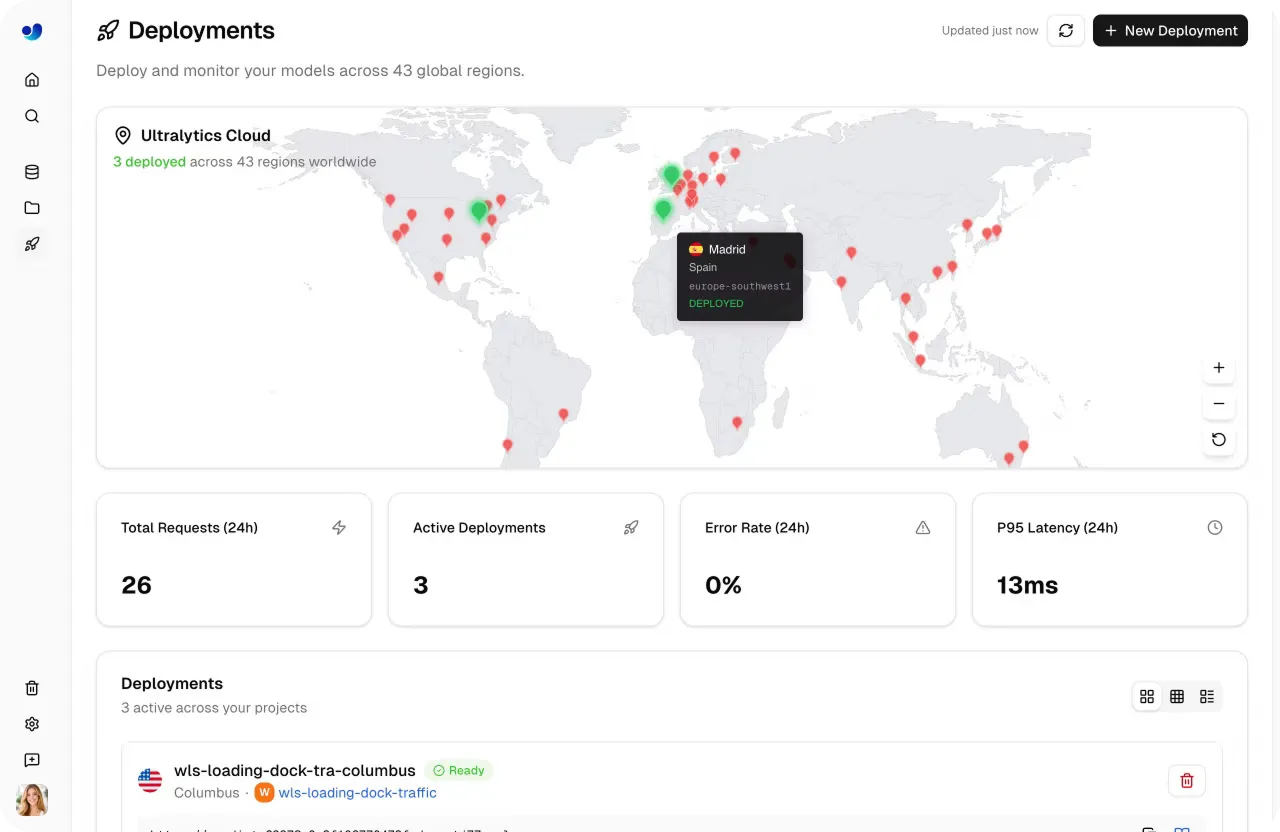

Ultralytics Platform fornisce una dashboard di monitoraggio integrata che offre una visione chiara delle prestazioni dei modelli distribuiti. Da un'unica interfaccia, puoi monitorare l'attività delle richieste, visualizzare i log e controllare lo stato di salute di ogni distribuzione. Puoi comprendere come i modelli vengono utilizzati e come si comportano nel tempo.

La dashboard include metriche chiave come il numero totale di richieste, i tassi di errore e la latenza, aiutandoti a valutare le prestazioni e la reattività. Queste metriche vengono aggiornate regolarmente e forniscono approfondimenti sia sui pattern di utilizzo che sull'affidabilità del sistema.

Una mappa mondiale integrata mostra dove sono distribuite le richieste e le distribuzioni tra le regioni. Con il supporto per le distribuzioni in più posizioni globali, questa vista aiuta a tracciare l'utilizzo geograficamente e a comprendere come i modelli si comportano in ambienti diversi.

Fig 5. Monitoraggio dei modelli distribuiti su Ultralytics Platform (Fonte)

Per un'analisi più approfondita, ogni distribuzione include log dettagliati con timestamp, dettagli della richiesta e messaggi di errore. I log possono essere filtrati per gravità, rendendo semplice il debug dei problemi e l'identificazione rapida dei guasti. Inoltre, i controlli di integrità forniscono indicatori di stato in tempo reale, mostrando se una distribuzione sta funzionando come previsto o se necessita di attenzione.

Il monitoraggio svolge anche un ruolo importante nell'ottimizzazione. Al variare dei dati di input, del traffico o dei pattern di utilizzo, le prestazioni possono variare. Monitorando metriche e log, puoi identificare problemi come latenza elevata, aumento dei tassi di errore o limitazioni di scalabilità e intervenire per mantenere prestazioni coerenti.

Link to this sectionVantaggi dell'utilizzo di Ultralytics Platform per costruire soluzioni di visione#

Ecco alcuni dei principali vantaggi dell'utilizzo di Ultralytics Platform per costruire e scalare sistemi di ispezione visiva:

- Ottimizzata per l'uso nel mondo reale: Funzionalità come endpoint di autoscaling, distribuzione edge ed esportazione del modello assicurano che il sistema possa funzionare in modo affidabile negli ambienti di produzione.

- Cicli di sviluppo più rapidi: Strumenti integrati e configurazioni predefinite aiutano a passare dai dati grezzi a un sistema funzionante in modo più efficiente.

- Facilità d'uso: Interfacce intuitive, flussi di lavoro semplificati e requisiti di configurazione minimi rendono la piattaforma accessibile sia ai principianti che agli utenti esperti.

- Meno lavoro manuale: Funzionalità come l'annotazione assistita dall'AI e l'elaborazione automatizzata dei dati riducono il tempo dedicato a compiti ripetitivi.

- Scalabile nel tempo: Al variare dei requisiti, il sistema può essere aggiornato aggiungendo nuovi dati e riaddestrando i modelli, consentendo l'adattamento a nuovi tipi di difetti, condizioni e configurazioni multi-camera.

Link to this sectionPunti chiave#

Costruire un sistema di ispezione visiva basato su telecamera non deve essere complesso o richiedere profonde competenze AI. Con Ultralytics Platform, puoi passare dai dati grezzi a un sistema funzionante e monitorarne le prestazioni, tutto in un unico posto. Questo semplifica il modo in cui i sistemi di ispezione vengono costruiti, migliorati e gestiti in contesti reali.

Unisciti alla nostra comunità ed esplora il nostro repository GitHub per saperne di più sulla vision AI. Dai un'occhiata alle nostre opzioni di licenza per avviare i tuoi progetti di computer vision. Sei interessato a innovazioni come l'AI nella produzione o la computer vision nel settore automobilistico? Visita le nostre pagine delle soluzioni per saperne di più.