Incorporación deYOLO Ultralytics al hardware de Axelera AI para la IA en el borde

Descubre la nueva integración de exportación que ofrece elPython Ultralytics , en colaboración con Axelera AI, para una IA periférica eficiente y de alto rendimiento.

Descubre la nueva integración de exportación que ofrece elPython Ultralytics , en colaboración con Axelera AI, para una IA periférica eficiente y de alto rendimiento.

En Ultralytics, estamos observando una tendencia cada vez más marcada a ejecutar modelos de visión artificial directamente en dispositivos periféricos, a medida que la IA se va generalizando. En nuestras conversaciones con la comunidad de visión artificial, tanto en línea como en persona en recientes conferencias tecnológicas, nuestro equipo ha constatado un interés creciente por implementar la IA de visión más cerca del lugar donde se generan los datos.

Desde los entornos minoristas inteligentes y la automatización industrial hasta la robótica, la información en tiempo real se está convirtiendo en algo esencial, y ya no basta con confiar únicamente en la nube.

En pocas palabras, la IA en el borde consiste en ejecutar modelos de IA de forma local en los dispositivos, en lugar de enviar los datos a servidores centralizados para su procesamiento. Esto permite reducir la latencia, mejorar la fiabilidad y responder a los acontecimientos del mundo real en tiempo real.

Sin embargo, la implementación de modelos de alto rendimiento en estos entornos plantea sus propios retos, ya que los recursos informáticos limitados y las restricciones de consumo energético exigen que los modelos sean eficientes y estén optimizados para el hardware en el que se ejecutan.

YOLO Ultralytics Ultralytics , como Ultralytics , están diseñados para la visión artificial en tiempo real, pero para aprovechar todo su potencial en el borde del dispositivo se necesita la combinación adecuada de software y hardware. Por eso nos complace anunciar nuestra colaboración con Axelera AI.

Nos hemos asociado con Axelera AI para presentar una integración de exportación actualizada, que permite una implementación eficiente y de alto rendimiento deYOLO Ultralytics en las unidades de procesamiento de IA (AIPU)de Metis®.

En este artículo, veremos cómo se pueden compilar fácilmenteYOLO Ultralytics para su implementación en Metis. ¡Empecemos!

A medida que las aplicaciones de visión artificial siguen evolucionando, la necesidad de un procesamiento más rápido y eficiente se vuelve cada vez más crucial. Los enfoques tradicionales basados en la nube pueden generar latencia, dependen de una conectividad estable y es posible que no satisfagan las exigencias en tiempo real de muchos casos de uso de visión inteligente.

La IA periférica aborda estos retos al permitir que los modelos se ejecuten directamente en dispositivos locales, lo que permite procesar los datos más cerca de su origen. Por ejemplo, pensemos en los drones con sistemas de visión artificial que se utilizan en operaciones de búsqueda y rescate.

Estos sistemas deben analizar las imágenes de vídeo en tiempo real para detect , obstáculos o peligros, a menudo en zonas remotas con conexión a Internet limitada o inexistente. Al ejecutar modelos de visión artificial directamente en el dron, la IA periférica permite una toma de decisiones más rápida y un rendimiento más fiable sin depender de la infraestructura en la nube.

Este cambio está abriendo nuevas posibilidades en todos los sectores. Aplicaciones como la detección de objetos en tiempo real en el comercio minorista, la inspección automatizada de la calidad en la industria manufacturera y la percepción en la robótica se benefician de tiempos de respuesta más rápidos y una mayor fiabilidad.

La IA en el borde se está convirtiendo rápidamente en un factor clave para implementar sistemas de visión artificial escalables y con gran capacidad de respuesta en entornos reales.

Antes de profundizar en la nueva integración de exportación, demos un paso atrás y conozcamos mejor las unidades de procesamiento Metis AI de Axelera AI y el papel que desempeñan a la hora de hacer posible una IA periférica eficiente.

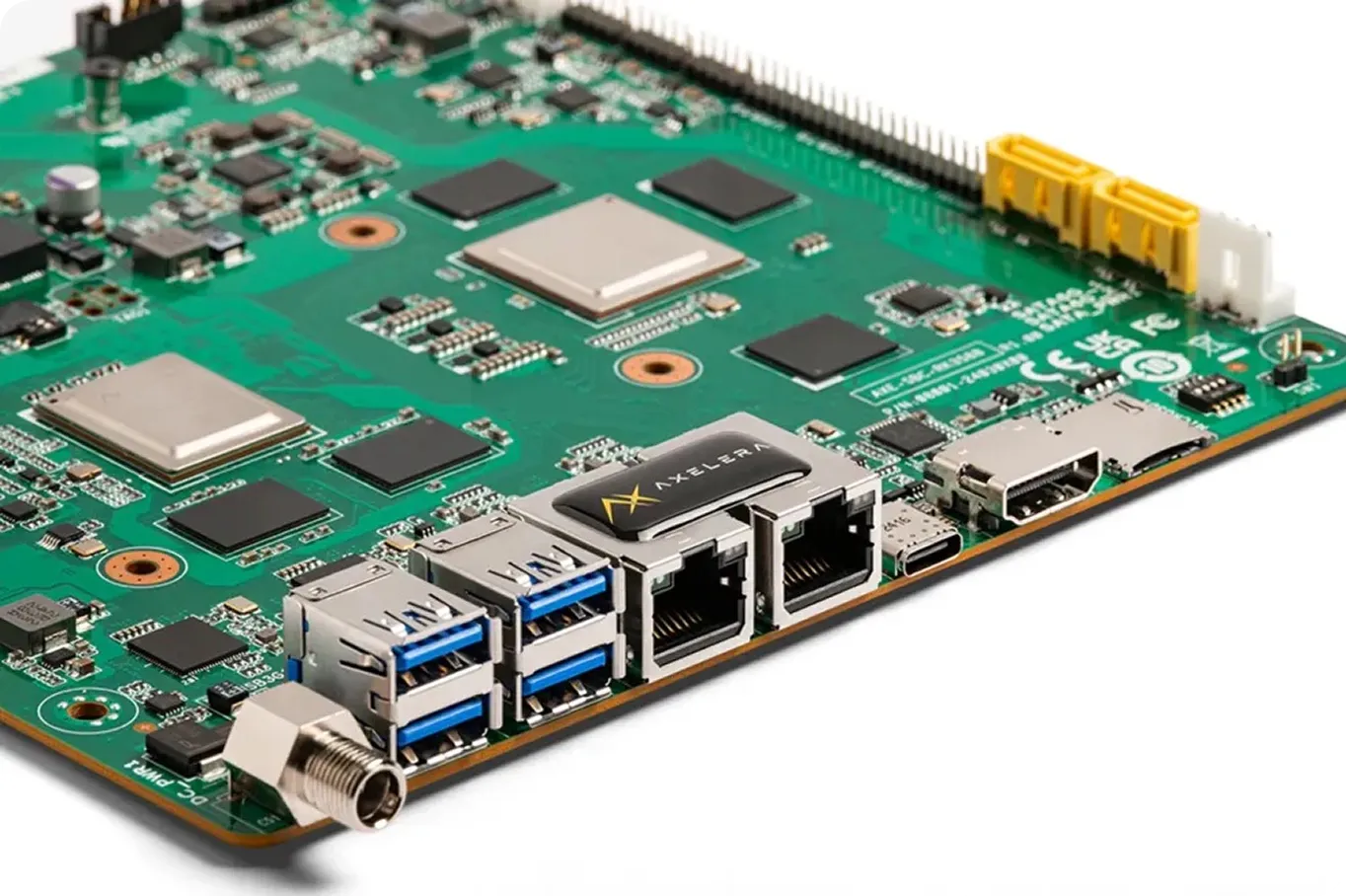

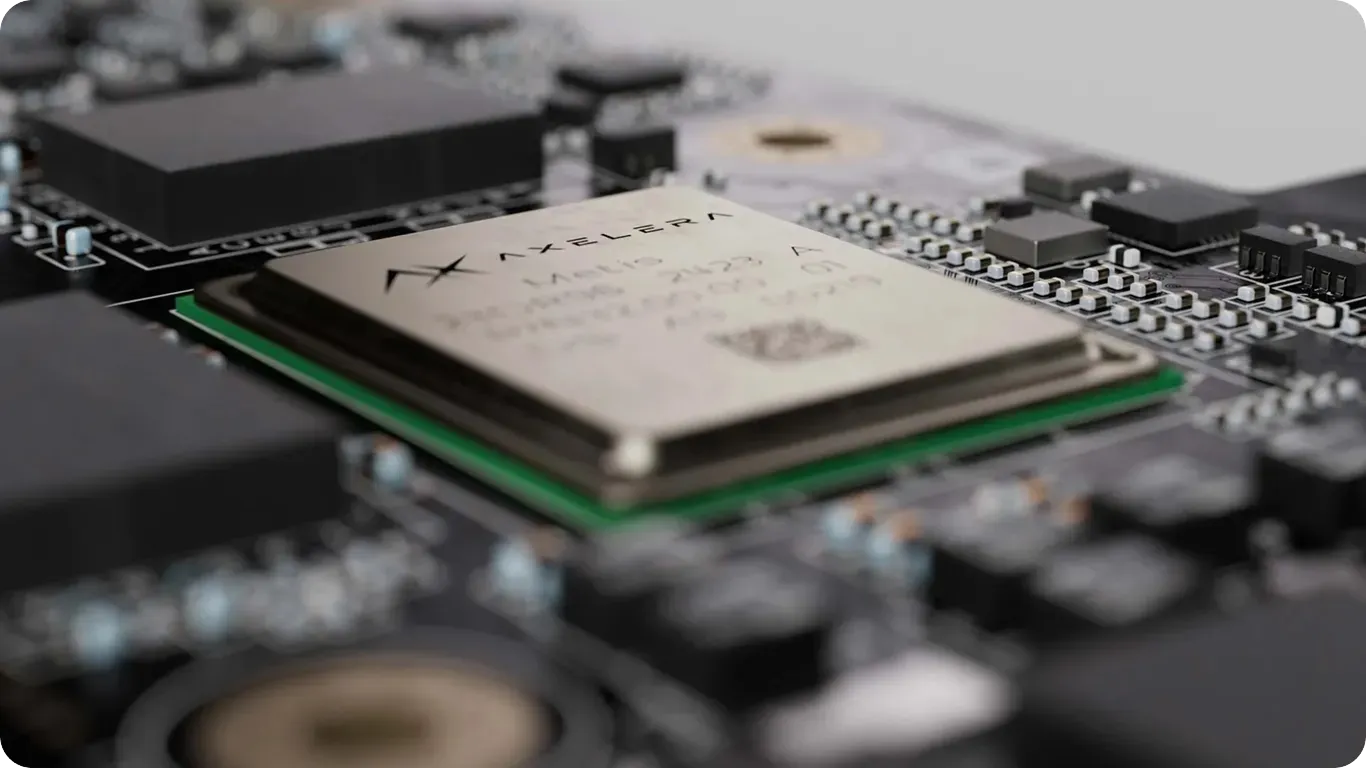

Axelera AI desarrolla hardware diseñado específicamente para acelerar la inferencia de IA en el borde. Un componente clave de este sistema es la Metis AIPU (unidad de procesamiento de IA), un procesador especializado creado para ejecutar redes neuronales de manera eficiente en dispositivos periféricos.

A diferencia de las unidades centrales de procesamiento (CPU) de uso general o incluso de las unidades de procesamiento gráfico (GPU), las AIPU están diseñadas para gestionar los patrones computacionales específicos de las cargas de trabajo de IA. Esto les permite ofrecer un alto rendimiento al tiempo que mantienen un bajo consumo energético, lo cual es fundamental en entornos periféricos, donde los recursos suelen ser limitados.

Lo que hace que el enfoque de Axelera AI sea especialmente innovador es su diseño «full-stack». Metis se ha diseñado con computación digital en memoria (D-IMC) y RISC-V para ofrecer un alto rendimiento con la eficiencia energética que exige la computación en el borde. Los cuatro núcleos de Metis se pueden programar de forma independiente, lo que significa que se pueden ejecutar cuatro modelos por chip en paralelo. Además del hardware, el SDK Voyager incluye un compilador y un entorno de ejecución que funcionan conjuntamente para optimizar los modelos de cara a su implementación.

Esto permite a los desarrolladores pasar de los modelos entrenados a la inferencia lista para producción de forma más eficiente. En concreto, las AIPU de Metis permiten ejecutar modelos avanzados de visión artificial, comoYOLO Ultralytics , directamente en dispositivos periféricos, desde entornos empresariales, minoristas, sanitarios y de fabricación hasta equipos agrícolas e industriales y satélites.

Python Ultralytics ofrece una interfaz unificada para entrenar, evaluar e implementar YOLO en una amplia gama de tareas de visión artificial. YOLO suelen desarrollarse y entrenarse con PyTorch, un entorno muy adecuado para la experimentación y el desarrollo de modelos.

Sin embargo, al implementar estos modelos en hardware periférico especializado, es necesario convertirlos a un formato optimizado para el dispositivo de destino. Aquí es donde entran en juego las integraciones de exportación compatibles con elPython Ultralytics .

Ultralytics una variedad de opciones de exportación que permiten convertir YOLO a diferentes formatos en función del destino de implementación, como ONNX, TensorRT y otros backends específicos para hardware. Estas integraciones simplifican el proceso de preparación de los modelos para aplicaciones en el mundo real, ya que se encargan de los pasos de optimización y conversión necesarios.

Partiendo de esta base, Ultralytics presentado una integración de exportación actualizada con Axelera AI, lo que permite exportar YOLO para su implementación en las AIPU de Metis.

Durante la exportación, el modelo se compila y se cuantifica en una representación optimizada diseñada específicamente para el hardware de Axelera. Este proceso genera un modelo compilado en formato «.axm», junto con los metadatos necesarios para su implementación e inferencia.

La integración es compatible con una amplia gama de tareas de visión artificial en Ultralytics YOLOv8, Ultralytics YOLO11y Ultralytics , incluyendo detección de objetos, estimación de poses, segmentación de instancias, detección de cajas delimitadoras orientadas (OBB) y clasificación de imágenes. Aunque la mayoría de las tareas son compatibles directamente a través del flujo de trabajo de exportación, la segmentación de YOLO26 se puede utilizar a través del «model zoo» con el SDK de Voyager.

Esta ampliación de la compatibilidad ofrece a los desarrolladores la flexibilidad necesaria para implementar diferentes tipos de modelos de visión en función de su aplicación, desde la detección de objetos en tiempo real hasta la interpretación de escenas, el seguimiento de movimientos y el análisis de datos visuales complejos.

Una vez exportados, los modelos se pueden implementar y ejecutar sin depender de PyTorch el momento de la inferencia. En su lugar, se ejecutan mediante el entorno de ejecución del SDK de Voyager, que permite crear flujos de trabajo de extremo a extremo para tareas como el procesamiento de vídeo, la detección en tiempo real y el seguimiento directamente en dispositivos periféricos.

Ahora que comprendemos mejor la nueva integración de exportación, veamos paso a paso cómo exportarYOLO Ultralytics a este formato personalizado y ejecutarlos en el hardware de Metis en el borde.

Para empezar, primero tendrás que instalar elPython Ultralytics . Este paquete ofrece una interfaz sencilla y coherente para entrenar, evaluar y exportar YOLO .

Puedes instalarlo con pip ejecutando el siguiente comando en tu terminal o en la línea de comandos:

pip install ultralytics

Si tienes algún problema durante la instalación o la exportación, la Ultralytics oficial Ultralytics y la guía de problemas comunes son recursos muy útiles para solucionarlos.

Para exportar y ejecutar modelos en el hardware de Axelera, también tendrás que instalar los controladores de Axelera y el SDK de Voyager. Este paso permite la comunicación con la AIPU Metis y proporciona las herramientas de tiempo de ejecución y compilación necesarias.

Los pasos que se indican a continuación deben realizarse en un entorno Linux con acceso al hardware Axelera AI Metis. Abre un terminal en tu sistema o utiliza una celda de Jupyter Notebook si estás ejecutando Jupyter Notebook en una configuración local compatible, y ejecuta los siguientes comandos.

Empieza añadiendo la clave del repositorio de Axelera de la siguiente manera:

sudo sh -c "curl -fsSL https://software.axelera.ai/artifactory/api/security/keypair/axelera/public | gpg --dearmor -o /etc/apt/keyrings/axelera.gpg"

A continuación, tal y como se muestra a continuación, añade el repositorio de Axelera a tu sistema:

sudo sh -c "echo 'deb [signed-by=/etc/apt/keyrings/axelera.gpg] https://software.axelera.ai/artifactory/axelera-apt-source/ ubuntu22 main' > /etc/apt/sources.list.d/axelera.list"

A continuación, instala el SDK de Voyager y carga el controlador Metis de la siguiente manera:

sudo apt update

sudo apt install -y metis-dkms=1.4.16

sudo modprobe metis

Una vez completados estos pasos, tu sistema estará listo para exportar y ejecutarYOLO Ultralytics YOLO en dispositivos Axelera AI Metis.

Una vez instalado el Ultralytics , puedes cargar tu YOLO y exportarlo como un paquete compilado para Metis. Este proceso convierte el modelo a un formato optimizado para su implementación en el hardware Axelera AI Metis.

En el siguiente ejemplo, utilizamos un modelo YOLO26 nano preentrenado y lo exportamos para Metis. El modelo exportado se guardará en un directorio denominado «/yolo26n_axelera_model».

from ultralytics YOLO

model = YOLO("yolo26n.pt")

model.export(format="axelera")

Una vez exportado el modelo, puedes cargarlo y ejecutar la inferencia en imágenes o secuencias de vídeo no vistas. Esto permite realizar tareas de visión artificial en tiempo real directamente en los dispositivos Axelera AI Metis.

Por ejemplo, el fragmento de código que aparece a continuación muestra cómo cargar el modelo exportado y ejecutar la inferencia en una URL de acceso público.

axelera_model = YOLO("yolo26n_axelera_model")

results = axelera_model("ultralytics", save=True)

En este caso, el modelo analiza la imagen de entrada y detecta objetos, guardando los resultados en el directoriodetect».

A continuación, analizaremos algunas aplicaciones habituales de IA en el borde en las queYOLO Ultralytics pueden implementarse en el hardware de Axelera AI en situaciones reales.

Las AIPU Metis de Axelera AI están diseñadas para una amplia gama de entornos de implementación, desde sistemas integrados y ordenadores industriales hasta robótica y servidores periféricos. Gracias a su capacidad de inferencia de alto rendimiento y bajo consumo, permiten que las aplicaciones de visión artificial se ejecuten directamente en el dispositivo en todos los sectores. El SDK Voyager también incluye un generador de flujos de trabajo para que los ingenieros de aprendizaje automático y de aplicaciones puedan convertir los modelos en productos listos para su uso en el borde.

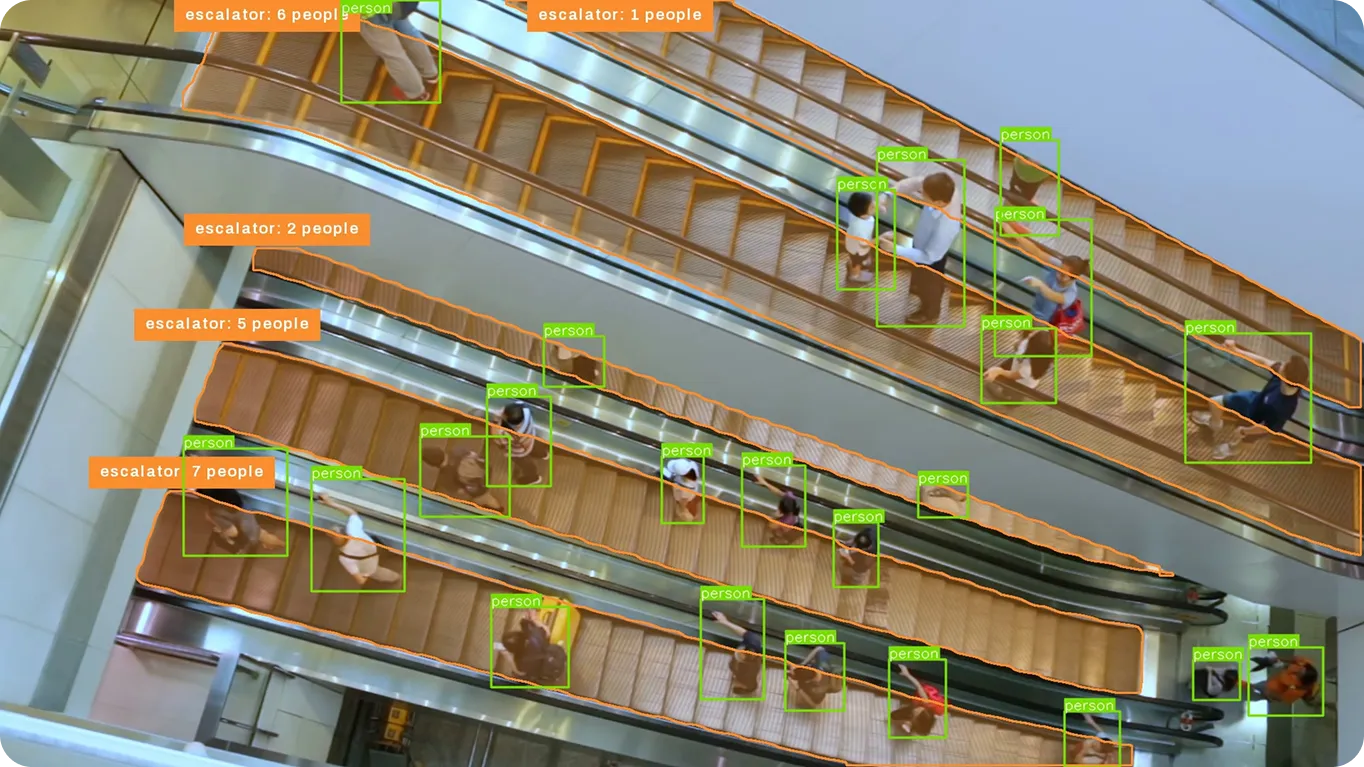

En el sector minorista, comprender el comportamiento de los clientes en tiempo real puede marcar una gran diferencia.

Gracias aYOLO Ultralytics , que se ejecutan en el hardware de Axelera AI, las tiendas pueden supervisar el tráfico peatonal, contar personas y analizar los patrones de movimiento dentro de la tienda en tiempo real. Dado que todo se ejecuta en el propio dispositivo, se pueden generar informes al instante sin necesidad de conexión a la nube, lo que ayuda a los equipos a reaccionar con mayor rapidez y a garantizar la privacidad de los datos.

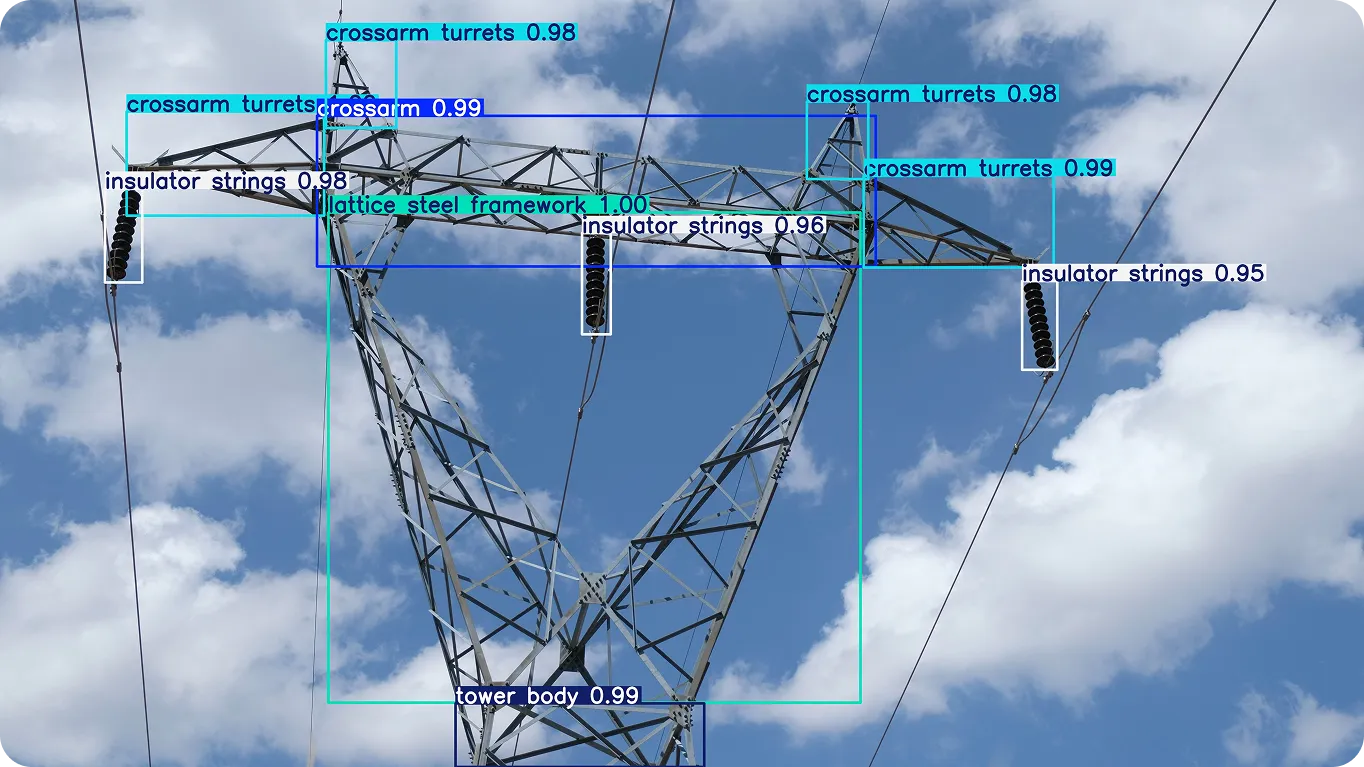

El mantenimiento de infraestructuras a gran escala, como las líneas eléctricas, es una tarea compleja que requiere muchos recursos. Estas redes suelen abarcar grandes distancias, lo que hace que las inspecciones sean laboriosas, costosas y potencialmente peligrosas. Cuando no se detectan las averías o los primeros signos de desgaste, pueden derivar en cortes de suministro, daños en los equipos o riesgos para la seguridad.

Los drones se utilizan cada vez más para mejorar la eficiencia de las inspecciones. Pueden cubrir largas distancias, acceder a zonas de difícil acceso y capturar imágenes de alta resolución de activos críticos.

La combinación de drones con IA en el borde mejora aún más estos flujos de trabajo.YOLO Ultralytics , que se ejecutan en el hardware de Axelera AI, permiten realizar análisis en tiempo real durante las inspecciones, identificando fallos, clasificando componentes y detectando anomalías in situ. Esto reduce la necesidad de revisiones manuales y permite una supervisión de la infraestructura más rápida y fiable.

En robótica, la velocidad y la capacidad de respuesta son fundamentales. Ya sea para desplazarse por un almacén o para trabajar en entornos industriales dinámicos, los robots deben interpretar su entorno al instante.

YOLO Ultralytics , que se ejecutan en el hardware de Axelera AI, permiten a los robots interpretar su entorno en tiempo real, desde la detección de obstáculos hasta el seguimiento de personas y la identificación de objetos. Esto permite que los sistemas se desplacen con mayor seguridad, se adapten a condiciones dinámicas y funcionen con mayor autonomía sin depender de una conexión constante a la nube.

Estas son algunas de las principales ventajas de implementarYOLO Ultralytics en el hardware Metis de Axelera AI mediante la nueva integración:

YOLO Ultralytics y las AIPU Metis de Axelera AI facilitan la implementación de la visión artificial de alto rendimiento en el borde. Al simplificar la implementación y optimizar los modelos para hardware especializado, esta integración contribuye a salvar la brecha entre el desarrollo y las aplicaciones del mundo real.

A medida que la IA en el borde sigue creciendo, disponer de opciones de implementación eficientes y escalables será fundamental para crear sistemas ágiles y fiables. Esta colaboración supone un paso adelante para que la IA de visión avanzada sea más accesible en todos los sectores.

¿Quiere obtener más información sobre la IA? Explore nuestro repositorio de GitHub, conéctese con nuestra comunidad y consulte nuestras opciones de licencia para impulsar su proyecto de visión artificial. Descubra cómo innovaciones como la IA en el comercio minorista y la visión artificial en la atención médica están dando forma al futuro.

Comience su viaje con el futuro del aprendizaje automático