Ultralytics YOLO26 vs YOLO11 vs YOLOv8 : lequel devrais-tu utiliser ?

Explore Ultralytics YOLO26, Ultralytics YOLO11 et Ultralytics YOLOv8 pour découvrir quel modèle de vision par ordinateur tu devrais choisir pour tes projets.

Les systèmes de computer vision de pointe, souvent basés sur des réseaux de neurones convolutifs (CNN), permettent aux machines d'analyser et d'interpréter des données visuelles provenant d'images et de vidéos, et sont désormais déployés dans une grande variété d'environnements.

De l'agriculture à la fabrication et au commerce de détail, ces systèmes fonctionnent dans divers environnements de déploiement, incluant les appareils en périphérie (edge), le matériel embarqué, les appareils de l'Internet des objets (IoT), le traitement sur appareil et les pipelines cloud à grande échelle qui prennent en charge les applications en temps réel.

En situation réelle, le déploiement de ces modèles n'est pas toujours simple. Ils doivent souvent fonctionner avec une puissance de calcul limitée, respecter des exigences strictes en matière de latence et passer à l'échelle sans augmenter considérablement les coûts. Ces contraintes font de la performance un problème multidimensionnel plutôt qu'une simple question de précision.

Bien que la précision soit toujours importante, il est tout aussi crucial qu'un modèle fonctionne efficacement en production. Des facteurs comme la vitesse, l'utilisation des ressources et l'évolutivité jouent un rôle majeur dans la performance d'un système sur le long terme.

Les modèles de vision par ordinateur comme les Ultralytics YOLO models ont évolué en gardant cet équilibre à l'esprit. Par exemple, Ultralytics YOLOv8 a établi une base solide et polyvalente, Ultralytics YOLO11 est allé plus loin avec une vitesse et une précision améliorées, et Ultralytics YOLO26 s'appuie sur ces acquis en étant plus léger, plus rapide et plus efficace que jamais.

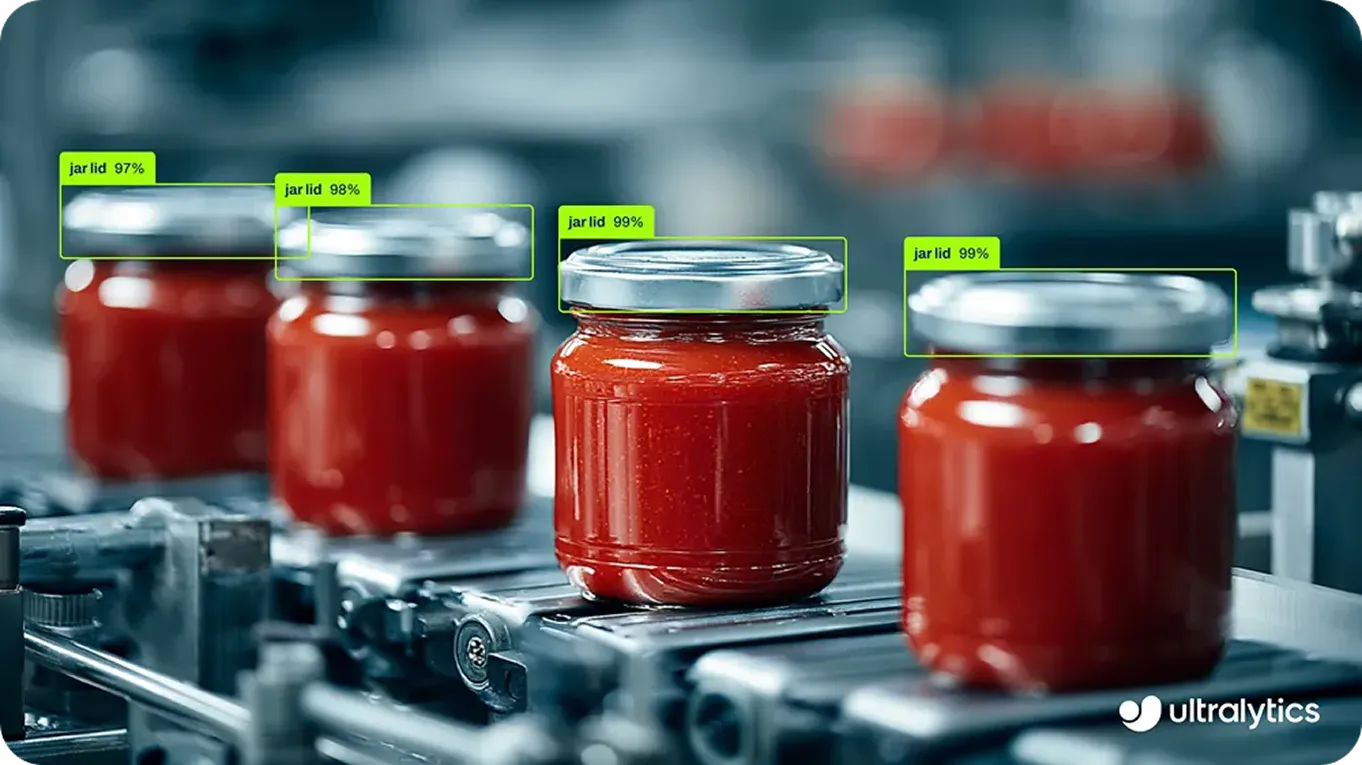

Fig 1. Utilisation de Ultralytics YOLO26 pour détecter des objets dans une image (Source)

Dans cet article, nous allons comparer Ultralytics YOLO26, YOLO11 et YOLOv8 pour t'aider à choisir le bon modèle pour ton projet de vision par ordinateur. Commençons !

Link to this sectionComprendre l'évolution des modèles Ultralytics YOLO#

Chaque itération des modèles Ultralytics YOLO a introduit des améliorations pour mieux répondre aux exigences du monde réel et rendre la vision par ordinateur plus accessible. Ces mises à jour ont rendu les modèles plus rapides, plus efficaces et plus faciles à déployer, soutenant ainsi la croissance de l'écosystème de l'IA visuelle.

Ils sont également basés sur PyTorch, ce qui les rend faciles à entraîner, à personnaliser et à intégrer dans des workflows d'apprentissage automatique intelligents. Prêts à l'emploi, les modèles Ultralytics YOLO sont disponibles en tant que modèles pré-entraînés, souvent entraînés sur des jeux de données comme COCO, permettant aux équipes de démarrer rapidement et de les affiner pour des cas d'utilisation spécifiques.

En plus de cela, le Ultralytics Python package simplifie le déploiement en offrant un support intégré pour l'exportation de modèles vers des formats comme ONNX et TensorRT. Cela facilite l'intégration des modèles sur différentes plateformes matérielles, des appareils en périphérie aux systèmes accélérés par GPU.

Link to this sectionPasser de Ultralytics YOLOv5 à Ultralytics YOLO26#

Le premier modèle Ultralytics YOLO, Ultralytics YOLOv5, est devenu très populaire pour ses capacités fiables de détection d'objets. Basé sur une approche de détection en une seule étape, il permettait des prédictions rapides en temps réel en un seul passage, ce qui le rendait parfaitement adapté aux workflows de production.

Des mises à jour ultérieures ont introduit des variantes sans ancres, où le modèle prédit directement les emplacements des objets au lieu d'utiliser des boîtes d'ancrage prédéfinies, rendant la détection plus flexible. Cependant, le modèle original restait principalement axé sur les tâches de détection d'objets.

En s'appuyant sur cette base, YOLOv8 a élargi la portée de la famille de modèles. Au lieu de se concentrer uniquement sur la détection d'objets, il a ajouté la prise en charge de multiples computer vision tasks telles que la segmentation d'instance, la classification d'images, l'estimation de pose et la détection par boîtes englobantes orientées (OBB). Il a également apporté des améliorations architecturales, notamment des conceptions de backbone et de neck avancées, qui ont amélioré l'extraction de caractéristiques et la performance globale de détection.

Au-delà, des variantes telles que YOLOv8n (Nano), YOLOv8s (Small), YOLOv8m (Medium), YOLOv8l (Large) et YOLOv8x (Extra Large) ont donné aux développeurs la flexibilité d'équilibrer vitesse, précision et utilisation des ressources en fonction de leurs besoins. Cette capacité étendue, combinée à sa facilité d'utilisation, en a fait un choix incontournable pour un large éventail d'applications visuelles.

Fig 2. Les modèles YOLO comme YOLOv8, YOLO11 et YOLO26 prennent en charge diverses tâches visuelles.

Par la suite, YOLO11 s'est concentré sur l'amélioration des performances dans les workflows réels, offrant une précision accrue ainsi que des vitesses d'inférence plus rapides. Avec une architecture plus légère, il fonctionne bien dans les environnements périphériques et cloud tout en étant compatible avec les pipelines YOLOv8 existants.

Le dernier ajout à la famille de modèles Ultralytics YOLO, YOLO26, est un modèle de pointe qui établit une nouvelle norme pour l'IA visuelle axée sur la périphérie, offrant une approche plus légère, plus rapide et plus efficace pour le déploiement réel. Il est conçu pour fonctionner efficacement sur CPU et systèmes embarqués tout en simplifiant le déploiement et en améliorant les performances en temps réel sur une large gamme d'applications.

Link to this sectionComparaison de YOLO26 vs YOLO11 vs YOLOv8#

Lorsque tu travailles sur des projets de vision par ordinateur, tu peux rencontrer différents modèles Ultralytics et te demander lequel est adapté à ton projet. Analysons comment YOLO26, YOLO11 et YOLOv8 se comparent dans des scénarios réels.

YOLOv8 a été publié en 2023 et a été largement utilisé par la communauté de la vision par ordinateur depuis. Son fort soutien communautaire et sa facilité d'utilisation en ont fait un modèle de référence pour de nombreuses équipes par le passé. Si tu recherches un modèle bien documenté avec une large gamme de tutoriels, de guides et de ressources communautaires, YOLOv8 est un excellent point de départ.

En 2024, YOLO11 a été introduit avec des améliorations en termes de performance et d'efficacité. Il offre une meilleure vitesse et précision par rapport à YOLOv8, tout en conservant une architecture plus petite et plus optimisée. C'est un modèle plus équilibré qui fonctionne de manière fiable en production sans augmenter significativement l'utilisation des ressources.

Cette année, YOLO26 a été publié en tant que dernière itération, se concentrant sur un déploiement efficace à grande échelle. Il offre une inférence CPU plus rapide et une meilleure utilisation des ressources, permettant aux équipes d'exécuter plus de charges de travail sur le même matériel.

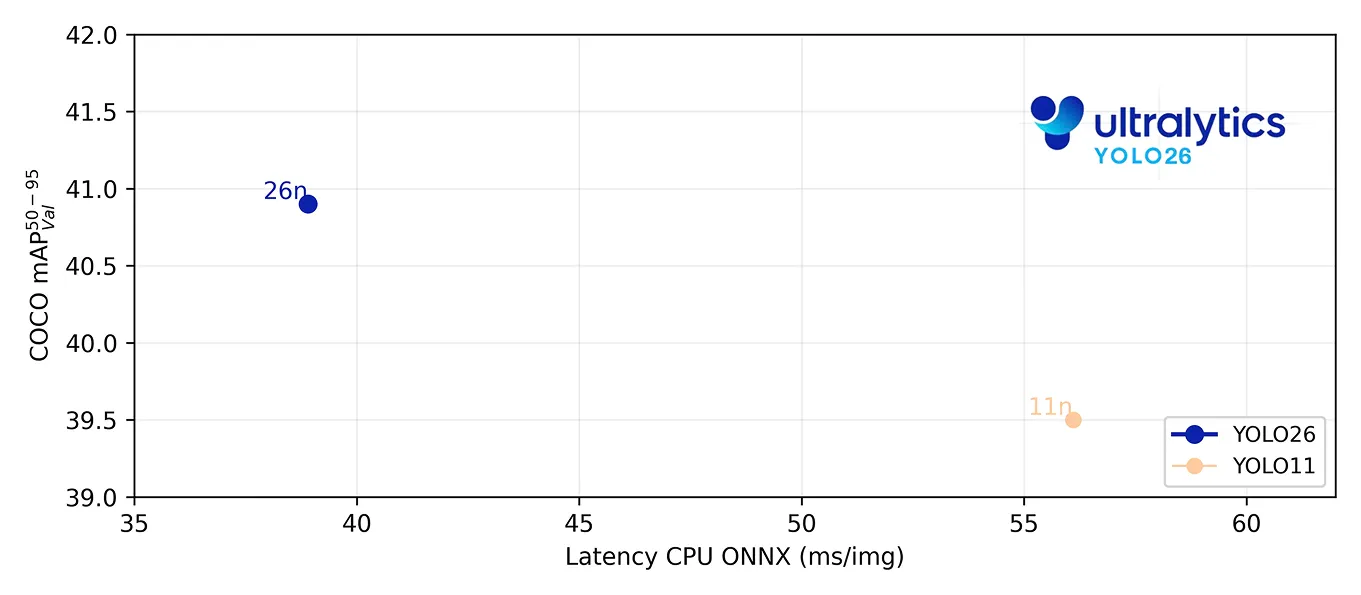

Par exemple, le modèle YOLO26 nano peut atteindre jusqu'à 43 % d'inférence plus rapide que YOLO11 sur les processeurs centraux (CPU), ce qui en fait une excellente option pour les environnements en périphérie et aux ressources limitées. C'est particulièrement vital car les configurations traditionnelles reposent souvent lourdement sur les unités de traitement graphique (GPU), qui peuvent être coûteuses et plus difficiles à mettre à l'échelle.

Fig 3. Benchmarking de la performance de YOLO26 sur CPU (Source)

Dans l'ensemble, YOLO26 est un choix solide pour les équipes et les individus cherchant à optimiser les compromis entre performance, coût et évolutivité.

Link to this sectionUn examen plus approfondi de Ultralytics YOLO26#

YOLO26 est un modèle de pointe conçu pour un déploiement réel, où l'efficacité, la vitesse et l'évolutivité comptent autant que la précision. Au lieu de se concentrer uniquement sur l'amélioration des performances de référence, il introduit des changements architecturaux et d'entraînement qui rendent les modèles plus faciles à exécuter, plus rapides à déployer et plus fiables dans différents environnements matériels.

Ces améliorations sont particulièrement importantes pour les systèmes en périphérie et de production, où une puissance de calcul limitée, des contraintes de latence et des considérations de coût jouent un rôle clé. En simplifiant l'inférence et en optimisant les performances, YOLO26 permet aux passionnés d'IA de créer et de mettre à l'échelle des applications visuelles plus efficacement.

Voici un aperçu de quelques-unes des caractéristiques clés de YOLO26 :

- Inférence end-to-end sans NMS : L'un des changements cruciaux est sa conception sans suppression des non-maximums (NMS), qui élimine le besoin de post-traitement. En termes simples, le modèle produit directement des prédictions finales. En conséquence, la latence devient plus prévisible et le déploiement devient plus facile.

- Suppression du DFL : YOLO26 abandonne le module Distribution Focal Loss (DFL) au profit d'une approche de prédiction de boîte englobante plus simple. Ce changement s'aligne avec sa conception end-to-end sans NMS, réduisant la complexité du pipeline et améliorant la cohérence du déploiement.

- Optimiseur MuSGD : Les derniers modèles Ultralytics YOLO introduisent MuSGD, un optimiseur hybride qui combine la descente de gradient stochastique (SGD) avec des mises à jour inspirées de Muon. Cela améliore la stabilité et la convergence de l'entraînement, conduisant à une optimisation plus fluide et un comportement plus cohérent entre les différentes tailles de modèles.

- ProgLoss et STAL : Ces innovations d'entraînement, le Progressive Loss Balancing (ProgLoss) et le Small-Target-Aware Label Assignment (STAL), rendent le modèle plus stable et fiable. ProgLoss aide le modèle à apprendre des jeux de données par étapes au fil du temps, tandis que STAL garantit que les petits objets ne sont pas ignorés pendant l'entraînement, améliorant la détection dans les scènes complexes.

Link to this sectionPrécision vs efficacité : Au-delà des benchmarks, vers une performance réelle#

Pour mettre les différences entre YOLO26, YOLO11 et YOLOv8 en contexte, comprenons mieux les facteurs qui influencent la performance du modèle dans le monde réel.

La précision, souvent mesurée par des métriques comme la précision moyenne (mAP), est depuis longtemps un moyen important d'évaluer les modèles de vision par ordinateur. Elle montre comment un modèle fonctionne dans des conditions normalisées et est utile pour comparer différentes versions.

Cependant, une fois que les modèles passent du test au déploiement réel, la précision seule ne suffit pas. La performance en production dépend de facteurs comme la taille du modèle, le temps d'inférence ou la latence, l'utilisation des ressources de calcul et la capacité d'un système à s'adapter à différents environnements.

Contrairement aux benchmarks contrôlés, les environnements réels sont souvent imprévisibles. Les conditions d'éclairage peuvent changer, les objets peuvent être partiellement visibles et les données d'entrée peuvent varier considérablement par rapport à ce sur quoi le modèle a été entraîné. Ces variations peuvent affecter la cohérence des performances d'un modèle en pratique.

Fig 4. Un exemple de YOLO26 utilisé dans un environnement imprévisible, comme un chantier de construction.

Par exemple, considère une configuration avec des centaines de caméras dans une ville intelligente, un magasin de détail ou un entrepôt. Chaque flux doit être traité en temps réel, nécessitant souvent des fréquences d'images constantes (images par seconde, ou FPS) pour éviter les retards ou la perte d'images.

Un modèle moins efficace peut gérer moins de flux simultanés sur un système donné, ce qui signifie que la mise à l'échelle nécessite généralement du matériel supplémentaire et augmente les coûts d'infrastructure.

Des modèles plus efficaces, comme YOLO26, peuvent traiter davantage de flux sur le même matériel, tirant un meilleur parti des ressources disponibles. Cela améliore l'efficacité globale du système et facilite la mise à l'échelle des déploiements au fil du temps.

Pour approfondir YOLO26 vs YOLO11 vs YOLOv8, consulte la documentation officielle Ultralytics.

Link to this sectionPoints clés#

La série de modèles Ultralytics YOLO a évolué pour mieux correspondre aux besoins de déploiement réels. Chaque version s'appuie sur la précédente, avec une attention croissante portée à l'efficacité, l'évolutivité et la facilité de déploiement. En d'autres termes, si tu construis une application de détection en temps réel qui doit fonctionner de manière fiable à grande échelle, Ultralytics YOLO26 est un choix parfait.

Tu souhaites intégrer l'IA visuelle dans tes opérations ? Consulte nos options de licence. Tu peux également visiter nos pages de solutions pour voir comment l'AI in manufacturing transforme les usines et comment la vision AI in robotics façonne l'avenir. Rejoins notre communauté grandissante et explore notre dépôt GitHub pour des ressources en IA.