Ultralytics YOLO26 frente a otros modelos Ultralytics YOLO para estimación de poses

Descubre cómo Ultralytics YOLO26 mejora la estimación de poses con mayor soporte para puntos clave no humanos, una convergencia más rápida, un mejor manejo de oclusiones y un despliegue eficiente en tiempo real.

Cuando observas la postura de alguien, es fácil notar si está encorvado, inclinado hacia delante o de pie con rectitud. Los humanos podemos entender rápidamente cómo se relacionan entre sí las diferentes partes del cuerpo.

Es una parte inherente de cómo interpretamos el movimiento y el lenguaje corporal en la vida cotidiana. Para las máquinas, sin embargo, este tipo de comprensión visual no es automática. Enseñar a un sistema a reconocer el movimiento y la estructura requiere técnicas avanzadas de aprendizaje profundo y visión artificial que le permitan interpretar las imágenes de forma significativa.

En particular, la estimación de poses es una técnica de IA de visión que hace posible que un modelo de visión artificial construya una comprensión similar. En lugar de limitarse a detectar un objeto en una imagen, el modelo predice puntos clave que representan hitos estructurales importantes.

Estos puntos clave podrían corresponder a articulaciones corporales, extremidades de animales, componentes de maquinaria o incluso puntos fijos como las esquinas de una pista. Al identificar y rastrear estos puntos, el sistema puede entender la posición, la alineación y el movimiento de forma estructurada y medible.

A medida que la estimación de poses se aplica a más escenarios del mundo real, los modelos deben manejar puntos clave no humanos, escenas complejas y conjuntos de datos personalizados de manera más eficaz. Por ejemplo, modelos de vanguardia como Ultralytics YOLO26 soportan tareas de visión artificial como la estimación de poses y se basan en modelos de pose YOLO anteriores con mejoras arquitectónicas y de entrenamiento diseñadas para aumentar la flexibilidad y el rendimiento general.

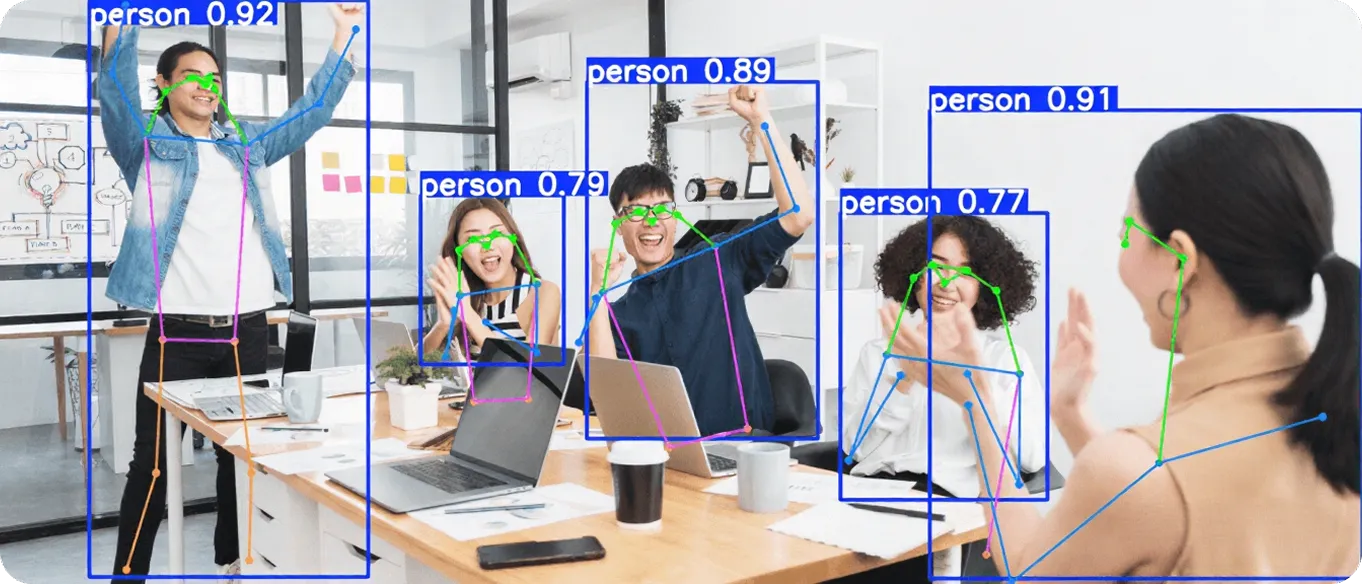

Fig 1. Un ejemplo de estimación de poses habilitado por YOLO (Fuente)

En este artículo, compararemos YOLO26-pose con modelos de pose YOLO anteriores de Ultralytics y exploraremos cómo mejora la flexibilidad, la velocidad de convergencia y el rendimiento en escenas complejas. ¡Empecemos!

Link to this section¿Qué es la estimación de poses?#

Antes de sumergirnos en la comparación de modelos de pose de Ultralytics YOLO, echemos un vistazo más de cerca a lo que significa realmente la estimación de poses en el contexto de la visión artificial.

La estimación de poses es una técnica utilizada para detectar y rastrear puntos clave específicos en una imagen o fotograma de vídeo. Estos puntos clave pueden representar hitos estructurales importantes, como las articulaciones de un cuerpo humano, las extremidades de un animal, los componentes de una máquina o puntos de referencia fijos en una escena.

Fig 2. Estimación de la pose de trabajadores usando estimación de pose humana (Fuente)

Al identificar las coordenadas de estos puntos, un modelo puede entender cómo está posicionado un objeto y cómo se mueve con el tiempo. A diferencia de la clasificación de imágenes, que asigna una etiqueta única a toda una imagen, o de los modelos de detección de objetos, que se centran en dibujar cajas delimitadoras alrededor de los objetos, la estimación de poses proporciona información espacial más detallada sobre la estructura y el movimiento.

Link to this sectionUna visión general de YOLO26-pose#

YOLO26-pose está disponible en múltiples variantes o tamaños de modelo, incluyendo opciones ligeras como YOLO26n-pose y modelos más grandes como YOLO26m-pose, YOLO26l-pose y YOLO26x-pose. Esto permite a los equipos elegir el equilibrio adecuado entre velocidad y precisión según sus necesidades de hardware y rendimiento.

Ultralytics también proporciona modelos de pose preentrenados en conjuntos de datos grandes y generales como el conjunto de datos COCO, específicamente las anotaciones COCO-Pose (puntos clave COCO) para la estimación de pose humana, para que no tengas que empezar desde cero. En la mayoría de los casos, los equipos ajustan estos modelos en su propio conjunto de datos para adaptarlos a puntos clave, diseños o entornos específicos.

Esto suele implicar la preparación de archivos de anotación personalizados que definen las coordenadas de los puntos clave y las etiquetas de clase en un formato estructurado. Estas anotaciones asignan puntos clave a coordenadas de píxeles específicas dentro de cada imagen, permitiendo al modelo aprender relaciones espaciales precisas durante el entrenamiento.

El uso de modelos preentrenados hace que el entrenamiento sea más rápido, reduce los requisitos de datos y ayuda a poner los proyectos en producción de manera más eficiente.

Link to this sectionAplicaciones en el mundo real de la estimación de pose humana#

Aquí tienes un vistazo de algunos casos de uso en el mundo real donde la estimación de poses juega un papel importante:

- Atención sanitaria y rehabilitación: Los clínicos pueden utilizar modelos de pose para evaluar la postura, controlar el progreso de la recuperación y analizar patrones de movimiento durante la fisioterapia.

- Sistemas autónomos: Los drones y las cámaras inteligentes pueden utilizar la información de pose para entender mejor la orientación y el movimiento de los objetos en escenas dinámicas.

- Seguridad en el lugar de trabajo: Las organizaciones pueden supervisar el posicionamiento corporal y los movimientos repetitivos para ayudar a identificar posibles riesgos de seguridad.

- Fitness y entrenamiento personal: Las apps de fitness utilizan la estimación de poses para realizar un seguimiento de la forma de ejercicio, contar repeticiones y proporcionar información en tiempo real sobre la postura y el movimiento mantenido durante los tutoriales de fitness.

Fig 3. La estimación de poses puede ayudar a rastrear puntos clave del cuerpo durante el movimiento atlético. (Fuente)

Link to this sectionExplorando el soporte de Ultralytics YOLO26 para la estimación de poses#

Ultralytics YOLO26 se basa en modelos anteriores de Ultralytics YOLO con actualizaciones diseñadas para hacer que el entrenamiento y la implementación sean más prácticos.

Al igual que las versiones anteriores, admite la estimación de poses como parte de un marco unificado. La principal diferencia es que YOLO26 está diseñado para ser más flexible y estable en una gama más amplia de casos de uso del mundo real.

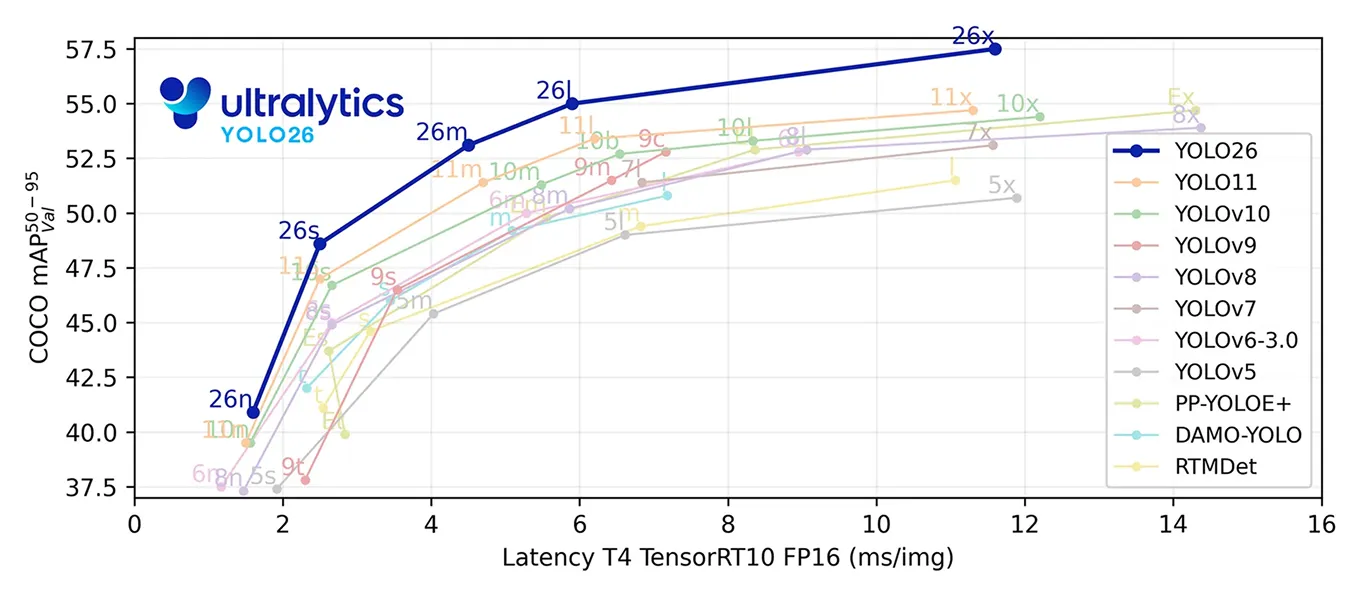

Fig 4. Benchmarking de YOLO26 (Fuente)

Los modelos de pose de Ultralytics YOLO anteriores estaban influenciados en gran medida por conjuntos de datos de pose humanos, lo que significaba que partes de los métodos antiguos estaban optimizadas en torno a las estructuras de las articulaciones humanas. YOLO26 elimina esas suposiciones específicas de los humanos.

Como resultado, es más adecuado para puntos clave no humanos, como la detección de las esquinas de una pista de tenis u otros puntos de referencia estructurales personalizados. Esto es importante porque, de entrada, los modelos preentrenados YOLO26-pose se entrenan con conjuntos de datos como COCO-pose y predicen puntos clave humanos definidos en las anotaciones del conjunto de datos.

Sin embargo, cuando los equipos quieren detectar diferentes tipos de puntos de referencia, como componentes de maquinaria, marcadores de campos deportivos o puntos de infraestructura, el modelo suele tener que ajustarse en un conjunto de datos personalizado donde esos puntos clave específicos estén anotados.

Dado que YOLO26 no está ligado a suposiciones sobre las estructuras articulares humanas, puede adaptarse con mayor eficacia durante el ajuste. Esta flexibilidad permite al modelo aprender diseños de puntos clave personalizados de manera más fiable, lo que conduce a mejores métricas de evaluación al validar en conjuntos de datos con configuraciones de puntos clave únicas.

YOLO26-pose también está diseñado para mejorar la localización de puntos clave cuando partes de un objeto están parcialmente ocultas o aparecen a una escala muy pequeña. En escenas del mundo real que involucran sujetos distantes, imágenes de drones o escenarios de objetos pequeños, esto puede conducir a predicciones de puntos clave más precisas en comparación con los modelos de pose anteriores.

Otra actualización importante es la formulación de pérdida mejorada utilizada durante el entrenamiento. La función de pérdida determina cómo corrige el modelo sus errores mientras aprende.

Cuando se trata de YOLO26-pose, este proceso es más eficaz, lo que ayuda al modelo a aprender más rápido y alcanzar una gran precisión en menos épocas, donde una época se refiere a una pasada completa a través del conjunto de datos de entrenamiento.

En general, YOLO26-pose se basa en los modelos de pose Ultralytics YOLO anteriores con mejoras más claras en el soporte de puntos clave no humanos y la convergencia del entrenamiento, manteniendo el mismo flujo de trabajo familiar.

Link to this sectionComparación de YOLO26-pose con Ultralytics YOLOv5#

La primera versión de los modelos de Ultralytics YOLO, Ultralytics YOLOv5, fue construida principalmente para la detección de objetos. Aunque YOLOv5 se expandió más tarde para soportar la segmentación de instancias, no incluye una cabecera de estimación de pose nativa y especializada dentro del marco oficial de Ultralytics.

Los equipos que necesitaban detección de puntos clave solían depender de implementaciones separadas o modificaciones personalizadas. Ultralytics YOLO26 incluye la estimación de pose como una tarea integrada, con una cabecera arquitectónica dedicada diseñada específicamente para predecir puntos clave.

Esto significa que los modelos YOLO26-pose pueden entrenarse, validarse e implementarse dentro del mismo flujo de trabajo unificado que la detección y la segmentación. Para proyectos centrados en la detección estructurada de puntos clave, YOLO26 proporciona soporte de pose nativo y una arquitectura específica para la tarea que YOLOv5 no ofrece de forma estándar.

Link to this sectionDiferencias clave: YOLO26-pose frente a Ultralytics YOLOv8-pose#

Ultralytics YOLOv8 introdujo la estimación de pose nativa dentro del marco unificado de Ultralytics, facilitando el entrenamiento y la implementación de modelos de puntos clave mediante el mismo flujo de trabajo que la detección y la segmentación. Se basa en una tubería de posprocesamiento tradicional con supresión no máxima (NMS) y utiliza formulaciones de pérdida anteriores para la regresión de cajas delimitadoras y el entrenamiento.

YOLO26 se basa en esta base con actualizaciones arquitectónicas y de entrenamiento que afectan directamente a la estimación de pose. Una diferencia importante es el diseño de extremo a extremo. YOLO26 elimina la necesidad de NMS externo durante la inferencia, lo que simplifica la implementación y mejora la consistencia de la latencia, especialmente en CPUs y dispositivos de borde.

Otra mejora clave está en la metodología de entrenamiento. YOLO26 introduce el optimizador MuSGD junto con estrategias de pérdida actualizadas. Para las tareas de pose, integra la estimación de verosimilitud logarítmica residual, que mejora cómo se modela la incertidumbre de los puntos clave. Juntos, estos cambios pueden conducir a una convergencia más rápida y a predicciones de puntos clave más estables, particularmente en escenas complejas o parcialmente ocluidas.

En resumen, YOLOv8-pose estableció una línea base sólida y versátil. YOLO26-pose refina esa base con una mayor eficiencia de entrenamiento, un mejor manejo de la oclusión y una mayor flexibilidad para aplicaciones de pose no humanas en el mundo real.

Link to this sectionYOLO26-pose frente a Ultralytics YOLO11-pose: ¿Qué ha mejorado?#

Ultralytics YOLO11 se basa en Ultralytics YOLOv8 refinando las capas de columna vertebral y extracción de características. Redujo los FLOPs, mejoró la eficiencia de los parámetros y ofreció un mAP más alto manteniendo un fuerte rendimiento en tiempo real. Para las tareas de pose, esto significó una mejor precisión de los puntos clave con una arquitectura más ligera.

YOLO26-pose continúa esa progresión con un cambio arquitectónico más fundamental. En pocas palabras, YOLO11 refinó la eficiencia y precisión de YOLOv8, y YOLO26 se basa en esa base con actualizaciones arquitectónicas y de entrenamiento destinadas a una convergencia más rápida, una inferencia más estable y una mejor precisión de pose en escenarios complejos.

Link to this section¿Por qué deberías empezar a usar el modelo YOLO26 para la estimación de poses?#

Mientras exploras las diferencias entre los modelos Ultralytics YOLO, es posible que te preguntes si debes cambiar a YOLO26-pose.

La respuesta corta es que es una actualización sencilla. Si ya estás utilizando Ultralytics YOLOv8-pose o Ultralytics YOLO11-pose, cambiar a YOLO26-pose normalmente solo significa cambiar la versión del modelo, no reconstruir tu flujo de trabajo.

Puedes beneficiarte de un mejor soporte para puntos clave no humanos, una convergencia más rápida durante el entrenamiento y un mejor manejo de los puntos ocluidos, todo ello mientras te mantienes en el mismo marco de trabajo de Ultralytics. Para la mayoría de los proyectos de pose nuevos y existentes, pasar a YOLO26-pose es una forma directa de obtener esas mejoras con la mínima fricción.

Además de esto, YOLO26-pose es totalmente compatible dentro del paquete Python de Ultralytics, que está construido sobre PyTorch y hace que el entrenamiento, la validación y la implementación sean sencillos. Los modelos se pueden exportar a formatos como ONNX, TensorRT, OpenVINO, CoreML y TFLite, lo que facilita la implementación en GPUs, CPUs y dispositivos de borde sin cambiar tu flujo de trabajo general.

Link to this sectionConclusiones clave#

Ultralytics YOLO26-pose hace que la estimación de poses sea más flexible y fiable, especialmente cuando se trabaja con puntos clave no humanos o escenas complejas. Se entrena más rápido, maneja mejor la oclusión y ofrece resultados más consistentes en diferentes conjuntos de datos. Para los equipos que ya utilizan modelos de pose de Ultralytics YOLO, YOLO26 ofrece mejoras claras sin cambiar los flujos de trabajo existentes.

¿Quieres saber más sobre IA? Consulta nuestra comunidad y nuestro repositorio de GitHub. Explora nuestras páginas de soluciones para aprender sobre IA en robótica y visión artificial en agricultura. ¡Descubre nuestras opciones de licencia y empieza hoy mismo a construir con visión artificial!