Cómo elegir una GPU en la nube para el entrenamiento de IA visual en la Plataforma Ultralytics

Aprende a elegir la GPU en la nube adecuada para el entrenamiento de visión artificial en la Plataforma Ultralytics basándote en factores como el tamaño del conjunto de datos, la complejidad del modelo y el coste.

El mes pasado presentamos Ultralytics Platform, un entorno integral diseñado para optimizar todo el flujo de trabajo de visión artificial, desde la gestión de datasets hasta el entrenamiento y despliegue de modelos. Ultralytics Platform reúne todo lo necesario para crear y escalar modelos de IA de visión en una experiencia única y unificada.

Una parte clave de este flujo de trabajo es el entrenamiento de modelos, donde las redes neuronales aprenden patrones a partir de datos para hacer predicciones precisas, y el acceso a los recursos de computación adecuados desempeña un papel crucial. Anteriormente, analizamos cómo Ultralytics Platform admite el entrenamiento de modelos mediante unidades de procesamiento gráfico (GPU) en la nube, lo que permite a los usuarios entrenar modelos de visión artificial sin gestionar infraestructura local.

Gracias al acceso bajo demanda a potentes GPUs de NVIDIA, usuarios que van desde estudiantes y startups hasta investigadores y grandes organizaciones pueden ejecutar cargas de trabajo de IA de forma más eficiente que nunca. Aunque empezar con el entrenamiento en la nube es sencillo, elegir la GPU adecuada implica considerar factores como el tamaño del dataset, la complejidad del modelo y el coste.

Con la amplia gama de opciones disponibles hoy en día, desde GPUs RTX rentables hasta el hardware de alto rendimiento NVIDIA H100 y la próxima generación Blackwell, seleccionar la configuración correcta puede afectar significativamente tanto al desarrollo del modelo como al coste.

En este artículo, analizaremos el entrenamiento con GPU en la nube para visión artificial en Ultralytics Platform y cómo elegir el hardware adecuado para tu carga de trabajo. ¡Empecemos!

Una visión general del entrenamiento en la nube en Ultralytics Platform

Antes de profundizar en cómo seleccionar una GPU para el entrenamiento en la nube en Ultralytics Platform, demos un paso atrás y veamos cómo funciona el entrenamiento en la nube.

¿Qué es el entrenamiento con GPU en la nube?

El entrenamiento con GPU en la nube consiste en utilizar GPUs alojadas en un entorno de computación en la nube para entrenar modelos de aprendizaje automático y aprendizaje profundo, en lugar de depender de tu propio hardware local o estación de trabajo. En Ultralytics Platform, esto te permite acceder a potentes GPUs bajo demanda y ejecutar trabajos de entrenamiento de forma remota, sin necesidad de tener tu propia configuración.

Esto facilita la escalabilidad de tus recursos en función de tu carga de trabajo. Puedes elegir GPUs más potentes o aumentar la capacidad según sea necesario, sin estar limitado por las capacidades de tu sistema. Puedes pensar en ello como acceder a máquinas potentes, o nodos, en centros de datos remotos, donde puedes aumentar o reducir la escala según sea necesario.

También elimina la necesidad de configurar y mantener hardware costoso. No tienes que comprar GPUs, instalar controladores ni lidiar con problemas de compatibilidad.

Ultralytics Platform gestiona todo a través de servicios en la nube administrados, desde el aprovisionamiento de recursos hasta la configuración del entorno, la orquestación y la ejecución de trabajos de entrenamiento, para que puedas centrarte en entrenar, experimentar y mejorar tus modelos.

Cómo funciona el entrenamiento de modelos en Ultralytics Platform

En Ultralytics Platform, el flujo de trabajo de entrenamiento acelerado por GPU es directo. Puedes empezar incorporando tu dataset de varias formas.

Puedes subir tus propios datos, utilizar datasets públicos disponibles en la plataforma o clonar datasets compartidos por la comunidad para aprovechar el trabajo existente. Clonar un dataset crea una copia en tu espacio de trabajo, lo que te permite editarlo y ampliarlo mientras mantienes el original sin cambios.

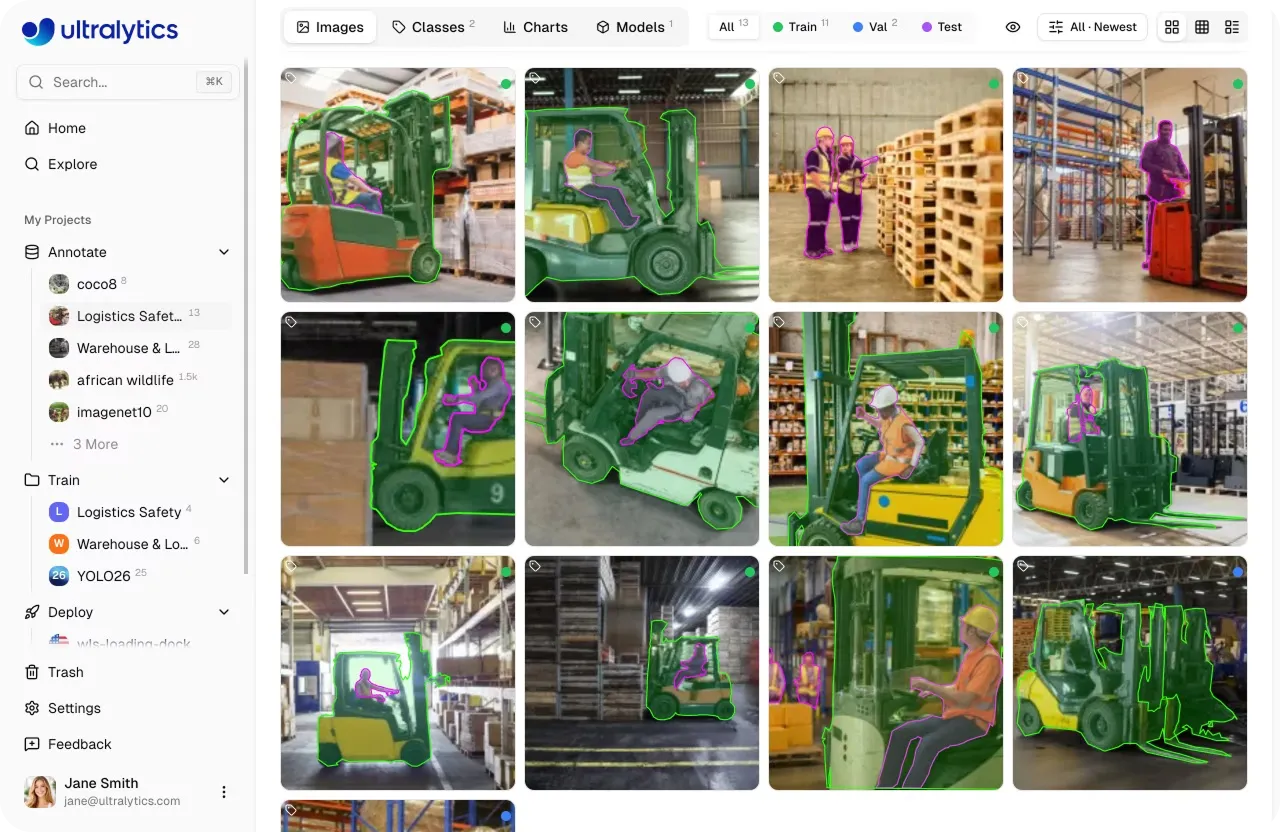

Una vez que hayas seleccionado un dataset, puedes revisar y organizar tus imágenes y anotaciones para asegurarte de que todo esté correctamente estructurado. La plataforma también incluye herramientas de anotación integradas, que te permiten etiquetar datos para tareas como detección de objetos, segmentación y clasificación, o acelerar el proceso con funciones asistidas por IA.

Fig 1. Visualización de un dataset dentro de Ultralytics Platform (Fuente)

A continuación, puedes seleccionar o crear un proyecto para gestionar tus ejecuciones de entrenamiento. Los proyectos te ayudan a organizar y comparar modelos, realizar un seguimiento de las métricas de rendimiento y mantener los experimentos relacionados en un solo lugar.

Desde ahí, puedes pasar al entrenamiento en la nube, donde eliges un modelo, configuras los parámetros y seleccionas una GPU según tus necesidades de rendimiento y presupuesto. La plataforma gestiona la infraestructura en la nube subyacente por ti.

Aprovisiona la instancia de GPU seleccionada, prepara tu dataset y ejecuta el trabajo de entrenamiento en la nube. A medida que avanza el entrenamiento, puedes supervisar las métricas, los registros y el rendimiento del sistema en tiempo real, sin necesidad de gestionar la configuración, los entornos CUDA, frameworks como PyTorch o TensorFlow, ni el hardware.

Características clave del entrenamiento con GPU en Ultralytics Platform

Aquí tienes algunas características clave del entrenamiento con GPU en la nube en Ultralytics Platform:

- Entrenamiento con un clic: Inicia trabajos de entrenamiento con una configuración mínima y pasa rápidamente del dataset al entrenamiento del modelo sin configuraciones complejas.

- GPUs bajo demanda: Elige entre una gama de opciones de GPU según tus necesidades y escala los recursos según sea necesario sin compromisos a largo plazo.

- Supervisión en tiempo real: Realiza un seguimiento del progreso del entrenamiento con gráficos y registros en vivo, y visualiza métricas del sistema como el uso de GPU y la memoria en tiempo real.

- Puntos de control automáticos: El progreso del entrenamiento se guarda a intervalos regulares, lo que facilita reanudar o recuperar el trabajo si es necesario.

- Despliegue sencillo: Una vez completado el entrenamiento, puedes desplegar tus modelos entrenados y utilizarlos en aplicaciones o flujos de trabajo a través de APIs de inferencia compartidas, endpoints dedicados o exportándolos para su uso en sistemas externos. Estas opciones de despliegue permiten una inferencia de baja latencia, lo que hace posible potenciar aplicaciones en tiempo real como análisis de vídeo, sistemas de automatización y soluciones de IA interactivas.

Diferentes opciones de GPU en la nube dentro de Ultralytics Platform

Ahora que hemos visto cómo funciona el entrenamiento en la plataforma, veamos las diferentes opciones de GPU disponibles. La GPU que elijas puede afectar a la velocidad de entrenamiento de tu modelo, a su rendimiento y a su coste.

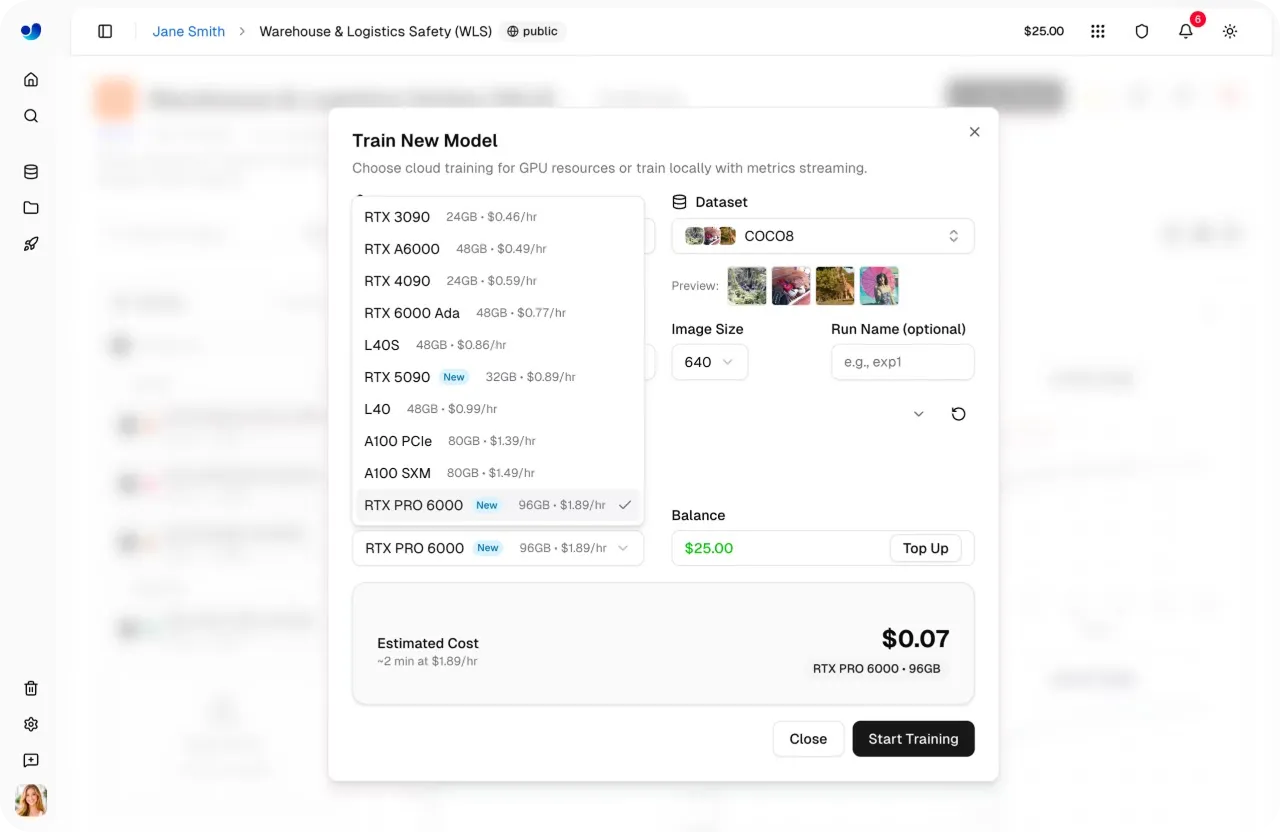

Ultralytics Platform ofrece una amplia gama de GPUs, empezando por opciones como la RTX 2000 Ada y la RTX A4500, pasando por GPUs como la RTX 4000 Ada, RTX A5000, RTX 3090 y RTX A6000, y llegando a opciones más potentes como la RTX 4090 y la RTX PRO 6000.

Fig 2. Un ejemplo de las diferentes opciones de GPU compatibles con Ultralytics Platform (Fuente)

Para la mayoría de los usuarios, la RTX PRO 6000 es una opción predeterminada equilibrada. Ofrece un rendimiento fiable en una gran variedad de cargas de trabajo sin necesidad de realizar muchos ajustes. La RTX 4090 es otra opción popular, que ofrece un gran rendimiento para su precio.

Para tareas más pequeñas como experimentos rápidos, creación de prototipos o trabajo con datasets ligeros, las GPUs como la RTX 2000 Ada y la RTX A4500 son un buen punto de partida. A medida que tu carga de trabajo crece, opciones como la RTX 4000 Ada, la RTX A5000 y la RTX 3090 proporcionan un rendimiento más consistente para el entrenamiento general.

En la gama alta, las GPUs como la A100 (Ampere), H100 y H200 (Hopper), y B200 (Blackwell) están diseñadas para cargas de trabajo a gran escala. Son las más adecuadas para entrenar modelos muy grandes, manejar datasets masivos o ejecutar trabajos donde la velocidad y el rendimiento son críticos.

Comprensión de los diferentes tipos de GPU y sus casos de uso

A continuación, veamos cómo se comparan los diferentes tipos de GPU y dónde encajan mejor.

Las GPUs RTX de NVIDIA son generalmente más rentables y se utilizan comúnmente para el entrenamiento diario, la experimentación y las cargas de trabajo pequeñas a medianas. Ofrecen un equilibrio entre rendimiento y accesibilidad, lo que las hace adecuadas para una amplia gama de casos de uso.

En comparación, las GPUs como la A100, A40 y L40 están diseñadas para cargas de trabajo más pesadas y entrenamiento a mayor escala. Proporcionan mayor estabilidad y escalabilidad, especialmente cuando se trabaja con datasets más grandes o modelos más complejos.

En la gama alta, las GPUs como la H100 y aquellas basadas en la arquitectura Blackwell de NVIDIA representan un hardware de IA más reciente. Están diseñadas para cargas de trabajo de alto rendimiento y suelen utilizarse para entrenamiento a gran escala, investigación avanzada o tareas sensibles al tiempo.

La gama de opciones de GPU disponibles en Ultralytics Platform proporciona flexibilidad en diferentes cargas de trabajo. Dependiendo de tus requisitos, puedes empezar con configuraciones más pequeñas y aumentar la escala según sea necesario.

Cómo elegir la GPU en la nube adecuada para tu proyecto

Al seleccionar una GPU para el entrenamiento en la nube en Ultralytics Platform, hay varios factores a considerar, incluyendo el tamaño del dataset, la complejidad del modelo y el coste. Analicemos cada uno de estos factores.

Adaptación de la potencia de la GPU al tamaño del dataset

Uno de los principales factores a la hora de elegir una GPU es el tamaño de tu dataset, ya que afecta al tiempo que requiere el entrenamiento y a la potencia de computación que necesitas.

Para datasets pequeños, generalmente de menos de 1000 imágenes, una GPU ligera como la RTX 2000 suele ser suficiente. Esto funciona bien para experimentos rápidos y ejecuciones de entrenamiento más cortas.

Para datasets de tamaño mediano, de entre 1000 y 10 000 imágenes, las GPUs como la RTX 4090 o la RTX A6000 ofrecen un mejor equilibrio de rendimiento y eficiencia, ayudándote a entrenar con mayor fluidez sin largas esperas.

Para datasets más grandes, de más de 10 000 imágenes, probablemente necesites un hardware más potente para mantener unos tiempos de entrenamiento razonables. Las GPUs como las H100 son más adecuadas para gestionar cargas de trabajo más pesadas y escalar eficazmente.

En general, se trata de hacer coincidir el tamaño de tu dataset con el nivel de potencia de cálculo y capacidad de procesamiento paralelo que necesitas.

Elección de una GPU basada en el tamaño y la complejidad del modelo

Otro factor importante a la hora de elegir una GPU es el tamaño y la complejidad de tu modelo de IA de visión. Los modelos de diferentes tamaños necesitarán distintas cantidades de potencia para el cálculo.

Por ejemplo, los modelos más pequeños necesitan menos potencia de cálculo de GPU y pueden ejecutarse eficientemente en GPUs como la RTX 2000 Ada, la RTX A4500 o incluso la RTX 4090 si buscas resultados más rápidos. Son ideales para experimentos rápidos, creación de prototipos y tareas más sencillas, permitiéndote iterar más rápido y probar ideas sin costes de computación elevados.

Por otro lado, los modelos más grandes y complejos requieren mucha más memoria y potencia de procesamiento. Las GPUs como la RTX A6000, la RTX PRO 6000 y las opciones de alta gama como la H100 son más adecuadas para estas cargas de trabajo. Pueden gestionar arquitecturas más grandes, reducir el tiempo de entrenamiento y prevenir problemas de memoria, algo especialmente importante cuando se trabaja con imágenes de alta resolución, tamaños de lote grandes o diseños de modelos más avanzados.

Comparación del tamaño de lote y la memoria de la GPU

Del mismo modo, el tamaño de lote (batch size) desempeña un papel importante en el entrenamiento de modelos. Se refiere al número de muestras de entrenamiento que el modelo procesa a la vez en un solo paso.

Los tamaños de lote más grandes pueden mejorar la eficiencia del entrenamiento al procesar más datos a la vez, pero también requieren más memoria de GPU (VRAM). En general, las GPUs con mayor ancho de banda de memoria pueden soportar tamaños de lote mayores, mientras que las GPUs con menos memoria pueden requerir lotes más pequeños.

Por ejemplo, las GPUs como la RTX A6000, la RTX PRO 6000 o la A100 pueden manejar tamaños de lote más grandes con mayor facilidad debido a su mayor memoria, mientras que opciones como la RTX 4090 o la RTX 2000 Ada pueden requerir tamaños de lote más pequeños según la carga de trabajo.

Sin embargo, no siempre es necesario utilizar la GPU más grande. Las GPUs de gama alta pueden mejorar la velocidad y la capacidad, pero también conllevan mayores costes. En muchos casos, ajustar el tamaño de lote en una GPU más pequeña puede ser una opción más eficiente.

En última instancia, el objetivo es encontrar el equilibrio adecuado entre el tamaño de lote, la memoria de GPU disponible y el coste en función de tu modelo y dataset.

El impacto de la configuración de entrenamiento en el rendimiento de la GPU

Otro factor que afecta al rendimiento de la GPU es la configuración del entrenamiento. Esto incluye parámetros como el número de épocas, el tamaño de la imagen y otros ajustes que controlan cómo se entrena un modelo.

Por ejemplo, los tamaños de imagen más grandes aumentan la cantidad de cálculo necesario por paso. Esto puede ralentizar el entrenamiento y puede requerir más potencia de computación o memoria para mantener un buen rendimiento.

Asimismo, aumentar el número de épocas prolonga el tiempo total de entrenamiento, especialmente en hardware menos potente. Una época se refiere a una pasada completa a través de todo el dataset durante el entrenamiento.

Técnicas como el aumento de datos también añaden procesamiento adicional durante el entrenamiento. El aumento de datos aplica transformaciones como volteo, rotación o escalado para aumentar la diversidad de los datos y mejorar el rendimiento del modelo. Aunque esto puede mejorar la robustez del modelo, también puede reducir la velocidad de entrenamiento.

En general, las GPUs más potentes pueden gestionar estas crecientes demandas de forma más eficiente, pero el impacto dependerá de la configuración general y la carga de trabajo.

Equilibrio entre coste y tiempo de entrenamiento

Al elegir una GPU para tu proyecto, a menudo existe un compromiso entre la velocidad de entrenamiento y el precio de la GPU.

Ultralytics Platform facilita la estimación y comprensión de estos costes antes de iniciar un trabajo de entrenamiento. Basándose en tu configuración, incluyendo el tamaño del dataset, el modelo y la GPU, puedes ver un coste estimado y la duración del entrenamiento por adelantado.

Fig 3. Ultralytics Platform hace que los costes en la nube sean fáciles de estimar y entender. (Fuente)

Las GPUs más rápidas suelen tener un coste por hora más elevado, pero pueden reducir el tiempo total de entrenamiento. Las GPUs como la RTX 4090, la RTX PRO 6000 y la H100 suelen ser capaces de completar el entrenamiento más rápidamente debido a su mayor rendimiento.

Las GPUs más lentas suelen tener un coste por hora más bajo, pero tardan más en completar el entrenamiento. Por ejemplo, las GPUs como la RTX 2000 Ada y la RTX A4500 se utilizan a menudo para cargas de trabajo más pequeñas o trabajos de larga duración donde se prioriza un coste menor.

Además de esto, algunas de las GPUs de gama más alta, como la H200 y la B200, solo están disponibles en los planes Pro o Enterprise, mientras que la mayoría de las otras opciones también son accesibles en el nivel Free.

Un vistazo a las estrategias de optimización de costes

Más allá de elegir la GPU adecuada, existen algunas formas prácticas de mantener los costes de entrenamiento bajo control. Uno de los enfoques más efectivos es comenzar con pequeñas ejecuciones de prueba antes de escalar.

En lugar de lanzarte directamente al entrenamiento completo, comienza con menos épocas para asegurarte de que tu configuración funciona como se espera. Esto te ayuda a validar rápidamente tus datos, anotaciones y configuración del modelo, y evita gastar tiempo y computación en ejecuciones que pueden no producir resultados útiles.

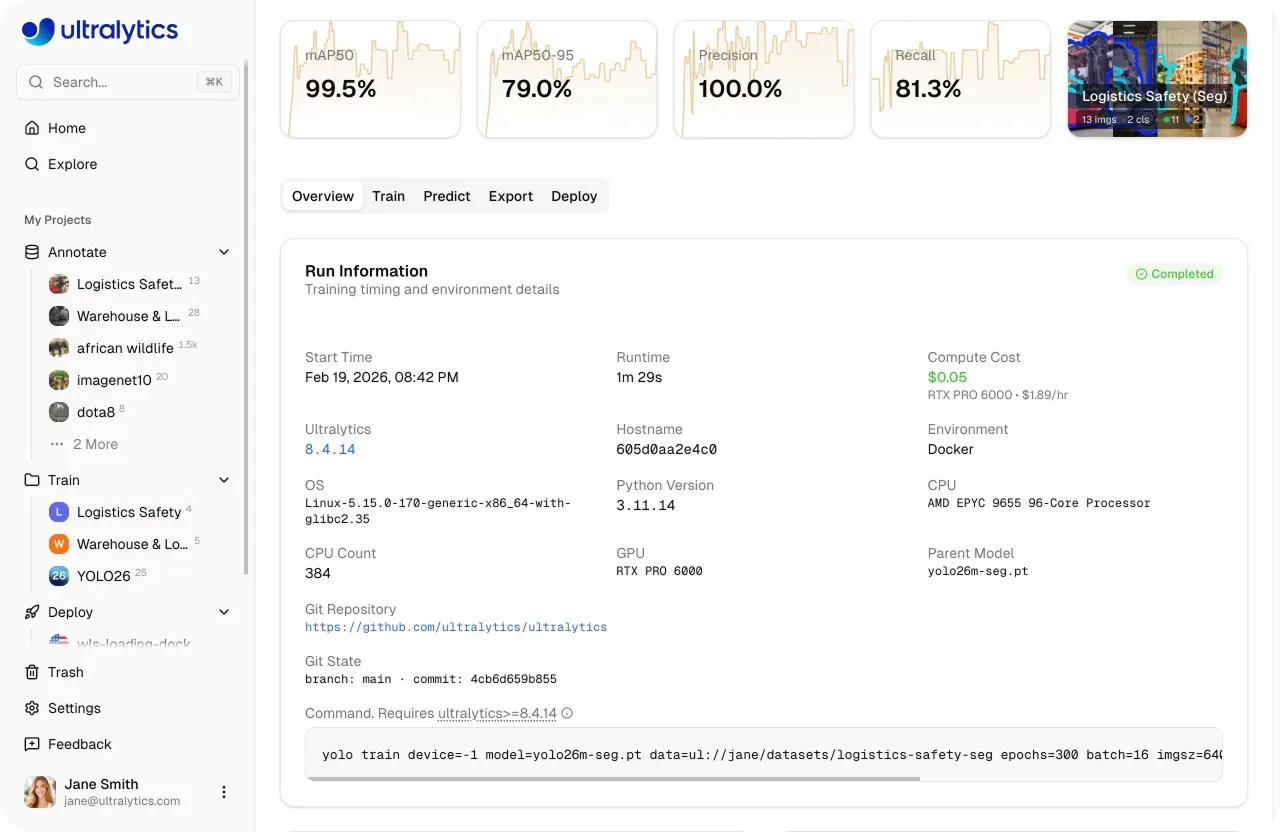

A medida que avanza el entrenamiento, vigila tus métricas y detén las ejecuciones pronto si el rendimiento se estanca o deja de mejorar. El seguimiento de las curvas de entrenamiento puede ayudarte a decidir si continuar o ajustar tu configuración.

También puedes ajustar parámetros como el tamaño de lote y el tamaño de la imagen. Los valores más pequeños reducen el uso de memoria y computación, haciendo más práctico experimentar, probar diferentes configuraciones o ejecutar simulaciones a pequeña escala antes de escalar.

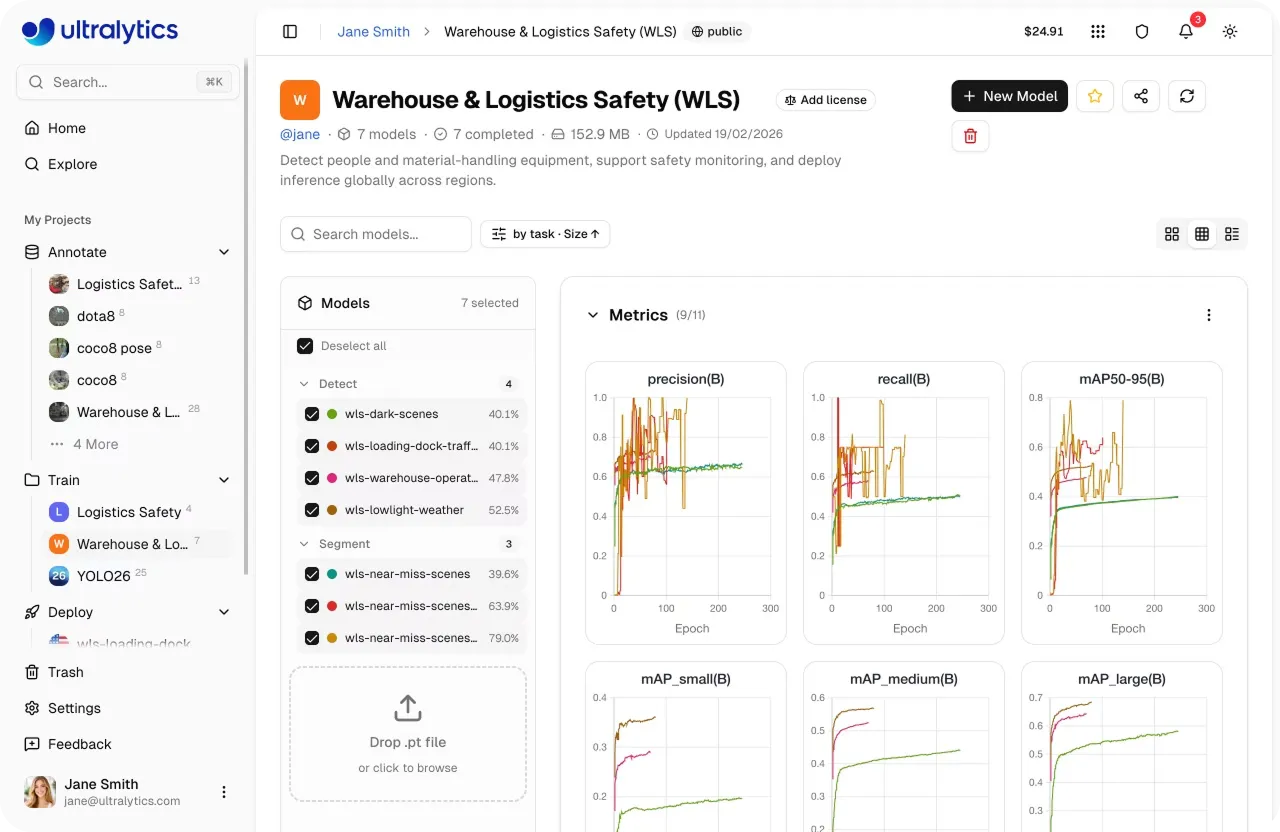

Fig 4. Visualizaciones de métricas de entrenamiento en Ultralytics Platform (Fuente)

Además de esto, Ultralytics Platform ayuda a simplificar la gestión de costes. Proporciona una estimación de costes integrada para que puedas entender los gastos esperados antes de iniciar un trabajo.

Con un sistema de pago por uso basado en créditos, solo pagas por el tiempo de computación que realmente utilizas. Esto facilita mantenerte dentro del presupuesto y escalar una vez que estés seguro de tu configuración de entrenamiento.

Mejores prácticas relacionadas con el entrenamiento con GPU en la nube para visión artificial

Aquí tienes algunas mejores prácticas a tener en cuenta para el entrenamiento con GPU en la nube en Ultralytics Platform:

- Valida los datasets antes del entrenamiento: Asegúrate de que tu dataset esté limpio, bien anotado y sea consistente antes de empezar. Detectar los problemas pronto ayuda a evitar el desperdicio de computación y mejora el rendimiento del modelo.

- Ejecuta experimentos rápidos primero: Comienza con pequeñas pruebas y menos épocas para verificar tu configuración. Esto ayuda a identificar problemas pronto sin comprometerte con trabajos de entrenamiento largos y costosos. En cierto modo, estás creando una plantilla que puedes reutilizar y escalar una vez que todo funcione como se espera.

- Monitoriza métricas clave: Realiza un seguimiento de métricas como la pérdida, mAP, precisión y recall durante todo el entrenamiento. Estas métricas actúan como puntos de referencia para evaluar el rendimiento del modelo y ayudarte a decidir cuándo ajustar o detener.

- Mantén eficientes los flujos de procesamiento de datos: Asegúrate de que la carga y el preprocesamiento de datos sean eficientes, ya que estas funciones dependen de los recursos de CPU y pueden convertirse en cuellos de botella que afecten al rendimiento general del entrenamiento.

- Utiliza herramientas integradas: Usa gráficos, registros de consola y métricas del sistema para monitorizar el entrenamiento en tiempo real y tomar decisiones informadas rápidamente.

Puntos clave

Elegir la GPU en la nube adecuada para visión artificial en Ultralytics Platform se reduce a entender tu carga de trabajo, incluyendo el tamaño del dataset, la complejidad del modelo y la configuración de entrenamiento. Con una gama de opciones de GPU disponibles, potenciadas por infraestructura en la nube y máquinas virtuales, puedes empezar con una elección equilibrada y escalar a medida que crezcan tus necesidades de entrenamiento o ajuste fino del modelo. Al combinar el hardware adecuado con buenas prácticas como la monitorización y el control de costes, puedes entrenar modelos de inteligencia artificial de última generación de forma eficiente mientras aprovechas al máximo la flexibilidad de la computación de alto rendimiento.

Echa un vistazo a nuestra creciente comunidad y repositorio en GitHub para aprender más sobre visión artificial. Si buscas crear soluciones de visión, echa un vistazo a nuestras opciones de licencia. Explora nuestras páginas de soluciones para saber más sobre los beneficios de la visión artificial en la fabricación y la IA en la agricultura.