Construye un sistema de inspección por visión basado en cámaras sin necesidad de experiencia en IA

Descubre cómo construir un sistema de inspección visual basado en cámara sin necesidad de experiencia en IA utilizando la plataforma Ultralytics, desde el etiquetado hasta el despliegue.

Cada producto que utilizamos, ya sea un teléfono, un artículo empaquetado o una pieza de coche, pasa por algún tipo de inspección de calidad antes de llegar a nosotros, el consumidor final. Tradicionalmente, esto se ha hecho mediante controles manuales o sistemas sencillos basados en reglas. Aunque estos métodos funcionan, a menudo son lentos, inconsistentes y difíciles de escalar a medida que aumenta la producción.

Para mejorar el proceso de inspección de calidad, muchas industrias están recurriendo a la visión artificial, una rama de la inteligencia artificial que ayuda a las máquinas a entender imágenes y vídeos. Por ejemplo, los modelos de IA de visión como Ultralytics YOLO26 pueden ayudar a detectar, clasificar y localizar defectos con un alto nivel de precisión.

En entornos de producción reales, estos modelos se pueden utilizar para analizar imágenes capturadas directamente desde líneas de montaje de alta velocidad. A medida que los productos avanzan por las distintas etapas, las cámaras industriales los siguen y el sistema comprueba si existen problemas como arañazos, piezas faltantes o desalineaciones. Esto hace que la detección de defectos sea más rápida y consistente, al tiempo que admite una inspección de alto rendimiento.

En el pasado, construir estos sistemas requería múltiples herramientas y una sólida experiencia técnica, lo que hacía que el proceso fuera complejo y lento. Ultralytics Platform, nuestra nueva solución integral para visión artificial, simplifica esto al reunir la preparación de datos, la anotación, el entrenamiento de modelos y el despliegue en un solo lugar.

En este artículo, exploraremos cómo puedes utilizar Ultralytics Platform para construir sistemas prácticos de inspección visual basados en cámaras sin necesidad de tener una profunda experiencia en IA. ¡Empecemos!

Link to this sectionEl papel de la visión artificial en el control de calidad#

Antes de profundizar en cómo Ultralytics Platform facilita la construcción de sistemas de inspección, demos un paso atrás y entendamos el papel de la visión artificial en la inspección de calidad.

La inspección es una parte clave del proceso de fabricación que garantiza que los productos cumplan con los estándares de calidad y estén libres de defectos. Sin embargo, los resultados pueden variar, especialmente durante turnos largos o producciones de gran volumen.

Para hacer que la inspección sea más fiable, muchas industrias utilizan visión artificial, también conocida como visión por computador, para analizar imágenes de la línea de producción e identificar defectos. Estos sistemas utilizan aprendizaje profundo (deep learning), donde los modelos y algoritmos aprenden patrones a partir de grandes conjuntos de imágenes etiquetadas de alta calidad.

Durante el entrenamiento del modelo, se le muestran al modelo ejemplos tanto de productos normales como de diferentes tipos de defectos. Con el tiempo, aprende a reconocer estos patrones por sí mismo. Una vez entrenado, un modelo puede inspeccionar grandes volúmenes de productos y aplicar los mismos criterios de forma consistente, mejorando la precisión.

Link to this sectionTareas comunes de visión artificial utilizadas en la inspección de calidad#

Las aplicaciones de visión artificial son posibles gracias a modelos de visión artificial como Ultralytics YOLO models que pueden admitir diferentes tipos de tareas de visión. A continuación, se ofrece una visión general de cómo se utilizan estas tareas de IA de visión para flujos de trabajo de inspección automatizados:

- Clasificación de imágenes: Esta tarea se utiliza para asignar una única etiqueta a una imagen completa, como "bueno" o "defectuoso". Proporciona una evaluación de alto nivel de la calidad del producto sin indicar la ubicación de los defectos.

- Detección de objetos: Ayuda a identificar defectos dentro de una imagen y localizarlos mediante cuadros delimitadores (bounding boxes). Esto hace posible detectar y localizar problemas como grietas, arañazos o componentes que faltan.

- Segmentación de instancias: Al ir un paso más allá de la detección de objetos, predice máscaras a nivel de píxel para cada defecto detectado. Esto permite un análisis preciso de la forma, el tamaño y los límites de los defectos.

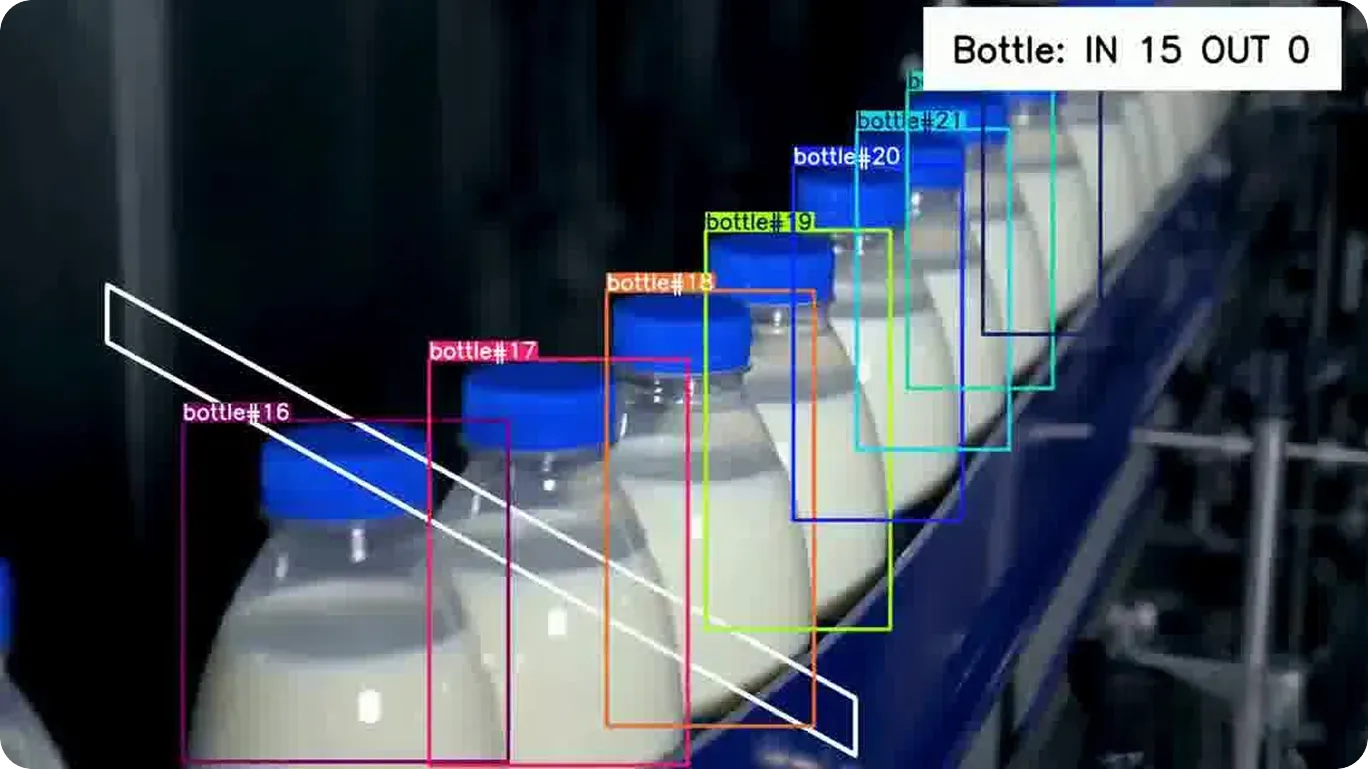

- Seguimiento de objetos: Al rastrear productos a lo largo de varios fotogramas, sigue los artículos a medida que se mueven por la línea de producción. Esto mantiene la consistencia y garantiza que no se pasen por alto los defectos.

- Detección de cuadros delimitadores orientados (OBB): Esta tarea detecta objetos utilizando cuadros delimitadores rotados en lugar de los alineados con los ejes. Es particularmente útil cuando los defectos o componentes aparecen en diferentes ángulos, lo que permite una localización más precisa.

Link to this sectionUn vistazo a las aplicaciones de inspección de calidad en todas las industrias#

La visión artificial se utiliza ampliamente en todas las industrias para mantener la calidad del producto, cumplir con los estándares y reducir la necesidad de inspección manual. Realiza funciones clave como la detección de defectos, clasificación, reconocimiento de objetos, medición y detección de anomalías.

Fig 1. Un ejemplo de detección y seguimiento de productos utilizando sistemas de visión artificial (Fuente)

Aquí tienes algunos ejemplos de casos de uso reales donde se aplica:

- Fabricación: La detección de defectos en la superficie se utiliza para identificar problemas como arañazos, abolladuras, grietas y decoloración mediante el análisis de imágenes de productos en la línea de producción para la detección de defectos en línea. También puede detectar piezas que faltan o errores de montaje en tiempo real, lo que permite una inspección continua.

- Automoción: Los sistemas de visión artificial analizan piezas de motores y paneles de carrocería para verificar la alineación y detectar daños. Son especialmente impactantes para inspeccionar formas complejas y áreas de difícil acceso, trabajando a menudo junto a sistemas robóticos para un posicionamiento preciso y una inspección automatizada.

- Electrónica y semiconductores: Estos sistemas detectan pequeños defectos en componentes como placas de circuito impreso (PCB), incluidos problemas de soldadura, microgrietas y circuitos dañados. Con el análisis de imágenes de alta resolución, se pueden detectar incluso defectos muy finos que a menudo pasan desapercibidos durante la inspección manual.

- Embalaje y logística: Los sistemas visuales realizan el escaneo de códigos de barras, leen etiquetas de productos y comprueban la calidad del embalaje. Garantizan que los productos estén correctamente embalados, sellados y listos para su envío, reduciendo errores.

- Alimentación y bebidas: Los sistemas de inspección impulsados por cámaras o sensores de visión analizan la apariencia del producto para identificar problemas como un sellado inadecuado, riesgos de contaminación, etiquetado incorrecto o inconsistencias visuales, ayudando a mantener la calidad y la seguridad.

- Farmacéutica: La visión artificial se utiliza para inspeccionar comprimidos, viales y envases en busca de defectos como grietas, contaminación, etiquetado incorrecto o inconsistencias en el nivel de llenado, garantizando el cumplimiento de estrictos estándares normativos y manteniendo la seguridad del producto.

Link to this sectionOptimización de los flujos de trabajo de inspección visual con Ultralytics Platform#

Considera una línea de fabricación donde los productos pasan por diferentes etapas mientras las cámaras capturan continuamente imágenes para su inspección. Estas imágenes se utilizan para comprobar si hay defectos como arañazos, piezas faltantes o desalineaciones.

Hasta ahora, la construcción y gestión de estos sistemas de inspección ha requerido múltiples herramientas y una cantidad considerable de experiencia técnica.

De hecho, en Ultralytics, hemos visto comentarios constantes de la comunidad de IA de visión sobre lo fragmentado y lento que puede llegar a ser este proceso, con cuellos de botella comunes que incluyen herramientas dispersas, configuración compleja del entorno, flujos de trabajo de etiquetado de datos ineficientes, retrasos en el entrenamiento de modelos y desafíos en el despliegue. Estos comentarios desempeñaron un papel clave en la configuración de Ultralytics Platform.

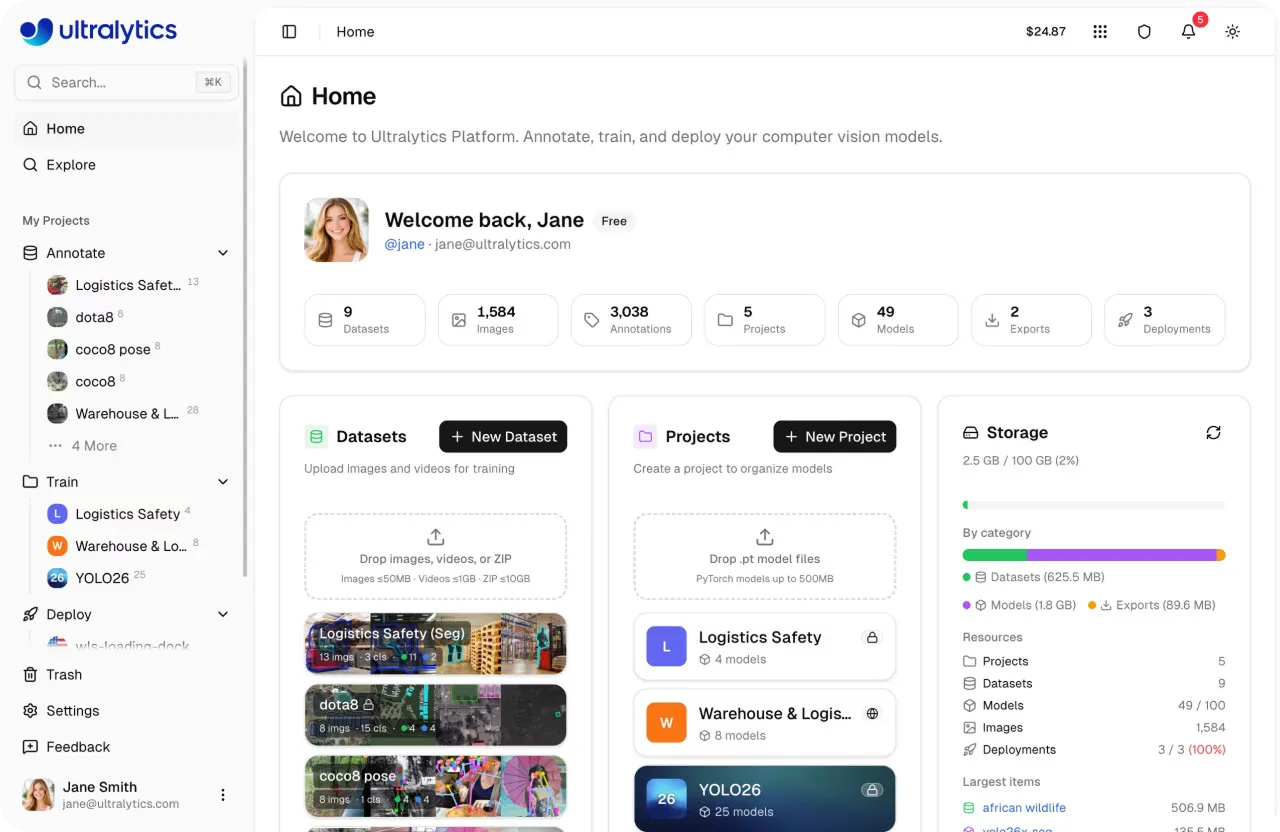

Fig 2. Un vistazo a Ultralytics Platform (Fuente)

Con Ultralytics Platform, todo el proceso de desarrollo y despliegue se puede gestionar en un solo lugar. Los datos brutos se pueden cargar y anotar para crear conjuntos de datos de entrenamiento, que luego se utilizan para entrenar modelos para detectar defectos. Una vez entrenados, estos modelos se pueden desplegar para analizar nuevas imágenes de la línea de producción, con herramientas integradas para monitorizar el rendimiento a lo largo del tiempo.

Además de llevar todo el flujo de trabajo a un solo lugar, Ultralytics Platform está diseñada para ser fácil de usar. Incluso los usuarios con experiencia limitada en aprendizaje automático pueden pasar de la ideación a la producción rápidamente.

Link to this sectionUtilizando Ultralytics Platform para etiquetar defectos en imágenes#

Ahora que hemos visto cómo Ultralytics Platform une el flujo de trabajo, repasemos cómo utilizarla en cada etapa del proceso de IA de visión, comenzando con la carga de datos y el etiquetado de defectos.

Link to this sectionGestión de conjuntos de datos de inspección en Ultralytics Platform#

El primer paso es llevar los datos a la plataforma. Puedes cargar imágenes, vídeos o archivos de conjunto de datos comprimidos como ZIP, TAR o GZ. Se admiten formatos de conjunto de datos comunes como YOLO y COCO, por lo que los conjuntos de datos existentes se pueden importar sin pasos adicionales.

También puedes empezar más rápido utilizando conjuntos de datos compartidos por la comunidad. Estos conjuntos de datos se pueden explorar y clonar en tu espacio de trabajo, permitiéndote construir sobre datos existentes en lugar de empezar desde cero. Una vez clonados, se pueden actualizar y ampliar para tu caso de uso específico.

Si estás trabajando en varios experimentos, los conjuntos de datos se pueden reutilizar importándolos como archivos NDJSON, lo que facilita su recreación o intercambio sin conversión adicional.

Después de cargar los datos, la plataforma los prepara automáticamente. Comprueba los formatos de archivo, procesa las anotaciones, cambia el tamaño de las imágenes si es necesario y genera estadísticas básicas del conjunto de datos. Los vídeos se dividen en fotogramas para que puedan utilizarse para el entrenamiento, y las imágenes se optimizan para facilitar la navegación y el análisis.

Link to this sectionAnotación de datos impulsada por Ultralytics Platform#

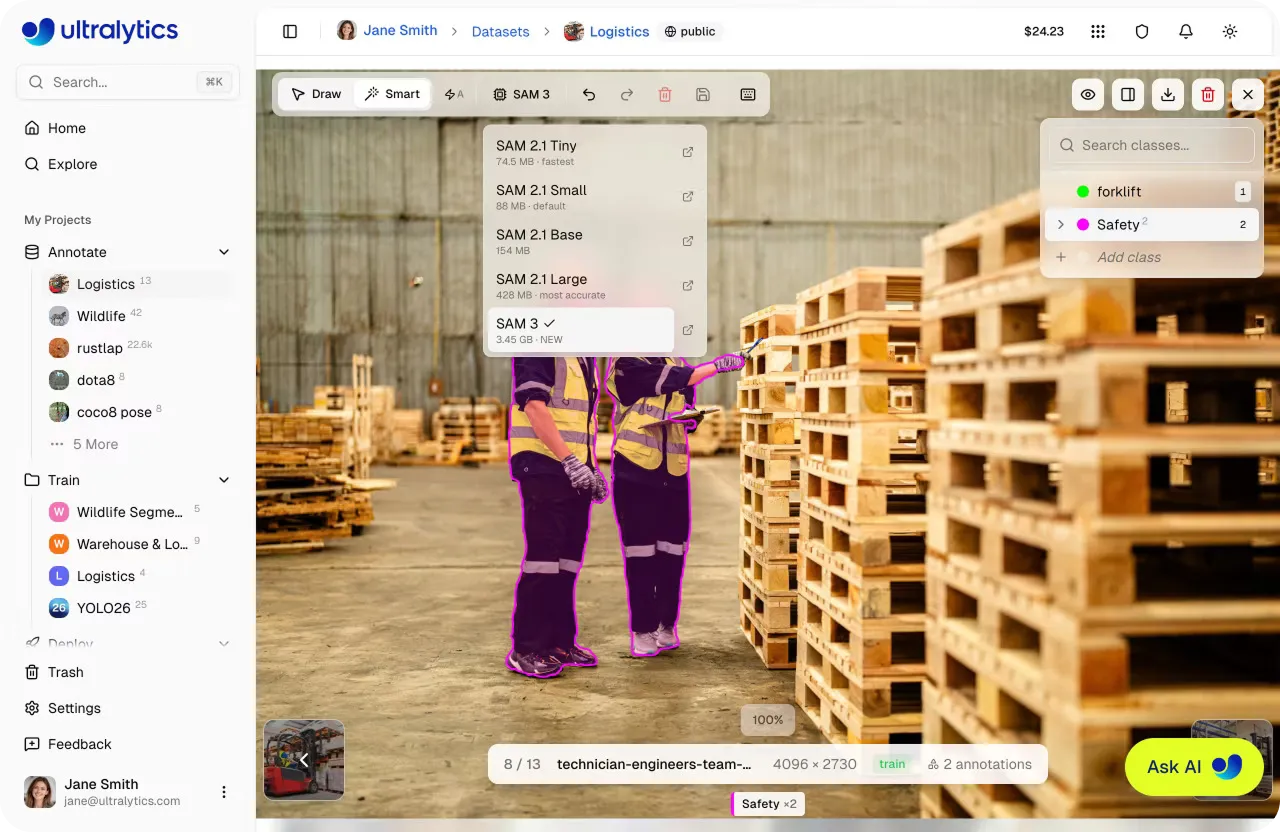

Una vez que los datos están listos, el siguiente paso es la anotación de datos. Aquí es donde se etiquetan los defectos para que el modelo pueda aprender qué detectar. Ultralytics Platform incluye un editor de anotación integrado que admite tareas como detección de objetos, segmentación de instancias, clasificación de imágenes, estimación de poses y detección de cuadros delimitadores orientados.

Puedes etiquetar los datos manualmente utilizando herramientas como cuadros delimitadores, polígonos o puntos clave, según tu caso de uso. Para acelerar las cosas, la plataforma también ofrece etiquetado asistido por IA.

Por ejemplo, la anotación inteligente basada en SAM te permite etiquetar objetos mediante simples clics. Al seleccionar las regiones que se deben incluir o excluir, el sistema genera una máscara en tiempo real, que luego se puede ajustar si es necesario.

Fig 3. Anotación inteligente basada en SAM dentro de Ultralytics Platform (Fuente)

Además, la anotación inteligente basada en YOLO puede generar etiquetas automáticamente utilizando predicciones de modelos. Estas se pueden revisar y refinar, lo que facilita el trabajo con grandes conjuntos de datos sin tener que etiquetar todo manualmente.

El editor de anotaciones también incluye funciones como gestión de clases, edición de anotaciones, atajos de teclado y opciones para deshacer o rehacer. Estas facilitan mantener la consistencia y revisar las anotaciones a medida que crece tu conjunto de datos.

A medida que etiquetas los datos, la plataforma proporciona información como la distribución de clases y el recuento de anotaciones. Esto ayuda a identificar lagunas, corregir inconsistencias y mejorar la calidad del conjunto de datos antes de pasar al entrenamiento.

Link to this sectionEntrenando YOLO26 para la detección de defectos en Ultralytics Platform#

El siguiente paso es entrenar un modelo para detectar automáticamente defectos utilizando los datos etiquetados. Ultralytics Platform admite el entrenamiento con modelos Ultralytics YOLO, incluido YOLO26, que se puede utilizar para tareas como detección de objetos, segmentación de instancias y clasificación de imágenes.

El entrenamiento se gestiona a través de un panel unificado donde puedes configurar, ejecutar y supervisar los trabajos de entrenamiento en un solo lugar. Para empezar, puedes seleccionar un conjunto de datos, incluido uno que hayas cargado, anotado en la plataforma, obtenido de conjuntos de datos públicos disponibles en la plataforma o clonado de la comunidad.

Una vez seleccionado, el conjunto de datos se vincula automáticamente a la ejecución del entrenamiento, lo que facilita el seguimiento de experimentos y el mantenimiento de la consistencia.

A continuación, puedes configurar los parámetros de entrenamiento como el número de épocas, el tamaño del lote (batch size), el tamaño de la imagen y la tasa de aprendizaje. Estos ajustes controlan cómo aprende el modelo y tienen un impacto directo tanto en el tiempo de entrenamiento como en el rendimiento.

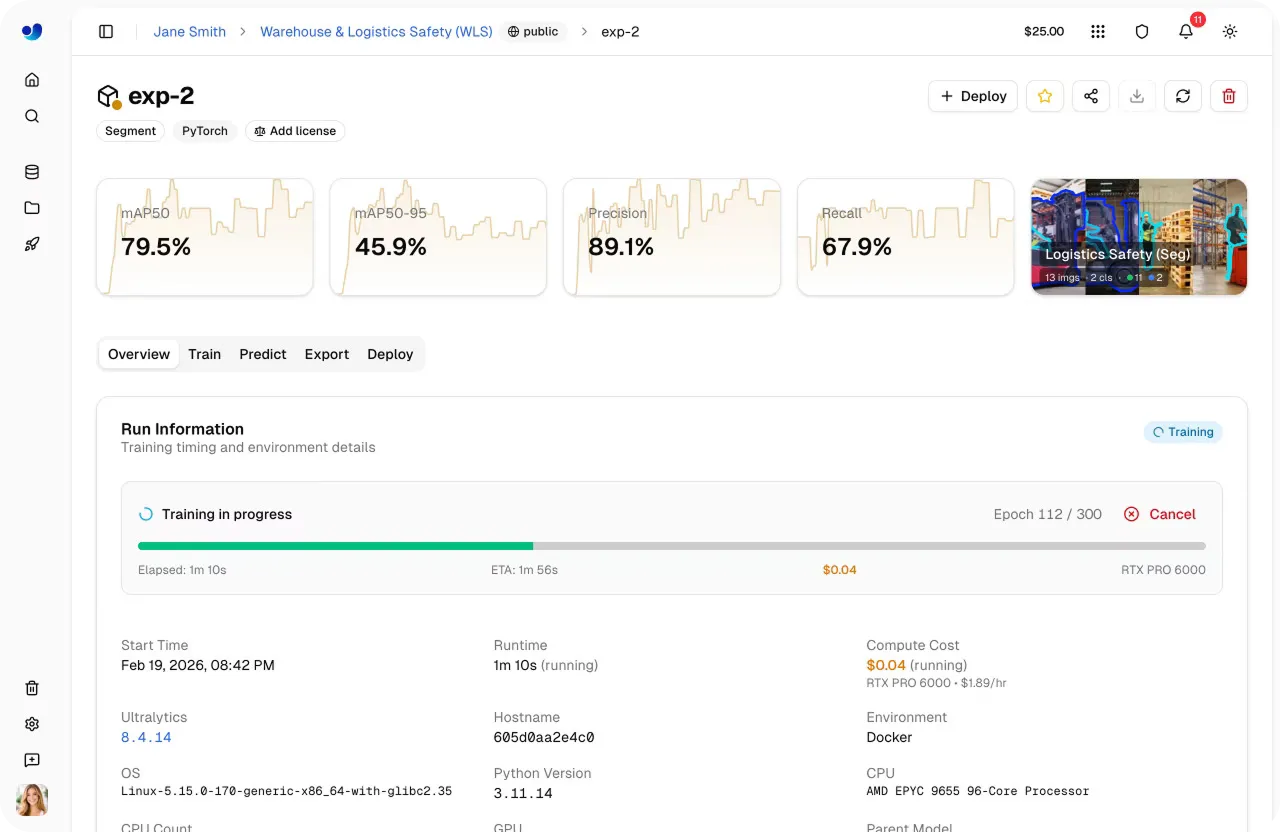

Link to this sectionEjecución y supervisión del entrenamiento#

Luego puedes elegir cómo ejecutar el entrenamiento. La plataforma admite entrenamiento en la nube en GPU gestionadas, entrenamiento local utilizando tu propio hardware y flujos de trabajo basados en navegador a través de entornos como Google Colab.

Cuando utilizas el entrenamiento en la nube, puedes elegir entre una gama de opciones de GPU como RTX 2000 Ada y RTX A4500 para experimentos más pequeños, RTX 4090 o RTX A6000 para cargas de trabajo más exigentes, y opciones de alto rendimiento como A100 o H100 para entrenamiento a gran escala.

Cuando comienza el entrenamiento, el progreso se puede supervisar directamente dentro de la plataforma. El panel proporciona visibilidad en tiempo real de métricas clave como las curvas de pérdida y métricas de rendimiento, junto con el uso del sistema y los registros de entrenamiento. Esto hace que sea sencillo entender cómo está aprendiendo el modelo e identificar posibles problemas desde el principio.

Fig 4. Puedes supervisar el progreso del entrenamiento fácilmente utilizando Ultralytics Platform (Fuente)

A medida que ejecutas múltiples experimentos, la plataforma realiza un seguimiento de las configuraciones, conjuntos de datos y resultados en un solo lugar. Esto hace que sea sencillo comparar diferentes ejecuciones de entrenamiento, evaluar el rendimiento utilizando métricas como precisión, recall y mAP, y seleccionar el modelo con mejor rendimiento para su despliegue.

Link to this sectionDespliegue de un modelo de visión a través de Ultralytics Platform#

Después del entrenamiento, el siguiente paso es validar cómo funciona el modelo entrenado con datos nuevos y desconocidos antes de pasar al despliegue. Ultralytics Platform incluye una pestaña Predict (predicción) integrada que te permite probar modelos directamente en el navegador sin ninguna configuración.

Puedes cargar imágenes, utilizar datos de muestra o capturar entradas a través de una cámara web, y los resultados aparecen al instante con superposiciones visuales y puntuaciones de confianza. Esto significa que puedes comprobar rápidamente el rendimiento del modelo e identificar cualquier problema antes de integrarlo en sistemas del mundo real.

Una vez que el modelo ha sido validado, se puede desplegar utilizando diferentes opciones dependiendo de tu caso de uso. Aquí tienes un vistazo más detallado a las opciones de despliegue de modelos admitidas por Ultralytics Platform:

- Inferencia compartida: Esta opción te permite acceder al modelo a través de una REST API, lo que facilita su integración en aplicaciones o flujos de trabajo. Se ejecuta en un sistema multiinquilino en unas pocas regiones centrales, donde las solicitudes se enrutan automáticamente al servicio disponible más cercano. Esto lo convierte en una buena opción para desarrollo, pruebas y uso más ligero antes de pasar a la producción.

- Endpoints dedicados: Para su uso en producción, los modelos se pueden desplegar como endpoints dedicados con sus propios recursos informáticos. Estos se ejecutan como servicios de inquilino único en 43 regiones globales, ayudando a reducir la latencia al desplegarse más cerca de los usuarios finales. También admiten el escalado automático y el escalado a cero, lo que permite que los recursos se ajusten automáticamente en función del tráfico.

- Exportación de modelos: Los modelos se pueden exportar y ejecutar fuera de la plataforma en sistemas locales o dispositivos de borde (edge). La plataforma admite 17 formatos, incluidos ONNX, TensorRT, OpenVINO, CoreML y TensorFlow Lite. Las opciones de exportación también admiten optimizaciones como cuantificación FP16 e INT8 para reducir el tamaño del modelo y mejorar la velocidad de inferencia para diferentes entornos de hardware.

Link to this sectionMonitorización de modelos desplegados utilizando Ultralytics Platform#

El ciclo de vida de una solución de procesamiento de imágenes o visión artificial no termina con el despliegue del modelo. Esto también es cierto para los sistemas de inspección visual. Una vez que un modelo está funcionando en producción, necesita ser monitorizado continuamente para asegurarse de que funciona de manera fiable a medida que cambian las condiciones.

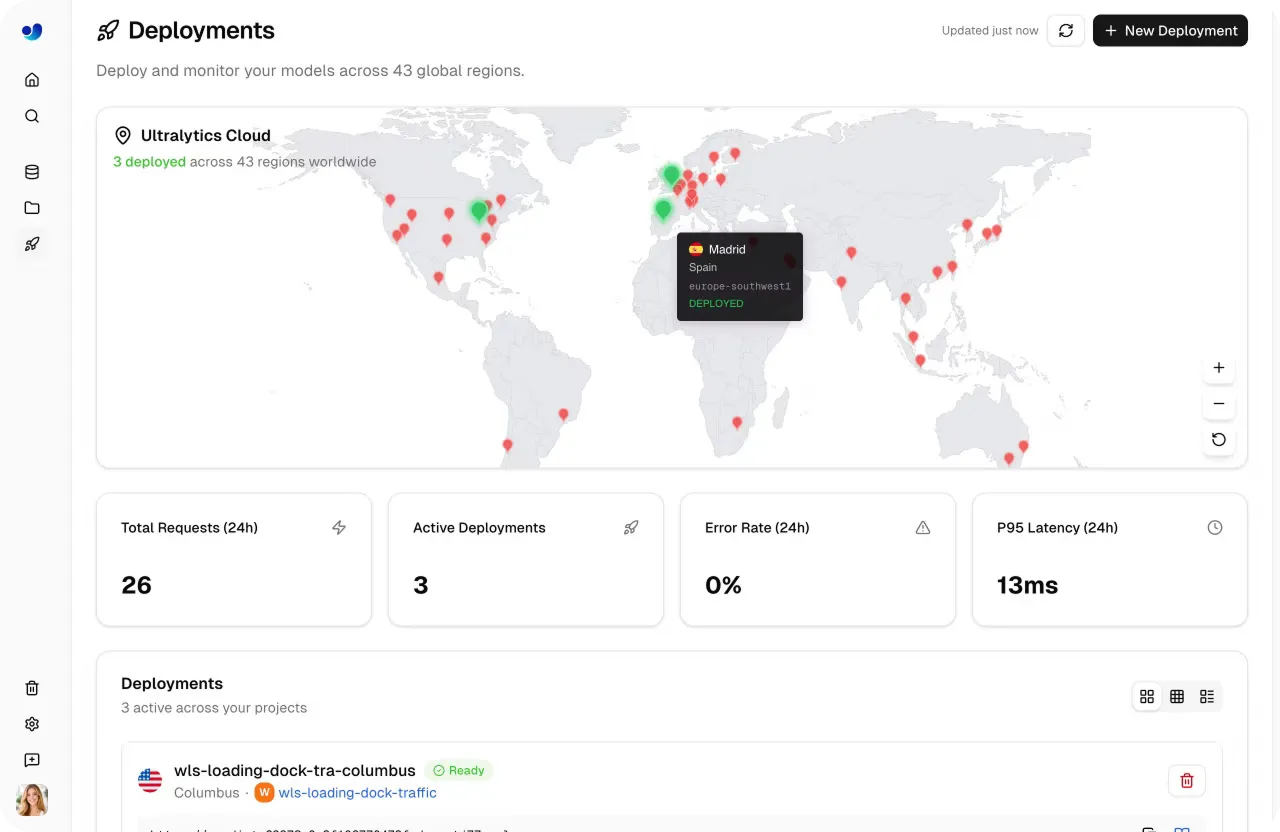

Ultralytics Platform proporciona un panel de monitorización integrado que ofrece una visión clara de cómo están funcionando los modelos desplegados. Desde una única interfaz, puedes realizar un seguimiento de la actividad de las solicitudes, ver registros y comprobar el estado de salud de cada despliegue. Puedes entender cómo se utilizan los modelos y cómo se comportan a lo largo del tiempo.

El panel incluye métricas clave como el total de solicitudes, tasas de error y latencia, lo que te ayuda a evaluar el rendimiento y la capacidad de respuesta. Estas métricas se actualizan regularmente y proporcionan información sobre los patrones de uso y la fiabilidad del sistema.

Un mapa mundial integrado muestra dónde se distribuyen las solicitudes y los despliegues en todas las regiones. Con soporte para despliegues en múltiples ubicaciones globales, esta vista ayuda a realizar un seguimiento del uso geográficamente y entender cómo funcionan los modelos en diferentes entornos.

Fig 5. Monitorización de modelos desplegados en Ultralytics Platform (Fuente)

Para un análisis más profundo, cada despliegue incluye registros detallados con marcas de tiempo, detalles de la solicitud y mensajes de error. Los registros se pueden filtrar por gravedad, lo que simplifica la depuración de problemas y la identificación rápida de fallos. Además, las comprobaciones de salud proporcionan indicadores de estado en tiempo real, mostrando si un despliegue funciona como se espera o si requiere atención.

La monitorización también desempeña un papel importante en la optimización. A medida que cambian los datos de entrada, el tráfico o los patrones de uso, el rendimiento puede variar. Mediante el seguimiento de métricas y registros, puedes identificar problemas como alta latencia, mayores tasas de error o limitaciones de escalado y tomar medidas para mantener un rendimiento consistente.

Link to this sectionBeneficios de usar Ultralytics Platform para construir soluciones de visión#

Aquí tienes algunas de las ventajas clave de usar Ultralytics Platform para construir y escalar sistemas de inspección visual:

- Optimizado para el uso en el mundo real: Funciones como los endpoints de escalado automático, el despliegue en el borde y la exportación de modelos garantizan que el sistema pueda funcionar de forma fiable en entornos de producción.

- Ciclos de desarrollo más rápidos: Las herramientas integradas y las configuraciones predeterminadas ayudan a pasar de los datos brutos a un sistema funcional de manera más eficiente.

- Facilidad de uso: Las interfaces intuitivas, los flujos de trabajo simplificados y los requisitos mínimos de configuración hacen que la plataforma sea accesible tanto para principiantes como para usuarios experimentados.

- Menos trabajo manual: Funciones como el etiquetado asistido por IA y el procesamiento automatizado de datos reducen el tiempo dedicado a tareas repetitivas.

- Escalable a lo largo del tiempo: A medida que cambian los requisitos, el sistema se puede actualizar añadiendo nuevos datos y reentrenando los modelos, permitiendo la adaptación a nuevos tipos de defectos, condiciones y configuraciones multicámara.

Link to this sectionPuntos clave#

Construir un sistema de inspección visual basado en cámaras no tiene por qué ser complejo ni requerir una profunda experiencia en IA. Con Ultralytics Platform, puedes pasar de datos brutos a un sistema funcional y monitorizar su rendimiento, todo en un solo lugar. Esto agiliza la forma en que se construyen, mejoran y ejecutan los sistemas de inspección en entornos reales.

Únete a nuestra comunidad y explora nuestro repositorio de GitHub para aprender más sobre IA de visión. Echa un vistazo a nuestras opciones de licencia para poner en marcha tus proyectos de visión artificial. ¿Te interesan innovaciones como la IA en la fabricación o la visión artificial en la automoción? Visita nuestras páginas de soluciones para descubrir más.